0 遇到过得反爬虫策略以及解决方法?

- 1.通过headers反爬虫

- 基于用户行为的发爬虫:(同一IP短时间内访问的频率)

- 动态网页反爬虫(通过ajax请求数据,或者通过JavaScript生成)

- 对部分数据进行加密处理的(数据是乱码)

解决方法:

对于基本网页的抓取可以自定义headers,添加headers的数据 使用多个代理ip进行抓取或者设置抓取的频率降低一些, 动态网页的可以使用selenium + phantomjs 进行抓取 对部分数据进行加密的,可以使用selenium进行截图,使用python自带的pytesseract库进行识别,但是比较慢最直接的方法是找到加密的方法进行逆向推理。

1 urllib 和 urllib2 的区别?

- urllib 和urllib2都是接受URL请求的相关模块,但是urllib2可以接受一个Request类的实例来设置URL请求的headers,urllib仅可以接受URL。urllib不可以伪装你的User-Agent字符串。

- urllib提供urlencode()方法用来GET查询字符串的产生,而urllib2没有。这是为何urllib常和urllib2一起使用的原因。

2 列举网络爬虫所用到的网络数据包,解析包?

- 网络数据包 urllib、urllib2、requests

- 解析包 re、xpath、beautiful soup、lxml

3 简述一下爬虫的步骤?

- 确定需求;

- 确定资源;

- 通过url获取网站的返回数据;

- 定位数据;

- 存储数据。

4 遇到反爬机制怎么处理?

反爬机制:

headers方向 判断User-Agent、判断Referer、判断Cookie。将浏览器的headers信息全部添加进去 注意:Accept-Encoding;gzip,deflate需要注释掉

5 常见的HTTP方法有哪些?

- GET:请求指定的页面信息,返回实体主体;

- HEAD:类似于get请求,只不过返回的响应中没有具体的内容,用于捕获报头;

- POST:向指定资源提交数据进行处理请求(比如表单提交或者上传文件),。数据被包含在请求体中。

- PUT:从客户端向服务端传送数据取代指定的文档的内容;

- DELETE:请求删除指定的页面;

- CONNNECT:HTTP1.1协议中预留给能够将连接方式改为管道方式的代理服务器;

- OPTIONS:允许客户端查看服务器的性能;TRACE:回显服务器的请求,主要用于测试或者诊断。

6 说一说redis-scrapy中redis的作用?

它是将scrapy框架中Scheduler替换为redis数据库,实现队列管理共享。

优点:

- 可以充分利用多台机器的带宽;

- 可以充分利用多台机器的IP地址。

7 遇到的反爬虫策略以及解决方法?

- 通过headers反爬虫:自定义headers,添加网页中的headers数据。

- 基于用户行为的反爬虫(封IP):可以使用多个代理IP爬取或者将爬取的频率降低。

- 动态网页反爬虫(JS或者Ajax请求数据):动态网页可以使用 selenium + phantomjs 抓取。

- 对部分数据加密处理(数据乱码):找到加密方法进行逆向推理。

8 如果让你来防范网站爬虫,你应该怎么来提高爬取的难度 ?

- 判断headers的User-Agent;

- 检测同一个IP的访问频率;

- 数据通过Ajax获取;

- 爬取行为是对页面的源文件爬取,如果要爬取静态网页的html代码,可以使用jquery去模仿写html。

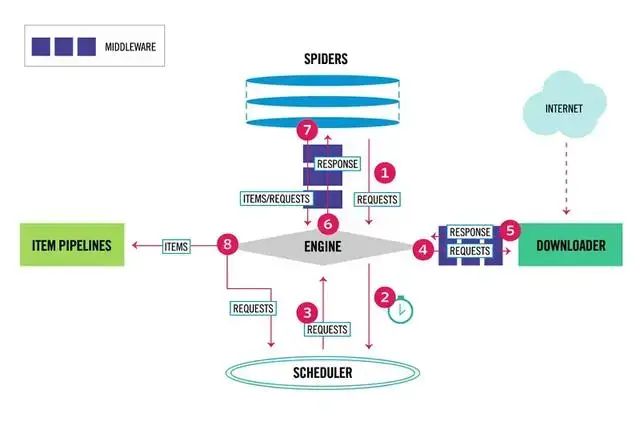

9 scrapy分为几个组成部分?分别有什么作用?

分为5个部分;Spiders(爬虫类),Scrapy Engine(引擎),Scheduler(调度器),Downloader(下载器),Item Pipeline(处理管道)。

- Spiders:开发者自定义的一个类,用来解析网页并抓取指定url返回的内容。

- Scrapy Engine:控制整个系统的数据处理流程,并进行事务处理的触发。

- Scheduler:接收Engine发出的requests,并将这些requests放入到处理列队中,以便之后engine需要时再提供。

- Download:抓取网页信息提供给engine,进而转发至Spiders。

- Item Pipeline:负责处理Spiders类提取之后的数据。比如清理HTML数据、验证爬取的数据(检查item包含某些字段)、查重(并丢弃)、将爬取结果保存到数据库中

10 简述一下scrapy的基本流程?

scrapy分为9个步骤:

- Spiders需要初始的start_url或则函数stsrt_requests,会在内部生成Requests给Engine;

- Engine将requests发送给Scheduler;

- Engine从Scheduler那获取requests,交给Download下载;

- 在交给Dowmload过程中会经过Downloader Middlewares(经过process_request函数);

- Dowmloader下载页面后生成一个response,这个response会传给Engine,这个过程中又经过了Downloader Middlerwares(经过process_request函数),在传送中出错的话经过process_exception函数;

- Engine将从Downloader那传送过来的response发送给Spiders处理,这个过程经过Spiders Middlerwares(经过process_spider_input函数);

- Spiders处理这个response,返回Requests或者Item两个类型,传给Engine,这个过程又经过Spiders Middlewares(经过porcess_spider_output函数);

- Engine接收返回的信息,如果使Item,将它传给Items Pipeline中;如果是Requests,将它传给Scheduler,继续爬虫;

- 重复第三步,直至没有任何需要爬取的数据

关于python的资料,小伙伴可以私信我“113”噢