- 深入解析LangChain框架:使用Python开发LLM应用的全生命周期指南

m0_57781768

langchainpython网络

深入解析LangChain框架:使用Python开发LLM应用的全生命周期指南前言在当前的人工智能浪潮中,大型语言模型(LLM)已成为众多应用的核心。LangChain是一个专为开发大型语言模型应用而设计的框架,它简化了LLM应用的整个生命周期,包括开发、生产化和部署。本文将详细介绍LangChain框架的各个方面,涵盖其核心组件、第三方集成、开发教程、API参考等,并通过实际案例展示如何使用La

- L8打卡学习笔记

无涯学徒1998

学习笔记支持向量机

本文为365天深度学习训练营中的学习记录博客原作者:K同学啊SVM与集成学习SVMSVM线性模型SVM非线性模型SVM常用参数集成学习随机森林导入数据查看数据信息数据分析随机森林模型预测结果结果分析个人总结SVM超平面:SVM在特征空间中寻找一个能够最大化类别间隔的超平面,称为最大间隔超平面。这个超平面就是将数据集分成不同类别的边界。支持向量:支持向量是离分隔超平面最近的样本点,它们决定了超平面的

- P5学习笔记

无涯学徒1998

pythonpytorch

本文为365天深度学习训练营中的学习记录博客原作者:K同学啊运动鞋品牌识别设置GPU导入数据构建CNN模型编写训练函数编写测试函数设置动态学习率等间隔动态调整自定义调整多间隔调整余弦退火正式训练结果可视化使用模型进行预测个人总结设置GPUimporttorchimporttorch.nnasnnimporttorchvision.transformsastransformsimporttorchv

- 深度学习中高斯噪声:为什么以及如何使用

小白学视觉

深度学习人工智能

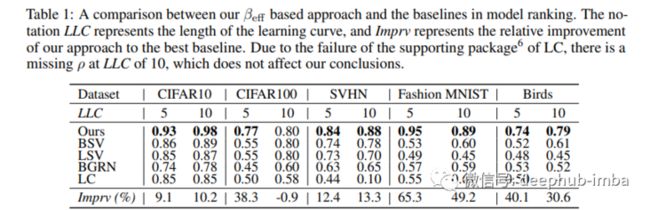

点击上方“小白学视觉”,选择加"星标"或“置顶”重磅干货,第一时间送达来源:DeepHubIMBA本文约1800字,建议阅读8分钟高斯噪声是深度学习中用于为输入数据或权重添加随机性的一种技术。在数学上,高斯噪声是一种通过向输入数据添加均值为零和标准差(σ)的正态分布随机值而产生的噪声。正态分布,也称为高斯分布,是一种连续概率分布,由其概率密度函数(PDF)定义:pdf(x)=(1/(σ*sqrt(

- 智能推理的革命:DeepSeek-R1 深度解析其算法与实现

步子哥

算法人工智能

在人工智能(AI)领域,语言模型(LargeLanguageModels,LLMs)正以惊人的速度发展,变得越来越智能,能够理解和生成复杂的语言内容。然而,尽管现有的模型在许多任务上表现出色,它们在深度推理和逻辑思维方面仍有显著的提升空间。DeepSeek-R1的出现,正是为了解决这一问题,通过强化学习(ReinforcementLearning,RL)赋予语言模型更强大的推理能力,开创了LLMs

- 《从传统到智能:大模型交换机的变革之路》

烁月_o9

数据库服务器运维web安全安全

大模型交换机是一种专门为大规模人工智能模型提供网络和计算资源调度的硬件设备。以下是关于它的详细介绍:特点高带宽和低延迟:大模型的训练和推理通常需要处理大量的数据,高带宽可以确保数据在各个计算节点之间快速传输,低延迟则能减少数据传输过程中可能出现的瓶颈,提高训练和推理的效率。智能路由与数据调度:基于AI算法的调度机制,能够动态地调整数据传输路径,以应对不同网络条件和负载的变化,避免某些节点的拥塞,确

- 深度学习|表示学习|卷积神经网络|由参数共享引出的特征图|08

漂亮_大男孩

表示学习深度学习学习cnn

如是我闻:FeatureMap(特征图)的概念与ParameterSharing(参数共享)密切相关。换句话说,参数共享是生成FeatureMap的基础。FeatureMap是卷积操作的核心产物,而卷积操作的高效性正是由参数共享带来的。下面我们详细看一下FeatureMap和ParameterSharing之间的关系:1.什么是FeatureMap?定义:FeatureMap是卷积操作生成的输出结

- 探秘FreeMovie:一个开源的电影推荐系统

孟振优Harvester

探秘FreeMovie:一个开源的电影推荐系统去发现同类优质开源项目:https://gitcode.com/项目简介是一个基于深度学习的开源电影推荐系统,由pojiezhiyuanjun开发并维护。该项目的目标是为用户提供个性化的电影推荐服务,通过机器学习算法理解用户的观影偏好,并据此进行智能推荐。技术分析FreeMovie的核心架构包括以下关键组件:数据处理-项目采用Hadoop进行大数据预处

- 『大模型笔记』AI自动化编程工具汇总[持续更新ING]!

AI大模型前沿研究

大模型笔记大模型AI自动化工具bolt.newCursorV0

『大模型笔记』AI自动化编程工具汇总!文章目录一.Bolt.new(开源AI驱动全栈Web开发工具)1.1.Bolt.new介绍1.2.编程小白如何打造自己的导航网站二.Cursor(人工智能代码编辑器)2.1.Cursor入门教程2.2.Cursor左侧布局设置和VSCode一样2.3.Cursor效率之道:Agent模式+7大高级技巧详解三.Windsurf(颠覆Cursor的全新工具)3.1

- Topaz Video AI——视频修复

爱研究的小牛

AIGC—视频AIGC

一、TopazVideoAI介绍及使用TopazVideoAI是一款基于人工智能的视频增强和修复软件,主要用于提升视频质量、去噪、插帧和分辨率提升。它利用深度学习技术对视频进行智能化处理,使得视频看起来更加清晰和流畅。TopazVideoAI特别适合那些需要修复旧视频、提升低分辨率视频质量的用户。二、TopazVideoAI的主要功能视频去噪:通过AI模型去除视频中的噪点,使画面更加干净。分辨率提

- RPA真的是人工智能吗?

微刻时光

RPA加油站rpa人工智能

1.RPA与AI的定义与区别1.1RPA的定义与特点机器人流程自动化(RoboticProcessAutomation,简称RPA)是一种软件技术,它通过模拟人类用户的操作行为来自动执行重复性、基于规则的任务。RPA的核心特点包括:非侵入性:RPA作为外挂工具部署在客户现有系统上,不影响原有IT基础架构。基于规则的操作:RPA流程必须有明确的、可被数字化的触发指令和输入,不允许出现无法提前定义的例

- 影刀 RPA:企业数字化转型的强大引擎

RPA李老师

rpa

一、影刀RPA是什么影刀RPA是一种基于机器学习和人工智能技术的自动化工具,它在当今数字化时代发挥着重要作用。影刀RPA是一款软件机器人,能模拟人的各种操作,在任何应用程式上进行鼠标点击、键盘输入、读取信息等自动化操作,释放人非主观决策、逻辑性高、规则性强的工作。在了解影刀RPA之前,我们先来认识一下RPA。RPA是RoboticProcessAutomation(机器人流程自动化)的简称,201

- 浅析AI大模型现状及其应用,零基础入门到精通,收藏这篇就够了

程序员_大白

互联网程序员大模型人工智能数据挖掘大模型

随着人工智能技术的迅猛发展,AI大模型已经成为全球科技竞争的焦点,展现出巨大的发展潜力和广阔的应用前景。AI大模型的应用落地正引发行业关注,技术进步正促使AI大模型的应用逐步从云端向终端设备延伸,从通用模型向针对特定行业的定制化解决方案转变,其商业潜力和对行业的影响不断增强。与此同时,国内外企业在大模型领域的竞争日趋激烈。AI大模型蓬勃发展AI大模型主要特征AI大模型具有泛化性(知识迁移到新领域)

- 【PLPR】Progressive Learning for Person Re-Identification with One Example

南风楠

PersonRe-IDOne-shotLearningFew-shotLearning深度学习机器学习神经网络

【PLPR】ProgressiveLearningforPersonRe-IdentificationwithOneExampleBibtexPublicinformationFieldsCodelinkMainworkKeytechnologyFrameworkDatasetResultsAlgorithmOthers论文下载:关注下方公众号,回复“PLPR”即可获得论文原文Bibtex@art

- 【自然语言处理(NLP)】jieba分词的使用(分词模式、关键词提取)

道友老李

自然语言处理(NLP)自然语言处理人工智能

文章目录介绍jieba分词的使用1.安装2.jieba分词模式2.1精确模式2.2全模式2.3搜索引擎模式2.4词性标注2.5加载自己的分词文件3.查看词频4.关键词提取个人主页:道友老李欢迎加入社区:道友老李的学习社区介绍**自然语言处理(NaturalLanguageProcessing,NLP)**是计算机科学领域与人工智能领域中的一个重要方向。它研究的是人类(自然)语言与计算机之间的交互。

- 【深度学习|变化检测孪生网络】基于共享权重的双流 U-Net 变化检测网络架构,附代码(一)

努力学习的大大

深度学习基础深度学习网络架构人工智能python

【深度学习|变化检测孪生网络】基于共享权重的双流U-Net变化检测网络架构,附代码(一)【深度学习|变化检测孪生网络】基于共享权重的双流U-Net变化检测网络架构,附代码(一)文章目录【深度学习|变化检测孪生网络】基于共享权重的双流U-Net变化检测网络架构,附代码(一)基于共享权重的双流U-Net变化检测网络架构1.双流网络(SiameseNetwork)概述2.双流网络的应用——变化检测3.U

- 【2025优质学术推荐】征稿控制科学、仪器、智能系统、通信、计算机、电子信息、人工智能、大数据、机器学习、软件工程、网络安全方向

努力学习的大大

学术会议推荐人工智能大数据深度学习神经网络

【2025优质学术推荐】征稿控制科学、仪器、智能系统、通信、计算机、电子信息、人工智能、大数据、机器学习、软件工程、网络安全方向【2025优质学术推荐】征稿控制科学、仪器、智能系统、通信、计算机、电子信息、人工智能、大数据、机器学习、软件工程、网络安全方向文章目录【2025优质学术推荐】征稿控制科学、仪器、智能系统、通信、计算机、电子信息、人工智能、大数据、机器学习、软件工程、网络安全方向2025

- 【深度学习|迁移学习】Wasserstein距离度量和跨域原型一致性损失(CPC Loss)如何计算?以及Wasserstein距离和CPC Loss结合的对抗训练示例,附代码(二)

努力学习的大大

深度学习基础深度学习迁移学习人工智能python

【深度学习|迁移学习】Wasserstein距离度量和跨域原型一致性损失(CPCLoss)如何计算?以及Wasserstein距离和CPCLoss结合的对抗训练示例,附代码(二)【深度学习|迁移学习】Wasserstein距离度量和跨域原型一致性损失(CPCLoss)如何计算?以及Wasserstein距离和CPCLoss结合的对抗训练示例,附代码(二)文章目录【深度学习|迁移学习】Wassers

- 2025年新出炉的MySQL面试题

长风清留扬

150道MySQL高频面试题mysql数据库面试sql

作者简介:CSDN\阿里云\腾讯云\华为云开发社区优质创作者,专注分享大数据、Python、数据库、人工智能等领域的优质内容个人主页:长风清留杨的博客形式准则:无论成就大小,都保持一颗谦逊的心,尊重他人,虚心学习。✨推荐专栏:Python入门到入魔,Mysql入门到入魔,Python入门基础大全,Flink入门到实战若缘分至此,无法再续相逢,愿你朝朝暮暮,皆有安好,晨曦微露道早安,日中炽热说午安,

- 精选了几道MySQL的大厂面试题,被提问的几率很高!

长风清留扬

150道MySQL高频面试题mysqlandroid数据库面试学习MySQL面试

作者简介:CSDN\阿里云\腾讯云\华为云开发社区优质创作者,专注分享大数据、Python、数据库、人工智能等领域的优质内容个人主页:长风清留杨的博客形式准则:无论成就大小,都保持一颗谦逊的心,尊重他人,虚心学习。✨推荐专栏:Python入门到入魔,Mysql入门到入魔,Python入门基础大全,Flink入门到实战若缘分至此,无法再续相逢,愿你朝朝暮暮,皆有安好,晨曦微露道早安,日中炽热说午安,

- 【OTFS与信号处理:论文阅读1】:考虑分数多普勒的OTFS系统有效信道估计(24.01.16更新)

Cuby!

OTFS论文学习信号处理论文阅读人工智能

2023.06.05最近在研究OTFS考虑分数多普勒时信道估计与信号检测相关问题,最近精读了一篇论文,并针对论文中部分公式进行推导,故记录一下学习过程。【OTFS与信号处理:论文阅读1】EfficientChannelEstimationforOTFSSystemsinthePresenceofFractionalDoppler前言一、摘要及背景摘要分数多普勒的引入估计分数多普勒的意义研究现状二、

- 2024 年 MathorCup 数学应用挑战赛——大数据竞赛 赛道 B:电商品类货量预测及品类分仓规划 思路和代码 持续更新中

2025年数学建模美赛

数学建模2024年大数据第五届MathorCupB题

2024年所有数学建模类比赛的个人思路和代码都会发布到专栏内,会结合最新的chatgpt发布思路,开赛一天后恢复原价99,不代写论文,不回复私信.没有群,只需订阅一次目录问题分析与解决思路问题1:货量预测模型问题2:一品一仓分仓规划问题3:一品多仓分仓规划总结这类大数据竞赛的重点在于构建一个全面的预测和优化模型,通过数据处理、时间序列分析以及运筹优化来完成货量预测和分仓规划。下面是一个解决问题的整

- 从 TCP/IP 演进看按序流与性能

dog250

tcp/ip网络协议网络

前面谈到互联网从早期对等通信模型转入后来内容分发模型后的一系列问题,诸如拥塞,安全等,本文谈谈关于性能的更普遍方面。TCP/IP祖师爷1974年的开山论文AProtocolforPacketNetworkIntercommunication以及随后RFC675,标志着TCP/IP的正式诞生,在此之前还有一个里程碑事件,即RFC33NCP标准化。RFC33解决了分布式通信问题,而RFC675解决了异

- 2025数学建模美赛B题完整建模思路——管理可持续旅游业

鹿鹿数模

数学建模

2025MCM问题B:管理可持续旅游业以下是我们对该题目的赛题分析,由于完整内容过长,因此在此处放出部分内容,欢迎从文末小卡片处加群获取。赛题分析以下内容包括三个主要部分:(1)题目的中文翻译(2)对题目的整体分析与思路综述(3)对题目要求的逐项详细分析与求解思路。本文的撰写将综合运用多元的数学模型、算法以及机器学习/深度学习的方法,并在必要时给出题外假设与可行的创新性思路,以期为参赛者提供较为系

- 使用YOLOv8训练一个无人机(UAV)检测模型,深度学习目标检测中_并开发一个完整的系统 yolov8来训练无人机数据集并检测无人机

QQ_767172261

无人及视角YOLO无人机深度学习

使用YOLOv8训练一个无人机(UAV)检测模型,深度学习目标检测中_并开发一个完整的系统yolov8来训练无人机数据集并检测无人机无人机数据集,yolo格式种类为uav,一共近5w张图片,如何用yolov8代码训练无人机检测数据集文章目录以下文章及内容仅供参考。1.环境部署2.数据预处理数据集准备划分数据集3.模型定义4.训练模型5.评估模型6.结果分析与可视化7.集成与部署PyQt6GUI(`

- 智能运维分析决策系统:赋能数字化转型的智慧引擎

我的运维人生

运维运维开发技术共享

智能运维分析决策系统:赋能数字化转型的智慧引擎在数字化转型的大潮中,企业运维管理正经历着从传统手动运维向智能化、自动化运维的深刻转变。智能运维分析决策系统(AIOps,ArtificialIntelligenceforITOperations)作为这一转变的核心驱动力,通过融合大数据、机器学习、人工智能等先进技术,实现了对运维数据的深度洞察与智能决策,极大地提升了运维效率与质量,为企业数字业务的连

- ChatGPT是强人工智能吗?

呵呵爱吃菜

chatgpt人工智能

ChatGPT是强人工智能吗?本文从人工智能发展的三个阶段的角度,分析当前强大的AI大模型所处的阶段,并通过对比各阶段的定义,明确各阶段的特点和未来发展方向;NarrowAI(弱人工智能)、AGI(人工通用智能)和ASI(人工超级智能)代表了人工智能发展的三个不同阶段,它们在智能水平、任务范围和应用场景上存在显著差异。以下是它们的总结与对比:1.定义与特点类型NarrowAI(弱人工智能)AGI(

- ESG资料大全(部分更新2024):数据+工具变量+论文复现

经管数据库

人工智能大数据物联网

资源介绍ESG是Environmental(环境)、Social(社会责任)、Governance(公司治理)3个英文单词的首字母缩写,是一种评价企业可持续性的指标及框架。不同于传统上对于企业财务绩效的评价,ESG是一种关注企业环境、社会责任和公司治理绩效的投资理念和企业评价标准。政府监管机构和投资者可以通过对企业ESG绩效的观察,评价投资对象在促进环境保护、促进经济可持续发展和履行社会责任等方面

- AlphaFold2的思路总结(十五)

xiaofengzihhh

蛋白质结构预测深度学习人工智能神经网络

2021SC@SDUSC这学期的代码分析工作接近尾声了,我想简单总结一下AlphaFold2的总体思路 具体来看,AlphaFold2主要利用多序列比对(MSA),把蛋白质的结构和生物信息整合到了深度学习算法中。它主要包括两个部分:神经网络EvoFormer和结构模块(Structuremodule)。一、EvoFormer 在EvoFormer中,主要是将图网络(Graphnetworks)

- python机器学习

方安乐

pythonpython机器学习人工智能

Python机器学习是当前最为热门的机器学习领域之一,其简洁、易用、高效的特点,让越来越多的开发者开始探索其应用。本文将从以下几个方面介绍Python机器学习的基础知识和实践案例,帮助读者更好地理解和应用机器学习技术。前提Python机器学习的应用领域A.图像识别和计算机视觉B.自然语言处理和文本分析C.数据挖掘和推荐系统深度学习A.神经网络的基本原理B.常用的深度学习框架和算法C.深度学习在图像

- 戴尔笔记本win8系统改装win7系统

sophia天雪

win7戴尔改装系统win8

戴尔win8 系统改装win7 系统详述

第一步:使用U盘制作虚拟光驱:

1)下载安装UltraISO:注册码可以在网上搜索。

2)启动UltraISO,点击“文件”—》“打开”按钮,打开已经准备好的ISO镜像文

- BeanUtils.copyProperties使用笔记

bylijinnan

java

BeanUtils.copyProperties VS PropertyUtils.copyProperties

两者最大的区别是:

BeanUtils.copyProperties会进行类型转换,而PropertyUtils.copyProperties不会。

既然进行了类型转换,那BeanUtils.copyProperties的速度比不上PropertyUtils.copyProp

- MyEclipse中文乱码问题

0624chenhong

MyEclipse

一、设置新建常见文件的默认编码格式,也就是文件保存的格式。

在不对MyEclipse进行设置的时候,默认保存文件的编码,一般跟简体中文操作系统(如windows2000,windowsXP)的编码一致,即GBK。

在简体中文系统下,ANSI 编码代表 GBK编码;在日文操作系统下,ANSI 编码代表 JIS 编码。

Window-->Preferences-->General -

- 发送邮件

不懂事的小屁孩

send email

import org.apache.commons.mail.EmailAttachment;

import org.apache.commons.mail.EmailException;

import org.apache.commons.mail.HtmlEmail;

import org.apache.commons.mail.MultiPartEmail;

- 动画合集

换个号韩国红果果

htmlcss

动画 指一种样式变为另一种样式 keyframes应当始终定义0 100 过程

1 transition 制作鼠标滑过图片时的放大效果

css

.wrap{

width: 340px;height: 340px;

position: absolute;

top: 30%;

left: 20%;

overflow: hidden;

bor

- 网络最常见的攻击方式竟然是SQL注入

蓝儿唯美

sql注入

NTT研究表明,尽管SQL注入(SQLi)型攻击记录详尽且为人熟知,但目前网络应用程序仍然是SQLi攻击的重灾区。

信息安全和风险管理公司NTTCom Security发布的《2015全球智能威胁风险报告》表明,目前黑客攻击网络应用程序方式中最流行的,要数SQLi攻击。报告对去年发生的60亿攻击 行为进行分析,指出SQLi攻击是最常见的网络应用程序攻击方式。全球网络应用程序攻击中,SQLi攻击占

- java笔记2

a-john

java

类的封装:

1,java中,对象就是一个封装体。封装是把对象的属性和服务结合成一个独立的的单位。并尽可能隐藏对象的内部细节(尤其是私有数据)

2,目的:使对象以外的部分不能随意存取对象的内部数据(如属性),从而使软件错误能够局部化,减少差错和排错的难度。

3,简单来说,“隐藏属性、方法或实现细节的过程”称为——封装。

4,封装的特性:

4.1设置

- [Andengine]Error:can't creat bitmap form path “gfx/xxx.xxx”

aijuans

学习Android遇到的错误

最开始遇到这个错误是很早以前了,以前也没注意,只当是一个不理解的bug,因为所有的texture,textureregion都没有问题,但是就是提示错误。

昨天和美工要图片,本来是要背景透明的png格式,可是她却给了我一个jpg的。说明了之后她说没法改,因为没有png这个保存选项。

我就看了一下,和她要了psd的文件,还好我有一点

- 自己写的一个繁体到简体的转换程序

asialee

java转换繁体filter简体

今天调研一个任务,基于java的filter实现繁体到简体的转换,于是写了一个demo,给各位博友奉上,欢迎批评指正。

实现的思路是重载request的调取参数的几个方法,然后做下转换。

- android意图和意图监听器技术

百合不是茶

android显示意图隐式意图意图监听器

Intent是在activity之间传递数据;Intent的传递分为显示传递和隐式传递

显式意图:调用Intent.setComponent() 或 Intent.setClassName() 或 Intent.setClass()方法明确指定了组件名的Intent为显式意图,显式意图明确指定了Intent应该传递给哪个组件。

隐式意图;不指明调用的名称,根据设

- spring3中新增的@value注解

bijian1013

javaspring@Value

在spring 3.0中,可以通过使用@value,对一些如xxx.properties文件中的文件,进行键值对的注入,例子如下:

1.首先在applicationContext.xml中加入:

<beans xmlns="http://www.springframework.

- Jboss启用CXF日志

sunjing

logjbossCXF

1. 在standalone.xml配置文件中添加system-properties:

<system-properties> <property name="org.apache.cxf.logging.enabled" value=&

- 【Hadoop三】Centos7_x86_64部署Hadoop集群之编译Hadoop源代码

bit1129

centos

编译必需的软件

Firebugs3.0.0

Maven3.2.3

Ant

JDK1.7.0_67

protobuf-2.5.0

Hadoop 2.5.2源码包

Firebugs3.0.0

http://sourceforge.jp/projects/sfnet_findbug

- struts2验证框架的使用和扩展

白糖_

框架xmlbeanstruts正则表达式

struts2能够对前台提交的表单数据进行输入有效性校验,通常有两种方式:

1、在Action类中通过validatexx方法验证,这种方式很简单,在此不再赘述;

2、通过编写xx-validation.xml文件执行表单验证,当用户提交表单请求后,struts会优先执行xml文件,如果校验不通过是不会让请求访问指定action的。

本文介绍一下struts2通过xml文件进行校验的方法并说

- 记录-感悟

braveCS

感悟

再翻翻以前写的感悟,有时会发现自己很幼稚,也会让自己找回初心。

2015-1-11 1. 能在工作之余学习感兴趣的东西已经很幸福了;

2. 要改变自己,不能这样一直在原来区域,要突破安全区舒适区,才能提高自己,往好的方面发展;

3. 多反省多思考;要会用工具,而不是变成工具的奴隶;

4. 一天内集中一个定长时间段看最新资讯和偏流式博

- 编程之美-数组中最长递增子序列

bylijinnan

编程之美

import java.util.Arrays;

import java.util.Random;

public class LongestAccendingSubSequence {

/**

* 编程之美 数组中最长递增子序列

* 书上的解法容易理解

* 另一方法书上没有提到的是,可以将数组排序(由小到大)得到新的数组,

* 然后求排序后的数组与原数

- 读书笔记5

chengxuyuancsdn

重复提交struts2的token验证

1、重复提交

2、struts2的token验证

3、用response返回xml时的注意

1、重复提交

(1)应用场景

(1-1)点击提交按钮两次。

(1-2)使用浏览器后退按钮重复之前的操作,导致重复提交表单。

(1-3)刷新页面

(1-4)使用浏览器历史记录重复提交表单。

(1-5)浏览器重复的 HTTP 请求。

(2)解决方法

(2-1)禁掉提交按钮

(2-2)

- [时空与探索]全球联合进行第二次费城实验的可能性

comsci

二次世界大战前后,由爱因斯坦参加的一次在海军舰艇上进行的物理学实验 -费城实验

至今给我们大家留下很多迷团.....

关于费城实验的详细过程,大家可以在网络上搜索一下,我这里就不详细描述了

在这里,我的意思是,现在

- easy connect 之 ORA-12154: TNS: 无法解析指定的连接标识符

daizj

oracleORA-12154

用easy connect连接出现“tns无法解析指定的连接标示符”的错误,如下:

C:\Users\Administrator>sqlplus username/

[email protected]:1521/orcl

SQL*Plus: Release 10.2.0.1.0 – Production on 星期一 5月 21 18:16:20 2012

Copyright (c) 198

- 简单排序:归并排序

dieslrae

归并排序

public void mergeSort(int[] array){

int temp = array.length/2;

if(temp == 0){

return;

}

int[] a = new int[temp];

int

- C语言中字符串的\0和空格

dcj3sjt126com

c

\0 为字符串结束符,比如说:

abcd (空格)cdefg;

存入数组时,空格作为一个字符占有一个字节的空间,我们

- 解决Composer国内速度慢的办法

dcj3sjt126com

Composer

用法:

有两种方式启用本镜像服务:

1 将以下配置信息添加到 Composer 的配置文件 config.json 中(系统全局配置)。见“例1”

2 将以下配置信息添加到你的项目的 composer.json 文件中(针对单个项目配置)。见“例2”

为了避免安装包的时候都要执行两次查询,切记要添加禁用 packagist 的设置,如下 1 2 3 4 5

- 高效可伸缩的结果缓存

shuizhaosi888

高效可伸缩的结果缓存

/**

* 要执行的算法,返回结果v

*/

public interface Computable<A, V> {

public V comput(final A arg);

}

/**

* 用于缓存数据

*/

public class Memoizer<A, V> implements Computable<A,

- 三点定位的算法

haoningabc

c算法

三点定位,

已知a,b,c三个顶点的x,y坐标

和三个点都z坐标的距离,la,lb,lc

求z点的坐标

原理就是围绕a,b,c 三个点画圆,三个圆焦点的部分就是所求

但是,由于三个点的距离可能不准,不一定会有结果,

所以是三个圆环的焦点,环的宽度开始为0,没有取到则加1

运行

gcc -lm test.c

test.c代码如下

#include "stdi

- epoll使用详解

jimmee

clinux服务端编程epoll

epoll - I/O event notification facility在linux的网络编程中,很长的时间都在使用select来做事件触发。在linux新的内核中,有了一种替换它的机制,就是epoll。相比于select,epoll最大的好处在于它不会随着监听fd数目的增长而降低效率。因为在内核中的select实现中,它是采用轮询来处理的,轮询的fd数目越多,自然耗时越多。并且,在linu

- Hibernate对Enum的映射的基本使用方法

linzx0212

enumHibernate

枚举

/**

* 性别枚举

*/

public enum Gender {

MALE(0), FEMALE(1), OTHER(2);

private Gender(int i) {

this.i = i;

}

private int i;

public int getI

- 第10章 高级事件(下)

onestopweb

事件

index.html

<!DOCTYPE html PUBLIC "-//W3C//DTD XHTML 1.0 Transitional//EN" "http://www.w3.org/TR/xhtml1/DTD/xhtml1-transitional.dtd">

<html xmlns="http://www.w3.org/

- 孙子兵法

roadrunners

孙子兵法

始计第一

孙子曰:

兵者,国之大事,死生之地,存亡之道,不可不察也。

故经之以五事,校之以计,而索其情:一曰道,二曰天,三曰地,四曰将,五

曰法。道者,令民于上同意,可与之死,可与之生,而不危也;天者,阴阳、寒暑

、时制也;地者,远近、险易、广狭、死生也;将者,智、信、仁、勇、严也;法

者,曲制、官道、主用也。凡此五者,将莫不闻,知之者胜,不知之者不胜。故校

之以计,而索其情,曰

- MySQL双向复制

tomcat_oracle

mysql

本文包括:

主机配置

从机配置

建立主-从复制

建立双向复制

背景

按照以下简单的步骤:

参考一下:

在机器A配置主机(192.168.1.30)

在机器B配置从机(192.168.1.29)

我们可以使用下面的步骤来实现这一点

步骤1:机器A设置主机

在主机中打开配置文件 ,

- zoj 3822 Domination(dp)

阿尔萨斯

Mina

题目链接:zoj 3822 Domination

题目大意:给定一个N∗M的棋盘,每次任选一个位置放置一枚棋子,直到每行每列上都至少有一枚棋子,问放置棋子个数的期望。

解题思路:大白书上概率那一张有一道类似的题目,但是因为时间比较久了,还是稍微想了一下。dp[i][j][k]表示i行j列上均有至少一枚棋子,并且消耗k步的概率(k≤i∗j),因为放置在i+1~n上等价与放在i+1行上,同理