springboot整合canal实现对mysql数据库实时监控

canal

-

-

- Canal介绍

- Mysql环境准备

- 安装canal

- springboot整合canal

-

Canal介绍

官网地址:https://github.com/alibaba/canal

canal [kə’næl],译意为水道/管道/沟渠,主要用途是基于 MySQL 数据库增量日志解析,提供增量数据订阅和消费

早期阿里巴巴因为杭州和美国双机房部署,存在跨机房同步的业务需求,实现方式主要是基于业务 trigger 获取增量变更。从 2010 年开始,业务逐步尝试数据库日志解析获取增量变更进行同步,由此衍生出了大量的数据库增量订阅和消费业务。

基于日志增量订阅和消费的业务包括

数据库镜像

数据库实时备份

索引构建和实时维护(拆分异构索引、倒排索引等)

业务 cache 刷新

带业务逻辑的增量数据处理

当前的 canal 支持源端 MySQL 版本包括 5.1.x , 5.5.x , 5.6.x , 5.7.x , 8.0.x

Mysql环境准备

使用mysql5.1.x以上,我的mysql是8.0,27目前最新版

Mysql的安装可以去直接看教程windows安装mysql8.0.27

步骤1:创建一个canal用户,用来监控

-- 使用命令登录:mysql -u root -p

-- 创建用户 用户名:canal 密码:canal

create user 'canal'@'%' identified by 'canal';

-- 授权 *.*表示所有库

grant SELECT, REPLICATION SLAVE, REPLICATION CLIENT on *.* to 'canal'@'%';

-- 删除用户

drop user 'canal'@'%';

注意:因为我的mysql是8.0.27最新版,与之前的mysql版本相比,创建账号和赋予权限的方式已经分开,如果你们用的不是最新的mysql,创建用户和赋予权限方式不是我这样,以下是之前的方式

-- 使用命令登录:mysql -u root -p

-- 创建用户 用户名:canal 密码:canal

create user 'canal'@'%' identified by 'canal';

-- 授权 *.*表示所有库

grant SELECT, REPLICATION SLAVE, REPLICATION CLIENT on *.* to 'canal'@'%' identified by 'canal';

步骤2:在Mysql配置文件my,ini,添加以下内容:

[mysqld]

# 打开binlog

log-bin=mysql-bin

# 选择ROW(行)模式

binlog-format=ROW

# 配置MySQL replaction需要定义,不要和canal的slaveId重复

server_id=1

步骤3:修改之后,重启mysql,使用以下命令查看所需要的信息

- 查看是否打开binlog模式

-- 查看是否打开binlog模式

show VARIABLES like '%log_bin%'

- 查看binlog日志文件列表

-- 查看binlog日志文件列表

show binary logs;

- 查看当前正在写入的binlog文件

-- 查看当前正在写入的binlog文件

show master status;

安装canal

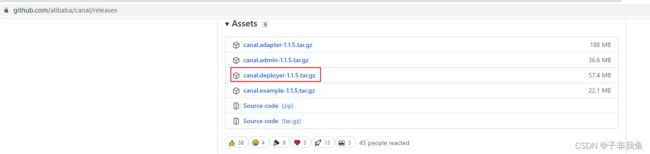

步骤1:资源下载

下载地址:https://github.com/alibaba/canal/releases

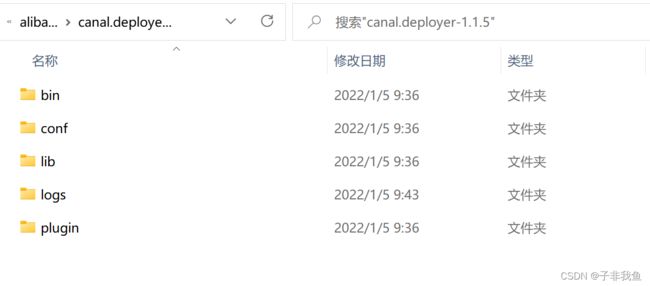

步骤2:解压下载好的资源(canal.deployer-1.1.5.tar.gz),到指定目录(随意)

步骤3:打开conf/example/instance.properties文件

- 未修改前

#################################################

## mysql serverId , v1.0.26+ will autoGen

# canal.instance.mysql.slaveId=0

# enable gtid use true/false

canal.instance.gtidon=false

# position info

canal.instance.master.address=127.0.0.1:3306

canal.instance.master.journal.name=

canal.instance.master.position=

canal.instance.master.timestamp=

canal.instance.master.gtid=

# rds oss binlog

canal.instance.rds.accesskey=

canal.instance.rds.secretkey=

canal.instance.rds.instanceId=

# table meta tsdb info

canal.instance.tsdb.enable=true

#canal.instance.tsdb.url=jdbc:mysql://127.0.0.1:3306/canal_tsdb

#canal.instance.tsdb.dbUsername=canal

#canal.instance.tsdb.dbPassword=canal

#canal.instance.standby.address =

#canal.instance.standby.journal.name =

#canal.instance.standby.position =

#canal.instance.standby.timestamp =

#canal.instance.standby.gtid=

# username/password

canal.instance.dbUsername=canal

canal.instance.dbPassword=canal

canal.instance.connectionCharset = UTF-8

# enable druid Decrypt database password

canal.instance.enableDruid=false

#canal.instance.pwdPublicKey=MFwwDQYJKoZIhvcNAQEBBQADSwAwSAJBALK4BUxdDltRRE5/zXpVEVPUgunvscYFtEip3pmLlhrWpacX7y7GCMo2/JM6LeHmiiNdH1FWgGCpUfircSwlWKUCAwEAAQ==

# table regex

canal.instance.filter.regex=.*\\..*

# table black regex

canal.instance.filter.black.regex=mysql\\.slave_.*

# table field filter(format: schema1.tableName1:field1/field2,schema2.tableName2:field1/field2)

#canal.instance.filter.field=test1.t_product:id/subject/keywords,test2.t_company:id/name/contact/ch

# table field black filter(format: schema1.tableName1:field1/field2,schema2.tableName2:field1/field2)

#canal.instance.filter.black.field=test1.t_product:subject/product_image,test2.t_company:id/name/contact/ch

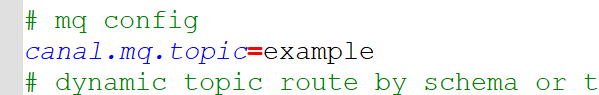

# mq config

canal.mq.topic=example

# dynamic topic route by schema or table regex

#canal.mq.dynamicTopic=mytest1.user,mytest2\\..*,.*\\..*

canal.mq.partition=0

# hash partition config

#canal.mq.partitionsNum=3

#canal.mq.partitionHash=test.table:id^name,.*\\..*

#canal.mq.dynamicTopicPartitionNum=test.*:4,mycanal:6

#################################################

- 修改后

#################################################

## mysql serverId , v1.0.26+ will autoGen

# canal.instance.mysql.slaveId=0

# enable gtid use true/false

canal.instance.gtidon=false

# 数据库地址

canal.instance.master.address=127.0.0.1:3306

# binlog日志名称

canal.instance.master.journal.name=mysql-bin.000001

# mysql主库连接时起始的binlog偏移量

canal.instance.master.position=156

# mysql主库连接时起始的binlog时间戳

canal.instance.master.timestamp=

canal.instance.master.gtid=

# rds oss binlog

canal.instance.rds.accesskey=

canal.instance.rds.secretkey=

canal.instance.rds.instanceId=

# table meta tsdb info

canal.instance.tsdb.enable=true

#canal.instance.tsdb.url=jdbc:mysql://127.0.0.1:3306/canal_tsdb

#canal.instance.tsdb.dbUsername=canal

#canal.instance.tsdb.dbPassword=canal

#canal.instance.standby.address =

#canal.instance.standby.journal.name =

#canal.instance.standby.position =

#canal.instance.standby.timestamp =

#canal.instance.standby.gtid=

# username/password

# 在mysql服务器授权的账号密码

canal.instance.dbUsername=canal

canal.instance.dbPassword=canal

canal.instance.connectionCharset = UTF-8

# enable druid Decrypt database password

canal.instance.enableDruid=false

#canal.instance.pwdPublicKey=MFwwDQYJKoZIhvcNAQEBBQADSwAwSAJBALK4BUxdDltRRE5/zXpVEVPUgunvscYFtEip3pmLlhrWpacX7y7GCMo2/JM6LeHmiiNdH1FWgGCpUfircSwlWKUCAwEAAQ==

# table regex .*..*表示监听所有表 也可以写具体的表名,用,隔开

canal.instance.filter.regex=.*\\..*

# table black regex mysql 数据解析表的黑名单,多个表用,隔开

canal.instance.filter.black.regex=

# table field filter(format: schema1.tableName1:field1/field2,schema2.tableName2:field1/field2)

#canal.instance.filter.field=test1.t_product:id/subject/keywords,test2.t_company:id/name/contact/ch

# table field black filter(format: schema1.tableName1:field1/field2,schema2.tableName2:field1/field2)

#canal.instance.filter.black.field=test1.t_product:subject/product_image,test2.t_company:id/name/contact/ch

# mq config

canal.mq.topic=example

# dynamic topic route by schema or table regex

#canal.mq.dynamicTopic=mytest1.user,mytest2\\..*,.*\\..*

canal.mq.partition=0

# hash partition config

#canal.mq.partitionsNum=3

#canal.mq.partitionHash=test.table:id^name,.*\\..*

#canal.mq.dynamicTopicPartitionNum=test.*:4,mycanal:6

#################################################

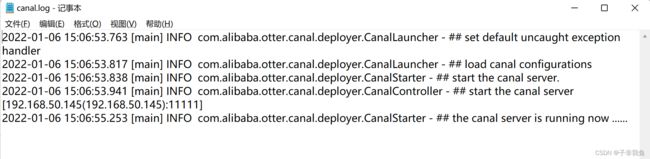

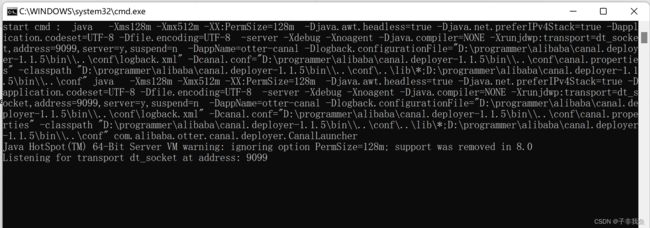

因为我这是在本地windows系统上进行演示的,所以在bin目录下找到startup.bat启动

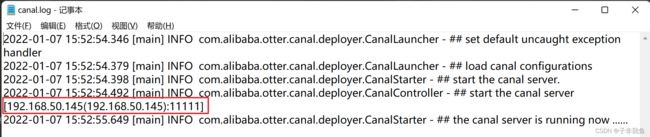

然后打开logs/canal/canal.log文件,看到内容没有异常信息,说明成功

springboot整合canal

步骤1:引入所需依赖

<dependency>

<groupId>com.alibaba.ottergroupId>

<artifactId>canal.clientartifactId>

<version>1.1.3version>

dependency>

步骤2:新建一个CanalClient.java类,用来监听mysql

package com.myqxin.controller;

import com.alibaba.otter.canal.client.CanalConnector;

import com.alibaba.otter.canal.client.CanalConnectors;

import com.alibaba.otter.canal.protocol.CanalEntry;

import org.springframework.beans.factory.InitializingBean;

import com.alibaba.otter.canal.protocol.Message;

import org.springframework.stereotype.Component;

import java.net.InetSocketAddress;

import java.util.List;

@Component

public class CanalClient implements InitializingBean {

private final static int BATCH_SIZE = 1000;

@Override

public void afterPropertiesSet() throws Exception {

// 创建链接

CanalConnector connector = CanalConnectors.newSingleConnector(new InetSocketAddress("127.0.0.1", 11111), "example", "root", "9527");

try {

//打开连接

connector.connect();

//订阅数据库表,全部表

connector.subscribe(".*..*");

//回滚到未进行ack的地方,下次fetch的时候,可以从最后一个没有ack的地方开始拿

connector.rollback();

while (true) {

// 获取指定数量的数据

Message message = connector.getWithoutAck(BATCH_SIZE);

//获取批量ID

long batchId = message.getId();

//获取批量的数量

int size = message.getEntries().size();

//如果没有数据

if (batchId == -1 || size == 0) {

try {

//线程休眠2秒

Thread.sleep(2000);

} catch (InterruptedException e) {

e.printStackTrace();

}

} else {

//如果有数据,处理数据

printEntry(message.getEntries());

List<CanalEntry.Entry> entries = message.getEntries();

}

//进行 batch id 的确认。确认之后,小于等于此 batchId 的 Message 都会被确认。

connector.ack(batchId);

}

} catch (Exception e) {

e.printStackTrace();

} finally {

connector.disconnect();

}

}

/**

* 打印canal server解析binlog获得的实体类信息

*/

private static void printEntry(List<CanalEntry.Entry> entrys) {

for (CanalEntry.Entry entry : entrys) {

if (entry.getEntryType() == CanalEntry.EntryType.TRANSACTIONBEGIN || entry.getEntryType() == CanalEntry.EntryType.TRANSACTIONEND) {

//开启/关闭事务的实体类型,跳过

continue;

}

//RowChange对象,包含了一行数据变化的所有特征

//比如isDdl 是否是ddl变更操作 sql 具体的ddl sql beforeColumns afterColumns 变更前后的数据字段等等

CanalEntry.RowChange rowChage;

try {

rowChage = CanalEntry.RowChange.parseFrom(entry.getStoreValue());

} catch (Exception e) {

throw new RuntimeException("ERROR ## parser of eromanga-event has an error , data:" + entry.toString(), e);

}

//获取操作类型:insert/update/delete类型

CanalEntry.EventType eventType = rowChage.getEventType();

//判断是否是DDL语句

if (rowChage.getIsDdl()) {

System.out.println("是DDL语句" + rowChage.getSql());

}

// 根据不同的语句类型,处理不同的业务

if (eventType == CanalEntry.EventType.INSERT) {

// 是新增语句,业务处理。如果新增的时候数据没有发生变化的情况下,是不会被执行

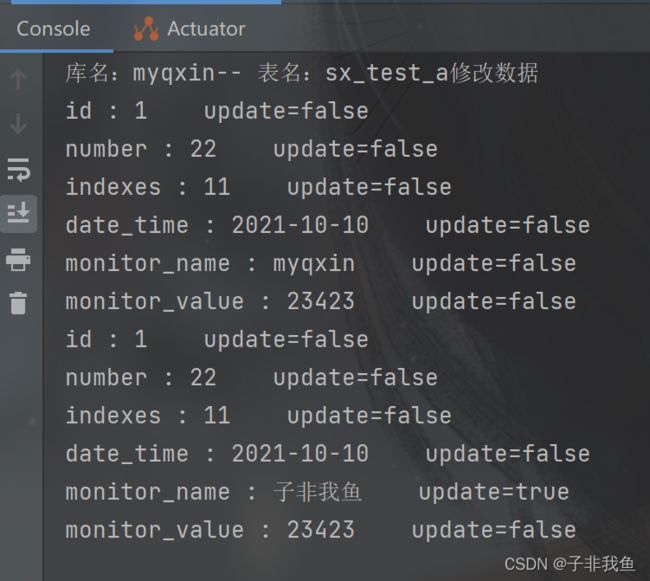

System.out.println("库名:" + entry.getHeader().getSchemaName() + "-- 表名:" + entry.getHeader().getTableName() + "新增数据");

// 获取RowChange对象里面的每一行信息

for (CanalEntry.RowData rowData : rowChage.getRowDatasList()) {

printColumn(rowData.getAfterColumnsList());

}

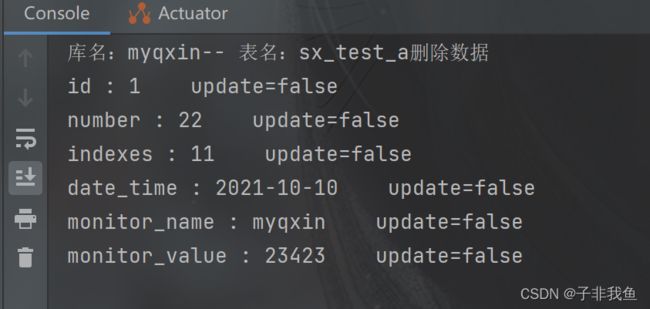

} else if (eventType == CanalEntry.EventType.DELETE) {

// 是删除语句,业务处理。如果删除的时候是没有数据的情况下,是不会被执行

System.out.println("库名:" + entry.getHeader().getSchemaName() + "-- 表名:" + entry.getHeader().getTableName() + "删除数据");

// 获取RowChange对象里面的每一行信息

for (CanalEntry.RowData rowData : rowChage.getRowDatasList()) {

printColumn(rowData.getBeforeColumnsList());

}

} else if (eventType == CanalEntry.EventType.UPDATE) {

// 是修改语句,业务处理。如果修改的时候是没有修改任何数据的情况下,是不会被执行

System.out.println("库名:" + entry.getHeader().getSchemaName() + "-- 表名:" + entry.getHeader().getTableName() + "修改数据");

// 获取RowChange对象里面的每一行信息

for (CanalEntry.RowData rowData : rowChage.getRowDatasList()) {

printColumn(rowData.getBeforeColumnsList());

printColumn(rowData.getAfterColumnsList());

}

}

}

}

private static void printColumn(List<CanalEntry.Column> columns) {

for (CanalEntry.Column column : columns) {

System.out.println(column.getName() + " : " + column.getValue() + " update=" + column.getUpdated());

}

}

}

![]()

这里的内容,ip为你当前服务器的地址,端口为canal服务端口,可以在\canal.deployer-1.1.5\logs\canal\canal.log文件里面看到

example是在\canal.deployer-1.1.5\conf\example\instance.properties文件里面查看

后面两个参数就是你数据库的账号和密码,用root的账号和密码(不使用canal账号)

以上代码只做简单的演示打印,没有业务代码

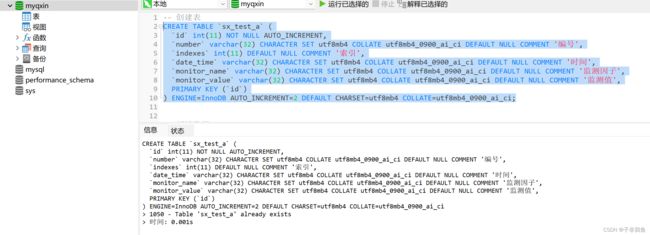

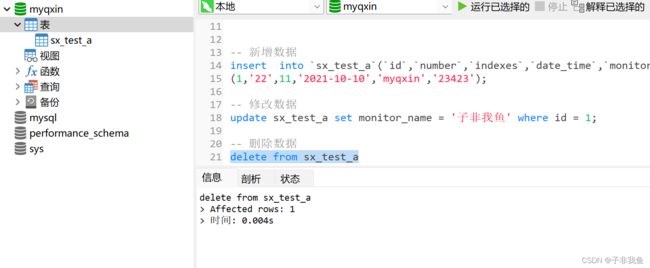

步骤3:测试

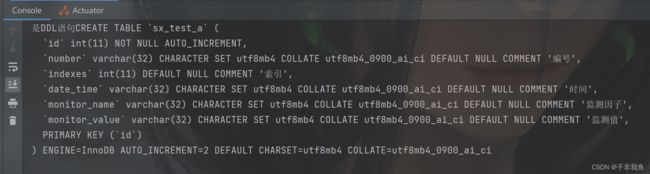

- 新建表语句(DDL)

-- 创建表

CREATE TABLE `sx_test_a` (

`id` int(11) NOT NULL AUTO_INCREMENT,

`number` varchar(32) CHARACTER SET utf8mb4 COLLATE utf8mb4_0900_ai_ci DEFAULT NULL COMMENT '编号',

`indexes` int(11) DEFAULT NULL COMMENT '索引',

`date_time` varchar(32) CHARACTER SET utf8mb4 COLLATE utf8mb4_0900_ai_ci DEFAULT NULL COMMENT '时间',

`monitor_name` varchar(32) CHARACTER SET utf8mb4 COLLATE utf8mb4_0900_ai_ci DEFAULT NULL COMMENT '监测因子',

`monitor_value` varchar(32) CHARACTER SET utf8mb4 COLLATE utf8mb4_0900_ai_ci DEFAULT NULL COMMENT '监测值',

PRIMARY KEY (`id`)

) ENGINE=InnoDB AUTO_INCREMENT=2 DEFAULT CHARSET=utf8mb4 COLLATE=utf8mb4_0900_ai_ci;

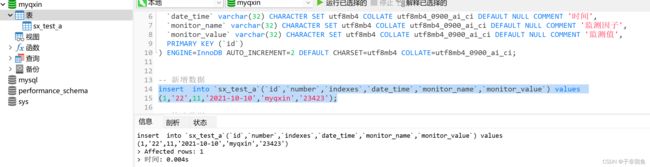

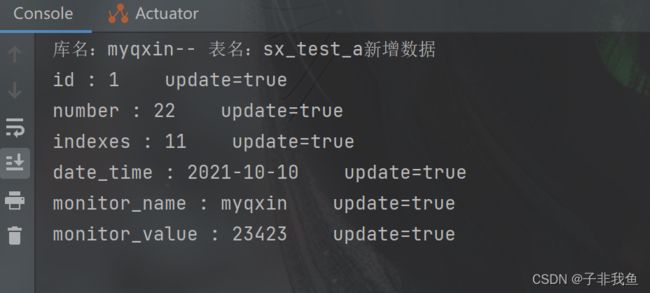

- 新增数据

-- 新增数据

insert into `sx_test_a`(`id`,`number`,`indexes`,`date_time`,`monitor_name`,`monitor_value`) values

(1,'22',11,'2021-10-10','myqxin','23423');

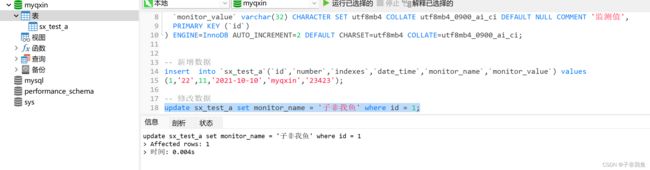

- 修改数据

-- 修改数据

update sx_test_a set monitor_name = '子非我鱼' where id = 1;

- 删除数据

-- 删除数据

delete from sx_test_a