爬虫入门——爬取OJ题目和学校信息通知

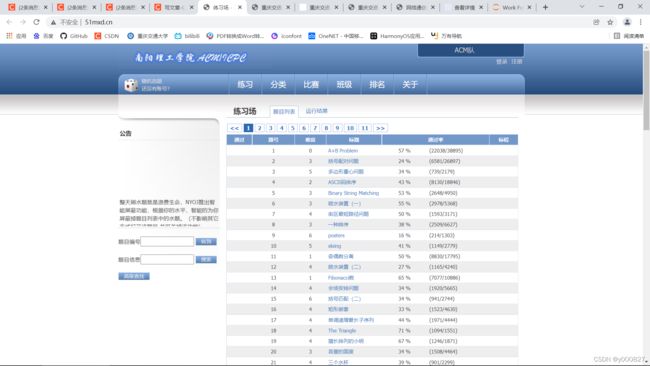

一、爬取南阳理工学院ACM题目

爬取网站:http://www.51mxd.cn

1、网页分析

- 通过切换页数可发现,第n页网址为:

http://www.51mxd.cn/problemset.php-page=n.htm

- 查看网页源码

在其中Ctrl + F 搜索该页的某一个题目

- 打开开发者模式,在源码中找到待爬取的数据位置

2、内容爬取

- 代码:

import requests

from bs4 import BeautifulSoup

import csv

from tqdm import tqdm

# 模拟浏览器访问

Headers = 'Mozilla/5.0 (Windows NT 10.0; WOW64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/70.0.3538.25 Safari/537.36 Core/1.70.3741.400 QQBrowser/10.5.3863.400'

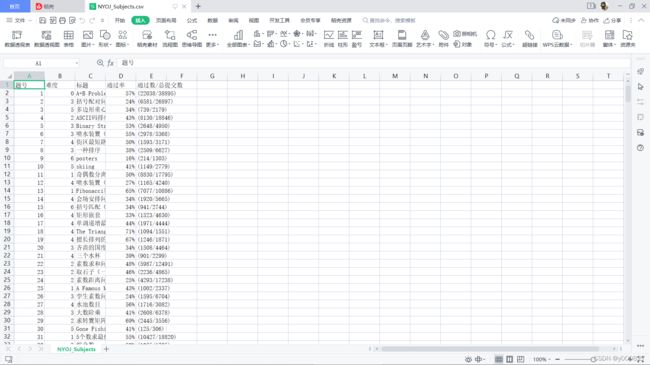

# 表头

csvHeaders = ['题号', '难度', '标题', '通过率', '通过数/总提交数']

# 题目数据

subjects = []

# 爬取题目

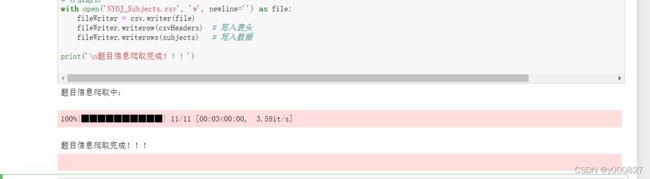

print('题目信息爬取中:\n')

# tqdm作业:以进度条方式显示爬取进度

# 爬取11页所有题目信息

for pages in tqdm(range(1, 11 + 1)):

# get请求第pages页

r = requests.get(f'http://www.51mxd.cn/problemset.php-page={pages}.htm', Headers)

# 判断异常

r.raise_for_status()

# 设置编码

r.encoding = 'utf-8'

# 创建BeautifulSoup对象,用于解析该html页面数据

soup = BeautifulSoup(r.text, 'lxml')

# 获取所有td标签

td = soup.find_all('td')

# 存放某一个题目的所有信息

subject = []

# 遍历所有td

for t in td:

if t.string is not None:

subject.append(t.string) # 获取td中的字符串

if len(subject) == 5: # 每5个为一个题目的信息

subjects.append(subject)

subject = []

# 存放题目

with open('NYOJ_Subjects.csv', 'w', newline='') as file:

fileWriter = csv.writer(file)

fileWriter.writerow(csvHeaders) # 写入表头

fileWriter.writerows(subjects) # 写入数据

print('\n题目信息爬取完成!!!')

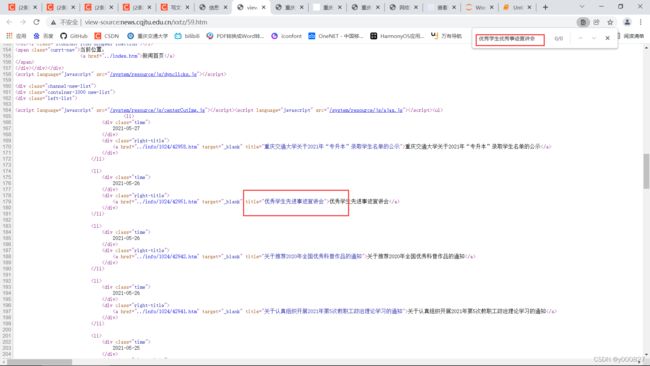

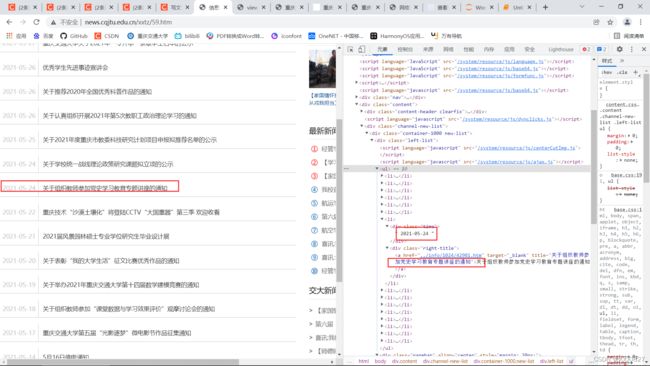

二、爬取学校信息通知

爬取网站:http://news.cqjtu.edu.cn/xxtz.htm

第一页url为http://news.cqjtu.edu.cn/xxtz.htm,

第二页为http://news.cqjtu.edu.cn/xxtz/65.htm,

第三页为http://news.cqjtu.edu.cn/xxtz/64.htm

1、网页分析

2、内容爬取

- 代码

import requests

from bs4 import BeautifulSoup

import csv

# 获取每页内容

def get_one_page(url):

headers = {

'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/95.0.4638.69 Safari/537.36'

}

try:

info_list_page = [] # 一页的所有信息

resp = requests.get(url, headers=headers)

resp.encoding = resp.status_code

page_text = resp.text

soup = BeautifulSoup(page_text, 'lxml')

li_list = soup.select('.left-list > ul > li') # 找到所有li标签

for li in li_list:

divs = li.select('div')

date = divs[0].string.strip()

title = divs[1].a.string

info = [date, title]

info_list_page.append(info)

except Exception as e:

print('爬取' + url + '错误')

print(e)

return None

else:

resp.close()

print('爬取' + url + '成功')

return info_list_page

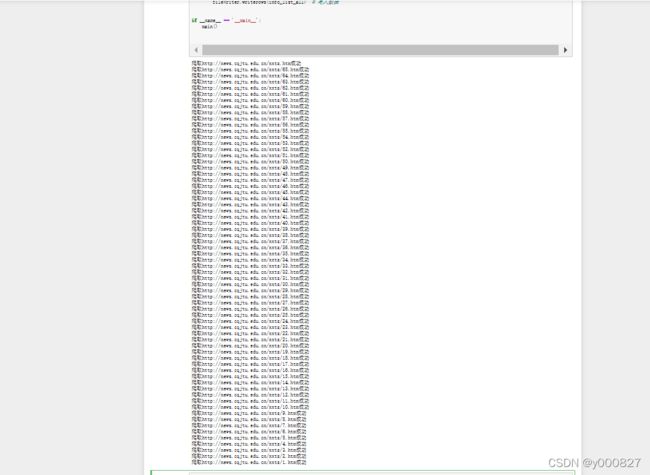

# main

def main():

# 爬取所有数据

info_list_all = []

base_url = 'http://news.cqjtu.edu.cn/xxtz/'

for i in range(1, 67):

if i == 1:

url = 'http://news.cqjtu.edu.cn/xxtz.htm'

else:

url = base_url + str(67 - i) + '.htm'

info_list_page = get_one_page(url)

info_list_all += info_list_page

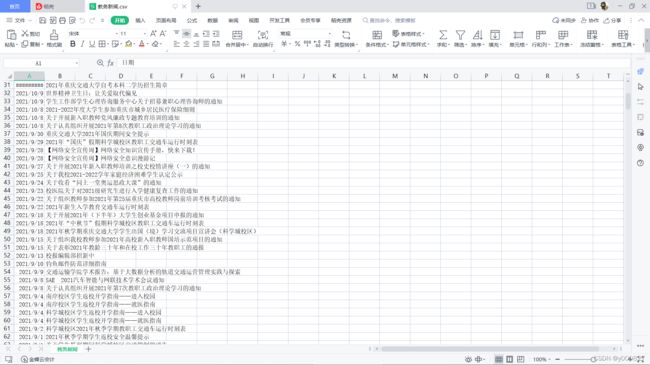

# 存入数据

with open('教务新闻.csv', 'w', newline='', encoding='utf-8') as file:

fileWriter = csv.writer(file)

fileWriter.writerow(['日期', '标题']) # 写入表头

fileWriter.writerows(info_list_all) # 写入数据

if __name__ == '__main__':

main()

三、总结

成功爬取OJ题目和学校信息通知,网络爬虫对于我们获得更多资源有很大的帮助

参考文章

Python爬虫练习(爬取OJ题目和学校信息通知)