TensorFlow(2)-数据载入

tensorflow 数据载入

- 1. tf.data.Dataset

- 2. dataset 创建数据集的方式

-

- 2.1 tf.data.Dataset.from_tensor_slices()

- 2.2 tf.data.TextLineDataset()

- 2.3 tf.data.FixedLengthRecordDataset()

- 2.4 tf.data.TFRecordDataset()

- 3. dateset 迭代操作iterator

-

- 3.1 make_one_shot_iterator()

- 3.2 make_initializable_iterator()

- 3.3 reinitializable iterator()

- 3.4 feedable iterator()

- 4. dataset的map、batch、shuffle、repeat操作

- 5. 非eager/eager 模式

-

- 5.1 非eager模式demo

- 5.2 eager模式demo

1. tf.data.Dataset

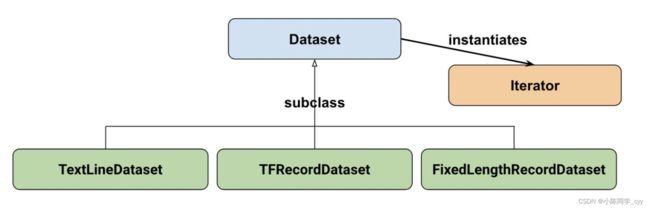

参考Google官方给出的Dataset API中的类图,Dataset 务于数据读取,构建输入数据的pipeline。

Dataset可以看作是相同类型“元素”的有序列表,可使用Iterator迭代获取Dataset中的元素。

2. dataset 创建数据集的方式

2.1 tf.data.Dataset.from_tensor_slices()

从tensor中创建数据集,数据集元素以tensor第一维度为划分。

import tensorflow as tf

import numpy as np

# 切分传入Tensor的第一个维度,生成相应的dataset。

dataset1 = tf.data.Dataset.from_tensor_slices(np.array([1.0, 2.0, 3.0, 4.0, 5.0]))

# 如果传入字典,那切分结果就是字典按值切分,元素型如{"a":[1],"b":[x,x]}

dataset2 = tf.data.Dataset.from_tensor_slices(

{

"a": np.array([1.0, 2.0, 3.0, 4.0, 5.0]),

"b": np.random.uniform(size=(5, 2))

}

)

2.2 tf.data.TextLineDataset()

读取文件数据创建数据集,数据集元素为文件的每一行

2.3 tf.data.FixedLengthRecordDataset()

从一个文件列表和record_bytes中创建数据集,数据集元素是文件中固定字节数record_bytes的内容。文件列表用来做啥?

2.4 tf.data.TFRecordDataset()

读TFRecord文件创建数据集,数据集元素是一个TFExample。

3. dateset 迭代操作iterator

iterator是从Dataset对象中创建出来的,用于迭代取数据集中的元素。

3.1 make_one_shot_iterator()

dataset.make_one_shot_iterator()–只能从头到尾读取一次dataset。如果一个dataset中元素被读取完了再sess.run()的话,会抛出tf.errors.OutOfRangeError异常。因此可以在外界捕捉这个异常以判断数据是否读取完。

import tensorflow as tf

import numpy as np

# 切分传入Tensor的第一个维度,生成相应的dataset。如果传入字典,那切分结果就是字典按值切分

dataset = tf.data.Dataset.from_tensor_slices(np.array([1.0, 2.0, 3.0, 4.0, 5.0]))

iterator = dataset.make_one_shot_iterator() # 只能从头到尾读取一次

one_element = iterator.get_next() # 从iterator里取出一个元素。

# 处于非Eager模式,所以one_element只是一个Tensor,并不是一个实际的值。调用sess.run(one_element)后,才能真正地取出一个值。

with tf.Session() as sess:

try:

while True:

print(sess.run(one_element))

except tf.errors.OutOfRangeError:

print("end!")

3.2 make_initializable_iterator()

dataset.make_initializable_iterator()–支持placeholder dataset 的迭代操作,这可以方便通过参数快速定义新的Iterator。

# limit相当于一个参数,它规定了Dataset中数的上限, 使用make_initializable_iterator

limit = tf.placeholder(dtype=tf.int32, shape=[])

dataset = tf.data.Dataset.from_tensor_slices(tf.range(start=0, limit=limit))

iterator = dataset.make_initializable_iterator()

next_element = iterator.get_next()

with tf.Session() as sess:

sess.run(iterator.initializer, feed_dict={limit: 10})

for i in range(10):

value = sess.run(next_element)

assert i == value

如果在dataset的构建时,一次性读入了所有的数据,会导致计算图变得很大,给传输、保存带来不便。make_initializable_iterator()支持placeholder 操作,仅在需要传输数据时再取数据。

# 从硬盘中读入两个Numpy数组

with np.load("/var/data/training_data.npy") as data:

features = data["features"]

labels = data["labels"]

features_placeholder = tf.placeholder(features.dtype, features.shape)

labels_placeholder = tf.placeholder(labels.dtype, labels.shape)

dataset = tf.data.Dataset.from_tensor_slices((features_placeholder, labels_placeholder))

iterator = dataset.make_initializable_iterator()

sess.run(iterator.initializer, feed_dict={features_placeholder: features,

labels_placeholder: labels})

3.3 reinitializable iterator()

dataset.reinitializable iterator() --待补

3.4 feedable iterator()

dataset.feedable iterator()–待补

4. dataset的map、batch、shuffle、repeat操作

map–接收一个函数,Dataset中的每个元素都会被当作这个函数的输入,并将函数返回值作为新的Dataset。

dataset = tf.data.Dataset.from_tensor_slices(np.array([1.0, 2.0, 3.0, 4.0, 5.0]))

dataset = dataset.map(lambda x: x + 1) # 2.0, 3.0, 4.0, 5.0, 6.0

batch–将多个元素组合成一个batch

dataset = dataset.batch(16) # 将数据集划分为batch size为16的小批次

shuffle– 打乱dataset中的元素,参数buffersize。打乱的实现机理:从buffer_size 大小的部buffer中随机抽取元素,组成打乱后的数据集。buffer中被抽走的元素由原数据集中的后续元素补位置。 重复‘抽取-补充’这个过程,直至buffer为空。

buffer_size 的大小详见tf.data.Dataset.shuffle(buffer_size)中buffer_size的理解

dataset = dataset.shuffle(buffer_size=10000)

repeat– 将整个序列重复多次,用来处理机器学习中的epoch,假设原始数据是一个epoch,使用repeat(5)就可以将之变成5个epoch

dataset = dataset.repeat(5)

5. 非eager/eager 模式

5.1 非eager模式demo

在非Eager模式下,Dataset中读出的一个元素一般对应一个batch的Tensor,我们可以使用这个Tensor在计算图中构建模型。

import tensorflow as tf

import numpy as np

# 切分传入Tensor的第一个维度,生成相应的dataset。如果传入字典,那切分结果就是字典按值切分

dataset = tf.data.Dataset.from_tensor_slices(np.array([1.0, 2.0, 3.0, 4.0, 5.0]))

iterator = dataset.make_one_shot_iterator() # 只能从头到尾读取一次

one_element = iterator.get_next() # 从iterator里取出一个元素。

# 处于非Eager模式,所以one_element只是一个Tensor,并不是一个实际的值。调用sess.run(one_element)后,才能真正地取出一个值。

with tf.Session() as sess:

try:

while True:

print(sess.run(one_element))

except tf.errors.OutOfRangeError:

print("end!")

5.2 eager模式demo

在Eager模式下,Dataset建立Iterator的方式有所不同,此时通过读出的数据就是含有值的Tensor,方便调试。

import tensorflow.contrib.eager as tfe

tfe.enable_eager_execution()

dataset = tf.data.Dataset.from_tensor_slices(np.array([1.0, 2.0, 3.0, 4.0, 5.0]))

for one_element in tfe.Iterator(dataset):

print(one_element) # 可直接读取数据

参考文献:TensorFlow全新的数据读取方式:Dataset API入门教程