端到端“大一统”模型 能否迎来多目标跟踪的终局?

©NLP论文解读 原创•作者 | 朱林

生活中多目标跟踪问题屡见不鲜,比如稠密人群检测、场景识别、智慧交通等场景下多目标跟踪都是避不开的话题。

解决多目标跟踪(Multi-Object Tracking, MOT)问题有两种基本范式,其一是先检测后跟踪(Tracking-by-detection, TBD),将检测和跟踪作为两个独立任务来对待。

另外一种是联合检测和跟踪两个任务(Joint detection and tracking, JDT),进行端到端(End-to-end)地学习训练。

最新研究表明,相较而言,TBD有性能低下、误差累积等诸多问题,而JDT则更有利于整体性能提升,但是构建模型难度较大。

最近的JDT方法,往往仅通过共享骨干网络(Backbone Network)的形式来融合检测和跟踪模型,但是其本质还是将检测和跟踪作为两个独立任务,彼此因果相关性不大。

CVPR2021最新一篇论文提出了一种TraDeS(Track to Detect and Segment)的网络,更彻底地贯彻了端到端的“大一统”思想,利用帧与帧之间的跟踪线索来将检测网络和跟踪网络紧密耦合在了一起。

那这种紧密耦合是如何实现的?这种方法能够迎来多目标跟踪的终局呢?带着思考让我们一起来看下这篇论文。

Introduction

论文标题:

Track to Detect and Segment: An Online Multi-Object Tracker

项目地址:

https://jialianwu.com/projects/TraDeS.html

论文代码:

https://github.com/JialianW/TraDeS

效果视频:

https://www.bilibili.com/video/BV12U4y1p7wg

论文地址:

https://arxiv.org/abs/2103.08808

作者提出了一种新颖的在线多目标跟踪器 TraDeS,它深度集成了跟踪线索以辅助框架中的检测部分并反馈给跟踪部分,即跟踪线索作为粘合剂将检测网络和跟踪网络有机粘合在了一起。

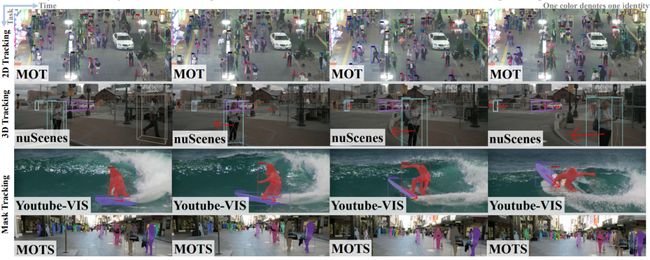

TraDeS是一个通用的跟踪器,通过添加简单的检测头网络(Head Network)即可很容易扩展到2D跟踪、3D跟踪和实例分割跟踪等不同任务。

Implementation

作者创新性地提出了两个新模块来实现TraDeS端到端多目标跟踪网络:CVA和MFW。

CVA:基于代价卷关联模块

(Cost Volume based Association)

实现目标:

该模块主要用于学习行人重识别嵌入(re-ID Embedding)特征和生成对象运动偏移矩阵。

实现细节:

CVA通过主干网络提取逐点的行人重识别嵌入特征以构建代价卷,该代价卷存储两帧中所有嵌入对之间的匹配相似性。

然后,从代价卷中推断出跟踪偏移量,即两帧中所有点的时空位移。跟踪偏移量与嵌入特征一起用于进行简单的两轮长期数据关联。具体来说有以下三步:

(1) 对相邻两帧图像分别采用共享权重的3层卷积网络提取行人重识别特征并进行下采样以便于有效计算。

(2) 将两帧分别得到的两个特征结果进行矩阵乘法得到一个新的4维特征图,即为代价卷关联图,其表示两个帧中任意一点与其对应点之间的相似性。

(3) 基于该图,通过Softmax分别计算横轴偏移和纵轴偏移,组成跟踪偏移(Tracking Offset)矩阵,它存储了所有点在相邻两帧中对应点的时空位移量。

注:CVA 模块在学习训练时,采用了以焦点损失(Focal Loss)为形式构建的损失函数,它强制一个对象不仅在前一帧接近自身,而且排斥其他对象和背景区域。

特色:

(1) 传统的行人重识别嵌入损失函数只强调类内差异,这可能会降低检测性能。相较而言,作者在损失函数中的不仅强调了类内差异,而且在学习嵌入时也强制增大了类间差异。作者发现这种处理可以在不损害检测的情况下更有效地学习嵌入特征。

(2) 由于跟踪偏移量是基于外观嵌入这种视觉相似性预测的,它可以在大范围的运动和低帧率下跟踪对象,甚至可以准确地跟踪不同数据集中的对象。因此,预测出的跟踪偏移可以作为稳定可靠的运动线索来指导后续的特征传播。

(3) 与仅预测数据关联的嵌入或跟踪偏移的CenterTrack网络相比,CVA 生成了用于长期数据关联的嵌入和跟踪偏移为后续MFW 网络提供更好的运动线索。

MFW:运动引导特征扭曲模块

(Motion-guided Feature Warper, MFW)

实现目标:

该模块旨在将CVA预测的跟踪偏移作为运动线索来扭曲和传播前一时刻特征到当前时刻特征,以补偿和增强当前特征,并得到最终的检测或分割结果。

实现细节:

MFW 将跟踪偏移量作为运动线索,将对象特征从前一帧传播到当前帧。最后,将传播的特征和当前特征进行聚合以得出检测和分割结果。具体有以下步骤:

(1) 采用3×3的卷积层作用于CVA生成的跟踪偏移矩阵来传递出新的跟踪偏移矩阵。

(2) 采用可变形卷积 (Deformable Convolution Network, DCN) 进行特征传播。将上述输出的新偏移图和两帧图像矩阵的残差特征作为输入传播出新的增强特征。

(3) 根据任务不同,即2D、3D、分割跟踪,采用对应的检测头网络(Head Network)进行输出。

(4) 生成的的检测和掩码(Mask)通过数据关联连接到之前的航迹图以构建端到端的学习。

特色:

为了实现增强特征的目标,作者通过单个可变形卷积执行有效的时间传播,然后通过聚合两帧传播信息来增强特征。

将跟踪线索整合到端到端的检测中,有效改进了对困难场景的检测,并反过来提高了跟踪结果的有效性。检测和跟踪两者相辅相成,共同成就彼此。

Experiments

如上图所示,作者在 4 组不同数据集(MOT、nuScenes、MOTS 和 Youtube-VIS)上进行了大量的实验。实验横跨了3 个不同的任务,包括 2D 对象跟踪、3D 对象跟踪和实例分割跟踪。TraDeS均有最先进的性能表现。

除了基准测试外,作者还采用了大量的消融实验来验证其提出的各个模块的有效性。如下表所示:

CONCLUSION

本篇论文的作者提出了一种新颖的在线联合检测和跟踪模型 TraDeS,利用跟踪线索来帮助检测和提升跟踪。 TraDeS 创新地引入了两个模块,CVA 和 MFW。

CVA 学习特别设计的行人重识别嵌入特征并通过 4维代价卷对对象运动进行建模。 而 MFW 将来自 CVA 的输出作为传播先前对象特征的线索,以强化当前的检测或分割。

该方法可以用于2D 跟踪、3D 跟踪和实例分割跟踪。作者在不同数据集的不同任务上运用详尽的实验证明了其各个部分的有效性并展示了较高的综合性能。

Reflection

笔者认为有监督的在线多目标跟踪任务采用端到端的思想构建模型从理论上来说能够比多个不同任务模型叠起来取得更好的结果,因为单模型能够通过深度学习去更好地消除误差,组合模型则具有累积误差。

当然,联合单模型的构建也更加困难,不同任务之间模型共享参数是否合理仍然是一个需要持续探究的问题。实际工程项目中的多目标跟踪任务会更复杂,往往不是一个简单的模型能够“一网打尽”的,由此看来多目标跟踪方向的探索还远未结束,任重而道远。

私信领取目标检测与R-CNN/数据分析的应用/电商数据分析/数据分析在医疗领域的应用/NLP学员项目展示/中文NLP的介绍与实际应用/NLP系列直播课/NLP前沿模型训练营等干货学习资源。

每月大咖直播分享、真实项目需求对接、求职内推、算法竞赛、干货资讯汇总等等。