Spark——安装及使用

一、spark入门与安装

1、spark概述

1)了解

Spark是一种快速、通用、可扩展的大数据分析引擎,2009年诞生于加州大学伯克利分校AMPLab,2010年开源,2013年6月成为Apache孵化项目,2014年2月成为Apache顶级项目。目前,Spark生态系统已经发展成为一个包含多个子项目的集合,其中包含SparkSQL、Spark Streaming、GraphX、MLlib等子项目,Spark是基于内存计算的大数据并行计算框架。Spark基于内存计算,提高了在大数据环境下数据处理的实时性,同时保证了高容错性和高可伸缩性,允许用户将Spark部署在大量廉价硬件之上,形成集群。

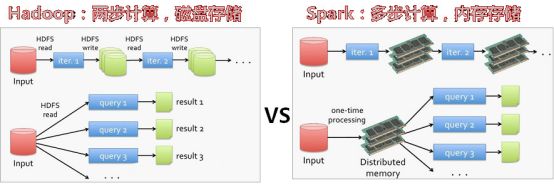

2)原理

中间结果输出: 基于MapReduce的计算引擎通常会将中间结果输出到磁盘上,进行存储和容错。出于任务管道承接的,考虑,当一些查询翻译到MapReduce任务时,往往会产生多个Stage,而这些串联的Stage又依赖于底层文件系统(如HDFS)来存储每一个Stage的输出结果

Spark是MapReduce的替代方案,而且兼容HDFS、Hive,可融入Hadoop的生态系统,以弥补MapReduce的不足。

3)特点

① 快

与Hadoop的MapReduce相比,Spark基于内存的运算要快100倍以上,基于硬盘的运算也要快10倍以上。Spark实现了高效的DAG执行引擎,可以通过基于内存来高效处理数据流。

② 易用

Spark支持Java、Python和Scala的API,还支持超过80种高级算法,使用户可以快速构建不同的应用。而且Spark支持交互式的Python和Scala的shell,可以非常方便地在这些shell中使用Spark集群来验证解决问题的方法

③ 通用

Spark提供了统一的解决方案。Spark可以用于批处理、交互式查询(Spark SQL)、实时流处理(Spark Streaming)、机器学习(Spark MLlib)和图计算(GraphX)。这些不同类型的处理都可以在同一个应用中无缝使用。Spark统一的解决方案非常具有吸引力,毕竟任何公司都想用统一的平台去处理遇到的问题,减少开发和维护的人力成本和部署平台的物力成本。

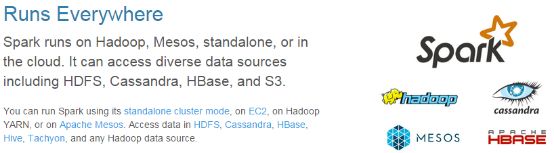

⑤ 兼容性

Spark可以非常方便地与其他的开源产品进行融合。比如,Spark可以使用Hadoop的YARN和Apache Mesos作为它的资源管理和调度器,器,并且可以处理所有Hadoop支持的数据,包括HDFS、HBase和Cassandra等。这对于已经部署Hadoop集群的用户特别重要,因为不需要做任何数据迁移就可以使用Spark的强大处理能力。Spark也可以不依赖于第三方的资源管理和调度器,它实现了Standalone作为其内置的资源管理和调度框架,这样进一步降低了Spark的使用门槛,使得所有人都可以非常容易地部署和使用Spark。此外,Spark还提供了在EC2上部署Standalone的Spark集群的工具。

2、spark集群安装

1)安装

① 机器避暑

准备两台以上Linux服务器,安装好JDK

② 下载Spark安装包

[root@node01 ~]# cd /home/hadoop/apps/

[root@node01 apps]# rz

[root@node01 apps]# tar -zxvf spark-1.5.1-bin-hadoop2.4/

③ 配置spark

//进入conf目录并重命名并修改spark-env.sh.template文件

[root@node01 apps]# cd spark-1.5.1-bin-hadoop2.4/conf/

[root@node01 apps]# mv spark-env.sh.template spark-env.sh

[root@node01 apps]# vi spark-env.sh

//在该配置文件中添加如下配置:

export JAVA_HOME=/home/hadoop/apps/jdk1.8.0_181

export SPARK_MASTER_IP=node01

export SPARK_MASTER_PORT=7077

//重命名并修改slaves.template文件

[root@node01 apps]# mv slaves.template slaves

[root@node01 apps]# vi slaves

//在该文件中添加子节点所在的位置(Worker节点):

node01

node02

node03

//将配置好的Spark拷贝到其他节点上

[root@node01 apps]# scp -r spark-1.5.1-bin-hadoop2.4/ node02:/home/hadoop/apps/

[root@node01 apps]# scp -r spark-1.5.1-bin-hadoop2.4/ node03:/home/hadoop/apps/

//Spark集群配置完毕,目前是1个Master,3个Work,在hadoop1上启动Spark集群

[root@node01 apps]# /home/hadoop/apps/spark-1.5.1-bin-hadoop2.4/sbin/start-all.sh

[root@node01 apps]# jps

//主节点上有Master进程,其他子节点上有Work进行,登录Spark管理界面查看集群状态(主节点):http://hadoop1:8080/

到此为止,Spark集群安装完毕,但是有一个很大的问题,那就是Master节点存在单点故障,要解决此问题,就要借助zookeeper,并且启动至少两个Master节点来实现高可靠,配置方式比较简单

Spark集群规划:hadoop1,hadoop2是Master;hadoop3,hadoop4,hadoop5是Worker

安装配置zk集群,并启动zk集群

//停止spark所有服务,修改配置文件spark-env.sh

[root@node01 apps]# /home/hadoop/apps/spark-1.5.1-bin-hadoop2.4/sbin/stop-all.sh

[root@node01 apps]# vi spark-env.sh

//在该配置文件中删掉SPARK_MASTER_IP并添加如下配置

export SPARK_DAEMON_JAVA_OPTS="-Dspark.deploy.recoveryMode=ZOOKEEPER -Dspark.deploy.zookeeper.url=zk1,zk2,zk3 -Dspark.deploy.zookeeper.dir=/spark"

//在hadoop1上执行sbin/start-all.sh脚本,然后在hadoop2上执行sbin/start-master.sh启动第二个Master

[root@node01 apps]# /home/hadoop/apps/spark-1.5.1-bin-hadoop2.4/sbin/start-all.sh

[root@node02 apps]# /home/hadoop/apps/spark-1.5.1-bin-hadoop2.4/sbin/start-Master.sh

3、执行spark程序

1)执行第一个spark程序

/usr/local/spark-1.5.1-bin-hadoop2.4/bin/spark-submit \

--class org.apache.spark.examples.SparkPi \

--master spark://hadoop1:7077 \

--executor-memory 1G \

--total-executor-cores 2 \

/usr/local/spark-1.5.1-bin-hadoop2.4/lib/spark-examples-1.5.1-hadoop2.4.0.jar \

100

//该算法是利用蒙特·卡罗算法求PI

2)启动Spark Shell

spark-shell是Spark自带的交互式Shell程序,方便用户进行交互式编程,用户可以在该命令行下用scala编写spark程序

//启动spark shell

/usr/local/spark-1.5.1-bin-hadoop2.4/bin/spark-shell \

--master spark://hadoop1:7077 \

--executor-memory 2g \

--total-executor-cores 2

//参数说明:

--master spark://hadoop1:7077 //指定Master的地址

--executor-memory 2g //指定每个worker可用内存为2G

--total-executor-cores 2 //指定整个集群使用的cup核数为2个

注意:

-

如果启动spark shell时没有指定master地址,但是也可以正常启动spark shell和执行spark shell中的程序,其实是启动了spark的local模式,该模式仅在本机启动一个进程,没有与集群建立联系。

-

Spark Shell中已经默认将SparkContext类初始化为对象sc。用户代码如果需要用到,则直接应用sc即可

在spark shell中编写WordCount程序

1.首先启动hdfs

2.向hdfs上传一个文件到hdfs://hadoop1:9000/words.txt

3.在spark shell中用scala语言编写spark程序

sc.textFile("hdfs://hadoop1:9000/words.txt").flatMap(_.split(" "))

.map((_,1)).reduceByKey(_+_).saveAsTextFile("hdfs://hadoop1:9000/out")

4.使用hdfs命令查看结果

hdfs dfs -ls hdfs://hadoop1:9000/out/p*

说明:

sc SparkContext对象,该对象时提交spark程序的入口

textFile(hdfs://hadoop1:9000/words.txt) hdfs中读取数据

flatMap(_.split(" ")) 先map在压平

map((_,1)) 将单词和1构成元组

reduceByKey(_+_) 按照key进行reduce,并将value累加

saveAsTextFile("hdfs://hadoop1:9000/out") 将结果写入到hdfs中

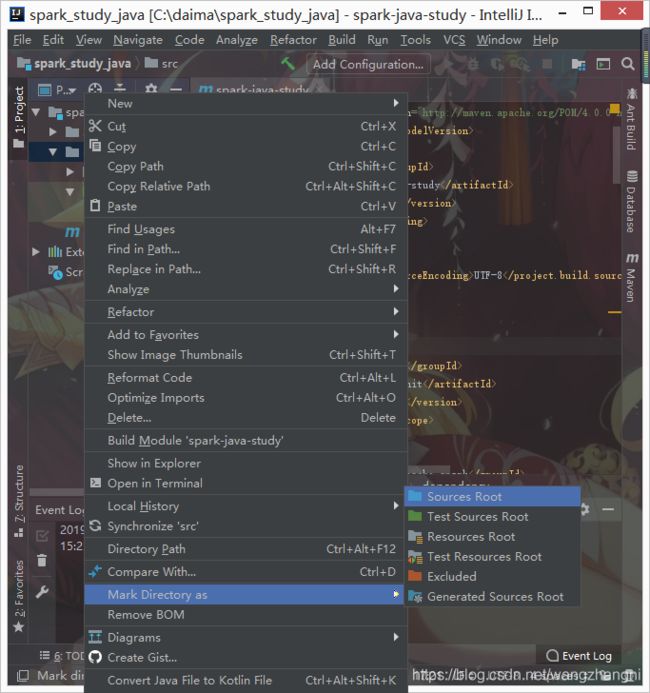

4、在IDEA中编写WordCount程序

- spark shell仅在测试和验证我们的程序时使用的较多,在生产环境中,通常会在IDE中编制程序,然后打成jar包,然后提交到集群,最常用的是创建一个Maven项目,利用Maven来管理jar包的依赖。

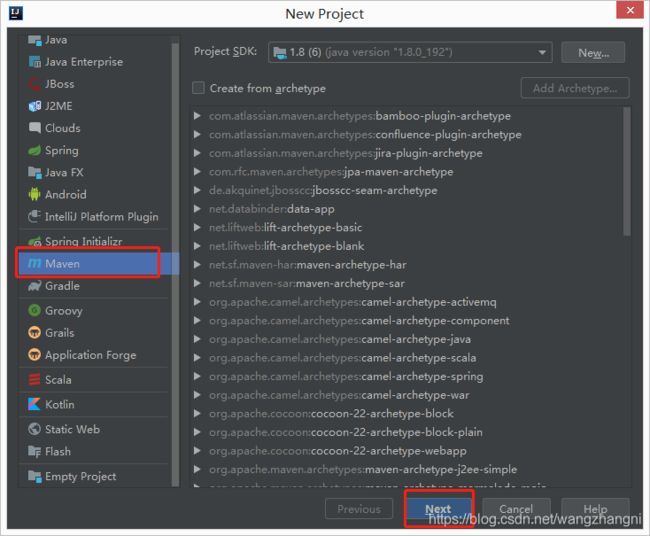

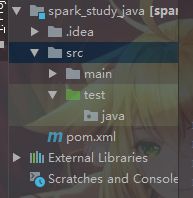

1.创建一个项目

2.选择Maven项目,然后点击next

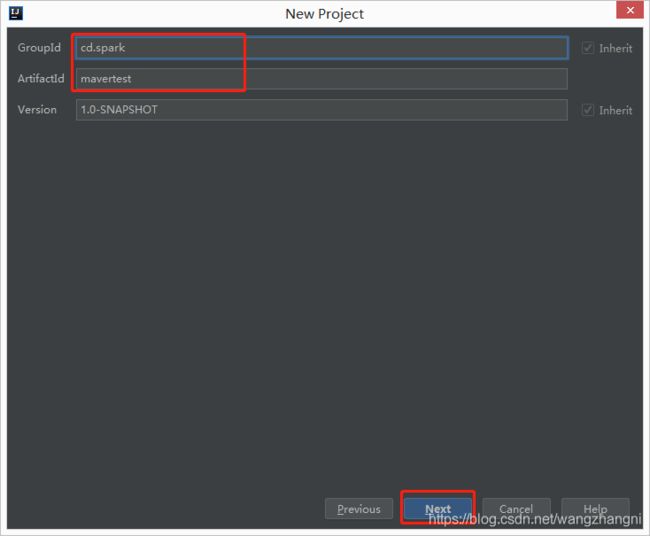

3.填写maven的GAV,然后点击next

4.填写项目名称,然后点击finish

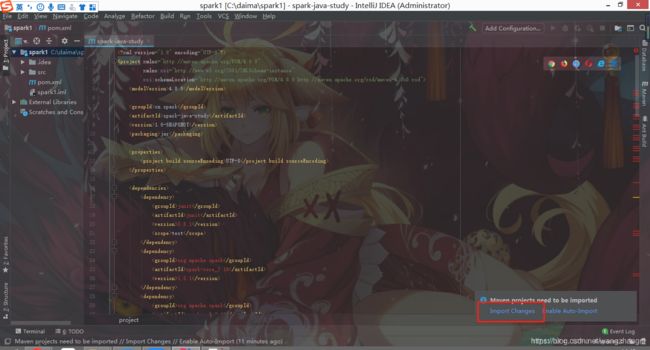

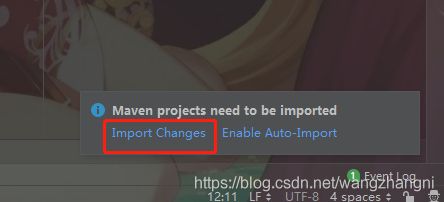

5.创建好maven项目后,点击Enable Auto-Import

6.配置Maven的pom.xml

7.新建一个scala class,类型为Object

8.编写spark程序

9.使用Maven打包:

首先修改pom.xml中的main class

点击idea右侧的Maven Project选项

点击Lifecycle,选择clean和package,然后点击Run Maven Build

10.选择编译成功的jar包,并将该jar上传到Spark集群中的某个节点上

11.首先启动hdfs和Spark集群

启动hdfs

/usr/local/hadoop-2.6.5/sbin/start-dfs.sh

启动spark

/usr/local/spark-2.1.0-bin-hadoop2.6/sbin/start-all.sh

12.使用spark-submit命令提交Spark应用(注意参数的顺序)

/usr/local/spark-2.1.0-bin-hadoop2.6/bin/spark-submit \

--class cn.itcast.spark.WordCount \

--master spark://hadoop1:7077 \

--executor-memory 2G \

--total-executor-cores 4 \

/root/spark-mvn-1.0-SNAPSHOT.jar \

hdfs://hadoop1:9000/words.txt \

hdfs://hadoop1:9000/out

查看程序执行结果

hdfs dfs -cat hdfs://hadoop1:9000/out/part-00000

//测试IDEA编写的程序

./spark-submit

–master spark://hdp01:7077

–executor-memory 512m

–total-executor-cores 4

–calss cn.lixiaolong.ScalaWC

/root/SparkDemo-1.0-SNAPSHOT.jar

hdfs://hdp01:9000/wc/a.txt \

hdfs:?/hdp01:9000/wc/scalaWCOut

./spark-submit --master spark://hsp01:7077 --executor-memory 512m --total-executor-cores 4 --class cn.lixiaolong.JavaLambdaWC /root/SparkDemo-1.0-SNAPSHOT.jar hdfs://hdp01:9000/wc/a.txt hdfs://hdp01:9000/wc/lambdaout

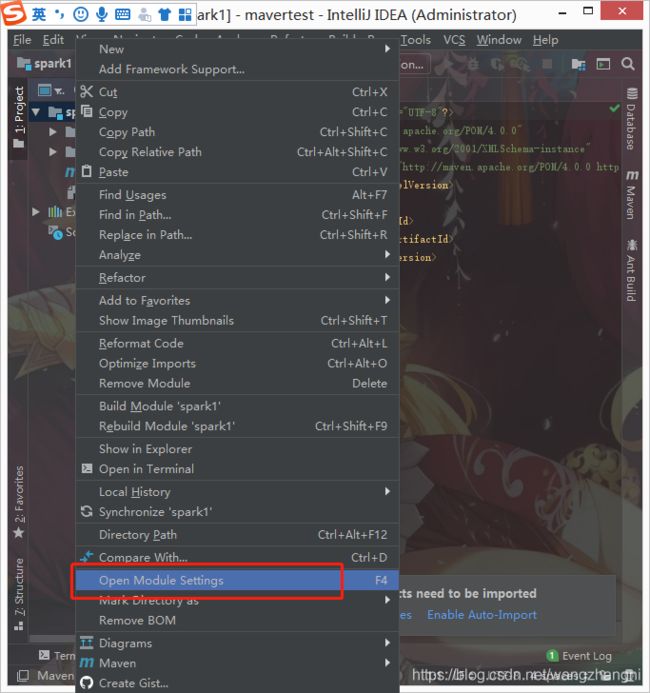

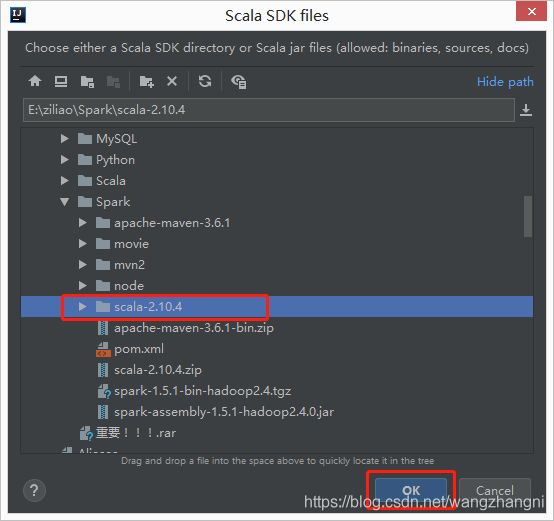

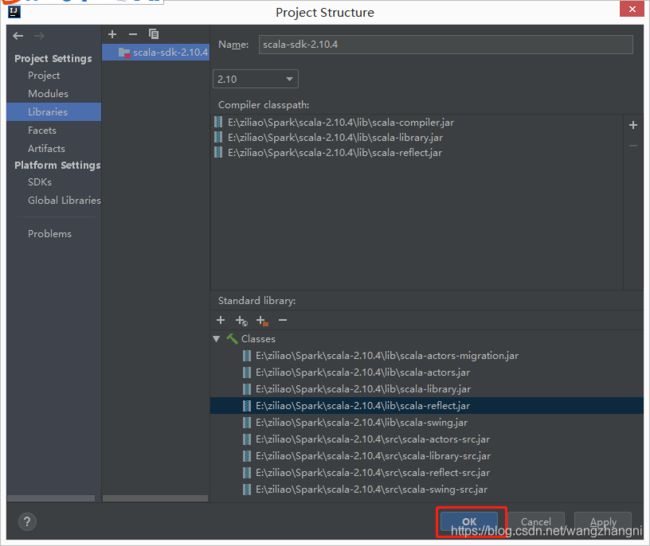

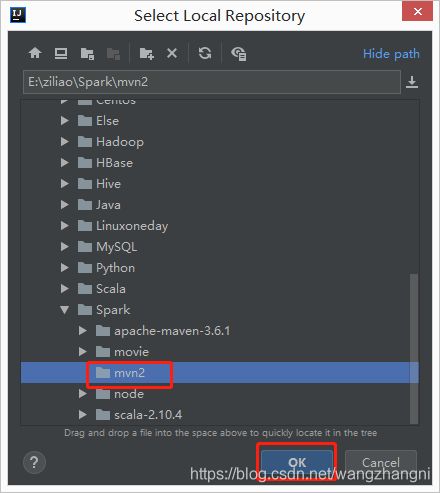

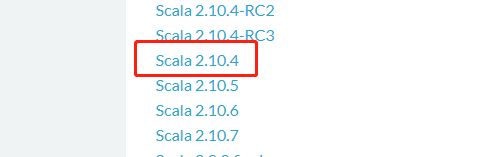

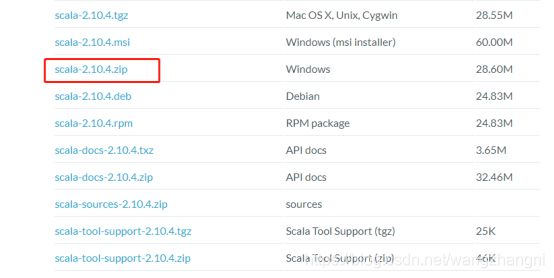

二、在idea中添加指定的scala版本

在spark1.5.1版本中需要的是scala的2.10.4版本,之前在windows中安装的是scala的2.12.7,此时我们需要在idea中安装需要的sdk版本

首先在scala的官网下载scala的2.10.4版本

Scala官网:https://www.scala-lang.org/download/

下载之后解压,然后打开idea

1、新建一个项目

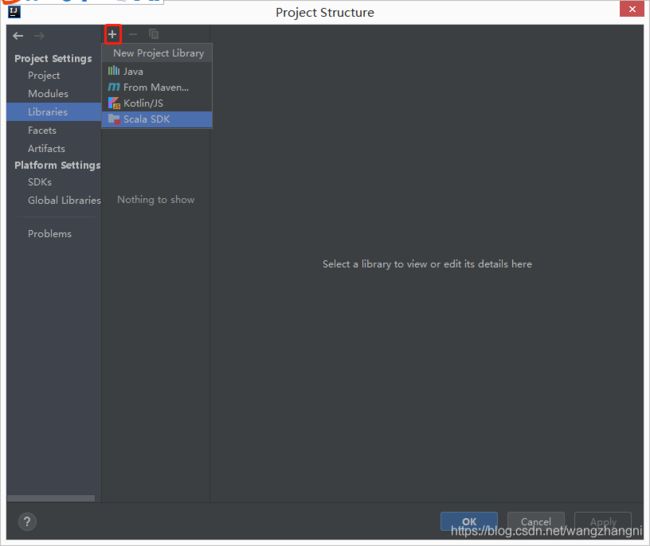

2、添加scala的2.10.4版本

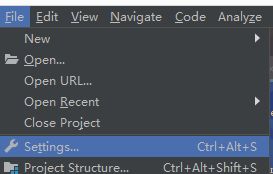

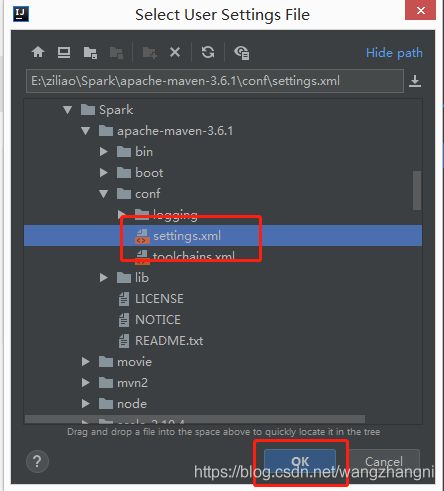

3、下载相关插件

<?xml version="1.0" encoding="UTF-8"?>

<project xmlns="http://maven.apache.org/POM/4.0.0"

xmlns:xsi="http://www.w3.org/2001/XMLSchema-instance"

xsi:schemaLocation="http://maven.apache.org/POM/4.0.0 http://maven.apache.org/xsd/maven-4.0.0.xsd">

<modelVersion>4.0.0</modelVersion>

<groupId>cn.spark</groupId>

<artifactId>spark-java-study</artifactId>

<version>1.0-SNAPSHOT</version>

<packaging>jar</packaging>

<properties>

<project.build.sourceEncoding>UTF-8</project.build.sourceEncoding>

</properties>

<dependencies>

<dependency>

<groupId>junit</groupId>

<artifactId>junit</artifactId>

<version>3.8.1</version>

<scope>test</scope>

</dependency>

<dependency>

<groupId>org.apache.spark</groupId>

<artifactId>spark-core_2.10</artifactId>

<version>1.5.1</version>

</dependency>

<dependency>

<groupId>org.apache.spark</groupId>

<artifactId>spark-sql_2.10</artifactId>

<version>1.5.1</version>

</dependency>

<dependency>

<groupId>org.apache.spark</groupId>

<artifactId>spark-hive_2.10</artifactId>

<version>1.5.1</version>

</dependency>

<dependency>

<groupId>org.apache.spark</groupId>

<artifactId>spark-streaming_2.10</artifactId>

<version>1.5.1</version>

</dependency>

<dependency>

<groupId>org.apache.hadoop</groupId>

<artifactId>hadoop-client</artifactId>

<version>2.4.1</version>

</dependency>

<dependency>

<groupId>org.apache.spark</groupId>

<artifactId>spark-streaming-kafka_2.10</artifactId>

<version>1.5.1</version>

</dependency>

</dependencies>

<build>

<sourceDirectory>src/main/java</sourceDirectory>

<testSourceDirectory>src/test</testSourceDirectory>

<plugins>

<plugin>

<artifactId>maven-assembly-plugin</artifactId>

<configuration>

<descriptorRefs>

<descriptorRef>jar-with-dependencies</descriptorRef>

</descriptorRefs>

<archive>

<manifest>

<mainClass></mainClass>

</manifest>

</archive>

</configuration>

<executions>

<execution>

<id>make-assembly</id>

<phase>package</phase>

<goals>

<goal>single</goal>

</goals>

</execution>

</executions>

</plugin>

<plugin>

<groupId>org.codehaus.mojo</groupId>

<artifactId>exec-maven-plugin</artifactId>

<version>1.2.1</version>

<executions>

<execution>

<goals>

<goal>exec</goal>

</goals>

</execution>

</executions>

<configuration>

<executable>java</executable>

<includeProjectDependencies>true</includeProjectDependencies>

<includePluginDependencies>false</includePluginDependencies>

<classpathScope>compile</classpathScope>

<mainClass>cn.spark.study.core.WordCountCluster_5</mainClass>

</configuration>

</plugin>

<plugin>

<groupId>org.apache.maven.plugins</groupId>

<artifactId>maven-compiler-plugin</artifactId>

<configuration>

<source>1.6</source>

<target>1.6</target>

</configuration>

</plugin>

</plugins>

</build>

</project>