【云计算】Hadoop3.1伪分布式环境搭建

1.环境准备

Hadoop3.1.1下载:Index of /dist/hadoop/common/hadoop-3.1.1[这里是图片001]https://archive.apache.org/dist/hadoop/common/hadoop-3.1.1/

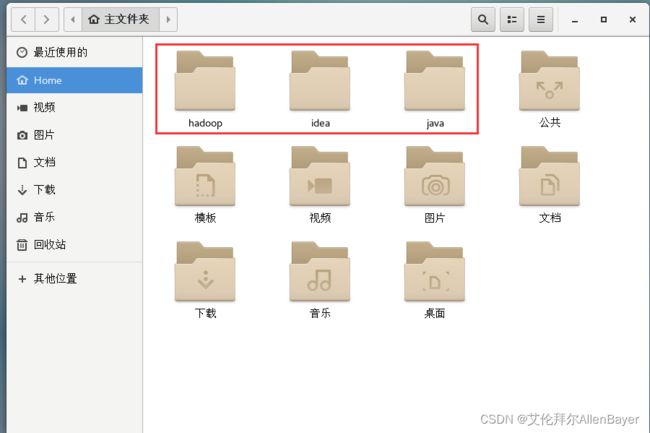

创建Centos7虚拟机之后,建立三个新文件夹用于存放文件

把我们的环境文件放入对应的文件夹

2.安装jdk1.8

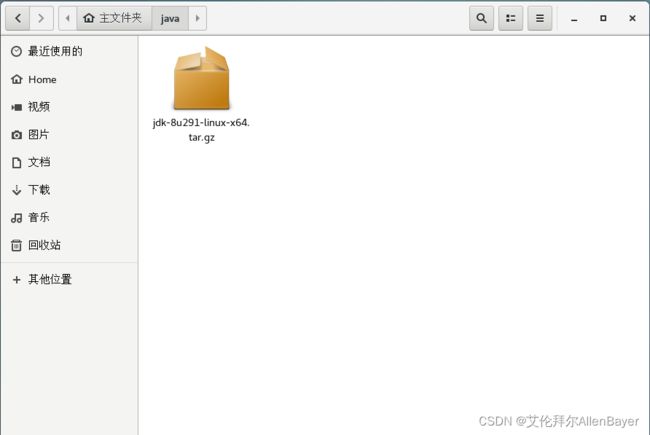

进入java文件夹,解压安装jdk1.8

[root@localhost master]# cd java

解压:

tar -zxvf jdk-8u291-linux-x64.tar.gz

移动:

mv jdk1.8.0_291 /usr/local/jdk1.8

修改配置文件:

vim /etc/profile

添加配置:

export JAVA_HOME=/usr/local/jdk1.8 export CLASSPATH= : C L A S S P A T H : :CLASSPATH: :CLASSPATH:JAVA_HOME/lib/ export PATH= P A T H : PATH: PATH:JAVA_HOME/bin

刷新配置:

source /etc/profile

转自:腾讯云服务器(linux终端)安装jdk1.8_Cabbage coder的博客-CSDN博客_腾讯云服务器终端

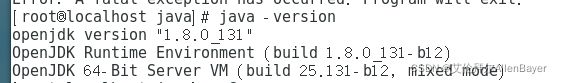

查看java版本

[root@localhost java]# java -version

jdk为1.8,安装成功

3.Hadoop配置

3.1 IP地址和主机名配置

执行

# vim /etc/hosts

写入我们的ip地址,并绑定一个名字

192.168.15.129是我们虚拟机的ip地址,master是我们为主机起的名字,我们这样做是把名字和主机ip绑定在一起

我们来测试一下是否绑定成功

在终端ping一下master

[root@localhost hadoop]# ping master

ping成功了

3.2安装Hadoop

进入Hadoop文件夹

解压Hadoop

tar -zxvf hadoop-3.1.1.tar.gz

移动Hadoop

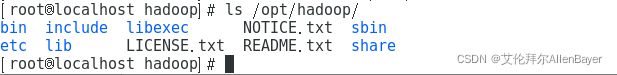

[root@localhost hadoop]# mv hadoop-3.1.1 /opt/hadoop

看一下移动结果

[root@localhost hadoop]# ls /opt/hadoop/

3.3进行Hadoop角色的配置

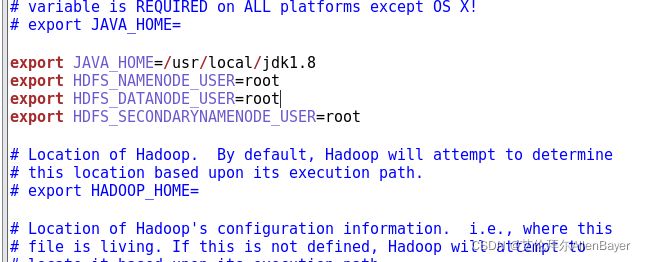

打开etc/hadoop/hadoop-env.sh进行配置

写入配置信息

export JAVA_HOME=/usr/local/jdk1.8

export HDFS_NAMENODE_USER=root

export HDFS_DATANODE_USER=root

export HDFS_SECONDARYNAMENODE_USER=root

etc/hadoop/core-site.xml 进入修改配置文件

写入配置

fs.defaultFS

hdfs://master:9820

hadoop.tmp.dir

/opt/sxt/local

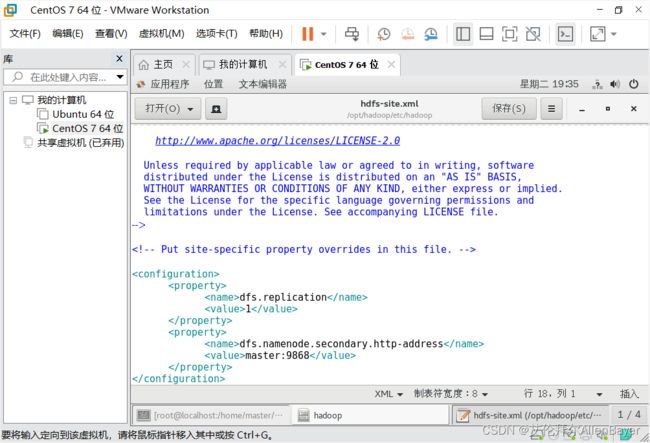

etc/hadoop/hdfs-site.xml 进入修改配置文件

dfs.replication

1

dfs.namenode.secondary.http-address

master:9868

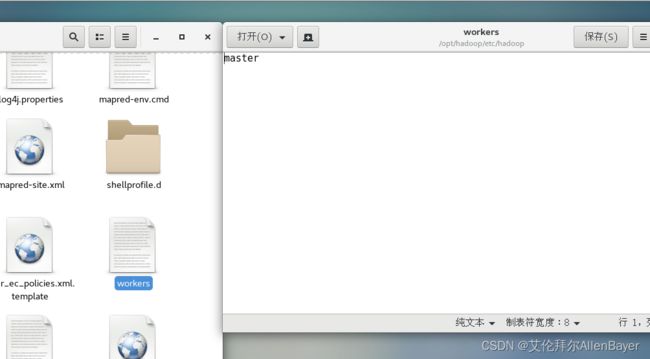

打开workers

改为自己的主机名(我的是master)

3.4执行format初始化命令(只在第一次安装时才初始化)

注意,在根目录的Hadoop下运行

[root@localhost hadoop]# ./bin/hdfs namenode -format

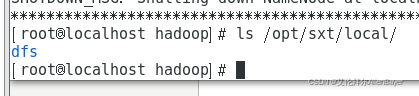

查看是否初始化生成指定文件夹

[root@localhost hadoop]# ls /opt/sxt/local/

4.设置SSH服务

安装SSH服务

yum -y install openssh openssh-server openssh-clients

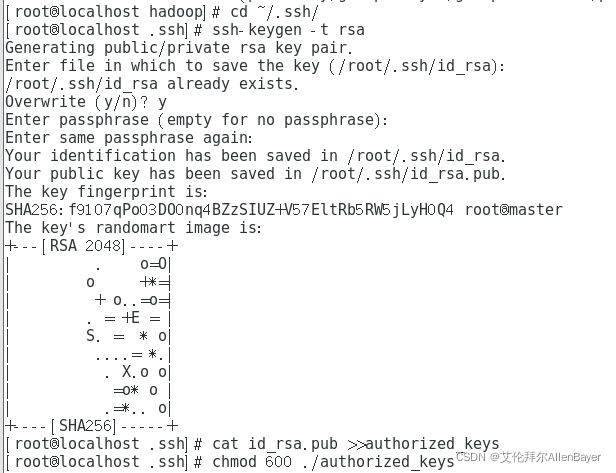

设置SSH免密登录

[root@localhost hadoop]# cd ~/.ssh/

[root@localhost .ssh]# ssh-keygen -t rsa

遇到输入的就回车

引用一张百度的图

将密钥加入到授权中,修改授权文件权限

[root@localhost .ssh]# cat id_rsa.pub >>authorized_keys

[root@localhost .ssh]# chmod 600 ./authorized_keys

测试一下,访问一下master

不用密码就能登录

5.启动Hadoop

在根目录Hadoop中启动Hadoop

[root@master hadoop]# ./sbin/start-dfs.sh

之前启动一次了,所以提示Stop it first

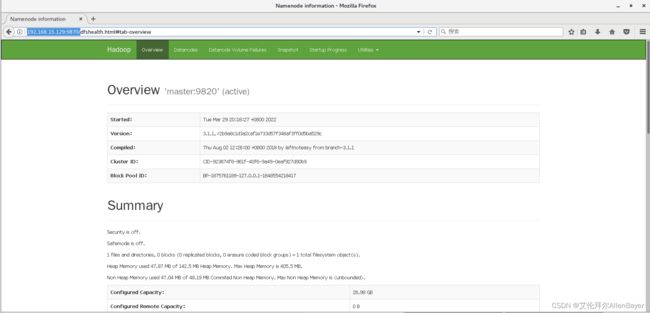

在centos的火狐浏览器中访问http://192.168.15.129:9870/

启动成功,至此,我们已经完成单台Hadoop配置