centos7安装hadoop集群(亲测可用)

环境准备

1、hadoop集群

| host | hostname |

|---|---|

| 192.168.46.22 | master |

| 192.168.46.23 | slave1 |

| 192.168.46.24 | slave2 |

2、软件版本

centos7:CentOS-7-x86_64-DVD-1708.iso 下载地址

hadoop:hadoop-2.9.2.tar.gz 下载地址

jdk:jdk-8u311-linux-x64.tar.gz 下载地址

虚拟机:VMware® Workstation 16 Pro

开始安装

一)准备三台虚拟机,ip地址即hostname如上所示

二)修改hostname(分别改成master、slave1、slave2)

[root@master ~]# vim /etc/hostname

master

重启 修改完hostname重启生效

[root@master ~]#reboot

三)在hosts文件末尾添加如下字段(master、slave1、slave2同样执行如下操作)

[root@master ~]# vim /etc/hosts

192.168.46.22 master

192.168.46.23 slave1

192.168.46.24 slave2

四)免密登录

[root@master ~]# ssh-keygen -t rsa #不输入密码,一路回车

[root@master ~]# ssh-copy-id slave1

[root@master ~]# ssh-copy-id slave2

#测试连通性,所有节点执行

[root@master ~]# ssh slave1

[root@master ~]# ssh slave2

[root@master ~]# ssh master

五)安装jdk(三个节点都需要安装)

1、将jdk放在 /opt/jdk 下并解压

[root@master jdk]# tar -zxvf jdk-8u311-linux-x64.tar.gz

2、设置环境变量,在末尾添加如下字段

[root@master ~]# vim /etc/profile

export JAVA_HOME=/opt/jdk/jdk1.8.0_311

export PATH=$PATH:$JAVA_HOME/bin

export CLASSPATH=.:$JAVA_HOME/lib/dt.jar:$JAVA_HOME/lib/tools.jar

3、刷新环境变量,使其生效

[root@master jdk]# source /etc/profile

六)安装hadoop(三个节点都安装)

1、创建几个必要目录

[root@master jdk]# mkdir /root/hadoop

[root@master jdk]# mkdir /root/hadoop/tmp

[root@master jdk]# mkdir /root/hadoop/var

[root@master jdk]# mkdir /root/hadoop/dfs

[root@master jdk]# mkdir /root/hadoop/dfs/name

[root@master jdk]# mkdir /root/hadoop/dfs/data

2、将hadoop-2.9.2.tar.gz 放在 /opt/hadoop 文件夹下

#解压

tar -zxvf hadoop-2.9.2.tar.gz

3、逐一修改配置文件,在如下目录

[root@master ~]# cd /opt/hadoop/hadoop-2.9.2/etc/hadoop

[root@master hadoop]# pwd

/opt/hadoop/hadoop-2.9.2/etc/hadoop

4、修改core-site.xml,添加如下配置

[root@master hadoop]# vim core-site.xml

hadoop.tmp.dir

/root/hadoop/tmp

Abase for other temporary directories.

fs.default.name

hdfs://master:9000

5、修改hadoop-env.sh,将JAVA_HOME改成如下字段

export JAVA_HOME=/opt/jdk/jdk1.8.0_311

6、修改 hdfs-site.xml,添加如下字段

[root@master hadoop]# vim hdfs-site.xml

dfs.name.dir

file:///root/hadoop/dfs/name

dfs.data.dir

file:///root/hadoop/dfs/data

dfs.replication

1

dfs.webhdfs.enabled

true

dfs.safemode.threshold.pct

0.999f

dfs.permissions.enabled

false

dfs.nameservices

lisy-cluster

dfs.namenode.secondary.http-address

master:50090

7、修改mapred-site.xml,由于源文件中没有所以先复制出来一个

[root@master hadoop]# cp mapred-site.xml.template mapred-site.xml

[root@master hadoop]# vim mapred-site.xml

mapreduce.framework.name

yarn

true

mapreduce.jobhistory.address

master:10020

mapreduce.jobhistory.webapp.address

master:19888

mapreduce.jobtracker.http.address

master:50030

mapreduce.jobhistory.address

master:10020

mapreduce.jobhistory.webapp.address

master:19888

mapred.job.tracker

http://master:9001

8、修改slaves文件 注意(slave1、slave2此文件为空即可)

删除原有文件替换成如下字段

[root@master hadoop]# vim slaves

master

slave1

slave2

9、在 /opt/hadoop/hadoop-2.9.2/sbin/start-yarn.sh 文件末尾增加如下字段

作用:看日志

"$bin"/mr-jobhistory-daemon.sh start historyserver

10、将hadoop 添加到环境变量,在末尾添加如下字段

[root@master ~]# vim /etc/profile

export PATH=$PATH:/opt/hadoop/hadoop-2.9.2/bin

[root@master jdk]# source /etc/profile

启动Hadoop

1、初始化namenode

hadoop namenode -format

2、启动hadoop

[root@master ~]# cd /opt/hadoop/hadoop-2.9.2/sbin

[root@master sbin]# ./start-all.sh

3、观测是否启动成功,存在如下进程则表示运行正常

[root@master sbin]# jps

37728 ResourceManager

37908 NodeManager

18022 JobHistoryServer

37494 DataNode

37353 NameNode

40157 Jps

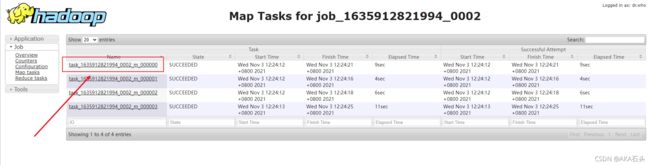

4、打开网址查看文件系统和集群

http://192.168.46.22:50070/ 查看hdfs文件

http://192.168.46.22:8088/cluster 查看map任务log