中国最大AI预训练模型发布:113亿参数!北京智源研究院、阿里、清华等联手打造

金磊 发自 凹非寺

量子位 报道 | 公众号 QbitAI

不久前,OpenAI 的GPT-3成功跨界,摇身一变成为“设计师”,名曰DALL·E。

而近日,北京智源人工智能研究院发布了与此类似的中国最大AI模型文汇,包含113亿参数。

据了解,这是面向认知的超大规模新型预训练模型,为的就是解决当前大规模自监督预训练模型不具有认知能力的问题。

这一项目由北京智源人工智能研究院、阿里巴巴、清华大学、中国人民大学、中国科学院、搜狗、智谱.AI、循环智能等共同完成。

“文汇”具有怎样的能力?

“文汇”主要面向的是认知,“看图说话”是它一种基本能力。

例如,给出下面一张图片:

“文汇”便能根据这张图给出这样的描述:

旗袍是一种古典的风格,它不仅能够彰显出女性优雅气质,而且还具有很好的修饰身形。这款旗袍采用了经典的圆领设计,穿着舒适自在,同时又能够展现出女性柔美的颈部线条,让你更加的迷人。精致的绣花工艺,使得整件衣服看起来更加的精致,也更加的凸显出女性的魅力。

也可以在给定一些提示 (Prompt)和图片的情况下生成文字。

例如,给定的提示是:

走进平定县宋家庄村,映入眼帘的是

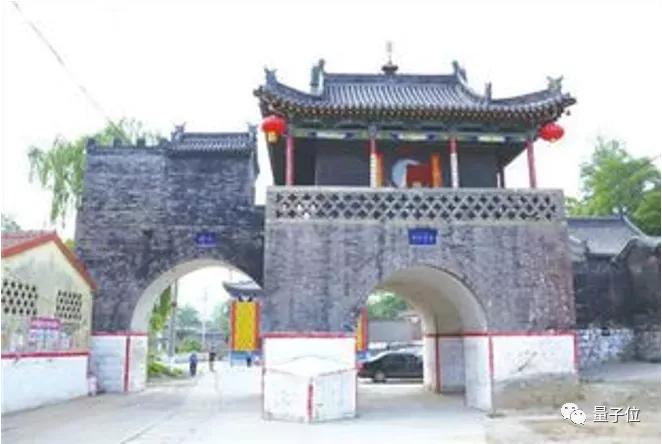

再给出如下所示的图像:

“文汇”所生成的文字内容为:

一座座古色古香的明清建筑,这里有着浓厚的历史文化底蕴和独特的民俗风情。走进村子,就像走进了一个童话故事里的世外桃源。村子里的房屋依山而建,错落有致地分布着各种各样的古建筑群,古朴典雅的建筑风格让人耳目一新。

嗯,确实有“看图写作”的味道了。

而在此技术背后,是研究组提出的针对多模态认知生成的大规模预训练的架构M6:MultiModality-to-MultiModality Multi-task Mega-Transformer。

据了解,模型整体架构基于Transformer,其中图像进行切块并对块采用ResNet-50提取特征。

这些特征以及对应的position embedding让图像和文本能组合在一起送入模型。

而与GPT不同的是,研究人员使用Transformer-XL来替换了GPT中原来的Transformer模型,从而能够生成超过Transformer的窗口长度(一般为512)的文本。

系统工程方面,采用的是阿里统一多种并行策略的分布式框架Whale,256卡训练速度是8GPU的29.4倍,加速比接近线性;而基于中文百科、知乎、问答三类数据,则由搜狗提供。

据介绍,“文汇”的部分应用即将合作上线,目前已有四个样例应用可用于展示效果:

- 基于上传图片的开放域问答:可以支持用户上传图片后,针对图片内容进行提问或生成图片的一句话描述。

- Talk to Data:只需要一句自然语言的话,就可以实现数据的可视化自动统计与查询。

- 基于预训练语言模型的诗词创作应用:可以基于输入的诗歌题目、朝代、作者,生成仿古诗词。

- 可控人设的开放域问答:支持用户上传问题,并生成具有人物角色风格的定制化文本回答。

为什么要做“文汇”?

GPT-3等现有主流模型的能力是有目共睹的,但智源人工智能研究院为什么还要打造“文汇”呢?

据介绍,虽然GPT-3在多项任务中表现出色,但它最大的问题是没有常识,不具有认知能力。

例如,如果问GPT-3“长颈鹿有几个眼睛”?

GPT-3会回答“2个眼睛”。

但若继续追问“我的脚有几个眼睛”?

GPT-3的回答依旧是“2个眼睛”。

对此,智源研究院学术副院长、清华大学计算机系唐杰教授认为:

GPT-3等超大型预训练模型在处理复杂的认知推理任务上,例如开放对话、基于知识的问答、可控文本生成等,结果仍然与人类智能有较大差距。

为了解决诸如此类现存的问题,早在去年10月,智源研究院启动了新型超大规模预训练模型研发项目“悟道”。

而此次发布的是“文汇”,是用于自动生成图片、文字以及视频,具有初级认知能力。

智源研究院院长、北京大学信息技术学院黄铁军教授指出:

“文汇”模型针对性地设计了多任务预训练的方法,可以同时学习文→文、图→文以及图文→文等多项任务,实现对多个不同模态的概念理解。

目前,“悟道”项目研究团队已经启动了四类大规模预训练模型的研制,包括:

- 文源,以中文为核心的超大规模预训练语言模型。

- 文汇,面向认知的超大规模新型预训练模型。

- 文澜,超大规模多模态预训练模型。

- 文溯,超大规模蛋白质序列预训练模型。

去年11月14日,智源研究院已发布了“文源”第一阶段26亿参数规模的中文语言模型。

据介绍,智源研究院的下一步,是加快四类大规模预训练模型的研发进度。

特别是“文汇”模型,未来将着力在多语言、多模态条件下,提升完成开放对话、基于知识的问答、可控文本生成等复杂认知推理任务的能力,使其更加接近人类水平。

并计划在今年的6月份,实现“中文自然语言应用系统”、“基于图文增强和知识融入的图文应用系统”、“基于认知的复杂认知系统”等一批各具特色的超大规模预训练模型。

参考链接:

https://mp.weixin.qq.com/s/0R-jqJZ7Xl1vGa0lf4gEPAmp.weixin.qq.com

—完—