零基础YOLOv5的详细使用教程

零基础YOLOv5的详细使用教程

- 说明

-

- 一.yolov5的下载

- 二.安装requirements.txt 中指定的所需环境

-

- 1.使用pip批量安装

- 2.使用pip单个安装

- 3.特殊问题

- 三.下载并训练coco128数据集

-

- 1.coco128下载方式:

- 2.下载预训练模型

- 3.训练coco128数据集

- 四.训练自己的数据集

-

- 1.准备数据集

- 2.构建数据集

- 训练自己的数据集

说明

本文章针对零基础yolov5的学习,包括了yolov5的下载、安装以及调试;同时使用了手势识别项目进行测试。

一.yolov5的下载

链接: https://github.com/ultralytics/yolov5.

网上关于yolov5的下载方式有很多,这个不一定是最新的,在下载前可以在网上搜索看自己需要那种。

二.安装requirements.txt 中指定的所需环境

1.使用pip批量安装

安装所需环境方式有很多,可以在yolov5目录下使用pip指令运行requirements.txt,这种方式最简单,但很有可能会遇到有些依赖无法安装的情况,这时需要使用第二种方法进行单个安装。

2.使用pip单个安装

这种方法秩序直接打开命令提示符使用pip install xxxx 的方式,对所需以来进行单个逐步安装。这种方式较为繁琐,但可以清楚知道那部分安装失败,然后进行解决。

pip install xxxx

3.特殊问题

在requirements.txt中,pycocotools>=2.0 # COCO mAP的安装很容易失败,原因是安装该依赖包所需的环境为vc++14.0,于是下载了visual studio 2019,但仍是无法安装,于是就单独安装了 vc++2015 build tools,具体解决方式见文章: https://blog.csdn.net/sinat_33486980/article/details/92840377.

三.下载并训练coco128数据集

1.coco128下载方式:

coco128数据是COCO train2017数据的一部分,只取了coco数据集中的128张标注的图片,下载地址为:

链接:https://pan.baidu.com/s/1mQ8Uav0biE1IgFWDQldTJw

提取码:pcdh

下载完后解压到/yolov5目录下即可,解压后的coco128文件结构如下:

coco128

|-- LICENSE

|-- README.txt # 相关说明

|-- DS_Store

|-- images # 128张jpg图片

`-- labels # 128张标注的txt文件

2.下载预训练模型

由于文件较大,在github上下载较慢,所以上传到了百度网盘和csdn上:

链接:https://pan.baidu.com/s/1oysJ8uAdWA_TW1BsvMEVZQ

提取码:o7hd

csdn下载地址:

在预训练模型中,yolov5s.pt训练速度最快,yolov5x.pt速度最慢,但训练效果最好。

3.训练coco128数据集

需要调整的参数

train.py

def parse_opt(known=False):

parser = argparse.ArgumentParser()

parser.add_argument('--weights', type=str, default='F:/yolov5/paper_date/weights/yolov5s.pt', help='initial weights path')

parser.add_argument('--cfg', type=str, default='F:/yolov5/yolov5-master/models/yolov5s.yaml', help='model.yaml path')

parser.add_argument('--data', type=str, default='F:/yolov5/paper_date1/ab.yaml', help='dataset.yaml path')

parser.add_argument('--hyp', type=str, default='F:/python code/yolov5/yolov5-master/data/hyps/hyp.scratch.yaml', help='hyperparameters path')

parser.add_argument('--epochs', type=int, default=200)

parser.add_argument('--batch-size', type=int, default=4, help='total batch size for all GPUs')

parser.add_argument('--imgsz', '--img', '--img-size', type=int, default=480, help='train, val image size (pixels)')

parser.add_argument('--rect', action='store_true', help='rectangular training')

parser.add_argument('--resume', nargs='?', const=True, default=False, help='resume most recent training')

parser.add_argument('--nosave', action='store_true', help='only save final checkpoint')

parser.add_argument('--noval', action='store_true', help='only validate final epoch')

parser.add_argument('--noautoanchor', action='store_true', help='disable autoanchor check')

epochs:指的就是训练过程中整个数据集将被迭代多少次,显卡不行你就调小点。

batch-size:一次看完多少张图片才进行权重更新,梯度下降的mini-batch,显卡不行你就调小点。

cfg:存储模型结构的配置文件

data:存储训练、测试数据的文件

img-size:输入图片宽高,显卡不行你就调小点。

rect:进行矩形训练

resume:恢复最近保存的模型开始训练

nosave:仅保存最终checkpoint

notest:仅测试最后的epoch

evolve:进化超参数

bucket:gsutil bucket

cache-images:缓存图像以加快训练速度

weights:权重文件路径

name: 重命名results.txt to results_name.txt

device:cuda device, i.e. 0 or 0,1,2,3 or cpu

adam:使用adam优化

multi-scale:多尺度训练,img-size +/- 50%

single-cls:单类别的训练集

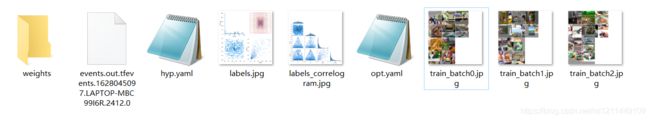

训练完成后,在yolov5/runs目录下即出现训练文件,表示训练成功。

四.训练自己的数据集

1.准备数据集

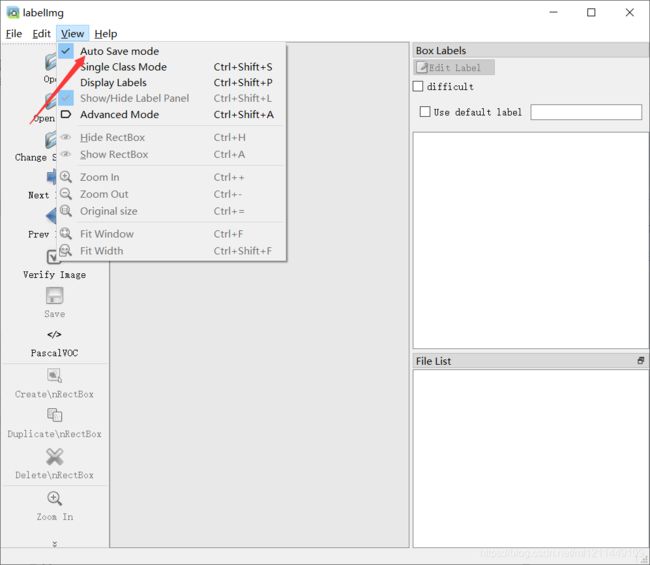

yolov5中的数据集的标签都是保存为YOLO格式的txt文件的。选择自己所需要的土浦安后,需要用LabelImg对图片进行标注。

Open为打开一张照片,一般选择Open Dir打开图片所在文件夹,方便对图片进行批量编辑,Change Save Dir为保存地址。快捷键:

w:打标签

d:下一张

a:上一张

需要提前设置自动保存。

2.构建数据集

在paper_date目录下创建三个文件夹,结构如下:

paper_date

......images #存放图像

......Annotations #存放图像对应的xml文件

......ImageSets/Main #存放训练/存放train.txt/val.txt/test.txt/trainval.txt文件

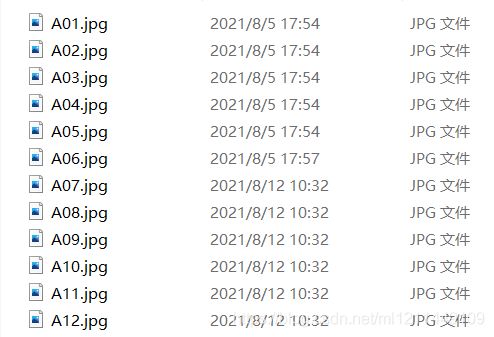

images为VOC数据集格式中的JPEGImages,内容如下:

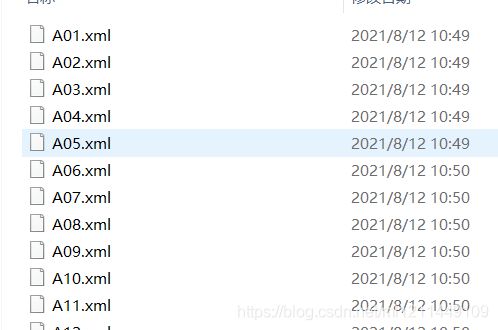

Annotations文件夹下面为xml文件,内容如下:

ImageSets文件夹下面新建一个Main子文件夹,用来存放训练集、验证集、测试集的划分,通过脚本生成,可以创建一个split_train_val.py文件,代码内容如下:

# coding:utf-8

import os

import random

import argparse

parser = argparse.ArgumentParser()

#xml文件的地址,根据自己的数据进行修改 xml一般存放在Annotations下

parser.add_argument('--xml_path', default='Annotations', type=str, help='input xml label path')

#数据集的划分,地址选择自己数据下的ImageSets/Main

parser.add_argument('--txt_path', default='ImageSets/Main', type=str, help='output txt label path')

opt = parser.parse_args()

trainval_percent = 1.0

train_percent = 0.9

xmlfilepath = opt.xml_path

txtsavepath = opt.txt_path

total_xml = os.listdir(xmlfilepath)

if not os.path.exists(txtsavepath):

os.makedirs(txtsavepath)

num = len(total_xml)

list_index = range(num)

tv = int(num * trainval_percent)

tr = int(tv * train_percent)

trainval = random.sample(list_index, tv)

train = random.sample(trainval, tr)

file_trainval = open(txtsavepath + '/trainval.txt', 'w')

file_test = open(txtsavepath + '/test.txt', 'w')

file_train = open(txtsavepath + '/train.txt', 'w')

file_val = open(txtsavepath + '/val.txt', 'w')

for i in list_index:

name = total_xml[i][:-4] + '\n'

if i in trainval:

file_trainval.write(name)

if i in train:

file_train.write(name)

else:

file_val.write(name)

else:

file_test.write(name)

file_trainval.close()

file_train.close()

file_val.close()

file_test.close()

运行代码后,在Main文件夹下生成下面四个txt文档:

接下来将labels文件夹编写,创建voc_label.py文件,将训练集、验证集、测试集生成label标签(训练中要用到),同时将数据集路径导入txt文件中,代码内容如下:

# -*- coding: utf-8 -*-

import xml.etree.ElementTree as ET

import os

from os import getcwd

sets = ['train', 'val', 'test']

classes = ["A", "B", "C", "D", "E", "F", "G", "H", "I", "J", "K", "L", "M", "N", "O", "P", "Q", "R", "S", "T", "U", "V" "W", "X", "Y", "Z"] # 改成自己的类别

abs_path = os.getcwd()

print(abs_path)

def convert(size, box):

dw = 1. / (size[0])

dh = 1. / (size[1])

x = (box[0] + box[1]) / 2.0 - 1

y = (box[2] + box[3]) / 2.0 - 1

w = box[1] - box[0]

h = box[3] - box[2]

x = x * dw

w = w * dw

y = y * dh

h = h * dh

return x, y, w, h

def convert_annotation(image_id):

in_file = open('F:/yolov5/paper_date1/Annotations/%s.xml' % (image_id), encoding='UTF-8')

out_file = open('F:/yolov5/paper_date1/labels/%s.txt' % (image_id), 'w')

tree = ET.parse(in_file)

root = tree.getroot()

size = root.find('size')

w = int(size.find('width').text)

h = int(size.find('height').text)

for obj in root.iter('object'):

#difficult = obj.find('difficult').text

difficult = obj.find('difficult').text

cls = obj.find('name').text

if cls not in classes or int(difficult) == 1:

continue

cls_id = classes.index(cls)

xmlbox = obj.find('bndbox')

b = (float(xmlbox.find('xmin').text), float(xmlbox.find('xmax').text), float(xmlbox.find('ymin').text),

float(xmlbox.find('ymax').text))

b1, b2, b3, b4 = b

# 标注越界修正

if b2 > w:

b2 = w

if b4 > h:

b4 = h

b = (b1, b2, b3, b4)

bb = convert((w, h), b)

out_file.write(str(cls_id) + " " + " ".join([str(a) for a in bb]) + '\n')

wd = getcwd()

for image_set in sets:

if not os.path.exists('F:/yolov5/paper_date1/labels/'):

os.makedirs('F:/yolov5/paper_date1/labels/')

image_ids = open('F:/yolov5/paper_date1/ImageSets/Main/%s.txt' % (image_set)).read().strip().split()

list_file = open('F:/yolov5/paper_date1/%s.txt' % (image_set), 'w')

for image_id in image_ids:

list_file.write(abs_path + 'F:/yolov5//paper_date1/images/%s.jpg\n' % (image_id))

convert_annotation(image_id)

list_file.close()

注:需将代码中所填地址改为自己各文件所在地址,相对地址、绝对地址都可。

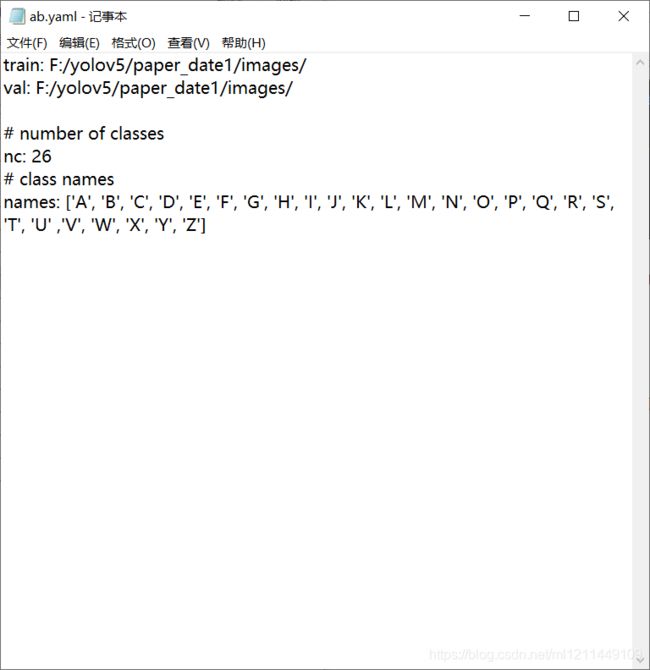

然后在yolov5目录下的data文件夹下新建一个ab.yaml文件(可以自定义命名),用来存放训练集和验证集的划分文件(train.txt和val.txt),这两个文件是通过运行voc_label.py代码生成的,然后是目标的类别数目和具体类别列表,ab.yaml内容如下:

train、val、nc、names都需要更改,自己需要什么改为什么,地址需用反斜杠(/),train、val后需要加一个空格

训练自己的数据集

参照训练coco128数据集,对train.py内的参数进行性修改。

在终端输入:

python3 train.py --img 640 --batch 8 --epoch 5 --data my_Data/my_data.yaml --cfg my_Data/my_yolov5s.yaml --weights weights/yolov5s.pt --device cpu # 0号GPU -device 0

如过已经在程序中更改过参数,可直接运行即可。