Task01:概览西瓜书+南瓜书第1、2章

Task01:概览西瓜书+南瓜书第1、2章

第1章 绪论

基本术语

数据集(data set):关于事件/对象的描述记录的集合(其中每条记录—“示例instance/样本sample”)

属性(attribute)/特征(feature):反映事件/对象在某方面的表现or性质的事项

属性值(attribute value):属性上的取值

属性空间(attribute space)/样本空间(sample space)/输入空间:属性张成的空间

特征向量(feature vector):每个示例在属性空间中都对应一个点,有一个坐标向量,因此将示例称为特征向量

一般地,令 D = { x 1 ⃗ , x 2 ⃗ , . . . , x m ⃗ } D=\{\vec{x_1},\vec{x_2},...,\vec{x_m}\} D={x1,x2,...,xm}表示包含m个示例的数据集,每个示例由d个属性描述 x i ⃗ = ( x i 1 ; x i 2 ; . . . ; x i d ) \vec{x_i}=(x_{i1};x_{i2};...;x_{id}) xi=(xi1;xi2;...;xid),是d维样本空间 x \mathcal{x} x中的一个向量,其中 x i j x_{ij} xij是 x i ⃗ \vec{x_{i}} xi在第j个属性上的取值,d是样本维数。

学习(learning)/训练(training):从数据中学习模型的过程(通过执行某个学习算法完成)

训练数据(training data):训练用数据;其中每个样本—训练样本(training sample);训练样本集合—训练集(training set)

假设(hypothesis):学得模型对应了关于数据的某种潜在规律,而这种潜在规律自身—真相/真实(ground-truth),学习过程就是为了找出或逼近真相。

模型(model)—学习器(learner):学习算法在给定数据和参数空间上的实例化

{ 学习算法基于经验数据产生模型,对学习算法设置不同的参数值,使用不同的训练数据集,会产生不同的结果 }

标记(label):示例结果的信息(例如猫/狗,好瓜/坏瓜),拥有标记信息的示例—样例(example)

一般地, ( x i ⃗ , y i ) (\vec{x_i},y_i) (xi,yi)表示第i个样例, y i ∈ y y_i\in\mathcal{y} yi∈y是示例 x i ⃗ \vec{x_i} xi的标记, y \mathcal{y} y是所有标记的集合,即标记空间(label space)/输出空间

使用学得模型进行预测—测试(testing),被预测样本—测试样本(testing sample),得到预测标记

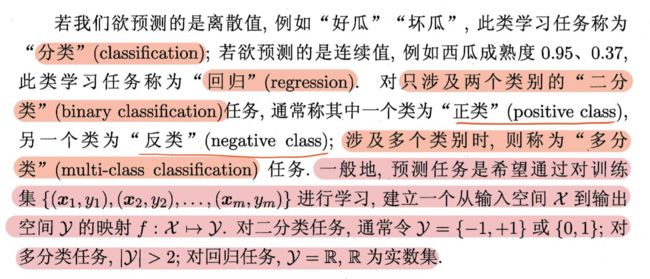

学习任务分类(根据训练数据是否拥有标记信息)

- 监督学习(supervised learning):分类,回归.etc

- 无监督学习(unsupervised learning):聚类.etc

泛化(generalization):学的模型适用于新样本的能力

假设空间

科学推理的两大基本手段:

- 归纳(induction):从特殊到一般的泛化过程(generalization),从具体事实归结出一般性规律

- 演绎(deduction):从一般到特殊的特化过程(specialization),从基础原理推演出具体状况

感觉与语法分析有异曲同工之妙

归结:从具体句子—>语法

推导:从基本语法—>具体句子

在数学公理系统中,基于一组公理和推导规则推导出与之相恰的定理—演绎,从样例中学习—归纳学习。

归纳学习:

-

广义:大体相当相当于从样例中学习

-

狭义:从训练数据中学得概念(concept),概念学习/概念形成

布尔概念学习:对可以表示为0/1布尔值的目标概念的学习。

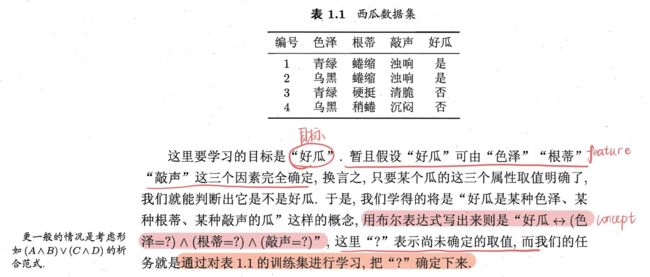

举例分析: 根据西瓜数据集学习好瓜的概念

编号1的瓜就是一个好瓜,但它只是好瓜概念的一个实例,如果仅通过”记住“训练样本(机械学习),只能对数据集中已知情况做出判断,不是好瓜的情况同理,对于不在数据集中的未知对象无法进行合理预测。

学习的目标是”泛化“:通过对训练集中瓜的学习以获得对没见过的瓜进行判断的能力。

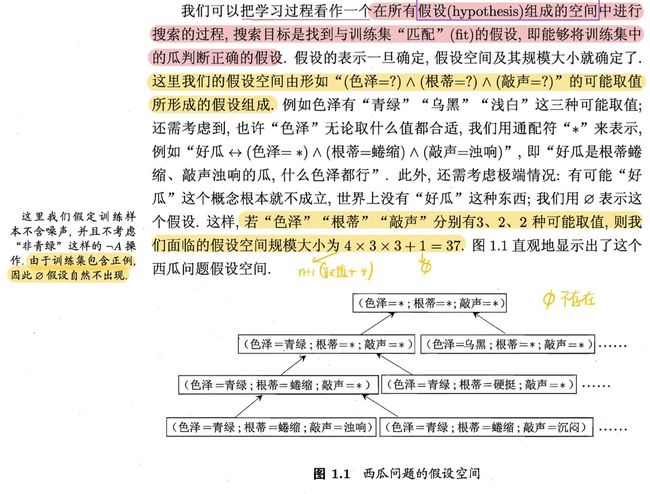

对假设空间进行搜索,删除与正例不一致/与反例一致的假设,最终得到与训练集一致的(即对所有训练样本都能正确判断的)假设

在现实问题中,基于很大的假设空间和有限样本训练集得到的结果中可能包含多个假设,即存在一个与训练集一致的假设集合——版本空间(version space)

归纳偏好

(某样本对版本空间的多个假设产生不同的结果——决定哪一个更好)

机器学习算法在学习过程中对某种类型假设的偏好——归纳偏好(inductive bias)/偏好

任何一个有效的机器学习算法必有其归纳偏好,否则将被假设空间中看似在训练集上”等效“的假设所迷惑,而无法产生确定的学习结果。

归纳偏好可看作学习算法自身在假设空间中对假设进行选择的启发式或“价值观”。

用于引导算法确立”正确“偏好的一般性原则。

“奥卡姆剃刀”——常用的自然科学研究中的最基本原则:若有多个假设与观察一致,则选最简单的那个。

简单的评价标准?需要借助其他机制才能解决。

NFL定理:若考虑所有潜在问题,则所有学习算法一样好,讨论算法的相对优劣,必须要针对具体的学习问题,学习算法自身的归纳偏好与问题是否相配对算法优劣性起到决定性作用。

第二章 模型评估与选择

一些概念

错误率(error rate):分类错误样本数占样本总数的比例。例:m个样本中有a个分类错误: E = a / m E=a/m E=a/m.

精度(accuracy): 精度=1-错误率= 1 − E 1-E 1−E.

误差(error):学习器的实际预测输出与样本的真实输出之间的差异。

训练误差/经验误差(training/empircal error):学习器在训练集上的误差。

泛化误差(generalization error):学习器在新样本上的误差。

学习的目的是为了得到泛化误差小的学习器,但通过已有数据实际只能令经验误差最小化,而经验误差由于过拟合现象存在而不适合作为评价标准。

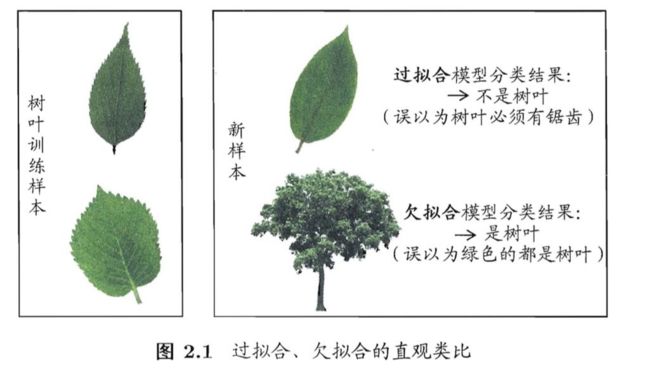

学习中的过拟合现象

过拟合是机器学习面临的关键障碍,且是无法彻底避免。

评估方法

在现实任务中的处理方式:将数据集进行适当的处理从中产生训练集S,测试集T

分离训练集与测试集的常见做法

- 留出法

- 交叉验证法

- 自助法

调参与最终模型