过拟合及过拟合处理

文章

-

- 一、过拟合

-

- 过拟合示例代码:

-

- 1.导入第三方库

- 2.加载数据及数据处理

- 3.搭建模型

- 4.训练模型

- 5.分析训练过程

- 二、Dropout层

-

- 解决过拟合问题

- 三、构建网络的总原则

一、过拟合

过拟合:在训练数据上得分很高,在测试数据上得分相对比较低。

欠拟合:在训练数据上得分比较低,在测试数据上得分相对比更低。

过拟合示例代码:

代码运行平台为jupyter-notebook,文章中的代码块,也是按照jupyter-notebook中的划分顺序进行书写的,运行文章代码,直接分单元粘入到jupyter-notebook即可。

1.导入第三方库

import matplotlib.pyplot as plt

import tensorflow as tf

import pandas as pd

import numpy as np

%matplotlib inline

2.加载数据及数据处理

# 载入fashion_mnist数据

(train_image,train_label),(test_image,test_label) = tf.keras.datasets.fashion_mnist.load_data()

# 对数据进行归一化

train_image = train_image/255.

test_image = test_image/255.

# 将顺序编码转为独热编码

train_label_onehot = tf.keras.utils.to_categorical(train_label)

test_label_onehot = tf.keras.utils.to_categorical(test_label)

3.搭建模型

model = tf.keras.Sequential()

model.add(tf.keras.layers.Flatten(input_shape=(28,28)))

model.add(tf.keras.layers.Dense(128, activation='relu'))

model.add(tf.keras.layers.Dense(128, activation='relu'))

model.add(tf.keras.layers.Dense(128, activation='relu'))

model.add(tf.keras.layers.Dense(10, activation='softmax'))

4.训练模型

model.compile(optimizer=tf.keras.optimizers.Adam(learning_rate=0.001),

loss='categorical_crossentropy',

metrics=['acc']

)

history = model.fit(train_image, train_label_onehot,

epochs=10,

validation_data=(test_image, test_label_onehot))

# dict_keys(['loss', 'acc', 'val_loss', 'val_acc'])

print(history.history.keys())

5.分析训练过程

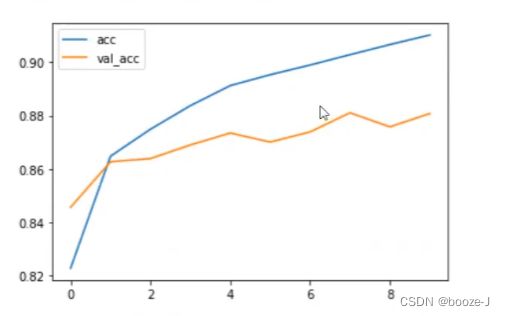

# 绘制训练集准确率随训练批次的变化关系

plt.plot(history.epoch, history.history.get('acc'), label='acc')

# 绘制验证集准确率随训练批次的变化关系

plt.plot(history.epoch, history.history.get('val_acc'), label='val_acc')

plt.legend()

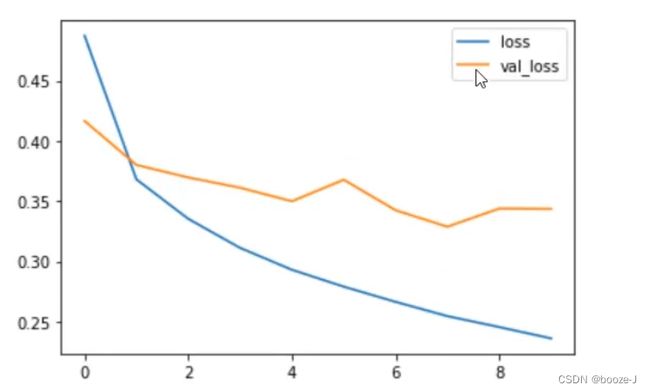

在验证数据集上的loss有一个先下降后上升的过程,而在训练数据集上的loss是不断的在下降,模型就是在训练集上效果很好,在验证机上效果一般,说明模型有过拟合的表现

# 绘制训练集损失随训练批次的变化关系

plt.plot(history.epoch, history.history.get('loss'), label='loss')

# 绘制验证集损失随训练批次的变化关系

plt.plot(history.epoch, history.history.get('val_loss'), label='val_loss')

plt.legend()

从正确率这里也可以看到,模型在训练集和验证集上的正确率有着巨大的鸿沟,这也说明着模型存在过拟合表现。

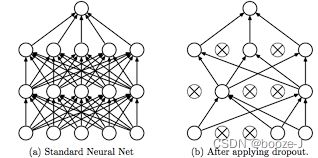

二、Dropout层

解决过拟合问题

使用dropout之后,每次训练都只是使用部分神经元进行训练,然后模型训练完之后,最后测试的时候,是使用所有神经元进行测试的,所以可以在一定程度上避免过拟合问题的产生。

只需要在示例代码中的搭建模型中加上dropout层即可:

model = tf.keras.Sequential()

model.add(tf.keras.layers.Flatten(input_shape=(28,28))) # 28*28

model.add(tf.keras.layers.Dense(128, activation='relu'))

model.add(tf.keras.layers.Dropout(0.5))

model.add(tf.keras.layers.Dense(128, activation='relu'))

model.add(tf.keras.layers.Dropout(0.5))

model.add(tf.keras.layers.Dense(128, activation='relu'))

model.add(tf.keras.layers.Dropout(0.5))

model.add(tf.keras.layers.Dense(10, activation='softmax'))

三、构建网络的总原则

- 1.增大网络容量,网络复杂度,直到模型过拟合

- 2.采取措施抑制过拟合(dropout,正则化,图像增强)

- 3.调节参数(训练批次,学习率等等)