深度学习之卷积神经网络CNN

需要PPT加Q1271370903

一、深度学习引入

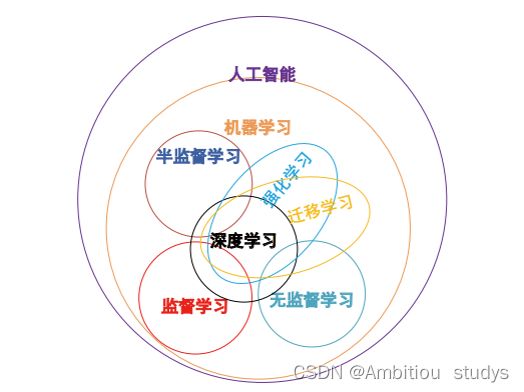

1.各学习方法之间的联系

SL、 SSL和UL是传统ML方法:DL提供了一个更强大的预测模型,可产生良好的预测结果;RL提供了更口快的学习机制,且更适应环境的变化;TL突破了任务的限制,将TL应用于RL中,能帮助RL更好地落实到实际问题。

2.概念

1.监督学习(Supervised learning,SL)向学习算法提供有标记的数据和所需的输出,对每一次输入,学习者均被提供了一个回应目标。根据标签类型进行划分,可将监督学习分为分类和回归两种问题。分类问题预测的是样本类别(离散的),而回归问题预测的是样本对应的实数输出(连续的)。常见的典型算法:决策树、支持向量机(SVM)、朴素贝叶斯、K近邻、随机森林等。

2.无监督学习(Unsupervised learning,UL)提供的数据都是未标记的,主要是通过建立一个模型,解释输入的数据,再应用于下一次输入。UL主要适用于聚类、降维等问题,常见的代表算法:聚类算法(K均值、AP聚类和层次聚类等)和降维算法(主成分分析等)。

3.半监督学习(Semi-Supervised Learning.SSL)属于UL和SL之间。

4.强化学习(Reinforcement learning,RL)的训练和uL同样都是使用未标记的训练集,其核心是描述并解决智能体在与环境交互的过程中学习策略以最大化回报或实现特定目标的问题。SL或UL主要应用的是统计学,RL则更多地使用了随机过程、离散数学等方法算法:Q-学习算法、瞬时差分法、自适应启发评价算法等。

5.迁移学习(Transfer Learning,TL)指的是根据任务间的相似性,将在辅助领域之前所学的知识用于相似却不相同的目标领域中来进行学习,有效地提高新任务的学习效率。

6.深度学习(Deep learning,DL)的训练样本是有标签的,试图使用复杂结构或由多重非线性变换构成的多个处理层对数据进行高层抽象。检测、图像识别、语言处理和识别等方面取得了良好的成效1990年卷积神经网络(Convolutional Neural Networks,CNN)开始被用于手写识别。2006年深度置信网络(DeepBelief Network. DBN)发表。

二、卷积神经网络

1.简介

卷积神经网络是一类包含卷积计算且具有深度结构的前馈神经网络(Feedforward Neural Networks),是深度学习的代表算法之一。卷积神经网络具有表征学习能力,能够按其阶层结构对输入信息进行平移不变分类,因此也被称为“平移不变人工神经网络”。

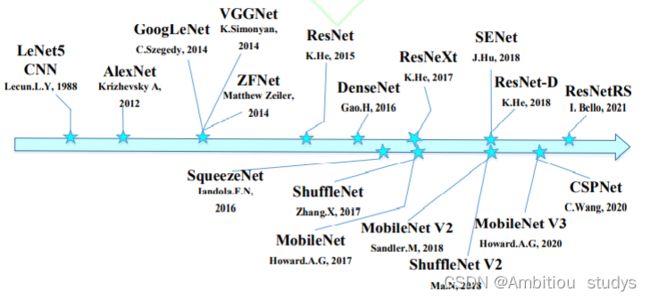

对卷积神经网络的研究始于二十世纪80至90年代,时间延迟网络和LeNet-5是最早出现的卷积神经网络;在二十一世纪后,随着深度学习理论的提出和数值计算设备的改进,卷积神经网络得到了快速发展,并被应用于计算机视觉、自然语言处理等领域(图像分类、图像分割、图像检测、文本等)。

卷积神经网络仿造生物的视知觉机制构建,可以进行监督学习和非监督学习,其隐含层内的卷积核参数共享和层间连接的稀疏性使得卷积神经网络能够以较小的计算量对格点化特征,例如像素和音频进行学习、有稳定的效果且对数据没有额外的特征工程要求。

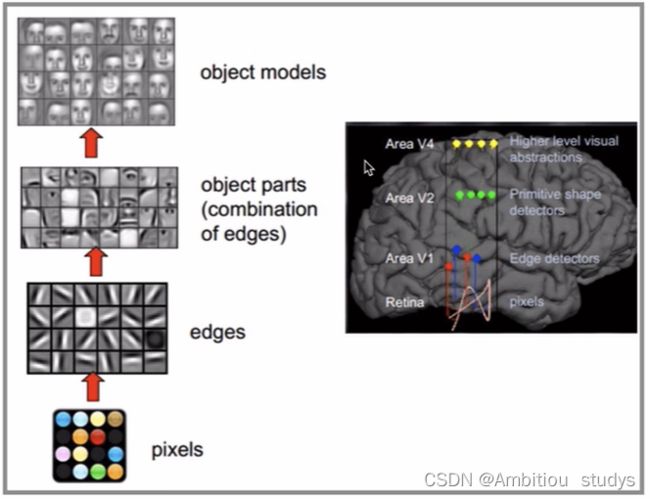

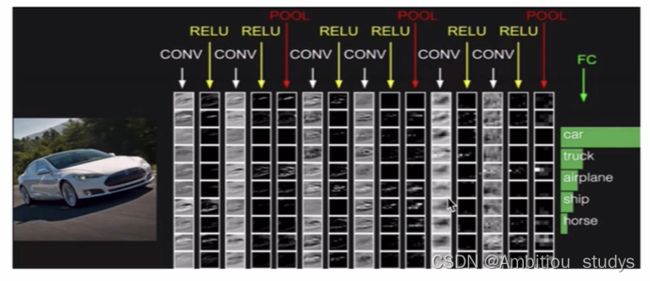

卷积神经网络的强大之处在于它的多层网络结构能自动学习输入数据的深层特征,不同层次的网络可以学习到不同层次的特征。浅层网络层感知区域较小,可以学习到输入数据的局部域特征(如图像物体的颜色、几何形状等);深层网络层具有较大的感知域,能够学习到输入数据中更加抽象一些特征(如图像物体的属性、轮廓特点、位置信息等高维性质)。深层次的抽象特征对图像中物体的大小、位置和方向等敏感度较低,从而大大提高了物体的识别率,因此卷积神经网络常用于图像处理领域。

2.发展

深度学习的典型代表,卷积神经网络(convolutional neural network, DCNN)在计算机视觉任务中大放异彩与人工提取特征的传统图像分类算法相比,卷积神经网络使用卷积操作对输入图像进行特征提取,有效地从大量样本中学习特征表达,模型泛化能力更强。

3.视觉角度

CNN网络受人类视觉神经系统的启发,人类的视觉原理:从原始信号摄入开始(瞳孔摄入像素Pixels),接着做初步处理(大脑皮层某些细胞发现边缘和方向),然后抽象(大脑判定,眼前的物体的形状,是圆形的),然后进一步抽象(大脑进一步判定该物体是只人脸)。下面是人脑进行人脸识别的一个示例:

4.结构

CNN网络主要有三部分构成:卷积层、池化层和全连接层构成,其中卷积层负责提取图像中的局部特征(激活函数、正则化等);池化层用来大幅降低参数量级(降维);全连接层类似人工神经网络的部分,用来输出想要的结果。

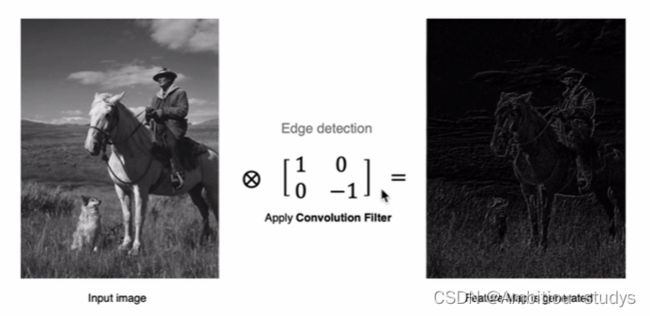

4.卷积层

卷积层是卷积神经网络中核心模块,卷积层的目的是提取输入特征图的特征,如下图提取图像中的边缘信息。

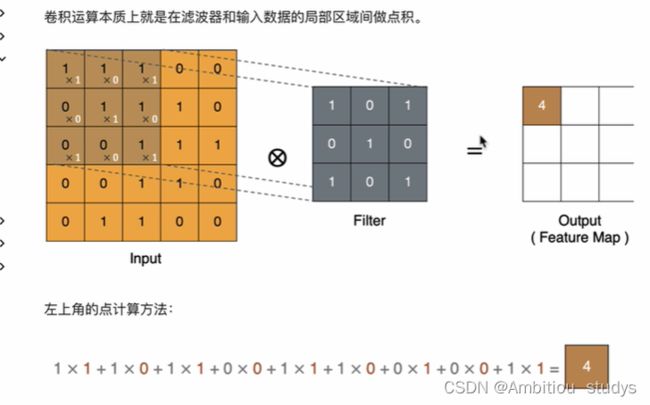

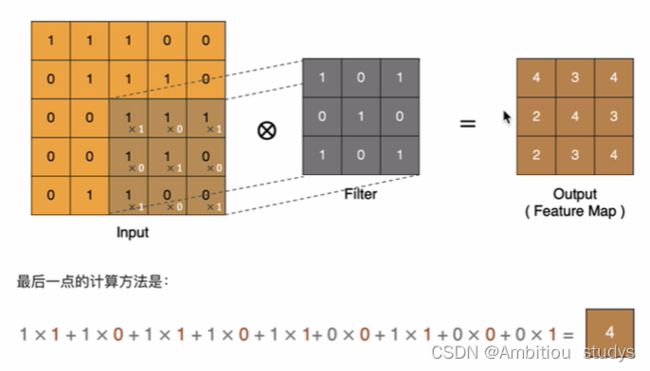

6.卷积计算

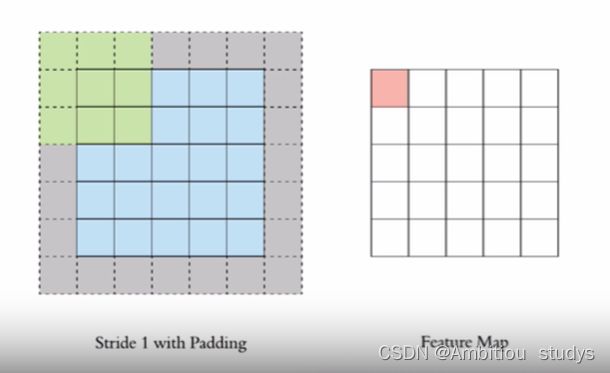

7.填充

在上述卷积过程中,特征图比原始图减少了很多,我们可以在原图像的周围进行padding,来保证在卷积过程中特征图大小不变

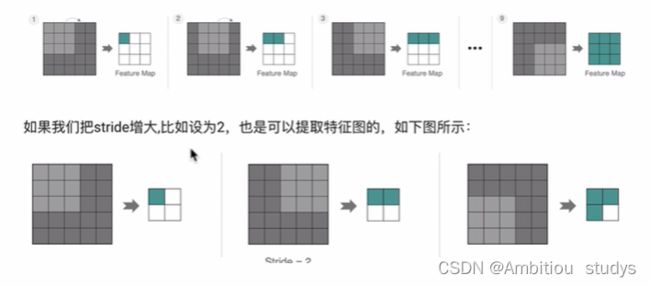

8.步长

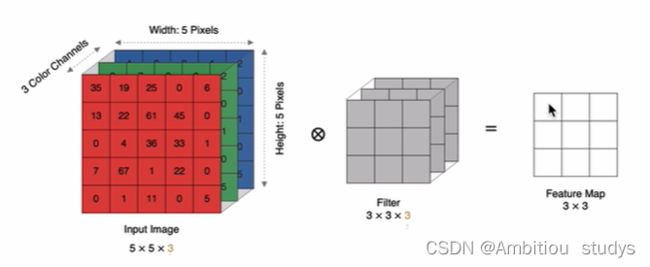

9.多通道卷积

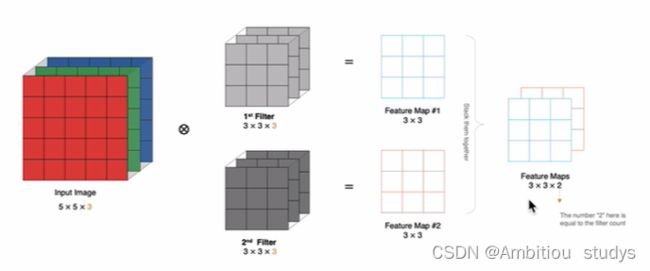

10.多卷积核卷积

计算方法如下︰当输入有多个通道(channel)时(例如图片可以有RGB三个通道),卷积核需要拥有相同的channel数,每个卷积核channel与输入层的对应channel进行卷积,将每个channe的卷积结果按位相加得到最终的Feature Map

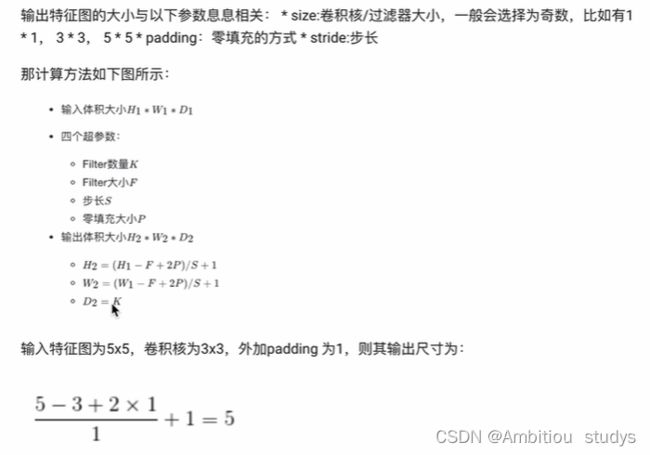

11.特征大小

12.池化层

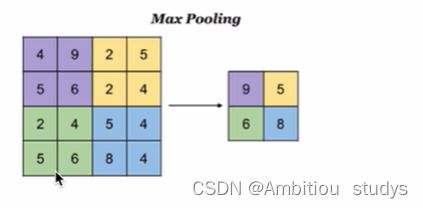

池化层迎来降低了后续网络层的输入维度,缩减模型大小,提高计算速度,并提高了Feature Map的鲁棒性,防止过拟合。对卷积层学习到的特征进行下采样处理

1.最大池化Map Pooling 取窗口内的最大值作为输出,这种方式使用较广泛

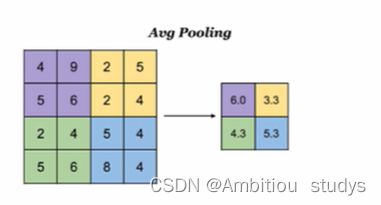

⒉**.平均池化**Axg. Pooling 取窗口内的所有值的均值作为输出

13.全连接层

全连接层位于CNN网络的末端,经过卷积层的特征提取与池化层的降维后,将特征图转换成一维向量送入到全连接层中进行分类或回归的操作。

接下篇LeNet-5实现