经典算法学习之---折半查找

@TOC

活动地址:CSDN21天学习挑战赛

一、什么是算法

算法是如何解决一类问题的明确规范,可以执行计算、数据处理、自动推理和其他任务。

️1.算法概念:

算法可以在有限的空间和时间内用定义明确的形式语言来表示,以计算函数。算法的一个典型例子是欧几里德算法,用于确定两个整数的最大公约数。在逻辑上,一个算法完成所需的时间是无法测量的,因为它与我们习惯的物理维度无关,这种不确定性导致无法找到既适合在某种意义上又适合抽象术语使用的算法定义。

算法(Algorithm)是指解题方案的准确而完整的描述,是一系列解决问题的清晰指令,算法代表着用系统的方法描述解决问题的策略机制。也就是说,能够对一定规范的输入,在有限时间内获得所要求的输出。如果一个算法有缺陷,或不适合于某个问题,执行这个算法将不会解决这个问题。不同的算法可能用不同的时间,空间或效率来完成同样的任务。一个算法的优劣可以用空间复杂度与时间复杂度来衡量。

算法中的指令描述的是一个计算,当其运行时能从一个初始状态和(可能为空的)初始输入开始,经过一系列有限而清晰定义的状态,最终产生输出并停止于一个终态。一个状态到另一个状态的转移不一定是确定的。随机化算法在内的一些算法,包含了一些随机输入。

算法的五大特征

有穷性(Finiteness)

算法的有穷性是指算法必须能在执行有限个步骤之后终止;

确切性(Definiteness)

算法的每一步骤必须有确切的定义;

输入项(Input)

一个算法有0个或多个输入,以刻画运算对象的初始情况,所谓0个输入是指算法本身定出了初始条件;

输出项(Output)

一个算法有一个或多个输出,以反映对输入数据加工后的结果。没有输出的算法是毫无意义的;

可行性(Effectiveness)

算法中执行的任何计算步骤都是可以被分解为基本的可执行的操作步骤,即每个计算步骤都可以在有限时间内完成(也称之为有效性)。

2.算法表达:

算法可用多种符号表示,包括自然语言、伪代码、流程图、drakon图表、编程语言或控制表。伪代码、流程图、drakon图表和控制表是表达算法的结构化方式,避免了自然语言语句中常见的许多歧义。编程语言主要用于以计算机可以执行的形式表达算法,但通常被用作定义或记录算法的一种方式。

3.计算机算法:

在计算机系统中,算法是软件开发人员用软件编写的逻辑实例, 使预定的“目标”计算机能够有效地从给定输入生成输出。一个最优算法,在旧硬件中运行,会比在更高效的硬件中运行的时间复杂度更高的算法产生更快的结果。

相信你也看过很多书上的定义,比如“算法是一组完成任务的指令”,“算法是操作数据的一组方法”。但是,你能举例说明吗?能让一个外行听明白吗?

它是什么

- 计算机算法,是指前人提炼出高效的、不断被验证过的标准流程。

举例说明

你去书店,要买一本《人生故事》,你用什么方式找到这本书呢?

方式1:一本本的去找,估计会累瘫在书店。

方式2:使用电脑查询一下书所在的编号,比如202015,202表示2楼第2个分区,015表示第15个书架。你到2楼找到02分区,第15个书架,很快就找到了那本书。

以上两种方式都是可以称为算法:

- 使用方式1的流程:能找到但是非常的慢,而且费力。

- 使用方式2的流程:能快速的找到且省力。因为使用了 麦尔威·杜威发明的很多国家都在使用的杜威十进制图书分类法。

那么我们就可以得出 好的算法又快又省事;

使用的时间少,就是要快。

消耗的资源少,就是要省。

总结:概括的说,算法就是解决问题的工具。在描述一个算法时,我们关注的是输入与输出。也就是说只要把原始数据和结果数据描述清楚了,那么算法所做的事情也就清楚了。我们在设计一个算法时也是需要先明确我们有什么和我们要什么,这一点相信大家在后面的文章中会慢慢体会到。

扩展:

- 算法本质是一个流程,与生活中的做事的流程类似。

- 生活中算法与计算机算法中的区别:比较计算机算法数时,需要考虑数据量特别特别大,大到近乎无穷大的情况。

因为,计算机的发明就是用于处理大量数据的。 - 我们需要学习前人的算法,避免重复造轮子,站在巨人的肩膀上前进,才能走的更远。

4.数据结构

数据结构(Data Structure)是计算机存储、组织数据的方式。数据结构是指相互之间存在一种或多种特定关系的数据元素的集合。通常情况下,精心选择的数据结构可以带来更高的运行或者存储效率。数据结构往往同高效的检索算法和索引技术有关。

数据结构定义

数据结构是指相互之间存在着一种或多种关系的数据元素的集合和该集合中数据元素之间的关系组成。记为:

Data_Structure=(D,R)

其中 D 是数据元素的集合,R 是该集合中所有元素之间的关系的有限集合。

数据结构具体指同一类数据元素中各元素之间的相互关系,包括三个组成成分,数据的逻辑结构、存储结构和数据运算结构。

数据的逻辑结构

数据的逻辑结构是指反映数据元素之间的逻辑关系的数据结构,其中的逻辑关系是指数据元素之间的前后件关系,而与他们在计算机中的存储位置无关。逻辑结构分为以下几种:

集合结构:数据元素同属一个集合,单个数据元素之间没有任何关系。

线性结构:数据结构中的元素存在一对一的相互关系。

树形结构:数据结构中的元素存在一对多的相互关系。

图形结构:数据结构中的元素存在多对多的相互关系。 作者:

**那么为什么算法经常会和数据结构一起出现呢?**这是因为对于同一个问题(如:排序),使用不同的数据结构来存储数据,对应的算法可能千差万别。所以在整个学习过程中,也会涉及到各种数据结构的使用。

常见的数据结构包括:数组、堆、栈、队列、链表、树等等。

5.算法的效率

算法效率是指算法执行的时间,算法执行时间需通过依据该算法编制的程序在计算机上运行时所消耗的时间来度量。在现在的计算机硬件环境中,比较少需要考虑这个问题了,特别是pc机的编程,内存空间越来越大,所以被考虑得也越来越少,不过一个好的程序员,都应该对自己的程序有要求,每一个for比别人少一次判断1000个for就能够少掉很多的运行时间。所以能够理解,能够大概的去运用"效率度量"还是有很大意义的。

在我们日常开发中,一个算法设计完成后,还需要对算法的执行情况做一个评估。**一个好的算法,可以大幅度的节省运行的资源消耗和时间。**在进行评估时不需要太具体,毕竟数据量是不确定的,通常是以数据量为基准来确定一个量级,通常会使用到

| 时间复杂度和空间复杂度这两个概念。 |

二.时间和空间复杂度

1.时间复杂度

在计算机科学中,时间复杂性,又称时间复杂度,算法的时间复杂度是一个函数,它定性描述该算法的运行时间。这是一个代表算法输入值的字符串的长度的函数。时间复杂度常用大O符号表述,不包括这个函数的低阶项和首项系数。使用这种方式时,时间复杂度可被称为是渐近的,亦即考察输入值大小趋近无穷时的情况。

通常把算法中的基本操作重复执行的频度称为算法的时间复杂度。算法中的基本操作一般是指算法中最深层循环内的语句(赋值、判断、四则运算等基础操作)。我们可以把时间频度记为T(n),它与算法中语句的执行次数成正比。其中的n被称为问题的规模,大多数情况下为输入的数据量。

对于每一段代码,都可以转化为常数或与n相关的函数表达式,记做f(n) 。如果我们把每一段代码的花费的时间加起来就能够得到一个刻画时间复杂度的表达式,在合并后保留量级最大的部分即可确定时间复杂度,记做O(f(n)) ,其中的O就是代表数量级。

常见的时间复杂度有(由低到高):O(1)、O( log 2 n \log _{2} n log2n)、O(n)、O( n log

2 n n\log _{2} n nlog2n)、O( n 2 n^{2} n2)、O( n 3 n^{3} n3)、O( 2 n

2^{n} 2n)、O(n!)。

四个时间复杂度

同一段代码在不同输入的情况下,可能存在时间复杂度量级不一样的情况,所以有以下四种不同的时间复杂度。

-

最好情况时间复杂度(best case time complexity);

-

最坏情况时间复杂度(worst case time complexity);

-

平均情况时间复杂度(average case time complexity);

-

均摊时间复杂度(amortized time complexity)。

1、最好、最坏、平均情况时间复杂度

// n表示数组array的长度

int find(int *array, int n, int x) {

int i = 0;

int pos = -1;

for ( ; i < n; ++i) {

if (array[i] == x) {

pos = i;

break;

}

}

return pos;

}

这是一个find()函数,这段代码的作用是查找参数x在数组array中的位置,如果没有就返回-1。

最好情况时间复杂度:

在最理想的情况下,代码的时间复杂度。本例中,如果数组中的第一个元素就是要查找的变量,则时间复杂度为O(1)。

最坏情况时间复杂度:

在最糟糕的情况下,代码的时间复杂度。本例中,如果数组中没有变量x,则需要遍历数组中的每一个元素,则时间复杂度为O(n)。

平均情况时间复杂度:

最好、最坏情况时间复杂度表示的都是代码在极端情况下的时间复杂度,发生的概率并不大,所以平均情况时间复杂度用于表示平均情况下的时间复杂度。

本例中,首先,变量x分为在数组中和不在数组中两种情况,假设两种情况的概率相同为![]() ;其次,要查找的变量出现在数组0 ~ n-1共n个位置的概率是一样的,都为

;其次,要查找的变量出现在数组0 ~ n-1共n个位置的概率是一样的,都为![]() ;最后,根据概率论的知识,变量x出现在0 ~ n-1这n个位置的概率都为

;最后,根据概率论的知识,变量x出现在0 ~ n-1这n个位置的概率都为![]() ,变量不在数组中的概率为

,变量不在数组中的概率为![]() 。

。

根据概率论中的加权平均值,也叫期望值的计算放法(每一种情况下的时间复杂度乘以其发生的概率)得出平均时间复杂度的值:

![]()

用大O表示法表示,则平均时间复杂度为O(n),所以平均时间复杂度又叫加权平均时间复杂度,或者期望时间复杂度。

一般情况下,我们并不会区分这三种时间复杂度,只使用其中一种即可。当同一代码块在不同情况下的时间复杂度有量级上的差距,才会区分这三种复杂度。

2、均摊时间复杂度

由上述可知,一般情况下,并不区分最好、最坏、平均情况时间复杂度,平均情况时间复杂度也只有在某些特殊的情况下才会使用,而均摊时间复杂度的应用场景比平均复杂度更特殊,更有限。

// array表示一个长度为n的数组

// 代码中的array.length就等于n

int *array = new int[n];

int count = 0;

void insert(int val) {

if (count == array.length) {

int sum = 0;

for (int i = 0; i < array.length; ++i) {

sum = sum + array[i];

}

array[0] = sum;

count = 1;

}

array[count] = val;

++count;

}

这是一个insert()函数,实现往数组中插入一个数据的功能,如果数组满了的话,即当count == array.length时,遍历数组求和,并把数据放到数组第一个位置,然后再把新的数据插入。

本段代码的时间复杂度分析:

最好情况时间复杂度:数组未满,有空闲的位置时为O(1);

最坏情况时间复杂度:数组已满,需要遍历求和时为O(n);

平均情况时间复杂度:分为数组未满和已满两种情况,未满时的插入有n种情况,每种情况的时间复杂度为O(1),已满时的时间复杂度度为O(n),所以共n+1种可能,这n+1种可能的概率相同都是![]() ,所以平均情况时间复杂度为:

,所以平均情况时间复杂度为:

![]()

2)、均摊时间复杂度

-

本例中的insert()函数区别于之前的find()函数:find()函数在极端情况下,时间复杂度为O(1),而insert()函数在大多数情况下时间复杂度都为O(1);find()函数时间复杂度的多种情况并没有任何规律。而insert()函数O(n)之后,必有n-1个O(1),循环往复。

-

针对这种特殊的场景,可以采用一种特殊的时间复杂度分析方法:摊还分析法,得出的是均摊时间复杂度。

-

分析方法:

因为时间复杂度有规律的在O(n) -> n-1个O(1)之间循环,所以把耗时最多的那次操作(O(n)),均摊到耗时最少的n-1次操作(O(1)),这样,每一组操作的时间复杂度都是O(1),即均摊时间复杂度为O(1)。 -

应用场景:

均摊时间复杂度就是一种特殊的平均情况时间复杂度,没有必要过度区分。当大部分情况下的时间复杂度较低,而只有极少数情况下的时间复杂度较高,且这些情况的出现有固定的时序性规律时,使用均摊时间复杂度。这时,尝试将较高复杂度操作的耗时均摊到较低复杂度的操作上,这就叫摊还分析法。

一般能应用摊还分析法的场景,均摊时间复杂度就等于最好情况时间复杂度

2. 折半查找

- 输入

n个数的有序序列,以数组为例,默认升序。

待查找元素key。

- 输出

查找成功:返回元素所在位置的编号。

查找失败:返回-1或自定义失败标识。

- 算法说明

算法的核心思想是不断的缩小搜索的范围,每次取区间的中心来进行比较,会有三种情况发生:

- 与key相等:直接返回对应的位置(对于有重复元素的情况,会在其他子专栏中说明)。

- 比key大:由于元素有序,要查找的元素一定在左侧(如有),于是搜索区间变为左一半。

- 比key小:由于元素有序,要查找的元素一定在右侧(如有),于是搜索区间变为右一半。

于是,只要不断的重复取中间比较和指定新的搜索区间这两个步骤,直到区间的两个端点已经重合(代表搜索完毕)或者找到元素时为止。

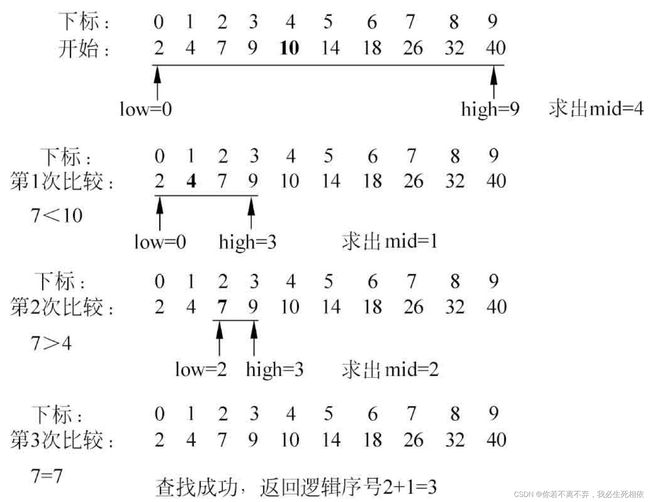

- 算法流程

- 第一次比较:mid坐标为4,对应元素为10,大于7,则区间变为左一半:[0,3]。

- 第二次比较:mid坐标为1,对应元素为1,小于7,则区间变为右一半:[2,3]。

- 第三次比较:mid坐标为2,对应元素为7,等于7,返回逻辑序号:mid + 1 = 3。

3. 伪代码

折半查找需要不断的改变区间和取中间元素来进行判断,只要明确key与比较元素的关系就可以确定新的比较区间,然后循环这个过程。理解了核心步骤后,伪代码表示如下:

left = 1

right = A.length

while left <= right

mid = (left + right) / 2

if A[mid] == key

return mid

else if A[mid] > key

right = mid - 1

else

left = mid + 1

return -1

算法的输入为升序数组A(其中包含n个元素,无重复)以及待查找元素key。

初始搜索区间为整个数组:从 A[1] 到 A[n]。

最后一次循环为左右区间已经重合,如果还没有找到元素,说明集合中没有元素。

如果在查找过程中,出现中间点与key相等的情况,则代表已经找到,直接返回。

如果中间点的值与key不相等,则需要改变其中一个端点,实现搜索区间的减半。

三、算法实践

1. 算法实现

- 输入数据(input):A = {10,11,12,14,20,32,34,35,41,43},key = 11

- Java源代码

需要注意源代码与伪代码的区别,请查看文章开头补充的概念部分,这里不做过多说明。

public class BinarySearch {

public static void main(String[] args) {

// input data

int[] a = {10,11,12,14,20,32,34,35,41,43};

int key = 11;

// 调用算法,并输出结果

int result = search(a, key);

System.out.println(result);

}

private static int search(int[] a,int key){

// 初始化变量

int left = 0;

int right = a.length - 1;

// 循环终止条件为:左右端点发生交错

while (left <= right){

// 取中间元素,以下写法防止数据量较大时发生溢出

int mid = (right - left) / 2 + left;

if (a[mid] == key){

// 情况1:与key相等

return mid + 1;

}else if(a[mid] > key){

// 情况2:比key大

right = mid - 1;

}else {

// 情况3:比key小

left = mid + 1;

}

}

// 循环结束还未触发内部的return则代表未找到,此时返回-1

return -1;

}

}

-

执行效果

-

输出数据(output):2

2. 时间复杂度

- 最坏的情况

最坏的情况就是直到最后一次才找到key,或者查找失败的情况。那么也就是说我们只要能计算出最多会找多少次,就能知道最快的情况。

可以知道,寻找的最大次数肯定是与n相关的,由于每次区间都缩小一半。所以这个问题就好比一根绳子,最多被折多少次,直到最后剩下一个元素(不能再折)为止。所以就是一个以2为底,相对于n的对数O( log 2 n \log _{2} n log2n) ,这也就是循环最多会执行的次数(循环内部的代码都是常量级别)。

- 最好的情况

对于二分查找来说最好的情况就是第一次就找到了key,也就是一脚定乾坤了,此时的时间复杂度为常数级:O(1) 。

- 平均情况

综合两种情况,二分查找的时间复杂度为O( log 2 n \log _{2} n log2n) 。

3. 空间复杂度

由于算法不会改变原有的元素集合,只需要几个额外的变量记录关键信息,所以空间复杂度为常数级:O(1) 。