语音识别 卷积神经网络,卷积神经网络字符识别

如何利用Python做简单的验证码识别

1 摘要验证码是目前互联网上非常常见也是非常重要的一个事物,充当着很多系统的 防火墙 功能,但是随时OCR技术的发展,验证码暴露出来的安全问题也越来越严峻。

本文介绍了一套字符验证码识别的完整流程,对于验证码安全和OCR识别技术都有一定的借鉴意义。

然后经过了一年的时间,笔者又研究和get到了一种更强大的基于CNN卷积神经网络的直接端到端的验证识别技术(文章不是我的,然后我把源码整理了下,介绍和源码在这里面):基于python语言的tensorflow的‘端到端’的字符型验证码识别源码整理(github源码分享)2 关键词关键词:安全,字符图片,验证码识别,OCR,Python,SVM,PIL3 免责声明本文研究所用素材来自于某旧Web框架的网站 完全对外公开 的公共图片资源。

本文只做了该网站对外公开的公共图片资源进行了爬取, 并未越权 做任何多余操作。本文在书写相关报告的时候已经 隐去 漏洞网站的身份信息。本文作者 已经通知 网站相关人员此系统漏洞,并积极向新系统转移。

本报告的主要目的也仅是用于 OCR交流学习 和引起大家对 验证安全的警觉 。

4 引言关于验证码的非技术部分的介绍,可以参考以前写的一篇科普类的文章:互联网安全防火墙(1)--网络验证码的科普里面对验证码的种类,使用场景,作用,主要的识别技术等等进行了讲解,然而并没有涉及到任何技术内容。

本章内容则作为它的 技术补充 来给出相应的识别的解决方案,让读者对验证码的功能及安全性问题有更深刻的认识。

5 基本工具要达到本文的目的,只需要简单的编程知识即可,因为现在的机器学习领域的蓬勃发展,已经有很多封装好的开源解决方案来进行机器学习。

普通程序员已经不需要了解复杂的数学原理,即可以实现对这些工具的应用了。

主要开发环境:python3.5pythonSDK版本PIL图片处理库libsvm开源的svm机器学习库关于环境的安装,不是本文的重点,故略去。

6 基本流程一般情况下,对于字符型验证码的识别流程如下:准备原始图片素材图片预处理图片字符切割图片尺寸归一化图片字符标记字符图片特征提取生成特征和标记对应的训练数据集训练特征标记数据生成识别模型使用识别模型预测新的未知图片集达到根据“图片”就能返回识别正确的字符集的目标7 素材准备7.1 素材选择由于本文是以初级的学习研究目的为主,要求 “有代表性,但又不会太难” ,所以就直接在网上找个比较有代表性的简单的字符型验证码(感觉像在找漏洞一样)。

最后在一个比较旧的网站(估计是几十年前的网站框架)找到了这个验证码图片。原始图:放大清晰图:此图片能满足要求,仔细观察其具有如下特点。

有利识别的特点 :由纯阿拉伯数字组成字数为4位字符排列有规律字体是用的统一字体以上就是本文所说的此验证码简单的重要原因,后续代码实现中会用到不利识别的特点 :图片背景有干扰噪点这虽然是不利特点,但是这个干扰门槛太低,只需要简单的方法就可以除去7.2 素材获取由于在做训练的时候,需要大量的素材,所以不可能用手工的方式一张张在浏览器中保存,故建议写个自动化下载的程序。

主要步骤如下:通过浏览器的抓包功能获取随机图片验证码生成接口批量请求接口以获取图片将图片保存到本地磁盘目录中这些都是一些IT基本技能,本文就不再详细展开了。

关于网络请求和文件保存的代码,如下:defdownloads_pic(**kwargs): pic_name=('pic_name',None) url='httand_code_captcha/' res=(url,stream=True) withopen(pic_path+pic_name+'.bmp','wb')asf: forchunkinres.iter_content(chunk_size=1024): ifchunk: #filteroutkeep-alivenewchunks f.write(chunk) f.flush() f.close()循环执行N次,即可保存N张验证素材了。

下面是收集的几十张素材库保存到本地文件的效果图:8 图片预处理虽然目前的机器学习算法已经相当先进了,但是为了减少后面训练时的复杂度,同时增加识别率,很有必要对图片进行预处理,使其对机器识别更友好。

针对以上原始素材的处理步骤如下:读取原始图片素材将彩色图片二值化为黑白图片去除背景噪点8.1 二值化图片主要步骤如下:将RGB彩图转为灰度图将灰度图按照设定阈值转化为二值图image=(img_path)imgry=image.convert('L') #转化为灰度图table=get_bin_table()out=imgry.point(table,'1')上面引用到的二值函数的定义如下:呵呵11121314 def get_bin_table(threshold=140): """ 获取灰度转二值的映射table :paramthreshold: :return: """ table = [] for i in range(256): if i

二值化后带噪点的 6937 的像素点输出后如下图:1111000111111000111111100001111100000011111011101111011101111101111011110011011110011100111101111010110110101011011101111101111111110110101111110101111111101111110100011111011100111111001111111110111111001110111110000011111110010111110111111101110001111111101011010110111111011111110111101111111110111101111011111101111111011110111101110011110111101111110111001110000111111000011101100001110111011111如果你是近视眼,然后离屏幕远一点,可以隐约看到 6937 的骨架了。

8.2 去除噪点在转化为二值图片后,就需要清除噪点。本文选择的素材比较简单,大部分噪点也是最简单的那种 孤立点,所以可以通过检测这些孤立点就能移除大量的噪点。

关于如何去除更复杂的噪点甚至干扰线和色块,有比较成熟的算法: 洪水填充法FloodFill ,后面有兴趣的时间可以继续研究一下。

本文为了问题简单化,干脆就用一种简单的自己想的 简单办法 来解决掉这个问题:对某个 黑点 周边的九宫格里面的黑色点计数如果黑色点少于2个则证明此点为孤立点,然后得到所有的孤立点对所有孤立点一次批量移除。

下面将详细介绍关于具体的算法原理。

将所有的像素点如下图分成三大类顶点A非顶点的边界点B内部点C种类点示意图如下:其中:A类点计算周边相邻的3个点(如上图红框所示)B类点计算周边相邻的5个点(如上图红框所示)C类点计算周边相邻的8个点(如上图红框所示)当然,由于基准点在计算区域的方向不同,A类点和B类点还会有细分:A类点继续细分为:左上,左下,右上,右下B类点继续细分为:上,下,左,右C类点不用细分然后这些细分点将成为后续坐标获取的准则。

主要算法的python实现如下:defsum_9_region(img,x,y): """ 9邻域框,以当前点为中心的田字框,黑点个数 :paramx: :paramy: :return: """ #todo判断图片的长宽度下限 cur_pixel=img.getpixel((x,y)) #当前像素点的值 width=img.width height=img.height ifcur_pixel==1: #如果当前点为白色区域,则不统计邻域值 return0 ify==0: #第一行 ifx==0: #左上顶点,4邻域 #中心点旁边3个点 sum=cur_pixel\ +img.getpixel((x,y+1))\ +img.getpixel((x+1,y))\ +img.getpixel((x+1,y+1)) return4-sum elifx==width-1: #右上顶点 sum=cur_pixel\ +img.getpixel((x,y+1))\ +img.getpixel((x-1,y))\ +img.getpixel((x-1,y+1)) return4-sum else: #最上非顶点,6邻域 sum=img.getpixel((x-1,y))\ +img.getpixel((x-1,y+1))\ +cur_pixel\ +img.getpixel((x,y+1))\ +img.getpixel((x+1,y))\ +img.getpixel((x+1,y+1)) return6-sum elify==height-1: #最下面一行 ifx==0: #左下顶点 #中心点旁边3个点 sum=cur_pixel\ +img.getpixel((x+1,y))\ +img.getpixel((x+1,y-1))\ +img.getpixel((x,y-1)) return4-sum elifx==width-1: #右下顶点 sum=cur_pixel\ +img.getpixel((x,y-1))\ +img.getpixel((x-1,y))\ +img.getpixel((x-1,y-1)) return4-sum else: #最下非顶点,6邻域 sum=cur_pixel\ +img.getpixel((x-1,y))\ +img.getpixel((x+1,y))\ +img.getpixel((x,y-1))\ +img.getpixel((x-1,y-1))\ +img.getpixel((x+1,y-1)) return6-sum else: #y不在边界 ifx==0: #左边非顶点 sum=img.getpixel((x,y-1))\ +cur_pixel\ +img.getpixel((x,y+1))\ +img.getpixel((x+1,y-1))\ +img.getpixel((x+1,y))\ +img.getpixel((x+1,y+1)) return6-sum elifx==width-1: #右边非顶点 #print('%s,%s'%(x,y)) sum=img.getpixel((x,y-1))\ +cur_pixel\ +img.getpixel((x,y+1))\ +img.getpixel((x-1,y-1))\ +img.getpixel((x-1,y))\ +img.getpixel((x-1,y+1)) return6-sum else: #具备9领域条件的 sum=img.getpixel((x-1,y-1))\ +img.getpixel((x-1,y))\ +img.getpixel((x-1,y+1))\ +img.getpixel((x,y-1))\ +cur_pixel\ +img.getpixel((x,y+1))\ +img.getpixel((x+1,y-1))\ +img.getpixel((x+1,y))\ +img.getpixel((x+1,y+1)) return9-sumTips:这个地方是相当考验人的细心和耐心程度了,这个地方的工作量还是蛮大的,花了半个晚上的时间才完成的。

计算好每个像素点的周边像素黑点(注意:PIL转化的图片黑点的值为0)个数后,只需要筛选出个数为 1或者2 的点的坐标即为 孤立点 。这个判断方法可能不太准确,但是基本上能够满足本文的需求了。

经过预处理后的图片如下所示:对比文章开头的原始图片,那些 孤立点 都被移除掉,相对比较 干净 的验证码图片已经生成。

9 图片字符切割由于字符型 验证码图片 本质就可以看着是由一系列的 单个字符图片 拼接而成,为了简化研究对象,我们也可以将这些图片分解到 原子级 ,即: 只包含单个字符的图片。

于是,我们的研究对象由 “N种字串的组合对象” 变成 “10种阿拉伯数字” 的处理,极大的简化和减少了处理对象。9.1 分割算法现实生活中的字符验证码的产生千奇百怪,有各种扭曲和变形。

关于字符分割的算法,也没有很通用的方式。这个算法也是需要开发人员仔细研究所要识别的字符图片的特点来制定的。当然,本文所选的研究对象尽量简化了这个步骤的难度,下文将慢慢进行介绍。

使用图像编辑软件(PhoneShop或者其它)打开验证码图片,放大到像素级别,观察其它一些参数特点:可以得到如下参数:整个图片尺寸是40*10单个字符尺寸是6*10左右字符和左右边缘相距2个像素字符上下紧挨边缘(即相距0个像素)这样就可以很容易就定位到每个字符在整个图片中占据的像素区域,然后就可以进行分割了,具体代码如下:defget_crop_imgs(img): """ 按照图片的特点,进行切割,这个要根据具体的验证码来进行工作.#见原理图 :paramimg: :return: """ child_img_list=[] foriinrange(4): x=2+i*(6+4) #见原理图 y=0 child_img=((x,y,x+6,y+10)) child_img_list.append(child_img) returnchild_img_list然后就能得到被切割的 原子级 的图片元素了:9.2 内容小结基于本部分的内容的讨论,相信大家已经了解到了,如果验证码的干扰(扭曲,噪点,干扰色块,干扰线……)做得不够强的话,可以得到如下两个结论:4位字符和40000位字符的验证码区别不大纯字母不区分大小写。

分类数为26区分大小写。分类数为52纯数字。分类数为10数字和区分大小写的字母组合。

分类数为62纯数字 和 数字及字母组合 的验证码区别不大在没有形成 指数级或者几何级 的难度增加,而只是 线性有限级 增加计算量时,意义不太大。

10 尺寸归一本文所选择的研究对象本身尺寸就是统一状态:6*10的规格,所以此部分不需要额外处理。但是一些进行了扭曲和缩放的验证码,则此部分也会是一个图像处理的难点。

11 模型训练步骤在前面的环节,已经完成了对单个图片的处理和分割了。后面就开始进行 识别模型 的训练了。

整个训练过程如下:大量完成预处理并切割到原子级的图片素材准备对素材图片进行人为分类,即:打标签定义单张图片的识别特征使用SVM训练模型对打了标签的特征文件进行训练,得到模型文件12 素材准备本文在训练阶段重新下载了同一模式的4数字的验证图片总计:3000张。

然后对这3000张图片进行处理和切割,得到12000张原子级图片。

在这12000张图片中删除一些会影响训练和识别的强干扰的干扰素材,切割后的效果图如下:13 素材标记由于本文使用的这种识别方法中,机器在最开始是不具备任何数字的观念的。

所以需要人为的对素材进行标识,告诉 机器什么样的图片的内容是1……。这个过程叫做 “标记”。

具体打标签的方法是:为0~9每个数字建立一个目录,目录名称为相应数字(相当于标签)人为判定 图片内容,并将图片拖到指定数字目录中每个目录中存放100张左右的素材一般情况下,标记的素材越多,那么训练出的模型的分辨能力和预测能力越强。

例如本文中,标记素材为十多张的时候,对新的测试图片识别率基本为零,但是到达100张时,则可以达到近乎100%的识别率14 特征选择对于切割后的单个字符图片,像素级放大图如下:从宏观上看,不同的数字图片的本质就是将黑色按照一定规则填充在相应的像素点上,所以这些特征都是最后围绕像素点进行。

字符图片 宽6个像素,高10个像素 ,理论上可以最简单粗暴地可以定义出60个特征:60个像素点上面的像素值。但是显然这样高维度必然会造成过大的计算量,可以适当的降维。

通过查阅相应的文献 [2],给出另外一种简单粗暴的特征定义:每行上黑色像素的个数,可以得到10个特征每列上黑色像素的个数,可以得到6个特征最后得到16维的一组特征,实现代码如下:defget_feature(img): """ 获取指定图片的特征值, 1.按照每排的像素点,高度为10,则有10个维度,然后为6列,总共16个维度 :paramimg_path: :return:一个维度为10(高度)的列表 """ width,height= pixel_cnt_list=[] height=10 foryinrange(height): pix_cnt_x=0 forxinrange(width): ifimg.getpixel((x,y))==0: #黑色点 pix_cnt_x+=1 pixel_cnt_list.append(pix_cnt_x) forxinrange(width): pix_cnt_y=0 foryinrange(height): ifimg.getpixel((x,y))==0: #黑色点 pix_cnt_y+=1 pixel_cnt_list.append(pix_cnt_y) returnpixel_cnt_list然后就将图片素材特征化,按照 libSVM 指定的格式生成一组带特征值和标记值的向量文。

卷积神经网络算法是什么?

一维构筑、二维构筑、全卷积构筑爱发猫 www.aifamao.com。

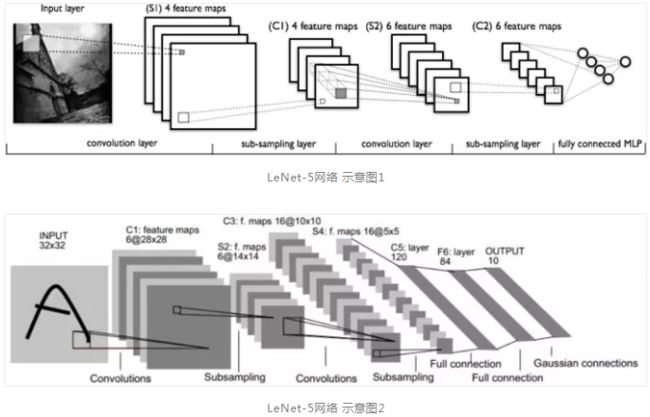

卷积神经网络(ConvolutionalNeuralNetworks,CNN)是一类包含卷积计算且具有深度结构的前馈神经网络(FeedforwardNeuralNetworks),是深度学习(deeplearning)的代表算法之一。

卷积神经网络具有表征学习(representationlearning)能力,能够按其阶层结构对输入信息进行平移不变分类(shift-invariantclassification),因此也被称为“平移不变人工神经网络(Shift-InvariantArtificialNeuralNetworks,SIANN)”。

卷积神经网络的连接性:卷积神经网络中卷积层间的连接被称为稀疏连接(sparseconnection),即相比于前馈神经网络中的全连接,卷积层中的神经元仅与其相邻层的部分,而非全部神经元相连。

具体地,卷积神经网络第l层特征图中的任意一个像素(神经元)都仅是l-1层中卷积核所定义的感受野内的像素的线性组合。

卷积神经网络的稀疏连接具有正则化的效果,提高了网络结构的稳定性和泛化能力,避免过度拟合,同时,稀疏连接减少了权重参数的总量,有利于神经网络的快速学习,和在计算时减少内存开销。

卷积神经网络中特征图同一通道内的所有像素共享一组卷积核权重系数,该性质被称为权重共享(weightsharing)。

权重共享将卷积神经网络和其它包含局部连接结构的神经网络相区分,后者虽然使用了稀疏连接,但不同连接的权重是不同的。权重共享和稀疏连接一样,减少了卷积神经网络的参数总量,并具有正则化的效果。

在全连接网络视角下,卷积神经网络的稀疏连接和权重共享可以被视为两个无限强的先验(pirior),即一个隐含层神经元在其感受野之外的所有权重系数恒为0(但感受野可以在空间移动);且在一个通道内,所有神经元的权重系数相同。

识别数字,bp神经网络算法,卷积神经网络算法,svm算法,adaboost算法哪种好

看数字图片而定。如果图片较小并且质量还不错,那么通过2层的神经网络就能胜任。对于MNIst数据集(28*28的手写数字),2层神经网络准确率可达99%,svm也有98%以上。

以上实现非常简单,matlab已经有现成工具箱。卷积神经网络通常用于更加复杂的场合,闭合是被图像内容等。

在MNIST数据集上cnn可达99.7%准确率,但是实现起来较为复杂,需要通过开源框架caffe,keras等进行编程。

如果对准确率要求没有达到小数点后两位的程度,用简单的svm,神经网络,softmax等调调参数就行了。

识别验证码的算法

一、验证码的基本知识1.验证码的主要目的是强制人机交互来抵御机器自动化攻击的。2.大部分的验证码设计者并不得要领,不了解图像处理,机器视觉,模式识别,人工智能的基本概念。

3.利用验证码,可以发财,当然要犯罪:比如招商银行密码只有6位,验证码形同虚设,计算机很快就能破解一个有钱的账户,很多帐户是可以网上交易的。

4.也有设计的比较好的,比如Yahoo,Google,Microsoft等。而国内Tencent的中文验证码虽然难,但算不上好。

二、人工智能,模式识别,机器视觉,图像处理的基本知识1)主要流程:比如我们要从一副图片中,识别出验证码;比如我们要从一副图片中,检测并识别出一张人脸。大概有哪些步骤呢?

1.图像采集:验证码呢,就直接通过HTTP抓HTML,然后分析出图片的url,然后下载保存就可以了。如果是人脸检测识别,一般要通过视屏采集设备,采集回来,通过A/D转操作,存为数字图片或者视频频。

2.预处理:检测是正确的图像格式,转换到合适的格式,压缩,剪切出ROI,去除噪音,灰度化,转换色彩空间这些。

3.检测:车牌检测识别系统要先找到车牌的大概位置,人脸检测系统要找出图片中所有的人脸(包括疑似人脸);验证码识别呢,主要是找出文字所在的主要区域。

4.前处理:人脸检测和识别,会对人脸在识别前作一些校正,比如面内面外的旋转,扭曲等。我这里的验证码识别,“一般”要做文字的切割5.训练:通过各种模式识别,机器学习算法,来挑选和训练合适数量的训练集。

不是训练的样本越多越好。过学习,泛化能力差的问题可能在这里出现。这一步不是必须的,有些识别算法是不需要训练的。

6.识别:输入待识别的处理后的图片,转换成分类器需要的输入格式,然后通过输出的类和置信度,来判断大概可能是哪个字母。识别本质上就是分类。2)关键概念:图像处理:一般指针对数字图像的某种数学处理。

比如投影,钝化,锐化,细化,边缘检测,二值化,压缩,各种数据变换等等。1.二值化:一般图片都是彩色的,按照逼真程度,可能很多级别。

为了降低计算复杂度,方便后续的处理,如果在不损失关键信息的情况下,能将图片处理成黑白两种颜色,那就最好不过了。2.细化:找出图像的骨架,图像线条可能是很宽的,通过细化将宽度将为1,某些地方可能大于1。

不同的细化算法,可能有不同的差异,比如是否更靠近线条中间,比如是否保持联通行等。3.边缘检测:主要是理解边缘的概念。边缘实际上是图像中图像像素属性变化剧烈的地方。

可能通过一个固定的门限值来判断,也可能是自适应的。门限可能是图像全局的,也可能是局部的。不能说那个就一定好,不过大部分时候,自适应的局部的门限可能要好点。被分析的,可能是颜色,也可能是灰度图像的灰度。

机器视觉:利用计算机来模式实现人的视觉。比如物体检测,定位,识别。按照对图像理解的层次的差别,分高阶和低阶的理解。

模式识别:对事物或者现象的某种表示方式(数值,文字,我们这里主要想说的是数值),通过一些处理和分析,来描述,归类,理解,解释这些事物,现象及其某种抽象。

人工智能:这种概念比较宽,上面这些都属于人工智能这个大的方向。简单点不要过分学院派的理解就是,把人类的很“智能”的东西给模拟出来协助生物的人来处理问题,特别是在计算机里面。

CNN(卷积神经网络)是什么?

在数字图像处理的时候我们用卷积来滤波是因为我们用的卷积模版在频域上确实是高通低通带通等等物理意义上的滤波器。

然而在神经网络中,模版的参数是训练出来的,我认为是纯数学意义的东西,很难理解为在频域上还有什么意义,所以我不认为神经网络里的卷积有滤波的作用。接着谈一下个人的理解。

首先不管是不是卷积神经网络,只要是神经网络,本质上就是在用一层层简单的函数(不管是sigmoid还是Relu)来拟合一个极其复杂的函数,而拟合的过程就是通过一次次backpropagation来调参从而使代价函数最小。

如何通过人工神经网络实现图像识别

神经网络实现图像识别的过程很复杂。但是大概过程很容易理解。我也是节选一篇图像识别技术的文章,大概说一下。图像识别技术主要是通过卷积神经网络来实现的。

这种神经网络的优势在于,它利用了“同一图像中相邻像素的强关联性和强相似度”这一原理。具体而言就是,在一张图像中的两个相邻像素,比图像中两个分开的像素更具有关联性。

但是,在一个常规的神经网络中,每个像素都被连接到了单独的神经元。这样一来,计算负担自然加重了。卷积神经网络通过削减许多不必要的连接来解决图像识别技术中的这一问题。

运用图像识别技术中的术语来说就是,卷积神经网络按照关联程度筛选不必要的连接,进而使图像识别过程在计算上更具有可操作性。

卷积神经网络有意地限制了图像识别时候的连接,让一个神经元只接受来自之前图层的小分段的输入(假设是3×3或5×5像素),避免了过重的计算负担。因此,每一个神经元只需要负责处理图像的一小部分。

大大加快了速度和准确率。

卷积神经网络在实施的过程中,实际上是分为两层,一个是卷积层,一个是汇聚层,简单理解就是卷积层将图片分散成一个一个或者3*3/5*5的小像素块,然后把这些输出值排列在图组中,用数字表示照片中各个区域的内容,数轴分别代表高度、宽度和颜色。

那么,我们就得到了每一个图块的三维数值表达。汇聚层是将这个三维(或是四维)图组的空间维度与采样函数结合起来,输出一个仅包含了图像中相对重要的部分的联合数组。

这一联合数组不仅能使卷积神经网络计算负担最小化,还能有效避免过度拟合的问题。以上大概就是使用卷积神经网络进行图像识别的过程。

具体可以关注ATYUN人工智能平台的文章:揭秘图像识别技术,机器如何利用卷积神经网络“看见”这个世界。

为什么图像识别都用卷积神经网络?不能使用遗传算法来做图像识别吗