视频超分辨率深度学习模型设计(一)

目录

图像超分与去噪

视频与图像区别和难点

视频帧对齐

视频帧融合

视频超分与去噪

方案分析

方案分析:感知能力不够强

方案分析:时序信息不充分

方案分析:特征表达不高效

改进方案

实验结果

方案总结

方案优缺点

图像超分与去噪

卷积网络在超分辩和去噪上泛应用,网络结构大致会有以下特点:

1.残羞结构

超分领城普遍认为更深的网络可以带来更优的性能,残差结构适合训练更深的网络模型

例如: EDSR.

2.多分支结构

网络模型的宽度也能一 定提高特征的表达能力,例如REDNet.

3.循环结构

循环结构有利于选代式处理图像 ,例如DRCN

4.渐进式培构

利用逐步增加分辨率的方式,提高超分性能,例如SCN.

5.注意力机制

注意力机制有力于提高特征的表达能力,例如RCAN, DRLN.

6.对抗横型

利用GAN的思想生成更符合主观质评价的像,例如: SRGAN, EnhanceNet,ESRGAN

视频与图像区别和难点

视频帧对齐

区别于图像超分,视频超分辩与增强需要参考多幅图像或多个视频帧的图像信息,然而视频数据本身的特性带来了运动信息,从而使得参考帧产生偏差,如何对齐参考帧和目标帧是视频超分的重点。

视频帧融合

视频数据中除了运动信息之外,还存在视频帧模糊或者场景切换的问题。在融合视频帧的过程中,如何自适应得处理这类情况将影响最终的性能。

视频超分与去噪

区别于图像超分去噪,视频需要考虑帧间融合,网络结构大致会有以下特点:

1.三堆卷积

三维卷积有利用提取时间维的特征,例如:

Fast Spatio-Temporal Residual Network for Video Super Resolution, CVPR 2019

2.循环结构

循环结构也可以用于提取帧间关系,融合目标帧和参考帧的信息,例如:

Recurrent Back-Projection Network for Video Super- Resolution, CVPR 2019.

Frame-Recurrent Video Super- Resolution, CVPR 2018.

3.滤波器预测

超分和去噪都可以用滤波的方式处理,利用深度学习,预测滤波翳参数,获得自适应的滤波效果,例:

Deep Video Super-Resolution Network Using Dynamic Upsampling Fiters Without Explicit Motion Compensation, CVPR 2018.

EDVR视频超分辨

EDVR的超分辩思路:对齐->融合一>重建

方案分析

EDVR香还存在问题?

感知能力不够强

时序信息不充分

特征表达不高效

方案分析:感知能力不够强

对齐横块(Alignment Module) Deformation Convolution

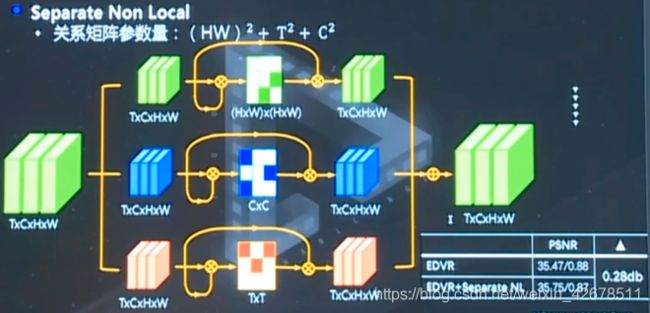

3D Non Local

关系矩阵参数量: (THW)2

Separate Non Local

关系矩阵参数量: (HW)2+ T2+ C2

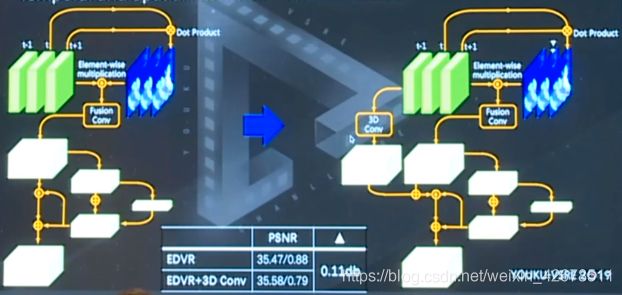

方案分析:时序信息不充分

融合横块(Fusion Module)

Temporal and Spatial Attention + 3D Convolution

方案分析:特征表达不高效

重叠模块(Reconstruct Module)

ResNet Block + Channel Attention

改进方案

感知能力不够强

原因: EDVR利用40层以上的卷积来增大感受野,带来网络参数的增加。

解决方案利用Separate non local在不加深网络的情况下,增大感受野。

时序值息不充分

原因: EDVR的视频帧被视为单独个体与目标帧做融合1忽视了视频帧的连续性信息。

解决方案: 增加3D卷积捕获时序特征。

特征表达不高效

原因: EDVR在重建模块堆叠resnet block ,网络深度大,难以保证特征学习的效性。

解决方案:引入Channel Attention提特征的表达能力。

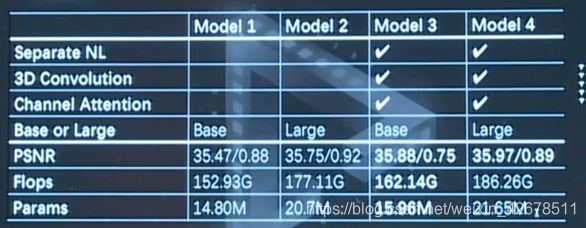

实验结果

方案总结

- 采用Separate Non Local增大模型感受野,减少模型所需参数量。

- 3D卷积的方式提取帧闻信息,提高特征融合效事。

- 引入Channel Attention提高重建feature map的特征表达。

方案优缺点

- 在相同性能下,模型参数量更小;

- 训练有一定不稳定性,主要原因是可变卷积;正在尝试方案替换可变卷积。