自动驾驶数据集盘点 | 小马数据

1.Apolloscape

网站地址:http://apolloscape.auto/

ApolloScape使用移动激光雷达扫描仪器从Reigl收集点云。这种方法产生的三维点云要比Velodyne产生点云更精确、更稠密。在采集车车顶上安装有标定好的高分辨率相机以每一米一帧的速率同步记录采集车周围的场景。而且,整个系统配有高精度GPS和IMU,相机的实时位姿都可以被同步记录。

2.Astyx Dataset HiRes2019

网站地址:https://www.astyx.com/development/astyx-hires2019-dataset.html

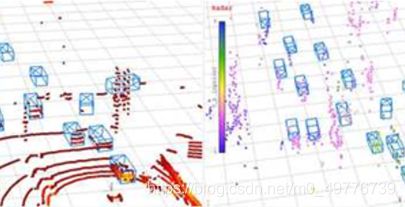

Astyx HiRes2019数据集是一个流行的汽车雷达数据集,用于基于深度学习的3D对象检测。开源该数据集的动机是为研究社区提供高分辨率的雷达数据,促进和激励使用雷达传感器数据的算法的研究。该数据集是以雷达为中心的自动数据集,基于雷达、激光雷达和摄像机数据,用于三维目标检测。数据集的大小超过350 MB,由546帧组成。

3.Berkeley DeepDrive BDD100k数据集:大规模、多样化的驾驶视频数据集

网站地址:http://bdd-data.berkeley.edu/

截至2018年最大规模、内容最具多样性的自动驾驶人工智能数据集。BDD100K 数据集包含10万段高清视频,每个视频约40秒,720p,30 fps 。每个视频的第10秒对关键帧进行采样,得到10万张图片(图片尺寸:1280 * 720 ),并进行标注。注释图像来自纽约和旧金山地区。

4.Cityscapes数据集:专注对城市街景做语义解析

网站地址:https://www.cityscapes-dataset.com/

Cityscapes专注于城市的街景主义理解,其本质是一个计算机视觉语义分割数据集。提供的下载数据集中测试集和验证集有标注,测试集提供原图,无标注,可以把结果上传到项目主页,然后验证你算法。

Cityscapes包含50个城市不同场景、不同背景、不同季节的街景,提供5000张精细标注的图像、20000张粗略标注的图像、30类标注物体。

5.comma.ai数据集

网站地址:https://archive.org/details/comma-dataset

7.25小时的高速公路驾驶。 包含10个可变大小的视频片段,以20 Hz的频率录制,相机安装在Acura ILX 2016的挡风玻璃上。与视频平行,还记录了一些测量值,如汽车的速度、加速度、转向角、GPS坐标、陀螺仪角度等。这些测量结果转换为均匀的100 Hz时基。

6.KITTI数据集:大型自动驾驶领域数据集

下载地址:http://www.cvlibs.net/datasets/kitti/raw_data.php

KITTI数据集由德国卡尔斯鲁厄理工学院和丰田美国技术研究院联合创办,是自动驾驶领域使用最广泛的数据集之一。

该数据集用于评测立体图像(stereo),光流(optical flow),视觉测距(visual odometry),3D物体检测(object detection)和3D跟踪(tracking)等计算机视觉技术在车载环境下的性能。

KITTI数据采集平台包括2个灰度摄像机,2个彩色摄像机,一个Velodyne 3D激光雷达,4个光学镜头,以及1个GPS导航系统。一共细分为Road, City, Residential, Campus和Person五类数据;包含市区、乡村高速公路的数据,每张图像最多15辆车及30个行人,而且还包含不同程度的遮挡。整个数据集由389对立体图像和光流图,39.2公里视觉测距序列以及超过200,000 3D标注物体的图像组成。

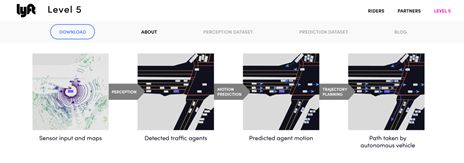

7.Level 5

网站地址:https://self-driving.lyft.com/level5/data/?source=post_page

Level 5是一个全面的、大规模的数据集,具有原始传感器摄像头和激光雷达输入,由多个高端自动驾驶车辆组成的车队在一个受限制的地理区域采集环境数据。数据集还包括人类标记的交通标志的三维边界框,一个底层的高清空间语义地图。

8.Mapillary

网站地址:https://www.mapillary.com/

Mapillary Vistas是世界上最大、最多样化的像素精确,和特定实例标注的街道级图像公开数据集。Mapillary Vistas数据集是一个大场景的街景数据集,包括25000张高分辨率的彩色图像,分成66个类,其中有37个类别是特定的附加于实例的标签。对物体的标签注释可以使用多边形进行稠密,精细的描绘,包含来自世界各地在各种条件下捕获的图像,包括不同天气,季节和时间的图像。

9.MIT AGE Lab

网站地址:https://lexfridman.com/carsync/

在 AgeLab 收集的 1000 多个小时的多传感器驱动数据集样本。

10.nuscenes

网站地址:https://www.nuscenes.org/

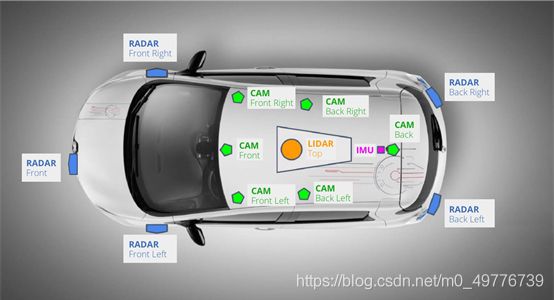

该数据集编辑了1000多个场景,其中包含140万幅图像、40万次激光雷达扫描(判断物体之间距离)和110万个三维边界框(用RGB相机、雷达和激光雷达组合检测的物体)。

此次数据搜集使用了6个摄像头、1个激光雷达、 5个毫米波雷达、GPS及惯导系统,包括对于自动驾驶系统有挑战性的复杂道路、天气条件等。这个数据集在sample的数量上、标注的形式上都非常好,记录了车的自身运动轨迹(相对于全局坐标),包含了非常多的传感器,可以用来实现更加智慧的识别算法和感知融合算法。

11. Open Images V5

网站地址:https://ai.googleblog.com/2019/05/announcing-open-images-v5-and-iccv-2019.html

该数据集包含了900多万张图像,这些图像都带有跨越数千个对象类别的标签。开放图像V5数据集具有350组280万个对象实例的分割标签。该数据集包括训练集上的268M分割标签、超过20k类别的3650M图像级标签以及验证集和测试集上的99K标签。

12.Oxford RobotCar

下载地址:https://robotcar-dataset.robots.ox.ac.uk/

该数据集对牛津的一部分连续的相同道路进行了上百次数据采集,收集到了多种天气、行人和交通情况下的数据,也有建筑和道路施工时的数据。1000小时以上。

13. Pandaset

网站地址:https://scale.com/open-datasets/pandaset

该数据集使研究人员能够研究自动驾驶,旨在促进自动驾驶和机器学习的先进研究和发展。数据集有6个摄像头,2个激光雷达,28个注释类,37类分割标签等。

14.Udacity’s Driving Dataset

网站地址:https://www.udacity.com/course/self-driving-car-engineer-nanodegree–nd013

该数据集是Udacity为其自动驾驶算法比赛专门准备的数据集,对连续视频图片进行了仔细的标注(2D坐标),主要有汽车、行人、大型车辆等类别。包含前左右图像、GPS信息、控制信息以及2D物体边框标注。

15.Waymo open dataset:数据量和场景都非常完整的数据集

网站地址:https://waymo.com/open

Waymo开放数据集是一个用于自动驾驶的开源高质量多模态传感器数据集。该数据集涵盖了从密集的城市中心到郊区景观的各种环境。这个系列由不同的驾驶条件组成,包括白天、黑夜、黎明、黄昏、雨天和晴天。

Waymo数据集包含3000种驾驶片段,每一片段包含20秒的连续驾驶画面。每个分段涵盖5个高分辨率Waymo激光雷达和五个前置和侧面摄像头的数据。且车辆、行人、自行车、标识牌等图像都经过精心标记,一共打了2500万个3D标签和2200万个2D标签。

16.奥迪开源自动驾驶数据集

网站地址:http://www.a2d2.audi

该数据主要来自德国街道,包含RGB图像,也包括对应的3D点云数据,记录的数据是时间同步的。目标3D包围框,语义分割,实例分割以及从汽车总线提取的数据。标注的41227帧非序列数据,都含有语义分割标注和点云标签。其中含有前置摄像头视野内目标3D包围框标注12497帧。另外,该库还包括 392,556 连续帧的无标注的传感器数据。

17. 福特Multi-AV 数据集(2020)

网站地址:https://avdata.ford.com/

该数据集的数据类型很丰富,并且该数据集是使用ROS采集,提供了ROS Topic,可以在ROS集成,使得应用非常方便。同时涵盖场景丰富,包含了不同季节以及不同场景的数据,还开源了3D Map。

——————————————————

关于我们:

小马数据,具有专业的人工智能数据标注服务与自研标注系统,以高质量数据服务赋能AI,提供更专业、更准确、更安全的数据服务。业务覆盖计算机视觉、自动驾驶、语音标注、文本处理及个性化定制等技术领域。