笔记:OpenCV之眨眼检测

前言

这个也是这个系列课程的笔记,我觉得这个实例不应该叫疲劳检测应该是单纯的眨眼检测哈哈哈哈,如果疲劳检测的话,应该再写一段程序:如果检测到连续20帧(比如说20帧呀),这个EAR值都低于阈值,那么这个驾驶员就在打盹,所以就是疲劳,所以应该报警,然后真实情况应该得加进一些点头频率的检测,就比较复杂。所以这个眨眼检测就是基础版啦,还挺有意思的,值得mark!

总体的一个思路流程

- 首先写一个while true循环读入每一帧图像

- 图像的预处理,包括灰度,更重要的是resize每一帧的图像,因为太小检测不到人脸

- 将一帧图的灰度处理后放入人脸检测的detector中,得到人脸检测的ROI区域

- 再写一个for 循环,(1)对每一个人脸ROI区域转换出它在原图的坐标;(2)计算左右眼的EAR值再取平均;(3)判断EAR值是不是小于阈值0.3,是的话就count+1,不是的话判断这个count是不是大于3,连续3帧小于EAR值的话,判断为眨眼+1;如果count不是小于3,那么就表示不是连续的3帧小于EAR值,所以不是眨眼,count清为0

- 返回while true 读入下一帧图像

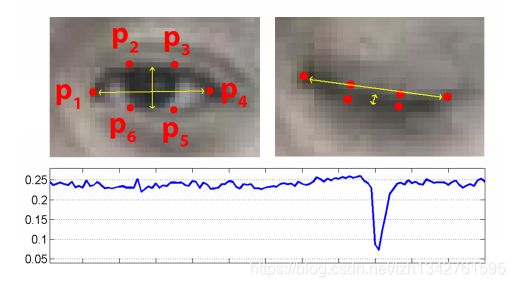

其中EAR值和对应的图像和计算公式就是这个论文所示的:

- EAR计算公式

具体实现

导入包

#导入工具包

from scipy.spatial import distance as dist# 导入计算距离的程序包scipy.spatial

from collections import OrderedDict # 导入顺序表

import numpy as np

import argparse

import time

import dlib

import cv2-

EAR计算公式函数

def eye_aspect_ratio(eye):# 根据论文的公式,计算6个点,3对点的距离

# 计算距离,竖直的

A = dist.euclidean(eye[1], eye[5])

B = dist.euclidean(eye[2], eye[4])

# 计算距离,水平的

C = dist.euclidean(eye[0], eye[3])

# ear值

ear = (A + B) / (2.0 * C)

return ear-

利顺序表写明68个点对应的器官

# 检测出来的将会有68个点,利用顺序表指定这68个点分别对应的类别

FACIAL_LANDMARKS_68_IDXS = OrderedDict([

("mouth", (48, 68)),

("right_eyebrow", (17, 22)),

("left_eyebrow", (22, 27)),

("right_eye", (36, 42)),

("left_eye", (42, 48)),

("nose", (27, 36)),

("jaw", (0, 17))

])-

转换坐标函数(点对坐标转换为全部一个np.array的坐标)

def shape_to_np(shape, dtype="int"):

# 创建68*2

coords = np.zeros((shape.num_parts, 2), dtype=dtype) #68个点,每一个点有x,y两个,所以68*2

# 遍历每一个关键点

# 得到坐标

for i in range(0, shape.num_parts):

coords[i] = (shape.part(i).x, shape.part(i).y)

return coords-

开始实现

# 输入参数

ap = argparse.ArgumentParser()

ap.add_argument("-p", "--shape-predictor", required=True,

help="path to facial landmark predictor")

ap.add_argument("-v", "--video", type=str, default="",

help="path to input video file")

args = vars(ap.parse_args())

# 设置判断参数

EYE_AR_THRESH = 0.3 # 这个是人眼睁开时正常的距离

EYE_AR_CONSEC_FRAMES = 3 # 这个是连续检测那个EAR小于阈值0.3的帧数

# 初始化计数器

COUNTER = 0

TOTAL = 0

# 检测与定位工具

print("[INFO] loading facial landmark predictor...")

detector = dlib.get_frontal_face_detector()# 初始化检测人脸的函数detector

predictor = dlib.shape_predictor(args["shape_predictor"]) # 将检测出的人脸的ROI区域放入predictor中可以获得关键点在ROI中的距离

# 分别取两个眼睛区域

(lStart, lEnd) = FACIAL_LANDMARKS_68_IDXS["left_eye"] # 42-48

(rStart, rEnd) = FACIAL_LANDMARKS_68_IDXS["right_eye"]# 36-42

# 读取视频

print("[INFO] starting video stream thread...")

vs = cv2.VideoCapture(args["video"])

#vs = FileVideoStream(args["video"]).start()

time.sleep(1.0)

# 遍历每一帧

while True:

# 预处理

frame = vs.read()[1]#只取第二个帧图像就可以,所以加个[1]

if frame is None: # 如果frame读出是None,表明这个视频已经播放完了,就结束循环

break

(h, w) = frame.shape[:2]

width=1200 #将每一帧的图像放大到宽度是1200,如果图像太小可能检测不到人脸

r = width / float(w)

dim = (width, int(h * r)) # 放大h,宽度和高度都要放大相同的比例

frame = cv2.resize(frame, dim, interpolation=cv2.INTER_AREA) # resize frame ,插值方法使用INTER_AREA内部区域插值

gray = cv2.cvtColor(frame, cv2.COLOR_BGR2GRAY)# 转灰度图

# 检测人脸

rects = detector(gray, 0)# 将灰度图输入到人脸检测器中,输出rects 可能含有多个人脸的ROI

# 遍历每一个检测到的人脸

for rect in rects:

# 获取坐标

shape = predictor(gray, rect) # 获得人脸ROI中在gray图中的坐标

shape = shape_to_np(shape) # 用自己定义的函数将坐标额点对转换为numpy类型的68*2长度数组

# 分别计算ear值

leftEye = shape[lStart:lEnd]# 取出左右眼的坐标36-42,42-48

rightEye = shape[rStart:rEnd]

leftEAR = eye_aspect_ratio(leftEye)

rightEAR = eye_aspect_ratio(rightEye)

# 算一个平均的

ear = (leftEAR + rightEAR) / 2.0

# 绘制眼睛区域

leftEyeHull = cv2.convexHull(leftEye)

rightEyeHull = cv2.convexHull(rightEye)

cv2.drawContours(frame, [leftEyeHull], -1, (0, 255, 0), 1)

cv2.drawContours(frame, [rightEyeHull], -1, (0, 255, 0), 1)

# 检查是否满足阈值

if ear < EYE_AR_THRESH: # 如果该帧算得的EAR值小于阈值0.3,就计数+1

COUNTER += 1

else:

# 如果连续几帧都是闭眼的,总数算一次

if COUNTER >= EYE_AR_CONSEC_FRAMES: # 如果连续几帧中出现一帧没有小于阈值,再去判断计数是否大于最大帧数3,如果是就认为出现眨眼睛,总数+1

TOTAL += 1

# 重置

COUNTER = 0

# 显示

cv2.putText(frame, "Blinks: {}".format(TOTAL), (10, 30),

cv2.FONT_HERSHEY_SIMPLEX, 0.7, (0, 0, 255), 2)

cv2.putText(frame, "EAR: {:.2f}".format(ear), (300, 30),

cv2.FONT_HERSHEY_SIMPLEX, 0.7, (0, 0, 255), 2)

cv2.imshow("Frame", frame)

key = cv2.waitKey(10) & 0xFF

if key == 27:

break

vs.release()

cv2.destroyAllWindows()

最后

这个就是眨眼检测的大体实现流程啦,同样用的是dlib这个库,同样我还是没有安装成功,先写个笔记免得忘记,谢谢大家。