企业级日志分析系统 ELK 详解

文章目录

- 前言

- 一、ELK 日志分析系统

-

- 1. ELK 简介

- 2. 组件说明

-

- 2.1 ElasticSearch

- 2.2 Logstash

- 2.3 Kibana

- 2.4 Filebeat

- 3. 完整日志系统的基本特征

- 4. ELK的工作原理

- 二、部署 ELK 日志分析系统

-

- 1. 服务器配置

- 2. 关闭防火墙

- 3. ElasticSearch集群部署(node1、node2)

-

- 3.1 环境准备

- 3.2 部署 ElasticSearch 软件

-

- 3.2.1 安装 elasticsearch-rpm 包

- 3.2.2 加载系统服务

- 3.2.3 修改 elasticsearch 主配置文件

- 3.2.4 创建数据存放路径并授权

- 3.2.5 启动 elasticsearch

- 3.2.6 查看节点信息

- 3.3 安装 Elasticsearch-head 插件

-

- 3.3.1 编译安装 node

- 3.3.2 安装 phantomjs

- 3.3.3 安装 Elasticsearch-head 数据可视化工具

- 3.3.4 修改 Elasticsearch 主配置文件

- 3.3.5 启动 elasticsearch-head 服务

- 3.3.6 通过 Elasticsearch-head 查看 ES 信息

- 3.3.7 插入索引

- 3.3.8 浏览器查看索引信息

- 4. ELK-Logstash 部署(在 Apache 节点上操作)

-

- 4.1 更改主机名

- 4.2 安装 Apache 服务(httpd)

- 4.3 安装 Java 环境

- 4.4 安装 logstash

- 4.5 测试 Logstash

-

- 4.5.1 Logstash 命令常用选项

- 4.5.2 定义输入和输出流

-

- 4.5.2.1 标准输入、输出

- 4.5.2.2 rubydebug 输出

- 4.5.2.3 输出到 ES

- 4.6 定义 logstash 配置文件

- 4.7 访问测试

- 5. ELK-Kibana 部署(在 node1 节点上操作)

-

- 5.1 安装 Kibana

- 5.2 设置 Kibana 的主配置文件

- 5.3 启动 Kibana 服务

- 5.4 验证 Kibana

- 5.5 将 Apache 服务器的日志(访问的、错误的)添加到 ES 并通过 Kibana 显示

- 5.6 浏览器访问

- 三、ELFK(Filebeat + ELK)

-

- 1. Filebeat 的作用

- 2. ELFK 工作流程

- 3. ELFK 的部署

-

- 3.1 服务器配置

- 3.2 服务器环境

- 3.3 安装 filebeat

- 3.4 修改 filebeat 主配置文件

- 3.5 在 logstash 组件所在节点(apache节点)上新建一个 logstash 配置文件

- 3.6 浏览器验证

前言

- 分析日志是运维工程师发现问题,解决系统故障的主要手段。日志主要包括系统日志、应用程序日志和安全日志。

- 一般大型系统是一个分布式部署的架构,不同的服务模块部署在不同的服务器上,问题出现时,大部分情况需要根据问题暴露的关键信息,定位到具体的服务器和服务模块,构建一套集中式日志系统,可以提高定位问题的效率。

- 经常分析日志可以了解服务器的负荷,性能安全性,从而及时采取措施纠正错误。通常,日志被分散的储存在不同的设备上。如果管理数十上百台服务器,还在使用依次登录每台机器的传统方法查阅日志,既繁琐又效率低下。为此,我们可以使用集中化的日志管理,例如:开源的 syslog,将所有服务器上的日志收集汇总。

- 集中化管理日志后,日志的统计和检查又成为一件比较麻烦的事情,一般我们使用 grep、awk 和 wc 等 Linux 命令能实现检索和统计,但是对于更高要求的查询、排序和统计等,再加上庞大的机器数量,使用这样的方法依然难免有点力不从心。

- 开源实时日志分析 ELK 平台能够完美的解决我们上述的问题,ELK 由 ElasticSearch、Logstash 和 Kibana 这三个开源工具组成。

一、ELK 日志分析系统

1. ELK 简介

ELK 平台是一套完整的日志集中处理解决方案,将 ElasticSearch、Logstash 和 Kibana 三个开源工具配合使用,完成更强大的用户对日志的查询、排序、统计需求。

2. 组件说明

2.1 ElasticSearch

- ES 是基于 Lucene(一个全文检索引擎的架构)开发的分布式存储检索引擎,用来存储各类日志。

- ES 是用 JAVA 开发的,可通过 RESTful Web 接口,让用户可以通过浏览器与 ES 通信。

- ES 是个分布式搜索和分析引擎,优点是能对大容量的数据进行接近实时的存储、搜索和分析操作。

2.2 Logstash

- Logstash 作为数据收集引擎。它支持动态的从各种数据源搜索数据,并对数据进行过滤、分析、丰富、统一格式等操作,然后存储到用户指定的位置,一般会发送给 ES。

- Logstash 由 JRuby 语言编写,运行在 JAVA 虚拟机(JVM)上,是一款强大的数据处理工具,可以实现数据传输、格式处理、格式化输出。Logstash 具有强大的插件功能,常用于日志处理。

2.3 Kibana

- Kibana 是基于 Node.js 开发的展示工具,可以为 Logstash 和 ES 提供图形化的日志分析 Web 界面展示,可以汇总、分析和搜索重要数据日志。

2.4 Filebeat

- Filebeat 是一款轻量级的开源日志文件数据搜索器。通常在需要采集数据的客户端安装 Filebeat,并指定目录与日志格式,Filebeat 就能快速收集数据,并发送给 Logstash 进行解析,或是直接发给 ES 存储,性能上相比运行于 JVM 上的 Logstash 优势明显,是对它的替代。

日志的集中化管理 beats 包括四种工具:

Packetbeat(搜索网络流量数据)

Topbeat(搜索系统、进程和文件系统级别的 CPU 和内存使用情况等数据)

Filebeat(搜集文件数据)

Winlogbeat(搜集 Windows 时间日志数据)

3. 完整日志系统的基本特征

- 收集:能够采集多种来源的日志数据

- 传输:能够稳定的把日志数据解析过滤并传输到存储系统

- 存储:存储日志数据

- 分析:支持 UI 分析

- 警告:能够提供错误报告,监控机制

4. ELK的工作原理

- AppServer 是一个类似于 Nginx、Apache 的集群,其日志信息由 Logstash 来收集

- 往往为了减少网络问题所带来的瓶颈,会把 Logstash 服务放入前者的集群内,减少网络的消耗

- Logstash 把收集到的日志数据格式化后输出转存至 ES 数据库内(这是一个将日志进行集中化管理的过程)

- 随后,Kibana 对 ES 数据库内格式化后日志数据信息进行索引和存储

- 最后,Kibana 把其展示给客户端

二、部署 ELK 日志分析系统

1. 服务器配置

| 服务器 | 配置 | 主机名 | ip地址 | 主要软件 |

|---|---|---|---|---|

| node1 节点 | 2C/4G | node1 | 192.168.10.100 | ElasticSearch、Kibana |

| node2 节点 | 2C/4G | node2 | 192.168.10.101 | ElasticSearch |

| apache 节点 | - | apache | 192.168.10.102 | Logstash、Apache |

2. 关闭防火墙

systemctl stop firewalld && systemctl disable firewalld

setenforce 0

ntpdate ntp.aliyun.com

3. ElasticSearch集群部署(node1、node2)

3.1 环境准备

以 node1 为例

[root@localhost ~]# hostnamectl set-hostname node1

[root@localhost ~]# su

[root@node1 ~]# echo "192.168.10.100 node1" >> /etc/hosts

[root@node1 ~]# echo "192.168.10.101 node2" >> /etc/hosts

[root@node1 ~]# java -version #不建议使用 openjdk

# rpm 安装 jdk (方法一)

cd /opt

#将软件包传至该目录下

rpm -ivh jdk-8u201-linux-x64.rpm

vim /etc/profile.d/java.sh

export JAVA_HOME=/usr/java/jdk1.8.0_201-amd64

export CLASSPATH=.:$JAVA_HOME/lib/tools.jar:$JAVA_HOME/lib/dt.jar

export PATH=$JAVA_HOME/bin:$PATH

#注释:

1.输出定义java的工作目录

2.输出指定java所需的类文件

3.输出重新定义环境变量,$PATH一定要放在$JAVA_HOME的后面,让系统先读取到工作目录中的版本信息

source /etc/profile.d/java.sh

java -version

# rpm 安装 jdk (方法二)

cd /opt

tar zxvf jdk-8u91-linux-x64.tar.gz -C /usr/local

mv /usr/local/jdk1.8.0_91/ /usr/local/jdk

vim /etc/profile

export JAVA_HOME=/usr/local/jdk

export JRE_HOME=${JAVA_HOME}/jre

export CLASSPATH=.:${JAVA_HOME}/lib:${JRE_HOME}/lib

export PATH=${JAVA_HOME}/bin:$PATH

source /etc/profile

java -version

3.2 部署 ElasticSearch 软件

3.2.1 安装 elasticsearch-rpm 包

以 node1 为例

[root@node1 ~]# cd /opt

[root@node1 opt]# rz -E

#上传elasticsearch-5.5.0.rpm到/opt目录下

rz waiting to receive.

[root@node1 opt]# rpm -ivh elasticsearch-5.5.0.rpm

3.2.2 加载系统服务

以 node1 为例

systemctl daemon-reload && systemctl enable elasticsearch.service

3.2.3 修改 elasticsearch 主配置文件

以 node1 为例

[root@node1 opt]# cp /etc/elasticsearch/elasticsearch.yml /etc/elasticsearch/elasticsearch.yml.bak

#备份配置文件

[root@node1 opt]# vim /etc/elasticsearch/elasticsearch.yml

##17行,取消注释,指定群集名称

cluster.name: my-elk-cluster

##23行,取消注释,指定节点名称(node1节点为node1,node2节点为node2)

node.name: node1

##33行,取消注释,指定数据存放路径

path.data: /data/elk_data

##37行,取消注释,指定日志存放路径

path.logs: /var/log/elasticsearch/

##43行,取消注释,不在启动的时候锁定内存(前端缓存,与IOPS-性能测试方式,每秒读写次数相关)

bootstrap.memory_lock: false

##55行,取消注释,设置监听地址,0.0.0.0代表所有地址

network.host: 0.0.0.0

##59行,取消注释,ES服务的默认监听端口为9200

http.port: 9200

##68行,取消注释,集群发现通过单播实现,指定要发现的节点node1、node2

discovery.zen.ping.unicast.hosts: ["node1", "node2"]

[root@node1 opt]# grep -v "^#" /etc/elasticsearch/elasticsearch.yml

cluster.name: my-elk-cluster

node.name: node1

path.data: /data/elk_data

path.logs: /var/log/elasticsearch/

bootstrap.memory_lock: false

network.host: 0.0.0.0

http.port: 9200

discovery.zen.ping.unicast.hosts: ["node1", "node2"]

-------------------------------------------------------

scp /etc/elasticsearch/elasticsearch.yml [email protected]:/etc/elasticsearch/elasticsearch.yml

#将配置好的文件用 scp 传至 node2,后续只用去改个节点名字即可

3.2.4 创建数据存放路径并授权

以 node1 为例

[root@node1 opt]# mkdir -p /data/elk_data

[root@node1 opt]# chown elasticsearch:elasticsearch /data/elk_data/

3.2.5 启动 elasticsearch

以 node1 为例

[root@node1 opt]# systemctl start elasticsearch.service

[root@node1 opt]# netstat -natp | grep 9200 #启动较慢,需等待

tcp6 0 0 :::9200 :::* LISTEN 4216/java

3.2.6 查看节点信息

浏览器访问 http://192.168.10.100:9200、http://192.168.10.101:9200 查看节点 node1、node2 的信息

浏览器访问 http://192.168.10.100:9200/_cluster/health?pretty、http://192.168.10.101:9200/_cluster/health?pretty查看群集的健康情况,可以看到status值为green(绿色),表示节点健康运行

浏览器访问 http://192.168.10.100:9200/_cluster/state?pretty、http://192.168.10.101:9200/_cluster/state?pretty 检查群集状态信息

使用上述方式查看群集的状态对用户并不友好,可以通过安装 Elasticsearch-head 插件,更方便的对群集进行管理。

3.3 安装 Elasticsearch-head 插件

ES 在 5.0 版本后,插件需要作为独立服务进行安装,需要使用 npm 工具(NodeJS 的包管理工具)安装。安装 Elasticsarch-head 需要提前安装好依赖软件 node 和 phantomjs。

- node

是一个基于 Chrome V8 引擎的 JavaScript 运行环境。 - phantomjs

是一个基于 webkit 的 JavaScriptAPI,可以理解为一个隐形的浏览器,任何基于 webkit 浏览器做的事情,它都可以做到。

3.3.1 编译安装 node

以 node1 为例

[root@node1 ~]# cd /opt

[root@node1 opt]# rz -E

#上传软件包node-v8.2.1.tar.gz到/opt目录

rz waiting to receive.

[root@node1 opt]# yum install -y gcc gcc-c++ make

[root@node1 opt]# tar zxvf node-v8.2.1.tar.gz

[root@node1 opt]# cd node-v8.2.1/

[root@node1 node-v8.2.1]# ./configure

[root@node1 node-v8.2.1]# make -j 4 && make install

#编译时间很长

3.3.2 安装 phantomjs

以 node1 为例

[root@node1 node-v8.2.1]# cd /opt

[root@node1 opt]# rz -E

#上传软件包phantomjs-2.1.1-linux-x86_64.tar.bz2到/opt目录

rz waiting to receive.

[root@node1 opt]# tar jxvf phantomjs-2.1.1-linux-x86_64.tar.bz2 -C /usr/local/src

[root@node1 opt]# cd /usr/local/src/phantomjs-2.1.1-linux-x86_64/bin

[root@node1 bin]# cp phantomjs /usr/local/bin

3.3.3 安装 Elasticsearch-head 数据可视化工具

以 node1 为例

[root@node1 bin]# cd /opt

[root@node1 opt]# rz -E

#上传软件包elasticsearch-head.tar.gz到/opt目录

rz waiting to receive.

[root@node1 opt]# tar zxvf elasticsearch-head.tar.gz -C /usr/local/src/

[root@node1 opt]# cd /usr/local/src/elasticsearch-head/

[root@node1 elasticsearch-head]# npm install

3.3.4 修改 Elasticsearch 主配置文件

以 node1 为例

[root@node1 elasticsearch-head]# vim /etc/elasticsearch/elasticsearch.yml

##末行添加以下内容

http.cors.enabled: true ##开启跨域访问支持,默认为false

http.cors.allow-origin: "*" ##指定跨域访问允许的域名地址为所有

[root@node1 elasticsearch-head]# systemctl restart elasticsearch.service

[root@node1 elasticsearch-head]# netstat -antp | grep 9200

3.3.5 启动 elasticsearch-head 服务

以 node1 为例

[root@node1 elasticsearch-head]# cd /usr/local/src/elasticsearch-head/

[root@node1 elasticsearch-head]# npm run start &

[1] 71012

> [email protected] start /usr/local/src/elasticsearch-head

> grunt server

Running "connect:server" (connect) task

Waiting forever...

Started connect web server on http://localhost:9100

^C

[root@node1 elasticsearch-head]# netstat -natp | grep 9100

tcp 0 0 0.0.0.0:9100 0.0.0.0:* LISTEN 71022/grunt

注:必须在解压后的 elasticsearch-head 目录下启动服务,进程会读取该目录下的 gruntfile.js 文件,否则可能启动失败。

3.3.6 通过 Elasticsearch-head 查看 ES 信息

通过浏览器访问 http://192.168.10.100:9100 地址并连接群集。如果看到群集健康值为 green,代表群集很健康。

有的时候显示未连接,这时将 localhost 改成 IP 地址即可

3.3.7 插入索引

通过命令插入一个测试索引,索引为 index-demo,类型为 test

[root@node1 elasticsearch-head]# curl -X PUT 'localhost:9200/index-demo/test/1?pretty&pretty' -H 'content-Type: application/json' -d '{"user":"zhangsan","mesg":"hello world"}'

{

"_index" : "index-demo",

"_type" : "test",

"_id" : "1",

"_version" : 1,

"result" : "created",

"_shards" : {

"total" : 2,

"successful" : 2,

"failed" : 0

},

"created" : true

}

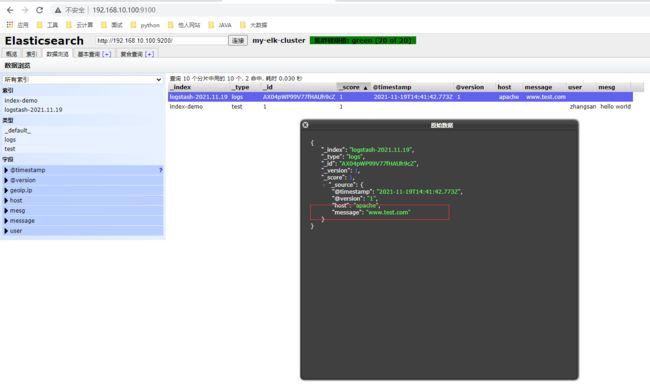

3.3.8 浏览器查看索引信息

浏览器访问 http://129.168.10.100:9100 查看索引信息,可以看见索引默认被分片为 5 个,并且有一个副本。

点击 **数据浏览**,会发现在 node1 上创建的索引为 index-demo,类型为 test 的相关信息。

4. ELK-Logstash 部署(在 Apache 节点上操作)

- Logstash 一般部署在需要监控其日志的服务器。在本案例中,Logstash 部署在 Apache 服务器上,用于收集 Apache 的日志信息并发送到 Elasticsearch。

4.1 更改主机名

[root@localhost ~]# hostnamectl set-hostname apache

[root@localhost ~]# su

[root@apache ~]#

4.2 安装 Apache 服务(httpd)

[root@apache ~]# yum install -y httpd

[root@apache ~]# systemctl start httpd && systemctl enable httpd

4.3 安装 Java 环境

cd /opt

tar zxvf jdk-8u91-linux-x64.tar.gz -C /usr/local

mv /usr/local/jdk1.8.0_91/ /usr/local/jdk

vim /etc/profile

export JAVA_HOME=/usr/local/jdk

export JRE_HOME=${JAVA_HOME}/jre

export CLASSPATH=.:${JAVA_HOME}/lib:${JRE_HOME}/lib

export PATH=${JAVA_HOME}/bin:$PATH

source /etc/profile

java -version

4.4 安装 logstash

[root@apache ~]# cd /opt

[root@apache opt]# rz -E #上传安装包 logstash-5.5.1.rpm

[root@apache opt]# rpm -ivh logstash-5.5.1.rpm

[root@apache opt]# systemctl start logstash.service && systemctl enable logstash.service

[root@apache opt]# ln -s /usr/share/logstash/bin/logstash /usr/local/bin/

4.5 测试 Logstash

4.5.1 Logstash 命令常用选项

| Logstash 命令常用选项 | 说明 |

|---|---|

| -f | 通过这个选项可以指定 Logstash 的配置文件,根据配置文件配置 Logstash 的输入和输出流 |

| -e | 从命令行中获取,输入、输出后面跟着字符串,该字符串可以被当做 Logstash 的配置(如果是空,则默认使用 stdin 作为输入,stdout 作为输出) |

| -t | 测试配置文件是否正确,然后退出 |

4.5.2 定义输入和输出流

4.5.2.1 标准输入、输出

输入采用标准输入,输出采用标准输出(类似管道)

[root@apache /opt]# logstash -e 'input { stdin{} } output { stdout{} }'

......

The stdin plugin is now waiting for input:

22:24:31.510 [Api Webserver] INFO logstash.agent - Successfully started Logstash API endpoint {:port=>9600}

www.test.com #键入内容(标准输入)

2021-11-19T14:28:36.175Z apache www.test.com #输入结果(标准输出)

www.4399.com

2021-11-19T14:29:01.315Z apache www.4399.com

www.baidu.com

2021-11-19T14:29:10.569Z apache www.baidu.com

2021-11-19T14:29:10.569Z apache www.baidu.com

^C22:30:07.071 [SIGINT handler] WARN logstash.runner - SIGINT received. Shutting down the agent.

22:30:07.081 [LogStash::Runner] WARN logstash.agent - stopping pipeline {:id=>"main"}

4.5.2.2 rubydebug 输出

使用 rubydebug 输出详细格式显示,codec 为一种编解码器

[root@apache /opt]# logstash -e 'input { stdin{} } output { stdout{ codec=>rubydebug } }'

......

The stdin plugin is now waiting for input:

22:37:46.417 [Api Webserver] INFO logstash.agent - Successfully started Logstash API endpoint {:port=>9600}

www.test.com #输入内容

{ #输出内容

"@timestamp" => 2021-11-19T14:38:03.535Z,

"@version" => "1",

"host" => "apache",

"message" => "www.test.com"

}

^C22:38:35.333 [SIGINT handler] WARN logstash.runner - SIGINT received. Shutting down the agent.

22:38:35.343 [LogStash::Runner] WARN logstash.agent - stopping pipeline {:id=>"main"}

4.5.2.3 输出到 ES

使用 logstash 将嘻嘻写入到 ES 中

[root@apache opt]# logstash -e 'input { stdin{} } output { elasticsearch { hosts=>["192.168.10.100:9200"] } }'

······

The stdin plugin is now waiting for input:

22:40:57.485 [Api Webserver] INFO logstash.agent - Successfully started Logstash API endpoint {:port=>9600}

www.test.com #键入内容(标准输出)

结果不在标准输出显示,而是发送至 ES,可浏览器访问 http://192.168.10.100:9100 查看索引和数据

4.6 定义 logstash 配置文件

logstash 配置文件基本由三部分组成:

- input 输入

- output 输出

- filter过滤

格式如下:

input {...}

output {...}

filter {...}

在每个部分中,也可以指定多个访问方式。例如:若要指定两个日志来源文件,则格式如下:

input {

file { path =>"/var/log/messages" type =>"syslog"}

file { path =>"/var/log/httpd/access.log" type =>"apache"}

}

修改 logstash 配置文件,让其收集系统日志 /var/log/messages,并将其输出到 ES 中。

[root@apache opt]# chmod o+r /var/log/messages

#赋予读的权限,让 Logstash 可以获取到该文件的内容

[root@apache opt]# vim /etc/logstash/conf.d/system.conf

##该文件需自行创建,文件名可自定义

input {

file{

path =>"/var/log/messages"

##指定要收集的日志的位置

type =>"system"

##自定义日志类型标识

start_position =>"beginning"

##表示从开始处收集

}

}

output {

elasticsearch{

##输出到ES

hosts =>["192.168.10.100:9200", "192.168.10.101:9200"]

##指定ES服务器的地址和端口,为避免单机故障,建议写全

index =>"system-%{+YYYY.MM.dd}"

##指定输出到ES的索引格式

}

}

[root@apache opt]# systemctl restart logstash.service

4.7 访问测试

浏览器访问 http://192.168.10.100:9100 查看索引信息

5. ELK-Kibana 部署(在 node1 节点上操作)

5.1 安装 Kibana

[root@node1 elasticsearch-head]# cd /opt

[root@node1 opt]# rz -E #上传软件包 kibana-5.5.1-x86_64.rpm

[root@node1 opt]# rpm -ivh kibana-5.5.1-x86_64.rpm

5.2 设置 Kibana 的主配置文件

[root@node1 opt]# cp /etc/kibana/kibana.yml /etc/kibana/kibana.yml.bak

#备份配置文件

[root@node1 opt]# vim /etc/kibana/kibana.yml

##2行,取消注释,kibana服务的默认监听端口为5601

server.port: 5601

##7行,取消注释,设置kibana的监听地址,0.0.0.0代表所有地址

server.host: "0.0.0.0"

##21行,取消注释,设置和ES建立连接的地址和端口

elasticsearch.url: "http://192.168.10.100:9200"

##30行,取消注释,设置在ES中添加.kibana索引

kibana.index: ".kibana"

5.3 启动 Kibana 服务

[root@node1 opt]# systemctl start kibana.service && systemctl enable kibana.service

[root@node1 opt]# netstat -natp | grep 5601

tcp 0 0 0.0.0.0:5601 0.0.0.0:* LISTEN 82765/node

5.4 验证 Kibana

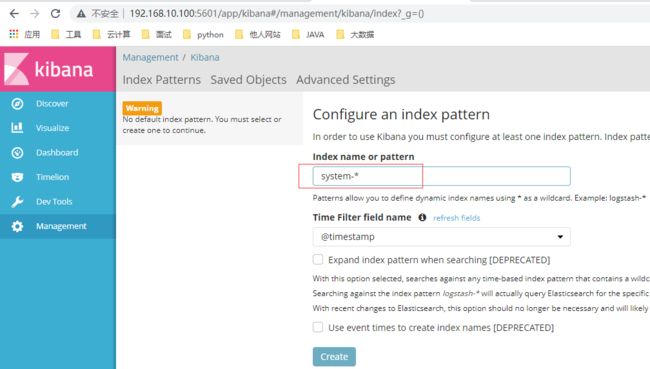

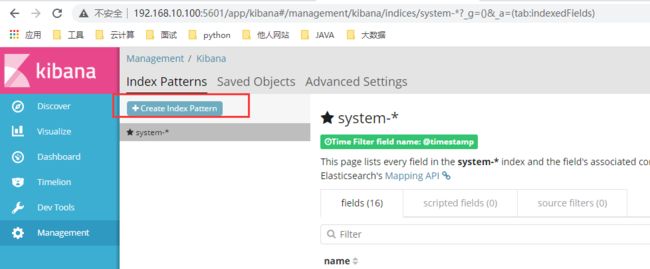

浏览器访问 http://192.168.10.100:5601

第一次登录需要添加一个 ES 索引

点击 create 创建

索引添加完成后,点击 Discover 按钮可查看图表信息及日志信息

数据展示可以分类显示,例如:在 Available Fileds 中的 host

5.5 将 Apache 服务器的日志(访问的、错误的)添加到 ES 并通过 Kibana 显示

apache 服务器

[root@apache opt]# vim /etc/logstash/conf.d/apache_log.conf

input {

file{

path => "/etc/httpd/logs/access_log"

type => "access"

start_position => "beginning"

}

file{

path => "/etc/httpd/logs/error_log"

type => "error"

start_position => "beginning"

}

}

output {

if [type] == "access" {

elasticsearch {

hosts => ["192.168.10.100:9200", "192.168.10.101:9200"]

index => "apache_access-%{+YYYY.MM.dd}"

}

}

if [type] == "error" {

elasticsearch {

hosts => ["192.168.10.100:9200", "192.168.10.101:9200"]

index => "apache_error-%{+YYYY.MM.dd}"

}

}

}

[root@apache opt]# cd /etc/logstash/conf.d

[root@apache conf.d]# /usr/share/logstash/bin/logstash -f apache_log.conf

······

23:42:13.199 [Api Webserver] INFO logstash.agent - Successfully started Logstash API endpoint {:port=>9601}

5.6 浏览器访问

浏览器访问 http://192.168.10.100:9100 查看索引是否创建

可能你只看到了 apache-error,那是因为 access 需要访问 httpd 页面才能生成

浏览器访问 http://192.168.10.100:5601 登录 kibana,添加 apache_access-* 和 apache_error-* 索引,查看日志信息。

三、ELFK(Filebeat + ELK)

1. Filebeat 的作用

- 由于 logstash 会大量占用系统的内存资源,一般我们会使用 filebeat 替换 logstash 收集日志的功能,组成 ELFK 架构。

- 或用 fluentd 替代 logstash 组成 EFK(elasticsearch/fluentd/kibana),由于 fluentd 是由 Go 语言开发的,一般在 K8s 环境中使用较多。

2. ELFK 工作流程

- filebeat 将日志收集后交由 logstash 处理

- logstash 进行过滤、格式化等操作,满足过滤条件的数据将发送给 ES

- ES 对数据进行分片存储,并提供索引功能

- Kibana 对数据进行图形化的 web 展示,并提供索引接口

3. ELFK 的部署

3.1 服务器配置

| 服务器 | 配置 | 主机名 | ip地址 | 主要软件部署 |

|---|---|---|---|---|

| node1 节点 | 2C/4G | node1 | 192.168.10.100 | ElasticSearch、Kibana |

| node2 节点 | 2C/4G | node2 | 192.168.10.101 | ElasticSearch |

| apache 节点 | - | apache | 192.168.10.30 | Logstash、Apache |

| filebeat 节点 | - | filebeat | 192.168.10.20 | Filebeat |

在 ELK 的基础上,增加一台 filebeat 服务器

3.2 服务器环境

filebeat 节点

[root@localhost ~]# hostnamectl set-hostname filebeat

[root@localhost ~]# su

[root@filebeat ~]# systemctl stop firewalld && systemctl disable firewalld

[root@filebeat ~]# setenforce 0

3.3 安装 filebeat

filebeat 节点

#wget https://artifacts.elastic.co/downloads/beats/filebeat/filebeat-6.2.4-linux-x86_64.tar.gz

#wget http://101.34.22.188/ELK/filebeat-5.5.1-linux-x86_64.tar.gz -P /opt

[root@filebeat ~]# wget http://101.34.22.188/ELK/filebeat-6.2.4-linux-x86_64.tar.gz -P /opt

[root@filebeat ~]# cd /opt

[root@filebeat opt]# tar zxvf filebeat-6.2.4-linux-x86_64.tar.gz

[root@filebeat opt]# mv filebeat-6.2.4-linux-x86_64 /usr/local/filebeat

3.4 修改 filebeat 主配置文件

filebeat 节点

[root@filebeat opt]# cd /usr/local/filebeat/

[root@filebeat filebeat]# cp filebeat.yml filebeat.yml.bak

[root@filebeat filebeat]# vim filebeat.yml

filebeat.prospectors:

##21行,指定log类型,从日志文件中读取消息

- type: log

##24行,开启日志收集功能,默认为false

enabled: true

##28行,指定监控的日志文件

- /var/log/*.log

##29行,添加收集/var/log/messages

- /var/log/messages

##31行,添加以下内容,注意格式

fields:

service_name: filebeat

log_type: log

service_id: 192.168.10.20

#-------------------------- Elasticsearch output ------------------------------

该区域内容全部注释

#----------------------------- Logstash output --------------------------------

##157行,取消注释

output.logstash:

##159行,取消注释,指定logstash的IP和端口号

hosts: ["192.168.10.30:5044"]

[root@filebeat filebeat]# ./filebeat -e -c filebeat.yml

#启动filebeat,-e记录到stderr并禁用syslog /文件输出,-c指定配置文件

3.5 在 logstash 组件所在节点(apache节点)上新建一个 logstash 配置文件

[root@apache ~]# cd /etc/logstash/conf.d/

[root@apache conf.d]# vim logstash.conf

input {

beats {

port => "5044"

}

}

output {

elasticsearch {

hosts => ["192.168.10.100:9200", "192.168.10.101:9200"]

index => "%{[fields][service_name]}-%{+YYYY.MM.dd}"

}

stdout {

codec => rubydebug

}

}

[root@apache conf.d]# /usr/share/logstash/bin/logstash -f apache_log.conf

3.6 浏览器验证

浏览器访问 http://192.168.10.100:5601 登录 kibana, 添加 filebeat-* 索引后在 Discover 中查看 filebeat 日志收集情况。

ELK 理论详解

ELK 部署

ELK 详解

Zookeeper、Kafka集群与Filebeat+Kafka+ELK架构