第十周 数据增强

第十周 数据增强

- 本文为365天深度学习训练营 中的学习记录博客

- 参考文章:365天深度学习训练营-第10周:数据增强(训练营内部成员可读)

- 原作者:K同学啊|接辅导、项目定制

第10周:数据增强

● 难度:夯实基础⭐⭐

● 语言:Python3、TensorFlow2

要求:

- 学会在代码中使用数据增强手段来提高acc

- 请探索更多的数据增强手段并记录

在本教程中,你将学会如何进行数据增强,并通过数据增强用少量数据达到非常非常棒的识别准确率。

我将展示两种数据增强方式,以及如何自定义数据增强方式并将其放到我们代码当中,两种数据增强方式如下:

● 将数据增强模块嵌入model中

● 在Dataset数据集中进行数据增强

一、前期工作

1. 设置GPU

import matplotlib.pyplot as plt

import numpy as np

#隐藏警告

import warnings

warnings.filterwarnings('ignore')

from tensorflow.keras import layers

import tensorflow as tf

gpus = tf.config.list_physical_devices("GPU")

if gpus:

tf.config.experimental.set_memory_growth(gpus[0], True) #设置GPU显存用量按需使用

tf.config.set_visible_devices([gpus[0]],"GPU")

# 打印显卡信息,确认GPU可用

print(gpus)

![]()

2. 导入并加载数据

data_dir = "G:/study/365_10data/"

img_height = 224

img_width = 224

batch_size = 32

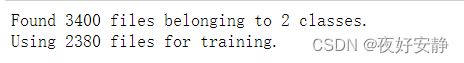

train_ds = tf.keras.preprocessing.image_dataset_from_directory(

data_dir,

validation_split=0.3,

subset="training",

seed=12,

image_size=(img_height, img_width),

batch_size=batch_size)

val_ds = tf.keras.preprocessing.image_dataset_from_directory(

data_dir,

validation_split=0.3,

subset="validation",

seed=12,

image_size=(img_height, img_width),

batch_size=batch_size)

3. 创建测试集

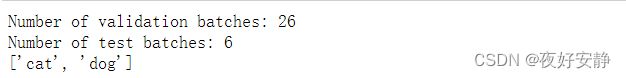

使用 tf.data.experimental.cardinality(cardinality基数) 确定验证集中有多少批次的数据,然后将其中的 20% 移至测试集。

val_batches = tf.data.experimental.cardinality(val_ds) #<tf.Tensor: shape=(), dtype=int64, numpy=32>,可通过.numpy()获取到批次数量,1020/32=31.875

test_ds = val_ds.take(val_batches//5)

val_ds = val_ds.skip(val_batches//5) #跳过20%

print('Number of validation batches: %d' % tf.data.experimental.cardinality(val_ds))

print('Number of test batches: %d' % tf.data.experimental.cardinality(test_ds))

class_names = train_ds.class_names

print(class_names)

)

4.归一化数据

AUTOTUNE = tf.data.experimental.AUTOTUNE

def preprocess_image(image,label):

return (image/255.0,label)

train_ds = train_ds.map(preprocess_image,num_parallel_calls=AUTOTUNE) #If the value`tf.data.AUTOTUNE` is used, then the number of parallel

val_ds = val_ds.map(preprocess_image,num_parallel_calls=AUTOTUNE) #calls is set dynamically based on available CPU.

test_ds = test_ds.map(preprocess_image,num_parallel_calls=AUTOTUNE)

train_ds = train_ds.cache().shuffle(1000).prefetch(buffer_size=AUTOTUNE)

val_ds = val_ds.cache().prefetch(buffer_size=AUTOTUNE)

plt.figure(figsize=(20,10))

for images,labels in train_ds.take(1):

for i in range(10):

ax = plt.subplot(5,10,i+1)

plt.imshow(images[i])

plt.title(class_names[labels[i]])

plt.axis('off')

二、数据增强

我们可以使用 tf.keras.layers.experimental.preprocessing.RandomFlip 与 tf.keras.layers.experimental.preprocessing.RandomRotation 进行数据增强

● tf.keras.layers.experimental.preprocessing.RandomFlip:水平和垂直随机翻转每个图像。

● tf.keras.layers.experimental.preprocessing.RandomRotation:随机旋转每个图像

data_augmentation = tf.keras.Sequential([

tf.keras.layers.experimental.preprocessing.RandomFlip("horizontal_and_vertical"),

tf.keras.layers.experimental.preprocessing.RandomRotation(0.2),

])

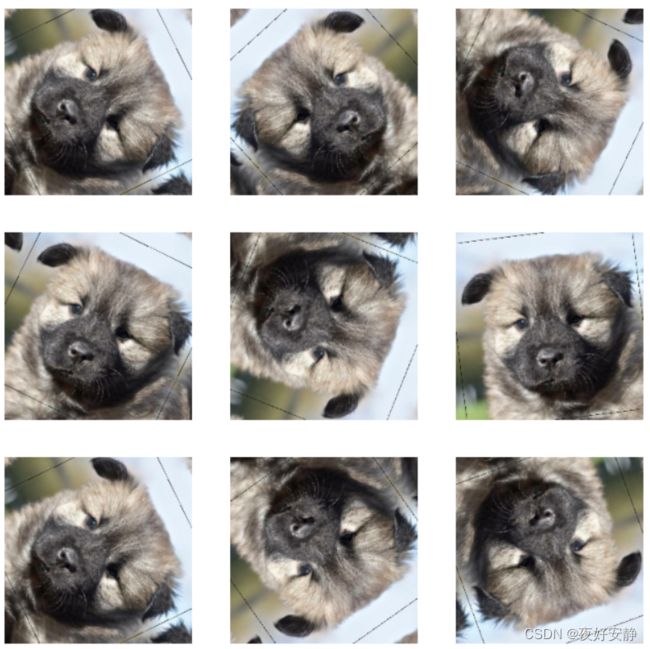

第一个层表示进行随机的水平和垂直翻转,而第二个层表示按照 0.2 的弧度值进行随机旋转。

# Add the image to a batch.

image = tf.expand_dims(images[i], 0)

plt.figure(figsize=(8, 8))

for i in range(9):

augmented_image = data_augmentation(image)

ax = plt.subplot(3, 3, i + 1)

plt.imshow(augmented_image[0])

plt.axis("off")

更多的数据增强方式可以参考:https://www.tensorflow.org/api_docs/python/tf/keras/layers/RandomRotation

三、增强方式

方法一:将其嵌入model中

model = tf.keras.Sequential([

data_augmentation,

layers.Conv2D(16, 3, padding='same', activation='relu'),

layers.MaxPooling2D(),

])

这样做的好处是:

● 数据增强这块的工作可以得到GPU的加速(如果你使用了GPU训练的话)

注意:只有在模型训练时(Model.fit)才会进行增强,在模型评估(Model.evaluate)以及预测(Model.predict)时并不会进行增强操作。

方法二:在Dataset数据集中进行数据增强

batch_size = 32

AUTOTUNE = tf.data.AUTOTUNE

def prepare(ds):

ds = ds.map(lambda x, y: (data_augmentation(x, training=True), y), num_parallel_calls=AUTOTUNE)

return ds

train_ds = prepare(train_ds)

四、训练模型

model = tf.keras.Sequential([

layers.Conv2D(32,(3,3),padding='same',activation='relu',input_shape=(224,224,3)),

layers.MaxPooling2D(),

layers.Conv2D(64,(3,3),padding='same',activation='relu'),

layers.MaxPooling2D(),

layers.Conv2D(128,(3,3),padding='same',activation='relu'),

layers.MaxPooling2D(),

layers.Flatten(),

layers.Dense(128,activation='relu'),

layers.Dense(2,activation='softmax')

])

model.compile(optimizer='adam',

loss=tf.keras.losses.SparseCategoricalCrossentropy(),

metrics=['accuracy'])

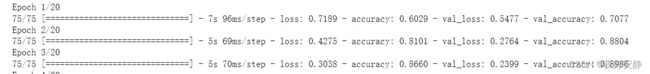

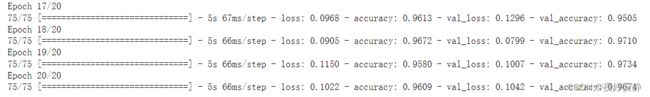

epochs=20

history = model.fit(

train_ds,

validation_data=val_ds,

epochs=epochs

)

loss,acc = model.evaluate(test_ds)

print('Accuracy',acc)

五、自定义增强函数

import random

#这是一个可以自由发挥的地方

def aug_img(image):

seed = (random.randint(0,9),0)

#随机改变图像对比度

stateless_random_brightness =tf.image.stateless_random_contrast(image,lower=0.1,upper=0.1,seed=seed)

return stateless_random_brightness

同样的可以将该函数作用到训练集数据上以实现数据增强