SVM(原理公式推导)

参考博客1

参考博客2

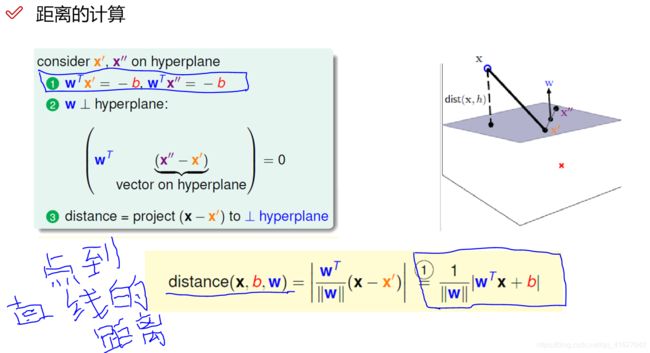

点到平面内一条直线的距离

如下图x’,x’'是一个平面内的两点,W是平面内的法向量,则点到直线的距离公式为:

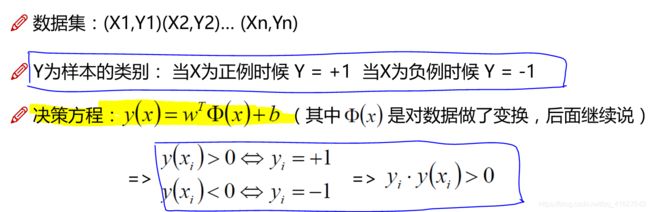

对于如下的一些训练样本:

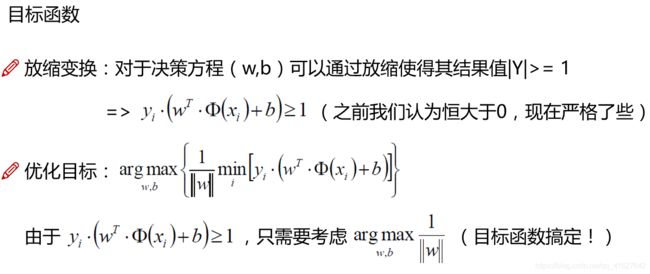

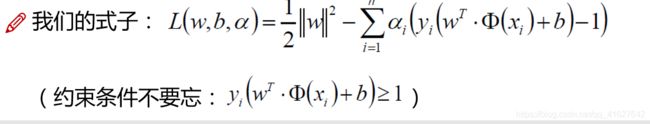

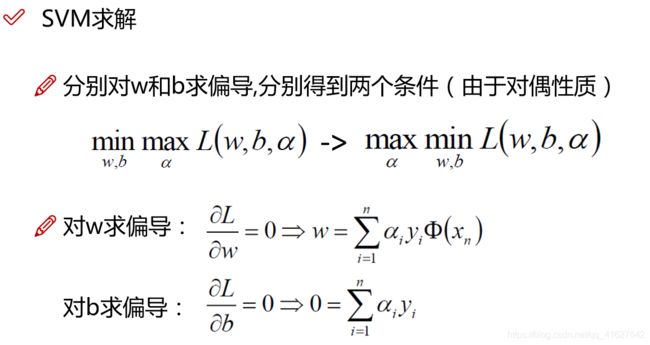

min求离直线最近的点,max使距离最远。1/w2的最大,转化为w2/2。

s

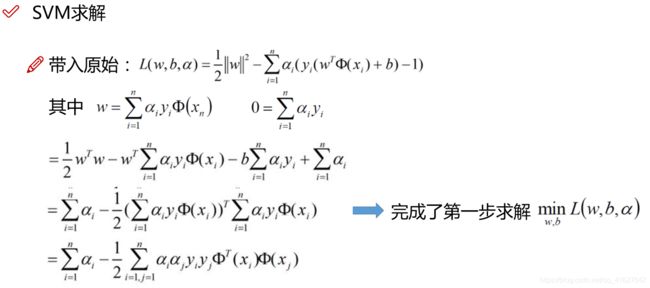

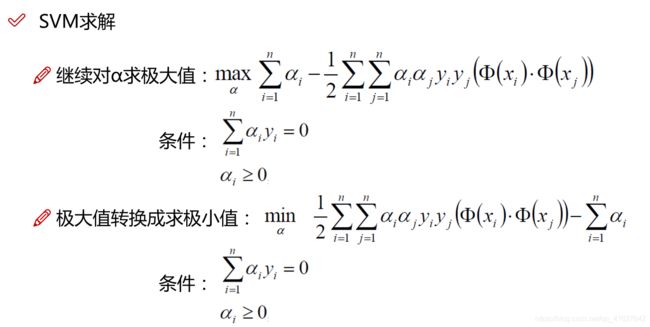

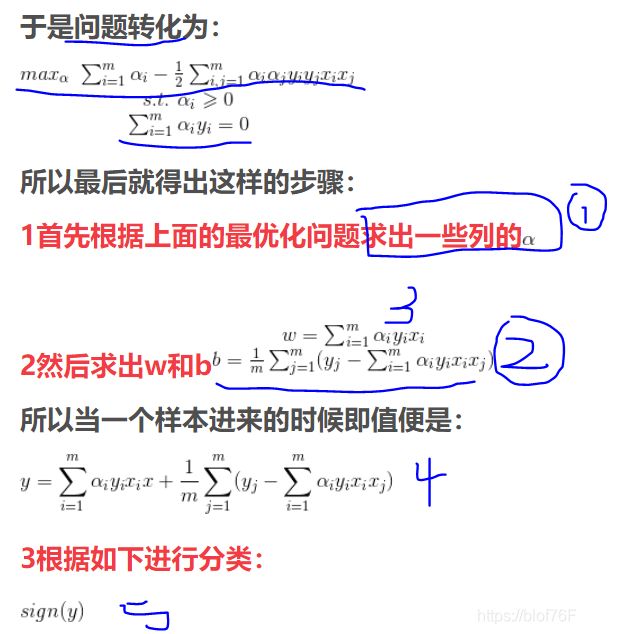

通过上面的公式推导,我们转化为以下三个步骤:

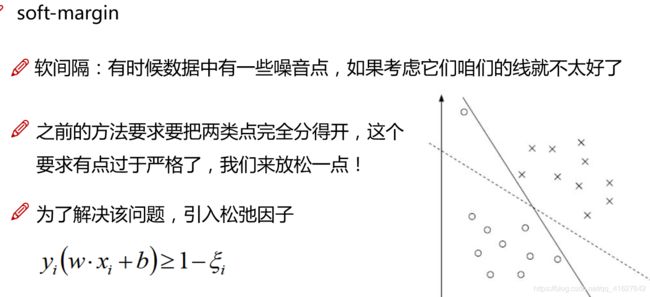

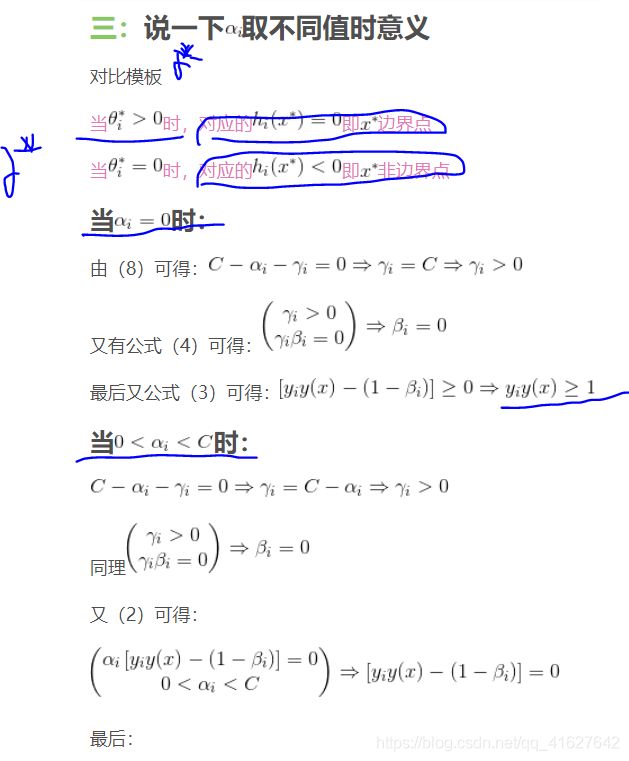

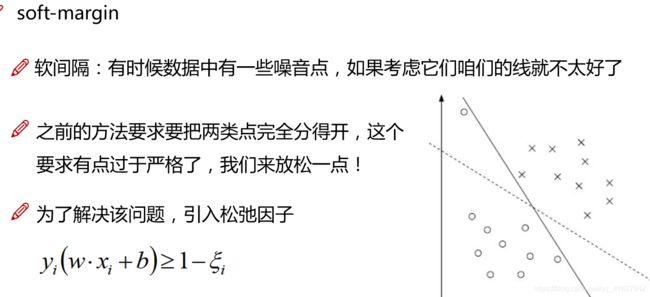

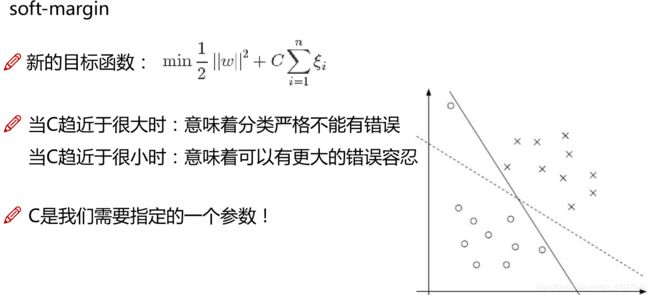

由于引入的松弛因子Bi,C是对松弛因子的严格程度。C越大,代表超平面越严格,意味着分类严格不能有错误;C很小,意味着可以有大的错误容忍。

通过求导和约束条件,我们知道ai系数再不通的取值范围内的分布。

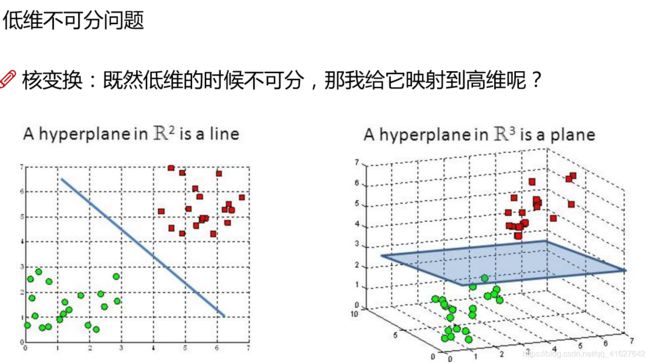

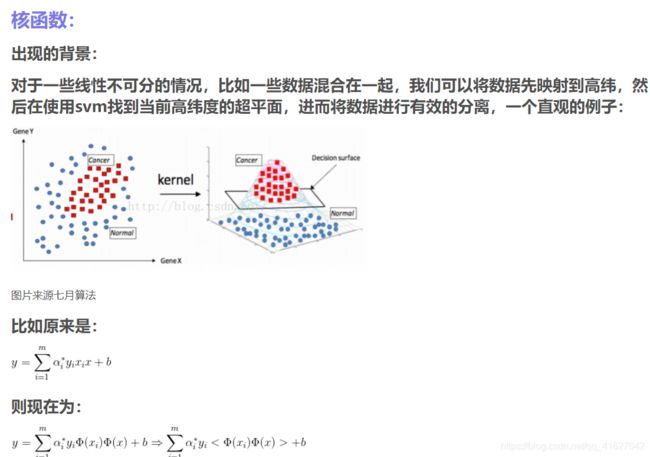

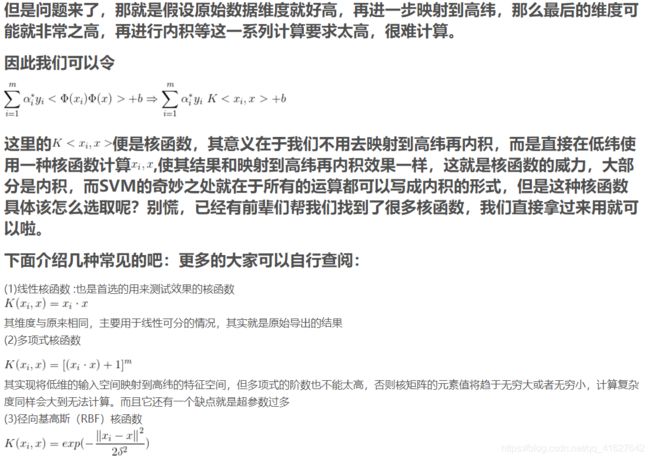

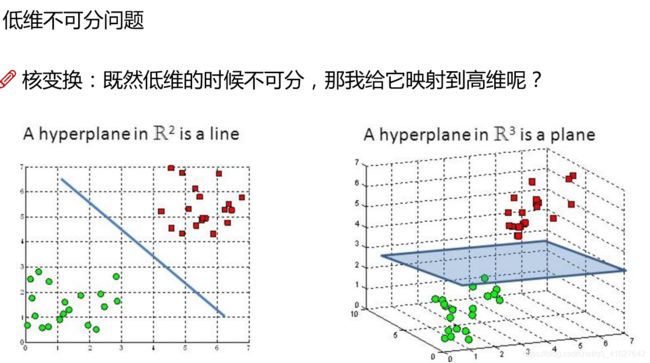

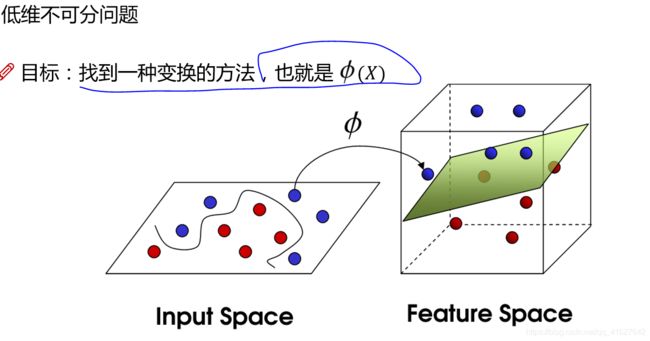

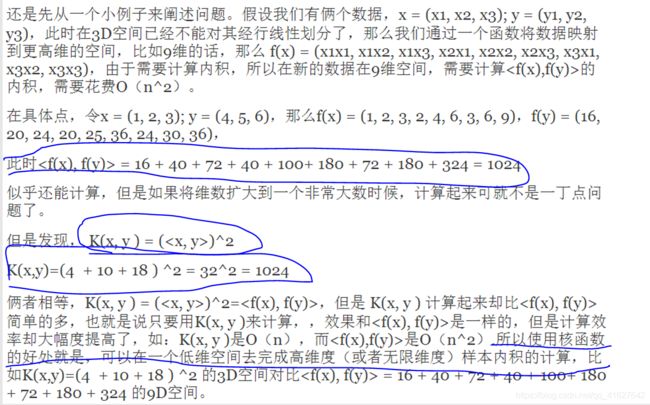

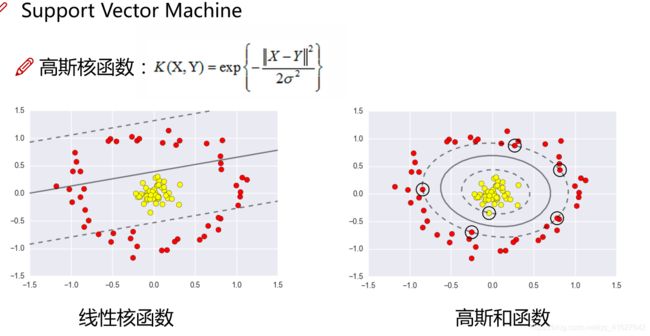

核函数介绍

有四种核函数,线性核函数、多项式核函数、高斯核函数,sigmoid核函数。

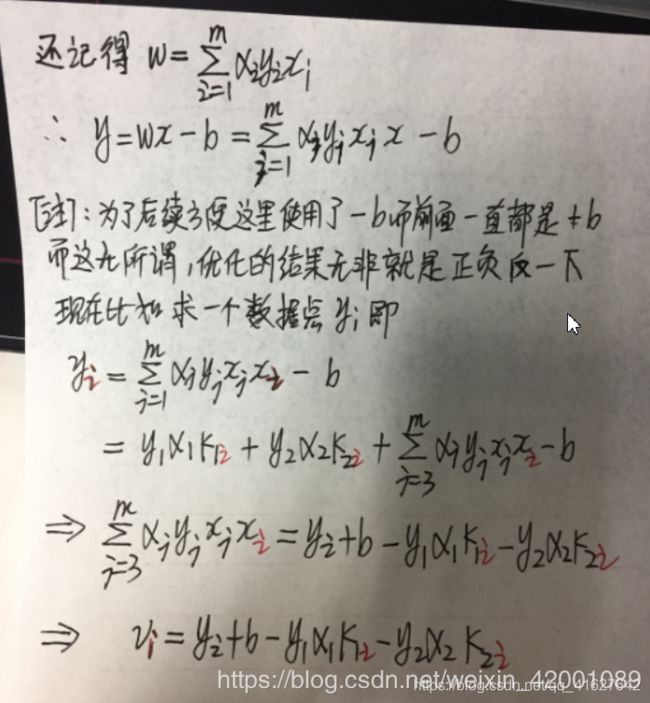

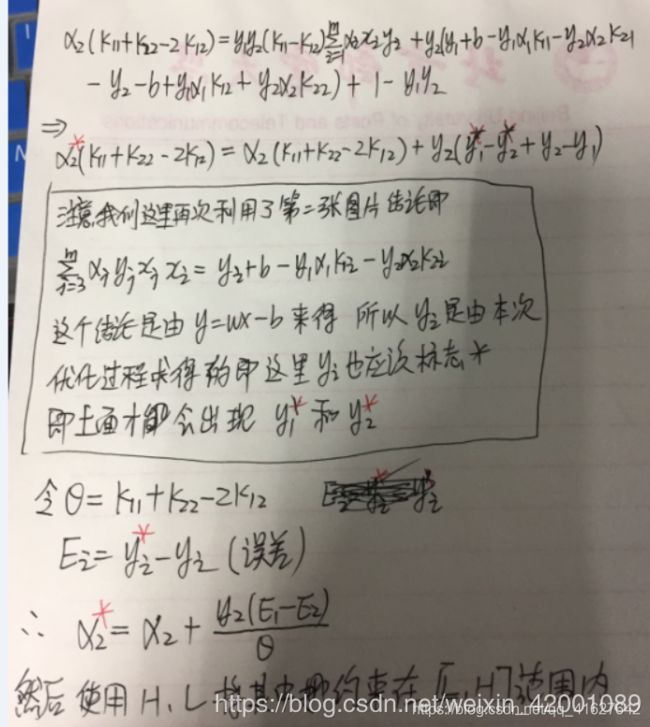

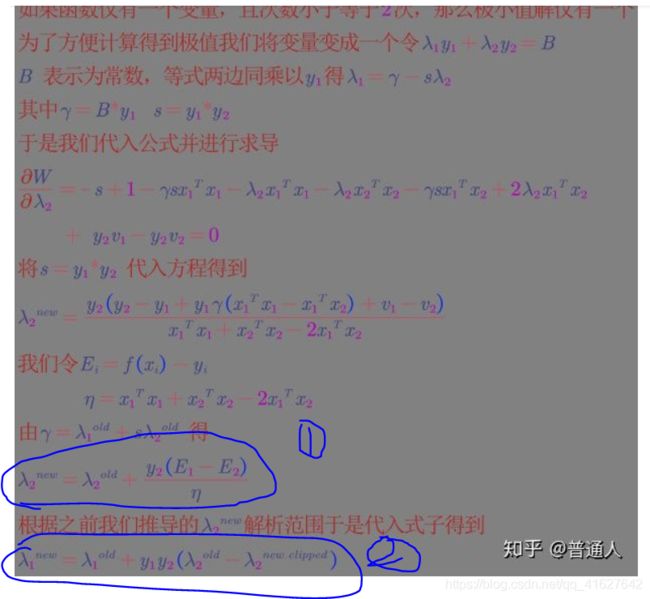

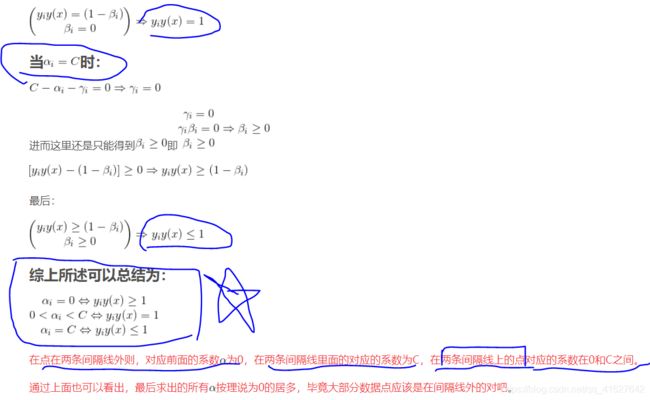

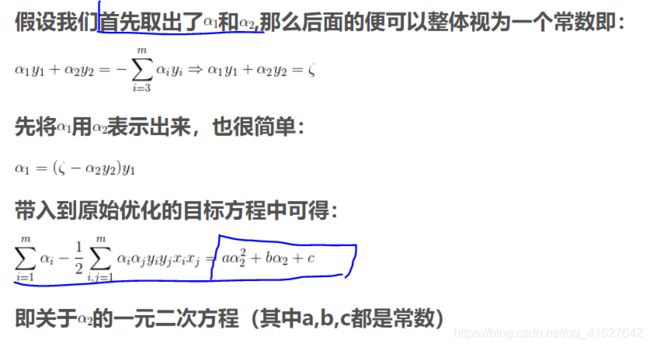

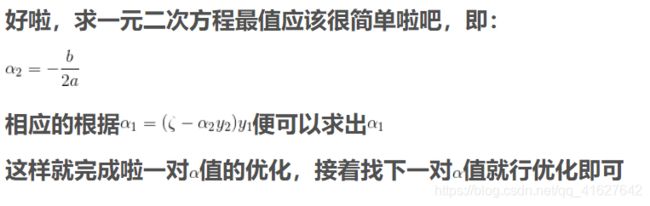

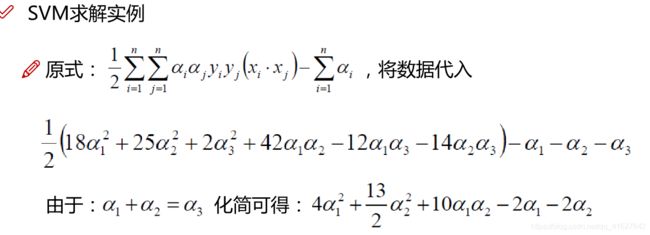

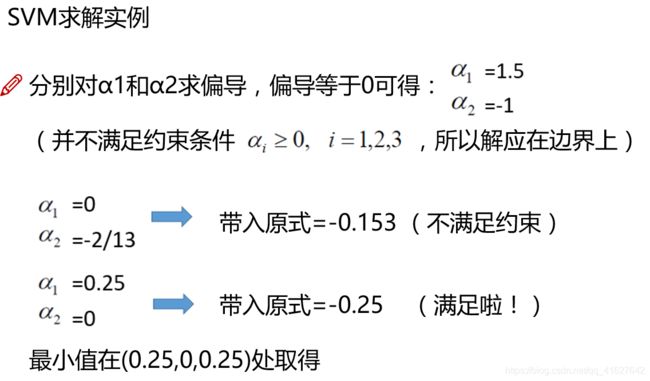

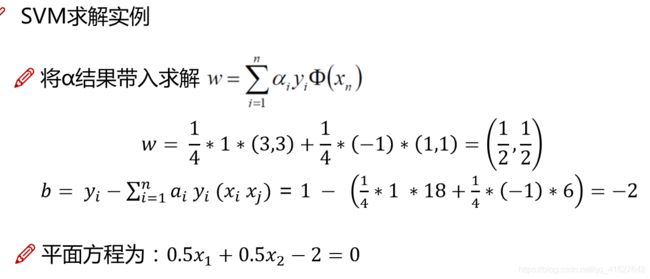

首先第一步,求解系数ai

为什么是二元一次方程呢?很简单由原始优化目标可以看出基本单元就是\alpha _{i}\alpha _{j},然后就是组合相加,所以最高次数就是2次,前面还有单次项,后面有常数项,所以最后归结起来就是一个一元二次方程

开始求解目标函数

xi和xj是点积。例如(3,3)T(3,3)=18

总结:对于a=0的是不起作用的对于决策边界的形成。

对于svm一边选择高斯核函数将低维映射到高维。

代码解析

计算a系数和b

#最简版本SMO算法

#dataMatIn为X,classLabels为y,C是核函数对应的系数C

def smoSimple(dataMatIn, classLabels, C, toler, maxIter):

dataMatrix = np.mat(dataMatIn); #将X转换为矩阵

labelMat = np.mat(classLabels).transpose()#将y转换为矩阵并转置为一列

b = 0;

m,n = np.shape(dataMatrix)#获取样本的行列

alphas = np.mat(np.zeros((m,1)))#定义a系数的初始值,m行一列

iter_num = 0#初始迭代次数

while (iter_num < maxIter):

alphaPairsChanged = 0#记录有多少被优化

#遍历完这一遍所有的\alpha后,alphaPairsChange用以记录看有多少对被优化啦

for i in range(m):

#注意一

#fxi由公式w=aiyixi的和组成,带入y=wx+b里形成了fxi,求每一个样本的预测值

fXi = float(np.multiply(alphas,labelMat).T*(dataMatrix*dataMatrix[i,:].T)) + b

Ei = fXi - float(labelMat[i])#误差ei=yi*-yi

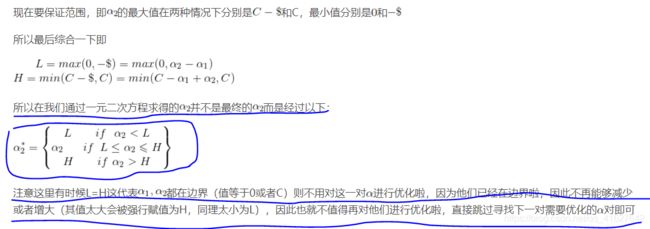

# 一旦alphas等于0或C,那么它们就巳经在“边界”上了,因而不再能够减小或增大,因此也就不值得再对它们进行优化了

#由公式推导,当ai=0,点再两条间隔线外侧,当ai=C,再间隔线内侧,0

#toler代表容忍错误值

if ((labelMat[i]*Ei < -toler) and (alphas[i] < C)) or ((labelMat[i]*Ei > toler) and (alphas[i] > 0)):

#开始优化,选择ai对。随机选择第二个alpha值j(不等于i)

j = selectJrand(i,m)

#就按第二个alpha值j对应的预测值

fXj = float(np.multiply(alphas,labelMat).T*(dataMatrix*dataMatrix[j,:].T)) + b#求yj*

Ej = fXj - float(labelMat[j])

alphaIold = alphas[i].copy();

alphaJold = alphas[j].copy();

# 下述判断保证alpha[j]在0,C之间

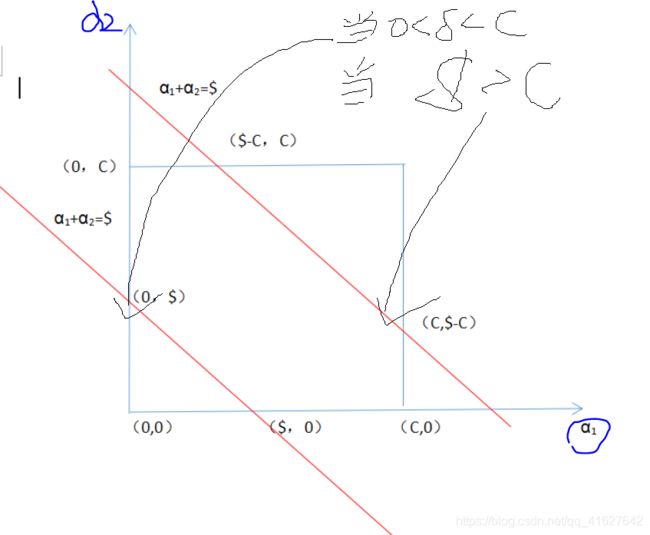

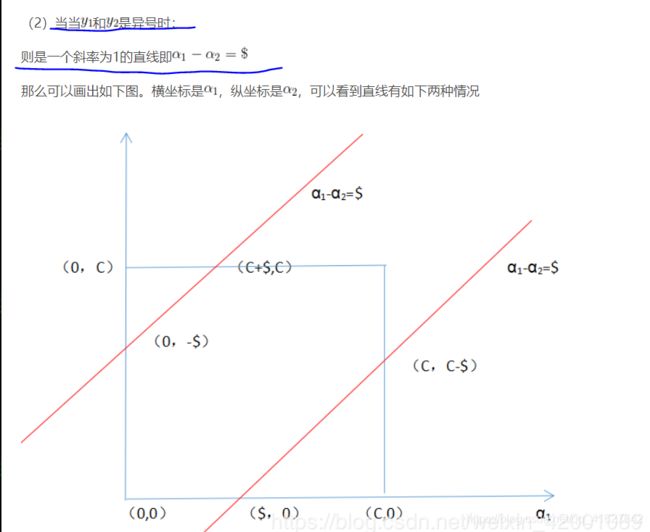

#yi和yj不同号时,yi和yj同号时,当L=H时,代表ai和aj都在边界上,不需要优化

if (labelMat[i] != labelMat[j]):

L = max(0, alphas[j] - alphas[i])

H = min(C, C + alphas[j] - alphas[i])

else:

L = max(0, alphas[j] + alphas[i] - C)

H = min(C, alphas[j] + alphas[i])

if L==H:

print("L==H");

continue

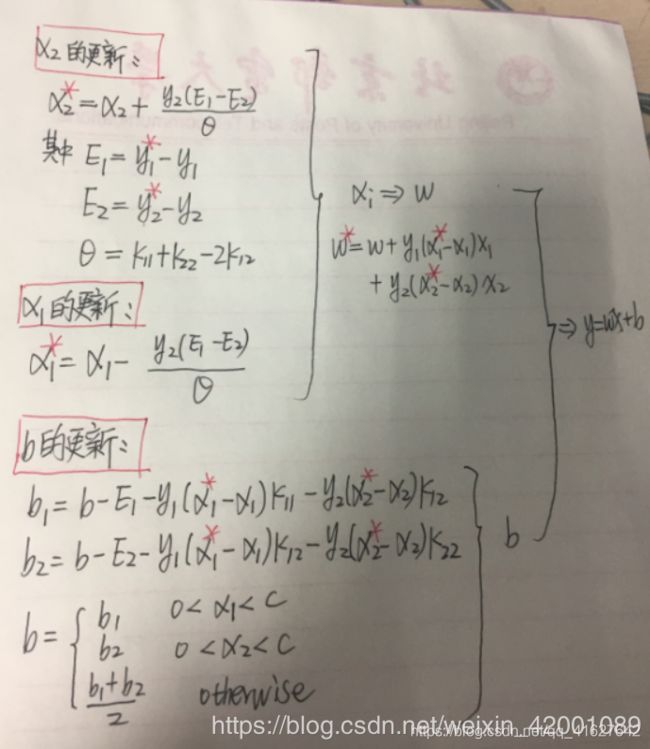

#注意二

#eta求的是K11+K22-2K12,现在是负得eta,所以保留小于0得值

eta = 2.0 * dataMatrix[i,:]*dataMatrix[j,:].T - dataMatrix[i,:]*dataMatrix[i,:].T - dataMatrix[j,:]*dataMatrix[j,:].T

if eta >= 0:

print("eta>=0");

continue

#计算获取新的alpha[j]

alphas[j] -= labelMat[j]*(Ei - Ej)/eta #求解出来

# 调整alpha aj的值,使值在(H,L)区间

alphas[j] = clipAlpha(alphas[j],H,L)

#推导部分的\alpha _{2}更新,只不过这里有一步如果变化太小我们就不更新了,直接跳过

if (abs(alphas[j] - alphaJold) < 0.00001): print("alpha_j变化小,不需要更新"); continue

#注意三,\alpha _{1}的更新即大小

#ai+=ai+yiyj(ajold-ajnew)

alphas[i] += labelMat[j]*labelMat[i]*(alphaJold - alphas[j])

#注意四,推导的b的更新

b1 = b - Ei- labelMat[i]*(alphas[i]-alphaIold)*dataMatrix[i,:]*dataMatrix[i,:].T - labelMat[j]*(alphas[j]-alphaJold)*dataMatrix[i,:]*dataMatrix[j,:].T

b2 = b - Ej- labelMat[i]*(alphas[i]-alphaIold)*dataMatrix[i,:]*dataMatrix[j,:].T - labelMat[j]*(alphas[j]-alphaJold)*dataMatrix[j,:]*dataMatrix[j,:].T

if (0 < alphas[i]) and (C > alphas[i]): b = b1

elif (0 < alphas[j]) and (C > alphas[j]): b = b2

else: b = (b1 + b2)/2.0

alphaPairsChanged += 1

print("第%d次迭代 样本:%d, alpha优化次数:%d" % (iter_num,i,alphaPairsChanged))

#alphaPairsChange为0时,说明我们这一遍走下来,说明\alpha都很好啦,没有优化的必要啦,我们将iter_num加一

if (alphaPairsChanged == 0):

iter_num += 1

else: iter_num = 0

print("迭代次数: %d" % iter_num)

#注意五

return b,alphas

'''

smo函数的alphaPairsChanged和iter_num以及maxIter的参数意义,maxIter是最外部的大循环,是人为设定的最大循环次数,循环为最大次数后就强行结束返回,在每一个大循环下都有一个for循环,用以遍历一遍所有的,遍历完这一遍所有的后,alphaPairsChange用以记录看有多少对被优化啦,如果alphaPairsChange不为0,

即这一遍走下来后,我们进行了优化,也就代表目前还不够好,所以我们将iter_num设为0,继续优化,当alphaPairsChange为0时,说明我们这一遍走下来,说明都很好啦,没有优化的必要啦,我们将iter_num加一,

接着下一遍再去整体看看,如果还是alphaPairsChange为0,恩恩,不错,不错,将iter_num再加一,如果iter_num到了maxIter即连续进行了maxIter遍整体(for)观察都没发现需要优化的,说明足够好了,返回吧!

'''

辅助函数

# -*- coding: utf-8 -*-

import random

import numpy as np

import matplotlib.pyplot as plt

#辅助函数一,第一个函数的作用就是用来选择\alpha对

def selectJrand(i, m):

j = i

while (j == i):

j = int(random.uniform(0, m))

return j

#辅助函函数二,函数就是为了将\alpha规划到[0,C]范围内

def clipAlpha(aj,H,L):

if aj > H:

aj = H

if L > aj:

aj = L

return aj

计算出来权重 w

def calcWs(dataMat, labelMat, alphas):

alphas, dataMat, labelMat = np.array(alphas), np.array(dataMat), np.array(labelMat)#把输入转化为数组形式

w = np.dot((np.tile(labelMat.reshape(1, -1).T, (1, 2)) * dataMat).T, alphas)#根据训练出来的\alpha生成w,1.np.tile((1,2))沿X轴复制

return w.tolist()

展示图像

def showClassifer(dataMat,labelMat,alphas, w, b):

data_plus = [] #正样本数据

data_minus = [] #负样本数据

#注意六

#我们把原始点画出来,不同的颜色代表不同的分离(橙色的点对应的标签是-1,蓝色的点对应的标签是1)

for i in range(len(dataMat)):

if labelMat[i] > 0:

data_plus.append(dataMat[i])

else:

data_minus.append(dataMat[i])

data_plus_np = np.array(data_plus) #列表转换为数组形式

data_minus_np = np.array(data_minus)

#画散点图

plt.scatter(np.transpose(data_plus_np)[0], np.transpose(data_plus_np)[1], s=30, alpha=0.7)

plt.scatter(np.transpose(data_minus_np)[0], np.transpose(data_minus_np)[1], s=30, alpha=0.7)

#注意七

#画出训练出来的超平面

x1 = max(dataMat)[0]

x2 = min(dataMat)[0]

a1, a2 = w

b = float(b)

a1 = float(a1[0])

a2 = float(a2[0])

#y1, y2 = (-b- a1*x1)/a2, (-b - a1*x2)/a2

y1, y2 = (-b- a1*x1)/a2, (-b - a1*x2)/a2

plt.plot([x1, x2], [y1, y2])

#注意八,画出来最近的样本点

#即在点在两条间隔线外则,对应前面的系数\alpha为0,在两条间隔线里面的对应的系数为C,在两条间隔线上的点对应的系数在0和C之间。

for i, alpha in enumerate(alphas):

if 0.6>abs(alpha) > 0:

x, y = dataMat[i]

plt.scatter([x], [y], s=150, c='none', alpha=0.7, linewidth=1.5, edgecolor='red')

if 0.6==abs(alpha) :

x, y = dataMat[i]

plt.scatter([x], [y], s=150, c='none', alpha=0.7, linewidth=1.5, edgecolor='yellow')

plt.show()

if __name__=="__main__":

x=[[1,8],[3,20],[1,15],[3,35],[5,35],[4,40],[7,80],[6,49],[1.5,25],[3.5,45],[4.5,50],[6.5,15],[5.5,20],[5.8,74],[2.5,5]]

y=[1,1,-1,-1,1,-1,-1,1,-1,-1,-1,1,1,-1,1]

b,alphas = smoSimple(x,y,0.6,0.001,40)

w = calcWs(x,y,alphas)

showClassifer(x,y,alphas, w, b)

改进得SMO算法

#Platt SMO:,改进其是SMO算法的一个改进版,速度更快

import numpy as np

import matplotlib.pyplot as plt

#首先optStruct函数定义了一个类作为数据结构来存储一些信息,这里面的alphas就是我们的\alpha,

#eCache第一列就是一个是否有效的标志位,第二列存储着误差值E

class optStructK:

def __init__(self,dataMatIn, classLabels, C, toler, kTup): # Initialize the structure with the parameters

self.X = dataMatIn

self.labelMat = classLabels

self.C = C

self.tol = toler

self.m = np.shape(dataMatIn)[0]

self.alphas = np.mat(np.zeros((self.m,1)))

self.b = 0

self.eCache = np.mat(np.zeros((self.m,2))) #第一列是有效的标志位

#""" knrnel

self.K = np.mat(np.zeros((self.m,self.m)))#函数增加了一个字段即K,其是一个m*m的矩阵

for i in range(self.m):

self.K[:,i] = kernelTrans(self.X, self.X[i,:], kTup)#计算核函数

#1.加载数据

def loadDataSet(filename):

dataMat = []#添加数据

labelMat = []#添加数据标签

f = open(filename,encoding='UTF-8')

#按行读取数据

for line in f.readlines():

lineArr = line.strip().split('\t')

dataMat.append([ float(lineArr[0]), float(lineArr[1])])#添加常数1

labelMat.append(float(lineArr[2]))

return dataMat, labelMat

#2.计算核函数,简单来说就是原先有x_{i}x的地方都要换成核函数的内积形式即x_{i}x\Rightarrow