李沐动手学深度学习V2-ResNet残差网络模型和代码实现

1.ResNet

1.1 神经网络嵌套函数和非嵌套函数(前提知识):

首先,假设有一类特定的神经网络架构 F \mathcal{F} F,它包括学习速率和其他超参数设置。对于所有 f ∈ F f \in \mathcal{F} f∈F,存在一些参数集(例如权重和偏置),这些参数可以通过在合适的数据集上进行训练而获得。现在假设 f ∗ f^* f∗是我们真正想要找到的函数,如果是 f ∗ ∈ F f^* \in \mathcal{F} f∗∈F,那我们可以轻而易举的训练得到它,但通常不能找到我们真正想要的函数 f ∗ f^* f∗,相反,我们将尝试找到一个函数 f F ∗ f^*_\mathcal{F} fF∗,这是我们在 F \mathcal{F} F中的最佳选择。例如,给定一个具有 X \mathbf{X} X特性和 y \mathbf{y} y标签的数据集,我们可以尝试通过解决以下优化问题来找到它:

f F ∗ : = a r g m i n f L ( X , y , f ) subject to f ∈ F . f^*_\mathcal{F} := \mathop{\mathrm{argmin}}_f L(\mathbf{X}, \mathbf{y}, f) \text{ subject to } f \in \mathcal{F}. fF∗:=argminfL(X,y,f) subject to f∈F.

那么,怎样得到更近似真正 f ∗ f^* f∗的函数呢?

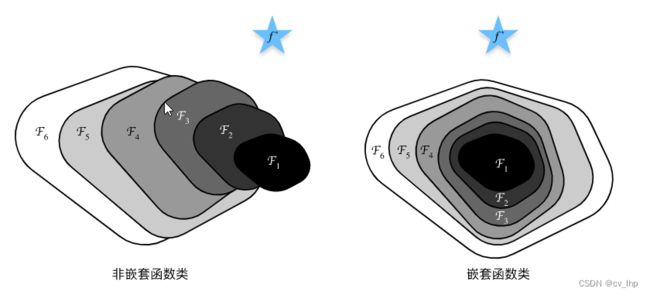

唯一合理的可能性是,我们需要设计一个更强大的架构 F ′ \mathcal{F}' F′。换句话说,我们预计 f F ′ ∗ f^*_{\mathcal{F}'} fF′∗比 f F ∗ f^*_{\mathcal{F}} fF∗“更近似”。然而,如果 F ⊈ F ′ \mathcal{F} \not\subseteq \mathcal{F}' F⊆F′,则无法保证新的体系“更近似”。事实上, f F ′ ∗ f^*_{\mathcal{F}'} fF′∗可能更糟:如下面左图所示,对于非嵌套函数(non-nested function)类,较复杂的函数类并不总是向“真”函数 f ∗ f^* f∗靠拢(复杂度由 F 1 \mathcal{F}_1 F1向 F 6 \mathcal{F}_6 F6递增)。在左边图中,虽然 F 3 \mathcal{F}_3 F3比 F 1 \mathcal{F}_1 F1更接近 f ∗ f^* f∗,但 F 6 \mathcal{F}_6 F6却离的更远了。相反对于下面右边图的嵌套函数(nested function)类 F 1 ⊆ … ⊆ F 6 \mathcal{F}_1 \subseteq \ldots \subseteq \mathcal{F}_6 F1⊆…⊆F6,我们可以避免上述问题。

因此,只有当较复杂的函数类包含较小的函数类时,我们才能确保提高它们的性能。 对于深度神经网络,如果我们能将新添加的层训练成恒等映射(identity function) ()= ,新模型和原模型将同样有效。 同时,由于新模型可能得出更优的解来拟合训练数据集,因此添加层似乎更容易降低训练误差。

针对这一问题,何恺明等人提出了残差网络(ResNet),它在2015年的ImageNet图像识别挑战赛夺魁,并深刻影响了后来的深度神经网络的设计。 残差网络的核心思想是:每个附加层都应该更容易地包含原始函数作为其元素之一。 于是,残差块(residual blocks)便诞生了,这个设计对如何建立深层神经网络产生了深远的影响。 凭借它,ResNet赢得了2015年ImageNet大规模视觉识别挑战赛。

1.2 残差块

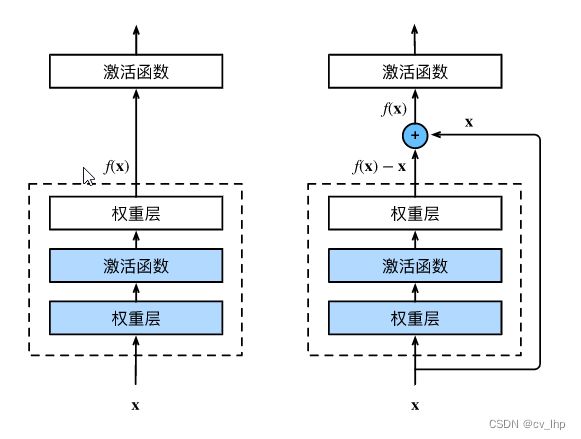

聚焦于神经网络局部:如下图所示,假设我们的原始输入为 ,而希望学出的理想映射为 () (作为下图上方激活函数的输入)。左图虚线框中的部分需要直接拟合出该映射 () ,而右图虚线框中的部分则需要拟合出残差映射 ()− ,残差映射在现实中往往更容易优化。 以上面提到的恒等映射(f(x)=x)作为我们希望学出的理想映射 () ,我们只需将下面右图虚线框内上方的加权运算的权重和偏置参数设成0,那么 () 即为恒等映射(输出等于输入)。 实际中,当理想映射 () 极接近于恒等映射时,残差映射也易于捕捉恒等映射的细微波动。 下面右图是ResNet的基础架构–残差块(residual block)。在残差块中,输入可通过跨层数据线路更快地向前传播。

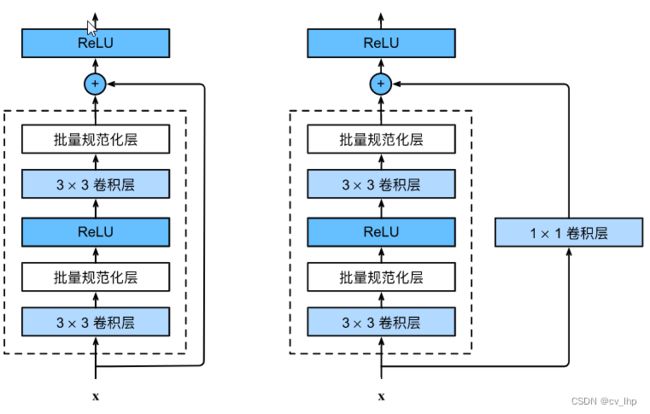

1.3 残差块的设计

ResNet沿用了VGG完整的 3×3 卷积层设计。 残差块里首先有2个有相同输出通道数的 3×3 卷积层。 每个卷积层后接一个批量规范化层和ReLU激活函数。 然后我们通过跨层数据通路,跳过这2个卷积运算,将输入直接加在最后的ReLU激活函数前。 这样的设计要求经过2个卷积层和只直接经过旁路层(跨层数据线路)的输出形状一样,从而使它们可以相加,即实现了输出y=f(x)+x (因此输出y=f(x)+x包含了输入x,也即是y包含了x,函数y比x更复杂,符合了上面提到的嵌套函数的概念,当f(x)=0,即权重和偏差为0时y=x)。 如果想改变通道数,就需要引入一个额外的 1×1 卷积层来将输入变换成需要的形状后再做相加运算。

1.4 残差块的实现如下:

import d2l.torch

import torch

from torch.nn import functional as F

from torch import nn

#一个残差网络层,包含两个卷积层和一个旁路支路

class Residul(nn.Module):

def __init__(self,input_channels,output_channels,use_1x1conv2d=False,stride=1):

super(Residul, self).__init__()

#一个残差块包含两个卷积层,第一个卷积层通常改变输入输出通道数,并且改变输出的尺寸的形状大小,第二个卷积层输入输出通道数通常不会改变,每一个卷积层会跟着一个批量规范层

self.conv2d_1 = nn.Conv2d(in_channels=input_channels,out_channels=output_channels,kernel_size=3,padding=1,stride=stride)

self.conv2d_2 = nn.Conv2d(in_channels=output_channels,out_channels=output_channels,kernel_size=3,padding=1,stride=1)

self.bn1 = nn.BatchNorm2d(num_features=output_channels)

self.bn2 = nn.BatchNorm2d(num_features=output_channels)

#当输入输出通道数(同时输出的形状大小也会改变)改变后需要加一个1x1卷积层,来改变输入X的形状大小和通道数

if use_1x1conv2d:

self.conv2d_3 = nn.Conv2d(in_channels=input_channels,out_channels=output_channels,kernel_size=1,stride=stride)

else:

self.conv2d_3 = None

def forward(self,X):

Y = F.relu(self.bn1(self.conv2d_1(X)))

Y = self.bn2(self.conv2d_2(Y))

if self.conv2d_3:

X = self.conv2d_3(X)

Y +=X

#将输入经过两层卷积层得到的输出Y再与输入X相加后,再经过ReLU()激活函数,必须保证X和Y的通道数和尺寸形状大小相同

return F.relu(Y)

#查看输入和输出形状一致,不改变输入的通道数和尺寸大小

residul = Residual(3,3)

X = torch.rand(4, 3, 6, 6)

Y = residul (X)

print(Y.shape)

#查看增加输出通道数的同时,并减半输入的高和宽

residul =Residul(3,6,use_1x1conv2d=True,stride=2)

X = torch.randn(size=(4,3,6,6))

Y = residul(X)

print(Y.shape)

'''

输出结果:

torch.Size([4, 3, 6, 6])

torch.Size([4, 6, 3, 3])

'''

此代码生成两种类型的网络如下所示: 一种是当use_1x1conv2d=False时,应用ReLU非线性函数之前,将输入直接经过跨层数据线路添加到输出。 另一种是当use_1x1conv2d=True时,通过添加 1×1 卷积调整输入通道和分辨率与经过两层卷积层的输出形状大小一样,从而才能进行输入和输出相加。

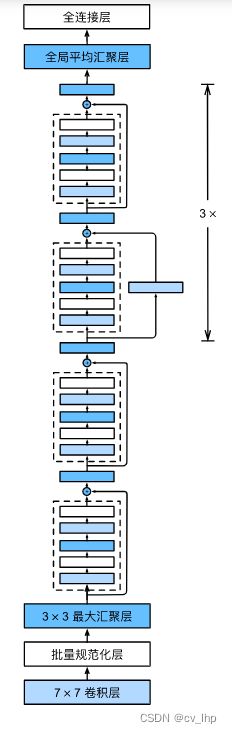

1.4 ResNet模型

- ResNet的前两层跟之前介绍的GoogLeNet中的一样: 在输出通道数为64、步幅为2的 7×7 卷积层后,接步幅为2的 3×3 的最大汇聚层。 不同之处在于ResNet每个卷积层后增加了批量规范化层。

#ResNet第一个模块跟GoogleNet第一个模块相同

b1 = nn.Sequential(nn.Conv2d(in_channels=1,out_channels=64,kernel_size=7,padding=3,stride=2),

nn.BatchNorm2d(64),

nn.ReLU(),

nn.MaxPool2d(kernel_size=3,padding=1,stride=2))

- GoogLeNet在后面接了4个由Inception块组成的模块。 ResNet则使用4个由残差块组成的模块,每个模块使用若干个同样输出通道数的残差块。 第一个模块的输出通道数同输入通道数一致。 由于之前已经使用了步幅为2的最大汇聚层,所以无须减小高和宽。 之后的每个模块在第一个残差块里将上一个模块的输出通道数翻倍,并将高和宽减半,下面代码来实现这个模块。注意,我们对第一个残差网络模块做了特别处理。

#定义一个ResNet块,通常包含两个残差块Residul块(也即是包含两个残差网络层),一个ResNet块通常通道数加倍,尺寸形状高和宽减半,对应到由第一个残差块输出通道是输入通道两倍,尺寸大小减半,第二个残差块输入输出通道数相同,输入输出尺寸形状大小不变,但除开第二个ResNet块,因为第一个ResNet块将输入尺寸形状大小降低了4倍

def resnet_block(input_channels,output_channels,num_residuls,first_block=False):

block = []

for i in range(num_residuls):

if i==0 and not first_block:

block.append(Residul(input_channels=input_channels,output_channels=output_channels,use_1x1conv2d=True,stride=2))

else:

block.append(Residul(input_channels=output_channels,output_channels=output_channels))

return block

- 接着在ResNet加入所有残差块,每个模块使用2个残差块。

b2 = nn.Sequential(*resnet_block(64,64,2,True))#第二个ResNet块,输入输出通道数不变,输入输出尺寸形状大小不变

b3 = nn.Sequential(*resnet_block(64,128,2,False))#第三个ResNet块,输出通道数是输入通道数2倍,则输出尺寸形状是输入尺寸形状高和宽的1/2

b4 = nn.Sequential(*resnet_block(128,256,2,False))#第二个ResNet块,输出通道数是输入通道数2倍,则输出尺寸形状是输入尺寸形状高和宽的1/2

b5 = nn.Sequential(*resnet_block(256,512,2,False))#第二个ResNet块,输出通道数是输入通道数2倍,则输出尺寸形状是输入尺寸形状高和宽的1/2

- 最后,与GoogLeNet一样,在ResNet中加入全局平均汇聚层,以及全连接层输出。

resnet = nn.Sequential(b1,b2,b3,b4,b5,

nn.AdaptiveAvgPool2d((1,1)),

nn.Flatten(),

nn.Linear(in_features=512,out_features=10))

- 每个模块有4个卷积层(不包括恒等映射的 1×1 卷积层)。 加上第一个 7×7 卷积层和最后一个全连接层,共有18层。 因此,这种模型通常被称为ResNet-18。 通过配置不同的通道数和模块里的残差块数可以得到不同的ResNet模型,例如更深的含152层的ResNet-152。 虽然ResNet的主体架构跟GoogLeNet类似,但ResNet架构更简单,修改也更方便。这些因素都导致了ResNet迅速被广泛使用,下图描述了完整的ResNet-18。

- 在训练ResNet之前看一下ResNet中不同模块的输出形状是如何变化的。 基本在所有架构中都是将分辨率降低,通道数量增加,直到全局平均汇聚层聚集所有特征。

#查看每一层输出的通道数和形状尺寸大小

X = torch.randn(size=(1,1,224,224))

for layer in resnet:

X = layer(X)

print(layer.__class__.__name__," output shape :\t",X.shape)

'''

输出结果如下:

Sequential output shape: torch.Size([1, 64, 56, 56])

Sequential output shape: torch.Size([1, 64, 56, 56])

Sequential output shape: torch.Size([1, 128, 28, 28])

Sequential output shape: torch.Size([1, 256, 14, 14])

Sequential output shape: torch.Size([1, 512, 7, 7])

AdaptiveAvgPool2d output shape: torch.Size([1, 512, 1, 1])

Flatten output shape: torch.Size([1, 512])

Linear output shape: torch.Size([1, 10])

'''

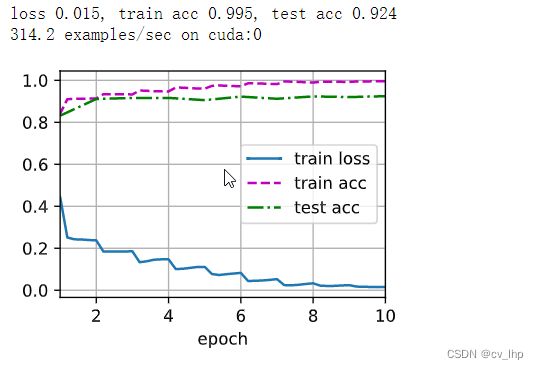

- ResNet模型训练和测试(学习率lr = 0.05,训练轮数为10轮,batch_size为64)

lr,num_epochs,batch_size = 0.05,10,64

train_iter,test_iter = d2l.torch.load_data_fashion_mnist(batch_size,resize=224)

d2l.torch.train_ch6(resnet,train_iter,test_iter,num_epochs,lr,device=d2l.torch.try_gpu())

1.5 小结:

- 残差映射可以更容易地学习同一函数,例如将权重层中的参数近似为零。

利用残差块(residual blocks)可以训练出一个有效的深层神经网络:输入可以通过跨层数据通路更快地向前传播。 - 残差网络(ResNet)对随后的深层神经网络设计产生了深远影响。

- 通常卷积层如果通道数加倍,输出尺寸形状高和宽都需要减半

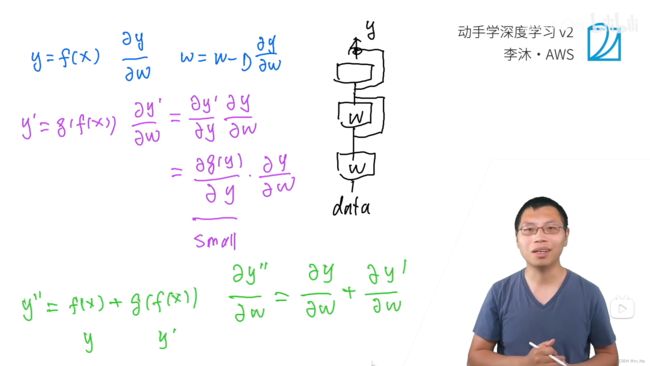

- ResNet模型中Residul残差块正是因为添加将输入加入到输出的跨层数据通路时,当神经网络达到很深时,网络底层(靠近输入层)的权重参数才不会出现梯度消失的情况,权重参数更新也不会更新的很缓慢,达不到收敛的状态。通常靠近输入层的网络层的权重梯度很小,会出现梯度消失的情况,当靠近输出层的网络层的权重梯度通常会比较大,会出现梯度爆炸的情况,Residul残差块解决了靠近输入层的网络底层权重更新缓慢,梯度消失,收敛很慢很慢的情况

- 加入Residul后靠近输入层的权重参数梯度不会随着层数加深而变小,仍然也会变得很大,从而靠近输入层的参数更容易更新,如下图所示:

2.ResNet模型全部代码:

import d2l.torch

import torch

from torch.nn import functional as F

from torch import nn

#一个残差网络层,包含两个卷积层和一个旁路支路

class Residul(nn.Module):

def __init__(self,input_channels,output_channels,use_1x1conv2d=False,stride=1):

super(Residul, self).__init__()

#一个残差块包含两个卷积层,第一个卷积层通常改变输入输出通道数,并且改变输出的尺寸的形状大小,第二个卷积层输入输出通道数通常不会改变,每一个卷积层会跟着一个批量规范层

self.conv2d_1 = nn.Conv2d(in_channels=input_channels,out_channels=output_channels,kernel_size=3,padding=1,stride=stride)

self.conv2d_2 = nn.Conv2d(in_channels=output_channels,out_channels=output_channels,kernel_size=3,padding=1,stride=1)

self.bn1 = nn.BatchNorm2d(num_features=output_channels)

self.bn2 = nn.BatchNorm2d(num_features=output_channels)

#当输入输出通道数(同时输出的形状大小也会改变)改变后需要加一个1x1卷积层,来改变输入X的形状大小和通道数

if use_1x1conv2d:

self.conv2d_3 = nn.Conv2d(in_channels=input_channels,out_channels=output_channels,kernel_size=1,stride=stride)

else:

self.conv2d_3 = None

def forward(self,X):

Y = F.relu(self.bn1(self.conv2d_1(X)))

Y = self.bn2(self.conv2d_2(Y))

if self.conv2d_3:

X = self.conv2d_3(X)

Y +=X

#将输入经过两层卷积层得到的输出Y再与输入X相加后,再经过ReLU()激活函数,必须保证X和Y的通道数和尺寸形状大小相同

return F.relu(Y)

residul =Residul(3,6,use_1x1conv2d=True,stride=2)

X = torch.randn(size=(4,3,6,6))

Y = residul(X)

print(Y.shape)

#ResNet第一个模块跟GoogleNet第一个模块相同

b1 = nn.Sequential(nn.Conv2d(in_channels=1,out_channels=64,kernel_size=7,padding=3,stride=2),

nn.BatchNorm2d(64),

nn.ReLU(),

nn.MaxPool2d(kernel_size=3,padding=1,stride=2))

#定义一个ResNet块,通常包含两个残差块Residul块(也即是包含两个残差网络层),一个ResNet块通常通道数加倍,尺寸形状高和宽减半,对应到由第一个残差块输出通道是输入通道两倍,尺寸大小减半,第二个残差块输入输出通道数相同,输入输出尺寸形状大小不变,但除开第二个ResNet块,因为第一个ResNet块将输入尺寸形状大小降低了4倍

def resnet_block(input_channels,output_channels,num_residuls,first_block=False):

block = []

for i in range(num_residuls):

if i==0 and not first_block:

block.append(Residul(input_channels=input_channels,output_channels=output_channels,use_1x1conv2d=True,stride=2))

else:

block.append(Residul(input_channels=output_channels,output_channels=output_channels))

return block

b2 = nn.Sequential(*resnet_block(64,64,2,True))#第二个ResNet块,输入输出通道数不变,输入输出尺寸形状大小不变

b3 = nn.Sequential(*resnet_block(64,128,2,False))#第三个ResNet块,输出通道数是输入通道数2倍,则输出尺寸形状是输入尺寸形状高和宽的1/2

b4 = nn.Sequential(*resnet_block(128,256,2,False))#第二个ResNet块,输出通道数是输入通道数2倍,则输出尺寸形状是输入尺寸形状高和宽的1/2

b5 = nn.Sequential(*resnet_block(256,512,2,False))#第二个ResNet块,输出通道数是输入通道数2倍,则输出尺寸形状是输入尺寸形状高和宽的1/2

resnet = nn.Sequential(b1,b2,b3,b4,b5,

nn.AdaptiveAvgPool2d((1,1)),

nn.Flatten(),

nn.Linear(in_features=512,out_features=10))

X = torch.randn(size=(1,1,224,224))

for layer in resnet:

X = layer(X)

print(layer.__class__.__name__," output shape :\t",X.shape)

lr,num_epochs,batch_size = 0.05,10,64

train_iter,test_iter = d2l.torch.load_data_fashion_mnist(batch_size,resize=224)

d2l.torch.train_ch6(resnet,train_iter,test_iter,num_epochs,lr,device=d2l.torch.try_gpu())