【OpenCV-Python】20 特征检测算法(上)

什么是特征?

粗略的讲,特征就是有意义的图像区域,该区域具有独特性或易于识别性。如角点、边缘、斑点(与周围有很大差异的图像区域)等。

OpenCV中最常使用的特征检测和提取算法有:

- Haarris:检测角点

- SIFT:检测斑点(blob)

- SURF:检测斑点

- FAST:检测角点

- BRIEF:检测斑点

- ORB:代表带方向的FAST算法与具有旋转不变性的BRIEF算法

通过以下方法进行特征匹配:

- 暴力(Brute-Force)匹配法

- 基于FLANN的匹配法

检测角点特征

使用cornerHarris来识别角点,该函数可以检测图像的角点。

文件的 tree / 树状图:

.

├── corner.py

├── sift.py

├── sift_surf.py

└──images

├── varese.jpg

└── chess_board.png

代码

# -*- coding: utf-8 -*-

"""

Created on Sun Jan 3 15:13:14 2021

@author: gkm0120

"""

# corner.py

import cv2

import numpy as np

import sys

# 使用Python使sys模块将图像路径通过命令行参数传递给脚本,使脚本具有通用性

img = cv2.imread('./images/' + sys.argv[1])

# img = cv2.imread("D:/Python/Test_code/pycv/images/chess_board.png")

gray = cv2.cvtColor(img, cv2.COLOR_BGR2GRAY)

gray = np.float32(gray)

# cv2.cornerHarris():参数2为标记角点的记号大小;参数3为Sobel算子的中孔(aperture)

dst = cv2.cornerHarris(gray, 2, 23, 0.04)

img[dst>0.01 * dst.max()] = [0, 0, 255] # 将检测到的角点标记为红色

while (True):

cv2.imshow('corners', img)

if cv2.waitKey(1000 // 12) & 0xff == ord("q"):

break

cv2.destroyAllWindows()

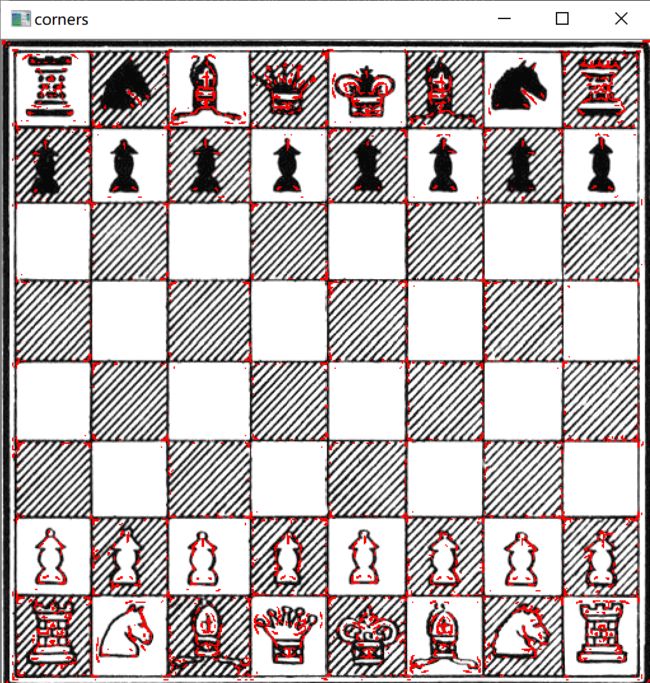

终端运行python corner.py chess_board.png

图例

chess_board.png chess_board.png

|

角点标记 角点标记

|

注:Sobel算子通过对图像行、列的变化来检测边缘,Sobel算子会通过核(kernel)来完成检测。cornerHarris函数会使用Sobel算子,并且第三个参数定义了Sobel算子的中孔。即该参数定义了角点检测的敏感度,其值必须是介于3~31之间的奇数。取3时,当检测到方块的边界时,棋盘中黑色方块的所有对角线都会被认为是角点。参数为23时,只有每个方块的角点才会被检测为角点。

使用DoG和SIFT进行特征提取和描述

特征损失现象需要一种与比例无关的角点检测方法来解决。尺度不变特征变换(Scale-Invariant Feature Transform,SIFT)并不检测关键点(关键点可通过Difference of Guassians检测),但SIFT会通过一个特征向量来秒速关键点周围区域的情况。

Difference of Guassians(DoG)是对同一图像使用不同的高斯滤波器所得到的结果。DoG操作的最终结果会得到感兴趣的区域(关键点),这将通过SIFT来进行说明。

代码

# -*- coding: utf-8 -*-

"""

Created on Sun Jan 3 16:11:00 2021

@author: gkm0120

"""

# sift.py

import cv2

import numpy as np

import sys

# 使用Python使sys模块将图像路径通过命令行参数传递给脚本,使脚本具有通用性

img = cv2.imread('./images/' + sys.argv[1])

# img = cv2.imread("D:/Python/Test_code/pycv/images/varese.jpg")

gray = cv2.cvtColor(img, cv2.COLOR_BGR2GRAY)

# 创建一个SIFT对象,并计算灰度图像

sift = cv2.xfeatures2d.SIFT_create()

# 检测和计算。操作的返回值为关键点信息(关键点)和描述符

keypoints, descriptor = sift.detectAndCompute(gray,None)

# 标志值4是cv2模块的属性值:cv2.DRAW_MATCHES_FLAGS_DRAW_RICH_KEYPOINT

img = cv2.drawKeypoints(image=img, outImage=img, keypoints = keypoints, flags = 4, color = (51, 163, 236))

# 绘制关键点,并用imshow函数显示这幅图像

cv2.imshow('sift_keypoints', img)

while (True):

if cv2.waitKey(1000 // 12) & 0xff == ord("q"):

break

cv2.destroyAllWindows()

终端运行python sift.py varese.jpg

图例

varese.jpg varese.jpg

|

SIFT SIFT

|

注:SIFT对象会使用DoG检测关键点,并且对每个关键点周围区域计算特征向量。

使用快速Hessian算法和SURF来提取和检测特征

SIFT算法是David Lowe 于1999年发表,加速稳健特征(Speeded Up Robust Features,SURF)算法是Herbert Bay 于2006年发表,该算法比SIFT快好几倍,它吸收了SIFT算法的思想。SURF是OpenCV的一个类,采用快速Hessian算法检测关键点,而SURF会提取特征(和SIFT类似)

注:SIFT和SURF都受专利保护,因此被归于OpenCV的xfeature2d模块中。

代码

# -*- coding: utf-8 -*-

"""

Created on Sun Jan 3 16:34:22 2021

@author: gkm0120

"""

# sift_surf.py

import cv2

import sys

import numpy as np

imgpath = sys.argv[1]

img = cv2.imread(imgpath)

alg = sys.argv[2]

def fd(algorithm):

algorithms = {

"SIFT": cv2.xfeatures2d.SIFT_create(),

"SURF": cv2.xfeatures2d.SURF_create(float(sys.argv[3]) if len(sys.argv) == 4 else 4000),

"ORB": cv2.ORB_create()

}

return algorithms[algorithm]

gray = cv2.cvtColor(img, cv2.COLOR_BGR2GRAY)

fd_alg = fd(alg)

keypoints, descriptor = fd_alg.detectAndCompute(gray,None)

img = cv2.drawKeypoints(image=img, outImage=img, keypoints = keypoints, flags = 4, color = (51, 163, 236))

cv2.imshow('keypoints', img)

while (True):

if cv2.waitKey(1000 // 12) & 0xff == ord("q"):

break

cv2.destroyAllWindows()

这幅图像由SURF算法处理,所采用的Hessian阈值为8000。阈值越高,能识别的特征越少,可以采用试探法来得到最优检测。

终端运行python sift_surf.py images/varese.jpg SURF 8000

图例

varese.jpg varese.jpg

|

SURF SURF

|