人工智能在脑电情感分类上干了啥?(一)

微信关注公众号:“脑电与图网络研究僧”

今天小编跟大家分享人工智能技术在脑电情感分类上的技术路线,还没有找到方向的脑电儿们不要迷路啦!

引言:

情感识别遵循模式识别研究的本质:根据现有数据和一些测量标准来判断目标样本的情感类别。使用图表总结了大多数相关工作中采用的现有模式识别方法,如下图所示,其中明确划分了不同的技术路线。随着深度学习(DL)在图像处理和自然语言处理领域的快速发展,基于深度学习的技术路线开始引起该领域研究人员的关注,现有的工作也确实被证明是有效的。以下部分对这些技术路线和代表性作品进行了总结。

模式识别技术路线在现场应用的流程图

1 Raw EEG Data → Signal Preprocessing → Feature Engineering → Threshold Seeting and Comparision → Emotion Recongnition

最简单的方法路线,即为特定特征设置阈值,如果特征值超过默认阈值,则样本确定属于特定的情绪状态。然而,阈值是固定的,取决于经验,导致缺乏适应性。因此,这条技术路线并不是主流。

2 Raw EEG Data → Signal Preprocessing →Feature Engineering →Machine Learning → Emotion Recongnition

目前,机器学习已经广泛研究在这个,包括传统的监督学习模型,例如,判别分析,支持向量机,K近邻,贝叶斯方法,随机森林,感知器等,以及无监督学习方法如流形学习,聚类等。传统的基于统计机器学习的方法遵循此路径,如下图详细说明。

基于 EEG 的情绪识别研究中的经典方法

以下是一些具有代表性的方法。Wang等人[1]从脑电图中提取了两种功率谱特征、两种小波特征和三种非线性特征。通过特征平滑方法降低特征噪声,并采用线性判别分析(LDA)进行特征降维。最终利用线性 SVM 分类器对这两种情绪进行分类。此外,基于流形学习方法预测情绪状态的变化轨迹。Jenke等人[2]从多通道脑电图中提取时频域特征以及通道组合特征。此外,利用基于 ReliefF 的特征选择方法、最小冗余最大相关性 (MRMR) 和具有二次判别分析 (QDA) 建模方法的统计测试方法来增强情感分类。此外,Atkinson 和 Campos[3]结合 MRMR 特征选择方法和核函数分类器来提升情感识别性能。Lan[4]和Ackermann[5]分别使用SVM和随机森林模型,构建基于统计特征、非线性特征、光谱特征等的识别模型,同时比较了该方法对用户同周期数据和不同周期数据的识别效果。Li等人[6]提出了图正则线性回归模型(GRSLR),其中引入了稀疏正则化来进行通道选择。此外,图正则化可以在数据嵌入后保留固有的流形拓扑,从而防止模型过度拟合。最近,Cheng等人[7]提出多粒度级联森林的深层森林模型,称为 gcForest,用于基于EEG的情感识别任务。gcForest 算法具有较少的超参数,并且对超参数设置具有鲁棒性。此外,它的模型复杂度适应不同大小的数据,值得我们关注。

参考文献

[1](2014)Emotional state classiication from EEG data using machine learning approach.

[2](2014)Feature extraction and selection for emotion recognition from EEG.

[3](2016)Improving BCI-based emotion recognition by combining EEG feature selection and kernel classiiers.

[4](2016)Real-time EEG-based emotion monitoring using stable features.

[5](2016)EEG-based automatic emotion recognition: Feature extraction, selection and classiication methods.

[6](2019)EEG emotion recognition based on graph regularized sparse linear regression.

[7](2020)Emotion recognition from multi-channel eeg via deep forest.

3 Raw EEG Data → Signal Preprocessing →Feature Engineering → Deep Learning → Emotion Recongnition

在部分基于 DL 的工作中,DL 模型纯粹被视为与传统机器学习模型发挥相同作用的分类器。与机器学习路线相比,该路线的优势在于可以将原始特征非线性转换到任何向量空间的DL模型的表示学习和通用逼近属性。例如,Zheng[1]和Thammasan[2]利用深度信念网络 (DBN) 基于从EEG提取的手工制作的特征 (例如PSD和离散小波) 来分类EEG情绪。DBN是由Hinton等人[3]提出的,它建立在多个受限玻尔兹曼机 (RBMs) 上,解决了深度神经网络的训练问题,促进了深度学习的快速发展。RBMs是具有生成功能的两层人工神经网络。与玻尔兹曼机器相比,RBMs在可见层和隐藏层之间的连接方面受到限制,它们能够学习输入数据的概率分布。

通常,DBN训练包括三个主要步骤: 1) 通过Gibbs采样方法对DBN进行预训练;2)将DBN转换为编码器-解码器网络,从而通过无监督的反向传播来调整DBN;3) 通过有监督反向传播对DBN进行训练,如下图所示。

深度信念网络(DBN)由受限玻尔兹曼机器(RBM)和相应的训练过程组成

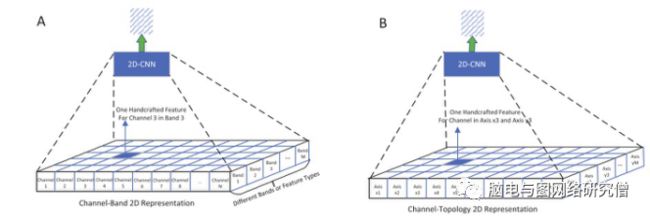

不同渠道的隐含相关性是识别情绪的重要指标。卷积神经网络(CNN)非常适合处理二维数据和提取通道间联合信息。将CNN应用于基于多通道EEG的情绪检测是值得研究的。需要解决两个核心问题:1)将脑电图数据转换为适当的表示,以向它表示 CNN 模型的输入格式;2)基于各种CNN模块构建有效的表示学习模型进行特征转换。 如下图所示,在应用2D-CNN时说明了两种可能的表示方法。例如,Yang等人[4]提出了一种通道频率卷积神经网络 (CFCNN),它与递归量化分析 (RQA) 一起工作。通过RQA导出的不同EEG频率范围内的熵特征作为CFCNN模型的输入,输入帧不保留信道拓扑信息。特征图的行对应通道,列是提取的不同频段的特征。Tripathi等人[5]提取了九类信号的统计脑电特征作为CNN模型的输入,最终该方法的效果达到并超过了主流方法。为了更好的数据表示,输入特征图还可以保留通道空间拓扑信息。Li等人[6]将来自不同通道的差分熵特征组织为 2D 稀疏图,它维护了电极空间拓扑的信息,最终用于 CNN 训练和推断,构建的输入特征图可以理解为输入图像。因此,情感识别任务可以通过计算机视觉任务中采用的方法来解决。

在情感识别中,采用基于2D-CNN的两种具有代表性的2D 脑电特征表示方法。

当CNN处于不同方向时,它们不擅长识别输入数据的特征。特别地,通过下采样,池化可以降低计算成本,以减少图像的变化。尽管如此,池化的优势是以忽略高级部分之间精确的空间相关性为代价的,这对于识别具有丰富空间信息的对象至关重要。为了解决这个问题,提出了一种受神经科学启发的新型神经网络,称为胶囊网络 (CapsNet)。人工神经元处理标量,胶囊处理向量,CapsNet可以对局部部分和整个对象之间的隐式关联进行建模。此外,与CNN模型相比,CapsNet可以以更快的速度进行训练,并且需要更少的训练样本。因此,研究人员已经开始将CapsNet引入这一技术路线。例如,Chao等人[7]指出各种情绪和皮层区域之间的显著对应关系可以通过CapsNet来区分,还提出了一种输入表示结构,称为多频带特征矩阵 (MFM),其中包含EEG通道之间的拓扑相关性以及各种EEG频率范围的区别。因此,它有助于在空间和频域中挖掘与情感相关的信息。基于MFM-Capsnet的方法下图所示,其中每个主胶囊的长度和方向分别指示与情绪相关的低级表示的存在和特征。

基于CapsNet的情感识别模型的体系结构,其中通道信号的PSD特征映射到模型输入,即多频带特征矩阵。

一些研究人员还认为,传统的 CNN 模型对于EEG 的特征学习可能不是最优的,因为在空间域是离散的,更紧密的空间关系可能并不能保证更紧密的功能关系。因此,采用2D表示和CNN模型可能会忽略不同通道之间的复杂关系、功能性大脑网络模式与情绪过程之间的关系。基于图的描述方法有利于在离散空间域中提取信号的判别特征,从功能连接图中学习的结构表示可以捕获上述相关信息。例如,图卷积神经网络 (GCNN) 允许探索表示EEG通道的多个图节点之间的隐式相关性。类似于下图(A)中所示的方法,Wang等人[8]在 EEG 派生图上构建了一个典型的 GCNN 模型,该图是频率内功能连接图(FCG)和跨频率FCG的融合。同频FCG是通过计算同一频段的每一对信道信号的PLV得到的,而跨频FCG不需要信号来自同一频段。这两个图表示连接成一个具有 N × M 个节点的大图,其中N和M分别表示通道和频带的计数,实验验证了 GCNN 在 FCG 表示上的表现优于 CNN。鉴于功能网络的动态过程,类似于下图(B)所示的方法,Song等人[9]提出了一种动态图卷积神经网络(DGCNN)模型,通过该模型可以同时提取判别特征和功能连接信息。与传统的 GCNN 不同,邻接矩阵不是静态的,而是在 DGCNN 训练期间自适应地动态更新。假设学习到的邻接矩阵可以捕捉脑电通道的内在相关性。图的顶点表示是手工提取的特征,包括五个频段的 DE、PSD、DASM 和 RASM特征。对于DE和PSD功能,基于每种图表评估性能。实验结果表明,DE 特征图具有最佳性能,并且优于基于GCNN 的方法。

应用图卷积神经网络 (GCNN) 的两种代表性方法。图A传统的GCNN模型,输入的功能连通图是预先确定的,在模型训练过程中是静态的。图B动态GCNN模型,功能连接图在模型训练过程中不断演化。

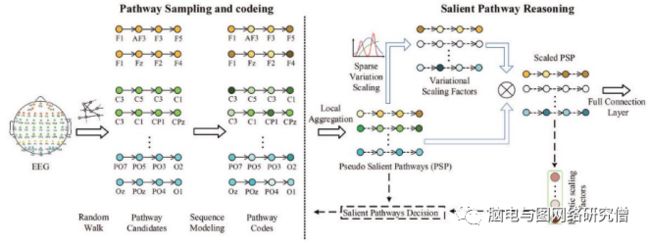

研究结果也鼓舞了情绪表达过程中空间相邻区域和功能相关区域之间存在联系和路径。如下图所示,Zhang 等人[10]提出了一种启发式变分路径推理 (VPR) 方法,该方法引入了随机游走以沿电极生成候选路径。LSTM 用于将它们的有序连接编码为路径的高级特征,这些特征表明电极之间的依赖性以表示每个路径,还提出了一种显著路径推理方法,包括路径聚合和稀疏变分缩放两个基本模块。它可以自适应地确定显著路径以促进 EEG 情绪识别,并为情绪分析提供一些解释。基于可解释的模型,探索了显著的交互途径 w.r.t.不同的情绪这项研究为 SEED 数据集设置了一个新的SOTA。

启发式变分途径推理 (VPR) 方法的框架,可以自适应地确定显著途径,以促进脑电图情绪识别。

另一项类似的工作如下图所示,考虑到半球之间的不对称信息在情绪认知中的重要性,Li 等人[11]开发了一个双半球差异模型 (BiHDM),如下图所示,其中两个单独的水平和垂直遍历 RNN 被用来扫描所有左半球和右半球通道的EEG特征,以学习两个半球的深层特征。与先前工作不同,电极路径是预先定义的。在获得上述每个通道的深度表示后,在大脑区域的对称位置上对成对的通道进行了成对减法、除法和内积,因为两个半球之间的不对称信息应该更能区分从 EEG 中识别情绪;另一个RNN对获得的非对称表示进行建模,并融合双向流信息进行最终分类。此外,他们在模型中添加了域鉴别器,以提取域不变的数据表示。在这项工作之前,Li等人[12]基于相同的神经科学假设开发了一个双半球域对抗神经网络(BiDANN)。将大脑半球不对称信息输入到框架中,并进行了域适应。该框架有两个特征提取器,两个局部鉴别器分别减少了左右半球域之间的分布差异。然后,全局鉴别器减少了两个域之间的整体分布差异。通过 LSTM 模块提取左右半球特征。研究人员首次将半球不对称理论引入深度学习模型设计,并验证了先前的神经科学知识有利于指导建模训练,这通常被先前的工作所忽视。

基于特征的手工包装双半球差异信息集成模型(BiHDM)。BiHDM利用四个RNN从水平和垂直流中捕获每个半球的EEG通道信息。

参考文献

[1](2015)Investigating critical frequency bands and channels for EEG-based emotion recognition with deep neural networks.

[2](2016)Application ofdeep beliefnetworks in eeg-based dynamic music-emotion recognition.

[3](2006)A fast learning algorithm for deep belief nets.

[4](2018)A recurrence quantiication analysis-based channel-frequency convolutional neural network for emotion recognition from EEG.

[5](2017)Using deep and convolutional neural networks for accurate emotion classiication on DEAP dataset.

[6](2018)Hierarchical convolutional neural networks for EEG-based emotion recognition.

[7](2019)Emotion recognition from multiband EEG signals using CapsNet.

[8](2019)Convolutional neural networks using dynamic functional connectivity

for EEG-based person identiication in diverse human states.

[9](2018)EEG emotion recognition using dynamical graph convolutional neural

networks.

[10](2020)Variational pathway reasoning for EEG emotion recognition.

[11](2020)A novel bi-hemispheric discrepancy model for eeg emotion recognition.

[12](2018)Novel Neural Network Model based on Cerebral Hemisphe-ric Asymmetry for EEG Emotion Recognition.

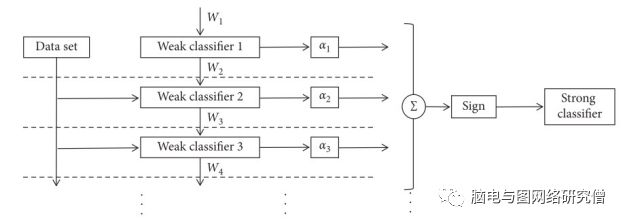

4 Deep Learning(Machine Learning) → Ensemble Learning → Emotion Recongnition

基于集成学习的识别方法也是在基于 EEG 的情绪识别任务中获得理想性能的有效策略。集成学习通过利用多个模型的决策边界,遵循“两个头脑比一个头脑更好”的理念。例如,Mehmood 等人[1]使用四种集成学习策略(Bagging、Boosting、Stacking 和 Voting)来整合多个机器学习模型的能力,然后基于 Voting 方法获得最佳识别效果。Stacking就是利用训练数据构建若干个基学习器,将这些学习器的概率输出作为一个新的训练集来学习一个元学习器。元学习器学习组织输入并将权重分配给基础学习器。例如,Yin等人[2]提出了一种基于深度学习的堆叠算法,构建的网络结合了多层堆叠的自动编码器,每个对应于多个时频域特征的一个特征子集。因此,可以从那些提高泛化能力和对数据不平衡的鲁棒性的子网络中提取多种类型的高级特征。Chen等人[3] 提出应用 Adaboost 算法自适应地提高识别性能,如下图所示,它基于迭代机制工作。每次迭代都包含一个弱分类器对加权样本进行训练,在每次迭代中确定这个弱分类器的重要性(权重),并根据分类结果调整样本权重。具体来说,在下一次迭代中,错误分类的样本将被分配更高的权重,以在模型训练中获得更多的关注,而正确分类的样本的权重会降低。最后,将这些弱分类器通过它们的权重组合成一个强分类器,从而在提高泛化能力和避免过度拟合的同时获得改进的识别性能。

参考文献

[1](2017)Optimal feature selection and deep learning ensembles method for emotion recognition from human brain EEG sensors.

[2](2017)Recognition of emotions using multimodal physiological signals and an ensemble deep learning model.

[3](2021)Emotion Recognition of EEG Signals Based on the Ensemble Learning Method: AdaBoost.

5 Raw EEG Data → Signal Preprocessing → Feature Engineering → Fuzzy Logic → Emotion Recongnition

获取的脑电信号和对应的标签可能有噪声、不精确和不确定,导致精确建模问题,模糊逻辑为基于模糊集理论的近似推理提供了基础。因此,除上述技术路线外,一些研究采用基于模糊逻辑的技术路线,将样本分配到具有一定隶属度的多个类别。Fuzzy C-Means 和 Fuzzy k-Means 聚类方法是两种具有代表性的模糊逻辑方法,它们很早就在基于 EEG 的情绪识别中实现了。此外,Matiko 等人[1]基于左右脑半球情绪活动的不对称理论设计了模糊分类规则,分类器根据各种规则输出情绪类型和置信度。基于 Dempster-Shafer 的理论,Soroush 等人[2]通过融合特征子集和多个 MLP 分类器来提高识别的准确性,结合模糊逻辑、神经网络和非线性动力系统方面的模糊认知图 (FCM) 也已在基于 EEG 的情绪识别中得到验证。总的来说,模糊逻辑在这个研究领域中很少被研究。

参考文献

[1](2014)Fuzzy logic based emotion classiication.

[2](2018)A novel method of EEG-based emotion recognition using nonlinear features variability and Dempster-Shafer theory.

6 Deep Learning → Data-Constrained Learning → Emotion Recongnition

从之前的相关著作可以看出,采用深度学习是基于EEG的情感识别的趋势。尽管如此,与浅层模型相比,深度神经网络模型包含更多参数,并且依赖于足够的标记训练数据来优化参数。因此,必须面对基于 EEG 的情绪识别的一个核心挑战:获取充足且高质量的训练数据。因此,一条有前途的研究路线是研究“数据约束学习”以解决数据限制问题,这里介绍两种可能的方式。

数据增强技术

一些研究人员专注于研究数据增强 (DA) 技术,可以从现有数据集生成新样本,以增加训练样本的数量。将模型暴露给训练样本的更多变量表示,使其对实际应用中可能遇到的数据转换具有鲁棒性。此外,增加训练集的大小有助于训练具有许多参数的更复杂的模型,并减少过度设置。数据增强通常在计算机视觉中通过应用几何变换 (例如旋转,裁剪等) 来进行,然而,脑电图是非平稳的时间序列。几何变换方法不适用于脑电图。一种简单的方式是将随机噪声 (例如,高斯、泊松、椒盐噪声等) 添加到原始EEG信号,数据扩充也采用基于滑动窗口的方法。但是,这些方法可能会引入建模和性能评估风险。基于深度生成学习的数据增强方法最近引起了广泛关注,包括基于生成对抗网络 (GAN) 的方法和基于变分自动编码器 (VAE) 的方法 [1]。例如,在对抗网络的训练过程中,生成器尝试生成与真实数据相似的数据,直到鉴别器无法区分假数据为止。

少样本学习

少样本学习也有可能解决数据限制问题,并已在最近的相关工作中进行了研究。少样本学习是一类机器学习技术,它构建有效的模型,可以很好地泛化在训练过程中看不见的类上。它适用于有限的样本,并且不依赖于对属于新类的数据进行重新训练。少样本学习也可以称为 N-shot-K-way 学习问题,大多数小样本学习技术依赖于度量学习。如下图所示,需要分别构造 Support 集和 Query 集。对于支持集,从 K 个类中的每一个抽取 N 个样本。此外,再次对 K 个类进行采样以构建查询集。需要一个嵌入函数来将这些样本投影到潜在空间,其中优化模型以减少属于同一类的查询和支持样本的嵌入之间的距离,同时增加属于不同类别的样本的距离。 Support 和 Query 集构建过程和优化过程迭代多次。迭代后,为了进行测试,只需要属于 unseen 类的几个样本就可以形成一个支持集,而查询集的样本是要推断的目标。

一般少样本学习范例:(a) 为支持集 S 生成嵌入,(b) 为查询集 Q 生成嵌入,(c) 使用支持样本映射查询集嵌入。

参考文献

[1](2020)Data augmentation for enhancing EEG-based emotion recognition with deep generative models.

7Deep Learning(Machine Learning) → AutoML →Emotion Recongnition

基于 EEG 的情绪识别研究涉及的过程有些繁琐,这项任务中隐藏的领域知识远远超出了机器学习专家的知识范围。有没有办法在原始 EEG 数据上自动构建强大的识别模型?在这方面,自动机器学习 (AutoML) 正在引起该领域的关注。对于基于 AI 的方法,有效的模型主要由模型超参数和数据表示决定。AutoML 是指用于自动优化数据预处理、特征工程、模型选择、模型构建和超参数优化的端到端方法和工具,它旨在生成提供最佳分类性能并最小化特定问题的泛化误差的模型。目前,一些研究人员已经开始将 AutoML 技术引入基于 EEG 的情绪识别中。例如,He等人[1]提出了一种完全集成的优化算法(FIOA),可以同时实现自动参数优化、特征选择和分类选择。对于基于深度学习的技术路线,Aquino-Brítez 等人[2] 提出了一种基于深度学习架构的多目标优化的完全可配置的优化框架。它不仅能够优化模型超参数,还可以适应模型架构,例如插入或删除层。目前它遇到的主要问题是计算负担高。例如,谷歌提出的神经架构搜索算法 NASNet 需要在 800 个 GPU 上训练 28 天。如此高的计算成本使得搜索算法对大多数研究人员来说是不切实际的。

参考文献

[1](2020)Strengthen EEG-based emotion recognition using irely integrated optimization algorithm.

[2](2021)Optimization of Deep Architectures for EEG Signal Classiication: An AutoML Approach Using Evolutionary Algorithms.

获取更多分享,关注微信公众号:脑电与图网络研究僧

PS:在学习过程中,参考大量中英文书籍、相关论文、博客,在此一并向各位学者、博主表示深深谢意。

仅用于学术交流,不用于商业行为,若有侵权及疑问,请后台留言,小编及时删除!