#Reading Paper# 【曝光偏差】WWW 2022 UKD: Debiasing Conversion Rate Estimation via Uncertainty-regularized

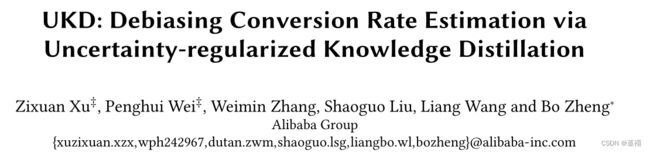

#论文题目:【曝光度偏差】UKD: Debiasing Conversion Rate Estimation via Uncertainty-regularized Knowledge Distillation(UKD:通过不确定性正则化知识蒸馏的去偏转化率(CVR)估计)

#论文地址:https://arxiv.org/pdf/2201.08024.pdf

#论文源码开源地址:暂无

#论文所属会议:WWW 2022

#论文所属单位:阿里

一、导读

本文是针对广告方面存在的样本选择偏差问题提出的相关改进方法,同样常见的推荐系统中也存在SSB问题,因此具有借鉴意义。

传统的点击后转化率 (CVR) 估计模型是使用点击样本进行训练的。但是,模型上线后,需要对所有展示广告进行估计,从而导致样本选择偏差 (SSB) 问题。因此,需要给未点击的广告提供可靠的监督信号,从而缓解SSB问题。

本文提出了一种不确定性正则化知识蒸馏 (UKD) 框架:

- 通过从未点击的广告中提取知识来消除 CVR 估计的偏差。教师模型学习点击自适应表征,并在未点击的广告上生成伪转换标签作为监督信号。

- 然后通过知识蒸馏对已点击和未点击的广告训练学生模型,进行不确定性建模以减轻伪标签中的固有噪声。

二、方法

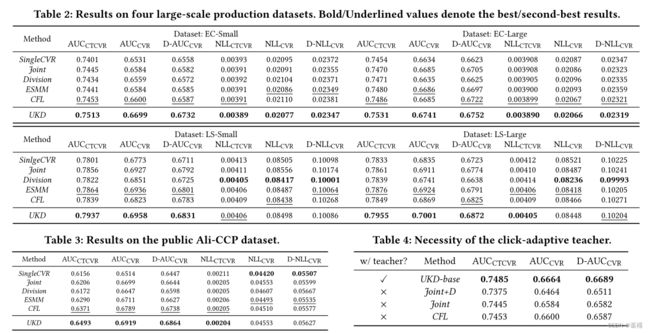

如图所示为模型的整体流程,点击自适应的教师模型来产生为标签和不确定性正则化的学生模型来蒸馏知识。

2.1 点击自适应教师模型

教师模型的目标是在只能访问到点击数据Dclick的转化标签的情况下,生成未点击数据Dunclick的伪标签。点击样本和未点击样本的特征分布存在差异。为了拥有对未点击广告的准确推断能力,教师模型需要学习点击自适应表征。从无监督域自适应的角度来处理伪转换标签生成,其中源/目标域是点击/未点击空间。通过这种方式,问题被表述为为未标记的未点击广告(Dunclick作为目标域)生成可靠的伪转换标签,给定标记的点击广告(Dclick作为源域)。

2.1.1 点击自适应表征学习

2.1.1.1 模型结构

教师模型为图2的左边部分,主要包含特征表征学习器 T T Tf( ),CVR预测器 T T Tp( ),点击判别器 T T Td( )。特征表征学习器 T T Tf( )以样本特征为输入学习他们的稠密表征 h h h(T), T T Tf( )包含了embedding层和多层dense layer。CVR预测期用于预测CVR分数

,主要包含dense layer和softmax函数。

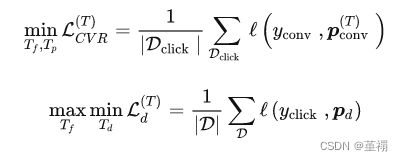

为了使特征表征 h h h(T)更好的点击自适应以促进在未点击广告上生成伪转换标签,教师模型引入了点击判别器 T T Td( )对每个样本的域(即点击或未点击)进行分类。如果一个强点击鉴别器不能正确预测样本的域标签,它的表征 h h h(T)是点击自适应的。公式表示如下,其中pconv是预测得到的cvr分布,pd是预测的域分布。

2.1.1.2 对抗学习

为了学习点击自适应表征,给定一个广告 ,通过 T T Tf()得到表征,希望混淆点击判别器并最大化域分类损失,而点击判别器 (·) 本身旨在最小化域分类损失成为一个强分类器。教师模型通过对抗学习进行优化:

第一个式子最小化 CVR 估计的损失,以优化 (·) 和 (·)。第二个意味着学习器 (·) 使点击和未点击广告的表征无法区分,而点击鉴别器 (·) 被优化以更好地区分点击广告和未点击广告。

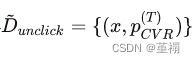

2.1.2 为未点击广告生成伪标签

将未点击的数据输入教师模型,预测其CVR分布![]() 作为伪标签。将

作为伪标签。将 作为未点击样本用于后续模型。

作为未点击样本用于后续模型。

2.2 不确定性正则的学生模型

基于点击自适应教师模型学习到的未点击广告的伪转换标签,UKD 框架进一步构建了一个基于知识蒸馏的学生模型,该模型从点击广告(带有真实标签)和未点击广告中学习(使用伪标签)进行整个空间 CVR 估计。与仅使用点击样本训练的模型相比,该模型通过在训练期间明确考虑未点击样本来缓解 SSB 问题。

蒸馏策略可以引导学生模型挖掘教师模型学到的有价值的知识。由于教师预测中存在固有噪声,未点击广告的伪标签的置信度不如点击广告的真实转换标签。为了解决这个问题,提出了一个不确定性正则化的学生模型,通过在蒸馏过程中模拟伪标签的不确定性来减少噪声的负面影响。

2.2.1 基学生模型:标签蒸馏

2.2.1.1 模型结构

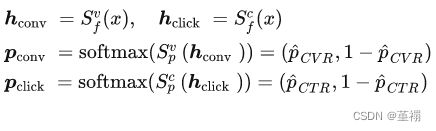

基学生模型基于多任务模型构建,由两个特征表征学习器组成(即, S S Svf( )用于 CVR 任务, S S Scf( )用于 CTR 任务)。两个表示学习器共享特征embedding层,每个学习器都有几个dense layer来学习各自的表征h。并且两个预测器中的每一个都包含softmax 函数的dense layer。基础学生模型的前向过程为:

2.2.1.2 从未点击广告中蒸馏知识

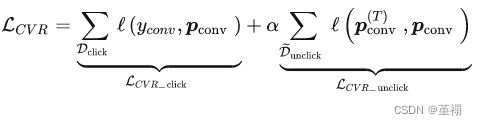

借助教师学习的未点击广告的伪转换标签,学生模型在整个空间中进行了优化,以缓解 SSB 问题。 CVR 估计任务的目标是:

总的损失函数表示为

2.2.2 不确定性正则化

预计未点击广告的伪转换标签的置信度低于点击广告的真实转换标签的置信度,因为后者是从用户反馈日志中获得的,而前者是由教师模型产生的。由于教师预测中存在固有噪声,具有噪声伪标签的未点击样本会误导学生模型的训练过程。 对于未点击广告的有效知识蒸馏,关键有两个方面:

- (i)识别嘈杂和不可靠的未点击样本,

- (ii)减少蒸馏过程中的负面影响。

本文通过估计未点击样本的伪标签的不确定性来反映噪声,其中更高的不确定性值表示更差的可靠性。通过使用高不确定性作为噪声未点击样本的度量,可以通过简单地为其 CVR 损失分配低权重来减少此类样本的负面影响,从而避免误导学生模型的蒸馏过程。因此,提出了一个不确定正则化的学生模型。它估计每个未点击广告的伪标签的不确定性,并根据不确定性级别动态调整未点击广告的 CVR 损失的权重,减少噪声的负面影响。

2.2.2.1 不确定性建模

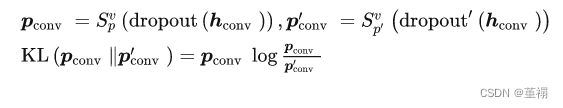

不确定性正则化学生模型包含两个 CVR 预测器 S S Svp( )和 S S Svp’( )来同时估计 CVR 分数(如图 2 右侧所示),然后将不确定性建模为它们的不一致性。让 p p pconv和 p ′ p' p′conv表示来自两个CVR预测器的预测分布。将不确定性表述为两个预测的 KL 散度,其中dropout的目的是为了增强两个预测的差异。

2.2.2.2 不确定性正则

基于每个未点击样本的估计不确定性,通过动态调整基于不确定性的权重与 CVR 损失来减少蒸馏过程中噪声未点击样本的负面影响。与基础学生模型相比,现在未点击广告的蒸馏过程通过伪标签的不确定性进行了正则化,减轻了教师预测中存在的固有噪声。

对于每个未点击的样本,使用 作为不确定性正则化来加权其原始 CVR 损失。该因子与不确定性成反比( 为超参数)。因此,损失 L L LCVR_unclick可以定义为下式,

作为不确定性正则化来加权其原始 CVR 损失。该因子与不确定性成反比( 为超参数)。因此,损失 L L LCVR_unclick可以定义为下式,

如果一个样本具有高不确定性,则该因子返回一个较小的值来降低其 CVR 损失的权重。如果不确定性接近 0,则因子趋于 1,这样的学生模型会转移到基础学生模型。