NNDL 作业10:第六章课后题(LSTM | GRU)

习题6-3:当使用公式(6.50)作为循环神经网络的状态更新公式时,分析其可能存

在梯度爆炸的原因并给出解决方法.

答:

令 ![]() 为在第 k 时刻函数 g(⋅) 的输入,在计算公式6.34中的误差项

为在第 k 时刻函数 g(⋅) 的输入,在计算公式6.34中的误差项 ![]() 时,梯度可能过大,从而导致梯度过大问题。

时,梯度可能过大,从而导致梯度过大问题。

解决办法:增加门控控制。例如:长短期记忆神经网络(LSTM)

习题6-4:推导LSTM网络中参数的梯度,并分析其避免梯度消失的效果.

答:

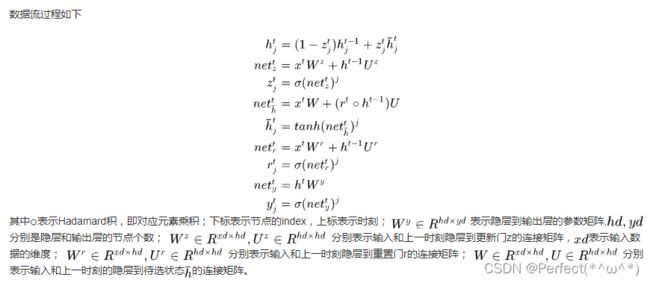

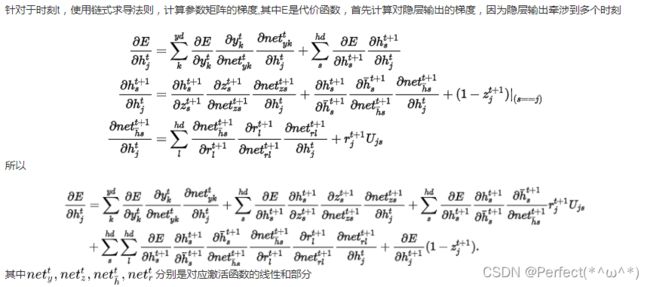

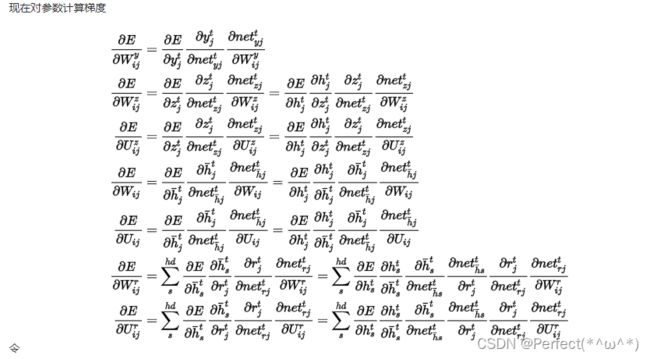

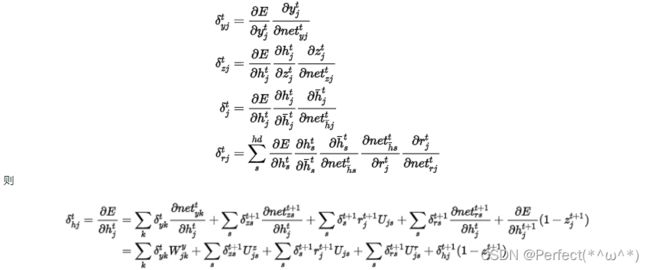

习题6-5:推导GRU网络中参数的梯度,并分析其避免梯度消失的效果. (选做)

答:GRU单元结构如下图所示:

附加题6-1P:什么时候应该用GRU?什么时候用L STM? (选做)

- 一般来说两者效果差不多,性能在很多任务上也不分伯仲。GRU参数更少,收敛更快;数据量很大时,LSTM效果会更好一些,因为LSTM参数也比GRU参数多一些。

- 但是GRU通过更新门来控制上一时刻的信息传递和当前时刻计算的隐层信息传递。GRU中由于是一个参数进行控制,因而可以选择完全记住上一时刻而不需要当前计算的隐层值,或者完全选择当前计算的隐层值而忽略上一时刻的所有信息,最后一种情况就是无论是上一时刻的信息还是当前计算的隐层值都选择传递到当前时刻隐层值,只是选择的比重不同。而LSTM是由两个参数(遗忘门和输入门)来控制更新的,他们之间并不想GRU中一样只是由一个参数控制,因而在比重选择方面跟GRU有着很大的区别,例如它可以既不选择上一时刻的信息,也不选择当前计算的隐层值信息(输入门拒绝输入,遗忘门选择遗忘)。

- GRU要在上一时刻的隐层信息的基础上乘上一个重置门,而LSTM无需门来对其控制,LSTM必须考虑上一时刻的隐层信息对当前隐层的影响,而GRU则可选择是否考虑上一时刻的隐层信息对当前时刻的影响。

附加题6-2P: LSTM BP推导,并用Numpy实现. (选做)

import numpy as np

def sigmoid(x):

return 1/(1+np.exp(-x))

def softmax(x):

e_x = np.exp(x-np.max(x))# 防溢出

return e_x/e_x.sum(axis=0)

def LSTM_CELL_Forward(xt, h_prev, C_prev, parameters):

"""

Arguments:

xt:时间步“t”处输入的数据 shape(n_x,m)

h_prev:时间步“t-1”的隐藏状态 shape(n_h,m)

C_prev:时间步“t-1”的memory状态 shape(n_h,m)

parameters

Wf 遗忘门的权重矩阵 shape(n_h,n_h+n_x)

bf 遗忘门的偏置 shape(n_h,1)

Wi 输入门的权重矩阵 shape(n_h,n_h+n_x)

bi 输入门的偏置 shape(n_h,1)

Wc 第一个“tanh”的权重矩阵 shape(n_h,n_h+n_x)

bc 第一个“tanh”的偏差 shape(n_h,1)

Wo 输出门的权重矩阵 shape(n_h,n_h+n_x)

bo 输出门的偏置 shape(n_h,1)

Wy 将隐藏状态与输出关联的权重矩阵 shape(n_y,n_h)

by 隐藏状态与输出相关的偏置 shape(n_y,1)

Returns:

h_next -- 下一个隐藏状态 shape(n_h,m)

c_next -- 下一个memory状态 shape(n_h,m)

yt_pred -- 时间步长“t”的预测 shape(n_y,m)

"""

# 获取参数字典中各个参数

Wf = parameters["Wf"]

bf = parameters["bf"]

Wi = parameters["Wi"]

bi = parameters["bi"]

Wc = parameters["Wc"]

bc = parameters["bc"]

Wo = parameters["Wo"]

bo = parameters["bo"]

Wy = parameters["Wy"]

by = parameters["by"]

# 获取 xt 和 Wy 的维度参数

n_x, m = xt.shape

n_y, n_h = Wy.shape

# 拼接 h_prev 和 xt

concat = np.zeros((n_x + n_h, m))

concat[: n_h, :] = h_prev

concat[n_h:, :] = xt

# 计算遗忘门、输入门、记忆细胞候选值、下一时间步的记忆细胞、输出门和下一时间步的隐状态值

ft = sigmoid(np.dot(Wf, concat) + bf)

it = sigmoid(np.dot(Wi, concat) + bi)

cct = np.tanh(np.dot(Wc, concat) + bc)

c_next = ft * C_prev + it * cct

ot = sigmoid(np.dot(Wo, concat) + bo)

h_next = ot * np.tanh(c_next)

# LSTM单元的计算预测

yt_pred = softmax(np.dot(Wy, h_next) + by)

return h_next, c_next, yt_pred

np.random.seed(1)

xt = np.random.randn(3,10)

h_prev = np.random.randn(5,10)

c_prev = np.random.randn(5,10)

Wf = np.random.randn(5, 5+3)

bf = np.random.randn(5,1)

Wi = np.random.randn(5, 5+3)

bi = np.random.randn(5,1)

Wo = np.random.randn(5, 5+3)

bo = np.random.randn(5,1)

Wc = np.random.randn(5, 5+3)

bc = np.random.randn(5,1)

Wy = np.random.randn(2,5)

by = np.random.randn(2,1)

parameters = {"Wf": Wf, "Wi": Wi, "Wo": Wo, "Wc": Wc, "Wy": Wy, "bf": bf, "bi": bi, "bo": bo, "bc": bc, "by": by}

h_next, c_next, yt = LSTM_CELL_Forward(xt, h_prev, c_prev, parameters)

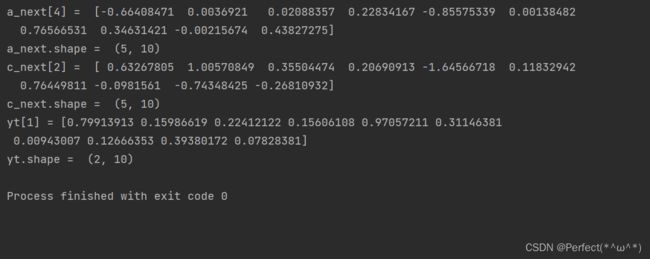

print("a_next[4] = ", h_next[4])

print("a_next.shape = ", c_next.shape)

print("c_next[2] = ", c_next[2])

print("c_next.shape = ", c_next.shape)

print("yt[1] =", yt[1])

print("yt.shape = ", yt.shape)

结果:

总结:本次作业主要是关于一些推导。推导过程比较麻烦,需要细心,一步步进行。了解了GRU 和LSTM各自的适用情况。他们都是RNN系列中的改进算法,LSTM是一种特殊的 RNN 类型,可以学习长期依赖信息。GRU可以看成是LSTM的变种,GRU把LSTM中的遗忘门和输入门用更新门来替代。

参考:GRU(Gated Recurrent Unit) 更新过程推导及简单代码实现

GRU 和 LSTM 的对比