统计学习方法(第二版)+简博士 读书笔记

文章目录

- 第一章 统计学习及监督学习概论

-

- 统计学习

-

- 定义

- 特点

- 统计学习方法的步骤

- 统计学习分类

- 统计学习方法的基本分类

-

- 监督学习(supervised learning)

-

- 定义

- 输入空间、特征空间、输出空间、实例

- 相关表示

- 基本假设

- 目的

- 形式

- 假设空间(hypothesis space)

- 对具体的输入进行相应的输出预测时,写作:

- 流程图

- 无监督学习(unsupervised learning)

-

- 定义

- 监督学习与无监督学习对比

- 相关表示

- 流程图

- 强化学习(reinforcement learning)

-

- 定义

- 流程图

- 统计学习方法的三要素

-

- 模型

- 策略

-

- 损失函数(loss function)

- 风险函数(risk function)

- 经验风险(empirical risk)

- 常见损失函数

-

- 0-1损失函数(0-1 loss function)----分类问题

- 平方损失函数(quadratic loss function)----回归问题

- 绝对损失函数(absolute loss function)----回归问题

- 对数损失函数(logarithmic loss function)----概率模型

- 基本策略

- 经验风险最小化

- 结构风险最小化

-

- 结构风险

- 结构风险最小化

- 算法

- 模型评估与模型选择

-

- 训练误差与测试误差

-

- 误差率与准确率

- 过拟合与模型选择

- 测试误差和训练误差与模型复杂度的关系

- 正则化与交叉验证

-

- 正则化

- 交叉验证

-

- 简单交叉验证

- S折交叉验证

- 留一交叉验证

- 泛化能力

-

- 泛化误差

- 泛化误差上界

-

- 定理1.1(泛化误差上界)

- 生成模型与判别模型

-

- 生成模型(generative model)

- 判别模型(discriminative model)

- 两者比较

- 监督学习应用

-

- 分类问题

-

- 分类准确率

- 标注问题

- 回归问题

-

- 类型

第一章 统计学习及监督学习概论

统计学习

定义

学习:一个系统通过执行某个过程改进它的性能

统计学习是关于计算机基于数据构建概率统计模型并运用模型对数据进行预测与分析的学科

特点

- 以计算机和网络为平台

- 以数据为研究对象

- 以预测和分析数据为目的

- 以方法为中心,构建模型去预测和分析

- 是多领域交叉学科

统计学习方法的步骤

- 得到一个有限的训练数据集合

- 确定所有可能的模型的假设空间,即学习模型的集合(模型)

- 确定模型选择的策略(策略)

- 实现求解最优模型的算法(算法)

- 通过学习方法选择最优模型

- 利用学习的最优模型对新数据进行预测或分析

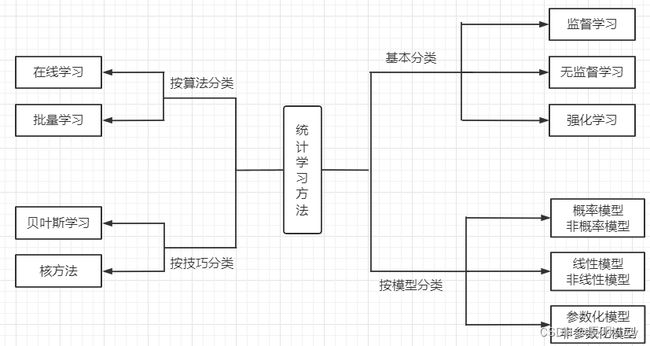

统计学习分类

统计学习方法的基本分类

监督学习(supervised learning)

定义

指从标注数据中学习预测模型的机器学习问题,本质是学习输入到输出的映射统计规律

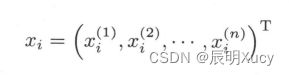

输入空间、特征空间、输出空间、实例

输入空间(input space):输入的所有可能取值的集合

实例(instance):每一个具体输入,通常由特征向量(feature vector)表示

特征空间(feature space):所有特征向量存在的空间

输出空间(output space):输出的所有可能取值的集合

tips:

- 输入与输出空间可以是同一个也可以是不同的空间。通常输出空间远远小于输入空间

相关表示

输入变量:X 输入变量取值:x

输出变量:Y 输出变量取值:y

以xi表示多个输入变量中的第i个变量:

样本容量为N的训练集(成对出现,输入&输出):

基本假设

X和Y具有联合概率分布P(X,Y)

目的

学习一个输入到输出的映射,这一映射以模型表示

形式

条件概率分布P(X|Y)或决策函数Y=f(X)

假设空间(hypothesis space)

所有这些可能模型的集合

对具体的输入进行相应的输出预测时,写作:

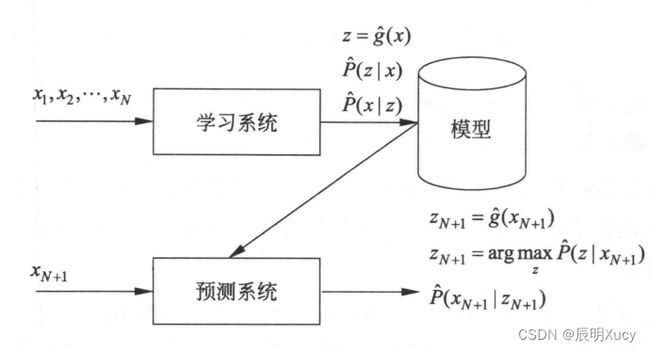

流程图

监督学习分为学习和预测两个过程,由学习系统和预测系统构成。

模型是利用给定的训练数据集通过学习得到的

无监督学习(unsupervised learning)

定义

指从==无标注数据中学习预测模型的机器学习问题,本质是学习数据中的统计规律或潜在结构==

监督学习与无监督学习对比

| 监督学习 | 无监督学习 | |

|---|---|---|

| 是\否 标注数据 | 标注数据:表示输入输出的对应关系 | 无标注数据:自然得到的数据 |

| 预测模型 | 对给定的输入产生相应的输出 | 表示数据的类别、转换或概率 |

| 本质 | 学习输入到输出的==映射==统计规律 | 学习数据中的统计规律或潜在结构 |

相关表示

输入空间:

隐式结构空间:

模型:函数z=g(x),条件概率分布P(z|x)或条件概率分布P(x|z)

假设空间:所有这些可能模型的集合

目的:选出在给定评价标准下的最优模型

样本容量为N的训练集:U={x1,x2,x3,···,xN} (只包含了输入,与监督学习不同)

流程图

强化学习(reinforcement learning)

定义

指智能系统在与环境的连续互动中学习最优行为策略的机器学习问题,本质是学习最优的序贯决策

流程图

系统从环境中观测到一个状态St和奖励rt,采取一个动作at,环境根据动作再决定下一步的的状态St+1和奖励rt+1

智能系统的目标是==长期积累奖励的最大化==

强化学习过程中,系统不断地试错,以达到学习最优策略的目的。

统计学习方法的三要素

模型+策略+算法

模型

假设空间:所有可能的条件概率分布或决策函数,用 表示

假设空间可以定义为决策函数的集合:

是由一个参数向量决定的函数族构成:

参数空间(parameter space)

假设空间可以定义为条件概率的集合:

是由一个参数向量决定的条件概率分布族构成:

策略

损失函数(loss function)

度量模型一次预测的好坏,记作:

Y:真实输出

f(X):利用模型预测的输出

风险函数(risk function)

度量平均意义下的模型预测的好坏

学习的目标就是选择期望风险最小的模型

经验风险(empirical risk)

训练集为:

常见损失函数

输出变量为有限个离散变量,解决的是分类问题

输入和输出变量为连续变量时,解决的是回归问题

0-1损失函数(0-1 loss function)----分类问题

平方损失函数(quadratic loss function)----回归问题

绝对损失函数(absolute loss function)----回归问题

对数损失函数(logarithmic loss function)----概率模型

基本策略

经验风险最小化和结构风险最小化

根据大数定理,当样本容量N趋于无穷时,经验风险Remp(f)趋于期望风险Rexp(f)

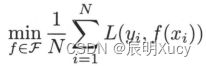

经验风险最小化

模型f(x)关于训练集的平均损失成为经验风险

样本容量N过小时,会产生过拟合现象

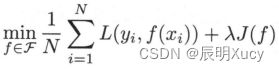

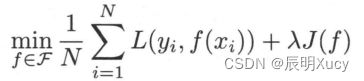

结构风险最小化

结构风险

是为防止过拟合提出的一种策略

结构风险最小化等价于正则化。

结构风险就是在经验风险的基础上加了表示模型复杂度的的正则化项(regularization)或者罚项(penalty term)

J(f)为模型复杂度。模型越复杂J(f)越大,反之越小

结构风险最小化

算法

指学习模型的具体计算方法

统计学习的算法成为求解==最优化问题==的算法

模型评估与模型选择

统计学习的目的:使学到的模型不仅对已知数据而且对==未知数据都能有很好的预测能力==

训练误差与测试误差

误差率与准确率

当损失函数是0-1损失时,测试误差—>误差率(error rate)

为指示函数(indicator function),不等时为1,相等为0(等不等于预测值)

相应准确率为:

即相等的比例

两者之和为1

过拟合与模型选择

过拟合(over-fitting):学习时选择的模型包含参数过多,对已知数据预测的很好,对未知数据预测的很差

测试误差和训练误差与模型复杂度的关系

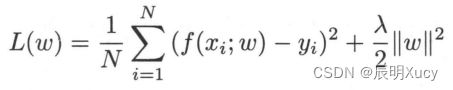

正则化与交叉验证

正则化:实现结构风险最小化的策略

正则化作用:选择经验风险与模型复杂度同时较小的模型

一般形式:

第一项为经验风险,第二项为正则化项,λ(≥0)为系数

λ越大,通过正则化选择的模型参数就会越少

正则化

||ω||1=∑j|ωj|

L1范数中可以使某些参数直接为0,最后选择的就是一个稀疏的模型(非0参数少)

L2范数:

L2范数可以防止过拟合,接近于0但不为0

交叉验证

基本想法:重复使用数据,把给定数据进行切分,在此基础上反复训练

训练集(training set):用来训练模型

验证集(validation set):用来选择模型

测试集(test set):用来最终评估学习方法

在学习到的不同复杂度的模型中,选择对验证集有最小验证误差的模型,由于验证集数据足够多,所以选择是有效的

简单交叉验证

数据不够充足,将其随机分为两个部分

用训练集在各种条件下训练模型,得到不同模型,然后在测试集上进行评估

S折交叉验证

随机将数据分为S个互不相交、大小相同的子集,用S-1个子集作为训练集,余下的子集作为测试集

这一过程对可能的S种选择重复进行,最后选出平均测试误差最小的模型

留一交叉验证

S折交叉验证特殊情况,S=N,往往在数据缺乏的情况下使用

N为数据集的样本容量

泛化能力

泛化能力:指由该方法学习到的模型对未知数据的预测能力

是学习方法本质上的重要性质

一般通过测试误差来评价学习方法的泛化能力(有可能不可靠,依赖于测试集)

泛化误差

泛化误差反映了学习方法的泛化能力,实际上,泛化误差就是期望风险

定义:如果学到的模型是f-hat,那么用这个模型对未知数据预测的误差即为泛化误差(generalization error)

泛化误差上界

泛化误差上界(generalization error bound):指泛化误差的概率上界

两种学习方法的优劣,通常通过他们的泛化误差上界进行比较

性质:

- 是样本容量的函数,样本容量增加,泛化上界趋于0

- 是假设空间容量的函数:假设空间容量越大,模型就越难学,泛化误差上界就越大

定理1.1(泛化误差上界)

对于二分类问题,当假设空间是有限个函数的集合={f1,f2,···,fd}时,对∀f∈,至少以概率1-δ,0<δ<1,以下不等式成立:

R(f)为泛化误差,或者称之为测试集上的期望风险,R^^(f)为训练集上的经验风险,R^^(f)+ε(d,N,δ)即为泛化误差上界

生成模型与判别模型

监督学习方法分为生成方法和判别方法,两者所学到的模型分别成为生成模型和判别模型

生成模型(generative model)

生成方法原理上由数据学习联合概率分布P(X,Y),然后**求出条件概率分布P(Y|X)**作为预测模型,即生成模型

典型生成模型:朴素贝叶斯法、隐马尔可夫模型

tips:输入和输出变量都要求为随机变量

判别模型(discriminative model)

由数据直接学习决策函数f(X)或者条件概率分布P(Y|X)作为预测模型,即为判别模型

典型判别模型:k近邻法、感知机、决策树等

tips:不需要输入和输出变量都要求为随机变量

两者比较

生成模型需要从大量数据中寻找规律

判别模型关注的是差别

| 生成模型 | 判别模型 |

|---|---|

| 所需数据量大 | 所需样本少于生成模型 |

| 可还原联合概率分布P(X,Y) | 可直接面对预测,准确率更高 |

| 收敛速度更快 | 可简化学习问题 |

| 能反映同类数据本身的相似度 | 不可以反映数据本身特性 |

| 隐变量存在时,任可用生成模型 |

隐变量:不可观测的随机变量

监督学习应用

分类问题

分类问题是监督学习的一个核心问题

输出变量Y取有限个离散值,预测问题就变成分类问题

输入变量X可以是离散的也可以是连续的

监督学习从数据中学习一个分类模型或分类决策函数成为分类器(classifier)

分类问题包括学习和分类两个过程

分类准确率

分类准确率是评价分类器性能的指标

定义:对于给定的测试数据集,分类器正确分类的样本数与总样本数之比称为分类准确率

通常关注的类为正类,其他为负类

TP——将正类预测为正类

FN——将正类预测为负类

FP——将负类预测为正类

TN——将负类预测为负类

二分类问题评价指标:

精确率:

召回率:

调和值:

标注问题

标注问题的输入是一个观测序列,输出是一个标记序列或状态序列

标注问题的目标:学习一个模型,是他能够对观测序列给出标记序列作为预测

标注问题分为学习和标注两个过程

回归问题

回归问题用于预测输入变量(自变量)和输出变量(因变量)之间的关系

类型

按照输入变量的个数:分为一元回归和多元回归

按照输入和输出变量的关系:分为线性回归和非线性回归

最常用的损失函数为平方损失函数,在此情况下回归问题可以用最小二乘法解决