人脸识别之目标追踪识别

人脸识别之目标追踪识别

1.开发工具

Python版本:Anaconda 3.8环境

开发软件:Pycharm社区版

相关模块:sys模块,pypinyin模块,os模块,opencv-contrib-python 模块,opencv-python模块。

模型:cv2中自带的人脸识别模型

2.环境搭建

安装Anaconda并将路径添加到环境变量,创建python虚拟环境,安装Pycharm并将路径添加到环境变量,使用pip安装需要的相关模块即可。

3.原理介绍

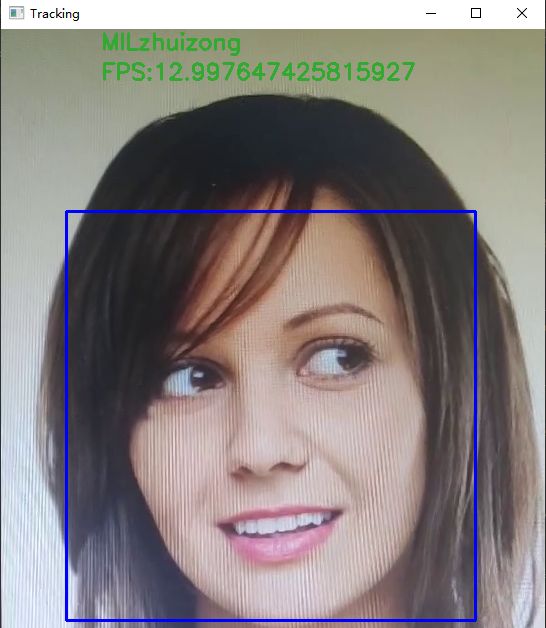

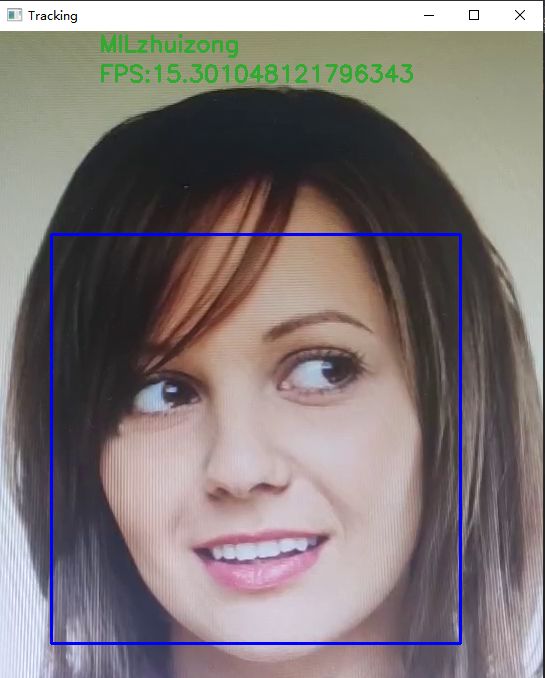

目标追踪的人脸识别是改进后的人脸识别算法,通过第一帧进行人脸模型的判定,当检测到人脸时,通过在人脸上画框,以这一张图片为基准,在接下来的视频中将会自动追踪刚刚识别到的人脸。

4.优点

由于只是从第一张检测到人脸的视频帧中使用了模型,在后续的视频中都是自动追踪人脸,大大的减少了每一帧图片处理时使用模型的时间,使得视频更快更流畅。

5.代码流畅分析介绍

导入相关模块

import sys

import pypinyin

import os

import cv2

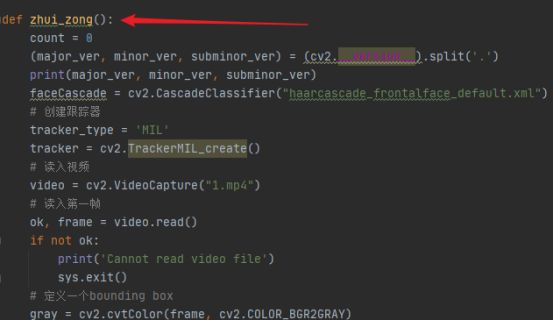

def zhui_zong():

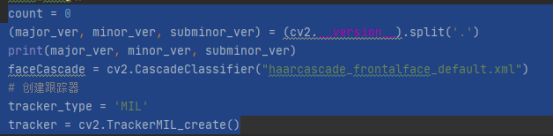

count = 0

(major_ver, minor_ver, subminor_ver) = (cv2.__version__).split('.')

print(major_ver, minor_ver, subminor_ver)

faceCascade = cv2.CascadeClassifier("haarcascade_frontalface_default.xml")

# 创建跟踪器

tracker_type = 'MIL'

tracker = cv2.TrackerMIL_create()

# 读入视频

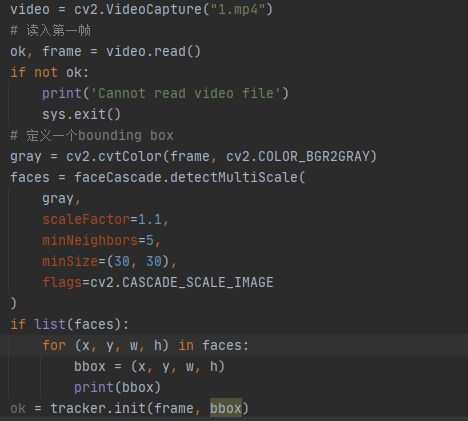

video = cv2.VideoCapture("1.mp4")

# 读入第一帧

ok, frame = video.read()

if not ok:

print('Cannot read video file')

sys.exit()

# 定义一个bounding box

gray = cv2.cvtColor(frame, cv2.COLOR_BGR2GRAY)

faces = faceCascade.detectMultiScale(

gray,

scaleFactor=1.1,

minNeighbors=5,

minSize=(30, 30),

flags=cv2.CASCADE_SCALE_IMAGE

)

if list(faces):

for (x, y, w, h) in faces:

bbox = (x, y, w, h)

print(bbox)

ok = tracker.init(frame, bbox)

while True:

ok, frame = video.read()

if not ok:

break

# Start timer

timer = cv2.getTickCount()

# Update tracker

ok, bbox = tracker.update(frame)

# Cakculate FPS

fps = cv2.getTickFrequency() / (cv2.getTickCount() - timer)

# Draw bonding box

if ok:

p1 = (int(bbox[0]), int(bbox[1]))

p2 = (int(bbox[0] + bbox[2]), int(bbox[1] + bbox[3]))

cv2.rectangle(frame, p1, p2, (255, 0, 0), 2, 1)

else:

cv2.putText(frame, "Tracking failed detected", (100, 80), cv2.FONT_HERSHEY_SIMPLEX, 0.75, (0, 0, 255), 2)

# 展示tracker类型

cv2.putText(frame, tracker_type + "Tracker", (100, 20), cv2.FONT_HERSHEY_SIMPLEX, 0.75, (50, 170, 50), 2)

# 展示FPS

cv2.putText(frame, "FPS:" + str(fps), (100, 50), cv2.FONT_HERSHEY_SIMPLEX, 0.75, (50, 170, 50), 2)

# Result

cv2.imshow("Tracking", frame)

# Exit

k = cv2.waitKey(1) & 0xff

if k == 27:

break

if __name__ == '__main__':

zhui_zong()