逻辑回归分类器(linear_model.LogisticRegression)

文章目录

- 前言

- 逻辑回归分类器(linear_model.LogisticRegression)

-

- 1. 二元逻辑回归的损失函数

- 2. 重要参数penalty & C

-

- 2.1 正则化

-

- 下面建立两个逻辑回归,来看一下L1正则化和L2正则化:

-

- 1.导入库

- 2. 导入数据

- 3. 建立L1,L2两个正则化的实例化并训练

- 4. 逻辑回归的重要属性coef_:查看每个特征所对应参数

- 5. 使用学习曲线查看

- 2.2 逻辑回归中的特征工程

-

- 2.2.1 业务选择

- 2.2.2 PCA和SVD一般不用

- 2.2.3 可以使用统计方法(非必要)

- 2.2.4 高效的嵌入法embedded(嵌入法详细看[特征选择中的嵌入法](https://blog.csdn.net/m0_50572604/article/details/120953907))

-

- 1.导入包

- 2. 数据的导入

- 3. 使用逻辑回归进行评分(默认是l2正则化)

- 4. 使用嵌入法特征选择

- 5. 验证模型效果

- 2.2.5 比较麻烦的系数累加法

- 2.2.6 简单快速的包装法

- 3. 梯度下降:重要参数max_iter

-

- 3.1 梯度下降求解逻辑回归

- 3.2 梯度下降的概念

- 3.3 步长的概念

-

- 3.3.1 以乳腺癌数据为例

- 4.二元回归与多元回归:重要参数solver & multi_class

- 5. 样本不平衡与参数class_weight

- 总结

前言

在菜菜老师课件的基础上进行添加一些自己的理解,代码运行等作为学习笔记

逻辑回归分类器(linear_model.LogisticRegression)

class sklearn.linear_model.LogisticRegression (penalty=’l2’, dual=False, tol=0.0001, C=1.0,

fit_intercept=True, intercept_scaling=1, class_weight=None, random_state=None, solver=’warn’, max_iter=100,multi_class=’warn’, verbose=0, warm_start=False, n_jobs=None)

1. 二元逻辑回归的损失函数

在学习决策树和随机森林时,我们曾经提到过两种模型表现:在训练集上的表现,和在测试集上的表现。我们建模,是追求模型在测试集上的表现最优,因此模型的评估指标往往是用来衡量模型在测试集上的表现的。然而,逻辑回归有着基于训练数据求解参数 θ \theta θ 的需求,并且希望训练出来的模型能够尽可能地拟合训练数据,即模型在训练集上的预测准确率越靠近100%越好。

因此,我们使用”损失函数“这个评估指标,来衡量参数为 θ \theta θ的模型拟合训练集时产生的信息损失的大小,并以此衡量参数 θ \theta θ的优劣。

- 如果用一组参数建模后,模型在训练集上表现良好,那我们就说模型拟合过程中的损失很小,损失函数的值很小,这一组参数就优秀;

- 如果模型在训练集上表现糟糕,损失函数就会很大,模型就训练不足,效果较差,这一组参数也就比较差。

即是说,我们在求解参数 θ \theta θ 时,追求损失函数最小,让模型在训练数据上的拟合效果最优,即预测准确率尽量靠近100%。

损失函数

-

衡量参数 的优劣的评估指标,用来求解最优参数的工具

-

损失函数小,模型在训练集上表现优异,拟合充分,参数优秀

-

损失函数大,模型在训练集上表现差劲,拟合不足,参数糟糕

-

我们追求,能够让损失函数最小化的参数组合

注意:没有”求解参数“需求的模型没有损失函数,比如KNN,决策树

逻辑回归的损失函数是由极大似然估计推导出来的(相关推导过程在二元逻辑回归的损失函数),具体结果可以写作:

J ( θ ) = − ∑ i = 1 m ( y i ∗ log ( y θ ( x i ) ) + ( 1 − y i ) ∗ log ( 1 − y θ ( x i ) ) ) J(\theta)=-\sum_{i=1}^{m}(y_i*\log(y_{\theta}(x_i))+(1-y_i)*\log(1-y_{\theta}(x_i))) J(θ)=−i=1∑m(yi∗log(yθ(xi))+(1−yi)∗log(1−yθ(xi)))

- θ : \theta: θ: 求解出来的一组参数

- m : m: m: 样本的个数

- y i : y_i: yi: 样本i上真实的标签

- y θ ( x i ) : y_{\theta}(x_i): yθ(xi): 样本i上,基于参数 θ \theta θ计算出来的逻辑回归返回值

- x i : x_i: xi: 样本i各个特征的取值

我们的目标,就是求解出使 J ( θ ) J(\theta) J(θ) 最小的 θ \theta θ 取值

注意:

- 在逻辑回归的本质函数y(x)里,特征矩阵x是自变量,参数是 θ \theta θ

- 在损失函数中,参数 θ \theta θ是损失函数的自变量,x和y都是已知的特征矩阵和标签,相当于是损失函数的参数

由于我们追求损失函数的最小值,让模型在训练集上表现最优,可能会引发另一个问题:如果模型在训练集上表示优秀,却在测试集上表现糟糕,模型就会过拟合。虽然逻辑回归和线性回归是天生欠拟合的模型,但我们还是需要控制过拟合的技术来帮助我们调整模型,对逻辑回归中过拟合的控制,通过正则化来实现。

2. 重要参数penalty & C

2.1 正则化

正则化是用来防止模型过拟合的过程,常用的有L1正则化和L2正则化两种选项,分别通过在损失函数后加上参数向量 θ \theta θ 的L1范式和L2范式的倍数来实现。这个增加的范式,被称为“正则项”,也被称为"惩罚项"。损失函数改变,基于损失函数的最优化来求解的参数取值必然改变,我们以此来调节模型拟合的程度。其中L1范式表现为参数向量中的每个参数的绝对值之和,L2范数表现为参数向量中的每个参数的平方和的开方值。

J ( θ ) L 1 = C ∗ J ( θ ) + ∑ j = 1 n ∣ θ j ∣ ( j ≥ 1 ) J(\theta)_{L1}=C*J(\theta)+\sum_{j=1}^{n}|\theta_j|~~~~(j\geq1) J(θ)L1=C∗J(θ)+j=1∑n∣θj∣ (j≥1)

J ( θ ) L 2 = C ∗ J ( θ ) + ∑ j = 1 n ( θ j ) 2 ( j ≥ 1 ) J(\theta)_{L2}=C*J(\theta)+\sqrt{\sum_{j=1}^{n}(\theta_j)^2}~~~~(j\geq1) J(θ)L2=C∗J(θ)+j=1∑n(θj)2 (j≥1)

- J ( θ ) : J(\theta): J(θ): 之前提过的损失函数

- C : C: C: 用来控制正则化程度的超参数

- n : n: n: 方程中特征的总数,也是方程中参数的总数

- j : j: j: 代表每个参数 ( 在这里,j要大于等于1,是因为我们的参数向量 θ \theta θ中,第一个参数是 θ 0 \theta_0 θ0,是我们的截距,它通常是不参与正则化的。)

在一些书和博客上可能会看见下面这种写法:

J ( θ ) L 1 = J ( θ ) + 1 2 b 2 ∑ j ∣ θ j ∣ J(\theta)_{L1}=J(\theta)+\frac{1}{2b^2}\sum_{j}|\theta_j| J(θ)L1=J(θ)+2b21j∑∣θj∣

J ( θ ) L 2 = J ( θ ) + θ T θ 2 σ 2 J(\theta)_{L2}=J(\theta)+\frac{\theta^T\theta}{2\sigma^2} J(θ)L2=J(θ)+2σ2θTθ

这两种式子的本质是一样的,不过在大多数教材和博客中,常数项是乘以正则项,通过调控正则项来调节对模型的惩罚。而sklearn当中,常数项C是在损失函数的前面,通过调控损失函数本身的大小,来调节对模型的惩罚。

L1正则化和L2正则化虽然都可以控制过拟合,但它们的效果并不相同。当正则化强度逐渐增大(即C逐渐变小),参数 θ \theta θ 的取值会逐渐变小,但L1正则化会将参数压缩为0,L2正则化只会让参数尽量小,不会取到0。

-

L1正则化在逐渐加强的过程中

携带信息量小的、对模型贡献不大的特征的参数,会比携带大量信息的、对模型有巨大贡献的特征的参数更快地变成0,所以L1正则化本质是一个特征选择的过程,掌管了参数的“稀疏性”。L1正则化越强,参数向量中就越多的参数为0,参数就越稀疏,选出来的特征就越少,以此来防止过拟合。因此,如果特征量很大,数据维度很高,我们会倾向于使用L1正则化。由于L1正则化的这个性质,逻辑回归的特征选择可以由Embedded嵌入法来完成。 -

L2正则化在加强的过程中

会尽量让每个特征对模型都有一些小的贡献,但携带信息少,对模型贡献不大的特征的参数会非常接近于0。通常来说,如果我们的主要目的只是为了防止过拟合,选择L2正则化就足够了。但是如果选择L2正则化后还是过拟合,模型在未知数据集上的效果表现很差,就可以考虑L1正则化。

而两种正则化下C的取值,都可以通过学习曲线来进行调整。

下面建立两个逻辑回归,来看一下L1正则化和L2正则化:

1.导入库

import numpy as np

import pandas as pd

import matplotlib.pyplot as plt

from sklearn.datasets import load_breast_cancer #乳腺癌数据集

from sklearn.linear_model import LogisticRegression as LR #逻辑回归

from sklearn.model_selection import train_test_split #划分数据集

from sklearn.metrics import accuracy_score # 预测值和真实值之间的差距,就是准确率,评分

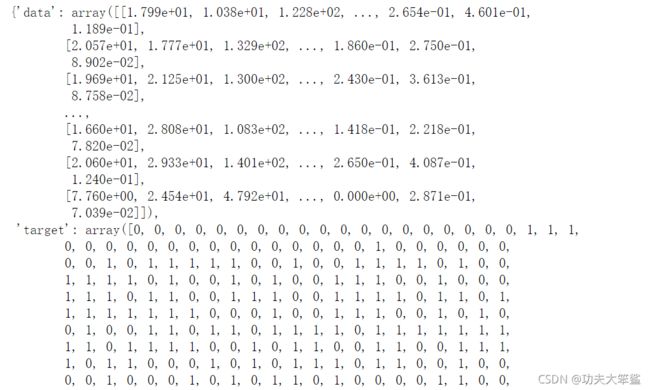

2. 导入数据

data = load_breast_cancer()

x = data.data

y = data.target

x.shape

>(569, 30)

3. 建立L1,L2两个正则化的实例化并训练

#solver='liblinear'和max_iter=1000在下面详细讲解

lrl1 = LR(penalty='l1',solver='liblinear',C=0.5,max_iter=1000)

lrl2 = LR(penalty='l2',solver='liblinear',C=0.5,max_iter=1000)

lrl1.fit(x,y)

lrl2.fit(x,y)

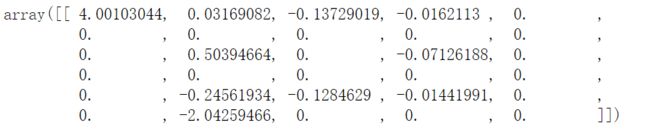

4. 逻辑回归的重要属性coef_:查看每个特征所对应参数

-

L1正则化:

lrl1.coef_lrl1.coef_ != 0(lrl1.coef_ != 0).sum() >10 -

L2正则化

lrl2.coef_

可以观察出,当我们选择L1正则化的时候,许多特征的参数都被设置为了0,这些特征在真正建模的时候,就不会出现在我们的模型当中了,而L2正则化则是对所有的特征都给出了参数。

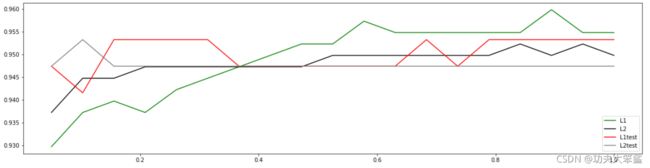

5. 使用学习曲线查看

l1 = []

l2 = []

l1test = []

l2test = []

xtrain, xtest, ytrain, ytest = train_test_split(x,y,test_size=0.3,random_state=500)

for i in np.linspace(0.05,1,19):

lrl1 = LR(penalty='l1',solver='liblinear',C=i,max_iter=1000)

lrl2 = LR(penalty='l2',solver='liblinear',C=i,max_iter=1000)

#accuracy_score就是获得评分

#理解成将预测出的y和原本的y进行一个对比评分

lrl1 = lrl1.fit(xtrain,ytrain)

l1.append(accuracy_score(lrl1.predict(xtrain),ytrain))

l1test.append(accuracy_score(lrl1.predict(xtest),ytest))

lrl2 = lrl2.fit(xtrain,ytrain)

l2.append(accuracy_score(lrl2.predict(xtrain),ytrain))

l2test.append(accuracy_score(lrl2.predict(xtest),ytest))

graph = [l1,l2,l1test,l2test]

color = ['green','black','red','gray']

label = ['L1','L2','L1test','L2test']

plt.figure(figsize=[20,5])

for i in range(len(graph)):

plt.plot(np.linspace(0.05,1,19),graph[i],color[i],label=label[i])

plt.legend(loc=4)#图例的位置在哪里?4表示,右下角

plt.show()

随着C的逐渐变大,正则化的强度越来越小,模型在训练集和测试集上的表现都呈上升趋势,对于L1直到C=0.8左右,训练集上的表现依然在走高,但模型在未知数据集上的表现开始不变,这时候就是容易出现了过拟合,对于L2,应选择C=0.2左右。

在实际使用时,基本就默认使用l2正则化,如果感觉到模型的效果不好,那就换L1试试看。

2.2 逻辑回归中的特征工程

当特征的数量很多的时候,我们出于业务考虑,也出于计算量的考虑,希望对逻辑回归进行特征选择来降维。比如,在判断一个人是否会患乳腺癌的时候,医生如果看5~8个指标来确诊,会比需要看30个指标来确诊容易得多。

2.2.1 业务选择

说到降维和特征选择,首先要想到的是利用自己的业务能力进行选择,肉眼可见明显和标签有关的特征就是需要留下的。当然,如果我们并不了解业务,或者有成千上万的特征,那我们也可以使用算法来帮助我们。或者,可以让算法先帮助我们筛选过一遍特征,然后在少量的特征中,我们再根据业务常识来选择更少量的特征。

2.2.2 PCA和SVD一般不用

说到降维,我们首先想到的是之前提过的高效降维算法,PCA和SVD,遗憾的是,这两种方法大多数时候不适用于逻辑回归。逻辑回归是由线性回归演变而来,线性回归的一个核心目的是通过求解参数来探究特征X与标签y之间的关系,而逻辑回归也传承了这个性质,我们常常希望通过逻辑回归的结果,来判断什么样的特征与分类结果相关,因此我们希望保留特征的原貌。PCA和SVD的降维结果是不可解释的,因此一旦降维后,我们就无法解释特征和标签之间的关系了。当然,在不需要探究特征与标签之间关系的线性数据上,降维算法PCA和SVD也是可以使用的。

2.2.3 可以使用统计方法(非必要)

既然降维算法不能使用,我们要用的就是特征选择方法。逻辑回归对数据的要求低于线性回归,由于我们不是使用最小二乘法来求解,所以逻辑回归对数据的总体分布和方差没有要求,也不需要排除特征之间的共线性,但如果我们确实希望使用一些统计方法,比如方差,卡方,互信息等方法来做特征选择,也并没有问题。过滤法中所有的方法,都可以用在逻辑回归上。

统计学的思路是一种“先验”的思路,不管做什么都要先”检验“,先”满足条件“,事后也要各种”检验“,以确保各种数学假设被满足,不然的话,理论上就无法得出好结果。而机器学习是一种”后验“的思路,不管三七二十一,先让模型跑一跑,效果不好再想办法,如果模型效果好,不在意什么共线性,残差不满足正态分布,没有哑变量之类的细节,模型效果好大过天!

2.2.4 高效的嵌入法embedded(嵌入法详细看特征选择中的嵌入法)

更有效的方法,毫无疑问会是我们的embedded嵌入法。我们已经说明了,由于L1正则化会使得部分特征对应的参数为0,因此L1正则化可以用来做特征选择,结合嵌入法的模块SelectFromModel,我们可以很容易就筛选出让模型十分高效的特征。注意,此时我们的目的是,尽量保留原数据上的信息,让模型在降维后的数据上的拟合效果保持优秀,因此我们不考虑训练集测试集的问题,把所有的数据都放入模型进行降维。

以乳腺癌数据集为例:

1.导入包

import numpy as np

import pandas as pd

import matplotlib.pyplot as plt

from sklearn.linear_model import LogisticRegression as LR # 逻辑回归

from sklearn.model_selection import cross_val_score #交叉验证

from sklearn.datasets import load_breast_cancer #乳腺癌数据集

from sklearn.feature_selection import SelectFromModel #嵌入法特征选择

2. 数据的导入

data = load_breast_cancer()

x = data.data

y = data.target

x.shape

>(569, 30)

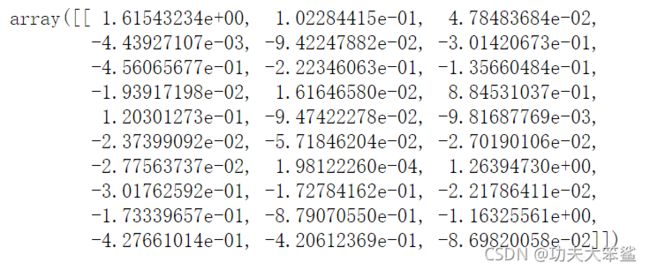

3. 使用逻辑回归进行评分(默认是l2正则化)

C使用的是上面2.1.5的得出的结论,0.2

LR_ = LR(solver='liblinear',C=0.2,random_state=500)

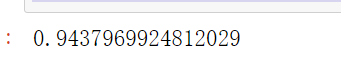

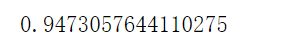

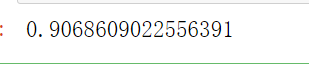

cross_val_score(LR_,x,y,cv=10).mean()

4. 使用嵌入法特征选择

#norm_order=1说明使用的是L1范式,模型会删除在L1范式下面无效的特征

x_embedded = SelectFromModel(LR_,norm_order=1).fit_transform(x,y)

x_embedded.shape

>(569, 10)

cross_val_score(LR_,x_embedded,y,cv=10).mean()

可以看出,虽然分数下降了一点,但是特征还保留了10个,删除了20个特征,如果我们要求不高,在这里其实就可以停下了。但是,能否让模型的拟合效果更好呢?在这里,有两种调整方式:

-

调节SelectFromModel这个类中的参数threshold

这是嵌入法的阈值,表示删除所有参数的绝对值低于这个阈值的特征。现在threshold默认为None,所以SelectFromModel只根据L1正则化的结果来选择了特征,即选择了所有L1正则化后参数不为0的特征。

我们此时,只要调整threshold的值(画出threshold的学习曲线),就可以观察不同的threshold下模型的效果如何变化。一旦调整threshold,就不是在使用L1正则化选择特征,而是使用模型的属性.coef_中生成的各个特征的系数来选择。coef_虽然返回的是特征的系数,但是系数的大小和决策树中的feature_ importances_以及降维算法中的可解释性方差explained_vairance_概念相似,其实都是衡量特征的重要程度和贡献度的,因此SelectFromModel中的参数threshold可以设置为coef_的阈值,即可以剔除系数小于threshold中输入的数字的所有特征

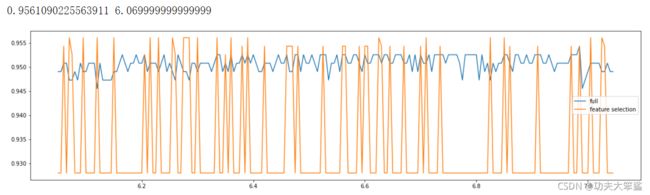

#分别储存没使用嵌入法特征选择的x和使用嵌入法特征选择后的x fullx = [] fsx = [] threshold = np.linspace(0,abs(LR_.fit(x,y).coef_).max(),20) for i in threshold: x_embedded = SelectFromModel(LR_,threshold=i).fit_transform(x,y) #将未特征选择和进行特征选择的x,使用交叉验证得出评分 fullx.append(cross_val_score(LR_,x,y,cv=10).mean()) fsx.append(cross_val_score(LR_,x_embedded,y,cv=10).mean()) #输出threshold和其对应的剩余特征个数 print(i,x_embedded.shape[1]) plt.figure(figsize=[20,5]) plt.plot(threshold,fullx,label='full') plt.plot(threshold,fsx,label='feature selection') plt.xticks(threshold) plt.legend() plt.show()

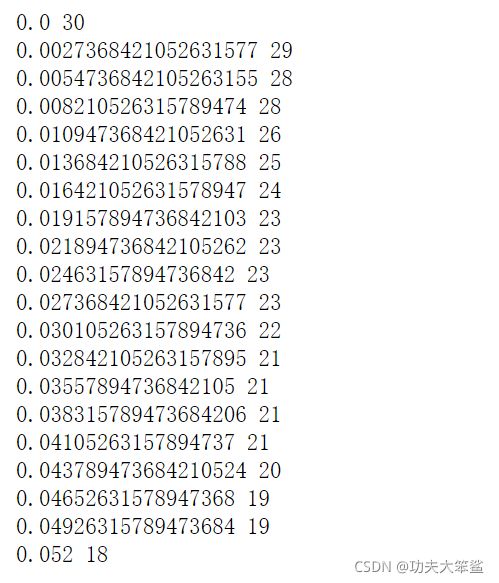

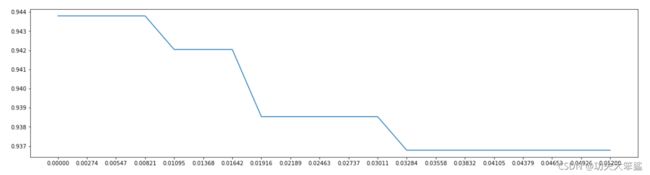

当threshold越来越大,被删除的特征越来越多,模型的效果也越来越差,可以看出,保存18个特征模型效果还可以,接下来进行学习曲线的优化fsx = [] threshold = np.linspace(0,0.052,20) for i in threshold: x_embedded = SelectFromModel(LR_,threshold=i).fit_transform(x,y) fsx.append(cross_val_score(LR_,x_embedded,y,cv=10).mean()) print(i,x_embedded.shape[1]) plt.figure(figsize=[20,5]) plt.plot(threshold,fsx) plt.xticks(threshold) plt.show()

如果要保证模型的效果比降维前更好,我们需要保留28个特征,这对于现实情况来说,是一种无效的降维:需要30个指标来判断病情,和需要25个指标来判断病情,对医生来说区别不大。 -

第二种调整方法,是调逻辑回归的类LR_,通过画C的学习曲线来实现:

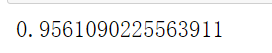

fullx = [] fsx = [] c = np.arange(0.01,10.01,0.5) for i in c: LR_ = LR(solver='liblinear',C=i,random_state=500) #使用没用嵌入法降维的x fullx.append(cross_val_score(LR_,x,y,cv=10).mean()) #使用嵌入法降维 x_embedded = SelectFromModel(LR_,norm_order=1).fit_transform(x,y) fsx.append(cross_val_score(LR_,x_embedded,y,cv=10).mean()) #得出最高的评分及相应的C值 print(max(fsx),c[fsx.index(max(fsx))]) plt.figure(figsize=[20,5]) plt.plot(c,fullx,label='full') plt.plot(c,fsx,label='feature selection') plt.legend() plt.show()fullx = [] fsx = [] c = np.arange(6.05,7.05,0.005) for i in c: LR_ = LR(solver='liblinear',C=i,random_state=500) #使用没用嵌入法降维的x fullx.append(cross_val_score(LR_,x,y,cv=10).mean()) #使用嵌入法降维,使用L1范式来进行特征选择 x_embedded = SelectFromModel(LR_,norm_order=1).fit_transform(x,y) fsx.append(cross_val_score(LR_,x_embedded,y,cv=10).mean()) #得出最高的评分及相应的C值 print(max(fsx),c[fsx.index(max(fsx))]) plt.figure(figsize=[20,5]) plt.plot(c,fullx,label='full') plt.plot(c,fsx,label='feature selection') plt.legend() plt.show()

5. 验证模型效果

-

降维之前

LR_ = LR(solver='liblinear',C=6.069999999999999,random_state=500) cross_val_score(LR_,x,y,cv=10).mean() -

降维之后

x_embedded = SelectFromModel(LR_,norm_order=1).fit_transform(x,y) cross_val_score(LR_,x_embedded,y,cv=10).mean() -

降维之后的特征数量

x_embedded.shape

这样我们就实现了在特征选择的前提下,保持模型拟合的高效,现在,如果有一位医生可以来为我们指点迷津,看看剩下的这些特征中,有哪些是对针对病情来说特别重要的,也许我们还可以继续降维。当然,除了嵌入法,系数累加法或者包装法也是可以使用的

2.2.5 比较麻烦的系数累加法

系数累加法的原理非常简单。在PCA中,我们通过绘制累积可解释方差贡献率曲线来选择超参数,在逻辑回归中我们可以使用系数coef_来这样做,并且我们选择特征个数的逻辑也是类似的:找出曲线由锐利变平滑的转折点,转折点之前被累加的特征都是我们需要的,转折点之后的我们都不需要。不过这种方法相对比较麻烦,因为我们要先对特征系数进行从大到小的排序,还要确保我们知道排序后的每个系数对应的原始特征的位置,才能够正确找出那些重要的特征。如果要使用这样的方法,不如直接使用嵌入法来得方便。

2.2.6 简单快速的包装法

相对的,包装法可以直接设定我们需要的特征个数,逻辑回归在现实中运用时,可能会有”需要5~8个变量”这种需求,包装法此时就非常方便了。不过逻辑回归的包装法的使用和其他算法一样,并不具有特别之处,因此在这里就不在赘述,包装法具体参考特征选择中的包装法。

3. 梯度下降:重要参数max_iter

逻辑回归的数学目的是求解能够让模型最优化,拟合程度最好的参数 θ \theta θ 的值,即求解能够让损失函数 J ( θ ) J(\theta) J(θ) 最小化的值。对于二元逻辑回归来说,有多种方法可以用来求解参数 ,最常见的有梯度下降法(Gradient Descent),坐标下降法(Coordinate Descent),牛顿法(Newton-Raphson method)等,其中又以梯度下降法最为著名。这些计算在执行的任务其实是类似的。

3.1 梯度下降求解逻辑回归

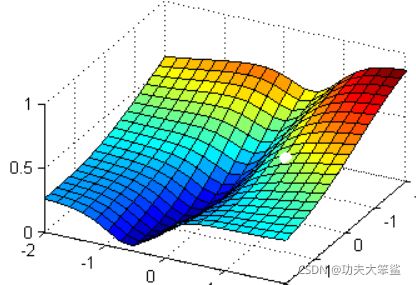

我们以最著名也最常用的梯度下降法为例,来看看逻辑回归的参数求解过程究竟实在做什么。现在有一个带两个特征并且没有截距的逻辑回归 y ( x 1 , x 2 ) y(x_1,x_2) y(x1,x2),两个特征所对应的参数分别为 [ θ 1 , θ 2 ] [\theta_1,\theta_2] [θ1,θ2]。下面这个华丽的平面就是我们的损失函数 J ( θ 1 , θ 2 ) J(\theta_1,\theta_2) J(θ1,θ2) 在以 θ 1 , θ 2 \theta_1,\theta_2 θ1,θ2 和 J为坐标轴的三维立体坐标系上的图像。现在,我们寻求的是损失函数的最小值,也就是图像的最低点。

在这个图像上随机放一个小球,当松手的时候,这个小球就会顺着这个华丽的平面滚落,直到滚到深蓝色的区域——损失函数的最低点。为了严格监控这个小球的行为,我让小球每次滚动的距离有限,不让他一次性滚到最低点,并且最多只允许它滚动100步,还要记下它每次滚动的方向,直到它滚到图像上的最低点。

可以想到,小球从高处滑落,在深蓝色的区域中来回震荡,最终停留在了图像凹陷处的某个点上。非常明显,我们可以观察到几个现象:

首先,小球并不是一开始就直向着最低点去的,它先一口气冲到了蓝色区域边缘,后来又折回来,我们已经规定了小球是多次滚动,所以可见,小球每次滚动的方向都是不同的。

另外,小球在进入深蓝色区域后,并没有直接找到某个点,而是在深蓝色区域中来回震荡了数次才停下。这有两种可能:1) 小球已经滚到了图像的最低点,所以停下了,2) 由于我设定的步数限制,小球还没有找到最低点,但也只好在100步的时候停下了。也就是说,小球不一定滚到了图像的最低处。

但无论如何,小球停下的就是我们在现有状况下可以获得的唯一点了。如果我们够幸运,这个点就是图像的最低点,那我们只要找到这个点的对应坐标 ( θ 1 ∗ , θ 2 ∗ , J m i n ) (\theta_1^*,\theta_2^*,J_{min}) (θ1∗,θ2∗,Jmin),就可以获取能够让损失函数最小的参数取值 [ θ 1 ∗ , θ 2 ∗ ] [\theta_1^*,\theta_2^*] [θ1∗,θ2∗]了。如此,梯度下降的过程就已经完成。

在这个过程中,小球其实就是一组组的坐标点 ( θ 1 , θ 2 , J ) (\theta_1,\theta_2,J) (θ1,θ2,J) ;小球每次滚动的方向就是那一个坐标点的梯度向量的方向,因为每滚动一步,小球所在的位置都发生变化,坐标点和坐标点对应的梯度向量都发生了变化,所以每次滚动的方向也都不一样;人为设置的100次滚动限制,就是sklearn中逻辑回归的参数max_iter,代表着能走的最大步数,即最大迭代次数。

所以梯度下降,其实就是在众多 [ θ 1 , θ 2 ] [\theta_1,\theta_2] [θ1,θ2] 可能的值中遍历,一次次求解坐标点的梯度向量,不断让损失函数的取值 J J J逐渐逼近最小值,再返回这个最小值对应的参数取值 [ θ 1 ∗ , θ 2 ∗ ] [\theta_1^*,\theta_2^*] [θ1∗,θ2∗] 的过程。

3.2 梯度下降的概念

那梯度究竟如何定义呢?在多元函数上对各个自变量求∂偏导数,把求得的各个自变量的偏导数以向量的形式写出来,就是梯度。比如损失函数 J ( θ 1 , θ 2 ) J(\theta_1,\theta_2) J(θ1,θ2),其自变量是逻辑回归预测函数 y θ ( x ) y_{\theta}(x) yθ(x)的参数 θ 1 , θ 2 \theta_1,\theta_2 θ1,θ2 ,在损失函数上对 θ 1 , θ 2 \theta_1,\theta_2 θ1,θ2求偏导数,求得的梯度向量 d d d就是 [ ∂ J ∂ θ 1 , ∂ J ∂ θ 2 ] T [\frac{\partial J}{\partial \theta_1},\frac{\partial J}{\partial \theta_2}]^T [∂θ1∂J,∂θ2∂J]T,简称 g r a d J ( θ 1 , θ 2 ) grad J(\theta_1,\theta_2) gradJ(θ1,θ2)或者 ∇ J ( θ 1 , θ 2 ) \nabla J(\theta_1,\theta_2) ∇J(θ1,θ2) 。在 θ 1 , θ 2 \theta_1,\theta_2 θ1,θ2和 J J J的取值构成的坐标系上,点 ( θ 1 ∗ , θ 2 ∗ , J ) (\theta_1^*,\theta_2^*,J) (θ1∗,θ2∗,J)具体的梯度向量就是 [ ∂ J ∂ θ 1 ∗ , ∂ J ∂ θ 2 ∗ ] T [\frac{\partial J}{\partial \theta_1^*},\frac{\partial J}{\partial \theta_2^*}]^T [∂θ1∗∂J,∂θ2∗∂J]T,或者 ∇ J ( θ 1 ∗ , θ 2 ∗ ) \nabla J(\theta_1^*,\theta_2^*) ∇J(θ1∗,θ2∗)。如果是3个参数的梯度向量,就是 [ ∂ J ∂ θ 1 , ∂ J ∂ θ 2 , ∂ J ∂ θ 3 ] T [\frac{\partial J}{\partial \theta_1},\frac{\partial J}{\partial\theta_2},\frac{\partial J}{\partial \theta_3}]^T [∂θ1∂J,∂θ2∂J,∂θ3∂J]T,以此类推。

注意:

求解梯度,是在损失函数 J ( θ 1 , θ 2 ) J(\theta_1,\theta_2) J(θ1,θ2)上对损失函数自身的自变量 θ 1 \theta_1 θ1和 θ 2 \theta_2 θ2 求偏导,而这两个自变量,刚好是逻辑回归的预测函数 y ( x ) = 1 1 + e − θ T x y(x)=\frac{1}{1+e^{-\theta^Tx}} y(x)=1+e−θTx1的参数。

那梯度有什么含义呢?

梯度是一个向量,因此它有大小也有方向。它的大小,就是偏导数组成的向量的大小,又叫做向量模,记作 d d d 。它的方向,几何上来说,就是损失函数 J ( θ ) J(\theta) J(θ)的值增加最快的方向,就是小球每次滚动的方向的反方向。只要沿着梯度向量的反方向移动坐标,损失函数 J ( θ ) J(\theta) J(θ) 的取值就会减少得最快,也就最容易找到损失函数的最小值。

在逻辑回归中,损失函数是:

J ( θ ) = − ∑ i = 1 m ( y i ∗ log ( y θ ( x i ) ) + ( 1 − y i ) ∗ log ( 1 − y θ ( x i ) ) ) J(\theta)=-\sum_{i=1}^{m}(y_i*\log(y_{\theta}(x_i))+(1-y_i)*\log(1-y_{\theta}(x_i))) J(θ)=−i=1∑m(yi∗log(yθ(xi))+(1−yi)∗log(1−yθ(xi)))

我们对这个函数上的自变量 θ \theta θ 求偏导,就可以得到梯度向量在第 j j j组 θ \theta θ的坐标点上的表示形式(详细推导过程看梯度向量的推导):

∂ J ( θ ) ∂ θ j = d j = ∑ i = 1 m ( x i × ( y θ ( x i ) − y i ) ) \frac{\partial J(\theta)}{\partial \theta_j}=d_j=\sum_{i=1}^{m}(x_i×(y_{\theta}(x_i)-y_i)) ∂θj∂J(θ)=dj=i=1∑m(xi×(yθ(xi)−yi))

在这个公式下,只要给定一组 θ \theta θ的取值 θ j \theta_j θj ,再带入特征矩阵 x x x,就可以求得这一组 θ \theta θ 取值下的预测结果 y θ ( x i ) y_{\theta}(x_i) yθ(xi),结合真实标签向量 y i y_i yi ,就可以获得这一组 θ j \theta_j θj取值下的梯度向量,其大小表示为 d j d_j dj。之前说过,我们的目的是在可能的 θ \theta θ取值上进行遍历,一次次计算梯度向量,并在梯度向量的反方向上让损失函数 J J J下降至最小值。在这个过程中,我们的 θ \theta θ 和梯度向量的大小 d d d 都会不断改变,而我们遍历 θ \theta θ 的过程可以描述为:

(梯度下降表示)

θ j + 1 = θ j − α ∗ d j = θ j − α ∗ ∑ i = 1 m ( y θ ( x i ) − y i ) x i \begin{aligned} \theta_{j+1}&=\theta_j-\alpha * d_j \\&=\theta_j-\alpha * \sum_{i=1}^{m}(y_{\theta}(x_i)-y_i)x_i \end{aligned} θj+1=θj−α∗dj=θj−α∗i=1∑m(yθ(xi)−yi)xi

- θ j + 1 : \theta_{j+1}: θj+1: 第j次迭代后的参数向量

- θ j : \theta_j: θj: 第j次迭代的参数向量

- α : \alpha: α: 步长,控制着每走一步(每迭代一次)后 θ \theta θ的变化,并以此来影响每次迭代后的梯度向量的大 ~~~~~~ 小和方向。

3.3 步长的概念

关于步长的说法,是”梯度下降中每一步沿梯度的反方向前进的长度“,”沿着最陡峭最易下山的位置走的那一步的长度“或者”梯度下降中每一步损失函数减小的量“,甚至有说,步长是二维平面著名的求导三角形中的”斜边“或者“对边”的,这些说法都是错误的。

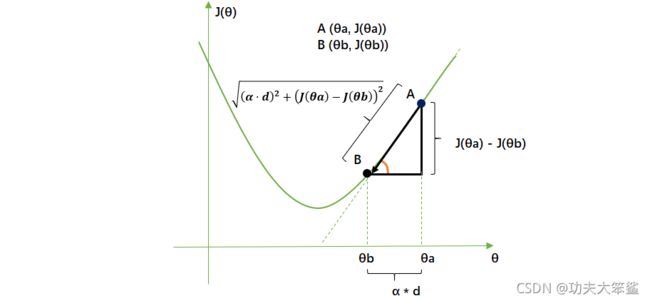

来看下面这一张二维平面的求导三角型图。类比到我们的损失函数和梯度概念上,图中的抛物线就是我们的损失函数 J ( θ ) J(\theta) J(θ) , A ( θ a , J ( θ a ) ) A(\theta_a,J(\theta_a)) A(θa,J(θa)) 就是小球最初在的位置, B ( θ b , J ( θ b ) ) B(\theta_b,J(\theta_b)) B(θb,J(θb)) 就是一次滚动后小球移动到的位置。从A到B的方向就是梯度向量的反方向,指向损失函数在A点下降最快的方向。而梯度向量的大小是点A在图像上对 θ \theta θ 求导后的结果,也是点A切线方向的斜率,橙色角的tan结果,记作 d : d: d:

梯度下降每走一步,损失函数减小的量,是损失函数在 变化之后的取值的变化,写作 J ( θ b ) − J ( θ a ) J(\theta_b)-J(\theta_a) J(θb)−J(θa),这是二维平面的求导三角型中的“对边”。

梯度下降每走一步,参数向量的变化,写作 θ a − θ b \theta_a-\theta_b θa−θb ,根据我们参数向量的迭代公式,就是我们的 步长 × 梯度向量的大小,记作 α ∗ d \alpha * d α∗d,这是二维平面的求倒三角形中的“邻边”。

梯度下降中每走一步,下降的距离,是 ( α ∗ d ) 2 + ( J ( θ a ) − J ( θ b ) ) 2 \sqrt{(\alpha * d)^2+(J(\theta_a)-J(\theta_b))^2} (α∗d)2+(J(θa)−J(θb))2 ,是对边和邻边的根号下平方和,是二维平面的求导三角型中的”斜边“

所以,步长不是任何物理距离,它甚至不是梯度下降过程中任何距离的直接变化,它是梯度向量的大小 d d d上的一个比例,影响着参数向量 θ \theta θ 每次迭代后改变的部分。

不难发现,既然参数迭代是靠梯度向量的大小 * 步长 来实现的,而 J ( θ ) J(\theta) J(θ) 的降低又是靠调节 θ \theta θ 来实现的,所以步长可以调节损失函数下降的速率。在损失函数降低的方向上,步长越长, θ \theta θ的变动就越大。相对的,步长如果很短, θ \theta θ的每次变动就很小。具体地说:

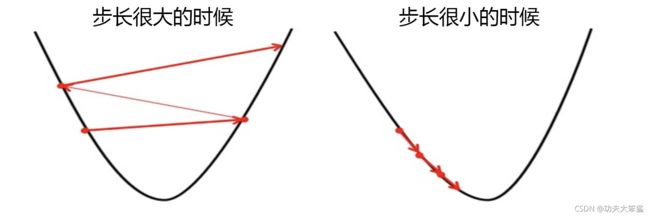

- 如果步长太大,损失函数下降得就非常快,需要的迭代次数就很少,但梯度下降过程可能跳过损失函数的最低点,无法获取最优值。

- 而步长太小,虽然函数会逐渐逼近我们需要的最低点,但迭代的速度却很缓慢,迭代次数就需要很多。

在小球运动时注意到,小球在进入深蓝色区域后,并没有直接找到某个点,而是在深蓝色区域中来回震荡了数次才停下,这种”震荡“其实就是因为我们设置的步长太大的缘故。但是在我们开始梯度下降之前,我们并不知道什么样的步长才合适,但梯度下降一定要在某个时候停止才可以,否则模型可能会无限地迭代下去。因此,在sklearn当中,我们设置参数max_iter最大迭代次数来代替步长,帮助我们控制模型的迭代速度并适时地让模型停下。max_iter越大,代表步长越小,模型迭代时间越长,反之,则代表步长设置很大,模型迭代时间很短。

迭代结束,获取到 J ( θ ) J(\theta) J(θ) 的最小值后,我们就可以找出这个最小值对应的参数向量 θ \theta θ ,逻辑回归的预测函数也就可以根据这个参数向量 θ \theta θ 来建立了。

3.3.1 以乳腺癌数据为例

1.导入库

import numpy as np

import pandas as pd

import matplotlib.pyplot as plt

from sklearn.datasets import load_breast_cancer #乳腺癌数据集

from sklearn.metrics import accuracy_score #评分,将预测的值与真实值进行对比评分

from sklearn.linear_model import LogisticRegression as LR #逻辑回归

from sklearn.model_selection import train_test_split #划分训练集和测试集

2.导入数据

data = load_breast_cancer()

x = data.data

y = data.target

3.max_iter不同值,训练集和测试集的预测值评分对比

xtrain, xtest, ytrain, ytest = train_test_split(x,y,test_size=0.3,random_state=300)

l2 = []

l2test = []

for i in range(1,101,10):

lrl2 = LR(penalty='l2',solver='liblinear',C=0.2,max_iter=i)

lrl2.fit(xtrain,ytrain)

#accuracy_score就是将预测值与真实值比较,得出评分

l2.append(accuracy_score(lrl2.predict(xtrain),ytrain))

l2test.append(accuracy_score(lrl2.predict(xtest),ytest))

plt.figure(figsize=[20,5])

plt.plot(range(1,101,10),l2,color='black',label='L2')

plt.plot(range(1,101,10),l2test,color='gray',label='L2test')

plt.legend(loc=4)

plt.xticks(range(1,101,10))

plt.show()

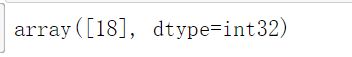

4.使用属性.n_iter_来调用本次求解中真正实现的迭代次数

lr = LR(penalty='l2',solver='liblinear',C=0.2,max_iter=21).fit(xtrain,ytrain)

lr.n_iter_

可以看出,迭代次数为18时就可以找到损失函数最小的了,准确率最高

#评分

accuracy_score(lr.predict(xtrain),ytrain)

>0.957286432160804

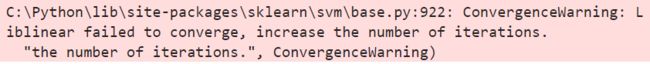

5.可能会弹出红色警告

当max_iter中限制的步数已经走完了,逻辑回归却还没有找到损失函数的最小值,参数 的值还没有被收敛,sklearn就会弹出这样的红色警告:

虽然写法看起来略有不同,但其实都是一个含义,**这是在提醒我们:参数没有收敛,请增大max_iter中输入的数字。**但我们不一定要听sklearn的。max_iter很大,意味着步长小,模型运行得会更加缓慢。虽然我们在梯度下降中追求的是损失函数的最小值,但这也可能意味着我们的模型会过拟合(在训练集上表现得太好,在测试集上却不一定),因此,如果在max_iter报红条的情况下,模型的训练和预测效果都已经不错了,那我们就不需要再增大max_iter中的数目了,毕竟一切都以模型的预测效果为基准。

4.二元回归与多元回归:重要参数solver & multi_class

之前我们对逻辑回归的讨论,都是针对二分类的逻辑回归展开,其实sklearn提供了多种可以使用逻辑回归处理多分类问题的选项。

- 我们可以把某种分类类型都看作1,其余的分类类型都为0值,和”数据预处理“中的二值化的思维类似,这种方法被称为 “一对多(One-vs-rest)”,简称OvR,在sklearn中表示为“ovr"。

- 又或者,我们可以把好几个分类类型划为1,剩下的几个分类类型划为0值,这是一种”多对多(Many-vs-Many)"的方法,简称MvM,在sklearn中表示为"Multinominal"。每种方式都配合L1或L2正则项来使用。

在sklearn中,我们使用参数multi_class来告诉模型,我们的预测标签是什么样的类型。

- ovr : 表示分类问题是二分类,或让模型使用"一对多"的形式来处理多分类问题。

- multinomial : 表示处理多分类问题,这种输入在参数solver是’liblinear’时不可用。

- auto : 表示会根据数据的分类情况和其他参数来确定模型要处理的分类问题的类型。比如说,如果数据是二分类,或者solver的取值为"liblinear",“auto"会默认选择"ovr”。反之,则会选择"nultinomial"。

注意:默认值将在0.22版本中从"ovr"更改为"auto"。

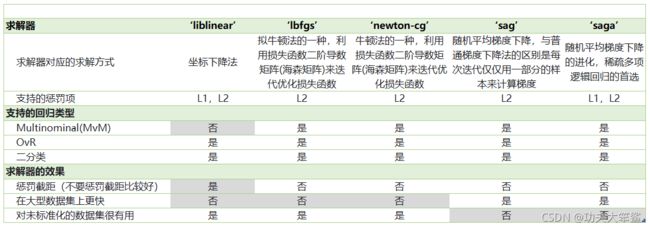

我们之前提到的梯度下降法,只是求解逻辑回归参数 θ \theta θ 的一种方法,并且我们只讲解了求解二分类变量的参数时的各种原理。sklearn为我们提供了多种选择,让我们可以使用不同的求解器来计算逻辑回归。求解器的选择,由参数"solver"控制,共有五种选择。其中“liblinear”是二分类专用,也是现在的默认求解器。

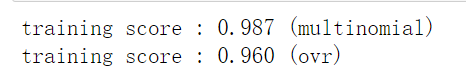

通过鸢尾花数据集来看看multinomial和ovr的区别

from sklearn.linear_model import LogisticRegression as LR #逻辑回归

from sklearn.datasets import load_iris

iris = load_iris()

#打印两种multi_class模式下的训练分数

for multi_class in ('multinomial','ovr'):

lr = LR(solver='sag',max_iter=100,random_state=500,multi_class=multi_class)

lr = lr.fit(iris.data,iris.target)

print("training score : %.3f (%s)" % (lr.score(iris.data, iris.target), multi_class))

5. 样本不平衡与参数class_weight

样本不平衡是指在一组数据集中,标签的一类天生占有很大的比例,或误分类的代价很高,即我们想要捕捉出某种特定的分类的时候的状况。

什么情况下误分类的代价很高?例如,我们现在要对潜在犯罪者和普通人进行分类,如果没有能够识别出潜在犯罪者,那么这些人就可能去危害社会,造成犯罪,识别失败的代价会非常高,但如果,我们将普通人错误地识别成了潜在犯罪者,代价却相对较小。所以我们宁愿将普通人分类为潜在犯罪者后再人工甄别,但是却不愿将潜在犯罪者分类为普通人,有种"宁愿错杀不能放过"的感觉。

再比如说,在银行要判断“一个新客户是否会违约”,通常不违约的人vs违约的人会是99:1的比例,真正违约的人其实是非常少的。这种分类状况下,即便模型什么也不做,全把所有人都当成不会违约的人,正确率也能有99%,这使得模型评估指标变得毫无意义,根本无法达到我们的“要识别出会违约的人”的建模目的。

因此我们要使用参数class_weight对样本标签进行一定的均衡,给少量的标签更多的权重,让模型更偏向少数类,向捕获少数类的方向建模。该参数默认None,此模式表示自动给与数据集中的所有标签相同的权重,即自动1: 1。当误分类的代价很高的时候,我们使用”balanced“模式,我们只是希望对标签进行均衡的时候,什么都不填就可以解决样本不均衡问题。

但是,sklearn当中的参数class_weight变幻莫测,大家用模型跑一跑就会发现,我们很难去找出这个参数引导的模型趋势,或者画出学习曲线来评估参数的效果,因此可以说是非常难用。我们有着处理样本不均衡的各种方法,其中主流的是采样法,是通过重复样本的方式来平衡标签,可以进行上采样(增加少数类的样本),比如SMOTE,或者下采样(减少多数类的样本)。对于逻辑回归来说,上采样是最好的办法。

在评分卡案例中,会学习到如何在逻辑回归中使用上采样。

总结

具体参数,属性,接口参考逻辑回归参数,属性,接口列表