[论]【SATP-GAN】 self-attention based generative adversarial network for traffic flow prediction

SATP-GAN: self-attention based generative adversarial network for traffic flow prediction

原文:见这里

作者:Liang Zhang,Jianqing Wu,Jun Shen,Ming Chen,Rui Wang,Xinliang Zhou,Cankun Xu,Quankai Yao,Qiang Wu

期刊:Transportmetrica B: Transport Dynamics

关键字:流量、流量时间序列、自我关注、GAN、强化学习

阅读指导:需要了解相关的知识

- 《Gan (生成式对抗网络)》

- 《知乎:生成对抗网络》

- 《self-attention》

文章目录

- SATP-GAN: self-attention based generative adversarial network for traffic flow prediction

-

- 摘要

- 1. Introduction

- 2. Preliminary and related works

-

- 2.1. Traffic flow prediction problem

- 2.2. Traditional methods

-

- 2.2.1. ARIMA

- 2.2.2. SVR

- 2.2.3. FNN

- 2.3. Recent methods

-

- 2.3.1. XGBoost

- 2.3.2. Gated RNN

- 2.3.3. GAN

- 3. Methodology: SATP-GAN

-

- 3.1. GAN module

-

- 3.1.1. Generator

- 3.1.2. Discriminator

- 3.2. RL module

- 3.3. Algorithm

- 4. Experiments

-

- 4.1. Dataset

- 4.2. Evaluation

- 4.3. Settings

- 4.4. Results

- 5. Conclusions

摘要

交通流预测Traffic flow prediction是交通控制和诱导系统中的一个基本问题,近年来随着人工智能的成功带来的新方法,交通流预测仍然受到越来越多的关注。本文提出了一种新的时间序列预测模型,即自注意生成对抗网络 self-attention generative adversarial networks for time-series prediction(SATP-GAN)。SATP-GAN方法基于自我注意 self-attention和生成性对抗网络(GAN)机制generative adversarial networks (GAN) mechanisms,由GAN模块和强化学习(RL)模块组成。在GAN模块中,我们使用自我注意层来捕获时间序列数据的模式,而不是使用递归神经网络(RNNs)。在RL模块中,我们应用RL算法调整SATP-GAN模型的参数。我们在真实的流量数据集上对该框架进行了评估,并获得了比基线方法6.5%的一致改进。SATP-GAN框架证明,在微调参数后,GAN机制也可用于时间序列预测。

1. Introduction

为人类做出预测是一件很有挑战性的事情,尤其是对未来的预测(Ellis 1970)。时间序列预测是通过分析历史数据,提取有意义的统计数据来预测未来的价值(Harvey 1989),在现代社会中起着至关重要的作用。例如,有不同的预测,如预测访客人数,为网站业主规划足够的硬件资源;预测未来的货品需求,为商人维持足够的货品库存;为电力公司建设新发电厂的电力需求预测(Hyndman和Athanasopoulos 2018)等。

在时间序列预测中,技术分析方法可分为两类:线性方法和非线性方法,它们都是基于历史时间序列数据。传统方法使用自回归方法(Box和Jenkins 1976;Toropov et al.2015;Y u、R a o和Dhillon 2016),这些方法缺少线性时间序列数据。近年来,在深度学习快速发展(Hinton et al.2012)的推动下,具有长-短期记忆(LSTM)(Hochreiter和Schmidhuber 1997)单元和门控递归单元(GRU)(Chung et al.2014)的递归神经网络(RNNs)架构在多个预测任务中取得了有希望的结果(Lai et al.2017;Tax等人,2017年;Karim、Majumdar和Darabi 2019年)。

交通流预测是典型的时间序列问题之一,它是智能交通系统中的关键问题,可以通过预测交通流来避免交通拥堵,并且可以动态规划出行路线而不是选择最短路径。如今,许多城市都安装了监控摄像头以确保交通安全。早在20世纪60 -70年代,一些研究者就开始将预测方法应用于交通流预测,主要是应用线性理论和统计理论(Miller 1961;法利和林1966)。在Van Arem等人(1997)讨论了在运输系统中应用的短期预测的统计方法。Vlahogianni, Golias和Karlaftis(2004)描述了2004年开发短期交通预测模型的框架。Liu et al.(2011)在2011年提出了一个类似于自回归综合移动平均(ARIMA)模型的线性模型。Abdi等人(2012)展示了一种基于神经模糊和边缘系统结构的新方法的强度。2012年,机器学习和深度学习开始成为这一研究领域的趋势。在Lippi, Bertini和Frasconi(2013)提出了两个新的支持向量回归模型用于交通流季节预测,Mingheng等人(2013)提出了一种基于SVM的方法来预测多步交通流。Junwei et al.(2014)提出了一个估算2014年不同条件下交通流量的元胞模型。Lu等(2015)提出了2015年交通流预测的交通关联模型和实时修正算法。在Kanrar和Mandal(2016)提出了一个基于会话的单用户带宽需求模型,用于视频流量分析。Wu et al.(2018)在2018年开发了一种混合深度学习模型来预测多步任务。In Gao等人(2019)提出了一种新的考虑突触非线性的树突神经元模型(DNM)。深度学习和机器学习的混合模型(毕、元、周2019;G u e t a l。2019;李、黄、王2019;L i等人,2019;G u e t a l。是近年来时间序列预测的新趋势。

由于交通流数据可以从路口的摄像头中收集(Toropov et al. 2015),所以基于深度学习神经网络如LSTM和GRU的方法(Lv et al. 2015;Zhang, Qi, and Zheng 2017),可以记忆和捕捉历史数据的趋势,最近取得了很好的结果(Lv et al. 2015;Lai等。2017;税务等,2017;张,齐,郑2017;Karim, Majumdar和Darabi, 2019;Lintonen和Räty 2019)。

一般来说,在交通流预测领域,大多数方法也主要分为两大类。一个主要的方法类别是基于线性模型,如自回归综合移动平均(ARIMA)模型和卡尔曼滤波(Liu et al. 2011;里皮、贝尔蒂尼和弗拉斯科尼(2013)。另一种是非线性模型,如基于深度学习模型的rnn模型(LSTM, GRU) (Lv et al. 2015;Zhang, Qi, and Zheng 2017)。

尽管前景广阔,但现有交通流预测方法的缺点,并不仅限于以下几点:

- 在现实世界中,交通流量预测的目标往往不能达到缓解交通拥堵的预期结果。

- 对于大型场景,需要进行多步交通流预测,但现有的方法在多步交通流预测中效果不佳。

- 现有方法中的级联依赖结构 cascade-dependent structure,特别是递归神经网络(RNN)中存在大量的乘法、内存访问和非线性变换等能耗低的操作,不能保证高计算速度和低功耗,这对边缘和传感器环境至关重要。

- 为了获得最优的交通流预测性能,需要对超参数优化进行调整以拟合统计特性。然而,现有的方法往往依赖于手动设置。

最近,基于自我注意机制的架构architectures based on self-attention mechanisms(Vaswani et al.2017)在NLP(自然语言处理)任务中取得了显著成功(Devlin et al.2018)。与此同时,随着生成性对抗网络(GAN s)的出现,计算机视觉取得了巨大进步(Goodfello等人,2014)。

受深度学习的启发,针对现有交通流预测方法的局限性,我们提出了一种新的框架,即自我注意GAN时间序列预测模型(self-attention GAN time-series prediction model, SATP-GAN),利用自我注意、GAN和强化学习(RL)机制来预测交通流。

以下是我们的贡献总结:

- 我们提出了一个新的框架SATP-GAN,利用自我注意,GAN和RL机制来预测交通流。

- 自注意机制取代了RNN (LSTM & GRU)的时序性,用于实现最适合并行计算的时序预测任务。

- GAN机制被用于生成新的数据,用于预测使用RL调优参数。

- 多步交通流预测可以避免累积误差。❓

- 时间步的输出是根据整个历史计算的,而不仅仅是输入,而且它的当前隐藏状态可以学习长期依赖关系。

- 实验表明,与基线相比,实验结果在6.5-9.1%之间得到了持续的改善。

本文的其余部分组织如下:第2节介绍了初步的和相关的工作,如自我注意、GAN网络和RL。第3节描述了SATP-GAN体系结构及其组件的详细信息。第4节展示了实验结果,并证明了我们的框架优于传统方法。第5部分对本文进行了总结,并指出了未来的工作。

2. Preliminary and related works

在本节中,我们对交通流预测问题进行形式化描述,回顾了交通流预测的相关研究成果,并介绍了深度学习在自我注意、GAN和RL机制方面的最新研究成果。

2.1. Traffic flow prediction problem

交通流预测是以历史观测数据为驱动力,预测交叉口未来的车流量。

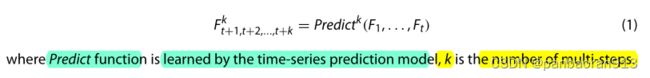

我们定义历史车辆流量观测为 F h i s = ( F 1 , … , F t ) F_{his} = (F_1,…, F_t) Fhis=(F1,…,Ft),我们的目标是预测多步未来车辆流:

2.2. Traditional methods

传统的交通流预测方法多为线性模型。2014年,Vlahogianni等人发表了他们的调查论文(Vlahogianni, Golias, and Karlaftis, 2014)。这些方法包括时间序列的自回归统计(ARIMA) (Williams and Hoel 2003)、支持向量回归(SVR) (Castro-Neto et al. 2009)和浅层人工神经网络(fnn) (Zhang et al. 2011)等。

2.2.1. ARIMA

ARIMA模型通常表示为 A R I M A ( p , d , q ) ARIMA(p,d,q) ARIMA(p,d,q),其中 p , d , q p,d, q p,d,q是由非负整数组成的参数。 p p p是自回归模型的时滞数集; d d d表示差值, q q q表示移动平均模型的阶数。ARIMA模型的公式如下:

![[论]【SATP-GAN】 self-attention based generative adversarial network for traffic flow prediction_第1张图片](http://img.e-com-net.com/image/info8/4b4bc92343534ea1a523d590f83b860c.jpg)

2.2.2. SVR

支持向量回归(SVR) 是由Drucker等人(1997)提出的。该模型采用与SVM相同的原理进行分类。在回归问题中,容差裕度margin of tolerance(ε)是一种近似。主要思想是最小化误差,找到最大限度的超平面,并确保容忍部分误差。我们定义 ε ε ε(如图1所示),虚线所定义区域内数据点的残差为0;虚线区域外的数据点(支持向量)到虚线边界的距离是剩余的 x i x_i xi和 x i ∗ x^ *_ i xi∗。支持向量机是找到一个最优条纹区域( 2 ε 2ε 2ε宽度),然后对区域外的点进行回归。

![[论]【SATP-GAN】 self-attention based generative adversarial network for traffic flow prediction_第3张图片](http://img.e-com-net.com/image/info8/58c40b48d7684470b4a55f62f9940308.jpg)

2.2.3. FNN

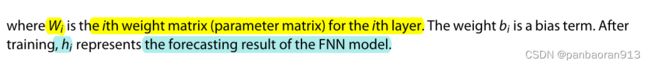

前馈神经网络(feedforward neural network, FNN) 是一种节点之间的连接不形成循环的人工神经网络,是深度学习主要基于和由Rumelhart, Hinton和Williams(1987)提出。它被广泛应用于预测。模糊神经网络以σ函数为激活函数,由非线性层组成。通常它有三层,包括输入层、隐藏层和输出层。每个内层都与前一层完全连接。

2.3. Recent methods

近年来,基于机器学习和深度学习的交通流预测方法受到越来越多的关注。研究人员使用XGBoost (Chen和Guestrin 2016)、深度循环神经网络(RNNs) (Yu et al. 2017)和卷积神经网络(CNNs)研究时间序列预测,这些网络已被应用于交通预测(Deng et al. 2016)。

2.3.1. XGBoost

XGBoost(Extreme Gradient Boosting) 是一种基于Chen和Guestrin(2016)提出的决策树的集成机器学习算法。XGBoost使用Gradient Boost作为框架,它属于GBDT (Friedman 2001)的一个变体。该算法与传统GBDT算法的不同之处在于:GBDT在变换时使用Taylor的一阶展开,而XGBoost使用Taylor的二阶展开。此外,XGBoost还引入了一个常规术语,从而更容易进行过拟合。

![[论]【SATP-GAN】 self-attention based generative adversarial network for traffic flow prediction_第4张图片](http://img.e-com-net.com/image/info8/4ec3f82630be44c389a35c915d6f182a.jpg)

![[论]【SATP-GAN】 self-attention based generative adversarial network for traffic flow prediction_第5张图片](http://img.e-com-net.com/image/info8/9d3f2d0a11564d869e7101a541f939b0.jpg)

2.3.2. Gated RNN

传统的RNN有两个缺点:梯度爆炸和梯度消失。为了克服这些缺点,Hochreiter等人提出了带有门模块的RNN模型,称为长短时记忆(LSTM,图2显示其结构)(Hochreiter和Schmidhuber 1997)。 Chung et al简化了LSTM的计算,并提出了GRU (Chung et al. 2014)模型。GRU具有更少的可训练参数。然而,使用lstm的要多得多。

一般情况下,LSTM不会单独用于时间序列预测,以提高预测精度。受机器翻译成功的启发(Cho et al. 2014),自然语言过程(NLP)中的Seq2Seq模型显示出巨大的潜力。更具体地说,一个标准的Seq2Seq模型由两个关键组件组成,一个编码器,它将源输入x映射到矢量表示,另一个解码器,它根据源和编码器生成输出序列。编码器和解码器都是lstm,用于捕获不同的组合模式。

2.3.3. GAN

生成对抗网络(GAN) 是一种以对抗方式估计分布的框架(Goodfellow et al. 2014)。它同时训练两个模型,分别是生成模型生成器Generator (G) 和 判别模型判别器Discriminator (D) 。对Discriminator进行训练,使来自训练数据和生成数据的两个样本分配合适标签的概率最大化。GANs用于时间序列预测问题的应用并不多。

- Generator生成器是一种神经网络: P G ( x ; θ ) P_G(x;θ) PG(x;θ)。该生成器的目的是找到 P G P_G PG的参数集 θ θ θ,使真实数据与生成数据尽可能接近。

- 判别器Discriminator(D)用来判别哪些数据是 P G ( x ; θ ) P_G(x;θ) PG(x;θ)来自生成器,哪些来自真实数据。鉴别器的目标更可能是能够区分真实数据和生成数据,成为工作中不断学习的质量检查员。

3. Methodology: SATP-GAN

在本节中,我们将详细介绍基于自我注意的交通流预测生成对抗网络(self-attention based generative adversarial network for traffic flow prediction,简称 SATP-GAN) 的框架,其总体架构如图3所示。SATP-GAN 主要由两部分组成:GAN模块(self-attention layer for generator, convolutional neural network(CNN) for discriminator)和RL模块(用于调整GAN的超参数)。以下是 SATP-GAN 如何工作的概述:

- 将历史流量同时输入到GAN模块。

- 基于自我注意机制和CNN对GAN模块进行训练,获得预测能力。

- 通过RL模块调整GAN参数,使GAN模块稳定。

3.1. GAN module

GAN模块 由产生器和鉴别器两部分组成。在生成器中,我们应用了自我注意层来捕获时间序列数据的模式,而不是RNN。在鉴别器中,我们利用CNN来检测预测数据(生成的)和真实数据的特征。

3.1.1. Generator

生成器根据输入的历史数据生成预测的时间序列数据。如图4所示:我们将历史流数据及其位置放入生成器中。此外,我们定义预测步长k作为生成器的约束。一般情况下,生成器的输入为:

- 历史交通流 ( F l o w 1 , F l o w 2 , . . . , F l o w t ) (Flow_1, Flow_2, . . . , Flow_t) (Flow1,Flow2,...,Flowt)

- 预测大小 k k k

- 数据呈正态分布z

自我注意层捕获输入数据模式,而不是rnn。此外,它还可以通过并行计算加速。经过自我注意层后,前馈层最终生成预测结果。

![[论]【SATP-GAN】 self-attention based generative adversarial network for traffic flow prediction_第9张图片](http://img.e-com-net.com/image/info8/c751c57c4f77469ab1f14bfa40980d05.jpg)

- Self-Attention Layer Attention (Vaswani et al. 2017)机制最近被广泛应用于深度学习的各个领域(图像处理Xu et al. 2015,自然语言处理Luong, Pham, and Manning 2015)。从概念上讲,注意力模仿了人们感知的方式,选择性地过滤掉少量重要信息并集中于其上,忽略大部分不那么重要的信息。注意信息选择过程的核心是信息权重系数的计算。自我注意机制是计算注意权重本身。首先,从交通流数据和数据位置计算输入嵌入 X i X_i Xi,准备Query, Key, Value嵌入。

![[论]【SATP-GAN】 self-attention based generative adversarial network for traffic flow prediction_第10张图片](http://img.e-com-net.com/image/info8/6d5251da00484b1ba2ab051e57478456.jpg)

1)根据Query和Key计算两者的相似度或相关性;

2)将步骤1计算的结果归一化,使用softmax得到权重系数;

3)加权系数是数值的加权和。

- Feed Forward Neural Network

引入前馈神经网络从自我注意层生成预测数据(如图6所示),因此,输入就是自我注意层的输出。输出为k步时间序列预测数据。

Fig.6 前馈神经网络。

- 超参数

生成器的超参数 由自注意层 n s e l f a t t e n t i o n n_{self_attention} nselfattention的数层组成;前馈神经网络 n F F N N n_{FFNN} nFFNN的层数。

3.1.2. Discriminator

判别器输入分别为真实数据和预测数据,输出为预测数据的真假、生成器和判别器置信度等分类结果。此外,鉴别器可以评估生成器和鉴别器本身。鉴别器由CNN和神经网络组成,如图7所示。以下是鉴别器的组件:

- CNN

cnn可以检测到一些特征,这些特征可以用于提取时间序列数据中模式的信息,它们对彼此之间更接近或更相关的数据点很好地工作。

- Neural Networks

在CNN输出的基础上,我们针对不同的目的设计了三种不同的神经网络。第一个神经网络是检测数据是否来自真实数据;第二个神经网络是评价鉴别器;第三个神经网络是对生成器进行评估。

- Hyperparameters

鉴别器的超参数为CNN层ncnn的层数和CNN结构nfilter的滤波器数;三个神经网络的层数 ( n c n n , n d i s , n g e n ) . (n_{cnn}, n_{dis}, n_{gen}). (ncnn,ndis,ngen).

3.2. RL module

强化学习 (Sutton and Barto 1998)是通过构建agent进行学习。agent的主要特征包括与环境的交互能力(根据round episode,一个完整的与环境的交互过程是一个episode),用于计算分析和决策。代理是一种实体,它可以根据其对环境的观察(感知)采取行动。RL的特点是:没有监督数据,只有奖励信号。

![[论]【SATP-GAN】 self-attention based generative adversarial network for traffic flow prediction_第14张图片](http://img.e-com-net.com/image/info8/8f1a958e9f7a440894b3207ce0386500.jpg)

在SATP-GAN中,我们采用RL模块对产生器和鉴别器的超参数进行调谐。如图8所示,将RL模块分为两部分,分别使用Q-Learning算法(Watkins and Dayan 1992)对超参数进行调优。Q(s, a)表示行动a中状态s的行动价值函数(在状态s中采取行动a获得的未来奖励)。通过Q(s, a)函数找到某一状态下的最佳行动,使最终获得的累积奖励最大,然后用Bellman方程求解。Q-学习公式如下:

![[论]【SATP-GAN】 self-attention based generative adversarial network for traffic flow prediction_第15张图片](http://img.e-com-net.com/image/info8/068e6cb699b14161bc73ab698ad9abae.jpg)

3.3. Algorithm

STAP-GAN算法为:

STAP-GAN算法不仅训练了基于自我注意的GAN模型,而且利用RL方法对生成器(G)和鉴别器(D)的超参数进行优化。生成器(G)和鉴别器(D)的超参数影响交通流预测的性能,在面对不同的数据集时需要进行调整。此外,我们使用RL学习器来调整超参数。输入交通流数据,初始化生成器(G)和鉴别器(D)的超参数,同时训练GAN和RL模型。固定generator’s (G’s)超参数,训练GAN模型,使用RL模型控制鉴别器(D)的超参数,直到RL模型找到最优超参数。修正discriminator (D’s)超参数,训练GAN模型,使用RL模型控制生成器(G)的超参数,直到RL模型找到最优超参数。重复这两个步骤,G和D都会在RL模型的帮助下找到它们的最优超参数。

4. Experiments

在本节中,我们将SATP-GAN等时间序列预测模型应用于交通流数据集,并收集模型的性能结果。

4.1. Dataset

我们收集了中国某城市一个十字路口的车流量,其中包含了一个月每小时的车辆数量。交通流分为四个不同的方向:西、东、北、南(如图9所示)。四个方向每小时的交通流,共1个月(30天),2880条数据。

数据集来自真实的交通状况。在兰州选择一个装有摄像头的路口,我们可以方便地获取该路口的监控视频。为了检测视频中的车辆,我们选择了一种最先进的目标检测方法(YOLOV4 Bochkovskiy, Wang, and Liao 2020),并标记了一些视频,用于训练我们的目标检测模型来进行车辆检测。从视频中可以通过路口的空间格局区分出四个方向的车辆。计算一个月(30天)每小时的车辆总数,得到2880(24小时× 30天× 4个方向)数据。数据集的生成过程包括交通视频采集、目标检测模型训练和数据组织。高质量和真实是我们数据集的特点。

4.2. Evaluation

我们使用了三个广泛使用的函数来评估时间序列模型的性能,即平均绝对误差(MAE),均方误差(MSE)和均方根误差(RMSE)。

![[论]【SATP-GAN】 self-attention based generative adversarial network for traffic flow prediction_第17张图片](http://img.e-com-net.com/image/info8/0a6c6118573a45d4a55f8a5add58e86a.jpg)

4.3. Settings

我们初始化了生成器超参数,自注意层 n s e l f a t t e n t i o n = 2 n_{self_attention} = 2 nselfattention=2,前馈神经网络 n F F N N = 3 n_{FFNN} = 3 nFFNN=3;取CNN层数 n c n n = 3 n_{cnn} = 3 ncnn=3,取CNN n f i l t e r n_{filter} nfilter的滤波器数 n c n n = 3 n_{cnn }= 3 ncnn=3,取三个神经网络的层数 n c n n = 3 , n d i s = 3 , n g e n = 3 n_{cnn} = 3, n_{dis} = 3, n_{gen} = 3 ncnn=3,ndis=3,ngen=3的判别器;我们设预测步数 k k k的值为1,3,5。

4.4. Results

我们应用了SATP-GAN和其他时间序列预测模型(ARIMA Williams和Hoel 2003, SVR Drucker et al. 1997, FNN Rumelhart, Hinton和Williams 1987, LSTM Hochreiter和Schmidhuber 1997, XGBoost Chen和Guestrin 2016, D N M G a o e t a l . 2019)到我们所提到的数据集。我们收集了所有方法的性能结果。

如图10所示,SATP-GAN在长期预测中表现最好。虽然当k = 1时,DNM表现最好,但DNM、XGBoost和STAP-GAN的MAE和RMSE结果非常接近。k越大,SATP-GAN的推进作用越明显。如表1所示,我们的SATP-GAN方法优于其他方法。与基线相比,sat - gan性能提高了6.5%以上。此外,SATP-GAN模型的训练时间比LSTM模型快10倍(如图11所示)。

从实验中,我们发现我们提出的SATP-GAN方法可以很好地预测交通流,与基线方法相比。而且,预测的步长越大,SATP-GAN的进步越明显。此外,SATP-GAN模型的计算速度比LSTM模型快10倍。

预测越精确,交通就越顺畅,交通就会堵塞,拥堵就可以提前预防,从而节约能源,保护环境,促进经济,等等。因此,在交通控制中使用sat - gan可以提高生活水平。此外,在RL模型的帮助下,SATP-GAN可以改变其超参数,使其适用于各种交通条件。

5. Conclusions

在本文中,我们提出了一种新颖的时间序列结构SATP-GAN,基于自我注意、GAN和RL范式来预测交通流。对于时间序列预测任务,自我注意机制取代了RNN(LSTM&GRU)的顺序性质,从而实现了并行计算。时间步的输出是根据整个历史计算的,而不仅仅是输入,而且它的当前隐藏状态可以学习长期依赖关系。此外,利用RL对SATP-GAN的超参数进行了调优。通过对某一城市交通数据进行所有方法的交通流预测实验,实验结果均较基线提高了6.5-9.1%。我们证明了SATP-GAN的性能优于其他模型。此外,SATP-GAN易于在实际中应用。

由于多个路口的交通流相互影响,在未来的研究中,我们将考虑多个路口的交通流,应用图神经网络进行进一步的研究。

![[论]【SATP-GAN】 self-attention based generative adversarial network for traffic flow prediction_第2张图片](http://img.e-com-net.com/image/info8/e4b22dfe2b5048b4bdcae4e84537732a.jpg)

![[论]【SATP-GAN】 self-attention based generative adversarial network for traffic flow prediction_第6张图片](http://img.e-com-net.com/image/info8/cd5f5808fa1542aab35d7c290d620756.jpg)

![[论]【SATP-GAN】 self-attention based generative adversarial network for traffic flow prediction_第7张图片](http://img.e-com-net.com/image/info8/8441c07ef84243129bdc6e9173fd2bb7.jpg)

![[论]【SATP-GAN】 self-attention based generative adversarial network for traffic flow prediction_第8张图片](http://img.e-com-net.com/image/info8/7e395ea29a044a57af106189abcf4b49.jpg)

![[论]【SATP-GAN】 self-attention based generative adversarial network for traffic flow prediction_第11张图片](http://img.e-com-net.com/image/info8/dbf83d7a3abb4d988c2f06504bc19b9e.jpg)

![[论]【SATP-GAN】 self-attention based generative adversarial network for traffic flow prediction_第12张图片](http://img.e-com-net.com/image/info8/e35d697bd9d2461bab4f4979ed155916.jpg)

![[论]【SATP-GAN】 self-attention based generative adversarial network for traffic flow prediction_第13张图片](http://img.e-com-net.com/image/info8/0614db599de04ab0a8fc42489f2c2563.jpg)

![[论]【SATP-GAN】 self-attention based generative adversarial network for traffic flow prediction_第16张图片](http://img.e-com-net.com/image/info8/4e24c75f92a54d4c937566687d431a49.jpg)

![[论]【SATP-GAN】 self-attention based generative adversarial network for traffic flow prediction_第18张图片](http://img.e-com-net.com/image/info8/c2e0a99829a94702bbde2c23c652be0e.jpg)

![[论]【SATP-GAN】 self-attention based generative adversarial network for traffic flow prediction_第19张图片](http://img.e-com-net.com/image/info8/15d6b62e07dc4f908ddf149052340dde.jpg)

![[论]【SATP-GAN】 self-attention based generative adversarial network for traffic flow prediction_第20张图片](http://img.e-com-net.com/image/info8/d68339adbfe94675af9f3eaa4bb7f9b4.jpg)