ICML2021会议论文整理

会议介绍

ICML是国际机器学习大会。与NeurIPS和ICLR 一起被评为机器学习和人工智能研究领域具有重大影响的三大主要会议之一。近年来,ICML会议的投稿数量一直增长:ICML 2020 投稿量为4990篇,ICML 2021的投稿量5513, 在一个月之前,ICML 2021的论文接收结果已经公布,其中1184篇论文被接收,接收率为 21.5% 。

AMiner通过AI技术,对ICML2021收录的会议论文进行了分类整理,欢迎收藏!

AMiner-ICML2021:https://www.aminer.cn/conf/icml2021?f=cs

<2>Neural Network

1.论文名称:Spectrum Dependent Learning Curves in Kernel Regression and Wide Neural Networks

论文链接:https://www.aminer.cn/pub/5e4129b13a55ac9f8f89e05e?f=cs

![]()

现代机器学习的一个基本问题是深度神经网络如何泛化。我们使用 1) 训练无限宽的神经网络和使用称为神经切线核 (NTK) (Jacot 等人,2018) 的确定性核执行核回归之间的等价性,以及 2) 来自统计物理学的理论工具,来解决这个问题。我们推导出核回归学习曲线的解析表达式,并使用它们来评估受过训练的神经网络的测试损失如何取决于样本数量。我们的方法不仅允许我们计算总测试风险,还允许我们计算由于内核的不同频谱分量而导致的风险分解。补充最近的结果表明,在梯度下降期间,神经网络首先拟合低频分量,我们确定了一种新型的频率原理:随着训练集大小的增加,核机器和神经网络开始依次拟合高频模式目标函数。我们通过核回归的模拟和训练广泛的人工神经网络来验证我们的理论。

2.论文名称:Joining datasets via data augmentation in the label space for neural networks

论文链接:https://www.aminer.cn/pub/60bdde338585e32c38af514c?f=cs

大多数(如果不是全部)现代深度学习系统都将自己限制在用于神经网络训练和推理的单个数据集。 在本文中,我们对连接具有相似目的的数据集的系统方法感兴趣。 与之前发表的作品在不可解释的潜在向量空间中无处不在地进行数据集连接不同,我们方法的核心是标签空间中的增强过程。 解决数据集连接标签空间的主要挑战是标签之间的差异:不重叠的标签注释集、不同的标签粒度或层次结构等。值得注意的是,我们提出了一种利用人工创建的知识图、循环神经网络和策略梯度的新技术,成功地实现了数据集加入标签空间。 图像和文本分类的实证结果证明了我们方法的有效性。

3.论文名称:Learning Neural Network Subspaces

论文链接:https://www.aminer.cn/pub/6034d5e991e01122c046f727?f=cs

最近的观察增进了我们对神经网络优化领域的理解,揭示了 (1) 包含不同解决方案的高精度路径和 (2) 提供改进性能的更广泛的最小值的存在。 以前观察不同路径的方法需要多次训练。 相比之下,我们的目标是通过单一方法和单一训练运行来利用属性 (1) 和 (2)。 使用与训练一个模型类似的计算成本,我们学习高精度神经网络的直线、曲线和单纯形。 这些神经网络子空间包含可以集成的不同解决方案,在没有训练成本的情况下接近独立训练网络的集成性能。 此外,使用子空间中点提高了标记噪声的准确性、校准和鲁棒性,优于随机加权平均。

4.论文名称:Provable Generalization of SGD-trained Neural Networks of Any Width in the Presence of Adversarial Label Noise

论文链接:https://www.aminer.cn/pub/5ff4607591e01130648dc6b6?f=cs

我们考虑在任意初始化后通过随机梯度下降训练的任意宽度的单隐藏层泄漏 ReLU 网络。 我们证明,随机梯度下降 (SGD) 产生的神经网络的分类精度可与分布上的最佳半空间的分类精度相媲美,适用于包括对数凹面各向同性和硬边界分布在内的广泛分布类别。 同样,当数据分布是线性可分但被对抗性标签噪声破坏时,这种网络可以泛化,尽管有过拟合的能力。 我们进行的实验表明,对于某些分布,我们的泛化界限几乎是严格的。 这是第一个结果,表明当数据被对抗性标签噪声破坏时,由 SGD 训练的过参数化神经网络可以实现泛化。

5.论文名称:Classifying high-dimensional Gaussian mixtures: Where kernel methods fail and neural networks succeed

论文链接:https://www.aminer.cn/pub/60362ef591e011703cfaf91d?f=cs

最近的一系列理论工作表明,内核方法可以很好地捕获具有特定初始化的神经网络的动力学。同时进行的实证工作表明,该方法可以接近神经网络在某些图像分类任务上的性能。这些结果提出了一个问题,尽管神经网络更具表现力,但神经网络是否只有在内核也学习成功的情况下才能成功学习。在这里,我们从理论上表明,只有少数隐藏神经元的两层神经网络 (2LNN) 可以在简单的高斯混合分类任务上击败内核学习的性能。我们研究了样本数量与输入维度成线性比例的高维限制,并表明虽然小型 2LNN 在此任务上实现了接近最佳的性能,但随机特征和内核方法等惰性训练方法却没有。我们的分析基于一组封闭方程的推导,这些方程跟踪 2LNN 的学习动态,从而允许提取网络的渐近性能作为信噪比和其他超参数的函数。

<3>Graph Neural Network

1.论文名称:E(n) Equivariant Graph Neural Networks

论文链接:https://www.aminer.cn/pub/6033832f91e011e54d039b86?f=cs

过度拟合训练集:我们解释了对称问题,并展示了等变图神经网络在给定数据集中优于其他方法。

2.论文名称:Lipschitz Normalization for Self-Attention Layers with Application to Graph Neural Networks

论文链接:https://www.aminer.cn/pub/6047909691e0116b67c79350?f=cs

我们证明了 Lipschitz 连续模块可以防止梯度爆炸现象,并且可以提高深度注意力模型的性能。

3.论文名称:On Explainability of Graph Neural Networks via Subgraph Explorations

论文链接:https://www.aminer.cn/pub/6025462c91e0118ffcd4a197?f=cs

在这项工作中,我们提出了一种称为 SubgraphX 的新方法,通过识别重要的子图来解释 GNN。 给定一个经过训练的 GNN 模型和一个输入图,我们的 SubgraphX 通过使用蒙特卡罗树搜索有效地探索不同的子图来解释其预测。

4.论文名称:Improving Molecular Graph Neural Network Explainability with Orthonormalization and Induced Sparsity

论文链接:https://www.aminer.cn/pub/609baf6491e0113c3c769369?f=cs

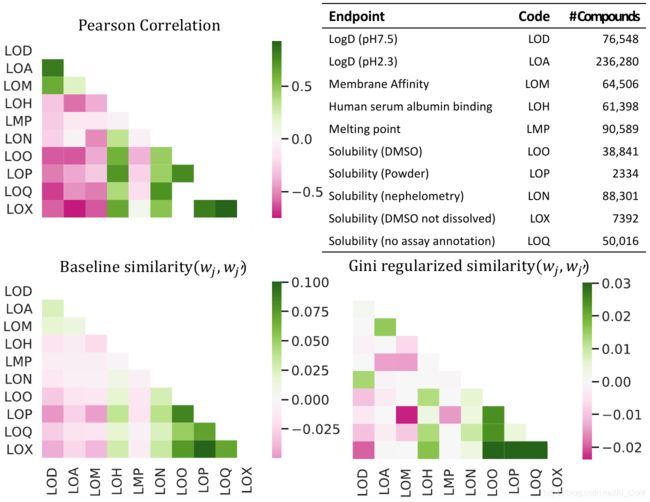

合理化分子的哪些部分驱动分子图卷积神经网络 (GCNN) 的预测可能很困难。 为了提供帮助,我们提出了两种在 GCNN 训练期间应用的简单正则化技术:批量表示正交化 (BRO) 和 Gini 正则化。

5.论文名称:Graph Neural Networks Inspired by Classical Iterative Algorithms

论文链接:https://www.aminer.cn/pub/6049f20b91e01118b758f10a?f=cs

为了在一个简单的透明框架内至少部分解决这些问题,我们考虑了一个新的 GNN 层系列,旨在模仿和集成两个经典迭代算法的更新规则,即近端梯度下降和迭代重加权最小二乘法 (IRLS)。

<4>Bandit

1.论文名称:Achieving Near Instance-Optimality and Minimax-Optimality in Stochastic and Adversarial Linear Bandits Simultaneously

论文链接:https://www.aminer.cn/pub/60264d8291e011821e023b40?f=cs

在这项工作中,我们开发了自动适应不同环境的linear bandit算法。 通过将一个新的损失估计器插入表征实例最优策略的优化问题,我们的第一个算法不仅在随机环境中实现了近乎实例最优的遗憾,而且还可以在损坏的环境中工作,额外的遗憾是损坏的数量。

2.论文名称:An Algorithm for Stochastic and Adversarial Bandits with Switching Costs

论文链接:https://www.aminer.cn/pub/6033840491e011e54d039b9a?f=cs

我们提出了一种具有切换成本的随机和对抗性multiarmed bandits的算法,在 Zimmert 和 Seldin (2021) 的 Tsallis-INF 算法基础上改编,并且不需要有关制度或时间范围的先验知识。

3.论文名称:Beyond log 2 ( T ) \log^2(T) log2(T) Regret for Decentralized Bandits in Matching Markets

论文链接:https://www.aminer.cn/pub/605075e291e0111e1cd4693c?f=cs

我们设计了去中心化算法以在双边匹配市场中最小化遗憾,并具有显着改进先前工作的one-sided bandit反馈(Liu 等人,2020a,2020b,Sankararaman 等人,2020 年)。

4.论文名称:Bias-Robust Bayesian Optimization via Dueling Bandit

论文链接:https://www.aminer.cn/pub/60af5a5591e0116560681632?f=cs

我们的第一个贡献是减少了dueling bandit模型的混淆设置,然后,我们提出了一种基于信息定向采样 (IDS) 的dueling bandits的新方法。我们的分析进一步将先前提出的semi-parametric linear bandit模型推广到非线性奖励函数,并揭示了与双稳健估计的有趣联系。

5.论文名称:Online Limited Memory Neural-Linear Bandits with Likelihood Matching

论文链接:https://www.aminer.cn/pub/60225fdf91e011e70e451193?f=cs

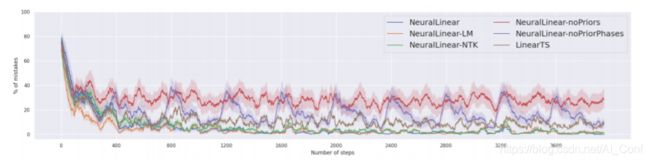

我们研究neural-linear bandit来解决问题,其中探索和表示学习都发挥着重要作用。Neural-linear bandits利用深度神经网络 (DNN) 的表示能力,并将其与为最后一个隐藏层顶部的linear contextual bandits设计的高效探索机制相结合。

<5>Transformer

1.论文名称:Thinking Like Transformers

论文链接:https://www.aminer.cn/pub/605040f49e795e84274dc840?f=cs

我们展示了几个用受限访问序列处理语言编写的表达性程序示例,展示了转换器如何实现复杂的操作。

2.论文名称:Relative Positional Encoding for Transformers with Linear Complexity

论文链接:https://www.aminer.cn/pub/60a4eba491e011e398b0d01a?f=cs

我们将随机位置编码作为一种生成 PE 的方法,该 PE 可用作经典加法(正弦)PE 的替代品,并且可证明其行为类似于 RPE。 主要的理论贡献是在相关高斯过程的位置编码和交叉协方差结构之间建立联系。

3.论文名称:Transformers with Competitive Ensembles of Independent Mechanism

论文链接:https://www.aminer.cn/pub/603e10a391e01129ef28fc5d?f=cs

我们提出了具有独立机制的变压器(TIM),这是一种新的变压器层,它将隐藏表示和参数划分为多个机制,这些机制只通过关注点交换信息。此外,我们提出了一种竞争机制,鼓励这些机制随着时间步长实现专业化,从而更加独立。

4.论文名称:ViLT: Vision-and-Language Transformer Without Convolution or Region Supervision

论文链接:https://www.aminer.cn/pub/60211a1e91e0113bfb1dc6a2?f=cs

![]()

我们提出了一个最小的VLP模型,视觉和语言转换器(ViLT),从视觉输入处理的极大简化到与文本输入处理相同的无卷积方式的意义上来说,它是单片的。我们发现ViLT比以前的VLP模型快60倍,而且具有更好的下游任务性能。

5.论文名称:PipeTransformer: Automated Elastic Pipelining for Distributed Training of Transformers

论文链接:https://www.aminer.cn/pub/6021115b91e0113bfb1dc5f5?f=cs

我们提出了PipeTransformer,它利用自动化的、弹性的流水线和数据并行来对Transformer模型进行高效分布式训练。PipeTransformer在训练过程中识别和冻结某些层,进而自动调整流水线和数据的并行性,并为其余活动层的训练分配资源。

<6>Deep Reinforcement Learning

1.论文名称:DouZero: Mastering DouDizhu with Self-Play Deep Reinforcement Learning

论文链接:https://www.aminer.cn/pub/60bdde338585e32c38af4eae?f=cs

我们提出了一个概念上简单但有效的DouDizhu人工智能系统,即DouZero,它利用深度神经网络、动作编码和并行的行动者增强了传统的蒙特卡罗方法。在一台拥有4个gpu的服务器上从零开始,DouZero在几天的训练中超越了所有现有的DouDizhu人工智能程序,并在344个人工智能代理的Botzone排行榜上排名第一。

2.论文名称:SAINT-ACC: Safety-Aware Intelligent Adaptive Cruise Control for Autonomous Vehicles Using Deep Reinforcement Learning

论文链接:https://www.aminer.cn/pub/60782a0091e011f5ecc9dbc0?f=cs

我们提出了一种自主自适应的巡航控制系统,即通过基于深度强化学习的跨车间隙动态适应,同时实现交通效率、驾驶安全性和驾驶舒适性的优化。

3.论文名称:Combining Pessimism with Optimism for Robust and Efficient Model-Based Deep Reinforcement Learning

论文链接:https://www.aminer.cn/pub/6054878891e0116f82f2d76f?f=cs

我们提出鲁棒幻觉上自信RL (RH-UCRL)算法来证明解决这一问题,同时获得接近最优的样本复杂度保证。RH-UCRL是一种基于模型的强化学习(MBRL)算法,有效地区分了认知和任意的不确定性,并在策略学习过程中有效地探索了代理和对手决策空间。

4.论文名称:Spectral Normalisation for Deep Reinforcement Learning: an Optimisation Perspective

论文链接:https://www.aminer.cn/pub/609bc82091e0113c3c7694f1?f=cs

我们进行了ablation研究,以解决归一化对学习动力学的各种影响,并表明这足以调节参数更新以恢复大部分谱归一化性能。这些发现提示,还需要关注神经组件及其学习动态,以解决深度强化学习的特点。

5.论文名称:Emphatic Algorithms for Deep Reinforcement Learning

论文链接:https://www.aminer.cn/pub/60bdde338585e32c38af51b3?f=cs

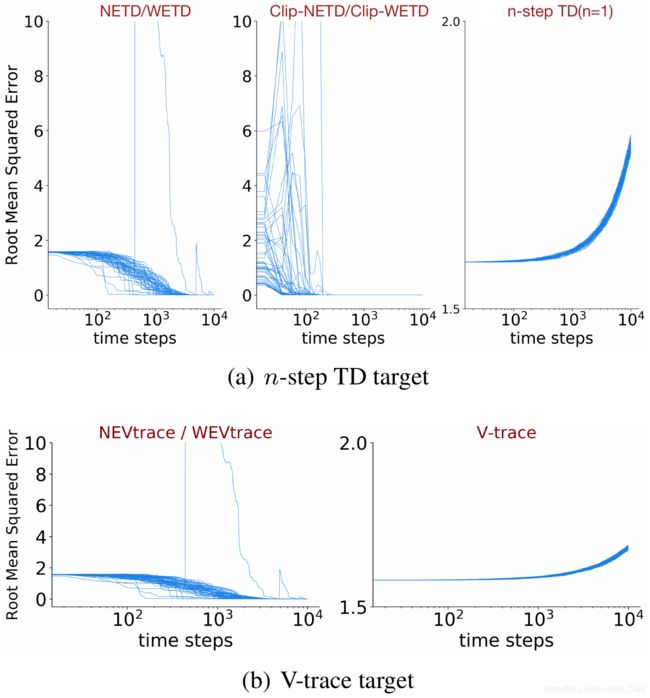

我们将重点方法的使用扩展到深度强化学习代理。我们展示了天真地将ETD( λ \lambda λ)适应于使用前向视图多步返回的流行深度强化学习算法,会导致较差的性能。然后,我们推导出用于此类算法的新重点算法,并证明了它们在突出TD方法不稳定性的小问题中提供了显著的好处。最后,我们观察到在Arcade Learning Environment中将这些算法大规模应用于经典Atari游戏时,游戏性能得到了改善。

<7>Generative Models

1.论文名称:Intermediate Layer Optimization for Inverse Problems using Deep Generative Model

论文链接:https://www.aminer.cn/pub/602bab4991e0113d72356d8d?f=cs

我们证明了中间层优化获得了最先进的无监督性能,以解决逆问题的深度生成模型在四种不同的设置:修复,超分辨率,去噪和压缩感知与循环矩阵。

2.论文名称:Fold2Seq: A Joint Sequence(1D)-Fold(3D) Embedding-based Generative Model for Protein Design

论文链接:https://www.aminer.cn/pub/60bdde338585e32c38af5239?f=cs

我们设计了一种新的基于变压器的模型,从折叠内部和折叠之间的二级结构元素的三维体素中提取无标度和粗糙的拓扑特征,并使用这些特征作为条件输入来设计蛋白质序列。

3.论文名称:NeRF-VAE: A Geometry Aware 3D Scene Generative Model

论文链接:https://www.aminer.cn/pub/6066fccb91e011f2d6d47cd9?f=cs

我们提出了NeRF- vae,一个通过NeRF结合几何结构和可微分体绘制的三维场景生成模型。与NeRF相比,我们的模型考虑了跨场景的共享结构,并且能够推断出一个新场景的结构——无需重新训练——使用摊销推理。

4.论文名称:Prior Image-Constrained Reconstruction using Style-Based Generative Models

论文链接:https://www.aminer.cn/pub/6038bbfc91e011c1c59ed148?f=cs

本研究提出一个框架估计的兴趣对象是语义相关的已知先验图像。优化问题在:基于风格的生成模型的解纠缠潜空间中进行表述,并利用先验图像的解纠缠潜表示强加语义上有意义的约束。

5.论文名称:Adversarial Purification with Score-based Generative Models

论文链接:https://www.aminer.cn/pub/60bdde338585e32c38af5109?f=cs

![]()

我们提出了一种新的对抗净化方法,该方法基于一个经过去噪评分匹配(DSM)训练的循证医学。我们证明了一个经过DSM训练的循证医学可以在几步之内快速地净化被攻击的图像,并进一步介绍了一个简单而有效的随机净化方案,即在净化前向图像注入随机噪声。

<8>Deep Learning

1.论文名称:Deep Learning for Functional Data Analysis with Adaptive Basis Layers

论文链接:https://www.aminer.cn/pub/60bdde338585e32c38af51e9?f=cs

我们引入了一种新的基层神经网络,其隐藏单元是每个基函数本身作为一个微神经网络实现。我们的体系结构学会了将简约的降维应用于只关注与目标相关的信息,而不是输入函数中无关的变量的功能输入。

2.论文名称:AUTOSAMPLING: SEARCH FOR EFFECTIVE DATA SAMPLING SCHEDULES

论文链接:https://www.aminer.cn/pub/6051af8e9e795e94b643fbf5?f=cs

我们提出了自动采样方法来自动学习模型训练的采样计划,包括以最优局部采样计划为目标的多重开发步骤和以理想采样分布为目标的探索步骤。

3.论文名称:The Hintons in your Neural Network: a Quantum Field Theory View of Deep Learning

论文链接:https://www.aminer.cn/pub/6047921f91e0116b67c7936b?f=cs

我们发展了一种用于深度学习的量子场论形式,其中输入信号以高斯状态编码,这是一种高斯过程的推广。我们展示了如何将线性和非线性层表示为单一量子门,并将量子模型的基本激发解释为粒子,称为“Hintons”。

4.论文名称:Measuring Robustness in Deep Learning Based Compressive Sensing

论文链接:https://www.aminer.cn/pub/60265a1291e011821e023c35?f=cs

我们测量了不同的图像重建方法的鲁棒性,包括训练过的神经网络,未训练过的网络,以及传统的基于稀疏度的方法。我们发现,与以前的工作相反,训练和未训练的方法都容易受到对抗性干扰;针对特定数据集调整的训练和未训练的方法在分布变化方面都有非常相似的问题。最后,我们证明了一种具有较高重建精度的图像重建方法,在精确恢复细节方面也有较好的表现。

5.论文名称:Quasi-Global Momentum: Accelerating Decentralized Deep Learning on Heterogeneous Data

论文链接:https://www.aminer.cn/pub/6023d3fa91e0119b5fbd97f1?f=cs

我们研究并识别了几种分散优化算法对不同程度数据异构的局限性。我们提出了一种新的基于动量的方法来缓解这种分散训练的困难。我们在不同的CV/NLP数据集(CIFAR-10, ImageNet, AG News和SST2)和一些网络拓扑(Ring和Social network)上进行了大量的经验实验。

<9>Meta Learning

1.论文名称:Bridging Multi-Task Learning and Meta-Learning: Towards Efficient Training and Effective Adaptation

论文链接:https://www.aminer.cn/pub/60bdde338585e32c38af516c?f=cs

我们首先证明了MTL与一类基于梯度的元学习(GBML)算法具有相同的优化公式。然后我们证明了对于具有足够深度的过参数化神经网络,MTL和GBML学习到的预测函数是接近的。

2.论文名称:A Distribution-Dependent Analysis of Meta-Learning

论文链接:https://www.aminer.cn/pub/60bdde338585e32c38af4f70?f=cs

本文以高斯噪声和高斯任务(或参数)分布下的固定设计线性回归算法为研究对象,给出了任意算法的转移风险的分布相关下界,并证明了一种新的、所谓的有偏正则化回归方法的加权版本,能够将这些下界匹配到一个固定的常数因子。

3.论文名称:Improving Generalization in Meta-learning via Task Augmentation

论文链接:https://www.aminer.cn/pub/60bdde338585e32c38af4e2f?f=cs

我们提出了两种任务扩展方法,包括MetaMix和Channel Shuffle。MetaMix线性组合了来自支持集和查询集的样本的特性和标签。对于每一类样本,Channel Shuffle随机地用来自不同类的对应的信道子集替换它们的信道子集。

4.论文名称:Large-Scale Meta-Learning with Continual Trajectory Shifting

论文链接:https://www.aminer.cn/pub/602ba44091e0113d72356cf8?f=cs

我们证明,允许元学习者采取更多的内部梯度步骤,可以更好地捕获异构和大规模任务分布的结构,从而获得更好的初始化点。此外,为了增加元更新的频率,即使内部优化轨迹过长,我们提出估计任务特定参数的变化所需的初始化参数的变化。

5.论文名称:PACOH: Bayes-Optimal Meta-Learning with PAC-Guarantees

论文链接:https://www.aminer.cn/pub/60bdde338585e32c38af4ef5?f=cs

我们利用PAC-Bayesian框架进行了理论分析,并导出了新的元学习泛化边界。利用这些边界,我们开发了一类具有性能保证和有原则的元级正则化的pac最优元学习算法。当用高斯过程和贝叶斯神经网络作为基础学习者实例化我们的pac -最优超后验(PACOH)时,所得到的方法在预测精度和不确定性估计的质量方面都取得了最先进的性能。

<10>Multi-Agent Reinforcement Learning

1.论文名称:Scaling Multi-Agent Reinforcement Learning with Selective Parameter Sharing

论文链接:https://www.aminer.cn/pub/602baf5491e0113d72356dfc?f=cs

我们演示了参数共享方法对训练速度和收敛收益的影响,建立了当不加选择地应用时,它们的有效性高度依赖于环境。因此,我们提出了一种新的方法,通过对智能体的能力和目标进行划分,自动识别可能受益于共享参数的智能体。

2.论文名称:Learning Fair Policies in Decentralized Cooperative Multi-Agent Reinforcement Learning

论文链接:https://www.aminer.cn/pub/60bdde338585e32c38af528b?f=cs

我们提出了一种新的神经网络结构,它由两个专门设计的子网络组成,以考虑公平性的两个方面。在实验中,我们证明了两个子网络对公平优化的重要性。我们的总体方法是通用的,因为它可以容纳任何 (sub)differentiable welfare函数。

3.论文名称:Coach-Player Multi-Agent Reinforcement Learning for Dynamic Team Composition

论文链接:https://www.aminer.cn/pub/60a4ff9f91e011e398b0d13f?f=cs

在现实世界的多智能体系统中,具有不同能力的智能体都可以加入或离开某个团队,却不改变其首要目标。协调这种动态构成的团队是具有挑战性的:最优的团队策略随着构成的不同而不断变化。因此,我们提出了COPA,一个coach-player框架,来解决这个问题。

4.论文名称:Emergent Social Learning via Multi-agent Reinforcement Learning

论文链接:https://www.aminer.cn/pub/60bdde338585e32c38af5039?f=cs

本文研究了多智能体环境下,独立强化学习(RL)智能体是否可以学会利用社会性学习来提高其性能。通过混合多智能体和单独训练,我们可以获得使用社会性学习来获得技能的智能体,它们可以单独部署,甚至从一开始就比单独训练的智能体表现更好。

5.论文名称:Randomized Entity-wise Factorization for Multi-Agent Reinforcement Learning

论文链接:https://www.aminer.cn/pub/60bdde338585e32c38af4f2a?f=cs

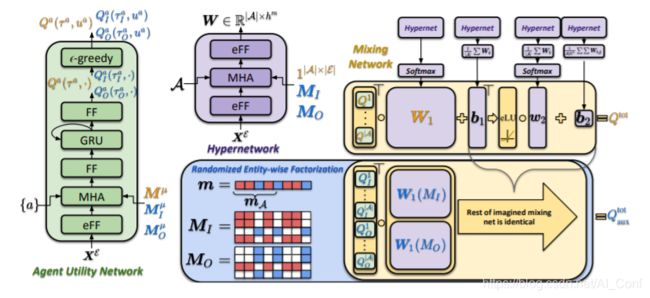

现实世界中,多智能体的设置经常涉及具有不同类型和数量的智能体和非智能体实体的任务;然而,在这些实体中经常会出现共同的行为模式。我们提出一个反事实的问题“当只考虑一个随机选择的观察实体的子组时,每个代理的预期效用是什么?”由此识别出,我们可能在另一个任务中遇到的实体亚组中的状态-行为轨迹,并利用我们在该任务中所学到的信息来预测当前任务。

<11>Representation Learning

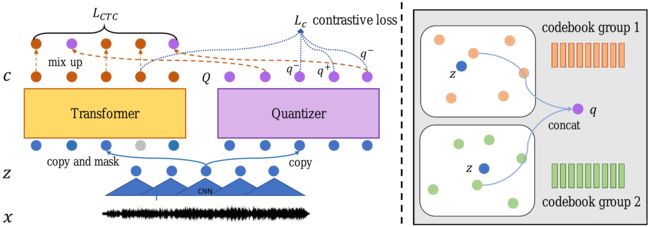

1.论文名称:UniSpeech: Unified Speech Representation Learning with Labeled and Unlabeled Data

论文链接:https://www.aminer.cn/pub/6008014091e011d056eee7a9?f=cs

我们提出了一种统一的前训练方法UniSpeech来学习无标记和有标记数据的语音表示,其中监督语音CTC学习和语音感知对比自我监督学习以多任务的学习方式进行。所产生的表示可以捕获与语音结构相关程度更高的信息,并改进跨语言和领域的泛化。

2.论文名称:Decomposed Mutual Information Estimation for Contrastive Representation Learning

论文链接:https://www.aminer.cn/pub/60bdde338585e32c38af51fa?f=cs

我们提出通过将一个视图分解成具有更多信息的子视图,并在分解后的视图之间应用链式法则的方法,将完整的MI估计问题分解成一系列较小的估计问题。这个表达式包含了无条件和有条件MI项的和,每个测量总的MI的适度块,这有助于通过对比界近似。

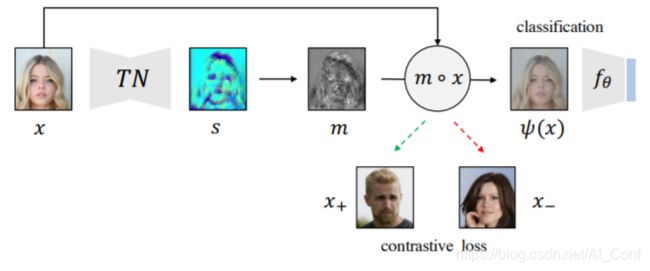

3.论文名称:Robust Representation Learning via Perceptual Similarity Metrics

论文链接:https://www.aminer.cn/pub/60bdde338585e32c38af5153?f=cs

我们提出了对比输入变形(CIM),一个表示学习框架,学习数据的输入空间转换,以减轻不相关的输入特征对下游性能的影响。我们的方法通过一个三元组损失来利用感知相似性度量,以确保转换保留任务相关的信息。通过经验,我们证明了我们的方法在任务上的有效性。

4.论文名称:Scaling Up Visual and Vision-Language Representation Learning With Noisy Text Supervision

论文链接:https://www.aminer.cn/pub/60bdde338585e32c38af4ed8?f=cs

我们利用了一个超过10亿图像替代文本对的噪声数据集,在概念性标题数据集中无需昂贵的过滤或后处理步骤即可获得。我们的视觉表示在转换到ImageNet和VTAB等分类任务时获得了强大的性能。

5.论文名称:Near-Optimal Representation Learning for Linear Bandits and Linear RL

论文链接:https://www.aminer.cn/pub/60bdde338585e32c38af4eba?f=cs

我们将算法和分析扩展到低固有Bellman误差下线性值函数逼近的多任务情景RL。据我们所知,这是第一个描述多任务表示学习对RL中使用函数近似进行探索的好处的理论结果。

<12>Network

1.论文名称:Learning Diverse-Structured Networks for Adversarial Robustness

论文链接:https://www.aminer.cn/pub/601bbfd191e011fcd67ef1b4?f=cs

我们认为NA和AT不能独立处理,因为给定一个数据集,ST中的最优NA将不再是AT中的最优NA。AT本身就是耗时的,而且在较大的搜索空间中直接搜索NAs是不可行的。因此,我们提出了一个不同结构的网络(DS-Net),以显著减少搜索空间的大小。

2.论文名称:Scaling Properties of Deep Residual Networks

论文链接:https://www.aminer.cn/pub/60b03f7491e0118b560feb1a?f=cs

我们通过详细的数值实验研究了随机梯度下降训练权值的性质,以及它们随网络深度的变换。根据网络结构的某些特征,如激活函数的光滑性,人们可以得到另一个ODE极限,一个随机微分方程,或者两者都不能。这些发现对神经ODE模型作为深度ResNets的充分渐近描述的有效性提出了质疑,并指出了另一类微分方程作为深度网络极限的更好描述。

3.论文名称:Dense for the Price of Sparse: Improved Performance of Sparsely Initialized Networks via a Subspace Offset

论文链接:https://www.aminer.cn/pub/602bb7dc91e0113d72356eb0?f=cs

我们引入了一种新的“DCT plus Sparse”层结构,在只剩下0.01%可训练核参数的情况下,也能保持信息传播和可训练性。我们展示了用这些层构建并在初始化时进行修剪的网络的标准训练,在各种基准网络架构和数据集上实现了最先进的极端稀疏性精度。

4.论文名称:Weisfeiler and Lehman Go Topological: Message Passing Simplicial Networks

论文链接:https://www.aminer.cn/pub/6042234f91e0115d09aff3c1?f=cs

在图机学习中,单靠图片不能捕获许多复杂系统中出现的多层次交互,而且其表达能力也被证明是有限的。为了克服这些限制,我们提出了消息传递简单网络(MPSNs),这是一类在简单复合体(SCs)上执行消息传递的模型。为了从理论上分析模型的表达性,我们引入了一种用于区分非同构SCs的单纯维斯菲尔勒-雷曼(SWL)着色程序。

5.论文名称:A Modular Analysis of Provable Acceleration via Polyak’s Momentum: Training a Wide ReLU Network and a Deep Linear Network

论文链接:https://www.aminer.cn/pub/60bdde338585e32c38af5184?f=cs

在本文中,我们首先回应了strongly convex quadratic问题,并证明了一个非渐近加速的Polyak动量线性速率。然后,我们证明了Polyak动量可以实现对单层宽ReLU网络和深度线性网络的加速训练,这可能是文献中最流行的两种研究优化和深度学习的典型模型。

<13>Gaussian Process

1.论文名称:High-Dimensional Gaussian Process Inference with Derivatives

论文链接:https://www.aminer.cn/pub/602bb20691e0113d72356e3f?f=cs

我们证明了在低数据条件KaTeX parse error: Expected 'EOF', got '&' at position 2: N&̲lt;D中,Gram矩阵可以以一种方式分解,从而将推理成本降低到 O ( N 2 D + ( N 2 ) 3 ) \mathcal{O}(N^2D + (N^2)^3) O(N2D+(N2)3)(即维度数是线性的),在特殊情况下,可以降低到 O ( N 2 D + N 3 ) \mathcal{O}(N^2D + N^3) O(N2D+N3)。这种复杂性的降低为使用梯度进行推理提供了新的用例,特别是在高维条件下,梯度观测的信息成本比显著增加。

2.论文名称:Value-at-Risk Optimization with Gaussian Processes

论文链接:https://www.aminer.cn/pub/609e50b591e0113e7e2e00cd?f=cs

本文提出了一种新的保证黑盒目标函数的VaR最大置信限(V-UCB)算法。为了实现这一点,我们首先推导出VaR的置信限,然后证明环境随机变量值的存在性(选择环境随机变量可以实现无悔),使VaR的置信限在目标函数在此值下的置信限之内。

3.论文名称:Scalable Variational Gaussian Processes via Harmonic Kernel Decomposition

论文链接:https://www.aminer.cn/pub/60bdde338585e32c38af521d?f=cs

我们提出调和核分解(HKD),它利用傅里叶级数将一个核分解为正交核的和。我们的变分近似利用这种正交性,以较低的计算成本实现大量诱导点。我们证明了,在一系列回归和分类问题上,我们的方法可以利用输入空间的对称性,如平移和反射,并且它在可伸缩性和准确性方面显著优于标准变分方法。

4.论文名称:Lenient Regret and Good-Action Identification in Gaussian Process Bandits

论文链接:https://www.aminer.cn/pub/60264a4891e011821e023aff?f=cs

我们研究了各种各样的\emph{\lenient regret}概念,其中所有接近最优的行为都招致零惩罚,并为GP-UCB提供了\emph{\lenient regret}的上界和一个消除算法,避免了通常的 O ( √ T ) O(√{T}) O(√T)项(时间范围 T T T)由于极大接近函数最大值而导致的结果。

5.论文名称:Bias-Free Scalable Gaussian Processes via Randomized Truncations

论文链接:https://www.aminer.cn/pub/602a4f4391e011a1a44cbe97?f=cs

本文分析了两种常用的技术:早期截断共轭梯度(CG)和随机傅里叶特征(RFF)。我们发现两种方法都对学习的超参数引入了系统性偏差:CG倾向于欠拟合,而RFF倾向于过拟合。我们使用随机截断估计来解决这些问题,消除偏差以换取增加的方差。

<14>Sample Complexity

1.论文名称:On the Sample Complexity of Causal Discovery and the Value of Domain Expertise

论文链接:https://www.aminer.cn/pub/6021172891e0113bfb1dc666?f=cs

我们在没有CI oracle的情况下分析了因果发现算法的样本复杂性。我们的方法允许我们根据数据样本来量化领域专业知识的价值。最后,我们用数值例子证明了这些样本率的准确性,并量化稀疏性先验和已知因果方向的好处。

2.论文名称:Towards Tight Bounds on the Sample Complexity of Average-reward MDPs

论文链接:https://www.aminer.cn/pub/60bdde338585e32c38af5209?f=cs

在生成模型的条件下,我们证明了无限视界平均回报马尔科夫决策过程(MDP)中![]()

最优策略的样本复杂度的新上界和下界。当所有策略的概率转移矩阵的混合时间不超过![]()

时,我们提出了一种利用每个状态-动作对的![]()

(oblivious)样本来解决该问题的算法。

3.论文名称:A Lower Bound for the Sample Complexity of Inverse Reinforcement Learning

论文链接:https://www.aminer.cn/pub/60475b4891e0116b67c79198?f=cs

本文给出了有限状态、有限作用IRL问题的样本复杂度的信息理论下界。研究了用球码构造![]()

-严格可分离IRL问题的几何结构。导出了系综尺寸的性质以及产生的轨迹间的kullbak - lebler散度。

4.论文名称:Tightening the Dependence on Horizon in the Sample Complexity of Q-Learning

论文链接:https://www.aminer.cn/pub/602a47e991e011a1a44cbe04?f=cs

对于任何![]()

,我们将同步Q-learning的样本复杂度提高到![]()

(最高可达对数因子),从而导致有效层位![]()

的有序改进。我们分析的一个关键因素在于建立新的错误分解和递归,这可能有助于分析其他Q-learning变量的有限样本性能。

5.论文名称:Exponential Reduction in Sample Complexity with Learning of Ising Model Dynamics

论文链接:https://www.aminer.cn/pub/606adc0a91e011f23f9096a2?f=cs

我们研究由动态过程产生的相关样本重建二值图形模型的问题,这在许多应用中是很自然的。我们分析了基于交互筛选目标和条件似然损失的两种估计的样本复杂度。我们观察到,对于来自远离平衡的动态过程的样本,与快速混合的动态过程相比,样本复杂度呈指数级下降。

<15>Machine Learning

1.论文名称:Model-Based Reinforcement Learning via Latent-Space Collocation

论文链接:https://www.aminer.cn/pub/604f1e209e795e5feaac5530?f=cs

我们提出了一种利用概率潜在变量模型使搭配适应于视觉规划的规划算法。在具有稀疏奖励和长期目标的具有挑战性的视觉控制任务中,采用我们规划算法的基于模型的强化学习agent显著优于先前的基于模型的agent。

我们提出了一种利用概率潜在变量模型使搭配适应于视觉规划的规划算法。在具有稀疏奖励和长期目标的具有挑战性的视觉控制任务中,采用我们规划算法的基于模型的强化学习agent显著优于先前的基于模型的agent。

2.论文名称:Exploiting structured data for learning contagious diseases under incomplete testing

论文链接:https://www.aminer.cn/pub/60501a3c9e795e8427406a43?f=cs

我们的分析表明,在有利的条件下,不完全测试可能足以实现相对较好的样本外预测误差。当未经检测的感染者具有与未经检测的健康者完全不同的特征,当被感染的人“强大”,这意味着他们感染了周围的大多数人时,有利的条件就出现了。我们开发了一种预测感染的算法,并证明它在模拟数据上优于基准。

3.论文名称:Decoupling Exploration and Exploitation for Meta-Reinforcement Learning without Sacrifices

论文链接:https://www.aminer.cn/pub/6051a93e9e795e94b6414afe?f=cs

原则上,通过最大化任务性能,可以端到端学习最佳的探索和开发。然而,学习探索需要良好的开发来衡量探索的效用,但学习开发需要通过探索收集信息。优化勘探和开发的单独目标可以避免这个问题,但是先前的元rl勘探目标会产生收集与任务无关的信息的次优策略。我们通过构建自动识别任务相关信息的开发目标和仅恢复此信息的探索目标来缓解这两个问题。

4.论文名称:Self-supervised and Supervised Joint Training for Resource-rich Machine Translation

论文链接:https://www.aminer.cn/pub/6054578d9e795e40330f45ab?f=cs

在本文中,我们提出了一种联合训练方法F2-XEnDec,将自监督和监督学习相结合来优化NMT模型。为了利用互补的自监督信号进行监督学习,NMT模型通过一种称为交叉编码器-解码器的新过程,在单语和并行句子的样本上进行训练。

5.论文名称:Knowledge Enhanced Machine Learning Pipeline against Diverse Adversarial Attacks

论文链接:https://www.aminer.cn/pub/60bdde338585e32c38af520d?f=cs

我们提出了一种知识增强机器学习管道(KEMLP),通过一阶逻辑规则将领域知识(即不同预测之间的逻辑关系)集成到概率图形模型中。我们通过将一组基于其逻辑关系的弱辅助模型集成到执行目标任务的主DNN模型来开发KEMLP。

<16>Sparse

1.论文名称:Leveraging Sparse Linear Layers for Debuggable Deep Networks

论文链接:https://www.aminer.cn/pub/609bafab91e0113c3c76936c?f=cs

我们展示了如何拟合稀疏线性模型在学习的深度特征表示可以导致更多的可调试神经网络。这些网络保持了高度的准确性,同时也更容易被人类解释,正如我们通过数字和人体实验定量地证明的那样。

2.论文名称:Do We Actually Need Dense Over-Parameterization? In-Time Over-Parameterization in Sparse Training

论文链接:https://www.aminer.cn/pub/602101eb91e0113bfb1dc4e3?f=cs

在本文中,我们通过提出在稀疏训练中实时过参数化(ITOP)的概念,引入了一种新的视角来训练具有最先进性能的深度神经网络,而不需要昂贵的过参数化。从一个随机稀疏网络出发,在训练过程中不断探索稀疏连通性,可以对时空流形进行过参数化,缩小稀疏训练和密集训练之间的表达性差距。

3.论文名称:Mind the box: l 1 l_1 l1-APGD for sparse adversarial attacks on image classifiers

论文链接:https://www.aminer.cn/pub/603f5b8b91e011cacfbda26e?f=cs

我们证明,当同样考虑图像域 [ 0 , 1 ] d [0,1]^d [0,1]d时,所建立的$ l1 − 投 影 梯 度 下 降 ( P G D ) 攻 击 是 次 优 的 , 因 为 它 们 没 有 考 虑 到 有 效 的 威 胁 模 型 是 -投影梯度下降(PGD)攻击是次优的,因为它们没有考虑到有效的威胁模型是 −投影梯度下降(PGD)攻击是次优的,因为它们没有考虑到有效的威胁模型是 l1 − b a l l 和 -ball和 −ball和[0,1]^d$的交集。我们研究了该有效威胁模型的最陡下降阶跃的期望稀疏性,并证明了对该集合的精确投影在计算上是可行的,并产生更好的性能。

4.论文名称:Sparse and Imperceptible Adversarial Attack via a Homotopy Algorithm

论文链接:https://www.aminer.cn/pub/60bdde338585e32c38af4f6a?f=cs

我们提出了一种同伦算法,在一个统一的框架内共同处理稀疏性和扰动界。每次迭代,我们的算法的主要步骤是通过利用非单调加速近端梯度法(nmAPG)对非凸规划优化一个l_0正则化的对抗损失;接下来是一个l_0更改控制步骤,以及一个可选的攻击后步骤,用于避免糟糕的局部最小值。我们还将算法扩展到结构稀疏正则化的处理。

5.论文名称:SigGPDE: Scaling Sparse Gaussian Processes on Sequential Data

论文链接:https://www.aminer.cn/pub/609a2c5791e011a44725cb08?f=cs

我们开发了SigGPDE,一个新的可扩展稀疏变分推理框架,用于序列数据上的高斯过程(GPs)。首先,我们构造支持稀疏逼近的诱导变量,使结果证据下界(ELBO)不需要任何矩阵反演。其次,我们证明GP签名核的梯度是一个双曲偏微分方程(PDE)的解。

<17>High-Dimensional

1.论文名称:Classifying high-dimensional Gaussian mixtures: Where kernel methods fail and neural networks succeed

论文链接:https://www.aminer.cn/pub/60362ef591e011703cfaf91d?f=cs

我们从理论上证明了只有少量隐藏神经元的两层神经网络(2LNN)在简单高斯混合分类任务上的性能优于核学习。我们研究了样本数量与输入维数成线性比例的高维极限,并表明,虽然小2LNN在这个任务上获得了接近最优的性能,但懒惰训练方法,如随机特征和核方法不能。

2.论文名称:Snowflake: Scaling GNNs to High-Dimensional Continuous Control via Parameter Freezing

论文链接:https://www.aminer.cn/pub/603f512991e011cacfbda1a7?f=cs

我们确定了导致糟糕伸缩性的常见GNN体系结构的弱点:在编码、解码和传播消息的网络中的mlp中过拟合。为了解决这个问题,我们引入了Snowflake,一种用于高维连续控制的GNN训练方法,它冻结了网络中存在过拟合的部分参数。Snowflake显著提高了GNN在大型代理上的运动控制性能,现在与MLP的性能相匹配,并具有优越的传输特性。

3.论文名称:Solving high-dimensional parabolic PDEs using the tensor train format

论文链接:https://www.aminer.cn/pub/603633b991e011703cfaf975?f=cs

在本文中,我们认为张量系为抛物偏微分方程提供了一个吸引人的近似框架:将倒向随机微分方程和张量格式的回归型方法的重新公式结合起来,有望利用潜在的低秩结构,使其既能压缩又能高效计算。根据这个范式,我们开发了新的迭代方案,包括显式和快速或隐式和准确的更新。

4.论文名称:High-Dimensional Gaussian Process Inference with Derivatives

论文链接:https://www.aminer.cn/pub/602bb20691e0113d72356e3f?f=cs

在低数据条件KaTeX parse error: Expected 'EOF', got '&' at position 2: N&̲lt;D中,Gram矩阵可以以一种方式分解,从而将推理成本降低到 O ( N 2 D + ( N 2 ) 3 ) \mathcal{O}(N^2D + (N^2)^3) O(N2D+(N2)3)(即维度数是线性的),在特殊情况下,可以降低到 O ( N 2 D + N 3 ) \mathcal{O}(N^2D + N^3) O(N2D+N3)。这种复杂性的降低为使用梯度进行推理提供了新的用例,特别是在高维条件下,在高维条件下,梯度观测的信息成本比显著增加。

5.论文名称:Multiscale Invertible Generative Networks for High-Dimensional Bayesian Inference

论文链接:https://www.aminer.cn/pub/609cfb7e91e01118a99b936d?f=cs

在两个高维贝叶斯逆问题上,我们展示了MsIGN方法在后验逼近和多模式捕获方面优于以往的方法。在自然图像合成任务中,MsIGN比基线模型在每维比特数上取得了更好的性能,并且在中间层产生了良好的神经元解释能力。

<18>Policy Optimization

1.论文名称:OptiDICE: Offline Policy Optimization via Stationary Distribution Correction Estimation

论文链接:https://www.aminer.cn/pub/60bdde338585e32c38af5197?f=cs

在本文中,我们提出了一种离线RL算法,以更有原则的方式防止高估。我们的算法OptiDICE,直接估计最优策略的平稳分布修正,不依赖于策略梯度,不像以前的离线RL算法。通过使用广泛的基准数据集进行离线RL,我们展示了OptiDICE与最先进的方法的性能竞争。

2.论文名称:On Proximal Policy Optimization’s Heavy-tailed Gradients

论文链接:https://www.aminer.cn/pub/6034cbf991e01122c046f657?f=cs

在本文中,我们提出了一个详细的实证研究来描述PPO代理报酬函数梯度的重尾性质。我们证明了梯度,特别是对于行动者网络,表现出明显的重尾性,并且随着代理的策略偏离行为策略(即随着代理进一步偏离策略),梯度会增加。进一步的研究表明,替代奖励的似然比和优势是所观察到的重尾性的主要来源。

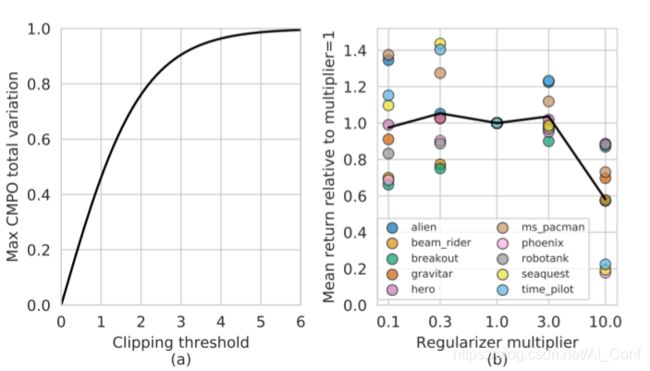

3.论文名称:Muesli: Combining Improvements in Policy Optimization

论文链接:https://www.aminer.cn/pub/6076c02691e0113d725743ae?f=cs

我们提出了一种新的策略更新,将正则化策略优化与模型学习相结合作为辅助损失。更新(从今以后的Muesli)匹配了MuZero在Atari的最先进的性能。值得注意的是,Muesli没有使用深度搜索:它直接与政策网络起作用,其计算速度可与无模型基线相媲美。

<19>Graph

1.论文名称:Graph Convolution for Semi-Supervised Classification: Improved Linear Separability and Out-of-Distribution Generalization

论文链接:https://www.aminer.cn/pub/602b974491e0113d72356bff?f=cs

一种新的学习模型已经出现,它在最基本的层面上依赖于首先应用图卷积后对数据进行分类。为了理解这种方法的优点,我们研究了混合高斯分类,其中数据对应于随机块模型的节点属性。我们证明,与混合模型数据本身相比,图卷积扩展了数据线性可分的范围,其中 D D D是一个节点的期望度。

2.论文名称:DeepWalking Backwards: From Embeddings Back to Graphs

论文链接:https://www.aminer.cn/pub/602e350891e01144a29ccc8b?f=cs

很少有人研究流行的嵌入方法到底对什么信息进行了编码,以及这些信息如何与下游机器学习任务的表现相关。我们通过研究嵌入是否可以(近似地)恢复用于生成它们的图来解决这个问题。