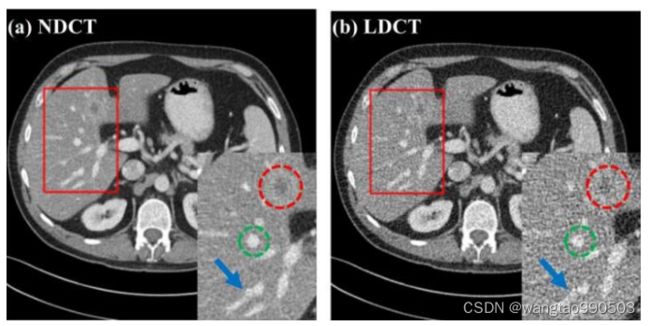

Artifact and Detail Attention Generative AdversarialNetworks for Low-Dose CT Denoising阅读笔记

目录

摘要

介绍

方法

A. Generator Architecture

B. Discriminator Structure

C. Loss Function

实验结果和分析

A. Experimental Settings

B. Parameter Selection

摘要

- 提出了一种多通道生成器:主特征提取通道+伪影和噪声关注通道+边缘噪声关注通道。

- 提出了一种称为多尺度Res2Net鉴别器的新结构,通过提取图像同一尺度下的多尺度特征来扩展模块中的感受野,以提高鉴别器的鉴别能力。

- 根据上述革新,设计了专门的损失函数。

介绍

作者分别分析了传统、CNN、GAN在该领域的进展:传统方法输出图像过于平滑或引入新的噪声,算法的鲁棒性和泛化能力有待提高;CNN的特征提取能力受到数据集、硬件资源和运行时间的限制,只有在大的情况下才能获得更好的去噪结果;GAN网络的稳定性有待提高。

此文主要贡献如下:

-

提出了一种多通道训练生成器结构。在主特征提取通道的基础上,增加了伪影和噪声注意通道以及边缘特征注意通道,以提高对不同类型信息的分类和处理能力。

-

在伪影和噪声注意通道中,设计了一个基于LSTM的递归注意子网络来捕捉条纹伪影的周期性变化,从而提高网络对条纹伪影的估计能力。在边缘特征注意通道中,设计了边缘特征提取模块来捕获LDCT图像的边缘特征,从而弥补多级去噪带来的边缘和结构信息的损失。

-

为了提高鉴别器的能力和生成对抗网络的稳定性,提出了一种多尺度Res2Net鉴别器,该鉴别器能够在多个尺度上表达图像特征,并扩展了网络各层的感受野。

-

为了保证网络的整体去噪性能,除了传统的全局L1损失外,还针对去噪网络的每个子通道提出了与其功能相对应的改进损失函数。

方法

本文提出的网络的工作分为两部分,两者相互补充:

- 去噪:将LDCT图像输入到主特征提取通道,获取图像的主要特征,保证了网络的基本去噪功能。其次,为了提高网络提取噪声和伪影的能力,将伪影和噪声注意通道提取的伪影掩模图像作为辅助特征发送到主特征提取子通道以获得伪影图像。最后,从LDCT图像中减去所生成的伪影图像,以获得初步去噪图像。

- 边缘增强:考虑到图像的边缘信息可能在多次去噪过程中丢失和过平滑,边缘特征注意通道提取的特征图用于补充初步去噪图像的边缘特征。

A. Generator Architecture

如图2所示。在去噪过程中,主要特征提取通道用于提取图像的主要特征,伪影和噪声注意通道和边缘特征注意通道用于提取补充特征,然后输入到主要特征通道。伪影和噪声注意通道用于从LDCT图像中提取干扰信息的掩蔽特征。边缘特征注意通道用于从LDCT图像中提取有用信息的特征,例如组织边缘细节。

三个特征提取通道具体结构如下:

- 主特征提取通道:由前端、中端、末端三部分组成。通道前端包括三个密集连接的模块,内核大小分别为3 × 3、5 × 5和7 × 7。这种设计保证了去噪网络对图像主要特征的有效提取。中间部分由具有不同感受野的四个并行下采样-上采样组成。在下采样过程中,平均池层的核大小分别为32 × 32、16 × 16、8 × 8和4 × 4。在上采样过程中,采用最近插值方法将特征上采样到它们的原始大小。在下采样和上采样之间使用具有两个滤波器的卷积层,核大小为1 × 1,步长为1。末端细化网络包括两个卷积层,步长为1,核大小为7 × 7 和 3 × 3。第一个卷积层有八个滤波器,然后是ReLU。第二个卷积层有三个滤波器,然后是Tanh。

- 伪影和噪声注意通道: 考虑到CT图像中的条纹伪影具有周期性变化,作为一种特殊的递归神经网络,具有记忆功能的LSTM适合处理具有周期性变化的信号,它可以有效地从具有一定顺序的样本中学习规则。受循环注意思想的启发,设计了基于LSTM的循环注意模块来提取伪像和噪声掩模特征,以提高网络注意LDCT中的伪像和噪声的能力。它的损失函数使用伪像掩模的约束。生成二值伪像掩模的过程如下:首先,从LDCT中减去NDCT,得到理想的伪像图像。其次,采用自适应阈值获得二值伪影掩模,即将阈值以上的像素值设为1,阈值以下的像素值设为0,以此来判断像素是否属于伪影区域。在本文中,Otsu_threshold算法用于在迭代期间自适应地选择对应于最小类内方差的最佳阈值。其结构包括四个回路。每个环路由5个ResNets、1个LSTM单元和1个卷积层组成[32],这保证了网络的多尺度和多级伪影特征提取以及其提取周期性伪影特征的能力。

- 边缘特征注意通道: 该通道使用由总方差生成的NDCT的边缘特征图作为约束。该通道的结构包括两个边缘特征提取块。每个边缘特征提取块由一个卷积层组成,其中卷积核的大小为3 × 3,步长为1。这种设计保证了网络能够有效地提取LDCT图像的边缘和细节。

整体过程个人猜想:主特征通道的前端输出与伪影通道的输出掩膜按照元素相乘得到伪影与噪声图像,经过中端和后端处理后,输出残差图,用LDCT与之相减得到生成的干净图像,最后于边缘特征通道的结果结合,形成最终输出的干净图像。

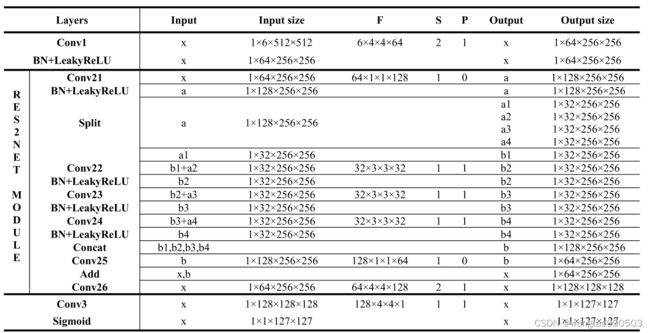

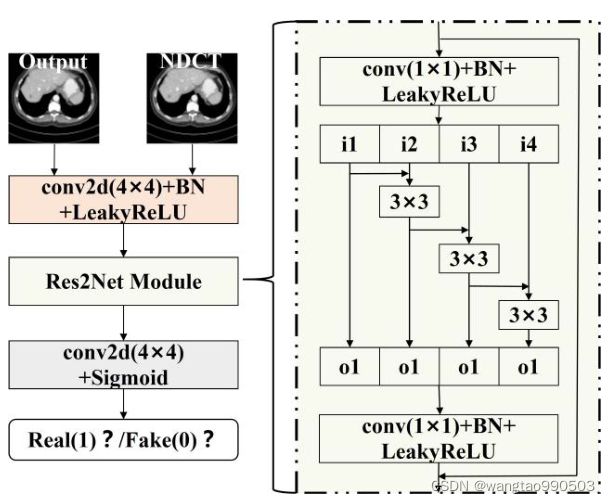

B. Discriminator Structure

通过在鉴别器的设计中引入Res2Net模块,我们设计了一个多尺度Res2Net鉴别器,它可以在给定的残差块中进行多尺度特征提取。

如图3和表1所示,所提出的鉴别器包含3层。鉴别器的第一层采用卷积核大小为4 × 4、步长为2的卷积运算,以减少网络计算量,扩大感受野。第二层由Res2Net模块组成,用于提取图像同一尺度特征块中的多尺度特征。鉴别器的第三层采用卷积核大小为4×4、步长为1的卷积运算,并在卷积层后增加了一个sigmoid激活函数。具体流程如下:

-

用128个核,每个核大小为1 × 1,步长为1进行卷积运算,实现特征维数变换。

-

变换后的128个特征被平均分成四组,每组包括32个通道用于处理。第一组特征保持不变,并直接添加到第二组特征中。组合后的特征馈入卷积层,其核大小为3 × 3,步长为1,填充为1,用于处理。此外,前一通道的已处理特征和下一通道的未处理特征被加在一起,并被用作下一通道的输入。相应的缩放操作被连续执行,并且相同的操作被重复四次。

-

将所有中间特征级联,用1 × 1的卷积核大小实现降维。

-

利用跨层连接的思想实现深层特征和浅层特征的融合,可以在一定程度上缓解训练过程中产生的梯度消失或梯度爆炸的问题。

本文提出的多尺度Res2Net鉴别器通过增加网络在模块中的感受野来减少网络参数,提高鉴别器的特征提取能力,从而可以利用同一尺度中的特征。

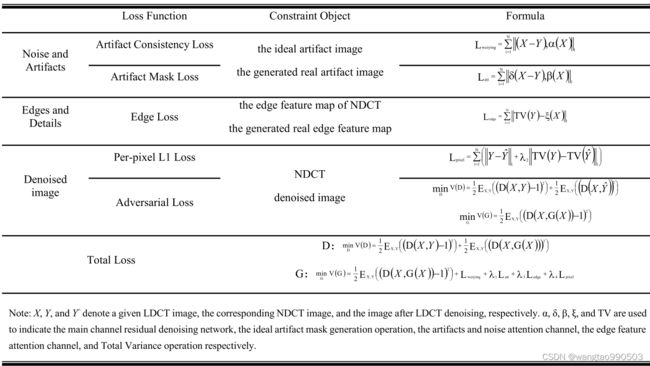

C. Loss Function

本文使用不同的损失函数去训练不同的通道,这些函数分为三类:

表2. 损失函数

表2. 损失函数

注:X、Y和Y分别表示给定的LDCT图像、相应的NDCT图像和LDCT去噪后的图像。α、δ、β、ζ和TV分别表示主信道残差去噪网络、理想伪影掩模生成操作、伪影和噪声注意通道、边缘特征注意信道和总变异操作。

- 为了提高伪影和噪声注意通道的能力,提出了一种伪影掩模损失函数。如表2中的第二个公式所示,其中伪影掩模损失的约束对象是理想伪影图像的二值掩模图像等于真实伪影图像的二值掩模图像。

- 边缘损失的设计是为了保证边缘特征注意通道提取的LDCT的边缘特征图接近NDCT的边缘特征图。

- 对于主特征通道,使用了三个损失函数:

-

伪影一致性损失:其约束对象是理想伪影图像和真实伪影图像。伪影一致性损失用于确保生成的理想伪影图像尽可能接近真实伪影图像。

-

逐像素L1损失:由数据保真度项和惩罚项组成,用于确保多通道生成器生成的最终图像的质量。

-

对抗性损失。

-

实验结果和分析

A. Experimental Settings

数据集:

- AAPM. (2017). Low Dose CT Grand Challenge.[Online].Available:http://www.aapm.org/GrandChallenge/LowDoseCT/

- C. McCollough, “TU-FG-207A-04: Overview of the low dose CT grand

challenge,” Med. Phys., vol. 43, no. 6, pp. 3759–3760, 2016. - Piglet Dataset. [Online]. Available: http://homepage.usask.ca/?xiy525/

publication/sagan/

对比算法:

- BM3D

- REDCNN

- GAN-based pix2pix

-

HFSGAN

-

SiameseGAN

-

w/o Att: 刨除伪像和噪声注意通道的ADAGAN

-

w/o TV:刨除边缘特征注意通道的ADAGAN

-

w/o MultiD:将多尺度Res2Net鉴别器子网替换为传统鉴别器的ADAGAN

三个指标,包括峰值信噪比(PSNR) [37],结构相似性指数措施(SSIM)和视觉信息保真度(VIF) [38]被选为图像质量的定量评估。

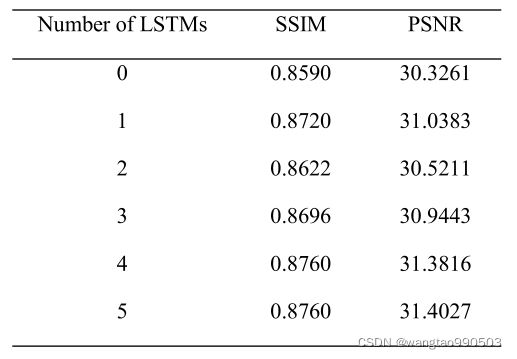

B. Parameter Selection

使用Adam,设置如下:学习率![]() ,两个指数衰减因子

,两个指数衰减因子![]() 和

和![]() 。

。

图像的输入尺寸为512×512。训练和测试批量为1。

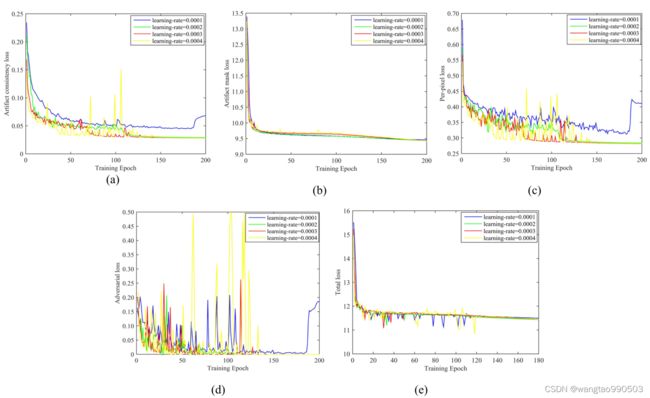

有四个超参数λ1、λ2、λ3和λ4:λ2控制基于总变异(TV)的正则化项和每像素L1损失保真度项之间的权衡,而λ1、λ3和λ4分别控制伪像掩模损失、边缘损失和每像素L1损失在总损失中的权重。经过实验,λ3和λ4取相同值,λ1、λ2对实验结果有显著影响,因此做了许多实验,分析训练过程中损失函数的变化曲线,以及不同参数设置下去噪结果的PSNR和SSIM值,如图4。

图4. (a)不同超参数设置下的网络收敛曲线。(b)降噪结果的平均SSIM-λ1、SSIM-λ2、PSNR-λ1和PSNR-λ2曲线:横坐标是λ1的值,纵坐标是PSNR(或SSIM)的值;随着λ1 ( o或λ2)的增加,SSIM值也发生变化,如不同形状的红色曲线所示;随着λ1 ( o或λ2)的增加,PSNR值表现为不同形状的蓝色曲线;(c)和(d)分别改变λ1和λ2时,所有去噪结果的平均PSNR和SSIM值

图4. (a)不同超参数设置下的网络收敛曲线。(b)降噪结果的平均SSIM-λ1、SSIM-λ2、PSNR-λ1和PSNR-λ2曲线:横坐标是λ1的值,纵坐标是PSNR(或SSIM)的值;随着λ1 ( o或λ2)的增加,SSIM值也发生变化,如不同形状的红色曲线所示;随着λ1 ( o或λ2)的增加,PSNR值表现为不同形状的蓝色曲线;(c)和(d)分别改变λ1和λ2时,所有去噪结果的平均PSNR和SSIM值

考虑到两个损失函数在网络中的作用以及去噪图像的SSIM和PSNR值的性能,本文采用了以下设置:λ1 = 25,λ2 = 0.5,λ3 = 10,λ4 = 10。

根据图5的观察选取0.0002为学习率。

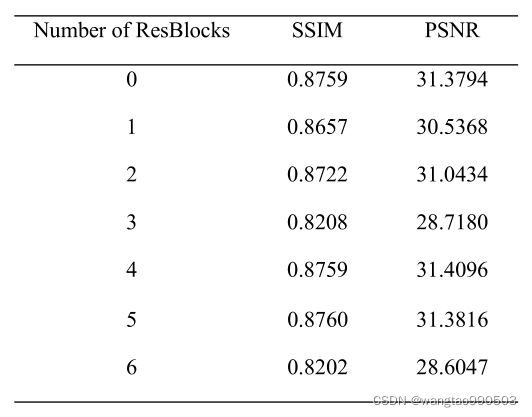

作者又针对伪影和噪声关注通道中LSTMs的数量和每个循环的ResBlock数量做了实验,最终取了4个LSTM和5个ResBlock,与上文同。

而后作者又对比了鉴别器中最后一个卷积层的卷积核大小和步长大小对网络性能的影响,发现卷积核在4x4时达到最优,步长在1时达到最优,与上文呼应。

PS:作者大大太肝了!!!!!!

后续就是作者在三个数据集上去噪成果的展示(实验量真的很大)感兴趣的读者可以看看原著,在此就不多记录了。感谢各位的耐心阅读,下篇见!