机器学习题目汇总

1. 深度学习中的激活函数需要具有哪些属性?

- 计算简单

- 非线性

- 具有饱和区

- 几乎处处可微

ABD。解析:(1)非线性:导数不能是常数。(2)几乎处处可微:sigmoid处处可微,ReLU仅在有限点处不可微)。(3)计算简单。(4)非饱和性:Sigmoid存在饱和区,存在梯度消失问题,后来提出了relu。(5)单调性。(6)输出范围有限;(7)接近恒等变换;(8)参数少;(9)归一化,助力稳定训练。

2. BatchNorm 层对于 input batch 会统计出 mean 和 variance 用于计算 EMA。如果input batch 的 shape 为(B, C, H, W),统计出的 mean 和 variance 的 shape 为:

- B * 1 * 1 * 1

- 1 * C * 1 * 1

- B * C * 1 * 1

- 1 * 1 * 1 * 1

B。解析:BN对多张图像的每个通道做归一化,有多少个通道就有多少均值和方差。

3.CNN常见的Loss函数不包括以下哪个()

- softmax_loss

- sigmoid_loss

- Contrastive_Loss

- siamese_loss

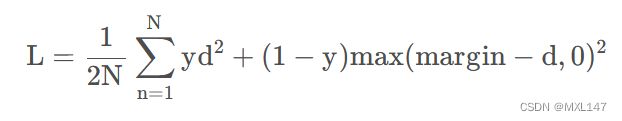

D。解析:siamese network(孪生神经网络)中应用Contrastive_Loss(对比损失),能有效的处理paired data的关系。对比损失主要用在降维中,保证本来相似的样本,降维后(新特征空间中)仍旧相似。表达式如下:

d是样本间距离,当样本相似时y=1,损失函数只剩前半部分,距离越大说明模型越差,损失越大。样本不相似时y=0,损失函数只剩后半部分,如果距离越小说明模型越差,损失越大。

4. 关于Attention-based Model,下列说法正确的是()

- 相似度度量模型

- 是一种新的深度学习网络

- 是一种输入对输出的比例模型

- 都不对

A。解析:Attention-based Model其实就是一个相似性的度量,当前的输入与目标状态越相似,那么在当前的输入的权重就会越大,说明当前的输出越依赖于当前的输入。

5. 考虑某个具体问题时,你可能只有少量数据来解决这个问题。不过幸运的是你有一个类似问题已经预先训练好的神经网络。可以用下面哪种方法来利用这个预先训练好的网络?

- 把除了最后一层外所有的层都冻结,重新训练最后一层

- 对新数据重新训练整个模型

- 只对最后几层进行调参(fine tune)

- 对每一层模型进行评估,选择其中的少数来用

C。解析:模型微调方法:

数据量少,数据相似度高:改最后几层或者只改输出层。

数据量少,数据相似度低:冻结一些,训练一些。

数据量大,数据相似度低:从头训练。

数据量大,数据相似度高:最理想。用预训练权重重新训练。

6. 基于二次准则函数的H-K算法较之于感知器算法的优点是?

- 计算量小

- 可以判别问题是否线性可分

- 其解完全适用于非线性可分的情况

- 其解的适应性更好

BD。解析:H-K算法是在最小均方误差准则下求得权矢量。适用于线性可分和非线性。对于线性可分的情况: 给出最优权矢量;对于非线性可分得情况: 能够判别出来,以退出迭代过程。

7. caffe中基本的计算单元为

- blob

- layer

- net

- solver

B。解析:blob: caffe的数据存储单元;layer: caffe的计算单元。

8. GoogLeNet提出的Inception结构优势有?

- 保证每一层的感受野不变,网络深度加深,使得网络的精度更高

- 使得每一层的感受野增大,学习小特征的能力变大

- 有效提取高层语义信息,且对高层语义进行加工,有效提高网络准确度

- 利用该结构有效减轻网络的权重

D。解析:多分支结构,大卷积核拆成小卷积核串联,3*3卷积拆成3*1和1*3卷积,使用1*1卷积等,能够减轻网络权重。

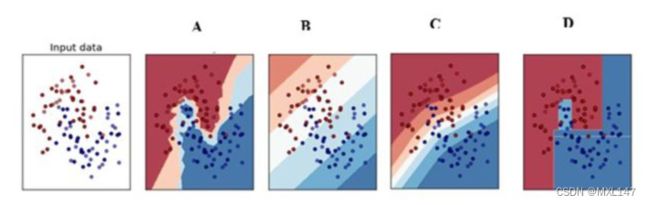

9. 下图是一个利用sigmoid函数作为激活函数的含四个隐藏层的神经网络训练的梯度下降图。这个神经网络遇到了梯度消失的问题。下面哪个叙述是正确的?

第一隐藏层对应D,第二隐藏层对应C,第三隐藏层对应B,第四隐藏层对应A

解析:在神经网络反向传播中,梯度从后往前传,梯度不断减小,最后变为零,此时,浅层的神经网络权重得不到更新,那么前面隐藏层的学习速率低于后面隐藏层的学习速率,即随着隐藏层数目的增加,分类准确率反而下降了。这种现象叫做梯度消失。梯度消失导致后层的权重更新的快,靠近输出层的权值更新相对正常,前层网络由于梯度传递不过去得不到更新。因此,靠近输入层的更新会变得很慢,导致靠近输入层的隐藏层权值几乎不变,接近于初始化的权值。这样在网络很深的时候,学习的速度很慢或者无法学习。D的学习速率最慢,因此是第一隐藏层。

10. 以下关于深度神经网络的说法中错误的是

A 使用梯度裁剪(gradient clipping)有助于减缓梯度爆炸问题

B 若batch size过小,batch normalization的效果会出现退化

C 在使用SGD训练时,若训练loss的变化逐渐平缓不再明显下降时,通常可以通过减小learning rate的方式使其再进一步下降

D 增大L2正则项的系数有助于减缓梯度消失问题

D。解析:L2正则化用于降低模型复杂度,防止过拟合,不能缓解梯度消失。残差结构、合适的激活函数、梯度裁剪、BN、初始化等可以缓解梯度消失。

11. 下列关于神经网络的叙述中,正确的是

A 损失函数关于输入一定是非凸或非凹的

B 存在某种深度神经网络(至少一个隐藏层),使其每个局部最优解都是全局最优解

C 深度神经网络容易陷入局部最优解

D 以上选项都不对

解析:B。神经网络容易陷入的是鞍部而不是局部最优解,在多维度的损失函数中局部最小点非常少。

12. 图像挖掘中常用卷积神经网络作为基础结构,以下关于卷积操作 (conv)和池化 ( pooling)的说法正确的是?

A conv基于平移不变性,pooling基于局部相关性

解析:平移不变性:对于同一张图及其平移后的版本,都能输出同样的结果。局部相关性:池化层利用局部相关性,对图像进行下采样,可以减少数据处理量同时保留有用信息,相当于图像压缩。

13.RNN中哪个做法能够更好处理梯度爆炸问题?

A 用LSTM或GRU

B 梯度裁剪

C dropout

解析:B。LSTM中有梯度累加,能够减轻梯度消失问题,但是会加剧梯度爆炸问题。最好的做法是限制梯度范围,进行梯度裁剪。

14. 关于神经网络中经典使用的优化器,以下说法正确的是

A Adam的收敛速度比RMSprop慢

B 相比于SGD或RMSprop等优化器,Adam的收敛效果是最好的

C 对于轻量级神经网络,使用Adam比使用RMSprop更合适

D 相比于Adam或RMSprop等优化器,SGD的收敛效果是最好的

解析:D。SGD 能收敛到极小值,但用时比较长。如果在意更快的收敛,并且需要训练较深较复杂的网络时,推荐使用学习率自适应的优化方法。

15. (多选)影响聚类算法效果的主要原因有?

A、特征选取

B、模式相似性测度

C、分类准则

D、已知类别的样本质量

解析:ABC。聚类是无监督,不使用标记好的数据。

16.(多选)数据清理中,处理缺失值的方法是?

A、估算

B、整例删除

C、变量删除

D、成对删除

解析:ABCD。

17.在HMM中,如果已知观察序列和产生观察序列的状态序列,那么可用以下哪种方法直接进行参数估计?

A、EM算法

B、维特比算法

C、前向后向算法

D、极大似然估计

解析:D。EM算法:只有观测序列,无状态序列时来学习模型参数,即Baum-Welch算法。维特比算法:用动态规划解决HMM的预测问题,不是参数估计。前向后向算法:用来算概率。极大似然估计:即观测序列和相应的状态序列都存在时的监督学习算法,用来估计参数。注意的是在给定观测序列和对应的状态序列估计模型参数,可以利用极大似然发估计。如果给定观测序列,没有对应的状态序列,才用EM,将状态序列看不不可测的隐数据。

18.L1与L2范数在Logistic Regression 中,如果同时加入L1和L2范数会怎样?。

A. 可以做特征选择,并在一定程度上防止过拟合

B. 能解决维度灾难问题

C. 能加快计算速度

D. 可以获得更准确的结果

解析:A。L1范数具有系数解的特性,但是要注意的是,L1没有选到的特征不代表不重要,原因是两个高相关性的特征可能只保留一个。如果需要确定哪个特征重要,再通过交叉验证。

19.(多选)假定某同学使用Naive Bayesian(NB)分类模型时,不小心将训练数据的两个维度搞重复了,那么关于NB的说法中正确的是?

A. 这个被重复的特征在模型中的决定作用会被加强

B. 模型效果相比无重复特征的情况下精确度会降低

C. 如果所有特征都被重复一遍,得到的模型预测结果相对于不重复的情况下的模型预测结果一样。

D. 当两列特征高度相关时,无法用两列特征相同时所得到的结论来分析问题

E. NB可以用来做最小二乘回归

F. 以上说法都不正确

解析:BD。

20.(多选)以下几种模型方法属于判别式模型(Discriminative Model)的有?

A 混合高斯模型

B 条件随机场模型

C 区分度训练

D 隐马尔科夫模型

解析:BC。常见的判别式模型有:Logistic Regression(Logistical 回归)、Linear discriminant analysis(线性判别分析) 、Supportvector machines(支持向量机)、Boosting(集成学习) 、 Conditional random fields(条件随机场) 、Linear regression(线性回归) 、Neural networks(神经网络)。

常见的生成式模型有:Gaussian mixture model and othertypes of mixture model(高斯混合及其他类型混合模型) 、Hidden Markov model(隐马尔可夫) 、NaiveBayes(朴素贝叶斯) 、 AODE(平均单依赖估计) 、Latent Dirichlet allocation(LDA主题模型) 、Restricted Boltzmann Machine(限制波兹曼机)。

生成式模型是根据概率乘出结果,而判别式模型是给出输入,计算出结果。

21.有两个样本点,第一个点为正样本,它的特征向量是(0,-1);第二个点为负样本,它的特征向量是(2,3),从这两个样本点组成的训练集构建一个线性SVM分类器的分类面方程?

A. 2x+y=4

B. x+2y=5

C. x+2y=3

D. 2x-y=0

解析:C。对于两个点来说,最大间隔就是垂直平分线,因此求出垂直平分线即可。

22.关于 Logit 回归和 SVM 不正确的是?

A. Logit回归目标函数是最小化后验概率

B. Logit回归可以用于预测事件发生概率的大小

C. SVM目标是结构风险最小化

D. SVM可以有效避免模型过拟合

解析:A。Logit回归本质上是一种根据样本对权值进行极大似然估计的方法,而后验概率正比于先验概率和似然函数的乘积。logit仅仅是最大化似然函数,并没有最大化后验概率,更谈不上最小化后验概率。而最小化后验概率是朴素贝叶斯算法要做的。

23.(多选)以下说法中正确的是?

A. SVM对噪声(如来自其他分布的噪声样本)鲁棒

B. 在AdaBoost算法中,所有被分错的样本的权重更新比例相同

C. Boosting和Bagging都是组合多个分类器投票的方法,二者都是根据单个分类器的正确率决定其权重

D. 给定n个数据点,如果其中一半用于训练,一般用于测试,则训练误差和测试误差之间的差别会随着n的增加而减少

解析:BD。SVM本身对噪声具有一定的鲁棒性,但实验证明,是当噪声率低于一定水平的噪声对SVM没有太大影响,但随着噪声率的不断增加,分类器的识别率会降低。Bagging的各个预测函数没有权重,而Boosting是有权重的。

24.(多选)以下哪个属于线性分类器最佳准则?

A. 感知准则函数

B.贝叶斯分类

C.支持向量机

D.Fisher准则

解析:ACD。线性分类器有三大类:感知器准则函数、SVM、Fisher准则,而贝叶斯分类器不是线性分类器。

感知准则函数 :准则函数以使错分类样本到分界面距离之和最小为原则。其优点是通过错分类样本提供的信息对分类器函数进行修正,这种准则是人工神经元网络多层感知器的基础。

支持向量机 :基本思想是在两类线性可分条件下,所设计的分类器界面使两类之间的间隔为最大,它的基本出发点是使期望泛化风险尽可能小。(使用核函数可解决非线性问题)

Fisher 准则 :更广泛的称呼是线性判别分析(LDA),将所有样本投影到一条远点出发的直线,使得同类样本距离尽可能小,不同类样本距离尽可能大,具体为最大化“广义瑞利商”。

25.下列时间序列模型中,哪一个模型可以较好地拟合波动性的分析和预测?

A. AR模型

B. MA模型

C. ARMA模型

D. GARCH模型

解析:D。

AR模型是一种线性预测,即已知N个数据,可由模型推出第N点前面或后面的数据(设推出P点),所以其本质类似于插值。

MA模型(moving average model)滑动平均模型,使用趋势移动平均法建立直线趋势的预测模型。

ARMA模型(auto regressive moving average model)自回归滑动平均模型,模型参量法高分辨率谱分析方法之一。这种方法是研究平稳随机过程有理谱的典型方法。它比AR模型法与MA模型法有较精确的谱估计及较优良的谱分辨率性能,但其参数估算比较繁琐。

GARCH模型称为广义ARCH模型,是ARCH模型的拓展。GARCH(p,0)模型,相当于ARCH(p)模型。GARCH模型是一个专门针对金融数据所量体订做的回归模型,除去和普通回归模型相同的之处,GARCH对误差的方差进行了进一步的建模。特别适用于波动性的分析和预测,这样的分析对投资者的决策能起到非常重要的指导性作用,其意义很多时候超过了对数值本身的分析和预测。

26.假设在训练中我们突然遇到了一个问题,在几次循环之后,误差瞬间降低。你认为数据有问题,于是你画出了数据并且发现也许是数据的偏度过大造成了这个问题。你打算怎么做来处理这个问题?

A. 对数据作归一化

B. 对数据取对数变化

C. 都不对

D. 对数据作主成分分析(PCA)和归一化

解析:D。

27.下面那个决策边界是神经网络生成的?

解析:ABCD。

28.下图显示,当开始训练时,误差一直很高,这是因为神经网络在往全局最小值前进之前一直被卡在局部最小值里。为了避免这种情况,我们可以采取下面哪种策略?

A. 改变学习速率,比如一开始的几个训练周期不断更改学习速率

B. 一开始将学习速率减小10倍,然后用动量项(momentum)

C. 增加参数数目,这样神经网络就不会卡在局部最优处

D. 其他都不对

解析:A。

29.对于一个分类任务,如果开始时神经网络的权重不是随机赋值的,二是都设成0,下面哪个叙述是正确的?

A. 其他选项都不对

B. 没啥问题,神经网络会正常开始训练

C. 神经网络可以训练,但是所有的神经元最后都会变成识别同样的东西

D. 神经网络不会开始训练,因为没有梯度改变

解析:C。

30.假设我们已经在ImageNet数据集(物体识别)上训练好了一个卷积神经网络。然后给这张卷积神经网络输入一张全白的图片。对于这个输入的输出结果为任何种类的物体的可能性都是一样的,对吗?

解析:不对。

31.下列哪项关于模型能力(model capacity)的描述是正确的?(指神经网络模型能拟合复杂函数的能力)

A. 隐藏层层数增加,模型能力增加

B. Dropout的比例增加,模型能力增加

C. 学习率增加,模型能力增加

D. 都不正确

解析:A。其实说的也不太对。

32.神经网络模型因受人类大脑的启发而得名。神经网络由许多神经元(Neuron)组成,每个神经元接受一个输入,对输入进行处理后给出一个输出。请问下列关于神经元的描述中,哪一项是正确的?

A.每个神经元只有一个输入和一个输出

B.每个神经元有多个输入和一个输出

C.每个神经元有一个输入和多个输出

D.每个神经元有多个输入和多个输出

E.上述都正确

解析:E。