【统计学】深入理解最大似然估计(MLE, maximum likelihood estimation)

目录

1. 前言

2. 案例导入

3. 理论阐述

4. 伯努利分布

5. 高斯(正态)分布

1. 前言

最大似然估计就是利用已知的样本结果,在使用某个模型的基础上,反推最有可能导致这样的结果的模型参数。

2. 案例导入

这里我们用一个经典的摸球游戏来阐述最大似然估计在伯努利分布模型上的应用。

假设一个袋子里面装有红球和白球,比例未知,现在我们要抽取10次(每次抽完都放回,保证每次抽取的独立性),假设抽取到了7次白球和3次红球(最大似然估计是“一种模型已经确定,参数未知”基于样本的的参数估计方法)。显而易见,此时样本的白球比例为70%,但如何通过理论的方法推知该袋中最大可能性的白球红球比例呢?一些简单的情况,很容易做出一个推断,如上面的摸球模型,就可以直接根据样本情况估计最有可能袋子里就是7个白球3个红球。但是,在一些复杂的情况下,是很难通过直观的方式获得答案的,这时候理论分析就变得格外重要,这也是最值似然估计要解决的问题。我们可以定义从袋子中连续两次摸球的概率为:

因为θ是未知的,所以我们定义似然L为:

两边取ln,取ln是为了将右边的乘号变成加号,以方便求导。

两边同时取对数,左边通常称为对数似然。

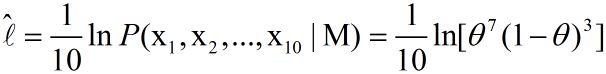

有时,也有上式为平均对数似然。

最大似然估计的过程,就是找到一个合适的theta,使得平均对数似然最大。因此,可以得到以下公式:

这里讨论的是2次采样的情况,当然也可以将其拓展到多次采样的情况:

我们定义M为模型,表示抽到白球的概率为θ,而抽到红球的概率为1-θ,因此10次抽取到白球7次的概率可以表示为:

将其描述为平均似然可得:

那么最大似然就是找到一个合适的θ,获得最大的平均似然。因此我们对平均似然的公式对θ进行求导,并令导数为0.

由此我们可以得到结论,当抽取白球的概率为0.7时,最可能产生10次抽取到白球7次的事件。

3. 理论阐述

假设我们有一个独立同分布的样本![]() 。假设

。假设![]() 是从某个定义在参数θ上的已知概率密度族p(x|θ)中抽取的实例:

是从某个定义在参数θ上的已知概率密度族p(x|θ)中抽取的实例:

![]() ~ p(x|θ)

~ p(x|θ)

我们希望找出这样的θ,使得![]() 尽可能像是从p(x|θ)抽取的【 l(θ|X) 最大】。因为

尽可能像是从p(x|θ)抽取的【 l(θ|X) 最大】。因为![]() 是独立的,所以给定参数θ,样本X的似然(likelihood)就是单个点似然的乘积:

是独立的,所以给定参数θ,样本X的似然(likelihood)就是单个点似然的乘积:

【这里插一句,如何理解 样本的似然 定义为 基于假设模型下样本的概率 也非常重要】

在最大似然估计中,我们感兴趣的是找到这样的θ,使得X最像是抽取的。因此,我们寻找最大化样本似然的θ,该似然记作 l(θ|X)。我们可以最大化该似然的对数,而不改变取最大值的θ值。log(·)把乘积转换为求和,并且当假定某种密度(例如,包含指数)是进一步简化计算量。对数似然(log likelihood)定义为:

现在,让我们来看看我们感兴趣的实际应用中出现的一些分布。如果我们有两类问题,我们就使用伯努利分布。高斯(正态)密度最常用来对具有数值输入的类条件密度建模的密度之一。对这两种分布,我们来讨论它们参数的最大似然估计(MLE)方法。

4. 伯努利分布

在伯努利分布中,有两个结果:事情要么发生,要么不发生。例如,实例是类的正例,或者不是。事件发生,伯努利随机变量X以概率p取值为1,事件不发生的概率为1-p,并用X取值为0表示。随机变量的取值概率表示为:

期望和方差可以用下式计算:

p是唯一的参数,并且给定独立同分布样本![]() ,其中

,其中![]() ∈{0, 1},希望计算p的估计

∈{0, 1},希望计算p的估计![]() 。其对数似然为:

。其对数似然为:

通过求解dL/dp=0,可以找出最大化该对数似然的![]() 。p上带帽表示它是p的一个估计。

。p上带帽表示它是p的一个估计。

p的估计是事件发生的次数与实验次数的比值。记住,如果X是参数为p的伯努利变量,则E[X]=p,并且作为期望,均值的最大似然估计是样本的平均值。

注意,该估计是样本的函数,并且也是一个随机变量。给定从相同的p(x)中抽取的不同![]() ,我们可以谈论

,我们可以谈论![]() 的分布。例如,期望

的分布。例如,期望![]() 的分布的方差随N增加而减少;随着样本增大,从而它们的平均值变得更加相似。

的分布的方差随N增加而减少;随着样本增大,从而它们的平均值变得更加相似。

5. 高斯(正态)分布

X是均值为E[X] ☰ μ,方差为Var(X) ☰ ![]() 的高斯(正态)分布,记作N(μ,

的高斯(正态)分布,记作N(μ, ![]() ),如果它的密度函数为:

),如果它的密度函数为:

给定样本![]() ,其中

,其中![]() ~ N(μ,

~ N(μ, ![]() ),高斯样本的对数似然为:

),高斯样本的对数似然为:

通过求该对数似然的偏导数并令它们等于0,可以求出最大似然估计为:

我们根据通常的约定,用希腊字母表示总体参数,用罗马字母表示它们的样本估计。有时,帽子(抑扬符号)表示估计。