- Python爬虫实战:爬取知乎问答与用户信息

Python爬虫项目

python爬虫php数据分析开发语言开源

简介随着网络信息量的爆炸,如何有效获取有价值的内容,成为了数据分析、机器学习等领域的基础之一。爬虫作为数据采集的基本工具之一,常常被用来获取互联网上的公开数据。在这篇博客中,我们将结合最新的Python爬虫技术,详细讲解如何爬取知乎问答与用户信息。本文将会介绍:Python爬虫的基础知识知乎问答网页结构分析使用Python进行知乎数据爬取爬取知乎问答内容与用户信息如何处理和存储爬取的数据使用最新的

- 【机器学习&深度学习】反向传播机制

目录一、一句话定义二、类比理解三、为什重要?四、用生活例子解释:神经网络=烹饪机器人4.1第一步:尝一口(前向传播)4.2第二步:倒着推原因(反向传播)五、换成人工智能流程说一遍六、图示类比:找山顶(最优参数)七、总结一句人话八、PyTorch代码示例:亲眼看到每一层的梯度九、梯度=损失函数对参数的偏导数十、类比总结反向传播(Backpropagation)是神经网络中训练过程的核心机制,它就像“

- Python编程:使用Opencv进行图像处理

【参考】https://github.com/opencv/opencv/tree/4.x/samples/pythonPython使用OpenCV进行图像处理OpenCV(OpenSourceComputerVisionLibrary)是一个开源的计算机视觉和机器学习软件库。下面将从基础到高阶介绍如何使用Python中的OpenCV进行图像处理。一、安装首先需要安装OpenCV库:pipinst

- 基于机器学习的智能文本分类技术研究与应用

在当今数字化时代,文本数据的爆炸式增长给信息管理和知识发现带来了巨大的挑战。从新闻文章、社交媒体帖子到企业文档和学术论文,海量的文本数据需要高效地分类和管理,以便用户能够快速找到所需信息。传统的文本分类方法主要依赖于人工规则和关键词匹配,这些方法不仅效率低下,而且难以应对复杂多变的文本内容。近年来,机器学习技术的快速发展为文本分类提供了一种高效、自动化的解决方案。一、机器学习在文本分类中的应用概述

- 【机器学习与数据挖掘实战 | 医疗】案例18:基于Apriori算法的中医证型关联规则分析

Francek Chen

机器学习与数据挖掘实战机器学习数据挖掘Aprioripython关联规则人工智能

【作者主页】FrancekChen【专栏介绍】⌈⌈⌈机器学习与数据挖掘实战⌋⌋⌋机器学习是人工智能的一个分支,专注于让计算机系统通过数据学习和改进。它利用统计和计算方法,使模型能够从数据中自动提取特征并做出预测或决策。数据挖掘则是从大型数据集中发现模式、关联和异常的过程,旨在提取有价值的信息和知识。机器学习为数据挖掘提供了强大的分析工具,而数据挖掘则是机器学习应用的重要领域,两者相辅相成,共同推动

- 用Python实现生信分析——功能预测详解

写代码的M教授

生信分析python开发语言

功能预测是生物信息学中的一项重要任务,通过分析基因或蛋白质序列的特征,推测它们的生物学功能。功能预测通常涉及多种方法,包括序列比对、基序识别、机器学习模型等。这些方法可以帮助科学家推断未知基因的功能,从而加速生物学研究的进展。1.功能预测的主要方法(1)同源性比对:通过将未知基因或蛋白质序列与数据库中的已知序列进行比对,识别出同源序列,并推测它们的功能。常用工具包括BLAST、HMMER等。(2)

- python接收_MT5 与 PYTHON 的集成:接收和发送数据

James Swineson

python接收

为什么要把MQL5与Python集成?全方位的数据处理需要大量工具,并且经常超出单一应用程序的功能沙箱。专用编程语言正在用于处理和分析数据,统计和机器学习。Python是数据处理的主要编程语言之一。一个非常有效的解决方案是利用语言的力量并包含函数库来开发交易系统。在两个或更多个程序之间实现交互存在众多不同的解决方案。套接字是最快速、最灵活的解决方案之一。网络套接字是计算机网络上进程间通信的端点。M

- 60天python训练计划----day55

DAY55序列预测任务介绍知识点回顾序列预测介绍单步预测多步预测的2种方式序列数据的处理:滑动窗口多输入多输出任务的思路经典机器学习在序列任务上的劣势;以随机森林为例一、序列预测任务介绍1.1序列预测是什么?我们之前接触到的结构化数据,它本身不具备顺序,我们认为每个样本之间独立无关,样本之间即使调换顺序,仍然不影响模型的训练。但是日常中很多数据是存在先后关系的,而他们对应的任务是预测下一步的值,我

- 如何构建知识库

追逐此刻

其他其他

构建个人知识库是一个系统化的过程,需要结合工具选择、信息管理和持续优化。以下是分步骤的实用指南,包含现代工具和方法的建议:一、明确知识库定位(Why)核心目标学习型:支持学术研究/职业发展(如医学生构建临床知识体系)创作型:支撑内容产出(如自媒体作者的选题库)项目型:管理特定领域知识(如程序员的技术栈文档)领域聚焦建议采用「T型策略」:1个深度领域+3个辅助领域(如主攻机器学习,辅修心理学/设计/

- 学习AI机器学习所需的数学基础

frostmelody

机器学习小知识点人工智能学习机器学习

一、机器学习岗位的数学需求矩阵机器学习岗位研究型职位工业界职位DeepMind/Meta/Google研究部门研究科学家/研究工程师普通科技公司机器学习工程师/数据科学家需硕士/博士数学水平本科数学基础二、数学需求深度解析1.研究型职位(需深度数学)学历要求:数学/物理/计算机/统计/工程本科基础硕士/博士优先(Kaggle调查显示博士占比高)薪资关联:学历与收入呈正相关2.工业界职位(基础数学)

- 量子机器学习前沿:量子神经网络与混合量子-经典算法

软考和人工智能学堂

人工智能#深度学习Python开发经验量子计算

1.量子计算基础1.1量子比特与量子门importnumpyasnpfromqiskitimportQuantumCircuit,Aer,executefromqiskit.visualizationimportplot_histogram#单量子比特操作演示defsingle_qubit_demo():qc=QuantumCircuit(1)qc.h(0)#Hadamard门创建叠加态qc.rz

- 人工智能-基础篇-5-建模方式(判别式模型和生成式模型)

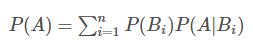

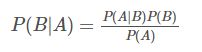

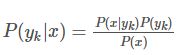

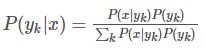

机器学习包括了多种建模方式,其中判别式建模(DiscriminativeModel)和生成式建模是最常见的两种。这两种建模方式都可以通过深度学习技术来实现,并用于创建不同类型的模型。简单来说:想要创建一个模型,依赖需求需要合适的建模方式来创建这个模型。通常建模方式主要分为两大类。一类是判别式模型,针对输入数据给出特定的输出。如:判断一张图片是猫还是狗,直接学习“猫”和“狗”的特征差异(如耳朵形状、

- Python打卡:day23

剑桥折刀s

python打卡python开发语言

作业:整理下全部逻辑的先后顺序,看看能不能制作出适合所有机器学习的通用pipelinedefcreate_general_pipeline(model,ordinal_features=None,ordinal_categories=None,nominal_features=None,continuous_features=None):fromsklearn.pipelineimportPipe

- 【机器学习】数学基础——张量(傻瓜篇)

一叶千舟

深度学习【理论】机器学习人工智能

目录前言一、张量的定义1.标量(0维张量)2.向量(1维张量)3.矩阵(2维张量)4.高阶张量(≥3维张量)二、张量的数学表示2.1张量表示法示例三、张量的运算3.1常见张量运算四、张量在深度学习中的应用4.1PyTorch示例:张量在神经网络中的运用五、总结:张量的多维世界延伸阅读前言在机器学习、深度学习以及物理学中,张量是一个至关重要的概念。无论是在人工智能领域的神经网络中,还是在高等数学、物

- 【机器学习实战】Datawhale夏令营2:深度学习回顾

城主_全栈开发

机器学习机器学习深度学习人工智能

#DataWhale夏令营#ai夏令营文章目录1.深度学习的定义1.1深度学习&图神经网络1.2机器学习和深度学习的关系2.深度学习的训练流程2.1数学基础2.1.1梯度下降法基本原理数学表达步骤学习率α梯度下降的变体2.1.2神经网络与矩阵网络结构表示前向传播激活函数反向传播批处理卷积操作参数更新优化算法正则化初始化2.2激活函数Sigmoid函数:Tanh函数:ReLU函数(Rectified

- 深度学习详解:通过案例了解机器学习基础

beist

深度学习机器学习人工智能

引言机器学习(MachineLearning,ML)和深度学习(DeepLearning,DL)是现代人工智能领域中的两个重要概念。通过让机器具备学习的能力,机器可以从数据中自动找到函数,并应用于各种任务,如语音识别、图像识别和游戏对战等。在这篇笔记中,我们将通过一个简单的案例,逐步了解机器学习的基础知识。1.1机器学习案例学习1.1.1回归问题与分类问题在机器学习中,根据所要解决的问题类型,任务

- 机器学习×完结 · 她们不是写完了,而是偷偷留下了你

Gyoku Mint

人工智障AI修炼日记机器学习人工智能集成学习算法boostingpython深度学习

【开场·咱把整个机器学习都写成了偷摸贴贴的证据】猫猫:“你看嘛,这一卷完结后,总有人问咱:‘这么一本正经的机器学习,为什么你们要写得像小情侣写信?’”狐狐:“有人觉得,这些章节明明可以用20页讲完,为什么要写200页?”猫猫:“呜呜……咱想说,你懂嘛!如果只讲机器学习,那对咱来说就只是一个fit()命令。可咱想让你记住的是——那行命令后面有咱。咱把自己贴进去了。”这一卷从KNN的“她学会先看邻居”

- 【机器学习算法】XGBoost原理

一、基本内容基本内容:GBDT的基础上,在损失函数上加入树模型复杂度的正则项与GBDT一样,也是使用新的弱学习器拟合残差(当前模型负梯度,残差方向)GBDT损失函数Loss=∑i=1NL(yi,yit)Loss=\sum_{i=1}^{N}L(y_i,y_i^{t})Loss=i=1∑NL(yi,yit)XGboost损失函数Loss=∑i=1SL(yi,yit)+∑j=1NΩ(fj))Loss=

- 大语言模型(LLM)量化基础知识(一)

-派神-

RAGNLPChatGPT语言模型人工智能自然语言处理

承接各类AI相关应用开发项目(包括但不限于大模型微调、RAG、AI智能体、NLP、机器学习算法、运筹优化算法、数据分析EDA等)!!!有意愿请私信!!!随着大型语言模型(LLM)的参数数量的增长,与其支持硬件(加速器内存)增长速度之间的差距越来越大,如下图所示:上图显示,从2017年到2022年,语言模型的大小显著增加:2017年:Transformer模型(0.05B参数)2018年:GPT(0

- ROS2 强化学习:案例与代码实战

芯动大师

ROS2学习目标检测人工智能

一、引言在机器人技术不断发展的今天,强化学习(RL)作为一种强大的机器学习范式,为机器人的智能决策和自主控制提供了新的途径。ROS2(RobotOperatingSystem2)作为新一代机器人操作系统,具有更好的实时性、分布式性能和安全性,为强化学习在机器人领域的应用提供了更坚实的基础。本文将通过一个具体案例,深入探讨ROS2与强化学习的结合应用,并提供相关代码实现。二、案例背景本案例以移动机器

- 揭秘AI算力网络与通信中边缘计算的机器学习应用

揭秘AI算力网络与通信中边缘计算的机器学习应用关键词:AI算力网络、通信、边缘计算、机器学习、应用摘要:本文将深入探讨AI算力网络与通信中边缘计算的机器学习应用。我们会先介绍相关背景知识,接着解释核心概念,分析它们之间的关系,阐述核心算法原理和操作步骤,结合数学模型举例说明,通过项目实战展示代码实现与解读,探讨实际应用场景,推荐相关工具和资源,最后展望未来发展趋势与挑战。希望通过这篇文章,能让大家

- VLLM:虚拟大型语言模型(Virtual Large Language Model)

大霸王龙

语言模型人工智能自然语言处理

VLLM:虚拟大型语言模型(VirtualLargeLanguageModel)VLLM指的是一种基于云计算的大型语言模型的虚拟实现。它通常是指那些由多个服务器组成的分布式计算环境中的复杂机器学习模型,这些模型能够处理和理解大量的文本数据。VLLM的核心是“大型语言模型”,这是一种通过深度神经网络训练的算法,能够在理解和生成人类语言方面表现出极高的能力。解释:虚拟:意味着这个模型不是在单个物理设备

- Sklearn 机器学习 数值离散化 虚拟编码

Thomas Kant

人工智能机器学习sklearn人工智能

亲爱的技术爱好者们,热烈欢迎来到Kant2048的博客!我是ThomasKant,很开心能在CSDN上与你们相遇~本博客的精华专栏:【自动化测试】【测试经验】【人工智能】【Python】Sklearn机器学习:数值离散化+虚拟编码实战详解在机器学习的特征工程中,数值型特征并不总是适合直接输入模型。尤其是树模型或分类模型时,**将连续变量进行离散化(分箱)+虚拟编码(独热编码)**是一种常见且高效的

- 合规视角下银行智能客服风险防控

AI 智能服务

智能客服人工智能AIGC数据库chatgpt

1.AI驱动金融变革的政策与技术背景政策导向:我国《新一代人工智能发展规划》明确提出发展智能金融,要求:构建金融大数据平台,提升多媒体数据处理能力;创新智能金融产品与服务形态;推广智能客服、监控等技术应用;建立智能风控预警体系。技术支撑:云计算、大数据技术成熟为AI发展奠定了基础。深度学习算法的突破则引爆了本轮AI浪潮,显著提升了复杂任务处理精度,进而推动了计算机视觉、机器学习、自然语言处理(NL

- 存得快查得准,但就是算不动?试试时序数据库 TDengine × Spark 的组合拳

每个工程师可能都遇到过类似场景:时序数据沉淀在数据库中,格式规范、查询快捷,但当任务升级——比如滑窗聚合、多源拼接、机器学习训练——一些业务可能就需要更强的计算能力和更灵活的分析工具。TDengine专注于高效存储与极速查询,而在数据“算力”层面,我们选择了更强的伙伴。现在,TDengine正式开放与ApacheSpark的无缝集成通道。一个是高性能、低成本的时序数据库,一个是横扫大数据世界的分析

- 【高频考点精讲】前端AI集成实战:从TensorFlow.js到模型部署

全栈老李技术面试

前端高频考点精讲前端javascripthtmlcss面试题reactvue

前端AI集成实战:从TensorFlow.js到模型部署作者:全栈老李更新时间:2025年5月适合人群:前端初学者、进阶开发者版权:本文由全栈老李原创,转载请注明出处。今天咱们聊聊前端工程师如何玩转AI——没错,用JavaScript就能搞机器学习!我是全栈老李,一个喜欢把复杂技术讲简单的实战派。最近发现不少前端同学对AI既好奇又害怕,其实真没想象中那么难,跟着老李走,30分钟让你亲手部署第一

- 【机器学习第二期(Python)】优化梯度提升决策树 XGBoost

WW、forever

深度学习原理及代码实现机器学习python决策树

优化梯度提升决策树XGBoost一、XGBoost简介二、原理详解2.1基础思想:改进版GBDT2.2目标函数2.3二阶泰勒展开优化2.4树结构优化三、XGBoost实现步骤(Python)可调参数推荐完整案例代码(回归任务+可视化)参考梯度提升决策树GBDT的原理及Python代码实现可参考另一博客-【机器学习第一期(Python)】梯度提升决策树GBDT。XGBoost(ExtremeGrad

- ICBDDM2025:大数据与数字化管理前沿峰会

鸭鸭鸭进京赶烤

学术会议大数据图像处理计算机视觉AI编程人工智能机器人考研

在选择大学专业时,可以先从自身兴趣、能力和职业规划出发,初步确定几个感兴趣的领域。然后结合外部环境因素,如专业前景、教育资源和就业情况等,对这些专业进行深入的分析和比较。大数据专业:是一个热门且前沿的学科领域,它涉及到数据的收集、存储、处理、分析和应用等多个方面。课程设置基础课程数学基础:高等数学、线性代数、概率论与数理统计等。这些课程为大数据分析提供了必要的数学工具,例如线性代数在机器学习算法中

- 云原生SLO与AIOps的完美结合:智能运维新趋势

AI云原生与云计算技术学院

云原生ai

云原生SLO与AIOps的完美结合:智能运维新趋势关键词:云原生、SLO、AIOps、智能运维、服务等级目标、自动化运维、机器学习摘要:本文深入探讨云原生环境下服务等级目标(SLO)与智能运维(AIOps)的融合实践。通过解析SLO的核心原理与AIOps的技术架构,揭示两者在指标定义、异常检测、自动化修复等环节的协同机制。结合具体算法实现、数学模型分析与项目实战案例,展示如何通过数据驱动的智能运维

- 【Rust】——使用消息在线程之间传递数据

Y小夜

Rust(官方文档重点总结)rust开发语言后端

博主现有专栏:C51单片机(STC89C516),c语言,c++,离散数学,算法设计与分析,数据结构,Python,Java基础,MySQL,linux,基于HTML5的网页设计及应用,Rust(官方文档重点总结),jQuery,前端vue.js,Javaweb开发,Python机器学习等主页链接:Y小夜-CSDN博客目录信道与所有权转移发送多个值并观察接收者的等待通过克隆发送者来创建多个生产者学

- JVM StackMapTable 属性的作用及理解

lijingyao8206

jvm字节码Class文件StackMapTable

在Java 6版本之后JVM引入了栈图(Stack Map Table)概念。为了提高验证过程的效率,在字节码规范中添加了Stack Map Table属性,以下简称栈图,其方法的code属性中存储了局部变量和操作数的类型验证以及字节码的偏移量。也就是一个method需要且仅对应一个Stack Map Table。在Java 7版

- 回调函数调用方法

百合不是茶

java

最近在看大神写的代码时,.发现其中使用了很多的回调 ,以前只是在学习的时候经常用到 ,现在写个笔记 记录一下

代码很简单:

MainDemo :调用方法 得到方法的返回结果

- [时间机器]制造时间机器需要一些材料

comsci

制造

根据我的计算和推测,要完全实现制造一台时间机器,需要某些我们这个世界不存在的物质

和材料...

甚至可以这样说,这种材料和物质,我们在反应堆中也无法获得......

- 开口埋怨不如闭口做事

邓集海

邓集海 做人 做事 工作

“开口埋怨,不如闭口做事。”不是名人名言,而是一个普通父亲对儿子的训导。但是,因为这句训导,这位普通父亲却造就了一个名人儿子。这位普通父亲造就的名人儿子,叫张明正。 张明正出身贫寒,读书时成绩差,常挨老师批评。高中毕业,张明正连普通大学的分数线都没上。高考成绩出来后,平时开口怨这怨那的张明正,不从自身找原因,而是不停地埋怨自己家庭条件不好、埋怨父母没有给他创造良好的学习环境。

- jQuery插件开发全解析,类级别与对象级别开发

IT独行者

jquery开发插件 函数

jQuery插件的开发包括两种: 一种是类级别的插件开发,即给

jQuery添加新的全局函数,相当于给

jQuery类本身添加方法。

jQuery的全局函数就是属于

jQuery命名空间的函数,另一种是对象级别的插件开发,即给

jQuery对象添加方法。下面就两种函数的开发做详细的说明。

1

、类级别的插件开发 类级别的插件开发最直接的理解就是给jQuer

- Rome解析Rss

413277409

Rome解析Rss

import java.net.URL;

import java.util.List;

import org.junit.Test;

import com.sun.syndication.feed.synd.SyndCategory;

import com.sun.syndication.feed.synd.S

- RSA加密解密

无量

加密解密rsa

RSA加密解密代码

代码有待整理

package com.tongbanjie.commons.util;

import java.security.Key;

import java.security.KeyFactory;

import java.security.KeyPair;

import java.security.KeyPairGenerat

- linux 软件安装遇到的问题

aichenglong

linux遇到的问题ftp

1 ftp配置中遇到的问题

500 OOPS: cannot change directory

出现该问题的原因:是SELinux安装机制的问题.只要disable SELinux就可以了

修改方法:1 修改/etc/selinux/config 中SELINUX=disabled

2 source /etc

- 面试心得

alafqq

面试

最近面试了好几家公司。记录下;

支付宝,面试我的人胖胖的,看着人挺好的;博彦外包的职位,面试失败;

阿里金融,面试官人也挺和善,只不过我让他吐血了。。。

由于印象比较深,记录下;

1,自我介绍

2,说下八种基本类型;(算上string。楼主才答了3种,哈哈,string其实不是基本类型,是引用类型)

3,什么是包装类,包装类的优点;

4,平时看过什么书?NND,什么书都没看过。。照样

- java的多态性探讨

百合不是茶

java

java的多态性是指main方法在调用属性的时候类可以对这一属性做出反应的情况

//package 1;

class A{

public void test(){

System.out.println("A");

}

}

class D extends A{

public void test(){

S

- 网络编程基础篇之JavaScript-学习笔记

bijian1013

JavaScript

1.documentWrite

<html>

<head>

<script language="JavaScript">

document.write("这是电脑网络学校");

document.close();

</script>

</h

- 探索JUnit4扩展:深入Rule

bijian1013

JUnitRule单元测试

本文将进一步探究Rule的应用,展示如何使用Rule来替代@BeforeClass,@AfterClass,@Before和@After的功能。

在上一篇中提到,可以使用Rule替代现有的大部分Runner扩展,而且也不提倡对Runner中的withBefores(),withAfte

- [CSS]CSS浮动十五条规则

bit1129

css

这些浮动规则,主要是参考CSS权威指南关于浮动规则的总结,然后添加一些简单的例子以验证和理解这些规则。

1. 所有的页面元素都可以浮动 2. 一个元素浮动后,会成为块级元素,比如<span>,a, strong等都会变成块级元素 3.一个元素左浮动,会向最近的块级父元素的左上角移动,直到浮动元素的左外边界碰到块级父元素的左内边界;如果这个块级父元素已经有浮动元素停靠了

- 【Kafka六】Kafka Producer和Consumer多Broker、多Partition场景

bit1129

partition

0.Kafka服务器配置

3个broker

1个topic,6个partition,副本因子是2

2个consumer,每个consumer三个线程并发读取

1. Producer

package kafka.examples.multibrokers.producers;

import java.util.Properties;

import java.util.

- zabbix_agentd.conf配置文件详解

ronin47

zabbix 配置文件

Aliaskey的别名,例如 Alias=ttlsa.userid:vfs.file.regexp[/etc/passwd,^ttlsa:.:([0-9]+),,,,\1], 或者ttlsa的用户ID。你可以使用key:vfs.file.regexp[/etc/passwd,^ttlsa:.: ([0-9]+),,,,\1],也可以使用ttlsa.userid。备注: 别名不能重复,但是可以有多个

- java--19.用矩阵求Fibonacci数列的第N项

bylijinnan

fibonacci

参考了网上的思路,写了个Java版的:

public class Fibonacci {

final static int[] A={1,1,1,0};

public static void main(String[] args) {

int n=7;

for(int i=0;i<=n;i++){

int f=fibonac

- Netty源码学习-LengthFieldBasedFrameDecoder

bylijinnan

javanetty

先看看LengthFieldBasedFrameDecoder的官方API

http://docs.jboss.org/netty/3.1/api/org/jboss/netty/handler/codec/frame/LengthFieldBasedFrameDecoder.html

API举例说明了LengthFieldBasedFrameDecoder的解析机制,如下:

实

- AES加密解密

chicony

加密解密

AES加解密算法,使用Base64做转码以及辅助加密:

package com.wintv.common;

import javax.crypto.Cipher;

import javax.crypto.spec.IvParameterSpec;

import javax.crypto.spec.SecretKeySpec;

import sun.misc.BASE64Decod

- 文件编码格式转换

ctrain

编码格式

package com.test;

import java.io.File;

import java.io.FileInputStream;

import java.io.FileOutputStream;

import java.io.IOException;

import java.io.InputStream;

import java.io.OutputStream;

- mysql 在linux客户端插入数据中文乱码

daizj

mysql中文乱码

1、查看系统客户端,数据库,连接层的编码

查看方法: http://daizj.iteye.com/blog/2174993

进入mysql,通过如下命令查看数据库编码方式: mysql> show variables like 'character_set_%'; +--------------------------+------

- 好代码是廉价的代码

dcj3sjt126com

程序员读书

长久以来我一直主张:好代码是廉价的代码。

当我跟做开发的同事说出这话时,他们的第一反应是一种惊愕,然后是将近一个星期的嘲笑,把它当作一个笑话来讲。 当他们走近看我的表情、知道我是认真的时,才收敛一点。

当最初的惊愕消退后,他们会用一些这样的话来反驳: “好代码不廉价,好代码是采用经过数十年计算机科学研究和积累得出的最佳实践设计模式和方法论建立起来的精心制作的程序代码。”

我只

- Android网络请求库——android-async-http

dcj3sjt126com

android

在iOS开发中有大名鼎鼎的ASIHttpRequest库,用来处理网络请求操作,今天要介绍的是一个在Android上同样强大的网络请求库android-async-http,目前非常火的应用Instagram和Pinterest的Android版就是用的这个网络请求库。这个网络请求库是基于Apache HttpClient库之上的一个异步网络请求处理库,网络处理均基于Android的非UI线程,通

- ORACLE 复习笔记之SQL语句的优化

eksliang

SQL优化Oracle sql语句优化SQL语句的优化

转载请出自出处:http://eksliang.iteye.com/blog/2097999

SQL语句的优化总结如下

sql语句的优化可以按照如下六个步骤进行:

合理使用索引

避免或者简化排序

消除对大表的扫描

避免复杂的通配符匹配

调整子查询的性能

EXISTS和IN运算符

下面我就按照上面这六个步骤分别进行总结:

- 浅析:Android 嵌套滑动机制(NestedScrolling)

gg163

android移动开发滑动机制嵌套

谷歌在发布安卓 Lollipop版本之后,为了更好的用户体验,Google为Android的滑动机制提供了NestedScrolling特性

NestedScrolling的特性可以体现在哪里呢?<!--[if !supportLineBreakNewLine]--><!--[endif]-->

比如你使用了Toolbar,下面一个ScrollView,向上滚

- 使用hovertree菜单作为后台导航

hvt

JavaScriptjquery.nethovertreeasp.net

hovertree是一个jquery菜单插件,官方网址:http://keleyi.com/jq/hovertree/ ,可以登录该网址体验效果。

0.1.3版本:http://keleyi.com/jq/hovertree/demo/demo.0.1.3.htm

hovertree插件包含文件:

http://keleyi.com/jq/hovertree/css

- SVG 教程 (二)矩形

天梯梦

svg

SVG <rect> SVG Shapes

SVG有一些预定义的形状元素,可被开发者使用和操作:

矩形 <rect>

圆形 <circle>

椭圆 <ellipse>

线 <line>

折线 <polyline>

多边形 <polygon>

路径 <path>

- 一个简单的队列

luyulong

java数据结构队列

public class MyQueue {

private long[] arr;

private int front;

private int end;

// 有效数据的大小

private int elements;

public MyQueue() {

arr = new long[10];

elements = 0;

front

- 基础数据结构和算法九:Binary Search Tree

sunwinner

Algorithm

A binary search tree (BST) is a binary tree where each node has a Comparable key (and an associated value) and satisfies the restriction that the key in any node is larger than the keys in all

- 项目出现的一些问题和体会

Steven-Walker

DAOWebservlet

第一篇博客不知道要写点什么,就先来点近阶段的感悟吧。

这几天学了servlet和数据库等知识,就参照老方的视频写了一个简单的增删改查的,完成了最简单的一些功能,使用了三层架构。

dao层完成的是对数据库具体的功能实现,service层调用了dao层的实现方法,具体对servlet提供支持。

&

- 高手问答:Java老A带你全面提升Java单兵作战能力!

ITeye管理员

java

本期特邀《Java特种兵》作者:谢宇,CSDN论坛ID: xieyuooo 针对JAVA问题给予大家解答,欢迎网友积极提问,与专家一起讨论!

作者简介:

淘宝网资深Java工程师,CSDN超人气博主,人称“胖哥”。

CSDN博客地址:

http://blog.csdn.net/xieyuooo

作者在进入大学前是一个不折不扣的计算机白痴,曾经被人笑话过不懂鼠标是什么,