Hadoop学习----HDFS

文件系统

- 文件系统:是一种存储和组织数据的方法,实现数据的存储、分级组织、访问和获取等操作,使得用户对文件访问和查找变得容易。

- 文件系统使用树形目录的抽象逻辑概念代替了硬盘等物理设备使用数据块的概念,用户不必关心数据底层存在硬盘哪里,只需要记住这个文件所属目录和文件名即可。

- 文件系统通常使用硬盘和光盘这样的存储设备,并维护文件在设备中的物理位置

传统常见的文件系统,更多的指的是单机文件系统,也就是底层不会横跨多台机器实现,比如windows操作系统的文件系统,Linux系统的文件系统等

这些文件系统特征:

1、带有抽象的目录树形结构,树都是从根目录开始向下蔓延

2、树中节点分为两类:目录和文件

3、从根目录开始,节点路径具有唯一性

数据和元数据:

- 数据:指的是内容本身,比如文件、视频、图片等,这些数据底层最终存储在磁盘等存储介质上的,用户无需关心,只需要基于目录树进行增删改查即可,实际针对数据的操作由文件系统完成。

- 元数据:称之为解释性数据,文件系统的元数据一般指,文件大小,最后修改时间,存储位置,权限等。

大数据时代,面对海量数据,传统文件系统问题。

传统存储硬件通用性差,设备投资加上后期维护、升级扩容成本非常高。

传统文件系统无法支撑高效率的计算分析,传统存储方式意味着数据,存储是存储,计算是计算,当需要处理数据时,把数据移动过来(移动到内存,内存能容下多大数据),数据和程序属于不用的技术厂商实现,无法有机统一整合在一起。

单节点IO性能瓶颈无法逾越,难以支撑海量数据的高并发高吞吐场景。

可扩展性差,无法实现快速部署和弹性扩展,动态扩容,缩容成本高,技术实现难度大。

分布式存储的优点

分布式存储功能

问题:数据量大,单机存储遇到瓶颈

解决:

单机纵向扩展:磁盘不够加磁盘,有上限瓶颈限制

多机横向扩展:机器不够加机器,理论上无线扩展

元数据记录功能

文件分布在不同机器上不利于寻找

元数据记录下文件及其存储位置信息,快速定位文件位置

Namenode管理的元数据具有两种类型:

1、文件自身属性信息:文件名称、权限、修改时间、文件大小、复制因子

2、文件快位置映射信息:记录文件快和DataNode之间的映射信息,即哪个快位于哪个节点上

文件分块存储

问题:文件过大导致单机存不下,上传下载效率低

解决:文件分块存储在不同机器,针对 块 并行操作提高效率,元数据进行详细描述。

块大小默认是128M,不足128M则本身就是一块,块的大小可以通过配置参数来规定,参数位于hdfs-default.xml中dfs.blocksize

副本机制作用:

问题:硬件故障,数据丢失

解决:不同机器设置备份,冗余存储,保障数据安全。升级元数据描述,描述冗余数据

文件的所有block都会有副本,副本系数可以在文件创建的时候指定,也可以在之后通过命令改变。副本参数由dfs.replication控制,默认值是3,也就是会额外再复制2分,连同本身共3份副本。

HDFS

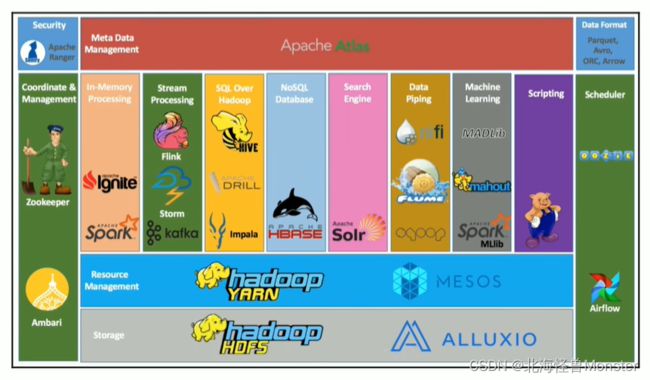

HDFS(Hadoop Distributed File System),Hadoop分布式文件系统

是Apache Hadoop核心组件之一,作为大数据生态圈最底层的分布式存储服务而存在,也可以说大数据首先要解决的问题就是海量数据的存储问题。

HDFS简介

- HDFS主要是解决大数据如何存储问题,分布式意味着HDFS是横跨在多台机器上的存储系统。

- HDFS是一种能够在普通硬件上运行的分布式文件系统,它的高度容错的,适应于具有大数据集的应用程序,它非常适用于存储大型数据

- HDFS使用多台计算机存储文件,并且提供统一的访问接口,像是访问一个普通文件系统一样使用分布式文件系统

HDFS shell命令操作

固定前缀:hadoop fs

HDFS Shell CLI支持操作多种文件系统,具体操作的是什么文件系统取决于命令中文件路径URL中的前缀协议

如果没有指定前缀,则会读取环境变量中的fs.defaultFS属性,以该属性作为默认文件系统

就是core-site.xml中的

<property>

<name>fs.defaultFSname>

<value>hdfs://node1:8020value>

property>

hadoop fs -ls file:/// #操作本地文件系统

hadoop fs -ls hdfs://node1:8020/ #操作HDFS分布式文件系统

HDFS文件系统的操作命令很多和Linux类似,因此学习成本相对较低。可以通过hadoop fs -help命令查看每个命令的详细用法

hadoop fs -mkdir [-p]

# path为带创建的目录 -p选项的行为是创建多级目录时

hadoop fs -ls [-h][-R] []

# path 指定目录路径 -h 人性化显示文件size -R 递归查看指定目录及其子目录

hadoop fs -put [-f][-p]

# -f 覆盖目标文件(已存在下) -p 保留访问和修改时间,所有权和权限

# localsrc 本地文件系统(客户端所在的系统) dst 目标文件系统

hadoop fs -cat

# 读取指定文件全部内容,显示在标准输出控制台。对于大文件的内容读取,慎重

hadoop fs -get [-f][-p]

# 下载文件到本地文件系统,localsrc是必须目录

# -f 覆盖目标文件(已存在下) -p 保留访问和修改时间,所有权和权限

hadoop fs -get /test/1.txt ./2.txt # 下载并改名

hadoop fs -appendToFile

# 将所有给定本地文件的内容追加到给定dst文件中

# dst如果文件不存在,将创建该文件,如果localsrc为-,则输入为从标准输入中读取

hadoop fs -appendToFile ./1.txt ./2.txt ./3.txt /test.txt

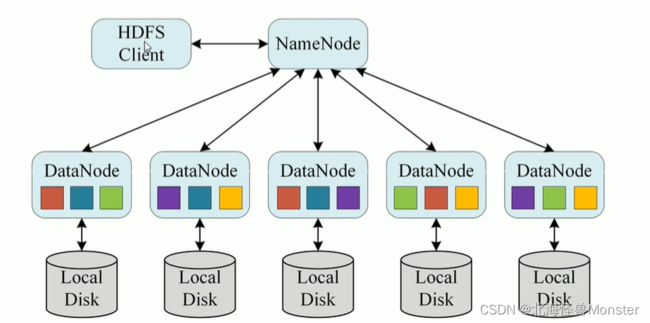

HDFS 集群和角色

主角色 NameNode,是Hadoop分布式文件系统的核心,架构中的主角色。维护和管理文件系统元数据,包括名称空间目录树结构,文件和块的位置信息,访问权限等信息。

从角色 DataNode,Hadoop的HDFS集群中的从角色,负责具体的数据块存储

DataNode的数量决定了HDFS集群的整体数据存储能力,通过和NameNode配合维护数据块

主角色辅助角色 secondaryNameNode,充当NameNode辅助节点,但不能代替NameNode

主要是帮助主角色进行元数据文件的合并动作,可以通俗理解为主角色的秘书

HDFS 写数据流程(上传文件)

核心概念–Pipeline管道

Pipeline中文翻译为管道,这是HDFS在上传文件写数据过程中采用的一种数据传输方式

客户端将数据写入第一个数据节点,第一个数据节点保存数据之后再将块复制到第二个数据节点,后者保存后将其复制到第三个数据节点。

核心概念–ACK应答响应

ACK即是确认字符,再数据通信中,接收方发给发送方的一种传输类控制字符,表示发来的数据已确认接收无误

再HDFS pipeline 管道传输数据的过程中,传输的反方向会进行ACK校验,确保数据传输安全。

ACK校验是两两之间的校验

核心概念–默认3副本存储策略

默认副本存储策略是由Block Placement Policy Default指定

第一块副本:优先客户端本地(如果存储空间允许),否则随机

第二块副本:不同于第一块副本的不同机架

第三块副本:第二块副本相同机架的不同机器

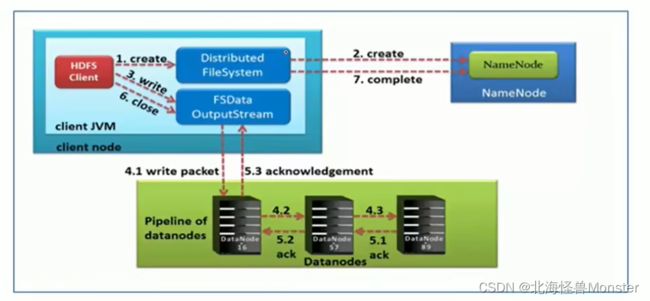

客户端上传文件的具体流程

1、HDFS客户端创建对象实例DistributedFileSystem,该对象中封装了与HDFS文件系统操作的相关方法

2、调用DistributedFileSystem对象的create()方法,通过RPC请求NameNode创建文件

NameNode执行各种检查判断:目标文件是否存在、父目录是否存在,客户端是否具有创建该文件的权限,检查

通过,NameNode就会为本次请求记录下一条记录,返回FSDataOutputStream输出流对象给客户端用于写数据

3、客户端通过FSDataOutputStream输出流开始写入数据

4、客户端写入数据时,将数据分成一个个数据包(packet 默认64k)。内部组件DataStreamer请求NameNode挑选出合适存储数据副本的一组DataNode地址,默认是3副本存储

DataStreamer将数据包流式传输到pipeline的第一个DataNode,该DataNode存储数据包并将它发送到pipeline的第二个DataNode。同样,第二个DataNode存储数据包并且发送给第三个(也是最后一个)DataNode

5、传输的反方向上,会通过ACK机制校验数据包传输是否成功

6、客户端完成数据写入后,在FSDataOutputStream输出流上调用close()方法关闭

7、DistributedFileSystem联系NameNode告知其文件写入完成,等待NameNode确认

如果管道在2,3之间断掉,会怎样?

因为namenode已经知道文件由哪些块组成(DataStream请求分配数据块),因此仅需等待最小复制快即可成功返回,最小复制参数由dfs.namenode.replication.min指定,默认为1

换句话说,只要一个副本上传成功了就认为是成功了,其他副本可以找其他机器进行复制。如果一个副本都没有成功,那就认为文件上传失败。