- 阿里云魔搭社区AIGC专区:中国AI创作的革命性平台

Liudef06小白

阿里云AIGC人工智能

在生成式人工智能重塑全球数字创作版图的浪潮中,中国首个一站式AIGC开发平台——阿里云魔搭社区AIGC专区于2024年9月杭州云栖大会正式亮相。这一突破性进展不仅填补了国内全流程AI创作工具的空白,更以157款多模态开源模型和全免费GPU算力的开放姿态,为超过690万开发者提供了从模型调用到应用落地的完整生态支持。一、魔搭社区:中国AI模型生态的奠基者魔搭社区(ModelScope)作为阿里云在2

- 探秘阿里云Tair KVCache:大模型推理的加速引擎

云资源服务商

阿里云云计算人工智能

一、引言近年来,人工智能领域发展迅猛,大语言模型(LLM)不断取得突破,其应用场景也日益广泛。从智能客服到内容生成,从智能写作到智能翻译,大语言模型正在深刻地改变着我们的生活和工作方式。随着模型规模的不断扩大和推理需求的日益增长,大模型推理过程中的显存瓶颈问题逐渐凸显,成为制约其发展和应用的关键因素。在大模型推理中,KVCache技术作为一种优化手段,通过缓存历史Token的Key/Value向量

- AI正在偷偷取代这10种职业,你的工作安全吗?

近年来,人工智能(AI)的飞速发展正在悄然改变我们的工作方式。从自动化客服到AI生成内容,许多传统职业正面临被取代的风险。虽然AI带来了更高的效率和便利,但也让不少人开始担忧:我的工作会被AI抢走吗?今天,我们就来盘点10种最容易被AI取代的职业,并探讨如何在这个AI时代保持竞争力。1.客服代表取代指数:★★★★★AI驱动的聊天机器人(如ChatGPT、GoogleBard)已经能够处理大部分基础

- 直播预告!探讨生成模型中的极简概念擦除

青稞社区.

青稞Talk人工智能图像处理

主页:http://qingkeai.online/原文:https://mp.weixin.qq.com/s/yc4whKbnVY8ho1w7rgFVGg6月16日20:00,青稞Talk第55期,新加坡国立大学博士生张扬,将直播分享《生成模型中的极简概念擦除》。分享嘉宾张扬,慕尼黑工业大学计算机专业硕士,新加坡国立大学人工智能专业博士。曾于牛津大学进行学术访问,并在微软亚洲研究院及美国运通新加

- 【DeepSeek实战】3、Ollama实战指南:LobeChat+多网关架构打造高可用大模型集群

无心水

Ollama实战指南LobeChat实战DeepSeek实战DeepSeek全栈应用开发AI入门大模型CSDN技术干货

一、企业级大模型集群架构全景解析在人工智能落地应用的过程中,大模型服务的高可用性、成本控制和灵活扩展能力成为企业关注的核心痛点。本方案通过LobeChat前端、AI网关层和Ollama模型集群的三层架构设计,实现了无需复杂运维即可部署的生产级大模型服务体系。该架构不仅支持负载均衡、故障转移和模型热切换等企业级特性。还通过量化技术将硬件成本降低60%以上,为中小企业提供了与商业云服务相当的性能体验。

- 生成式人工智能实战 | 深度卷积生成对抗网络(Deep Convolutional Generative Adversarial Network, DCGAN)

盼小辉丶

生成式人工智能实战150讲人工智能生成对抗网络神经网络

生成式人工智能实战|深度卷积生成对抗网络0.前言1.模型与数据集分析1.1模型分析1.2数据集介绍2.构建DCGAN生成人脸图像2.1数据处理2.2模型构建2.3模型训练0.前言深度卷积生成对抗网络(DeepConvolutionalGenerativeAdversarialNetworks,DCGAN)是基于生成对抗网络(ConvolutionalGenerativeAdversarialNet

- 深度学习实战:基于嵌入模型的AI应用开发

AIGC应用创新大全

AI人工智能与大数据应用开发MCP&Agent云算力网络人工智能深度学习ai

深度学习实战:基于嵌入模型的AI应用开发关键词:嵌入模型(EmbeddingModel)、深度学习、向量空间、语义表示、AI应用开发、相似性搜索、迁移学习摘要:本文将带你从0到1掌握基于嵌入模型的AI应用开发全流程。我们会用“翻译机”“数字身份证”等生活比喻拆解嵌入模型的核心原理,结合Python代码实战(BERT/CLIP模型)演示如何将文本、图像转化为可计算的语义向量,并通过“智能客服问答”“

- 2024年AI 智能助手(大模型)产品市场分析|商派

徐礼昭|商派软件市场负责人

人工智能

一、引言人工智能的浪潮不断向前推进,智能助手作为其中的重要应用,已经逐渐渗透到我们生活的各个方面。它们以其便捷性和个性化的特点,改变了我们与世界的互动方式。本报告将对AI智能助手进行全面的行业分析,包括行业概况、主要玩家、用户数据、发展要素以及未来趋势等方面,并通过具体案例分享,帮助读者深入了解这一领域的现状和未来发展潜力。二、行业概览(一)智能助手的定义和发展阶段智能助手是利用人工智能技术为用户

- 基于OpenCv的图片倾斜校正系统详细设计与具体代码实现

AI大模型应用之禅

人工智能数学基础计算科学神经计算深度学习神经网络大数据人工智能大型语言模型AIAGILLMJavaPython架构设计AgentRPA

基于OpenCv的图片倾斜校正系统详细设计与具体代码实现1.背景介绍1.1图像处理的重要性在当今数字时代,图像处理技术在各个领域都扮演着重要角色。无论是在计算机视觉、模式识别、医学影像、遥感探测还是多媒体处理等领域,图像处理都是不可或缺的核心技术。通过对图像进行预处理、增强、分割、特征提取等操作,可以从图像中获取有价值的信息,为后续的分析和决策提供支持。1.2图像倾斜问题及其影响在实际应用中,由于

- 高通 QCS8550 大模型性能深度解析:从算力基准到场景实测的全维度 Benchmark

伊利丹~怒风

Qualcomm人工智能AI编程pythonarm自然语言处理

前言在人工智能技术狂飙突进的时代,大模型正以前所未有的速度重塑各行业生态,从智能客服到多模态交互,从边缘推理到端侧部署,其应用场景不断拓展。而这一切革新的背后,离不开底层硬件的强力支撑。高通QCS8550作为面向下一代智能设备的旗舰级计算平台,凭借高达48TOPS的AI算力与先进的第七代高通AI引擎,在大模型性能表现上极具竞争力。其异构多核架构不仅能高效处理复杂的神经网络计算,还通过软硬件协同优化

- 从零开始理解零样本学习:AI人工智能必学技术

AI天才研究院

AgenticAI实战AI人工智能与大数据AI大模型企业级应用开发实战ai

从零开始理解零样本学习:AI人工智能必学技术关键词:零样本学习、人工智能、机器学习、知识迁移、语义嵌入摘要:本文旨在全面深入地介绍零样本学习这一在人工智能领域具有重要意义的技术。首先阐述零样本学习的背景和基本概念,通过详细的解释和直观的示意图让读者建立起对零样本学习的初步认识。接着深入剖析其核心算法原理,结合Python代码进行详细说明,同时引入相关数学模型和公式并举例阐释。通过项目实战部分,带领

- 卷积神经网络(Convolutional Neural Network, CNN)

不想秃头的程序

神经网络语音识别人工智能深度学习网络卷积神经网络

卷积神经网络(ConvolutionalNeuralNetwork,CNN)是一种专门用于处理图像、视频等网格数据的深度学习模型。它通过卷积层自动提取数据的特征,并利用空间共享权重和池化层减少参数量和计算复杂度,成为计算机视觉领域的核心技术。以下是CNN的详细介绍:一、核心思想CNN的核心目标是从图像中自动学习层次化特征,并通过空间共享权重和平移不变性减少参数量和计算成本。其关键组件包括:卷积层(

- ResNet(Residual Network)

不想秃头的程序

神经网络语音识别人工智能深度学习网络残差网络神经网络

ResNet(ResidualNetwork)是深度学习中一种经典的卷积神经网络(CNN)架构,由微软研究院的KaimingHe等人在2015年提出。它通过引入残差连接(SkipConnection)解决了深度神经网络中的梯度消失问题,使得网络可以训练极深的模型(如上百层),并在图像分类、目标检测、语义分割等任务中取得了突破性成果。以下是ResNet的详细介绍:一、核心思想ResNet的核心创新是

- P25:LSTM实现糖尿病探索与预测

?Agony

lstm人工智能rnn

本文为365天深度学习训练营中的学习记录博客原作者:K同学啊一、相关技术1.LSTM基本概念LSTM(长短期记忆网络)是RNN(循环神经网络)的一种变体,它通过引入特殊的结构来解决传统RNN中的梯度消失和梯度爆炸问题,特别适合处理序列数据。结构组成:遗忘门:决定丢弃哪些信息,通过sigmoid函数输出0-1之间的值,表示保留或遗忘的程度。输入门:决定更新哪些信息,同样通过sigmoid函数控制更新

- Python训练营打卡——DAY16(2025.5.5)

cosine2025

Python训练营打卡python开发语言机器学习

目录一、NumPy数组基础笔记1.理解数组的维度(Dimensions)2.NumPy数组与深度学习Tensor的关系3.一维数组(1DArray)4.二维数组(2DArray)5.数组的创建5.1数组的简单创建5.2数组的随机化创建5.3数组的遍历5.4数组的运算6.数组的索引6.1一维数组索引6.2二维数组索引6.3三维数组索引二、SHAP值的深入理解三、总结1.NumPy数组基础总结2.SH

- [Python]-基础篇1- 从零开始的Python入门指南

踏雪无痕老爷子

Pythonpython开发语言

无论你是尚未接触编程的新手,还是想从其他语言转向Python的开发者,这篇文章都是你的入门课。一、Python是什么?Python是一种解释型、高级、通用型编程语言,以简洁明了、简单易用着称。它可以应用于网站开发、自动化脚本、数据分析、人工智能、系统操作等多种场景。二、如何安装Python步骤:访问Python官方网站选择目前最新的Python3.x版本下载Windows用户请务必勾选“AddPy

- 【机器学习&深度学习】反向传播机制

目录一、一句话定义二、类比理解三、为什重要?四、用生活例子解释:神经网络=烹饪机器人4.1第一步:尝一口(前向传播)4.2第二步:倒着推原因(反向传播)五、换成人工智能流程说一遍六、图示类比:找山顶(最优参数)七、总结一句人话八、PyTorch代码示例:亲眼看到每一层的梯度九、梯度=损失函数对参数的偏导数十、类比总结反向传播(Backpropagation)是神经网络中训练过程的核心机制,它就像“

- 人脸识别算法赋能园区无人超市安防升级

智驱力人工智能

算法人工智能边缘计算人脸识别智慧园区智慧工地智慧煤矿

人脸识别算法赋能园区无人超市安防升级正文在园区无人超市的运营管理中,传统安防手段依赖人工巡检或基础监控设备,存在响应滞后、误报率高、环境适应性差等问题。本文从技术背景、实现路径、功能优势及应用场景四个维度,阐述如何通过人脸识别检测、人员入侵算法及疲劳检测算法的协同应用,构建高效、精准的智能安防体系。一、技术背景:视觉分析算法的核心支撑人脸识别算法基于深度学习的卷积神经网络(CNN)模型,通过提取面

- 潜入思维的海洋:SoftCoT++如何让语言模型更聪明

步子哥

智能涌现语言模型人工智能自然语言处理

在人工智能的浩瀚星空下,大型语言模型(LLMs)如同一颗颗璀璨的恒星,照亮了从文本生成到复杂推理的广阔领域。然而,这些模型在推理任务中往往像是在迷雾中航行——尽管它们能抵达目的地,却常常因为固定的思维路径而错过更优的航线。2025年5月,一篇题为《SoftCoT++:Test-TimeScalingwithSoftChain-of-ThoughtReasoning》的论文如同一盏明灯,照亮了如何让

- BI+AI实战:我们如何用3秒完成车企供应链推演

qq_43696218

人工智能

一、BI+AI引领财务分析新纪元在财务数据分析领域,奥威BI+AI正以革命性的姿态颠覆传统。当金蝶、用友等工具仍深陷报表泥潭时,奥威BI+AI通过深度融合商业智能(BI)与人工智能(AI),实现了从滞后报表到实时洞察的飞跃。这不仅极大地提升了财务分析的效率,更为企业的战略决策提供了前所未有的精准支持。二、BI+AI的核心技术优势实时动态分析o奥威BI+AI摒弃了静态数据集,依托原始科目余额表实

- DeepSeek-V3 通俗详解:从诞生到优势,以及与 GPT-4o 的对比

码事漫谈

AIai

前些天发现了一个巨牛的人工智能学习网站,通俗易懂,风趣幽默,忍不住分享一下给大家。点击跳转到网站1.DeepSeek的前世今生1.1什么是DeepSeek?DeepSeek是一家专注于人工智能技术研发的公司,致力于打造高性能、低成本的AI模型。它的目标是让AI技术更加普惠,让更多人能够用上强大的AI工具。1.2DeepSeek-V3的诞生DeepSeek-V3是DeepSeek公司推出的最新一代A

- 企业级AI开发利器:Spring AI框架深度解析与实战_spring ai实战

AI大模型-海文

人工智能springpython算法开发语言java机器学习

企业级AI开发利器:SpringAI框架深度解析与实战一、前言:Java生态的AI新纪元在人工智能技术爆发式发展的今天,Java开发者面临着一个新的挑战:如何将大语言模型(LLMs)和生成式AI(GenAI)无缝融入企业级应用。传统的Java生态缺乏统一的AI集成方案,开发者往往需要为不同AI供应商(如OpenAI、阿里云、HuggingFace)编写大量重复的接口适配代码,这不仅增加了开发成本,

- Python编程:使用Opencv进行图像处理

【参考】https://github.com/opencv/opencv/tree/4.x/samples/pythonPython使用OpenCV进行图像处理OpenCV(OpenSourceComputerVisionLibrary)是一个开源的计算机视觉和机器学习软件库。下面将从基础到高阶介绍如何使用Python中的OpenCV进行图像处理。一、安装首先需要安装OpenCV库:pipinst

- 图扑软件智慧云展厅,开启数字化展馆新模式

智慧园区

可视化5g人工智能大数据安全云计算

随着疫情的影响以及新兴技术的不断发展,展会的发展形式也逐渐从线下转向线上。通过“云”上启动、云端互动、双线共频的形式开展。通过应用大数据、人工智能、沉浸式交互等多重技术手段,构建数据共享、信息互通、精准匹配的高精度“云展厅”,突破时空壁垒限制。图扑软件运用HT强大的渲染功能,数字孪生“云展位”,1:1复现实际展厅内部独特的结构造型和建筑特色。也可以第一人称视角漫游,模拟用户在展厅内的参观场景,在保

- 转行要趁早!网络安全行业人才缺口大,企业招聘需求正旺!

网络安全行业具有人才缺口大、岗位选择多、薪资待遇好、学历要求不高等优势,对于想要转行的人员来说,是一个非常不错的选择。人才缺口大网络安全攻防技术手段日新月异,特别是现在人工智能技术飞速发展,网络安全形势复杂严峻,人才重要性凸显。教育部《网络安全人才实战能力白皮书》数据显示,到2027年,我国网络安全人员缺口将达327万。近期发布的《2024年网络安全产业人才发展报告》中提到,沿用ISC2的人才缺口

- 【机器学习与数据挖掘实战 | 医疗】案例18:基于Apriori算法的中医证型关联规则分析

Francek Chen

机器学习与数据挖掘实战机器学习数据挖掘Aprioripython关联规则人工智能

【作者主页】FrancekChen【专栏介绍】⌈⌈⌈机器学习与数据挖掘实战⌋⌋⌋机器学习是人工智能的一个分支,专注于让计算机系统通过数据学习和改进。它利用统计和计算方法,使模型能够从数据中自动提取特征并做出预测或决策。数据挖掘则是从大型数据集中发现模式、关联和异常的过程,旨在提取有价值的信息和知识。机器学习为数据挖掘提供了强大的分析工具,而数据挖掘则是机器学习应用的重要领域,两者相辅相成,共同推动

- 【Python深度学习】零基础掌握Pytorch Pooling layers nn.MaxPool方法

Mr数据杨

Python深度学习python深度学习pytorch

在深度学习的世界中,MaxPooling是一种关键的操作,用于降低数据的维度并保留重要特征。这就像是从一堆照片中挑选出最能代表某个场景的那张。PyTorch提供了多种MaxPooling层,包括nn.MaxPool1d、nn.MaxPool2d和nn.MaxPool3d,它们分别适用于不同维度的数据处理。如果处理的是声音信号(一维数据),就会用到nn.MaxPool1d。而处理图像(二维数据)时,

- 误差的回响:反向传播算法与神经网络的惊天逆转

田园Coder

人工智能科普人工智能科普

当专家系统在20世纪80年代初期大放异彩,成为人工智能实用化的耀眼明星时,另一股曾经被宣判“死刑”的力量——连接主义(神经网络)——正在寒冬的冻土下悄然涌动,孕育着一场惊天动地的复苏。马文·明斯基和西摩·帕尔特在1969年《感知机》专著中那精准而冷酷的理论批判,如同沉重的封印,将多层神经网络的研究禁锢了近二十年。他们指出的核心死结——缺乏有效算法来训练具有隐藏层的网络——仿佛一道无法逾越的天堑。单

- 【Html实现“心形日出”(附效果+源代码)】| JavaScript面试题:解释一下异步编程中的回调函数、Promise和Async/Await的概念。它们有什么区别?

追光者♂

html5css3心形日出前端特效JS面试题PromiseAsync/Await

风会带走你曾经存在过的证明。——虞姬作者主页:追光者♂个人简介:[1]计算机专业硕士研究生[2]2023年城市之星领跑者TOP1(哈尔滨)[3]2022年度博客之星人工智能领域TOP4[4]阿里云社区特邀专家博主[5]CSDN-人工智能领域优质创作者无限进步,一起追光!!!

- 阅读笔记(2) 单层网络:回归

a2507283885

笔记

阅读笔记(2)单层网络:回归该笔记是DataWhale组队学习计划(共度AI新圣经:深度学习基础与概念)的Task02以下内容为个人理解,可能存在不准确或疏漏之处,请以教材为主。1.从泛函视角来看线性回归还记得线性代数里学过的“基”这个概念吗?一组基向量是一组线性无关的向量,它们通过线性组合可以张成一个向量空间。也就是说,这个空间里的任意一个向量,都可以表示成这组基的线性组合。函数其实也可以看作是

- java观察者模式

3213213333332132

java设计模式游戏观察者模式

观察者模式——顾名思义,就是一个对象观察另一个对象,当被观察的对象发生变化时,观察者也会跟着变化。

在日常中,我们配java环境变量时,设置一个JAVAHOME变量,这就是被观察者,使用了JAVAHOME变量的对象都是观察者,一旦JAVAHOME的路径改动,其他的也会跟着改动。

这样的例子很多,我想用小时候玩的老鹰捉小鸡游戏来简单的描绘观察者模式。

老鹰会变成观察者,母鸡和小鸡是

- TFS RESTful API 模拟上传测试

ronin47

TFS RESTful API 模拟上传测试。

细节参看这里:https://github.com/alibaba/nginx-tfs/blob/master/TFS_RESTful_API.markdown

模拟POST上传一个图片:

curl --data-binary @/opt/tfs.png http

- PHP常用设计模式单例, 工厂, 观察者, 责任链, 装饰, 策略,适配,桥接模式

dcj3sjt126com

设计模式PHP

// 多态, 在JAVA中是这样用的, 其实在PHP当中可以自然消除, 因为参数是动态的, 你传什么过来都可以, 不限制类型, 直接调用类的方法

abstract class Tiger {

public abstract function climb();

}

class XTiger extends Tiger {

public function climb()

- hibernate

171815164

Hibernate

main,save

Configuration conf =new Configuration().configure();

SessionFactory sf=conf.buildSessionFactory();

Session sess=sf.openSession();

Transaction tx=sess.beginTransaction();

News a=new

- Ant实例分析

g21121

ant

下面是一个Ant构建文件的实例,通过这个实例我们可以很清楚的理顺构建一个项目的顺序及依赖关系,从而编写出更加合理的构建文件。

下面是build.xml的代码:

<?xml version="1

- [简单]工作记录_接口返回405原因

53873039oycg

工作

最近调接口时候一直报错,错误信息是:

responseCode:405

responseMsg:Method Not Allowed

接口请求方式Post.

- 关于java.lang.ClassNotFoundException 和 java.lang.NoClassDefFoundError 的区别

程序员是怎么炼成的

真正完成类的加载工作是通过调用 defineClass来实现的;

而启动类的加载过程是通过调用 loadClass来实现的;

就是类加载器分为加载和定义

protected Class<?> findClass(String name) throws ClassNotFoundExcept

- JDBC学习笔记-JDBC详细的操作流程

aijuans

jdbc

所有的JDBC应用程序都具有下面的基本流程: 1、加载数据库驱动并建立到数据库的连接。 2、执行SQL语句。 3、处理结果。 4、从数据库断开连接释放资源。

下面我们就来仔细看一看每一个步骤:

其实按照上面所说每个阶段都可得单独拿出来写成一个独立的类方法文件。共别的应用来调用。

1、加载数据库驱动并建立到数据库的连接:

Html代码

St

- rome创建rss

antonyup_2006

tomcatcmsxmlstrutsOpera

引用

1.RSS标准

RSS标准比较混乱,主要有以下3个系列

RSS 0.9x / 2.0 : RSS技术诞生于1999年的网景公司(Netscape),其发布了一个0.9版本的规范。2001年,RSS技术标准的发展工作被Userland Software公司的戴夫 温那(Dave Winer)所接手。陆续发布了0.9x的系列版本。当W3C小组发布RSS 1.0后,Dave W

- html表格和表单基础

百合不是茶

html表格表单meta锚点

第一次用html来写东西,感觉压力山大,每次看见别人发的都是比较牛逼的 再看看自己什么都还不会,

html是一种标记语言,其实很简单都是固定的格式

_----------------------------------------表格和表单

表格是html的重要组成部分,表格用在body里面的

主要用法如下;

<table>

&

- ibatis如何传入完整的sql语句

bijian1013

javasqlibatis

ibatis如何传入完整的sql语句?进一步说,String str ="select * from test_table",我想把str传入ibatis中执行,是传递整条sql语句。

解决办法:

<

- 精通Oracle10编程SQL(14)开发动态SQL

bijian1013

oracle数据库plsql

/*

*开发动态SQL

*/

--使用EXECUTE IMMEDIATE处理DDL操作

CREATE OR REPLACE PROCEDURE drop_table(table_name varchar2)

is

sql_statement varchar2(100);

begin

sql_statement:='DROP TABLE '||table_name;

- 【Linux命令】Linux工作中常用命令

bit1129

linux命令

不断的总结工作中常用的Linux命令

1.查看端口被哪个进程占用

通过这个命令可以得到占用8085端口的进程号,然后通过ps -ef|grep 进程号得到进程的详细信息

netstat -anp | grep 8085

察看进程ID对应的进程占用的端口号

netstat -anp | grep 进程ID

&

- 优秀网站和文档收集

白糖_

网站

集成 Flex, Spring, Hibernate 构建应用程序

性能测试工具-JMeter

Hmtl5-IOCN网站

Oracle精简版教程网站

鸟哥的linux私房菜

Jetty中文文档

50个jquery必备代码片段

swfobject.js检测flash版本号工具

- angular.extend

boyitech

AngularJSangular.extendAngularJS API

angular.extend 复制src对象中的属性去dst对象中. 支持多个src对象. 如果你不想改变一个对象,你可以把dst设为空对象{}: var object = angular.extend({}, object1, object2). 注意: angular.extend不支持递归复制. 使用方法: angular.extend(dst, src); 参数:

- java-谷歌面试题-设计方便提取中数的数据结构

bylijinnan

java

网上找了一下这道题的解答,但都是提供思路,没有提供具体实现。其中使用大小堆这个思路看似简单,但实现起来要考虑很多。

以下分别用排序数组和大小堆来实现。

使用大小堆:

import java.util.Arrays;

public class MedianInHeap {

/**

* 题目:设计方便提取中数的数据结构

* 设计一个数据结构,其中包含两个函数,1.插

- ajaxFileUpload 针对 ie jquery 1.7+不能使用问题修复版本

Chen.H

ajaxFileUploadie6ie7ie8ie9

jQuery.extend({

handleError: function( s, xhr, status, e ) {

// If a local callback was specified, fire it

if ( s.error ) {

s.error.call( s.context || s, xhr, status, e );

}

- [机器人制造原则]机器人的电池和存储器必须可以替换

comsci

制造

机器人的身体随时随地可能被外来力量所破坏,但是如果机器人的存储器和电池可以更换,那么这个机器人的思维和记忆力就可以保存下来,即使身体受到伤害,在把存储器取下来安装到一个新的身体上之后,原有的性格和能力都可以继续维持.....

另外,如果一

- Oracle Multitable INSERT 的用法

daizj

oracle

转载Oracle笔记-Multitable INSERT 的用法

http://blog.chinaunix.net/uid-8504518-id-3310531.html

一、Insert基础用法

语法:

Insert Into 表名 (字段1,字段2,字段3...)

Values (值1,

- 专访黑客历史学家George Dyson

datamachine

on

20世纪最具威力的两项发明——核弹和计算机出自同一时代、同一群年青人。可是,与大名鼎鼎的曼哈顿计划(第二次世界大战中美国原子弹研究计划)相 比,计算机的起源显得默默无闻。出身计算机世家的历史学家George Dyson在其新书《图灵大教堂》(Turing’s Cathedral)中讲述了阿兰·图灵、约翰·冯·诺依曼等一帮子天才小子创造计算机及预见计算机未来

- 小学6年级英语单词背诵第一课

dcj3sjt126com

englishword

always 总是

rice 水稻,米饭

before 在...之前

live 生活,居住

usual 通常的

early 早的

begin 开始

month 月份

year 年

last 最后的

east 东方的

high 高的

far 远的

window 窗户

world 世界

than 比...更

- 在线IT教育和在线IT高端教育

dcj3sjt126com

教育

codecademy

http://www.codecademy.com codeschool

https://www.codeschool.com teamtreehouse

http://teamtreehouse.com lynda

http://www.lynda.com/ Coursera

https://www.coursera.

- Struts2 xml校验框架所定义的校验文件

蕃薯耀

Struts2 xml校验Struts2 xml校验框架Struts2校验

>>>>>>>>>>>>>>>>>>>>>>>>>>>>>>>>>>>>>>

蕃薯耀 2015年7月11日 15:54:59 星期六

http://fa

- mac下安装rar和unrar命令

hanqunfeng

mac

1.下载:http://www.rarlab.com/download.htm 选择

RAR 5.21 for Mac OS X 2.解压下载后的文件 tar -zxvf rarosx-5.2.1.tar 3.cd rar sudo install -c -o $USER unrar /bin #输入当前用户登录密码 sudo install -c -o $USER rar

- 三种将list转换为map的方法

jackyrong

list

在本文中,介绍三种将list转换为map的方法:

1) 传统方法

假设有某个类如下

class Movie {

private Integer rank;

private String description;

public Movie(Integer rank, String des

- 年轻程序员需要学习的5大经验

lampcy

工作PHP程序员

在过去的7年半时间里,我带过的软件实习生超过一打,也看到过数以百计的学生和毕业生的档案。我发现很多事情他们都需要学习。或许你会说,我说的不就是某种特定的技术、算法、数学,或者其他特定形式的知识吗?没错,这的确是需要学习的,但却并不是最重要的事情。他们需要学习的最重要的东西是“自我规范”。这些规范就是:尽可能地写出最简洁的代码;如果代码后期会因为改动而变得凌乱不堪就得重构;尽量删除没用的代码,并添加

- 评“女孩遭野蛮引产致终身不育 60万赔偿款1分未得”医腐深入骨髓

nannan408

先来看南方网的一则报道:

再正常不过的结婚、生子,对于29岁的郑畅来说,却是一个永远也无法实现的梦想。从2010年到2015年,从24岁到29岁,一张张新旧不一的诊断书记录了她病情的同时,也清晰地记下了她人生的悲哀。

粗暴手术让人发寒

2010年7月,在酒店做服务员的郑畅发现自己怀孕了,可男朋友却联系不上。在没有和家人商量的情况下,她决定堕胎。

12月5日,

- 使用jQuery为input输入框绑定回车键事件 VS 为a标签绑定click事件

Everyday都不同

jspinput回车键绑定clickenter

假设如题所示的事件为同一个,必须先把该js函数抽离出来,该函数定义了监听的处理:

function search() {

//监听函数略......

}

为input框绑定回车事件,当用户在文本框中输入搜索关键字时,按回车键,即可触发search():

//回车绑定

$(".search").keydown(fun

- EXT学习记录

tntxia

ext

1. 准备

(1) 官网:http://www.sencha.com/

里面有源代码和API文档下载。

EXT的域名已经从www.extjs.com改成了www.sencha.com ,但extjs这个域名会自动转到sencha上。

(2)帮助文档:

想要查看EXT的官方文档的话,可以去这里h

- mybatis3的mapper文件报Referenced file contains errors

xingguangsixian

mybatis

最近使用mybatis.3.1.0时无意中碰到一个问题:

The errors below were detected when validating the file "mybatis-3-mapper.dtd" via the file "account-mapper.xml". In most cases these errors can be d

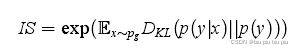

![]() 是均值,

是均值,![]() 是协方差,tr()表示矩阵的迹。FID值被认为比IS更鲁棒,且更接近于人类质量评估,可用于复杂的数据集

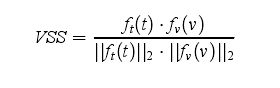

是协方差,tr()表示矩阵的迹。FID值被认为比IS更鲁棒,且更接近于人类质量评估,可用于复杂的数据集![]() ,可看做是图像编码器和文本编码器,它们分别将真实图像和文本映射到公共语义空间(512维)

,可看做是图像编码器和文本编码器,它们分别将真实图像和文本映射到公共语义空间(512维)![]() 是边界,一般设置为0.2,c(x,y)是余弦相似度函数,计算x和y的余弦相似度。{v, tv} 和 {t, vt} 是真实且匹配的图像文本对,其他组合是不匹配的。将v和t分别经fv和ft映射到公共的语义空间,计算他们之间的余弦相似度,其值越大,表示该图像v和文本t的语义一致性越大。

是边界,一般设置为0.2,c(x,y)是余弦相似度函数,计算x和y的余弦相似度。{v, tv} 和 {t, vt} 是真实且匹配的图像文本对,其他组合是不匹配的。将v和t分别经fv和ft映射到公共的语义空间,计算他们之间的余弦相似度,其值越大,表示该图像v和文本t的语义一致性越大。