【中文分词】最大熵马尔可夫模型MEMM

Xue & Shen '2003 [2]用两种序列标注模型——MEMM (Maximum Entropy Markov Model)与CRF (Conditional Random Field)——用于中文分词;看原论文感觉作者更像用的是MaxEnt (Maximum Entropy) 模型而非MEMM。MEMM是由McCallum et al. '2000 [1]提出MEMM,针对于HMM的两个痛点:一是其为生成模型(generative model),二是不能使用更加复杂的feature。

1. 前言

首先,将简要地介绍HMM与MaxEnt模型。

HMM

概率图模型(probabilistic graphical model, PGM)指用图表示变量相关(依赖)关系的概率模型,主要分为两类:

- 有向图模型或贝叶斯网(Bayesian network),使用有向图表示变量间的依赖关系;

- 无向图模型或马尔可夫网(Markov network),使用无向图表示变量间相关关系。

监督学习的任务就是学习一个模型,对于给定的输入XX,能预测出类别YY。所学习到的模型一般可表示为决策函数:

或者为条件概率

监督学习的模型分为生成模型(generative model)与判别模型(discriminative model)。生成模型学习联合概率分布P(X,Y)P(X,Y),然后通过贝叶斯定理求解条件概率(2)(2),而判别模型则是直接学习决策函数(1)(1)或条件概率(2)(2)。HMM属于生成模型的有向图PGM,通过联合概率建模:

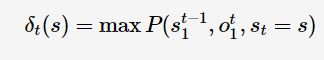

其中,SS、OO分别表示状态序列与观测序列。HMM的解码问题为argmaxSP(S|O)argmaxSP(S|O);定义在时刻tt状态为ss的所有单个路径st1s1t中的概率最大值为

则有

δt+1(s)=maxP(st1,ot+11,st+1=s)=maxs′P(st−11,ot1,st=s′)P(st+1|st)P(ot+1|st+1)=maxs′[δt(s′)P(s|s′)]P(ot+1|s)δt+1(s)=maxP(s1t,o1t+1,st+1=s)=maxs′P(s1t−1,o1t,st=s′)P(st+1|st)P(ot+1|st+1)=maxs′[δt(s′)P(s|s′)]P(ot+1|s)

上述式子即为(用于解决HMM的解码问题的)Viterbi算法的递推式;可以看出HMM是通过联合概率来求解标注问题的。

最大熵模型

最大熵(Maximum Entropy)模型属于log-linear model,在给定训练数据的条件下对模型进行极大似然估计或正则化极大似然估计:

其中,![]() 为归一化因子,w为最大熵模型的参数,fi(x,y)fi(x,y)为特征函数(feature function)——描述(x,y)(x,y)的某一事实。

为归一化因子,w为最大熵模型的参数,fi(x,y)fi(x,y)为特征函数(feature function)——描述(x,y)(x,y)的某一事实。

最大熵模型并没有假定feature相互独立,允许用户根据domain knowledge设计feature。

2. MEMM

MEMM并没有像HMM通过联合概率建模,而是直接学习条件概率

因此,有别于HMM,MEMM的当前状态依赖于前一状态与当前观测;HMM与MEMM的图模型如下(图来自于[3]):

一般化条件概率(4)为P(s|s′,o)P(s|s′,o)。MEMM用最大熵模型来学习条件概率(4),套用模型(3)则有:

其中,λaλa为学习参数;a=

类似于HMM,MEMM的解码问题的递推式:

但是,MEMM存在着标注偏置问题(label bias problem)。比如,有如下的概率分布(图来自于[7]):

但是,从全局的角度分析:

- 无论观测值,State 1 总是更倾向于转移到State 2;

- 无论观测值,State 2 总是更倾向于转移到State 2.

从式子(5)(5)可以看出MEMM所做的是本地归一化,导致有更少转移的状态拥有的转移概率普遍偏高,概率最大路径更容易出现转移少的状态。因MEMM存在着标注偏置问题,故全局归一化的CRF被提了出来[3]。欲知CRF如何,请看下一篇分解。

3. 参考资料

[1] McCallum, Andrew, Dayne Freitag, and Fernando CN Pereira. "Maximum Entropy Markov Models for Information Extraction and Segmentation." Icml. Vol. 17. 2000.

[2] Xue, Nianwen, and Libin Shen. "Chinese word segmentation as LMR tagging." Proceedings of the second SIGHAN workshop on Chinese language processing-Volume 17. Association for Computational Linguistics, 2003.

[3] Lafferty, John, Andrew McCallum, and Fernando Pereira. "Conditional random fields: Probabilistic models for segmenting and labeling sequence data." Proceedings of the eighteenth international conference on machine learning, ICML. Vol. 1. 2001.

[4] 李航,《统计学习方法》.

[5] 周志华,《机器学习》.

[6] Nikos Karampatziakis, Maximum Entropy Markov Models.

[7] Ramesh Nallapati, Conditional Random Fields.

作者:Treant

出处:http://www.cnblogs.com/en-heng/