2019-9-25 opencv摄像机标定与三维重构1-Camera Calibration摄像机标定/图像畸变校准

官网https://docs.opencv.org/3.4.1/d9/db7/tutorial_py_table_of_contents_calib3d.html

今天的廉价针孔摄像机带来了图像的畸变(distortion )。畸变主要有2种:径向畸变和切向畸变。

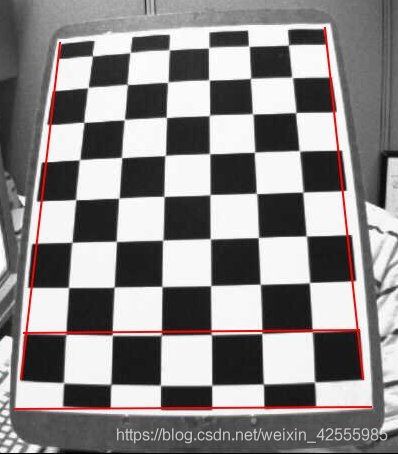

径向畸变会让直线出现弯曲。离图像中心越远,效果越明显。以下图为例,国际象棋棋盘2边用红色线标注出来。可以发现棋盘边界和红线并不重合,说明边界不是直线。我们期望是直线的地方都凸了出来。可以访问Distortion (optics)获得更多信息。

畸变表示如下:

x d i s t o r t e d = x ( 1 + k 1 r 2 + k 2 r 4 + k 3 r 6 ) x_{distorted}=x(1+k_1r^2+k_2r^4+k_3r^6) xdistorted=x(1+k1r2+k2r4+k3r6)

y d i s t o r t e d = y ( 1 + k 1 r 2 + k 2 r 4 + k 3 r 6 ) y_{distorted}=y(1+k_1r^2+k_2r^4+k_3r^6) ydistorted=y(1+k1r2+k2r4+k3r6)

与此类似,切向畸变是因为(摄像机)镜头无法于成像平面绝对平行对齐造成的。所以某些区域看上去要比想象的要近。它的表示如下:

x d i s t o r t e d = x + [ 2 p 1 x y + p 2 ( r 2 + 2 x 2 ) ] x_{distorted}=x+[2p_1xy+p_2(r^2+2x^2)] xdistorted=x+[2p1xy+p2(r2+2x2)]

y d i s t o r t e d = y + [ p 1 ( r 2 + 2 y 2 ) + 2 p 2 x y ] y_{distorted}=y+[p_1(r^2+2y^2)+2p_2xy] ydistorted=y+[p1(r2+2y2)+2p2xy]

简而言之,我们需要5个参数来获得畸变系数distortion coefficients

D i s t o r t i o n c o e f f i c i e n t s = ( k 1 , k 2 , p 1 , p 2 , k 3 ) Distortion \; {coefficients}=(k_1,k_2,p_1,p_2,k_3) Distortioncoefficients=(k1,k2,p1,p2,k3)

此外,我们还需要再找到一些信息,比如摄像机的内部和外部参数。内部参数是摄像机特有的,包含:焦距 ( fx,fy), 光学中心( cx,cy)。这也被称为摄像机矩阵。它完全依赖于摄像机自身,所以一旦计算获得后,就可以保存下来用于将来用途。摄像机矩阵为3x3矩阵,表达如下

c a m e r a m a t r i x = [ f x 0 c x 0 f y c y 0 0 1 ] camera \; matrix=\begin{bmatrix} f_x & 0 & c_x\\0 & f_y & c_y\\0 & 0 & 1\\ \end{bmatrix} cameramatrix=⎣⎡fx000fy0cxcy1⎦⎤

外部参数与旋转向量和变换向量相对应,可以将3D点坐标转换到坐标系中。

对于立体应用,这些畸变必须首先被矫正。为了找到这些参数,我们必须首先提供一些包含良好定义图案模型的图片样本(比如棋盘)。我们可以在其中找到一些特殊点(棋盘的四个角)。这样我们就知道了这些特殊点在真实世界的坐标和在图像中的坐标。利用这些数据,就可以在后台求解一些数学问题,得到畸变系数。为了得到更好的结果,我们至少需要10个测试用图案模型。

opencv中提供了一些测试棋盘图片(left01.jpg – left14.jpg),我们可以使用它们。http://globalempiresoft.com/tools/AR/OpenCV-2.1.0/samples/c/

为了便于理解,我们可以认为只有一张棋盘图片。对于摄像机标定来说,重要的输入数据是3D的真实世界的点以及对应的2D图像中的点。2D图像点我们可以在图像中轻松找到,这些点是棋盘图像中2个黑色块接触的地方(角点)。

那么真实世界的3D点怎么得到?这些图像通过静态摄像机和棋盘不同的摆放位置和朝向来获得。所以我们需要知道 (X,Y,Z)的值。为了简化,我们假设棋盘在xy平面上是静止的,即Z=0,摄像机参照这个规则移动(围绕棋盘移动)。这样我们只需要知道X,Y值就行了,也就是只需要传入代表点的坐标(0,0), (1,0), (2,0)。本例中,我们得到的结果就是棋盘方块的大小。一旦我们知道了方块的大小(比如30mm),我们就能传入值 (0,0),(30,0),(60,0),获得结果的单位就是mm。

3D 点被称为对象点,2D 图像点被称为图像点。

opencv中我们用cv2.findChessboardCorners()函数发现棋盘中的方块。我们还需要传入需要寻找的图形类型,比如8x8格子或者5x5格子。本例中,我们使用7x6格子。通常棋盘有8x8个格子和7x7个内角。函数会返回角点,如果能找到图形,返回值类型是True。这些角会按照从左到右,从上到下排序。

这个函数可能不能在所有图像中都找到所需要的图案。所以一个好的选择是编写代码,启动摄像机并在每一帧中检查是否有应有的图案。一旦找到图案,就把角点保存成列表。同时还要提供时间间隔,这样在读取下一帧之前,我们(有时间)调整棋盘的方向。持续进行这个过程,直到我们得到最够多好的图像。在本例中,我们也并不知道在14张图像中有多少好的图像。所以我们要读取所有图像,获得好的图像。

我们还可以使用圆形格子替代棋盘,这就需要使用 cv.findCirclesGrid()函数寻找图案。据说使用圆形格子只要很少图像就可以了。

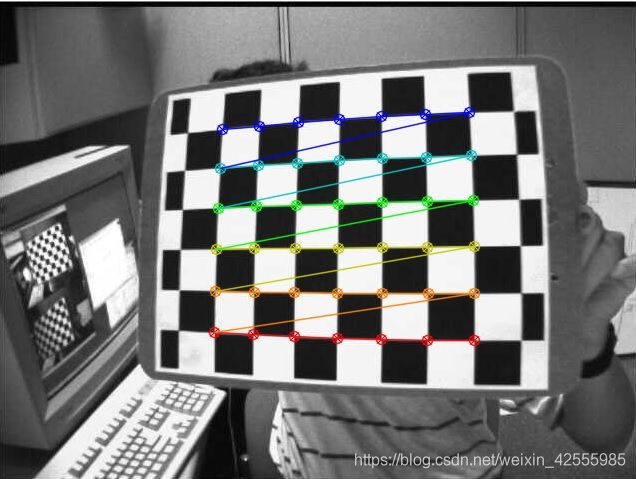

一旦我们找到角点后,就可以使用cv.cornerSubPix()增加准确性。我们使用cv.drawChessboardCorners()函数绘制图像。

1.绘制图案

代码如下

import cv2

import numpy as np

import glob

from matplotlib import pyplot as plt

# termination criteria

criteria = (cv2.TERM_CRITERIA_EPS + cv2.TERM_CRITERIA_MAX_ITER, 30, 0.001)

# prepare object points, like (0,0,0), (1,0,0), (2,0,0) ....,(6,5,0)

objp = np.zeros((6*7,3), np.float32)

objp[:,:2] = np.mgrid[0:7,0:6].T.reshape(-1,2)

# Arrays to store object points and image points from all the images.

objpoints = [] # 3d point in real world space

imgpoints = [] # 2d points in image plane.

images = glob.glob('*.jpg')

for fname in images:

img = cv2.imread(fname)

gray = cv2.cvtColor(img, cv2.COLOR_BGR2GRAY)

# Find the chess board corners

ret, corners = cv2.findChessboardCorners(gray, (7,6), None)

# If found, add object points, image points (after refining them)

if ret == True:

objpoints.append(objp)

corners2 = cv2.cornerSubPix(gray,corners, (11,11), (-1,-1), criteria)

imgpoints.append(corners)

# Draw and display the corners

cv2.drawChessboardCorners(img, (7,6), corners2, ret)

cv2.imshow('img', img)

cv2.waitKey(500)

cv2.destroyAllWindows()

只截了2个图,其他可以自己尝试。

2.标定/校准(Calibration)

现在对象点和图像点都得到了,就可以进行标定/校准了。

opencv中使用cv.calibrateCamera()函数实现。它返回摄像机矩阵,畸变系数,旋转和变换向量等。

ret, mtx, dist, rvecs, tvecs = cv2.calibrateCamera(objpoints, imgpoints, gray.shape[::-1], None, None)

3.畸变校正(Undistortion)

我们已经得到了我们想要的东西,现在可以找一副图像进行畸变校正了。opencv提供了2种方法,我们都来看一下。在此之前,我们使用cv.getOptimalNewCameraMatrix()函数对摄像机矩阵基于自由缩放系数进行优化。如果缩放系数alpha=0,它返回的未畸变图像带有最小的不想要的像素。所以它甚至可以在图像角点的去除一些像素。如果缩放系数alpha=1,图像的所有像素都保留,此外还有一些额外的黑色。它还会返回一个ROI图像,这个图像可以被用于裁剪结果。

这里我们使用图片test11.jpg

img = cv2.imread('left11.jpg')

h, w = img.shape[:2]

newcameramtx, roi = cv2.getOptimalNewCameraMatrix(mtx, dist, (w,h), 1, (w,h))

方法1,使用cv.undistort()

这是最简单的方法。只需使用这个函数和上边得到的ROI 对结果进行裁剪。

# undistort

dst = cv2.undistort(img, mtx, dist, None, newcameramtx)

# crop the image

x, y, w, h = roi

dst = dst[y:y+h, x:x+w]

cv2.imwrite('calibresult.png', dst)

方法2,使用remapping

这个方法比较绕了。首先要找到从畸变图像到非畸变图像的映射函数。再使用重映射函数。

# undistort

mapx, mapy = cv2.initUndistortRectifyMap(mtx, dist, None, newcameramtx, (w,h), 5)

dst = cv2.remap(img, mapx, mapy, cv.INTER_LINEAR)

# crop the image

x, y, w, h = roi

dst = dst[y:y+h, x:x+w]

cv2.imwrite('calibresult.png', dst)

使用方法1,运行后可以得到以下校正后的图像。

原图像是test11.jpg

可以发现,结果图像中所有的边界都变直了。

现在你就可以使用Numpy提供的函数(np.savez,np.savetxt 等)将摄像机矩阵和畸变系数保存以便将来使用。

4.反投影误差(Re-projection)

反投影误差可以很好的对于找到参数的准确性进行估计。结果越接近0越好。有了内部参数,畸变参数和旋转变换矩阵,我们就可以使用cv.projectPoints()函数将对象点转换到图像点。然后我们计算变换得到图像与角点检测算法的绝对差。为了找到平均误差,我们计算所有标定图像误差的算数平均值。

代码如下

mean_error = 0

for i in xrange(len(objpoints)):

imgpoints2, _ = cv2.projectPoints(objpoints[i], rvecs[i], tvecs[i], mtx, dist)

error = cv2.norm(imgpoints[i], imgpoints2, cv2.NORM_L2)/len(imgpoints2)

mean_error += error

print( "total error: {}".format(mean_error/len(objpoints)) )

最终结果,total error: 0.0236860003754,非常接近0 。