- DAY 43 复习日

yizhimie37

python训练营打卡笔记深度学习

@浙大疏锦行https://blog.csdn.net/weixin_45655710第一步:寻找并准备图像数据集在Kaggle等平台上,你可以找到大量用于图像分类任务的数据集,例如英特尔图像分类数据集(IntelImageClassification)或手写数字识别数据集(DigitRecognizer)。对于初学者,一个更便捷的选择是使用像TensorFlow或PyTorch这样深度学习框架内

- PettingZoo:多智能体强化学习的标准API

资源存储库

多智能体强化学习人工智能深度学习

PettingZoo:AStandardAPIforMulti-AgentReinforcementLearningPettingZoo:多智能体强化学习的标准API目录Abstract摘要1Introduction1介绍2BackgroundandRelatedWorks2背景及相关工作2.1PartiallyObservableStochasticGamesandRLlib2.1部分可观察随机

- 神经网络架构搜索

IJCAST主编

进化计算神经网络架构人工智能

InternationalJournalofComplexityinAppliedScienceandTechnology,投稿网址:https://www.inderscience.com/jhome.php?jcode=ijcast,发表论文不收取任何费用,论文平均审稿25天内即可录用。1.神经网络架构搜索方法分类当前,神经网络架构搜索的方法主要可以归纳为以下三类:a.基于强化学习的NAS方法

- 用Tensorflow进行线性回归和逻辑回归(十)

lishaoan77

tensorflow线性回归tensorboard可视化

用TensorBoard可视化线性回归模型TensorBoard是一种可视化工具,用于了解、调试和优化模型训练过程。它使用在执行程序时编写的摘要事件。上面定义的模型使用tf.summary.FileWriter来写日志到日志目录/tmp/lr-train.我们可以用命令调用日志目录的TensorBoard,见Example3-13(TensorBoard已黙认安装与TensorFlow一起).Ex

- 强化学习 16G实践以下是基于CQL(Conservative Q-Learning)与QLoRA(Quantized Low-Rank Adaptation)结合的方案相关开源项目及资源,【ai技】

行云流水AI笔记

开源人工智能

根据你提供的CUDA版本(11.5)和NVIDIA驱动错误信息,以下是PyTorch、TensorFlow的兼容版本建议及环境修复方案:1.版本兼容性表框架兼容CUDA版本推荐安装命令(CUDA11.5)PyTorch11.3/11.6pipinstalltorchtorchvisiontorchaudio--extra-index-urlhttps://download.pytorch.org/

- 大模型RLHF强化学习笔记(一):强化学习基础梳理Part1

Gravity!

大模型笔记大模型LLM算法机器学习强化学习人工智能

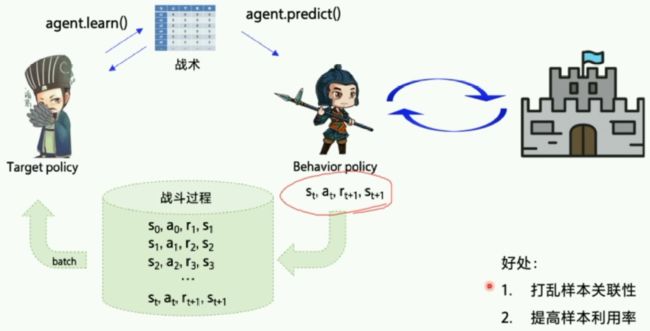

【如果笔记对你有帮助,欢迎关注&点赞&收藏,收到正反馈会加快更新!谢谢支持!】一、强化学习基础1.1Intro定义:强化学习是一种机器学习方法,需要智能体通过与环境交互学习最优策略基本要素:状态(State):智能体在决策过程中需要考虑的所有相关信息(环境描述)动作(Action):在环境中可以采取的行为策略(Policy):定义了在给定状态下智能体应该选择哪个动作,目标是最大化智能体的长期累积奖

- TensorFlow Serving学习笔记3: 组件调用关系

一、整体架构TensorFlowServing采用模块化设计,核心组件包括:Servables:可服务对象(如模型、查找表)Managers:管理Servable生命周期(加载/卸载)Loaders:负责Servable的初始化状态管理Sources:提供新版本Servable的LoaderAspiredVersions:Servable的期望状态集合Core:连接所有组件的核心枢纽APIs:gR

- LLMs基础学习(八)强化学习专题(7)

汤姆和佩琦

NLP学习Actor-Critic算法

LLMs基础学习(八)强化学习专题(7)文章目录LLMs基础学习(八)强化学习专题(7)Actor-Critic算法基础原理算法流程细节算法优缺点分析算法核心总结视频链接:https://www.bilibili.com/video/BV1MQo4YGEmq/?spm_id_from=333.1387.upload.video_card.click&vd_source=57e4865932ea6c

- 强化学习-双臂老虎机

transuperb

强化学习人工智能

本篇文章模拟AI玩两个老虎机,AI需要判断出哪个老虎机收益更大,然后根据反馈调整对于不同老虎机的价值判断,如果把这个看作一个简单的强化学习的话,那么AI就是agent,两个老虎机就是environment,AI首先会对两台老虎机有一个预测值Q,预测哪一个的价值高,然后AI通过策略函数判断应该选择哪个老虎机,进行Action后根据Reward更新每个老虎机的价值Value,然后再进行下一次判断,直到

- ROS2 强化学习:案例与代码实战

芯动大师

ROS2学习目标检测人工智能

一、引言在机器人技术不断发展的今天,强化学习(RL)作为一种强大的机器学习范式,为机器人的智能决策和自主控制提供了新的途径。ROS2(RobotOperatingSystem2)作为新一代机器人操作系统,具有更好的实时性、分布式性能和安全性,为强化学习在机器人领域的应用提供了更坚实的基础。本文将通过一个具体案例,深入探讨ROS2与强化学习的结合应用,并提供相关代码实现。二、案例背景本案例以移动机器

- 解析AI算力网络与通信领域强化学习的算法

AI算力网络与通信

AI人工智能与大数据技术AI算力网络与通信原理AI人工智能大数据架构人工智能网络算法ai

解析AI算力网络与通信领域强化学习的算法:从"快递员找路"到"智能网络大脑"关键词:AI算力网络、通信领域、强化学习、马尔可夫决策、资源调度摘要:本文将用"快递物流系统"的类比,带您理解AI算力网络与通信领域如何通过强化学习实现智能决策。我们会从核心概念讲起,逐步拆解强化学习在网络资源调度中的算法原理,结合Python代码实战,最后探索其在5G/6G、边缘计算等场景的应用。即使您没学过复杂数学,也

- 【高频考点精讲】前端AI集成实战:从TensorFlow.js到模型部署

全栈老李技术面试

前端高频考点精讲前端javascripthtmlcss面试题reactvue

前端AI集成实战:从TensorFlow.js到模型部署作者:全栈老李更新时间:2025年5月适合人群:前端初学者、进阶开发者版权:本文由全栈老李原创,转载请注明出处。今天咱们聊聊前端工程师如何玩转AI——没错,用JavaScript就能搞机器学习!我是全栈老李,一个喜欢把复杂技术讲简单的实战派。最近发现不少前端同学对AI既好奇又害怕,其实真没想象中那么难,跟着老李走,30分钟让你亲手部署第一

- AI 在自动驾驶路径规划中的深度强化学习优化

QuantumWalker

人工智能自动驾驶机器学习

```htmlAI在自动驾驶路径规划中的深度强化学习优化在当今快速发展的科技领域中,人工智能(AI)的应用正在不断拓展其边界。特别是在自动驾驶技术中,AI的应用已经从简单的感知和识别发展到了复杂的决策和控制阶段。其中,深度强化学习作为AI的一个重要分支,在自动驾驶路径规划中发挥着越来越重要的作用。一、深度强化学习简介深度强化学习是一种结合了深度学习和强化学习的机器学习方法。它通过让智能体在环境中进

- 聚焦OpenVINO与OpenCV颜色通道转换的实践指南

颜色通道顺序问题:OpenVINO模型RGB输入与OpenCVBGR格式的转换在计算机视觉任务中,框架间的颜色通道差异常导致模型推理错误。以下方法解决OpenVINO模型需要RGB输入而OpenCV默认输出BGR的问题。理解核心差异OpenCV的imread()函数遵循BGR通道顺序,源于历史摄像头硬件的数据格式。而OpenVINO等深度学习框架多采用RGB顺序,与TensorFlow/PyTor

- python打卡训练营Day41

珂宝_

python打卡训练营python

importnumpyasnpfromtensorflowimportkerasfromtensorflow.kerasimportlayers#加载和预处理数据(x_train,y_train),(x_test,y_test)=keras.datasets.mnist.load_data()x_train=x_train.reshape(-1,28,28,1).astype("float32")

- TensorFlow深度学习模型训练:掌握神经网络的构建与优化

瞎了眼的枸杞

深度学习tensorflow神经网络

引言深度学习是人工智能领域的重要分支,它通过模拟人脑的神经网络结构来解决复杂的数据表示和学习问题。TensorFlow作为目前最受欢迎的深度学习框架之一,为开发者提供了强大的工具和丰富的资源。本文将带你了解如何使用TensorFlow进行深度学习模型的训练和优化。TensorFlow的核心概念什么是TensorFlow?定义:TensorFlow是一个用于数值计算的开源库,特别适合于大规模的机器学

- 强化学习实战:从 Q-Learning 到 PPO 全流程

荣华富贵8

程序员的知识储备2程序员的知识储备3人工智能算法机器学习

1引言随着人工智能的快速发展,强化学习(ReinforcementLearning,RL)凭借其在复杂决策与控制问题上的卓越表现,已成为研究与应用的前沿热点。本文旨在从经典的Q-Learning算法入手,系统梳理从值迭代到策略优化的全流程技术细节,直至最具代表性的ProximalPolicyOptimization(PPO)算法,结合理论推导、代码实现与案例分析,深入探讨强化学习的核心原理、算法演

- 基于CTDE MAPPO的无线通信资源分配强化学习实现

pk_xz123456

仿真模型深度学习算法lstm人工智能rnn深度学习开发语言

基于CTDEMAPPO的无线通信资源分配强化学习实现摘要本文提出了一种基于集中训练分散执行(CTDE)框架的多智能体近端策略优化(MAPPO)方法,用于解决无线通信网络中的资源分配问题。我们设计了一个多基站协作环境,其中每个基站作为独立智能体,通过分布式决策实现网络吞吐量最大化。实验结果表明,MAPPO算法在频谱效率和用户公平性方面显著优于传统启发式算法。1.引言1.1研究背景随着5G/6G通信技

- Tensorflow实现经典CNN网络AlexNet

您懂我意思吧

python开发tensorflowcnn人工智能python

1、概念AlexNet在ILSVRC-2012的比赛中获得top5错误率15.3%的突破(第二名为26.2%),其原理来源于2012年Alex的论文《ImageNetClassificationwithDeepConvolutionalNeuralNetworks》,这篇论文是深度学习火爆发展的一个里程碑和分水岭,加上硬件技术的发展,深度学习还会继续火下去。2、AlexNet网络结构由于受限于当时

- 强化学习系列——PPO算法

lqjun0827

算法深度学习算法人工智能

强化学习系列——PPO算法PPO算法一、背景知识:策略梯度&Advantage二、引入重要性采样(ImportanceSampling)三、PPO-Clip目标函数推导✅四、总结公式(一图总览)参考文献PPO示例代码实现补充内容:重要性采样一、问题背景:我们想估计某个期望❗问题:二、引入重要性采样(ImportanceSampling)三、离散采样形式(蒙特卡洛估计)四、标准化的重要性采样五、在强

- TensorFlow Lite (TFLite) 和 PyTorch Mobile介绍2

追心嵌入式

tensorflowpytorch人工智能

以下是TensorFlowLite(TFLite)和PyTorchMobile两大轻量化框架的核心用途、典型应用场景及在嵌入式开发中的实际价值对比,结合你的OrangePiZero3开发板特性进行说明:TensorFlowLite(TFLite)核心用途嵌入式设备推理:将训练好的TensorFlow模型转换为轻量格式,在资源受限设备(如手机、边缘计算盒子、OrangePi)上高效运行。硬件加速:通

- 人工神经网络:架构原理与技术解析

weixin_47233946

架构

##引言在深度学习和人工智能领域,人工神经网络(ArtificialNeuralNetwork,ANN)作为模拟人脑认知机制的核心技术,已在图像识别、自然语言处理和强化学习等领域实现了革命性突破。从AlphaGo击败人类顶尖棋手到ChatGPT的对话生成能力,ANN的进化持续推动技术边界的扩展。本文将深入剖析人工神经网络的核心原理、技术实现与发展趋势。##一、基础概念与数学模型###1.1生物启发

- Spring中如何使用AI

Mn孟

spring人工智能java后端

Spring是一个用于构建Java应用程序的开源框架,它可以与各种AI技术集成。要在Spring中使用AI,首先需要选择一种AI技术,如机器学习、自然语言处理等。然后可以使用SpringBoot来构建应用程序,并使用相应的AI框架或库来实现AI功能。例如,可以使用TensorFlow或PyTorch来实现机器学习功能,使用NLTK或spaCy来实现自然语言处理功能。此外,还可以使用SpringCl

- 医疗AI新势力:自演进多智能体MAS的进击之路

Allen_Lyb

医疗高效编程研发人工智能健康医疗机器学习架构大数据

医疗AI新势力:自演进多智能体MAS的进击之路往期相关文章:Python在开放式医疗诊断多智能体系统中的深度应用与自动化分析基于多智能体强化学习的医疗AI中RAG系统程序架构优化研究自演进多智能体在医疗临床诊疗动态场景中的应用医疗AI的新变革在数字化与智能化飞速发展的时代,人工智能(AI)已经逐渐渗透到医疗领域的各个角落,成为推动医疗行业变革的重要力量。从疾病的早期诊断到个性化治疗方案的制定,从医

- 无线通信中的多智能体强化学习:基于CTDE-MAPPO的功率控制优化

pk_xz123456

仿真模型深度学习算法算法人工智能制造

无线通信中的多智能体强化学习:基于CTDE-MAPPO的功率控制优化摘要本文提出了一种基于集中训练分布式执行(CTDE)框架的多智能体近端策略优化(MAPPO)算法,用于解决无线通信网络中的分布式功率控制问题。通过将多个基站建模为协作智能体,我们设计了一个多智能体强化学习系统,能够在复杂动态环境中实现全局网络效用的优化。本文详细介绍了系统架构、算法实现、实验设置以及性能评估,展示了MAPPO在5G

- 传统蒙特卡洛(Monte Carlo, MC)方法在强化学习中直接把整条回报序列当作“真值”来估计价值函数,通常配合表格化存储,因此无需环境模型且估计无偏,但只能处理有限状态-动作空间且方差较大

强化学习曾小健

人工智能

传统蒙特卡洛(MonteCarlo,MC)方法在强化学习中直接把整条回报序列当作“真值”来估计价值函数,通常配合表格化存储,因此无需环境模型且估计无偏,但只能处理有限状态-动作空间且方差较大medium.comanalyticsvidhya.comincompleteideas.net。“深度蒙特卡洛”(DeepMonteCarlo,DMC)则保留“按回报直接更新”的思想,却用深度网络来逼近$Q(

- 使用Simulink结合MATLAB进行基于强化学习控制下的动态滤波器参数调节系统的仿真

amy_mhd

matlab开发语言

目录一、背景介绍二、所需工具和环境三、步骤详解步骤1:定义系统需求示例:定义系统需求步骤2:准备强化学习环境步骤3:训练强化学习代理步骤4:创建Simulink模型步骤5:添加信号源步骤6:合并信号步骤7:导入强化学习代理步骤8:设计滤波器步骤9:可视化结果步骤10:连接各模块步骤11:设置仿真参数步骤12:运行仿真并分析结果四、总结在现代信号处理领域,动态调整滤波器参数以适应不断变化的环境条件是

- C++(个人学习总结,不断更新......)

一、初识C++1.1C++简介C++是由BjarneStroustrup研发的,在计算机编程语言中,C++兼容了c语言,又增加了面向对象的机制,同时拥有丰富的库,有标准模板库STL以及很多第三方库,STL中有set、map、hash等容器,第三方库中有Boost库、图形库QT、图库像处理库Opencv、机械学习库Tensorflow等,这些库可以为嵌入式开发提供非常大的支持。1.2C++程序编写#

- 强化学习(Reinforcement Learning, RL)概览

MzKyle

人工智能人工智能强化学习机器学习机器人

一、强化学习的核心概念与定位1.定义强化学习是机器学习的分支,研究智能体(Agent)在动态环境中通过与环境交互,以最大化累积奖励为目标的学习机制。与监督学习(有标注数据)和无监督学习(无目标)不同,强化学习通过“试错”学习,不依赖先验知识,适合解决动态决策问题。2.核心要素智能体(Agent):执行决策的主体,如游戏AI、机器人。环境(Environment):智能体之外的一切,如棋盘、物理世界

- 无监督学习概览

MzKyle

人工智能人工智能无监督学习机器学习

一、无监督学习的本质与定位定义:无监督学习是机器学习的三大范式之一(另外两种为监督学习和强化学习),其核心特点是处理未标注数据,通过算法自动发现数据中的隐藏结构、模式或内在规律。与监督学习依赖"输入-输出"对不同,无监督学习仅以原始数据作为输入,目标是揭示数据的内在组织方式。与其他学习范式的区别:监督学习:依赖标签(如分类、回归任务),学习从输入到输出的映射关系强化学习:通过与环境交互获得奖励信号

- 如何用ruby来写hadoop的mapreduce并生成jar包

wudixiaotie

mapreduce

ruby来写hadoop的mapreduce,我用的方法是rubydoop。怎么配置环境呢:

1.安装rvm:

不说了 网上有

2.安装ruby:

由于我以前是做ruby的,所以习惯性的先安装了ruby,起码调试起来比jruby快多了。

3.安装jruby:

rvm install jruby然后等待安

- java编程思想 -- 访问控制权限

百合不是茶

java访问控制权限单例模式

访问权限是java中一个比较中要的知识点,它规定者什么方法可以访问,什么不可以访问

一:包访问权限;

自定义包:

package com.wj.control;

//包

public class Demo {

//定义一个无参的方法

public void DemoPackage(){

System.out.println("调用

- [生物与医学]请审慎食用小龙虾

comsci

生物

现在的餐馆里面出售的小龙虾,有一些是在野外捕捉的,这些小龙虾身体里面可能带有某些病毒和细菌,人食用以后可能会导致一些疾病,严重的甚至会死亡.....

所以,参加聚餐的时候,最好不要点小龙虾...就吃养殖的猪肉,牛肉,羊肉和鱼,等动物蛋白质

- org.apache.jasper.JasperException: Unable to compile class for JSP:

商人shang

maven2.2jdk1.8

环境: jdk1.8 maven tomcat7-maven-plugin 2.0

原因: tomcat7-maven-plugin 2.0 不知吃 jdk 1.8,换成 tomcat7-maven-plugin 2.2就行,即

<plugin>

- 你的垃圾你处理掉了吗?GC

oloz

GC

前序:本人菜鸟,此文研究学习来自网络,各位牛牛多指教

1.垃圾收集算法的核心思想

Java语言建立了垃圾收集机制,用以跟踪正在使用的对象和发现并回收不再使用(引用)的对象。该机制可以有效防范动态内存分配中可能发生的两个危险:因内存垃圾过多而引发的内存耗尽,以及不恰当的内存释放所造成的内存非法引用。

垃圾收集算法的核心思想是:对虚拟机可用内存空间,即堆空间中的对象进行识别

- shiro 和 SESSSION

杨白白

shiro

shiro 在web项目里默认使用的是web容器提供的session,也就是说shiro使用的session是web容器产生的,并不是自己产生的,在用于非web环境时可用其他来源代替。在web工程启动的时候它就和容器绑定在了一起,这是通过web.xml里面的shiroFilter实现的。通过session.getSession()方法会在浏览器cokkice产生JESSIONID,当关闭浏览器,此

- 移动互联网终端 淘宝客如何实现盈利

小桔子

移動客戶端淘客淘寶App

2012年淘宝联盟平台为站长和淘宝客带来的分成收入突破30亿元,同比增长100%。而来自移动端的分成达1亿元,其中美丽说、蘑菇街、果库、口袋购物等App运营商分成近5000万元。 可以看出,虽然目前阶段PC端对于淘客而言仍旧是盈利的大头,但移动端已经呈现出爆发之势。而且这个势头将随着智能终端(手机,平板)的加速普及而更加迅猛

- wordpress小工具制作

aichenglong

wordpress小工具

wordpress 使用侧边栏的小工具,很方便调整页面结构

小工具的制作过程

1 在自己的主题文件中新建一个文件夹(如widget),在文件夹中创建一个php(AWP_posts-category.php)

小工具是一个类,想侧边栏一样,还得使用代码注册,他才可以再后台使用,基本的代码一层不变

<?php

class AWP_Post_Category extends WP_Wi

- JS微信分享

AILIKES

js

// 所有功能必须包含在 WeixinApi.ready 中进行

WeixinApi.ready(function(Api) {

// 微信分享的数据

var wxData = {

&nb

- 封装探讨

百合不是茶

JAVA面向对象 封装

//封装 属性 方法 将某些东西包装在一起,通过创建对象或使用静态的方法来调用,称为封装;封装其实就是有选择性地公开或隐藏某些信息,它解决了数据的安全性问题,增加代码的可读性和可维护性

在 Aname类中申明三个属性,将其封装在一个类中:通过对象来调用

例如 1:

//属性 将其设为私有

姓名 name 可以公开

- jquery radio/checkbox change事件不能触发的问题

bijian1013

JavaScriptjquery

我想让radio来控制当前我选择的是机动车还是特种车,如下所示:

<html>

<head>

<script src="http://ajax.googleapis.com/ajax/libs/jquery/1.7.1/jquery.min.js" type="text/javascript"><

- AngularJS中安全性措施

bijian1013

JavaScriptAngularJS安全性XSRFJSON漏洞

在使用web应用中,安全性是应该首要考虑的一个问题。AngularJS提供了一些辅助机制,用来防护来自两个常见攻击方向的网络攻击。

一.JSON漏洞

当使用一个GET请求获取JSON数组信息的时候(尤其是当这一信息非常敏感,

- [Maven学习笔记九]Maven发布web项目

bit1129

maven

基于Maven的web项目的标准项目结构

user-project

user-core

user-service

user-web

src

- 【Hive七】Hive用户自定义聚合函数(UDAF)

bit1129

hive

用户自定义聚合函数,用户提供的多个入参通过聚合计算(求和、求最大值、求最小值)得到一个聚合计算结果的函数。

问题:UDF也可以提供输入多个参数然后输出一个结果的运算,比如加法运算add(3,5),add这个UDF需要实现UDF的evaluate方法,那么UDF和UDAF的实质分别究竟是什么?

Double evaluate(Double a, Double b)

- 通过 nginx-lua 给 Nginx 增加 OAuth 支持

ronin47

前言:我们使用Nginx的Lua中间件建立了OAuth2认证和授权层。如果你也有此打算,阅读下面的文档,实现自动化并获得收益。SeatGeek 在过去几年中取得了发展,我们已经积累了不少针对各种任务的不同管理接口。我们通常为新的展示需求创建新模块,比如我们自己的博客、图表等。我们还定期开发内部工具来处理诸如部署、可视化操作及事件处理等事务。在处理这些事务中,我们使用了几个不同的接口来认证:

&n

- 利用tomcat-redis-session-manager做session同步时自定义类对象属性保存不上的解决方法

bsr1983

session

在利用tomcat-redis-session-manager做session同步时,遇到了在session保存一个自定义对象时,修改该对象中的某个属性,session未进行序列化,属性没有被存储到redis中。 在 tomcat-redis-session-manager的github上有如下说明: Session Change Tracking

As noted in the &qu

- 《代码大全》表驱动法-Table Driven Approach-1

bylijinnan

java算法

关于Table Driven Approach的一篇非常好的文章:

http://www.codeproject.com/Articles/42732/Table-driven-Approach

package com.ljn.base;

import java.util.Random;

public class TableDriven {

public

- Sybase封锁原理

chicony

Sybase

昨天在操作Sybase IQ12.7时意外操作造成了数据库表锁定,不能删除被锁定表数据也不能往其中写入数据。由于着急往该表抽入数据,因此立马着手解决该表的解锁问题。 无奈此前没有接触过Sybase IQ12.7这套数据库产品,加之当时已属于下班时间无法求助于支持人员支持,因此只有借助搜索引擎强大的

- java异常处理机制

CrazyMizzz

java

java异常关键字有以下几个,分别为 try catch final throw throws

他们的定义分别为

try: Opening exception-handling statement.

catch: Captures the exception.

finally: Runs its code before terminating

- hive 数据插入DML语法汇总

daizj

hiveDML数据插入

Hive的数据插入DML语法汇总1、Loading files into tables语法:1) LOAD DATA [LOCAL] INPATH 'filepath' [OVERWRITE] INTO TABLE tablename [PARTITION (partcol1=val1, partcol2=val2 ...)]解释:1)、上面命令执行环境为hive客户端环境下: hive>l

- 工厂设计模式

dcj3sjt126com

设计模式

使用设计模式是促进最佳实践和良好设计的好办法。设计模式可以提供针对常见的编程问题的灵活的解决方案。 工厂模式

工厂模式(Factory)允许你在代码执行时实例化对象。它之所以被称为工厂模式是因为它负责“生产”对象。工厂方法的参数是你要生成的对象对应的类名称。

Example #1 调用工厂方法(带参数)

<?phpclass Example{

- mysql字符串查找函数

dcj3sjt126com

mysql

FIND_IN_SET(str,strlist)

假如字符串str 在由N 子链组成的字符串列表strlist 中,则返回值的范围在1到 N 之间。一个字符串列表就是一个由一些被‘,’符号分开的自链组成的字符串。如果第一个参数是一个常数字符串,而第二个是type SET列,则 FIND_IN_SET() 函数被优化,使用比特计算。如果str不在strlist 或st

- jvm内存管理

easterfly

jvm

一、JVM堆内存的划分

分为年轻代和年老代。年轻代又分为三部分:一个eden,两个survivor。

工作过程是这样的:e区空间满了后,执行minor gc,存活下来的对象放入s0, 对s0仍会进行minor gc,存活下来的的对象放入s1中,对s1同样执行minor gc,依旧存活的对象就放入年老代中;

年老代满了之后会执行major gc,这个是stop the word模式,执行

- CentOS-6.3安装配置JDK-8

gengzg

centos

JAVA_HOME=/usr/java/jdk1.8.0_45

JRE_HOME=/usr/java/jdk1.8.0_45/jre

PATH=$PATH:$JAVA_HOME/bin:$JRE_HOME/bin

CLASSPATH=.:$JAVA_HOME/lib/dt.jar:$JAVA_HOME/lib/tools.jar:$JRE_HOME/lib

export JAVA_HOME

- 【转】关于web路径的获取方法

huangyc1210

Web路径

假定你的web application 名称为news,你在浏览器中输入请求路径: http://localhost:8080/news/main/list.jsp 则执行下面向行代码后打印出如下结果: 1、 System.out.println(request.getContextPath()); //可返回站点的根路径。也就是项

- php里获取第一个中文首字母并排序

远去的渡口

数据结构PHP

很久没来更新博客了,还是觉得工作需要多总结的好。今天来更新一个自己认为比较有成就的问题吧。 最近在做储值结算,需求里结算首页需要按门店的首字母A-Z排序。我的数据结构原本是这样的:

Array

(

[0] => Array

(

[sid] => 2885842

[recetcstoredpay] =&g

- java内部类

hm4123660

java内部类匿名内部类成员内部类方法内部类

在Java中,可以将一个类定义在另一个类里面或者一个方法里面,这样的类称为内部类。内部类仍然是一个独立的类,在编译之后内部类会被编译成独立的.class文件,但是前面冠以外部类的类名和$符号。内部类可以间接解决多继承问题,可以使用内部类继承一个类,外部类继承一个类,实现多继承。

&nb

- Caused by: java.lang.IncompatibleClassChangeError: class org.hibernate.cfg.Exten

zhb8015

maven pom.xml关于hibernate的配置和异常信息如下,查了好多资料,问题还是没有解决。只知道是包冲突,就是不知道是哪个包....遇到这个问题的分享下是怎么解决的。。

maven pom:

<dependency>

<groupId>org.hibernate</groupId>

<ar

- Spark 性能相关参数配置详解-任务调度篇

Stark_Summer

sparkcachecpu任务调度yarn

随着Spark的逐渐成熟完善, 越来越多的可配置参数被添加到Spark中来, 本文试图通过阐述这其中部分参数的工作原理和配置思路, 和大家一起探讨一下如何根据实际场合对Spark进行配置优化。

由于篇幅较长,所以在这里分篇组织,如果要看最新完整的网页版内容,可以戳这里:http://spark-config.readthedocs.org/,主要是便

- css3滤镜

wangkeheng

htmlcss

经常看到一些网站的底部有一些灰色的图标,鼠标移入的时候会变亮,开始以为是js操作src或者bg呢,搜索了一下,发现了一个更好的方法:通过css3的滤镜方法。

html代码:

<a href='' class='icon'><img src='utv.jpg' /></a>

css代码:

.icon{-webkit-filter: graysc