如何处理yolov5模型在推理阶段出现 assert(engine->getNbBindings() == 2

背景:

大部分人用yolov5模型训练后,都是参考

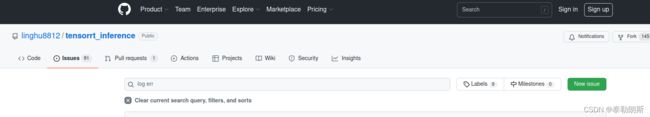

这个项目来进行C++部署推理的。

这个项目来进行C++部署推理的。

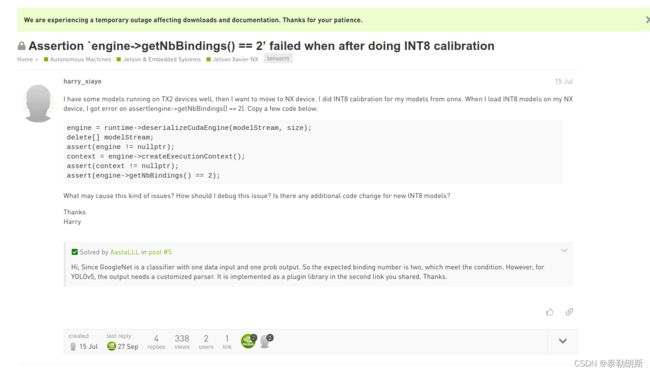

按照正常流程,大家在官方yolov5训练结束后,在官方export.py导出onnx,然后将onnx->转换为trt,部署上来后,估计出现的就是上面的问题。

作者核心意思就是:对于pt模型转onnx后处理不一样,导致getNbBinds不一样。

说说我的解决方案:

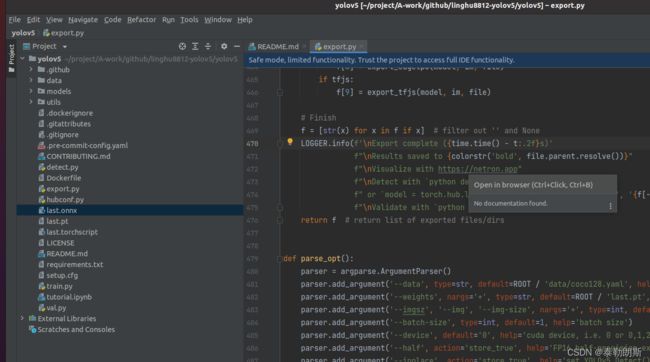

我在官方yolov5下训练一个模型后,生成了一个last.pt,然后我把这个last.pt拷贝到入口2作者的yolov5里面,如下图

然后执行linghu8812/yolov里面的export.py,然后生成了一个last.onnx文件。

就是说训练好的模型用作者linghu8812/yolov提供的export去转,不要用yolov5官方的。

用作者自己的不要用yolov5官方的。

然后用这个onnx->trt工具:

链接: https://pan.baidu.com/s/1aTmlPL1sdPFTqD98qfaLrA 提取码: mg0s

将last.onnx转换为trt,然后就可以在作者的检测代码上跑了。

如果你是用下图的转换器

如果你是用下图的转换器

那么记住它是跟yolov5版本对应的,yolov5是V5.0的,那么这个也要是V5.0的,

那么记住它是跟yolov5版本对应的,yolov5是V5.0的,那么这个也要是V5.0的,

git clone -b yolov5-v5.0 https://github.com/wang-xinyu/tensorrtx.git

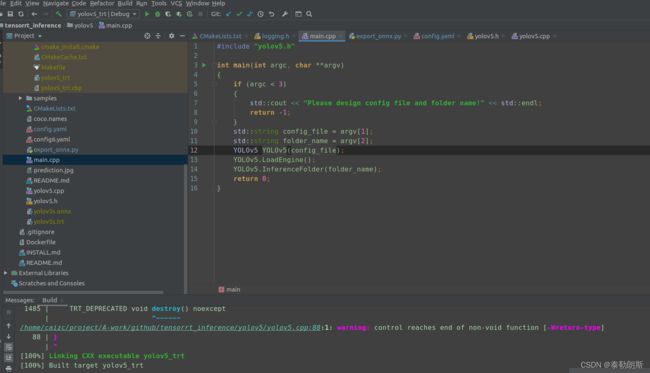

总之流程是这样:

pt转为onnx,onnx转为trt。

./yolov5_trt ../config.yaml ../samples

检测结果如上。