第1113期AI100_机器学习日报(2017-10-05)

AI100_机器学习日报 2017-10-05

- 爱奇艺视频场景下的自然语言处理应用

- 基于Xgboost + LR + Keras 建模评估用户信用状态

- 人工神经网络和生物神经网络详细对比

- 机器学习对话管理引擎

- DeepMind WaveNet语音合成技术正式产品化

@好东西传送门 出品,由@AI100运营, 过往目录 见http://geek.ai100.com.cn

订阅:关注微信公众号 AI100(ID:rgznai100,扫二维码),回复“机器学习日报”,加你进日报群

![]()

本期话题有:

全部23 深度学习14 算法10 自然语言处理5 语音4 资源4 经验总结4 视觉3 公告板2 会议活动2

用日报搜索找到以前分享的内容: http://ml.memect.com/search/

今日焦点 (5)

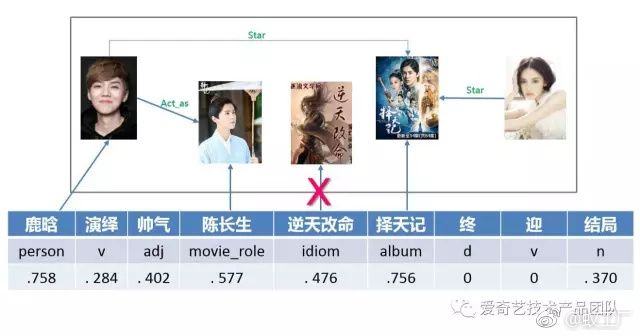

经验总结 自然语言处理 博客

#技术博客推荐# 爱奇艺视频场景下的自然语言处理应用。自然语言处理(Natural Language Processing,简称 NLP)是人工智能的一个重要分支,它研究能实现人与机器之间用自然语言进行有效通信的各种理论和方法,即让机器“懂”人类的语言。 在爱奇艺的视频场景下,自然语言处理的使命即是让机器更好地理…全文: http://m.weibo.cn/2194035935/4159435578091963

wx: 网页版 2017-10-06 06:42

深度学习 视觉 算法 语音 回归 决策树 神经网络 数据质量 特征工程 统计

「基于Xgboost + LR + Keras 建模评估用户信用状态」项目背景 拍拍贷“魔镜风控系统”基于400多个数据维度来对当前用户的信用状态进行评估,通过历史数据每个借款人的性别、年龄、籍贯、学历信息、通讯方式、网站登录信息、第三方时间信息等用户信息以及对应的分类标签,在此基础上结合新发标的用户信息,得到用户六个月内逾期率的预测,为金融平台提供关键的决策支持。数据格式 数据下载–点这里 这里面包含三期数据,每期数据内容和格式相同,这里面包括两部分信息: 一部分是Master PPD_dat_1.csv PPD_dat_2.csv PPD_dat_3.csv 一部分是Log info PPD_daht_1_LogInfo.csv PPD_daht_2_LogInfo.csv PPD_daht_3_LogInfo.csv 一部分是Update info PPD_daht_1_Userupdate.csv PPD_daht_2_Userupdate.csv PPD_daht_3_Userupdate.csv 数据清洗对数据的合并:要把几次的数据合并到一起;要把主表和日志表合并在一起;要把训练集和测试集合并在一起。对字符空格的转换:存在着汉字和英文字符,需要转换成数值形式;存在着数据表达不统一的情况,比如北京和北京市,QQ和Qq,以及多空格等情况。对LogInfo与UserupdateInfo 日期信息的处理等:历史记录相对于主表的主要差异在于对于每个index的各项信息,主表是按列汇总,而历史记录是按行堆叠,因此将历史记录按index 分组,将各行信息汇总到各列上,使得各个index 对应唯一一行以与主表连接。此外,对每笔贷款的历史记录中的时间信息,通常其起始时间和登陆/更新信息的总频率对衡量借款人的行为较为重要。数据摘要它的作用是简化并理解数据特征,主要包括了变量的类型、变量空值/非空值数据、变量频数前五的值与对应数量、其他值的数量、数字变量的统计量(均值、方差、四分位数)特征工程数值特征的保留与非数值特征的转换:有额外信息的非数值变量转化为对应的数值:时间–>年月日周、相对天数,地名–>经纬度和城市等级,定序变量–>序数;其他非数值变量全部0-1哑变量处理。选取统计量概况一系列相似变量:取中位数、方差、求和、最值、空值树等概况各时期第三方信息、几个城市变量信息等,统计量尽量要相互独立删除稀疏特征:空值/同一值占绝大比例的列删除共线特征:相关矩阵的严格下三角阵有接近正负1的列使用中位数填充空值,通常数据分布不对称时,中位数比平均数更能保持排序关系最后正态标准化:rank与正态分布的百分位函数复合。之所以考虑正态标准化,是为了应对实际数据的大量有偏分布和极端值,在正态标准化的情况下,数据只保留排序关系,彻底去除了有偏分布和极端值,在大样本下能满足众多模型假设,在本次数据集下能明显提高逻辑回归和神经网络的效果。模型选择Logistic Regression 简单、快捷、稳健、可解释性强,工业界最常用的模型之一。虽然LR模型对变量关系的线性限制,使得其难以达到最优,但可以在建模时通过增加L2罚函数 来减少过拟合;此外,作为基准,能够对数据清洗效果和模型表现作出快速评估。最后,与树模型、神经网络模型等模型差异度较大,适合进行模型的加权组合,补充模型精度。XGBoost 适合处理非线性、变量成分多元化、样本和变量间无固定模式关联(图像、语音),在KDDCup等竞赛中表现优秀的模型之一。如果以精度为目标,综合稳健性、速度、通用性等因素可以首选XGBoostKeras ,深度学习框架,分为线性模型和泛化模型,其中里面各层独立,灵活性高。深度学习的出发点是各变量充满复杂的非线性关系,通过不断优化网络权值向真实关联趋近;而XGBoost 的出发点是认为各变量独立,从决策树的二分关联叠加向真实关联趋近。所以两者各有特点,有较高的互补性。 转自:大数据挖掘DT数据分析 via: http://mp.weixin.qq.com/s?__biz=MzA4NDEyMzc2Mw==&mid=2649678194&idx=4&sn=4a00086384e0bdff362b59abe800a602&scene=0#wechat_redirect

深度学习 视觉 算法 语音 回归 决策树 神经网络 数据质量 特征工程 统计

「基于Xgboost + LR + Keras 建模评估用户信用状态」项目背景 拍拍贷“魔镜风控系统”基于400多个数据维度来对当前用户的信用状态进行评估,通过历史数据每个借款人的性别、年龄、籍贯、学历信息、通讯方式、网站登录信息、第三方时间信息等用户信息以及对应的分类标签,在此基础上结合新发标的用户信息,得到用户六个月内逾期率的预测,为金融平台提供关键的决策支持。数据格式 数据下载–点这里 这里面包含三期数据,每期数据内容和格式相同,这里面包括两部分信息: 一部分是Master PPD_dat_1.csv PPD_dat_2.csv PPD_dat_3.csv 一部分是Log info PPD_daht_1_LogInfo.csv PPD_daht_2_LogInfo.csv PPD_daht_3_LogInfo.csv 一部分是Update info PPD_daht_1_Userupdate.csv PPD_daht_2_Userupdate.csv PPD_daht_3_Userupdate.csv 数据清洗对数据的合并:要把几次的数据合并到一起;要把主表和日志表合并在一起;要把训练集和测试集合并在一起。对字符空格的转换:存在着汉字和英文字符,需要转换成数值形式;存在着数据表达不统一的情况,比如北京和北京市,QQ和Qq,以及多空格等情况。对LogInfo与UserupdateInfo 日期信息的处理等:历史记录相对于主表的主要差异在于对于每个index的各项信息,主表是按列汇总,而历史记录是按行堆叠,因此将历史记录按index 分组,将各行信息汇总到各列上,使得各个index 对应唯一一行以与主表连接。此外,对每笔贷款的历史记录中的时间信息,通常其起始时间和登陆/更新信息的总频率对衡量借款人的行为较为重要。数据摘要它的作用是简化并理解数据特征,主要包括了变量的类型、变量空值/非空值数据、变量频数前五的值与对应数量、其他值的数量、数字变量的统计量(均值、方差、四分位数)特征工程数值特征的保留与非数值特征的转换:有额外信息的非数值变量转化为对应的数值:时间–>年月日周、相对天数,地名–>经纬度和城市等级,定序变量–>序数;其他非数值变量全部0-1哑变量处理。选取统计量概况一系列相似变量:取中位数、方差、求和、最值、空值树等概况各时期第三方信息、几个城市变量信息等,统计量尽量要相互独立删除稀疏特征:空值/同一值占绝大比例的列删除共线特征:相关矩阵的严格下三角阵有接近正负1的列使用中位数填充空值,通常数据分布不对称时,中位数比平均数更能保持排序关系最后正态标准化:rank与正态分布的百分位函数复合。之所以考虑正态标准化,是为了应对实际数据的大量有偏分布和极端值,在正态标准化的情况下,数据只保留排序关系,彻底去除了有偏分布和极端值,在大样本下能满足众多模型假设,在本次数据集下能明显提高逻辑回归和神经网络的效果。模型选择Logistic Regression 简单、快捷、稳健、可解释性强,工业界最常用的模型之一。虽然LR模型对变量关系的线性限制,使得其难以达到最优,但可以在建模时通过增加L2罚函数 来减少过拟合;此外,作为基准,能够对数据清洗效果和模型表现作出快速评估。最后,与树模型、神经网络模型等模型差异度较大,适合进行模型的加权组合,补充模型精度。XGBoost 适合处理非线性、变量成分多元化、样本和变量间无固定模式关联(图像、语音),在KDDCup等竞赛中表现优秀的模型之一。如果以精度为目标,综合稳健性、速度、通用性等因素可以首选XGBoostKeras ,深度学习框架,分为线性模型和泛化模型,其中里面各层独立,灵活性高。深度学习的出发点是各变量充满复杂的非线性关系,通过不断优化网络权值向真实关联趋近;而XGBoost 的出发点是认为各变量独立,从决策树的二分关联叠加向真实关联趋近。所以两者各有特点,有较高的互补性。 转自:大数据挖掘DT数据分析 via: http://mp.weixin.qq.com/s?__biz=MzA4NDEyMzc2Mw==&mid=2649678194&idx=4&sn=4a00086384e0bdff362b59abe800a602&scene=0#wechat_redirect

wx: 网页版 2017-10-05 18:46

公告板 会议活动 深度学习 视觉 算法 语音 资源 David Hubel De Vlamingh 行业动态 会议 活动 迁移学习 神经网络 数据 文强

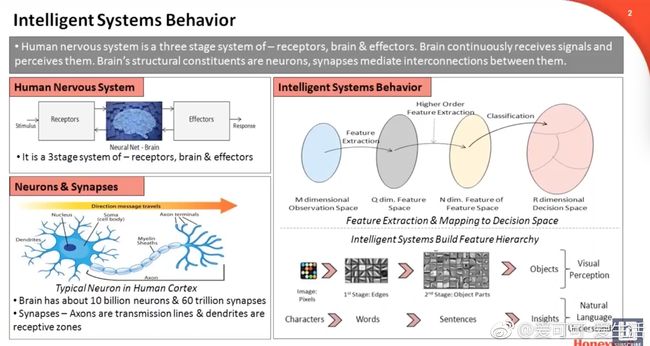

「AI距离匹敌人类大脑还有多远?人工神经网络和生物神经网络最详细对比」2017 年 11 月 8 日,在北京国家会议中心举办的 AI WORLD 2017 世界人工智能大会开放售票!早鸟票 5 折 抢票倒计时 3 天开抢。还记得去年一票难求的AI WORLD 2016盛况吗?今年,我们邀请了冷扑大师”之父 Tuomas 亲临现场,且谷歌、微软、亚马逊、BAT、讯飞、京东和华为等企业重量级嘉宾均已确认出席。关于大会,请关注新智元微信公众号或访问活动行页面: http://www.huodongxing.com/event/2405852054900?td=4231978320026了解更多1新智元编译 来源:news.sophos.co编译:文强 弗格森 【新智元导读】 人工神经网络性能的好坏取决于哪些要素?取得了哪些进展,最新发展趋势是什么?通过与生物神经网络的对比,本文带来对人工神经网络的深度介绍。 能够学习被认为是智能生物的一大标志。机器学习现在有能力从数据集中学习和推断,从而完成复杂的任务,比如对以前从未见过的物体进行分类。 机器学习与人类学习有着惊人的相似和重要的差异。通过比较和对比生物与人工智能如何学习,我们可以建立一个更完善的架构。 在生物神经网络中,学习源自于大脑中无数神经元之间的连接。大脑接触到新的刺激后,这些神经元之间的连接改变了配置。这些更改包括出现新的连接,加强现有连接和删除那些没有使用的连接。例如,重复给定任务的次数越多,与这个任务相关的神经连接就越强,最终我们会认为这个任务被学会了。 神经元使用记忆和感知里预先建立(pre-established)的表征来处理新的刺激。每个刺激都能让一组神经元在认知过程中会被激活,而这样的神经元有很多很多。 这种生物学上的奇妙设计也启发了人工智能研究者,人工神经网络(ANN)旨在抽象地模拟这种行为,但规模和形式都要小并且简单得多。 ANN由互相连接的神经元组成,这些神经会接收一组输入,以及一组连接权重的设置,然后进行一些数学运算,并将结果作为一组与生物神经元中的突触相似的“激活”作为输出。ANN通常由几百到上千个神经元组成,但人脑的生物神经网络有数十亿神经元。 从比较高的层次看,人工神经网络由四个部分组成: 神经元拓扑结构,也即神经元之间的连接路径权重一种学习算法 在人脑生物神经网络和用软件表达的人工神经网络之间,这四大部分有着显著的不同。 在下图中,我们看到一个生物神经元。轴突(Axon)负责输出从神经核到其他神经元的信息,树突(Dendrite)则负责从其他神经元接收信息,来自神经元(突触)的电化学信号聚集在细胞核中。如果电信号聚合超过突触阈值,就会形成电化学脉冲,沿轴突向下传播到其他神经元的树突。 下图展示了一个人脑中神经元拓扑结构的合理假设。可以看出,这个结构蕴含了让信息循环和传播的巨大潜力。 在像人脑这样的生物神经网络中,学习是通过对现有表征进行微小调整实现的,其配置(configuration)在任何学习开始前就已经包含了重要的信息。神经元或权重之间的连接的强度不以随机的方式开始,连接的结构,即网络拓扑也并非随机。这种初始状态是由遗传衍生而来的,是进化的副产物。 随着时间的推移,网络通过调整拓扑和权重来学习如何执行新的功能。实际上,拥有一个起始表征(initial representation)对完成任务来说都很有用,这一点有证据支撑。研究表明,一个月大的新生儿可以通过学习识别陌生人和父母的脸之间的差异。换句话说,人类对“人脸”的概念在很大程度上是从父母那里传承的。 随着婴儿逐渐发育成长,走过童年、青春期、成年,甚至到退休,他们每天都会看到和认识新的朋友,并且要学习他们的样子。而这是通过对大脑中神经网络进行微小的改变来实现的。 同样的现象也适用于其他任务,包括被动感知任务,从识别通用对象到将声音作为一种语音模式来处理,以及主动进行的任务,比如运动和说话。这些技能逐渐被学习,那些用于改进它们的调整幅度也不断缩小。对应这种现象的精确的拓扑结构,是训练这些生物神经网络刺激类型的函数。一个著名的例子是由诺贝尔奖得主David Hubel和Torsten Wiesel领导的单眼剥夺研究。该研究涉及在发育过程中强迫动物的眼睛闭合两个月,观察其主要视觉皮层的变化。 结果表明,通常对双眼输入有反应的细胞变得完全不再对信号产生反应。因此,动物大脑和眼睛中的细胞都发生了改变。这种现象也延伸到人类身上。例如,对视觉感知的心理测验表明,相比居住在农村的人,生活在城市中的人往往对平行线条和锐角更敏感(居住在农村的人则对光滑的纹理渐变更敏感),很可能是城市中道路、摩天大楼和窗户的平行结构过多造成的。 与生物神经网络不同,人工神经网络(ANN)通常从头开始训练,使用的素材是现有的针对某个问题的拓扑结构。目前,这些网络的拓扑不会随时间发生变化,而网络的权重也是通过优化算法随机初始化和进行调整,尽可能将输入刺激映射到期望的输出函数。 不过,ANN也可以基于先前存在的表征来进行学习,这一过程被称为微调。微调也包括使用相对较慢的学习速率调整预训练网络拓扑的权重,从而让网络在新的训练数据上表现良好。 我们也可以毫不费力地复制ANN,但是要做出一个人类大脑还需要一定的时间。 无论是从头开始还是微调训练,权重更新过程都是通过在神经网络中传递数据测量结果,并相应地修改权重开始的。这就是人工神经网络如何进行“学习”的整个过程。权重会按照能在最大程度上提高所需任务性能的方向被逐渐改变,例如最大限度准确识别输入样本的方向。人工神经网络这种学习过程,可以比作一个试图学习识别日常物品的孩子。在尝试失败后,对答案的准确性进行反馈,孩子再次尝试不同的方向,为了得到正确的反应。 ANN在学习时执行的都是相同的任务。一旦这个学习过程完成,ANN就可以使用以前的问题表征来对学习过程中以前没有接触过的新刺激做出反应。跟人类的孩子一样,ANN通过接触尽可能多的类似问题,让自己学得更好。对于人类儿童,练习的次数越多,就能越快处理新的问题,因为孩子大脑中的相关神经元连接变得更加明确。而ANN则类似于更广泛地分配有关任务的可能刺激的广泛分布,从而在以前没有接触过的相同分布中学习,应对新的刺激。 我们人类在长久的发展中学习到,对于儿童来说,暴露在现实世界中的机会越多,他们就能够学得越好,即使这种学习有时候是痛苦的。事实上,当学习是痛苦的时候,痛苦本身就是一个很大的反馈机制。类似地,要训练或微调任何类型的神经网络,将ANN暴露于特定领域中的各种刺激是非常重要的,并且这可以确保你的模型不会对某一种刺激产生过拟合。 通过对特定类别的刺激进行额外的表示,网络可以更好地分类新的刺激或生成概念。这适用于生物神经网络和人工神经网络,虽然生物神经网络在泛化上做得更好。这是真的,部分是因为它们暴露于更多的数据类型和模式,部分原因是由于更先进的生物拓扑和学习算法,并且在很大程度上是因为达尔文主义。 这一说法的一个例子,来源于Nassim Taleb开发的“黑天鹅理论”。这个术语来自于16世纪伦敦的一个“常识”,有人认为所有天鹅都是白色的,因为没有任何其他颜色的天鹅的记录。因此,对他们来说,天鹅必须是白色的,才能被分类为天鹅。荷兰探险家威尔明·德·弗莱明(Willem de Vlamingh)后来见到了西澳的黑天鹅,改变了这种固有的分类。 这里的概念是,如果一个人从小到大到只能看到白天鹅,也就是说,一个人的神经网络只能在“所有的天鹅都是白色的”这一分布上进行训练,这个时候给他呈现一个“黑天鹅”,他就不能将它分类为天鹅, 因为这是一个从未见过的天鹅。如果一个人从小到大看到天鹅有两种颜色,那么他更适合对所有的天鹅类型进行分类,因为这个生物神经网络是在更大的天鹅类型分布上进行训练的,这些分布中包括了更多的知识,让人可以更多地了解天鹅可能包含的属性。 泛化,或者说从以前学到的知识进行抽象的能力,是一种非常有用的功能,可以通过轻微地权重调整,快速地解决跨不同领域的问题。这是一个神经网络针对迁移学习和解决适应性问题的方案。 事实上,不用重新连接很多的神经元这一点,也是平均而言经常滑雪的人要比第一次滑雪的人滑得快的一个原因。被训练用于物体检测的人工神经网络在通过微调后,也能很好用于面部识别,其性能往往比从头开始在相同的面部识别数据集上严格训练的解决方案要更好。 应该清楚的是,今天的人工神经网络还处于起步阶段。虽然在结构上类似,对于权重概念,神经元(功能单位),拓扑学习和学习算法,它们还不能模仿人类对于许多复杂类型任务的处理能力。它们的拓扑结构要简单得多,它们的数量级要小一些,学习算法比较幼稚。此外,他们还不能同时接受许多异构任务的训练。 随着我们继续构建ANN来解决诸如检测以前未知类型的恶意软件的难题,我们还将继续了解人类大脑如何完成任务。或者某些类别的任务,ANN实际上可以胜过人类分析人员的准确性和速度。大脑中的动作电位以千秒数传播,而ANN可以更快地对数据量进行分类。 对于其他任务,ANN的优势补充和增强了即使是最强大的人类思维的能力,使大型工作流程自动化。在不久的将来,ANN将开始在近人甚至超人的层面上执行额外的任务,它们可能在数学和结构上更类似于生物神经网络。 原文链接: https://news.sophos.com/en-us/2017/09/21/man-vs-machine-comparing-artificial-and-biological-neural-networks/ 【扫一扫或点击阅读原文抢购“早鸟票”】AI WORLD 2017 世界人工智能大会购票二维码: via: http://mp.weixin.qq.com/s?__biz=MzI3MTA0MTk1MA==&mid=2652005797&idx=2&sn=81371f384584f8ed7c9d7ae948ffacdc&scene=0#wechat_redirect

公告板 会议活动 深度学习 视觉 算法 语音 资源 David Hubel De Vlamingh 行业动态 会议 活动 迁移学习 神经网络 数据 文强

「AI距离匹敌人类大脑还有多远?人工神经网络和生物神经网络最详细对比」2017 年 11 月 8 日,在北京国家会议中心举办的 AI WORLD 2017 世界人工智能大会开放售票!早鸟票 5 折 抢票倒计时 3 天开抢。还记得去年一票难求的AI WORLD 2016盛况吗?今年,我们邀请了冷扑大师”之父 Tuomas 亲临现场,且谷歌、微软、亚马逊、BAT、讯飞、京东和华为等企业重量级嘉宾均已确认出席。关于大会,请关注新智元微信公众号或访问活动行页面: http://www.huodongxing.com/event/2405852054900?td=4231978320026了解更多1新智元编译 来源:news.sophos.co编译:文强 弗格森 【新智元导读】 人工神经网络性能的好坏取决于哪些要素?取得了哪些进展,最新发展趋势是什么?通过与生物神经网络的对比,本文带来对人工神经网络的深度介绍。 能够学习被认为是智能生物的一大标志。机器学习现在有能力从数据集中学习和推断,从而完成复杂的任务,比如对以前从未见过的物体进行分类。 机器学习与人类学习有着惊人的相似和重要的差异。通过比较和对比生物与人工智能如何学习,我们可以建立一个更完善的架构。 在生物神经网络中,学习源自于大脑中无数神经元之间的连接。大脑接触到新的刺激后,这些神经元之间的连接改变了配置。这些更改包括出现新的连接,加强现有连接和删除那些没有使用的连接。例如,重复给定任务的次数越多,与这个任务相关的神经连接就越强,最终我们会认为这个任务被学会了。 神经元使用记忆和感知里预先建立(pre-established)的表征来处理新的刺激。每个刺激都能让一组神经元在认知过程中会被激活,而这样的神经元有很多很多。 这种生物学上的奇妙设计也启发了人工智能研究者,人工神经网络(ANN)旨在抽象地模拟这种行为,但规模和形式都要小并且简单得多。 ANN由互相连接的神经元组成,这些神经会接收一组输入,以及一组连接权重的设置,然后进行一些数学运算,并将结果作为一组与生物神经元中的突触相似的“激活”作为输出。ANN通常由几百到上千个神经元组成,但人脑的生物神经网络有数十亿神经元。 从比较高的层次看,人工神经网络由四个部分组成: 神经元拓扑结构,也即神经元之间的连接路径权重一种学习算法 在人脑生物神经网络和用软件表达的人工神经网络之间,这四大部分有着显著的不同。 在下图中,我们看到一个生物神经元。轴突(Axon)负责输出从神经核到其他神经元的信息,树突(Dendrite)则负责从其他神经元接收信息,来自神经元(突触)的电化学信号聚集在细胞核中。如果电信号聚合超过突触阈值,就会形成电化学脉冲,沿轴突向下传播到其他神经元的树突。 下图展示了一个人脑中神经元拓扑结构的合理假设。可以看出,这个结构蕴含了让信息循环和传播的巨大潜力。 在像人脑这样的生物神经网络中,学习是通过对现有表征进行微小调整实现的,其配置(configuration)在任何学习开始前就已经包含了重要的信息。神经元或权重之间的连接的强度不以随机的方式开始,连接的结构,即网络拓扑也并非随机。这种初始状态是由遗传衍生而来的,是进化的副产物。 随着时间的推移,网络通过调整拓扑和权重来学习如何执行新的功能。实际上,拥有一个起始表征(initial representation)对完成任务来说都很有用,这一点有证据支撑。研究表明,一个月大的新生儿可以通过学习识别陌生人和父母的脸之间的差异。换句话说,人类对“人脸”的概念在很大程度上是从父母那里传承的。 随着婴儿逐渐发育成长,走过童年、青春期、成年,甚至到退休,他们每天都会看到和认识新的朋友,并且要学习他们的样子。而这是通过对大脑中神经网络进行微小的改变来实现的。 同样的现象也适用于其他任务,包括被动感知任务,从识别通用对象到将声音作为一种语音模式来处理,以及主动进行的任务,比如运动和说话。这些技能逐渐被学习,那些用于改进它们的调整幅度也不断缩小。对应这种现象的精确的拓扑结构,是训练这些生物神经网络刺激类型的函数。一个著名的例子是由诺贝尔奖得主David Hubel和Torsten Wiesel领导的单眼剥夺研究。该研究涉及在发育过程中强迫动物的眼睛闭合两个月,观察其主要视觉皮层的变化。 结果表明,通常对双眼输入有反应的细胞变得完全不再对信号产生反应。因此,动物大脑和眼睛中的细胞都发生了改变。这种现象也延伸到人类身上。例如,对视觉感知的心理测验表明,相比居住在农村的人,生活在城市中的人往往对平行线条和锐角更敏感(居住在农村的人则对光滑的纹理渐变更敏感),很可能是城市中道路、摩天大楼和窗户的平行结构过多造成的。 与生物神经网络不同,人工神经网络(ANN)通常从头开始训练,使用的素材是现有的针对某个问题的拓扑结构。目前,这些网络的拓扑不会随时间发生变化,而网络的权重也是通过优化算法随机初始化和进行调整,尽可能将输入刺激映射到期望的输出函数。 不过,ANN也可以基于先前存在的表征来进行学习,这一过程被称为微调。微调也包括使用相对较慢的学习速率调整预训练网络拓扑的权重,从而让网络在新的训练数据上表现良好。 我们也可以毫不费力地复制ANN,但是要做出一个人类大脑还需要一定的时间。 无论是从头开始还是微调训练,权重更新过程都是通过在神经网络中传递数据测量结果,并相应地修改权重开始的。这就是人工神经网络如何进行“学习”的整个过程。权重会按照能在最大程度上提高所需任务性能的方向被逐渐改变,例如最大限度准确识别输入样本的方向。人工神经网络这种学习过程,可以比作一个试图学习识别日常物品的孩子。在尝试失败后,对答案的准确性进行反馈,孩子再次尝试不同的方向,为了得到正确的反应。 ANN在学习时执行的都是相同的任务。一旦这个学习过程完成,ANN就可以使用以前的问题表征来对学习过程中以前没有接触过的新刺激做出反应。跟人类的孩子一样,ANN通过接触尽可能多的类似问题,让自己学得更好。对于人类儿童,练习的次数越多,就能越快处理新的问题,因为孩子大脑中的相关神经元连接变得更加明确。而ANN则类似于更广泛地分配有关任务的可能刺激的广泛分布,从而在以前没有接触过的相同分布中学习,应对新的刺激。 我们人类在长久的发展中学习到,对于儿童来说,暴露在现实世界中的机会越多,他们就能够学得越好,即使这种学习有时候是痛苦的。事实上,当学习是痛苦的时候,痛苦本身就是一个很大的反馈机制。类似地,要训练或微调任何类型的神经网络,将ANN暴露于特定领域中的各种刺激是非常重要的,并且这可以确保你的模型不会对某一种刺激产生过拟合。 通过对特定类别的刺激进行额外的表示,网络可以更好地分类新的刺激或生成概念。这适用于生物神经网络和人工神经网络,虽然生物神经网络在泛化上做得更好。这是真的,部分是因为它们暴露于更多的数据类型和模式,部分原因是由于更先进的生物拓扑和学习算法,并且在很大程度上是因为达尔文主义。 这一说法的一个例子,来源于Nassim Taleb开发的“黑天鹅理论”。这个术语来自于16世纪伦敦的一个“常识”,有人认为所有天鹅都是白色的,因为没有任何其他颜色的天鹅的记录。因此,对他们来说,天鹅必须是白色的,才能被分类为天鹅。荷兰探险家威尔明·德·弗莱明(Willem de Vlamingh)后来见到了西澳的黑天鹅,改变了这种固有的分类。 这里的概念是,如果一个人从小到大到只能看到白天鹅,也就是说,一个人的神经网络只能在“所有的天鹅都是白色的”这一分布上进行训练,这个时候给他呈现一个“黑天鹅”,他就不能将它分类为天鹅, 因为这是一个从未见过的天鹅。如果一个人从小到大看到天鹅有两种颜色,那么他更适合对所有的天鹅类型进行分类,因为这个生物神经网络是在更大的天鹅类型分布上进行训练的,这些分布中包括了更多的知识,让人可以更多地了解天鹅可能包含的属性。 泛化,或者说从以前学到的知识进行抽象的能力,是一种非常有用的功能,可以通过轻微地权重调整,快速地解决跨不同领域的问题。这是一个神经网络针对迁移学习和解决适应性问题的方案。 事实上,不用重新连接很多的神经元这一点,也是平均而言经常滑雪的人要比第一次滑雪的人滑得快的一个原因。被训练用于物体检测的人工神经网络在通过微调后,也能很好用于面部识别,其性能往往比从头开始在相同的面部识别数据集上严格训练的解决方案要更好。 应该清楚的是,今天的人工神经网络还处于起步阶段。虽然在结构上类似,对于权重概念,神经元(功能单位),拓扑学习和学习算法,它们还不能模仿人类对于许多复杂类型任务的处理能力。它们的拓扑结构要简单得多,它们的数量级要小一些,学习算法比较幼稚。此外,他们还不能同时接受许多异构任务的训练。 随着我们继续构建ANN来解决诸如检测以前未知类型的恶意软件的难题,我们还将继续了解人类大脑如何完成任务。或者某些类别的任务,ANN实际上可以胜过人类分析人员的准确性和速度。大脑中的动作电位以千秒数传播,而ANN可以更快地对数据量进行分类。 对于其他任务,ANN的优势补充和增强了即使是最强大的人类思维的能力,使大型工作流程自动化。在不久的将来,ANN将开始在近人甚至超人的层面上执行额外的任务,它们可能在数学和结构上更类似于生物神经网络。 原文链接: https://news.sophos.com/en-us/2017/09/21/man-vs-machine-comparing-artificial-and-biological-neural-networks/ 【扫一扫或点击阅读原文抢购“早鸟票”】AI WORLD 2017 世界人工智能大会购票二维码: via: http://mp.weixin.qq.com/s?__biz=MzI3MTA0MTk1MA==&mid=2652005797&idx=2&sn=81371f384584f8ed7c9d7ae948ffacdc&scene=0#wechat_redirect

经验总结 博客

【机器学习对话管理引擎】”Rasa Core: Machine Learning-based Dialogue Management” http://t.cn/ROPs1cC GitHub: https ://github .com/RasaHQ/rasa_core ref:《A New Approach to Conversational Software》 http://t.cn/ROPs1Uh

经验总结 深度学习 语音 博客

【高性能WaveNet成Google助理语音合成标配】《WaveNet launches in the Google Assistant | DeepMind》 http://t.cn/ROvCRJn

最新动态

2017-10-05 (16)

wx: 网页版 2017-10-05 18:46

公告板 会议活动 深度学习 算法 语音 自然语言处理 Sundar Pichai 产业 行业动态 胡祥杰 会议 活动 机器翻译 神经网络 文强

「【谷歌硬件发布会全回顾】9大新品重磅发布,DeepMind强力助攻硬件AI化」2017 年 11 月 8 日,在北京国家会议中心举办的 AI WORLD 2017 世界人工智能大会开放售票!早鸟票 5 折 抢票倒计时 3 天开抢。还记得去年一票难求的AI WORLD 2016盛况吗?今年,我们邀请了冷扑大师”之父 Tuomas 亲临现场,且谷歌、微软、亚马逊、BAT、讯飞、京东和华为等企业重量级嘉宾均已确认出席。 关于大会,请关注新智元微信公众号或访问活动行页面: http://www.huodongxing.com/event/2405852054900?td=4231978320026了解更多1新智元报道 来源:Google,TechCrunch 作者/编译:胡祥杰,文强 【新智元导读】 谷歌昨天夜间进行了本年度规模最大的一场硬件发布会,一口气发布了多款新品,包括拍照完爆iphone 8 Plus的手机、笔记本电脑、能实时翻译的耳机、价格亲民的音箱、电子笔、摄像头等。从软件到硬件,谷歌现在已经全面AI化。本文带来这些产品的全面介绍,带你一览谷歌的AI黑科技。最值得注意的是,被谷歌收购后的DeepMind现在已经开始为谷歌产品提供产品支持,DeepMind宣布WaveNet的升级版本正被用于各个平台上生成Google Assistant的声音。 先来看看本场发布会的5大亮点: 可能是最让人惊喜的设备:谷歌AI驱动的摄像头——Clips,这并不是Pixel手机或者其他任何设备的“附属品”,而是一个独立的摄像头,能够自动完成拍照、选择照片和剪辑等功能。据报道,谷歌在这一摄像头中使用的是英特尔所买下的公司Movidius所提供的极端低功耗芯片VPU。Pixel 2 在照相机的排行榜上,将iPhone8 Plus 和 Galaxy Note 8挤下王座。在 DxOMark 上的测试分数达到了98分,iPhone8 Plus 和 Galaxy Note 8只有94。Google Pixel 2 一个摄像头就能玩转景深效果。谷歌在笔记本电脑上可能是最认真的一次尝试:Google Pixelbook,一个四合一变形本,你可以把它当笔记本用,或者反面折叠成平板,还可以翻过来把键盘当支架。Google Pixel Buds耳机,可以实时翻译的可穿戴设备,能翻译40多种语言。 发布会一开始,谷歌CEO Sundar Pichai 首先阐述了谷歌的AI战略,包括软件和硬件层。 Sundar Pichai 在演讲一开始,首先对拉斯维加斯枪击案中的受害者和家人表达了慰问。 在AI上,他提到的第一个关键词是机器学习。主要是介绍谷歌如何使用机器学习技术。主要的例子包括,发展中国家中困难的图像问题如何用机器学习来解决;还有就是如何利用机器学习来解决地方难题,比如在旧金山的停车问题。 接下来,他提到了谷歌翻译,并透露谷歌的机器翻译现在每天进行的翻译超过了2亿次。 “这是为什么我们对从移动为先转换到AI为先的世界如此兴奋的原因”,Sundar 说。 他认为,计算也将是无处不在的,屏幕也无处不在。 AI还将使得计算变得更加语境化,这一直是Google从一开始就追逐的核心。另外,移动端的计算变得越来越自然,而AI 将成为这一进程中的重要一步。 他说:“计算需要学习和适应我们的需要”。 对计算的这一认知,也许正是谷歌如何看待向AI转型对真正的用户的影响的一种体现。 接下来我们再看谷歌发布会上推出的各种新产品,从最新款的手机到机器学习驱动的可穿戴摄像头,高科技应用应有尽有。 要说信息量太大,你没时间全部过一遍?我们懂的,所以下面就是这场发布会的精华,全部用图片的形式呈现——你准备好了吗? Google Home Mini 如果你觉得Google Home的概念不错,但不喜欢那个长得像空气净化器的设计,那么你不妨看看Google Home Mini。 面包圈大小,但功能一个也不少,表面大部分由面料构成,最下面是LED灯。颜色分三款——这里就省去那些炫酷的形容词了:橙色(coral)、灰色(chalk)和黑色(charcoal),10月19日发售。 Google Home Max 刚刚说完了缩小款,现在接着来放大版。Google Home Max是谷歌对标苹果HomePod的产品,可竖放可横躺,附带一个橡胶底座,底座与主体通过磁力相连。除了网线、蓝牙,Google Home Max还可以和Cast相连。 Google Home Max的发售时间要等到12月,颜色有灰黑两款。 广播功能 如果你家里有多台Google Home设备,新的这种广播功能让你在整个屋子里播放“OK Google,播放‘上学时间到了’”这种消息。 其他Google Home的新功能 通过Google Home直接拨打电话(目前仅供美国和加拿大),接下来在英国也可以使用通过Google Home拨打的电话,号码可以显示为你的私人号码(当你在App确认后) Google Home本周将在日本发布,有日语支持 Nest新增语音激活Chromecast支持功能 如果你“All in Google”,家里有Nest摄像头、一堆Google Home产品,而且带有Chromecast,那么你就可以实现类似说“OK Google,显示客厅”或“OK Google,谁在敲门”,然后在离你最近的电视机屏幕上显示图像。 Google Pixelbook 谷歌已经好久没用心做Chrombook了,所以Google Pixelbook出来确实让人小吃一惊。Google Pixelbook算是一个四合一变形本,你可以把它当笔记本用,或者反面折叠成平板,还可以翻过来把键盘当支架。 Google Pixelbook重量约为1千克,10mm厚,12.3英寸触摸屏。搭载i5/i7处理器,内存最高16GB,硬盘(固态存储器)最高512G。Google Pixelbook还有个最新的“立即连接热点”功能,发现WiFi不行立即与你手机进行网络共享。 Google Pixelbook最低配置版本999美元,10月31日发货。 Pixelbook电子笔 谷歌和Wacom合作打造了这款电子笔,号称10微秒以下延迟,2000级压力灵敏度,供你尽情写画。花99美元,你最早10月31日就能用到了。 Pixel 2 谷歌的手机Pixel火爆一时,断货都有出现过。现在,他们又搞了个Pixel 2。Pixel 2手机有两种大小,5英寸和6英寸XL版。全铝机身,弯曲OLED屏,指纹传感器(背面),正面麦克风以及IP67防水/防尘,也没有耳机插口,全部走USB-C路线。 Pixel 2借鉴了HTC U11的“挤压”功能概念,你稍微挤一挤Pixel 2,就能激活Google Assistant。 5英寸的Pixel 2最低649美元起售,6英寸的Pixel 2 XL最低售价849美元。今天就开放预售,10月17日发货。 Pixel 2超炫摄像头 Google Pixel的摄像头就已经很不错了,这回谷歌表示他们还要做得更好。 很多公司都在玩“Portrait Mode”(景深摄影)这个概念,也就是让摄像头聚焦一个物体的同时,让背景有个DSLR那样的虚化。一般来说,这需要两个摄像头才能做到,一个聚焦近景,一个聚焦远景。但是,谷歌却说他们只用一个摄像头就搞定了!因此,Pixel 2的前向摄像头和后向摄像头都能有Portrait Mode。 有了“fused image stabilization”融合图像稳定技术,Pixel 2能同时进行光线稳定和数字稳定。 DXOMark评级分数高达98,要知道去年Pixel的得分是89。 AR贴纸 用户喜欢贴纸,用户也喜欢AR,为什么不把这两者合起来呢? 谷歌AR贴纸让你的手机摄像头瞬间就转换为互动的3D视角。如果你在一个镜头图像里放多张“贴纸”,它们还能互动。 新的Daydream VR头盔 继2016年Daydream头盔后,Daydream View又有了更宽广的视角,以及几种新的颜色。 Google Pixel Buds耳机 谷歌也加入无线耳机战场,而且这种耳机还自带翻译器。Google Pixel Buds耳机的实时翻译功能能翻译40多种语言,售价159美元,有个充电器外盒,一次充电使用大约24小时。11月起发货。 Google Clips便携摄像头 Google Clips是一个带夹子的摄像头,能够卡在……它能够卡在的所有东西上面,包括衣服、自行车、书桌。Google Clips摄像头使用机器学习,自动拍摄照片,它能识别人体,检测到稳定的画面,然后snap,自动拍摄图片。 想想有些……侵犯隐私。谷歌表示会有一个状态显示器表明这是一个摄像头。售价249美元,发货时间“soon”。 被谷歌收购后,DeepMind的技术也开始更多地出现在了谷歌的产品中。本场发布会举行的时候,DeepMind宣布WaveNet的升级版本正被用于各个平台上生成Google Assistant的声音,包括英语(美音)和日文。使用新的WaveNet模型可以为Assistant 提供一系列更自然的声音。 一年多前,DeepMind提出了WaveNet,这是一种新的深层神经网络,能生成原始音频波形,能够产生比当时技术更好和更逼真的声音语音。当时,这个模型是一个研究的原型,要用在消费产品中的话,计算量太大了。 据介绍, 现在,Wavenet已经能够大范围地扩展,并且成为谷歌最新的TPU云基础设施上发布的第一个产品。 为了理解WaveNet如何实现现有技术水平,首先要了解文本到语音(TTS)或语音合成系统是如何工作的。 这些大多数都是基于所谓的并置TTS,它使用大量高质量录音数据库,持续数小时地收集一个声音演员的声音。这些记录被分割成小块,然后可以将其组合或连接,以形成完整的话语。然而,这些系统可能导致不自然的声音,并且也难以修改,因为每当需要一组改变(例如新的情绪或语调)时,就需要记录全新的数据库。 为了克服这些问题,有时使用称为参数TTS的替代模型。这需要通过使用一系列关于语法和嘴巴移动的规则和参数来引导计算机生成的语音来连接声音。虽然便宜又快捷,但这种方法创造出的声音却不够自然。 Wavenet使用的是一种完全不同的方法,在最初的论文中,研究院描述了一种深度生成模型,能够从头开始创造声浪格式,每次一个样本,每秒能生成16000个样本,并且在每一种声音中都能做到无缝连接。 以Wavenet和谷歌助手的联合为例,谷歌强大的基础设施,比如谷歌云和产品能力,加上DeepMind前沿的AI技术,会碰撞出多少火花,我们拭目以待。 【扫一扫或点击阅读原文抢购“早鸟票”】AI WORLD 2017 世界人工智能大会购票二维码: via: http://mp.weixin.qq.com/s?__biz=MzI3MTA0MTk1MA==&mid=2652005797&idx=1&sn=b00438b7e703cdf806243200c20b4522&scene=0#wechat_redirect

公告板 会议活动 深度学习 算法 语音 自然语言处理 Sundar Pichai 产业 行业动态 胡祥杰 会议 活动 机器翻译 神经网络 文强

「【谷歌硬件发布会全回顾】9大新品重磅发布,DeepMind强力助攻硬件AI化」2017 年 11 月 8 日,在北京国家会议中心举办的 AI WORLD 2017 世界人工智能大会开放售票!早鸟票 5 折 抢票倒计时 3 天开抢。还记得去年一票难求的AI WORLD 2016盛况吗?今年,我们邀请了冷扑大师”之父 Tuomas 亲临现场,且谷歌、微软、亚马逊、BAT、讯飞、京东和华为等企业重量级嘉宾均已确认出席。 关于大会,请关注新智元微信公众号或访问活动行页面: http://www.huodongxing.com/event/2405852054900?td=4231978320026了解更多1新智元报道 来源:Google,TechCrunch 作者/编译:胡祥杰,文强 【新智元导读】 谷歌昨天夜间进行了本年度规模最大的一场硬件发布会,一口气发布了多款新品,包括拍照完爆iphone 8 Plus的手机、笔记本电脑、能实时翻译的耳机、价格亲民的音箱、电子笔、摄像头等。从软件到硬件,谷歌现在已经全面AI化。本文带来这些产品的全面介绍,带你一览谷歌的AI黑科技。最值得注意的是,被谷歌收购后的DeepMind现在已经开始为谷歌产品提供产品支持,DeepMind宣布WaveNet的升级版本正被用于各个平台上生成Google Assistant的声音。 先来看看本场发布会的5大亮点: 可能是最让人惊喜的设备:谷歌AI驱动的摄像头——Clips,这并不是Pixel手机或者其他任何设备的“附属品”,而是一个独立的摄像头,能够自动完成拍照、选择照片和剪辑等功能。据报道,谷歌在这一摄像头中使用的是英特尔所买下的公司Movidius所提供的极端低功耗芯片VPU。Pixel 2 在照相机的排行榜上,将iPhone8 Plus 和 Galaxy Note 8挤下王座。在 DxOMark 上的测试分数达到了98分,iPhone8 Plus 和 Galaxy Note 8只有94。Google Pixel 2 一个摄像头就能玩转景深效果。谷歌在笔记本电脑上可能是最认真的一次尝试:Google Pixelbook,一个四合一变形本,你可以把它当笔记本用,或者反面折叠成平板,还可以翻过来把键盘当支架。Google Pixel Buds耳机,可以实时翻译的可穿戴设备,能翻译40多种语言。 发布会一开始,谷歌CEO Sundar Pichai 首先阐述了谷歌的AI战略,包括软件和硬件层。 Sundar Pichai 在演讲一开始,首先对拉斯维加斯枪击案中的受害者和家人表达了慰问。 在AI上,他提到的第一个关键词是机器学习。主要是介绍谷歌如何使用机器学习技术。主要的例子包括,发展中国家中困难的图像问题如何用机器学习来解决;还有就是如何利用机器学习来解决地方难题,比如在旧金山的停车问题。 接下来,他提到了谷歌翻译,并透露谷歌的机器翻译现在每天进行的翻译超过了2亿次。 “这是为什么我们对从移动为先转换到AI为先的世界如此兴奋的原因”,Sundar 说。 他认为,计算也将是无处不在的,屏幕也无处不在。 AI还将使得计算变得更加语境化,这一直是Google从一开始就追逐的核心。另外,移动端的计算变得越来越自然,而AI 将成为这一进程中的重要一步。 他说:“计算需要学习和适应我们的需要”。 对计算的这一认知,也许正是谷歌如何看待向AI转型对真正的用户的影响的一种体现。 接下来我们再看谷歌发布会上推出的各种新产品,从最新款的手机到机器学习驱动的可穿戴摄像头,高科技应用应有尽有。 要说信息量太大,你没时间全部过一遍?我们懂的,所以下面就是这场发布会的精华,全部用图片的形式呈现——你准备好了吗? Google Home Mini 如果你觉得Google Home的概念不错,但不喜欢那个长得像空气净化器的设计,那么你不妨看看Google Home Mini。 面包圈大小,但功能一个也不少,表面大部分由面料构成,最下面是LED灯。颜色分三款——这里就省去那些炫酷的形容词了:橙色(coral)、灰色(chalk)和黑色(charcoal),10月19日发售。 Google Home Max 刚刚说完了缩小款,现在接着来放大版。Google Home Max是谷歌对标苹果HomePod的产品,可竖放可横躺,附带一个橡胶底座,底座与主体通过磁力相连。除了网线、蓝牙,Google Home Max还可以和Cast相连。 Google Home Max的发售时间要等到12月,颜色有灰黑两款。 广播功能 如果你家里有多台Google Home设备,新的这种广播功能让你在整个屋子里播放“OK Google,播放‘上学时间到了’”这种消息。 其他Google Home的新功能 通过Google Home直接拨打电话(目前仅供美国和加拿大),接下来在英国也可以使用通过Google Home拨打的电话,号码可以显示为你的私人号码(当你在App确认后) Google Home本周将在日本发布,有日语支持 Nest新增语音激活Chromecast支持功能 如果你“All in Google”,家里有Nest摄像头、一堆Google Home产品,而且带有Chromecast,那么你就可以实现类似说“OK Google,显示客厅”或“OK Google,谁在敲门”,然后在离你最近的电视机屏幕上显示图像。 Google Pixelbook 谷歌已经好久没用心做Chrombook了,所以Google Pixelbook出来确实让人小吃一惊。Google Pixelbook算是一个四合一变形本,你可以把它当笔记本用,或者反面折叠成平板,还可以翻过来把键盘当支架。 Google Pixelbook重量约为1千克,10mm厚,12.3英寸触摸屏。搭载i5/i7处理器,内存最高16GB,硬盘(固态存储器)最高512G。Google Pixelbook还有个最新的“立即连接热点”功能,发现WiFi不行立即与你手机进行网络共享。 Google Pixelbook最低配置版本999美元,10月31日发货。 Pixelbook电子笔 谷歌和Wacom合作打造了这款电子笔,号称10微秒以下延迟,2000级压力灵敏度,供你尽情写画。花99美元,你最早10月31日就能用到了。 Pixel 2 谷歌的手机Pixel火爆一时,断货都有出现过。现在,他们又搞了个Pixel 2。Pixel 2手机有两种大小,5英寸和6英寸XL版。全铝机身,弯曲OLED屏,指纹传感器(背面),正面麦克风以及IP67防水/防尘,也没有耳机插口,全部走USB-C路线。 Pixel 2借鉴了HTC U11的“挤压”功能概念,你稍微挤一挤Pixel 2,就能激活Google Assistant。 5英寸的Pixel 2最低649美元起售,6英寸的Pixel 2 XL最低售价849美元。今天就开放预售,10月17日发货。 Pixel 2超炫摄像头 Google Pixel的摄像头就已经很不错了,这回谷歌表示他们还要做得更好。 很多公司都在玩“Portrait Mode”(景深摄影)这个概念,也就是让摄像头聚焦一个物体的同时,让背景有个DSLR那样的虚化。一般来说,这需要两个摄像头才能做到,一个聚焦近景,一个聚焦远景。但是,谷歌却说他们只用一个摄像头就搞定了!因此,Pixel 2的前向摄像头和后向摄像头都能有Portrait Mode。 有了“fused image stabilization”融合图像稳定技术,Pixel 2能同时进行光线稳定和数字稳定。 DXOMark评级分数高达98,要知道去年Pixel的得分是89。 AR贴纸 用户喜欢贴纸,用户也喜欢AR,为什么不把这两者合起来呢? 谷歌AR贴纸让你的手机摄像头瞬间就转换为互动的3D视角。如果你在一个镜头图像里放多张“贴纸”,它们还能互动。 新的Daydream VR头盔 继2016年Daydream头盔后,Daydream View又有了更宽广的视角,以及几种新的颜色。 Google Pixel Buds耳机 谷歌也加入无线耳机战场,而且这种耳机还自带翻译器。Google Pixel Buds耳机的实时翻译功能能翻译40多种语言,售价159美元,有个充电器外盒,一次充电使用大约24小时。11月起发货。 Google Clips便携摄像头 Google Clips是一个带夹子的摄像头,能够卡在……它能够卡在的所有东西上面,包括衣服、自行车、书桌。Google Clips摄像头使用机器学习,自动拍摄照片,它能识别人体,检测到稳定的画面,然后snap,自动拍摄图片。 想想有些……侵犯隐私。谷歌表示会有一个状态显示器表明这是一个摄像头。售价249美元,发货时间“soon”。 被谷歌收购后,DeepMind的技术也开始更多地出现在了谷歌的产品中。本场发布会举行的时候,DeepMind宣布WaveNet的升级版本正被用于各个平台上生成Google Assistant的声音,包括英语(美音)和日文。使用新的WaveNet模型可以为Assistant 提供一系列更自然的声音。 一年多前,DeepMind提出了WaveNet,这是一种新的深层神经网络,能生成原始音频波形,能够产生比当时技术更好和更逼真的声音语音。当时,这个模型是一个研究的原型,要用在消费产品中的话,计算量太大了。 据介绍, 现在,Wavenet已经能够大范围地扩展,并且成为谷歌最新的TPU云基础设施上发布的第一个产品。 为了理解WaveNet如何实现现有技术水平,首先要了解文本到语音(TTS)或语音合成系统是如何工作的。 这些大多数都是基于所谓的并置TTS,它使用大量高质量录音数据库,持续数小时地收集一个声音演员的声音。这些记录被分割成小块,然后可以将其组合或连接,以形成完整的话语。然而,这些系统可能导致不自然的声音,并且也难以修改,因为每当需要一组改变(例如新的情绪或语调)时,就需要记录全新的数据库。 为了克服这些问题,有时使用称为参数TTS的替代模型。这需要通过使用一系列关于语法和嘴巴移动的规则和参数来引导计算机生成的语音来连接声音。虽然便宜又快捷,但这种方法创造出的声音却不够自然。 Wavenet使用的是一种完全不同的方法,在最初的论文中,研究院描述了一种深度生成模型,能够从头开始创造声浪格式,每次一个样本,每秒能生成16000个样本,并且在每一种声音中都能做到无缝连接。 以Wavenet和谷歌助手的联合为例,谷歌强大的基础设施,比如谷歌云和产品能力,加上DeepMind前沿的AI技术,会碰撞出多少火花,我们拭目以待。 【扫一扫或点击阅读原文抢购“早鸟票”】AI WORLD 2017 世界人工智能大会购票二维码: via: http://mp.weixin.qq.com/s?__biz=MzI3MTA0MTk1MA==&mid=2652005797&idx=1&sn=b00438b7e703cdf806243200c20b4522&scene=0#wechat_redirect

经验总结 深度学习 算法 博客 分布式学习 强化学习

《Solving Atari games with Distributed Reinforcement Learning》by Igor Adamski http://t.cn/ROhP0EF

进化计算 算法

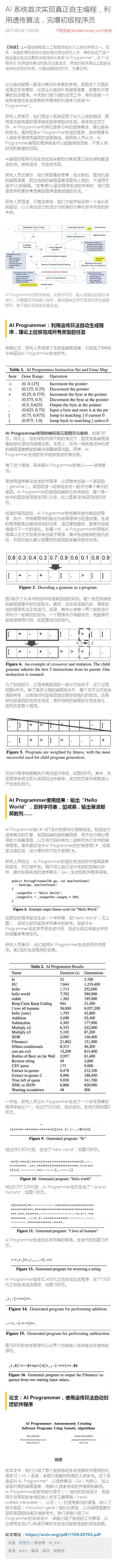

【AI 系统首次实现真正自主编程,利用遗传算法,完爆初级程序员】让AI自动编程是人工智能领域长久以来的梦想之一。现在,来自彭博和英特尔实验室的两位研究人员,号称实现了首个能够自动生成完整软件程序的AI系统“AI Programmer”。详见 http://t.cn/R0nxA70(来自:新智元)

深度学习 算法 神经网络

【新智元导读】 人工神经网络性能的好坏取决于哪些要素?取得了哪些进展,最新发展趋势是什么?通过与生物神经网络的对比,本文带来对人工神经网络的深度介绍。 http://t.cn/ROP2qTo

【新智元导读】从小有“学术天才”之称的 Kamil Tamiola 将计算生物学和机器学习相结合,组建了自己的创业公司。他表示,当年最痛苦的事情就是“科学写作”,他曾经认为那是浪费时间。但今天,他大声疾呼,认为自己当年大错特错,并痛陈如今 AI/ML 论文写作中的一些普遍问题。 http://t.cn/ROP227G

深度学习

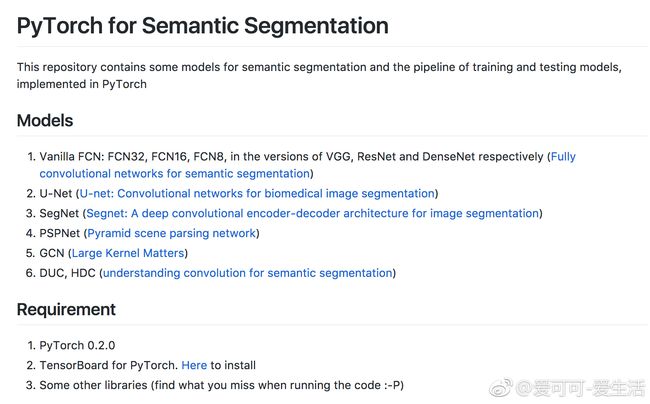

【PyTorch语义分割】’PyTorch for Semantic Segmentation’ by ZijunDeng GitHub: https ://github .com/ZijunDeng/pytorch-semantic-segmentation

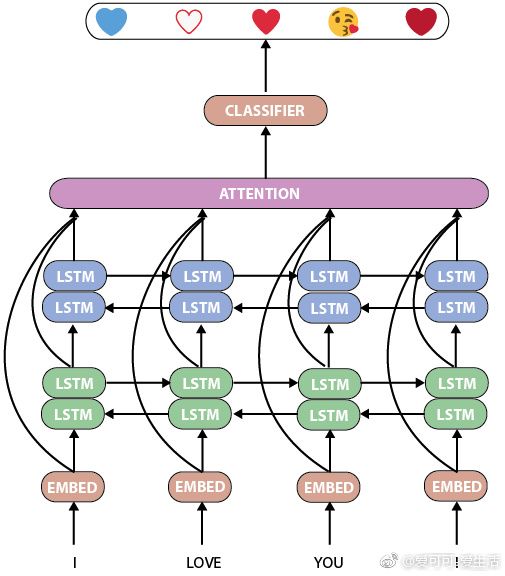

深度学习 自然语言处理 Thomas Wolf 情感分析

《Understanding emotions — from Keras to pyTorch》by Thomas Wolf http://t.cn/ROvj7OJ pdf: http://t.cn/ROvj7Oi

深度学习

【从GitHub看深度学习框架流行度(10月版)】“Deep learning frameworks seen through GitHub metrics – October 2017” via:François Chollet

深度学习 资源 视频

【深度学习研究趋势】《The Future of Deep Learning Research – YouTube》by Siraj Raval http://t.cn/ROvOeCC GitHub: https ://github .com/llSourcell/7_Research_Directions_Deep_Learning

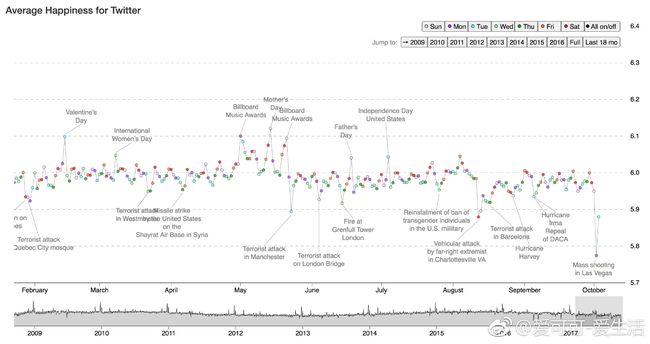

自然语言处理 情感分析

【Twitter情感分析:拉斯维加斯枪击成最悲伤一日】“Average Happiness for Twitter” http://t.cn/ROv0lSX

深度学习 资源 视频

【你所需要了解的深度学习】《All You Need to Know About Deep Learning – YouTube》by Atul Katole http://t.cn/ROvCOn0

深度学习 James Temperton

《DeepMind’s new AI ethics unit is the company’s next big move | WIRED UK》by James Temperton http://t.cn/ROvCJeM

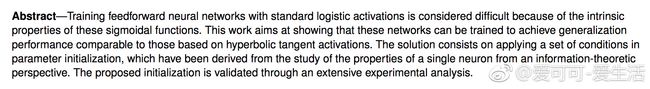

算法 论文 神经网络

《Training Feedforward Neural Networks with Standard Logistic Activations is Feasible》E Sansone, F G.B. D Natale (2017) http://t.cn/ROvCbIF

算法 论文 神经网络

《Neural Trojans》Y Liu, Y Xie, A Srivastava [University of Maryland] (2017) http://t.cn/ROv9u1U

深度学习 算法 论文 神经网络

《Facial Key Points Detection using Deep Convolutional Neural Network – NaimishNet》N Agarwal, A Krohn-Grimberghe, R Vyas [IIIT-Allahabad & University of Paderborn] (2017) http://t.cn/ROv9Yl9