matlab数学建模-神经网络:测试不同隐藏层神经元的个数、更改学习函数

目录

通过误差,和训练步数对比,确定隐含层个数,并检验隐含层个数对性能的影响。

1)trainlm 算法

2)traingdm 算法

3)trainrp 算法

4) traingdx 算法

5)traincgf 算法

通过误差,和训练步数对比,确定隐含层个数,并检验隐含层个数对性能的影响。

隐藏层范围是按设计经验公式,和本例实际情况,选的 9:16

%变量x范围

x=-4:0.01:4;

%输入目标函数

y1=sin((1/2)*pi*x)+sin(pi*x);

%隐藏层的神经元个数

s=9:16;

%欧式距离

res=1:8;

%选不同的隐藏层数目,进行网络测试

for i=1:8

%建立前向型BP网络,输入层和隐藏层激励函数为tansig, 输出层为purelin

%训练函数为trainlm,也是默认函数

net=newff(minmax(x),[1,s(i),1],{'tansig','tansig','purelin'},'trainlm');

%训练步数最大200

net.trainparam.epochs=2000;

%设定目标误差0.00001

net.trainparam.goal=0.00001;

%训练

net=train(net,x,y1);

%仿真

y2=sim(net,x);

%求欧式距离,判定性能

err=y2-y1;

res(i)=norm(err);

end运行结果

各种BP网络学习算法采用了不同的学习函数,所以这里只需要更改学习函数。

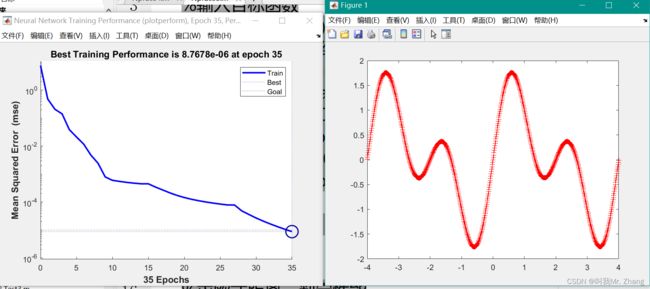

1)trainlm 算法

%变量x范围

x=-4:0.01:4;

%输入目标函数

y1=sin((1/2)*pi*x)+sin(pi*x);

%建立前向型BP网络,输入层和隐藏层激励函数为tansig, 输出层为purelin

%训练函数为trainlm,也是默认函数

net=newff(minmax(x),[1,s(i),1],{'tansig','tansig','purelin'},'trainlm');

%训练步数最大200

net.trainparam.epochs=2000;

%设定目标误差0.00001

net.trainparam.goal=0.00001;

%训练

net=train(net,x,y1);

%仿真

y2=sim(net,x);

%求欧式距离,判定性能

err=y2-y1;

res(i)=norm(err);

plot(x,y1);

hold on

plot(x,y2,'r+');仿真得到的 网络误差曲线(左)和网络仿真曲线(右)

注意网络仿真曲线,'r+' 是网络仿真,'——'是目标曲线

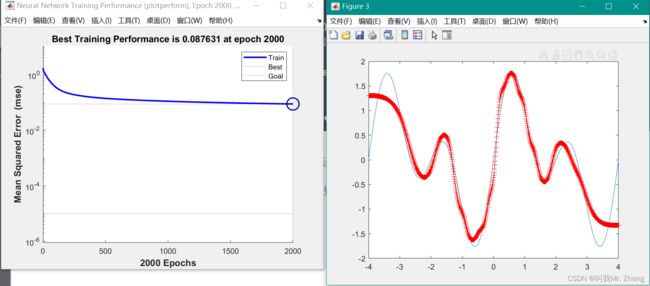

2)traingdm 算法

%变量x范围

x=-4:0.01:4;

%输入目标函数

y1=sin((1/2)*pi*x)+sin(pi*x);

%建立前向型BP网络,输入层和隐藏层激励函数为tansig, 输出层为purelin

%训练函数为trainlm,也是默认函数

net=newff(minmax(x),[1,s(i),1],{'tansig','tansig','purelin'},'traingdm');

%训练步数最大200

net.trainparam.epochs=2000;

%设定目标误差0.00001

net.trainparam.goal=0.00001;

%训练

net=train(net,x,y1);

%仿真

y2=sim(net,x);

%求欧式距离,判定性能

err=y2-y1;

res(i)=norm(err);

plot(x,y1);

hold on

plot(x,y2,'r+');仿真得到的 网络误差曲线(左)和网络仿真曲线(右)

注意网络仿真曲线,'r+' 是网络仿真,'——'是目标曲线

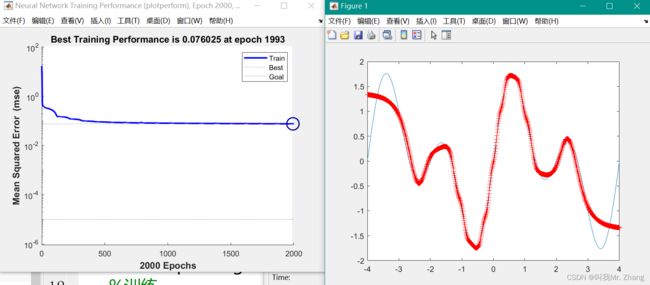

3)trainrp 算法

%变量x范围

x=-4:0.01:4;

%输入目标函数

y1=sin((1/2)*pi*x)+sin(pi*x);

%建立前向型BP网络,输入层和隐藏层激励函数为tansig, 输出层为purelin

%训练函数为trainlm,也是默认函数

net=newff(minmax(x),[1,s(i),1],{'tansig','tansig','purelin'},'trainrp');

%训练步数最大200

net.trainparam.epochs=2000;

%设定目标误差0.00001

net.trainparam.goal=0.00001;

%训练

net=train(net,x,y1);

%仿真

y2=sim(net,x);

%求欧式距离,判定性能

err=y2-y1;

res(i)=norm(err);

plot(x,y1);

hold on

plot(x,y2,'r+');仿真得到的 网络误差曲线(左)和网络仿真曲线(右)

注意网络仿真曲线,'r+' 是网络仿真,'——'是目标曲线

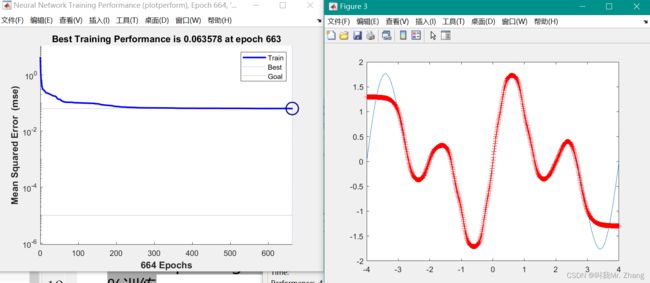

4) traingdx 算法

%变量x范围

x=-4:0.01:4;

%输入目标函数

y1=sin((1/2)*pi*x)+sin(pi*x);

%建立前向型BP网络,输入层和隐藏层激励函数为tansig, 输出层为purelin

%训练函数为trainlm,也是默认函数

net=newff(minmax(x),[1,s(i),1],{'tansig','tansig','purelin'},'traingdx');

%训练步数最大200

net.trainparam.epochs=2000;

%设定目标误差0.00001

net.trainparam.goal=0.00001;

%训练

net=train(net,x,y1);

%仿真

y2=sim(net,x);

%求欧式距离,判定性能

err=y2-y1;

res(i)=norm(err);

plot(x,y1);

hold on

plot(x,y2,'r+');仿真得到的 网络误差曲线(左)和网络仿真曲线(右)

注意网络仿真曲线,'r+' 是网络仿真,'——'是目标曲线

5)traincgf 算法

%变量x范围

x=-4:0.01:4;

%输入目标函数

y1=sin((1/2)*pi*x)+sin(pi*x);

%建立前向型BP网络,输入层和隐藏层激励函数为tansig, 输出层为purelin

%训练函数为trainlm,也是默认函数

net=newff(minmax(x),[1,s(i),1],{'tansig','tansig','purelin'},'traincgf');

%训练步数最大200

net.trainparam.epochs=2000;

%设定目标误差0.00001

net.trainparam.goal=0.00001;

%训练

net=train(net,x,y1);

%仿真

y2=sim(net,x);

%求欧式距离,判定性能

err=y2-y1;

res(i)=norm(err);

plot(x,y1);

hold on

plot(x,y2,'r+');仿真得到的 网络误差曲线(左)和网络仿真曲线(右)

注意网络仿真曲线,'r+' 是网络仿真,'——'是目标曲线

不确定性因素,会对网络训练有不同的影响,产生不同的效果。