第三次作业:卷积神经网络基础

文章目录

- 一、视频学习

-

- 第一部分:卷积神经网络相关概念

-

- 概括

- 卷积

- 池化

- 全连接

- 小结

- 第二部分:卷积神经网络典型结构

-

- 发展历程

- AlexNet

- VGG16

- GoogleNet

- ResNet

- 疑问

- 二、代码练习

-

- (一)练习1 MNIST 数据集分类:构建简单的CNN对 mnist 数据集进行分类。

-

- 1.引入所需库,加载数据集(MNIST)

- 2.构建网络

- 3.定义训练函数和测试函数

- 4.在小型全连接网络上训练(Fully-connected network)

- 5.在卷积神经网络上训练

- 6.打乱像素顺序再次在两个网络上训练与测试

- (二)练习2 CIFAR10 数据集分类:使用 CNN 对 CIFAR10 数据集进行分类

-

- 1.引入所需库,加载数据集(CIFAR10)

- 2.定义网络,损失函数和优化器:

- 3.训练和测试

- (三)练习3 使用 VGG16 对 CIFAR10 分类

-

- VGG16介绍

- 1. 定义 dataloader

- 2.定义VGG网络

- 3.网络训练

- 4.测试验证准确率

- 三、本周写博客需要思考的问题:

-

- 5、residual leanring 为什么能够提升准确率?

- 6、代码练习二里,网络和1989年 Lecun 提出的 LeNet 有什么区别?

- 7、代码练习二里,卷积以后feature map 尺寸会变小,如何应用 Residual Learning?

- 8、有什么方法可以进一步提升准确率?

一、视频学习

第一部分:卷积神经网络相关概念

概括

-

卷积神经网络的应用:分类、检索、检测、分割;人脸识别、图像生成、智能驾驶。

-

深度学习三部曲:搭建神经网络结构,提取特征;合适的损失函数;合适的优化参数;

-

传统神经网络和卷积神经网络:

使用传统神经网络:参数太多,会导致过拟合现象,泛化性能差

卷积神经网络:局部关联;参数共享

相同之处:层级结构 -

卷积神经网络基本组成结构:卷积;池化;全连接

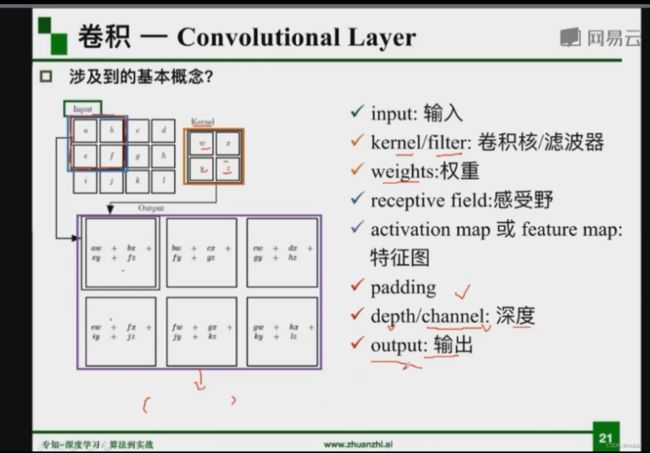

卷积

-

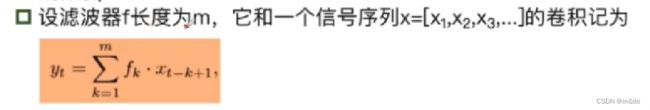

一维卷积

应用:信号处理,计算信号延迟累计

滤波器(卷积核) f=[f1,f2,f3]长度为m

信号序列 x=[x1,x2,x3,…]

卷积:

-

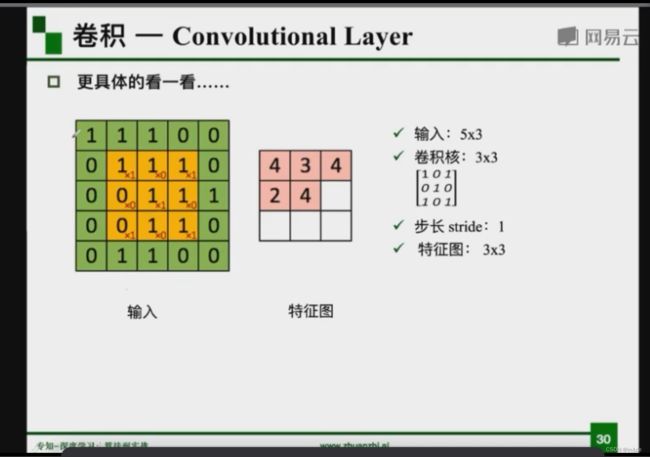

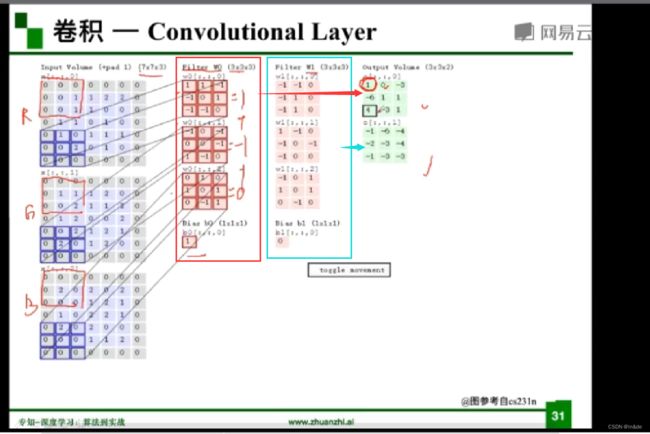

卷积的具体操作举例

输入有多个channel时,如(R,G,B),使用两个三维权重矩阵

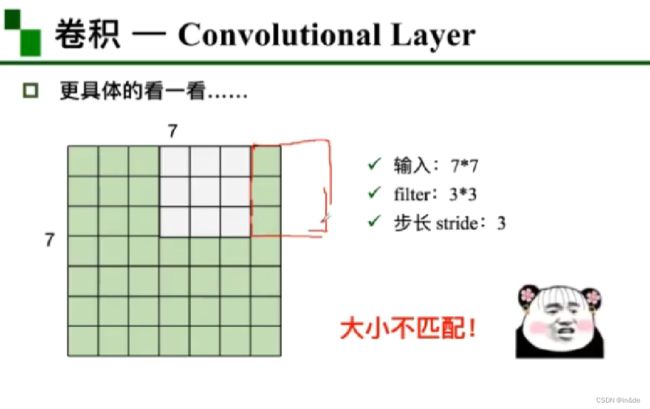

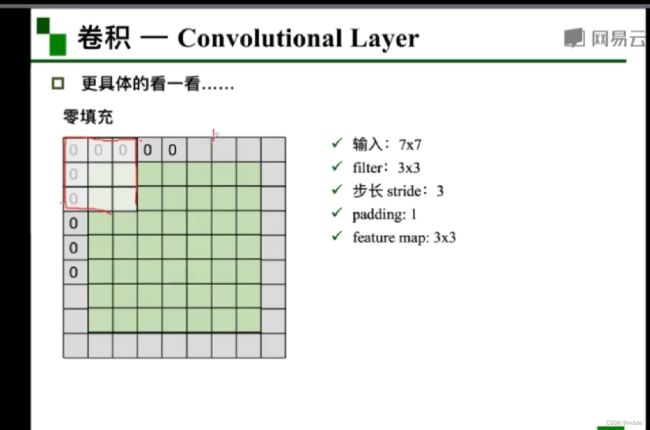

大小不匹配时,进行零填充(padding)

-

输出特征图的大小的计算

行列数=(N+padding*2-F)/stride+1

N–输入大小

F–卷积核大小

stride–步长

padding–填充大小 -

深度的概念;

depth/channel=filter个数 -

输出=特征图大小*深度

-

卷积的可视化理解:不同的卷积核关注不同的特征

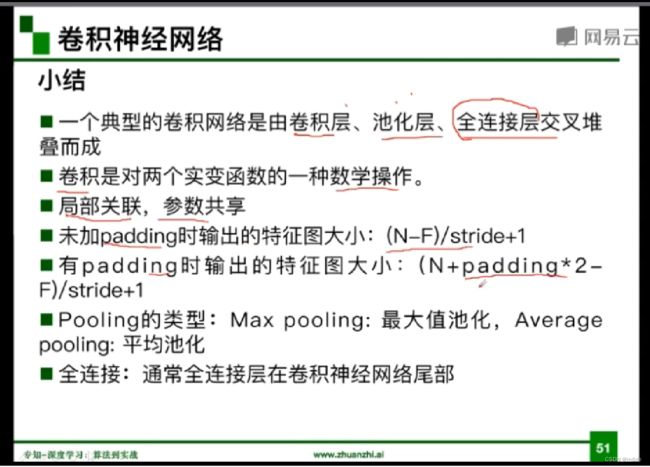

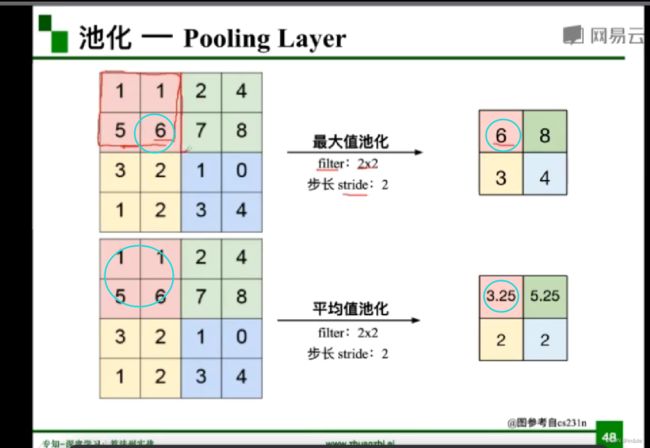

池化

- 相当于缩放,参数量0,有filter和stride

- 作用:保留主要特征,减少参数量和计算量,防止过拟合,提高模型泛化能力

- 位于卷积层与卷积层间、全连接层与全连接层之间

- 常用方法:

最大值池化(分类)

平均值池化

全连接

一般放在卷积神经网络的尾部,参数量大

小结

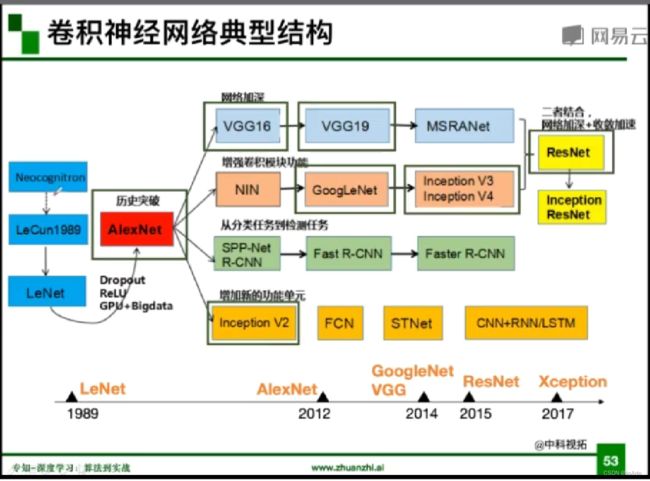

第二部分:卷积神经网络典型结构

发展历程

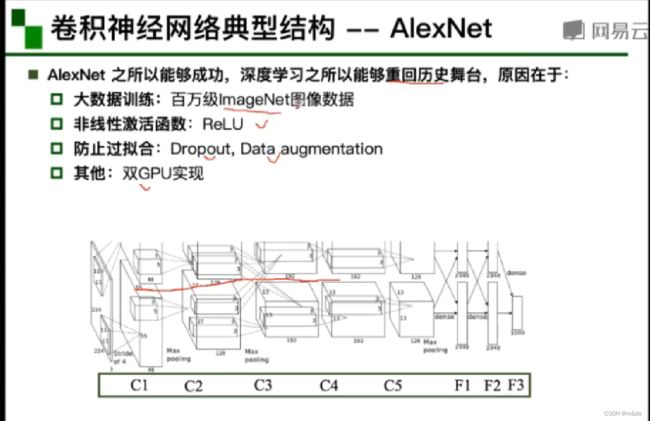

AlexNet

- 影响最大的是收敛速度

- 总结用到的一些优化方法:

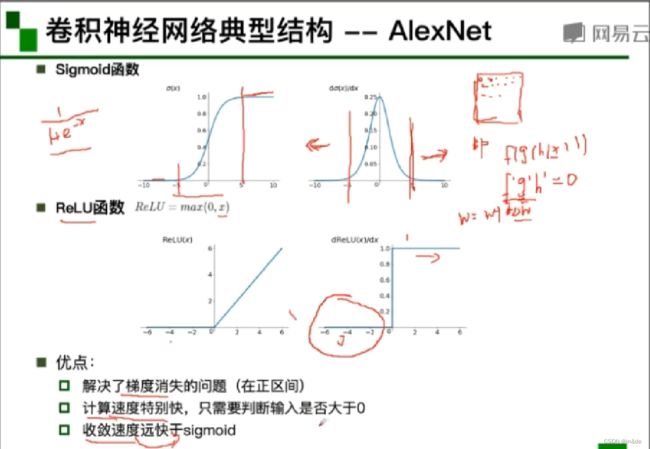

1.ReLU激活函数

2.DropOut(随机失活):从减少参数量方面考虑,训练时每次随机关闭一些神经元以降低参数量,整合时使用全部。

3.水平翻转:增加样本量

4.改变EGB通道强度:对rgb空间做高斯扰动。

VGG16

- VGG的思想:增加深度,通过固定参数实现训练

GoogleNet

是模型结构的改进:除了类别输出层没有额外的全连接层

- inception模块:通过多个卷积核增加特征多样性

inceptionV2:降维

inceptionV3:继续降维,裂变,用小的卷积核替代大的卷积核

优点:降低参数量;增加了非线性激活函数(裂变)

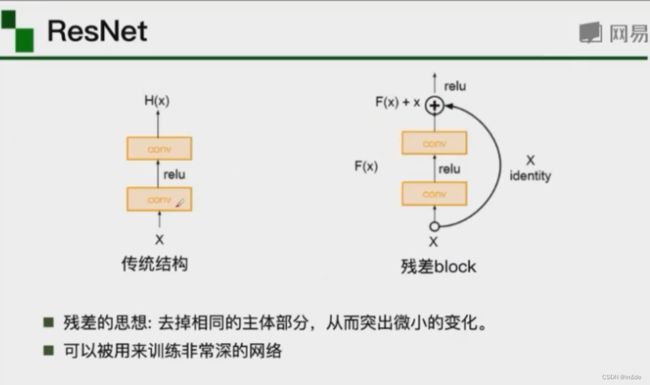

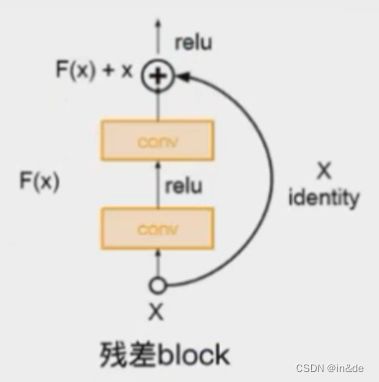

ResNet

残差学习网络,深度152层而无梯度消失问题,适用于很深的网络。

- 与传统卷积网络的差异

结构比较:

- 传统结构:复合函数f(h…)求导,结果是乘积形式。

残差block:f(h…)+x求导,结果为1+?的形式,解决了梯度消失问题。 - 灵活性考虑极端情况:

f(x)=0此时输出f(x)+x=x,可以自调节结构深度

疑问

1.为什么最大值池化更适用于分类问题?

2.filter和stride是如何选取的?

二、代码练习

(一)练习1 MNIST 数据集分类:构建简单的CNN对 mnist 数据集进行分类。

1.引入所需库,加载数据集(MNIST)

import torch

import torch.nn as nn

import torch.nn.functional as F

import torch.optim as optim

from torchvision import datasets, transforms

import matplotlib.pyplot as plt

import numpy

# 一个函数,用来计算模型中有多少参数

def get_n_params(model):

np=0

for p in list(model.parameters()):

np += p.nelement()

return np

# 使用GPU训练,可以在菜单 "代码执行工具" -> "更改运行时类型" 里进行设置

device = torch.device("cuda:0" if torch.cuda.is_available() else "cpu")

PyTorch里包含了 MNIST, CIFAR10 等常用数据集,调用 torchvision.datasets

即可把这些数据由远程下载到本地,下面给出MNIST的使用方法:torchvision.datasets.MNIST(root, train=True, transform=None,

target_transform=None, download=False) root 为数据集下载到本地后的根目录,包括

training.pt 和 test.pt 文件

train,如果设置为True,从training.pt创建数据集,否则从test.pt创建。 download,如果设置为True,

从互联网下载数据并放到root文件夹下 transform, 一种函数或变换,输入PIL图片,返回变换之后的数据。

target_transform 一种函数或变换,输入目标,进行变换。

另外值得注意的是,DataLoader是一个比较重要的类,提供的常用操作有:batch_size(每个batch的大小),

shuffle(是否进行随机打乱顺序的操作), num_workers(加载数据的时候使用几个子进程)

input_size = 28*28 # MNIST上的图像尺寸是 28x28

output_size = 10 # 类别为 0 到 9 的数字,因此为十类

train_loader = torch.utils.data.DataLoader(

datasets.MNIST('./data', train=True, download=True,

transform=transforms.Compose(

[transforms.ToTensor(),

transforms.Normalize((0.1307,), (0.3081,))])),

batch_size=64, shuffle=True)

test_loader = torch.utils.data.DataLoader(

datasets.MNIST('./data', train=False, transform=transforms.Compose([

transforms.ToTensor(),

transforms.Normalize((0.1307,), (0.3081,))])),

batch_size=1000, shuffle=True)

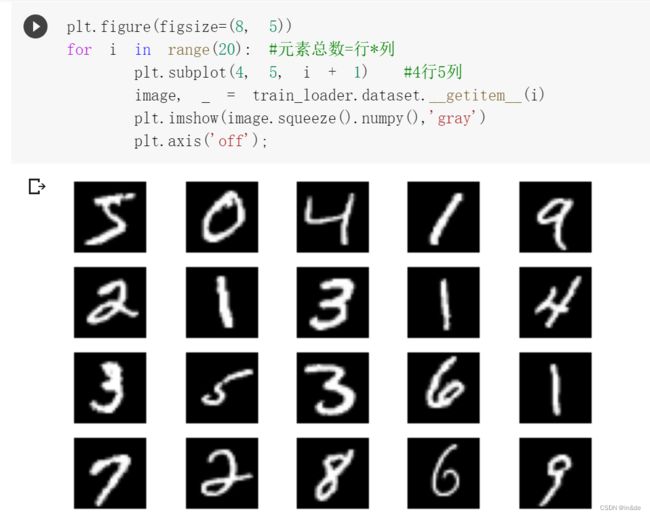

显示数据集中的部分图像

plt.figure(figsize=(8, 5))

for i in range(20): #元素总数=行*列

plt.subplot(4, 5, i + 1) #4行5列

image, _ = train_loader.dataset.__getitem__(i)

plt.imshow(image.squeeze().numpy(),'gray')

plt.axis('off');

2.构建网络

-

Softmax函数常用的用法是指定参数dim就可以:

(1)dim=0:对每一列的所有元素进行softmax运算,并使得每一列所有元素和为1。

(2)dim=1:对每一行的所有元素进行softmax运算,并使得每一行所有元素和为1。 -

LogSoftmax其实就是对softmax的结果进行log,即Log(Softmax(x))

LogSoftmax的作用:

速度变快,数据稳定(些值经过softmax后概率非常低, 会下溢出. 所以一般会取概率的log表示概率) -

forward 函数定义了网络的结构,按照一定顺序,把上面构建的一些结构组织起来。

-

x.view()将向量铺平,便于传入全连接层,比如使矩阵的每行存放一张图片的各个参数,即使每行对应一张图片。

-

网络层次:卷积-relu激活-池化-卷积-激活-池化-矩阵变形处理(便于传入全连接层)-全连接-激活-全连接-输出

class FC2Layer(nn.Module):

def __init__(self, input_size, n_hidden, output_size):

# nn.Module子类的函数必须在构造函数中执行父类的构造函数

# 下式等价于nn.Module.__init__(self)

super(FC2Layer, self).__init__()

self.input_size = input_size

# 这里直接用 Sequential 就定义了网络,注意要和下面 CNN 的代码区分开

self.network = nn.Sequential(

nn.Linear(input_size, n_hidden),

nn.ReLU(),

nn.Linear(n_hidden, n_hidden),

nn.ReLU(),

nn.Linear(n_hidden, output_size),

nn.LogSoftmax(dim=1) #Log(Softmax(x))

)

def forward(self, x):

# view一般出现在model类的forward函数中,用于改变输入或输出的形状

# x.view(-1, self.input_size) 的意思是多维的数据展成二维

# 代码指定二维数据的列数为 input_size=784,行数 -1 表示我们不想算,电脑会自己计算对应的数字

# 在 DataLoader 部分,我们可以看到 batch_size (行)是64,所以得到 x 的行数是64

# 大家可以加一行代码:print(x.cpu().numpy().shape)

# 训练过程中,就会看到 (64, 784) 的输出,和我们的预期是一致的

# forward 函数的作用是,指定网络的运行过程,这个全连接网络可能看不啥意义,

# 下面的CNN网络可以看出 forward 的作用。

x = x.view(-1, self.input_size)

return self.network(x)

class CNN(nn.Module):

def __init__(self, input_size, n_feature, output_size):

# 执行父类的构造函数,所有的网络都要这么写

super(CNN, self).__init__()

# 下面是网络里典型结构的一些定义,一般就是卷积和全连接

# 池化、ReLU一类的不用在这里定义

self.n_feature = n_feature

#卷积层

self.conv1 = nn.Conv2d(in_channels=1, out_channels=n_feature, kernel_size=5)

#输入、输出、卷积核

self.conv2 = nn.Conv2d(n_feature, n_feature, kernel_size=5)

#全连接层

self.fc1 = nn.Linear(n_feature*4*4, 50)

self.fc2 = nn.Linear(50, 10) #最后分为10类

# 下面的 forward 函数,定义了网络的结构,按照一定顺序,把上面构建的一些结构组织起来

# 意思就是,conv1, conv2 等等的,可以多次重用

def forward(self, x, verbose=False):

#卷积-relu激活-池化-卷积-激活-池化-矩阵变形处理(便于传入全连接层)-全连接-激活-全连接-输出

x = self.conv1(x)

x = F.relu(x)

x = F.max_pool2d(x, kernel_size=2)

x = self.conv2(x)

x = F.relu(x)

x = F.max_pool2d(x, kernel_size=2)

x = x.view(-1, self.n_feature*4*4)

x = self.fc1(x)

x = F.relu(x)

x = self.fc2(x)

x = F.log_softmax(x, dim=1)

return x

3.定义训练函数和测试函数

# 训练函数

def train(model):

model.train()

# 从train_loader里,64个样本一个batch为单位提取样本进行训练

for batch_idx, (data, target) in enumerate(train_loader):

# 把数据送到GPU中

data, target = data.to(device), target.to(device)

optimizer.zero_grad()

output = model(data)

loss = F.nll_loss(output, target)

loss.backward()

optimizer.step()

if batch_idx % 100 == 0:

print('Train: [{}/{} ({:.0f}%)]\tLoss: {:.6f}'.format(

batch_idx * len(data), len(train_loader.dataset),

100. * batch_idx / len(train_loader), loss.item()))

#测试

def test(model):

model.eval()

test_loss = 0

correct = 0

for data, target in test_loader:

# 把数据送到GPU中

data, target = data.to(device), target.to(device)

# 把数据送入模型,得到预测结果

output = model(data)

# 计算本次batch的损失,并加到 test_loss 中

test_loss += F.nll_loss(output, target, reduction='sum').item()

# get the index of the max log-probability,最后一层输出10个数,

# 值最大的那个即对应着分类结果,然后把分类结果保存在 pred 里

pred = output.data.max(1, keepdim=True)[1]

# 将 pred 与 target 相比,得到正确预测结果的数量,并加到 correct 中

# 这里需要注意一下 view_as ,意思是把 target 变成维度和 pred 一样的意思

correct += pred.eq(target.data.view_as(pred)).cpu().sum().item()

test_loss /= len(test_loader.dataset)

accuracy = 100. * correct / len(test_loader.dataset)

print('\nTest set: Average loss: {:.4f}, Accuracy: {}/{} ({:.0f}%)\n'.format(

test_loss, correct, len(test_loader.dataset),

accuracy))

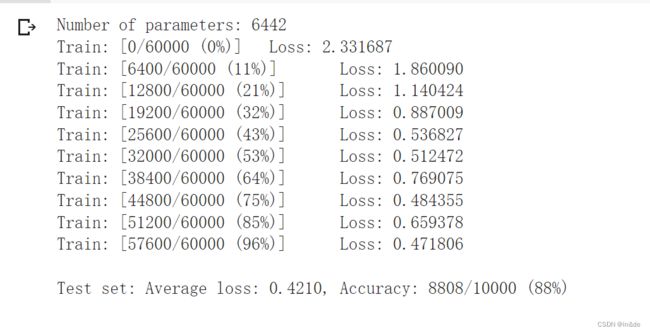

4.在小型全连接网络上训练(Fully-connected network)

n_hidden = 8 # number of hidden units隐藏层单元数

model_fnn = FC2Layer(input_size, n_hidden, output_size)#全连接层参数

model_fnn.to(device)#运行到GPU

optimizer = optim.SGD(model_fnn.parameters(), lr=0.01, momentum=0.5)

print('Number of parameters: {}'.format(get_n_params(model_fnn)))

train(model_fnn)

test(model_fnn)

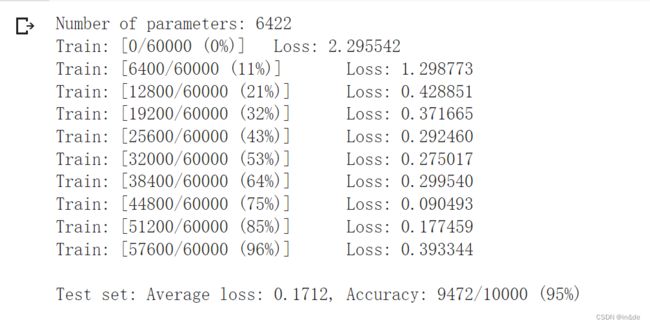

5.在卷积神经网络上训练

# Training settings 在卷积神经网络上训练

n_features = 6 # number of feature maps 特征图

model_cnn = CNN(input_size, n_features, output_size) #卷积神经网络参数

model_cnn.to(device)

optimizer = optim.SGD(model_cnn.parameters(), lr=0.01, momentum=0.5)

print('Number of parameters: {}'.format(get_n_params(model_cnn)))

train(model_cnn)

test(model_cnn)

通过上面的测试结果,可以发现,含有相同参数的 CNN 效果要明显优于 简单的全连接网络,是因为 CNN

能够更好的挖掘图像中的信息,主要通过两个手段:

- 卷积:Locality and stationarity in images

- 池化:Builds in some translation invariance

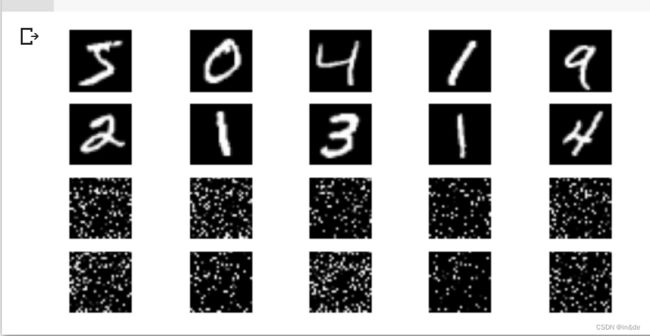

6.打乱像素顺序再次在两个网络上训练与测试

考虑到CNN在卷积与池化上的优良特性,如果我们把图像中的像素打乱顺序,这样 卷积 和 池化

就难以发挥作用了,为了验证这个想法,我们把图像中的像素打乱顺序再试试。

首先下面代码展示随机打乱像素顺序后,图像的形态:

# 这里解释一下 torch.randperm 函数,给定参数n,返回一个从0到n-1的随机整数排列

perm = torch.randperm(784)

plt.figure(figsize=(8, 4))

for i in range(10):

image, _ = train_loader.dataset.__getitem__(i)

# permute pixels随机排列像素顺序

image_perm = image.view(-1, 28*28).clone() #转化为二维矩阵

image_perm = image_perm[:, perm] #乱序

image_perm = image_perm.view(-1, 1, 28, 28) #恢复四维

#绘图

plt.subplot(4, 5, i + 1)

plt.imshow(image.squeeze().numpy(), 'gray')

plt.axis('off')

plt.subplot(4, 5, i + 11)

plt.imshow(image_perm.squeeze().numpy(), 'gray')

plt.axis('off')

重新定义训练与测试函数,我们写了两个函数 train_perm 和 test_perm,分别对应着加入像素打乱顺序的训练函数与测试函数。

与之前的训练与测试函数基本上完全相同,只是对 data 加入了打乱顺序操作。

# 对每个 batch 里的数据,打乱像素顺序的函数

def perm_pixel(data, perm):

# 转化为二维矩阵

data_new = data.view(-1, 28*28)

# 打乱像素顺序

data_new = data_new[:, perm]

# 恢复为原来4维的 tensor

data_new = data_new.view(-1, 1, 28, 28)

return data_new

# 训练函数

def train_perm(model, perm):

model.train()

for batch_idx, (data, target) in enumerate(train_loader):

data, target = data.to(device), target.to(device)

# 像素打乱顺序

data = perm_pixel(data, perm)

optimizer.zero_grad()

output = model(data)

loss = F.nll_loss(output, target)

loss.backward()

optimizer.step()

if batch_idx % 100 == 0:

print('Train: [{}/{} ({:.0f}%)]\tLoss: {:.6f}'.format(

batch_idx * len(data), len(train_loader.dataset),

100. * batch_idx / len(train_loader), loss.item()))

# 测试函数

def test_perm(model, perm):

model.eval()

test_loss = 0

correct = 0

for data, target in test_loader:

data, target = data.to(device), target.to(device)

# 像素打乱顺序

data = perm_pixel(data, perm)

output = model(data)

test_loss += F.nll_loss(output, target, reduction='sum').item()

pred = output.data.max(1, keepdim=True)[1]

correct += pred.eq(target.data.view_as(pred)).cpu().sum().item()

test_loss /= len(test_loader.dataset)

accuracy = 100. * correct / len(test_loader.dataset)

print('\nTest set: Average loss: {:.4f}, Accuracy: {}/{} ({:.0f}%)\n'.format(

test_loss, correct, len(test_loader.dataset),

accuracy))

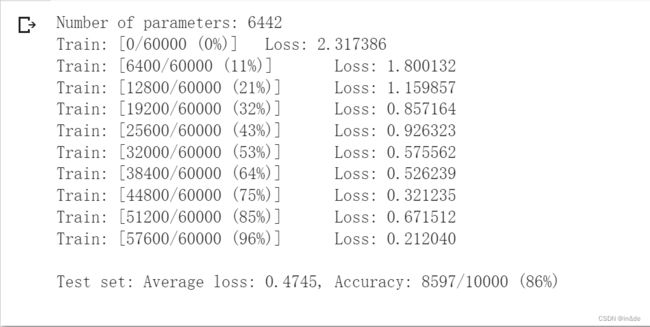

在全连接网络上训练与测试:

perm = torch.randperm(784)

n_hidden = 8 # number of hidden units

model_fnn = FC2Layer(input_size, n_hidden, output_size)

model_fnn.to(device)

optimizer = optim.SGD(model_fnn.parameters(), lr=0.01, momentum=0.5)

print('Number of parameters: {}'.format(get_n_params(model_fnn)))

train_perm(model_fnn, perm)

test_perm(model_fnn, perm)

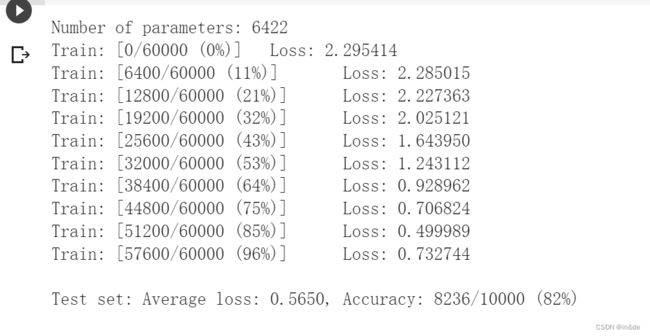

在卷积神经网络上训练与测试:

perm = torch.randperm(784)

n_features = 6 # number of feature maps

model_cnn = CNN(input_size, n_features, output_size)

model_cnn.to(device)

optimizer = optim.SGD(model_cnn.parameters(), lr=0.01, momentum=0.5)

print('Number of parameters: {}'.format(get_n_params(model_cnn)))

train_perm(model_cnn, perm)

test_perm(model_cnn, perm)

但是打乱像素顺序后,全连接网络的性能基本上没有发生变化,但是 卷积神经网络的性能明显下降。

这是因为对于卷积神经网络,会利用像素的局部关系,但是打乱顺序以后,这些像素间的关系将无法得到利用。

(二)练习2 CIFAR10 数据集分类:使用 CNN 对 CIFAR10 数据集进行分类

对于视觉数据,PyTorch 创建了一个叫做 totchvision 的包,该包含有支持加载类似Imagenet,CIFAR10,MNIST

等公共数据集的数据加载模块 torchvision.datasets 和支持加载图像数据数据转换模块

torch.utils.data.DataLoader。下面将使用CIFAR10数据集,它包含十个类别:‘airplane’, ‘automobile’, ‘bird’, ‘cat’,

‘deer’, ‘dog’, ‘frog’, ‘horse’, ‘ship’, ‘truck’。CIFAR-10

中的图像尺寸为3x32x32,也就是RGB的3层颜色通道,每层通道内的尺寸为32*32。

1.引入所需库,加载数据集(CIFAR10)

首先,加载并归一化 CIFAR10 使用 torchvision 。torchvision 数据集的输出是范围在[0,1]之间的 PILImage,我们将他们转换成归一化范围为[-1,1]之间的张量 Tensors。

import torch

import torchvision

import torchvision.transforms as transforms

import matplotlib.pyplot as plt

import numpy as np

import torch.nn as nn

import torch.nn.functional as F

import torch.optim as optim

# 使用GPU训练,可以在菜单 "代码执行工具" -> "更改运行时类型" 里进行设置

device = torch.device("cuda:0" if torch.cuda.is_available() else "cpu")

transform = transforms.Compose(

[transforms.ToTensor(),

transforms.Normalize((0.5, 0.5, 0.5), (0.5, 0.5, 0.5))])

# 注意下面代码中:训练的 shuffle 是 True,测试的 shuffle 是 false

# 训练时可以打乱顺序增加多样性,测试是没有必要

trainset = torchvision.datasets.CIFAR10(root='./data', train=True,

download=True, transform=transform)

trainloader = torch.utils.data.DataLoader(trainset, batch_size=64,

shuffle=True, num_workers=2)

testset = torchvision.datasets.CIFAR10(root='./data', train=False,

download=True, transform=transform)

testloader = torch.utils.data.DataLoader(testset, batch_size=8,

shuffle=False, num_workers=2)

classes = ('plane', 'car', 'bird', 'cat',

'deer', 'dog', 'frog', 'horse', 'ship', 'truck')

展示 CIFAR10 里面的一些图片

def imshow(img):

plt.figure(figsize=(8,8))

img = img / 2 + 0.5 # 转换到 [0,1] 之间

npimg = img.numpy()

plt.imshow(np.transpose(npimg, (1, 2, 0)))

plt.show()

# 得到一组图像

images, labels = iter(trainloader).next()

# 展示图像

imshow(torchvision.utils.make_grid(images))

# 展示第一行图像的标签

for j in range(8):

print(classes[labels[j]])

结果:

2.定义网络,损失函数和优化器:

class Net(nn.Module):

def __init__(self):

super(Net, self).__init__()

self.conv1 = nn.Conv2d(3, 6, 5)

self.pool = nn.MaxPool2d(2, 2)

self.conv2 = nn.Conv2d(6, 16, 5)

self.fc1 = nn.Linear(16 * 5 * 5, 120)

self.fc2 = nn.Linear(120, 84)

self.fc3 = nn.Linear(84, 10)

def forward(self, x):

x = self.pool(F.relu(self.conv1(x)))

x = self.pool(F.relu(self.conv2(x)))

x = x.view(-1, 16 * 5 * 5)

x = F.relu(self.fc1(x))

x = F.relu(self.fc2(x))

x = self.fc3(x)

return x

# 网络放到GPU上

net = Net().to(device)

criterion = nn.CrossEntropyLoss()

optimizer = optim.Adam(net.parameters(), lr=0.001)

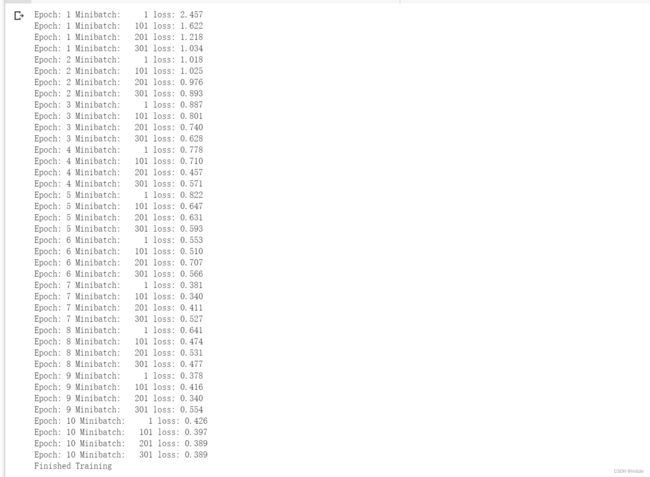

3.训练和测试

训练网络

for epoch in range(10): # 重复多轮训练

for i, (inputs, labels) in enumerate(trainloader):

inputs = inputs.to(device)

labels = labels.to(device)

# 优化器梯度归零

optimizer.zero_grad()

# 正向传播 + 反向传播 + 优化

outputs = net(inputs)

loss = criterion(outputs, labels)

loss.backward()

optimizer.step()

# 输出统计信息

if i % 100 == 0:

print('Epoch: %d Minibatch: %5d loss: %.3f' %(epoch + 1, i + 1, loss.item()))

print('Finished Training')

从测试集中取出8张图片:

# 得到一组图像

images, labels = iter(testloader).next()

# 展示图像

imshow(torchvision.utils.make_grid(images))

# 展示图像的标签

for j in range(8):

print(classes[labels[j]])

outputs = net(images.to(device))

_, predicted = torch.max(outputs, 1)

# 展示预测的结果

for j in range(8):

print(classes[predicted[j]])

correct = 0

total = 0

for data in testloader:

images, labels = data

images, labels = images.to(device), labels.to(device)

outputs = net(images)

_, predicted = torch.max(outputs.data, 1)

total += labels.size(0)

correct += (predicted == labels).sum().item()

print('Accuracy of the network on the 10000 test images: %d %%' % (

100 * correct / total))

(三)练习3 使用 VGG16 对 CIFAR10 分类

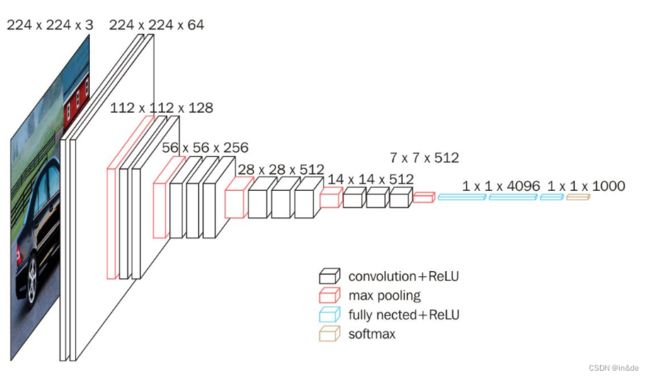

VGG16介绍

VGG是由Simonyan 和Zisserman在文献《Very Deep Convolutional Networks for Large

Scale Image Recognition》中提出卷积神经网络模型,其名称来源于作者所在的牛津大学视觉几何组(Visual

Geometry Group)的缩写。该模型参加2014年的 ImageNet图像分类与定位挑战赛,取得了优异成绩:在分类任务上排名第二,在定位任务上排名第一。

VGG16的网络结构如下图所示:

16层网络的结节信息如下:

01:Convolution using 64 filters

02: Convolution using 64 filters + Max pooling

03: Convolution using 128 filters

04: Convolution using 128 filters + Max pooling

05: Convolution using 256 filters

06: Convolution using 256 filters

07: Convolution using 256 filters + Max pooling

08: Convolution using 512 filters

09: Convolution using 512 filters

10: Convolution using 512 filters + Max pooling

11: Convolution using 512 filters

12: Convolution using 512 filters

13: Convolution using 512 filters + Max pooling

14: Fully connected with 4096 nodes

15: Fully connected with 4096 nodes

16: Softmax

1. 定义 dataloader

import torch

import torchvision

import torchvision.transforms as transforms

import matplotlib.pyplot as plt

import numpy as np

import torch.nn as nn

import torch.nn.functional as F

import torch.optim as optim

# 使用GPU训练,可以在菜单 "代码执行工具" -> "更改运行时类型" 里进行设置

device = torch.device("cuda:0" if torch.cuda.is_available() else "cpu")

transform_train = transforms.Compose([

transforms.RandomCrop(32, padding=4),

transforms.RandomHorizontalFlip(),

transforms.ToTensor(),

transforms.Normalize((0.4914, 0.4822, 0.4465), (0.2023, 0.1994, 0.2010))])

transform_test = transforms.Compose([

transforms.ToTensor(),

transforms.Normalize((0.4914, 0.4822, 0.4465), (0.2023, 0.1994, 0.2010))])

trainset = torchvision.datasets.CIFAR10(root='./data', train=True, download=True, transform=transform_train)

testset = torchvision.datasets.CIFAR10(root='./data', train=False, download=True, transform=transform_test)

trainloader = torch.utils.data.DataLoader(trainset, batch_size=128, shuffle=True, num_workers=2)

testloader = torch.utils.data.DataLoader(testset, batch_size=128, shuffle=False, num_workers=2)

classes = ('plane', 'car', 'bird', 'cat',

'deer', 'dog', 'frog', 'horse', 'ship', 'truck')

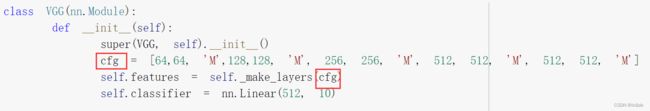

2.定义VGG网络

class VGG(nn.Module):

def __init__(self):

super(VGG, self).__init__()

cfg = [64,64, 'M',128,128, 'M', 256, 256, 'M', 512, 512, 'M', 512, 512, 'M']

self.features = self._make_layers(cfg)

self.classifier = nn.Linear(512, 10)

def forward(self, x):

out = self.features(x)

out = out.view(out.size(0), -1)

out = self.classifier(out)

return out

def _make_layers(self, cfg):

layers = []

in_channels = 3

for x in cfg:

if x == 'M':

layers += [nn.MaxPool2d(kernel_size=2, stride=2)] #池化

else:

layers += [nn.Conv2d(in_channels, x, kernel_size=3, padding=1), #卷积

nn.BatchNorm2d(x),

nn.ReLU(inplace=True)]

in_channels = x

layers += [nn.AvgPool2d(kernel_size=1, stride=1)]

return nn.Sequential(*layers)

# 网络放到GPU上

net = VGG().to(device)

criterion = nn.CrossEntropyLoss()

optimizer = optim.Adam(net.parameters(), lr=0.001)

3.网络训练

for epoch in range(10): # 重复多轮训练

for i, (inputs, labels) in enumerate(trainloader):

inputs = inputs.to(device)

labels = labels.to(device)

# 优化器梯度归零

optimizer.zero_grad()

# 正向传播 + 反向传播 + 优化

outputs = net(inputs)

loss = criterion(outputs, labels)

loss.backward()

optimizer.step()

# 输出统计信息

if i % 100 == 0:

print('Epoch: %d Minibatch: %5d loss: %.3f' %(epoch + 1, i + 1, loss.item()))

print('Finished Training')

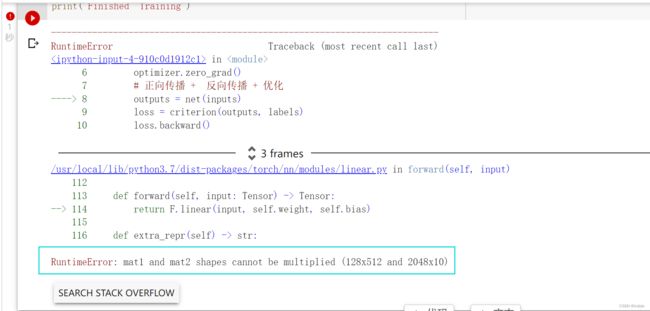

一开始报了矩阵乘法错误,显然两个矩阵的行列不匹配,这里返回上一步修改2048为512,可以正常运行了。

运行结果:

4.测试验证准确率

correct = 0

total = 0

for data in testloader:

images, labels = data

images, labels = images.to(device), labels.to(device)

outputs = net(images)

_, predicted = torch.max(outputs.data, 1)

total += labels.size(0)

correct += (predicted == labels).sum().item()

print('Accuracy of the network on the 10000 test images: %.2f %%' % (

100 * correct / total))

结果:

![]()

可以看到,使用一个简化版的 VGG 网络,就能够显著地将准确率由 63%,提升到 83%。

三、本周写博客需要思考的问题:

5、residual leanring 为什么能够提升准确率?

(1)不会存在梯度消失问题,可以用来训练非常深的网络结构

如图所示ResNet的输出不再是一个复合函数的形式,而是加了一个x,这样求导的结果就不是一个乘积的形式,而是加了一个1,解决了梯度消失的问题。

(2)是一个非常灵活的结构,可以自适应去学习应有的网络深度

如上图所示,输入x,当输出f(x)=0时,f(x)+x=x。

6、代码练习二里,网络和1989年 Lecun 提出的 LeNet 有什么区别?

激活函数不同,LeNet使用sigmoid激活函数,代码练习二中使用ReLu激活函数;

网络结构略有不同,比如池化的方法、全连接层的个数。

7、代码练习二里,卷积以后feature map 尺寸会变小,如何应用 Residual Learning?

令padding=1,进行零填充。

8、有什么方法可以进一步提升准确率?

使用Dropout防止过拟合;

选用更合适的池化方法,比如最大值池化更适合分类问题;

增加数据集的数据量,对于图片数据,可以采用平移、翻转等方法使数据倍增;

增加residual learning网络的深度;

选用更合适的损失函数和激活函数;