Kubernetes详细笔记

Kubernetes

1、Kubernetes介绍

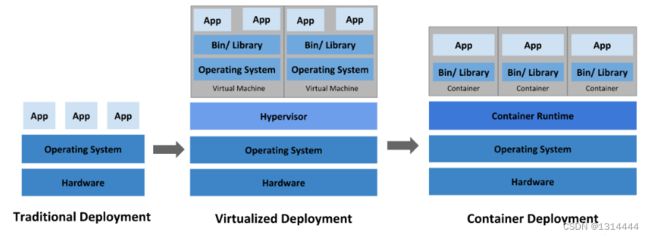

1.1、应用部署方式演变

- 传统部署:互联网早期,会直接将应用程序部署在物理机上

优点:简单,不需要其它技术的参与

缺点:不能为应用程序定义资源使用边界,很难合理地分配计算资源,而且程序之间容易产生影响

- 虚拟化部署:可以在一台物理机上运行多个虚拟机,每个虚拟机都是独立的一个环境

优点:程序环境不会相互产生影响,提供了一定程度的安全性

缺点:增加了操作系统,浪费了部分资源

- 容器化部署:与虚拟化类似,但是共享了操作系统

优点:可以保证每个容器拥有自己的文件系统、CPU、内存、进程空间等

运行应用程序所需要的资源都被容器包装,并和底层基础架构解耦

容器化的应用程序可以跨云服务商、跨Linux操作系统发行版进行部署

- 容器化部署方式给带来很多的便利,但是也会出现一些问题,比如说:

一个容器故障停机了,怎么样让另外一个容器立刻启动去替补停机的容器

当并发访问量变大的时候,怎么样做到横向扩展容器数量

- 这些容器管理的问题统称为容器编排问题,为了解决这些容器编排问题,就产生了一些容器编排的软件:

Swarm:Docker自己的容器编排工具

Mesos:Apache的一个资源统一管控的工具,需要和Marathon结合使用

Kubernetes:Google开源的的容器编排工具

1.2、kubernetes简介

kubernetes,是一个全新的基于容器技术的分布式架构领先方案,是谷歌严格保密十几年的秘密武器----Borg系统的一个开源版本,于2014年9月发布第一个版本,2015年7月发布第一个正式版本。

kubernetes的本质是一组服务器集群,它可以在集群的每个节点上运行特定的程序,来对节点中的容器进行管理。目的是实现资源管理的自动化,主要提供了如下的主要功能:

- 自我修复:一旦某一个容器崩溃,能够在1秒中左右迅速启动新的容器

- 弹性伸缩:可以根据需要,自动对集群中正在运行的容器数量进行调整

- 服务发现:服务可以通过自动发现的形式找到它所依赖的服务

- 负载均衡:如果一个服务起动了多个容器,能够自动实现请求的负载均衡

- 版本回退:如果发现新发布的程序版本有问题,可以立即回退到原来的版本

- 存储编排:可以根据容器自身的需求自动创建存储卷

1.3、kubernetes组件

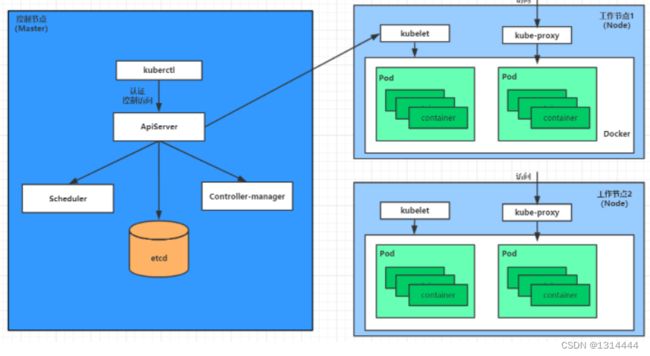

一个kubernetes集群主要是由控制节点(master)、工作节点(node) 构成,每个节点上都会安装不同的组件。

- master:集群的控制平面,负责集群的决策 ( 管理 )

ApiServer : 资源操作的唯一入口,接收用户输入的命令,提供认证、授权、API注册和发现等机制

Scheduler : 负责集群资源调度,按照预定的调度策略将Pod调度到相应的node节点上

ControllerManager : 负责维护集群的状态,比如程序部署安排、故障检测、自动扩展、滚动更新等

Etcd :负责存储集群中各种资源对象的信息

- node:集群的数据平面,负责为容器提供运行环境

Kubelet : 负责维护容器的生命周期,即通过控制docker,来创建、更新、销毁容器

KubeProxy : 负责提供集群内部的服务发现和负载均衡

Docker : 负责节点上容器的各种操作

下面,以部署一个nginx服务来说明kubernetes系统各个组件调用关系:

1.首先要明确,一旦kubernetes环境启动之后,master和node都会将自身的信息存储到etcd数据库中

2.一个nginx服务的安装请求会首先被发送到master节点的apiServer组件

3.apiServer组件会调用scheduler组件来决定到底应该把这个服务安装到哪个node节点上。

在此时,它会从etcd中读取各个node节点的信息,然后按照一定的算法进行选择,并将结果告知apiServer4.apiServer调用controller-manager去调度Node节点安装nginx服务

5.kubelet接收到指令后,会通知docker,然后由docker来启动一个nginx的pod

pod是kubernetes的最小操作单元,容器必须跑在pod中至此,6.一个nginx服务就运行了,如果需要访问nginx,就需要通过kube-proxy来对pod产生访问的代理

这样,外界用户就可以访问集群中的nginx服务了

1.4、kubernetes概念

Master:集群控制节点,每个集群需要至少一个master节点负责集群的管控

Node:工作负载节点,由master分配容器到这些node工作节点上,然后node节点上的docker负责容器的运行

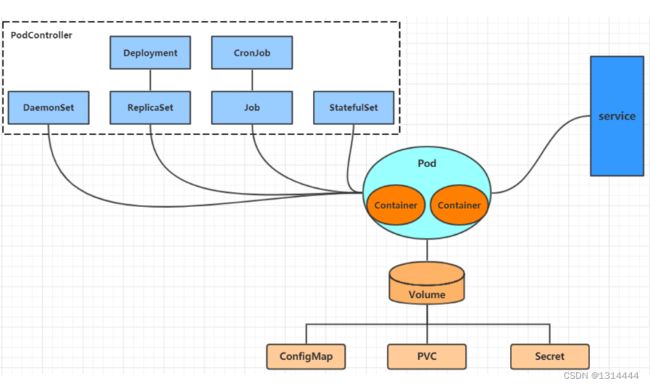

Pod:kubernetes的最小控制单元,容器都是运行在pod中的,一个pod中可以有1个或者多个容器

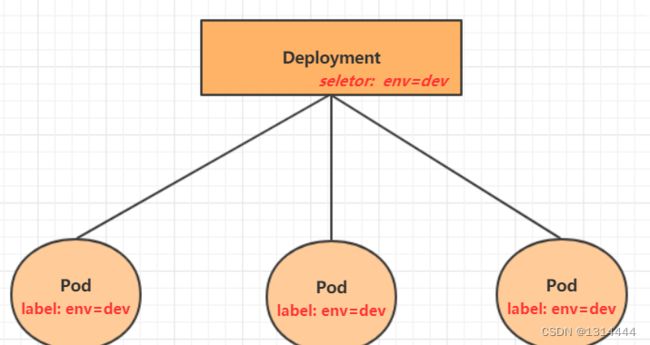

Controller:控制器,通过它来实现对pod的管理,比如启动pod、停止pod、伸缩pod的数量等等

Service:pod对外服务的统一入口,下面可以维护者同一类的多个pod

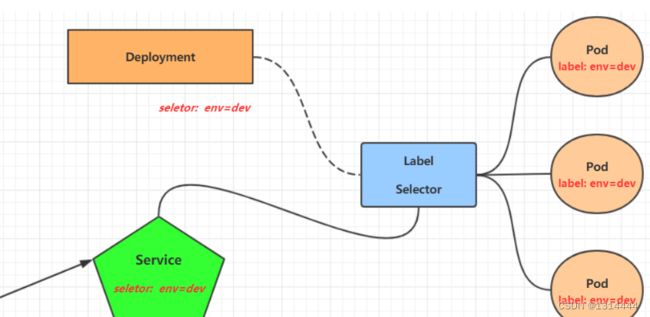

Label:标签,用于对pod进行分类,同一类pod会拥有相同的标签

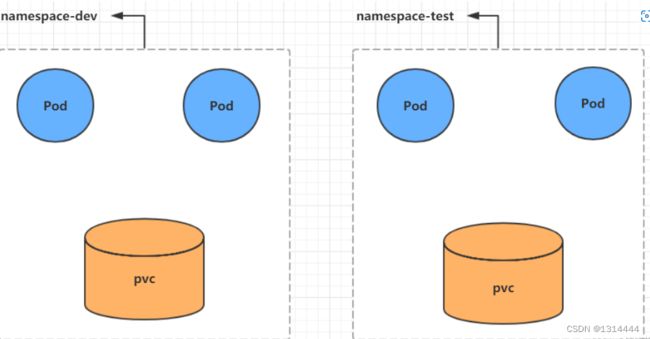

NameSpace:命名空间,用来隔离pod的运行环境

2、集群环境搭建

2.1、环境规划

2.1.1、集群类型

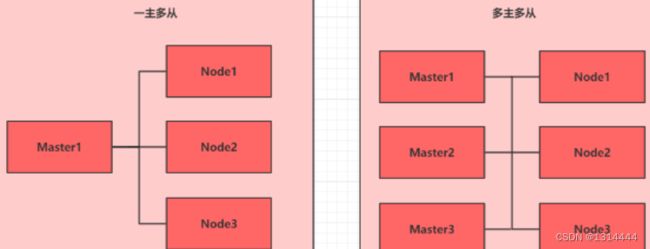

kubernetes集群大体上分为两类:一主多从和多住多从

2.1.2、安装方式

kubernets有多种部署方式,目前主流的方式有kubeadm、minikube、二进制包

-

minikube:一个用于快速搭建单节点kubernetes的工具

-

kubeadm:一个用于快速搭建kubernetes集群的工具

- https://kubernetes.io/docs/reference/setup-tools/kubeadm/kubeadm/

-

二进制包:从官网下载每个组件的二进制包,依次去安装,此方式对于理解kubernetes组件更加有效

- https://github.com/kubernetes/kubernetes

说明:现在需要安装kubernetes的集群环境,但是又不想过于麻烦,所有选择使用kubeadm方式

2.1.3、安装要求

在开始之前,部署Kubernetes集群机器需要满足以下几个条件:

至少3台机器,操作系统 centos

硬件配置:2GB或更多RAM,2个CPU或更多CPU,硬盘20GB或更多

集群中所有机器之间网络互通

可以访问外网,需要拉取镜像

禁止swap分区

| 主机名称(hostname) | 主机用途 | IP地址 | 软件环境 |

|---|---|---|---|

| k8s-master-100 | k8s master节点 | 192.168.109.100 | centos7.5,docker,kubectl,kubeadm,kubelet |

| k8s-node01-101 | k8s worker 节点 | 192.168.109.101 | centos7.5,docker,kubectl,kubeadm |

| k8s-node02-102 | k8s worker 节点 | 192.168.109.102 | centos7.5,docker,kubectl,kubeadm |

2.2、环境搭建

本次环境搭建需要安装三台linux系统(一主二从),内置Centos7.5系统,然后在每台liunx中分别安装docker(20.16.3)。kubeadm(1.20.0),kubelet(1.20.0),kubelet(1.20.0)。

2.2.1、主机安装

-

安装虚拟机过程中注意下面选项的设置:

-

操作系统环境:CPU (2C)内存(2G)硬盘(30G)

-

语言选择:中文简体

-

软件选择:基础设施服务器

-

分区选择:自动分区

-

网络配置:按照下面配置网路地址信息

网络地址:192.168.109.108(每台主机都不一样惇分别为100、101、102)

子网掩码:255.255.255.0

默认网关:192.168.109.2

DNS:223.5.5.5

- 主机名设置:按照下面信息设置主机名

master节点:master

node节点:node1

node节点:node2

2.2.2、环境初始化

1)~ 8)每台都要进行配置 9)~11) 只在master端配置

1)修改主机名

hostnamectl set-hostname master

2)检查操作系统的版本

# 此方式下安装kubernetes集群要求Centos版本要在7.5或之上

cat /etc/redhat-release

4)主机名解析

为了方便集群节点间的直接调用,在这个配置一下主机名解析,企业中推荐使用内部DNS服务器

# 主机名成解析 编辑三台服务器的/etc/hosts文件,添加下面内容

cat >> /etc/hosts << EOF

192.168.129.250 master

192.168.129.135 node1

192.168.129.136 node2

EOF

5) 时间同步

kubernetes要求集群中的节点时间必须精确一致,这里使用chronyd服务从网络同步时间

企业中建议配置内部的时间同步服务器

# 启动chronyd服务

yum -y install chrony

sed -i 's/2.centos.pool.ntp.org/time1.aliyun.com/' /etc/chrony.conf #用ailiyun时间同步

systemctl enable --now chronyd

date

6) 禁用iptable和firewalld服务

kubernetes和docker 在运行的中会产生大量的iptables规则,为了不让系统规则跟它们混淆,直接关闭系统的规则

# 1 关闭firewalld服务

systemctl disable --now firewalld

# 2 关闭iptables服务

systemctl disable --now iptables

7) 禁用selinux

selinux是linux系统下的一个安全服务,如果不关闭它,在安装集群中会产生各种各样的奇葩问题

sed -i 's/enforcing/disabled/' /etc/selinux/config

8) 禁用swap分区

swap分区指的是虚拟内存分区,它的作用是物理内存使用完,之后将磁盘空间虚拟成内存来使用,启用swap设备会对系统的性能产生非常负面的影响,因此kubernetes要求每个节点都要禁用swap设备,但是如果因为某些原因确实不能关闭swap分区,就需要在集群安装过程中通过明确的参数进行配置说明

# 编辑分区配置文件/etc/fstab,注释掉swap分区一行

# 注意修改完毕之后需要重启linux服务

vim /etc/fstab

UUID=ca3c6953-8c52-4d28-8798-b28bd0a6820a /boot xfs defaults 0 0

#/dev/mapper/centos-swap swap swap defaults 0 0 #注释此行

注释掉 /dev/mapper/centos-swap swap

或者使用 sed -i.bak '/swap/s/^/#/' /etc/fstab

reboot(必须要重启)

9) 修改linux的内核参数

只在master上添加,做将桥接的IPv4流量传递到iptables的链

# 修改linux的内核采纳数,添加网桥过滤和地址转发功能

# 编辑/etc/sysctl.d/kubernetes.conf文件,添加如下配置:

[root@master ~]# cat > /etc/sysctl.d/kubernetes.conf << EOF

net.bridge.bridge-nf-call-ip6tables = 1

net.bridge.bridge-nf-call-iptables = 1

net.ipv4.ip_forward = 1

EOF

# 加载网桥过滤模块

[root@master ~]# modprobe br_netfilter

# 重新加载配置

[root@master ~]# sysctl -p /etc/sysctl.d/kubernetes.conf

# 查看网桥过滤模块是否加载成功

[root@master ~]# lsmod | grep br_netfilter

# 生效

[root@master ~]# sysctl --system

10 )配置ipvs功能

在Kubernetes中Service有两种带来模型,一种是基于iptables的,一种是基于ipvs的两者比较的话,ipvs的性能明显要高一些,但是如果要使用它,需要手动载入ipvs模块

只在master上添加

# 1.安装ipset和ipvsadm

[root@master ~]# yum install ipset ipvsadm -y

# 2.添加需要加载的模块写入脚本文件

[root@master ~]# cat < /etc/sysconfig/modules/ipvs.modules

#!/bin/bash

modprobe -- ip_vs

modprobe -- ip_vs_rr

modprobe -- ip_vs_wrr

modprobe -- ip_vs_sh

modprobe -- nf_conntrack_ipv4

EOF

# 3.为脚本添加执行权限

[root@master ~]# chmod +x /etc/sysconfig/modules/ipvs.modules

# 4.执行脚本文件

[root@master ~]# /bin/bash /etc/sysconfig/modules/ipvs.modules

# 5.查看对应的模块是否加载成功

[root@master ~]# lsmod | grep -e ip_vs -e nf_conntrack_ipv4

11)免密登录

在master上操作

# 生成秘钥

[root@master ~]# ssh-keygen -t rsa

#将公钥发送给各个用户端

[root@master ~]# ssh-copy-id master

[root@master ~]# ssh-copy-id node1

[root@master ~]# ssh-copy-id node2

# 测试互通性

for i in master node1 node2;do ssh root@$i "date";done

2.2.3、安装docker

每台都要进行配置

# 1、切换镜像源

yum -y install wget

wget https://mirrors.aliyun.com/docker-ce/linux/centos/docker-ce.repo -O /etc/yum.repos.d/docker-ce.repo

# 2、查看当前镜像源中支持的docker版本

yum list docker-ce --showduplicates

# 3、安装特定版本的docker-ce

# 必须制定--setopt=obsoletes=0,否则yum会自动安装更高版本

yum install --setopt=obsoletes=0 docker-ce-3:20.10.16-3.el7 -y

# 4、添加一个配置文件

#Docker 在默认情况下使用Vgroup Driver为cgroupfs,而Kubernetes推荐使用systemd来替代cgroupfs

mkdir /etc/docker

cat <<EOF> /etc/docker/daemon.json

{

"exec-opts": ["native.cgroupdriver=systemd"],

"registry-mirrors": ["https://kn0t2bca.mirror.aliyuncs.com"]

}

EOF

# 5、启动dokcer

systemctl enable --now docker

2.2.4、安装Kubernetes组件

每台都要进行配置

# 1、由于kubernetes的镜像在国外,速度比较慢,这里切换成国内的镜像源

# 2、编辑/etc/yum.repos.d/kubernetes.repo,添加下面的配置

cat <<EOF > /etc/yum.repos.d/kubernetes.repo

[kubernetes]

name=Kubernetes

baseurl=http://mirrors.aliyun.com/kubernetes/yum/repos/kubernetes-el7-x86_64

enabled=1

gpgchech=0

repo_gpgcheck=0

gpgkey=http://mirrors.aliyun.com/kubernetes/yum/doc/yum-key.gpg

http://mirrors.aliyun.com/kubernetes/yum/doc/rpm-package-key.gpg

EOF

# 3、安装kubeadm、kubelet和kubectl

yum install --setopt=obsoletes=0 kubelet-1.20.0 kubeadm-1.20.0 kubectl-1.20.0 -y

# 4、配置kubelet的cgroup

#编辑/etc/sysconfig/kubelet, 添加下面的配置

cat <<EOF > /etc/sysconfig/kubelet

KUBELET_CGROUP_ARGS="--cgroup-driver=systemd"

KUBE_PROXY_MODE="ipvs"

EOF

# 5、设置kubelet开机自启

systemctl enable kubelet

2.2.5、准备集群镜像(网络没问题可忽略这一步)

此镜像kubernetes的仓库中,由于网络原因,无法连接,下面提供了一种替换方案

# 在安装kubernetes集群之前,必须要提前准备好集群需要的镜像,所需镜像可以通过下面命令查看

[root@master ~]# kubeadm config images list

# 下载镜像

vi pull-k8s-images.sh

images=(

kube-apiserver:v1.20.0

kube-controller-manager:v1.20.0

kube-scheduler:v1.20.0

kube-proxy:v1.20.0

pause:3.2

etcd:3.4.13-0

coredns:1.7.0

)

for imageName in ${images[@]};do

docker pull registry.cn-hangzhou.aliyuncs.com/google_containers/$imageName

docker tag registry.cn-hangzhou.aliyuncs.com/google_containers/$imageName k8s.gcr.io/$imageName

docker rmi registry.cn-hangzhou.aliyuncs.com/google_containers/$imageName

done

2.2.6、集群初始化

只需要在master节点上执行即可

-

apiserver-advertise-address 集群通告地址

-

image-repository 由于默认拉取镜像地址k8s.gcr.io国内无法访问,这里指定阿里云镜像仓库地址。

-

kubernetes-version K8s版本,与上面安装的一致

-

service-cidr 集群内部虚拟网络,Pod统一访问入口

-

pod-network-cidr Pod网络,与下面部署的CNI网络组件yaml中保持一致

-

--token-ttl 默认的token有效期24小时, 设置为0表示永不过期

# 创建集群

[root@master ~]# kubeadm init \

--apiserver-advertise-address=192.168.129.157 \

--image-repository k8s.gcr.io \

--kubernetes-version=v1.20.0 \

--service-cidr=10.96.0.0/12 \

--pod-network-cidr=10.244.0.0/16 \

--token-ttl=0

# 创建必要文件

[root@master ~]# mkdir -p $HOME/.kube

[root@master ~]# sudo cp -i /etc/kubernetes/admin.conf $HOME/.kube/config

[root@master ~]# sudo chown $(id -u):$(id -g) $HOME/.kube/config

下面的操作只需要在node节点上执行即可

kubeadm join 192.168.109.100:6443 --token hglo7o.0ya3tbi82wqdjif4 \

--discovery-token-ca-cert-hash sha256:f6be891c6cd273a9283a6c05ca795811f7350afa2b5072990a294b7070ff9a4f

默认token有效期为24小时,当过期之后,该token就不可用了。这时就需要重新创建token,操作如下:

kubeadm token create --print-join-command

2.2.7、安装网络插件

kubernetes支持多种网络插件,比如flannel、calico、canal等等,任选一种使用即可,本次选择flannel

只需要在master节点上执行即可,插件使用的是DaemonSet的控制器,它会在每个节点上都运行

方案1

# 获取fannel的配置文件

wget https://raw.githubusercontent.com/coreos/flannel/master/Documentation/kube-flannel.yml

# 如果出现无法访问的情况,可以直接用下面的 记得文件名是kube-flannel.yml,位置:/root/kube-flannel.yml内容:

https://github.com/flannel-io/flannel/tree/master/Documentation/kube-flannel.yml

# 修改文件中quay.io仓库为quay-mirror.qiniu.com

# 使用配置文件启动fannel

kubectl apply -f kube-flannel.yml

# 再次查看集群节点的状态

kubectl get nodes

方案2

cat /etc/hosts //添加如下内容

echo "199.232.96.133 raw.githubusercontent.com" >> /etc/hosts

[root@master ~]# kubectl apply -f https://raw.githubusercontent.com/coreos/flannel/master/Documentation/kube-flannel.yml

---

apiVersion: policy/v1beta1

kind: PodSecurityPolicy

metadata:

name: psp.flannel.unprivileged

annotations:

seccomp.security.alpha.kubernetes.io/allowedProfileNames: docker/default

seccomp.security.alpha.kubernetes.io/defaultProfileName: docker/default

apparmor.security.beta.kubernetes.io/allowedProfileNames: runtime/default

apparmor.security.beta.kubernetes.io/defaultProfileName: runtime/default

spec:

privileged: false

volumes:

- configMap

- secret

- emptyDir

- hostPath

allowedHostPaths:

- pathPrefix: "/etc/cni/net.d"

- pathPrefix: "/etc/kube-flannel"

- pathPrefix: "/run/flannel"

readOnlyRootFilesystem: false

# Users and groups

runAsUser:

rule: RunAsAny

supplementalGroups:

rule: RunAsAny

fsGroup:

rule: RunAsAny

# Privilege Escalation

allowPrivilegeEscalation: false

defaultAllowPrivilegeEscalation: false

# Capabilities

allowedCapabilities: ['NET_ADMIN', 'NET_RAW']

defaultAddCapabilities: []

requiredDropCapabilities: []

# Host namespaces

hostPID: false

hostIPC: false

hostNetwork: true

hostPorts:

- min: 0

max: 65535

# SELinux

seLinux:

# SELinux is unused in CaaSP

rule: 'RunAsAny'

---

kind: ClusterRole

apiVersion: rbac.authorization.k8s.io/v1

metadata:

name: flannel

rules:

- apiGroups: ['extensions']

resources: ['podsecuritypolicies']

verbs: ['use']

resourceNames: ['psp.flannel.unprivileged']

- apiGroups:

- ""

resources:

- pods

verbs:

- get

- apiGroups:

- ""

resources:

- nodes

verbs:

- list

- watch

- apiGroups:

- ""

resources:

- nodes/status

verbs:

- patch

---

kind: ClusterRoleBinding

apiVersion: rbac.authorization.k8s.io/v1

metadata:

name: flannel

roleRef:

apiGroup: rbac.authorization.k8s.io

kind: ClusterRole

name: flannel

subjects:

- kind: ServiceAccount

name: flannel

namespace: kube-system

---

apiVersion: v1

kind: ServiceAccount

metadata:

name: flannel

namespace: kube-system

---

kind: ConfigMap

apiVersion: v1

metadata:

name: kube-flannel-cfg

namespace: kube-system

labels:

tier: node

app: flannel

data:

cni-conf.json: |

{

"name": "cbr0",

"cniVersion": "0.3.1",

"plugins": [

{

"type": "flannel",

"delegate": {

"hairpinMode": true,

"isDefaultGateway": true

}

},

{

"type": "portmap",

"capabilities": {

"portMappings": true

}

}

]

}

net-conf.json: |

{

"Network": "10.244.0.0/16",

"Backend": {

"Type": "vxlan"

}

}

---

apiVersion: apps/v1

kind: DaemonSet

metadata:

name: kube-flannel-ds

namespace: kube-system

labels:

tier: node

app: flannel

spec:

selector:

matchLabels:

app: flannel

template:

metadata:

labels:

tier: node

app: flannel

spec:

affinity:

nodeAffinity:

requiredDuringSchedulingIgnoredDuringExecution:

nodeSelectorTerms:

- matchExpressions:

- key: kubernetes.io/os

operator: In

values:

- linux

hostNetwork: true

priorityClassName: system-node-critical

tolerations:

- operator: Exists

effect: NoSchedule

serviceAccountName: flannel

initContainers:

- name: install-cni-plugin

image: rancher/mirrored-flannelcni-flannel-cni-plugin:v1.1.0

command:

- cp

args:

- -f

- /flannel

- /opt/cni/bin/flannel

volumeMounts:

- name: cni-plugin

mountPath: /opt/cni/bin

- name: install-cni

image: quay.io/coreos/flannel:v0.18.0

command:

- cp

args:

- -f

- /etc/kube-flannel/cni-conf.json

- /etc/cni/net.d/10-flannel.conflist

volumeMounts:

- name: cni

mountPath: /etc/cni/net.d

- name: flannel-cfg

mountPath: /etc/kube-flannel/

containers:

- name: kube-flannel

image: quay.io/coreos/flannel:v0.18.0

command:

- /opt/bin/flanneld

args:

- --ip-masq

- --kube-subnet-mgr

resources:

requests:

cpu: "100m"

memory: "50Mi"

limits:

cpu: "100m"

memory: "50Mi"

securityContext:

privileged: false

capabilities:

add: ["NET_ADMIN", "NET_RAW"]

env:

- name: POD_NAME

valueFrom:

fieldRef:

fieldPath: metadata.name

- name: POD_NAMESPACE

valueFrom:

fieldRef:

fieldPath: metadata.namespace

volumeMounts:

- name: run

mountPath: /run/flannel

- name: flannel-cfg

mountPath: /etc/kube-flannel/

volumes:

- name: run

hostPath:

path: /run/flannel

- name: cni-plugin

hostPath:

path: /opt/cni/bin

- name: cni

hostPath:

path: /etc/cni/net.d

- name: flannel-cfg

configMap:

name: kube-flannel-cfg

2.2.8、访问网站

quay.io

2.3 服务部署

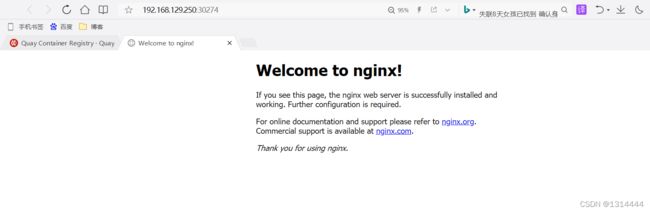

2.3.1、部署nginx

接下来在kubernetes集群中部署一个nginx程序,测试下集群是否在正常工作。

# 1.部署nginx

kubectl create deployment nginx --image=nginx //运行一个nginx的pod

# 2.暴露端口

kubectl expose deployment nginx --port=80 --type=NodePort //映射80端口

# 3.查看服务状态

kubectl get pods,svc

NAME READY STATUS RESTARTS AGE

pod/nginx-6799fc88d8-8hwr2 0/1 ContainerCreating 0 33s

NAME TYPE CLUSTER-IP EXTERNAL-IP PORT(S) AGE

service/kubernetes ClusterIP 10.96.0.1 <none> 443/TCP 87m

service/nginx NodePort 10.111.93.135 <none> 80:30274/TCP 24s

# 4.最后在访问nginx服务

curl http://10.111.93.135

<!DOCTYPE html>

<html>

<head>

<title>Welcome to nginx!</title>

<style>

html { color-scheme: light dark; }

body { width: 35em; margin: 0 auto;

font-family: Tahoma, Verdana, Arial, sans-serif; }

</style>

</head>

<body>

<h1>Welcome to nginx!</h1>

<p>If you see this page, the nginx web server is successfully installed and

working. Further configuration is required.</p>

<p>For online documentation and support please refer to

<a href="http://nginx.org/">nginx.org</a>.<br/>

Commercial support is available at

<a href="http://nginx.com/">nginx.com</a>.</p>

<p><em>Thank you for using nginx.</em></p>

</body>

</html>

2.3.2、访问

192.168.129.250:30274

2.3.3、删除

kubectl delete deployment nginx -n default

# 强制删除

kubectl delete pods nginx-6799fc88d8-f7l9g --grace-period=0 --force

3、资源管理

3.1、资源管理介绍

在kubernetes中,所有的内容都抽象为资源,用户需要通过操作资源来管理kubernetes。

kubernetes的本质上就是一个集群系统,用户可以在集群中部署各种服务,所谓的部署服务,其实就是在kubernetes集群中运行一个个的容器,并将指定的程序跑在容器中。

kubernetes的最小管理单元是pod而不是容器,所以只能将容器放在Pod中,而kubernetes一般也不会直接管理Pod,而是通过Pod控制器来管理Pod的。

Pod可以提供服务之后,就要考虑如何访问Pod中服务,kubernetes提供了Service资源实现这个功能。

当然,如果Pod中程序的数据需要持久化,kubernetes还提供了各种存储系统。

3.2、资源管理方式

命令式对象管理:直接使用命令去操作kubernetes资源

kubectl run nginx-pod --image=nginx:1.17.1 --port=80

命令式对象配置:通过命令配置和配置文件去操作kubernetes资源

kubectl create/patch -f nginx-pod.yaml

声明式对象配置:通过apply命令和配置文件去操作kubernetes资源

kubectl apply -f nginx-pod.yaml

| 类型 | 操作对象 | 适用环境 | 优点 | 缺点 |

|---|---|---|---|---|

| 命令式对象管理 | 对象 | 测试 | 简单 | 只能操作活动对象,无法审计、跟踪 |

| 命令式对象配置 | 文件 | 开发 | 可以审计、跟踪 | 项目大时,配置文件多,操作麻烦 |

| 声明式对象配置 | 目录 | 开发 | 支持目录操作 | 意外情况下难以调试 |

3.3、命令式对象管理

3.3.1、命令式对象配置

命令式对象配置就是使用命令配合配置文件一起来操作kubernetes资源。

1) 创建一个nginxpod.yaml,内容如下:

apiVersion: v1

kind: Namespace

metadata:

name: dev

---

apiVersion: v1

kind: Pod

metadata:

name: nginxpod

namespace: dev

spec:

containers:

- name: nginx-containers

image: nginx:latest

2)执行create命令,创建资源:

kubectl create -f nginxpod.yaml

namespace/dev created

pod/nginxpod created

此时发现创建了两个资源对象,分别是namespace和pod

3)执行get命令,查看资源:

[root@master ~]# kubectl get -f nginxpod.yaml

NAME STATUS AGE

namespace/dev Active 18s

NAME READY STATUS RESTARTS AGE

pod/nginxpod 1/1 Running 0 17s

这样就显示了两个资源对象的信息

4)执行delete命令,删除资源:

[root@master ~]# kubectl delete -f nginxpod.yaml

namespace "dev" deleted

pod "nginxpod" deleted

总结:

命令式对象配置的方式操作资源,可以简单的认为:命令 + yaml配置文件(里面是命令需要的各种参数)

3.3.2、声明式对象配置

声明式对象配置跟命令式对象配置很相似,但是它只有一个命令apply。

# 首先执行一次kubectl apply -f yaml文件,发现创建了资源

[root@master ~]# kubectl apply -f nginxpod.yaml

namespace/dev created

pod/nginxpod created

# 再次执行一次kubectl apply -f yaml文件,发现说资源没有变动

[root@master ~]# kubectl apply -f nginxpod.yaml

namespace/dev unchanged

pod/nginxpod unchanged

总结:

其实声明式对象配置就是使用apply描述一个资源最终的状态(在yaml中定义状态)

使用apply操作资源:

如果资源不存在,就创建,相当于 kubectl create

如果资源已存在,就更新,相当于 kubectl patch

4、实战入门

4.1、Namespace

Namespace是kubernetes系统中的一种非常重要资源,它的主要作用是用来实现多套环境的资源隔离或者多租户的资源隔离。

默认情况下,kubernetes集群中的所有的Pod都是可以相互访问的。但是在实际中,可能不想让两个Pod之间进行互相的访问,那此时就可以将两个Pod划分到不同的namespace下。kubernetes通过将集群内部的资源分配到不同的Namespace中,可以形成逻辑上的"组",以方便不同的组的资源进行隔离使用和管理。

可以通过kubernetes的授权机制,将不同的namespace交给不同租户进行管理,这样就实现了多租户的资源隔离。此时还能结合kubernetes的资源配额机制,限定不同租户能占用的资源,例如CPU使用量、内存使用量等等,来实现租户可用资源的管理。

kubernetes在集群启动之后,会默认创建几个namespace

[root@master ~]# kubectl get namespace

NAME STATUS AGE

default Active 12d # 所有未指定Namespace的对象都会被分配在default命名空间

kube-node-lease Active 12d # 集群节点之间的心跳维护,v1.13开始引入

kube-public Active 12d # 此命名空间下的资源可以被所有人访问(包括未认证用户)

kube-system Active 12d # 所有由Kubernetes系统创建的资源都处于这个命名空间

4.1.1、查看

# 1 查看所有的ns 命令:kubectl get ns

[root@master ~]# kubectl get ns

NAME STATUS AGE

default Active 12d

kube-node-lease Active 12d

kube-public Active 12d

kube-system Active 12d

# 2 查看指定的ns 命令:kubectl get ns ns名称

[root@master ~]# kubectl get ns default

NAME STATUS AGE

default Active 12d

# 3 指定输出格式 命令:kubectl get ns ns名称 -o 格式参数

# kubernetes支持的格式有很多,比较常见的是wide、json、yaml

[root@master ~]# kubectl get ns default -o yaml

apiVersion: v1

kind: Namespace

metadata:

creationTimestamp: "2022-05-20T15:33:40Z"

labels:

istio-system: enabled

managedFields:

- apiVersion: v1

fieldsType: FieldsV1

fieldsV1:

f:status:

f:phase: {}

manager: kube-apiserver

operation: Update

time: "2022-05-20T15:33:40Z"

- apiVersion: v1

fieldsType: FieldsV1

fieldsV1:

f:metadata:

f:labels:

.: {}

f:istio-system: {}

manager: kubectl-label

operation: Update

time: "2022-05-21T05:23:16Z"

name: default

resourceVersion: "116228"

uid: b016a8dc-4d07-487a-8025-9fe9b396cd30

spec:

finalizers:

- kubernetes

status:

phase: Active

# 4 查看ns详情 命令:kubectl describe ns ns名称

[root@master ~]# kubectl describe ns default

Name: default

Labels: <none>

Annotations: <none>

Status: Active # Active 命名空间正在使用中 Terminating 正在删除命名空间

# ResourceQuota 针对namespace做的资源限制

# LimitRange针对namespace中的每个组件做的资源限制

No resource quota.

No LimitRange resource.

4.1.2、创建

# 创建namespace

[root@master ~]# kubectl create ns test

namespace/test created

4.1.3、删除

# 删除namespace

[root@master ~]# kubectl delete ns test

namespace "test" deleted

4.1.4、配置方式

首先准备一个yaml文件:test-ns.yaml

apiVersion: v1

kind: Namespace

metadata:

name: test

然后就可以执行对应的创建和删除命令了:

-

创建:kubectl create -f ns-dev.yaml

-

删除:kubectl delete -f ns-dev.yaml

4.2 Pod

-

Pod是kubernetes集群进行管理的最小单元,程序要运行必须部署在容器中,而容器必须存在于Pod中。

-

Pod可以认为是容器的封装,一个Pod中可以存在一个或者多个容器。

kubernetes在集群启动之后,集群中的各个组件也都是以Pod方式运行的。可以通过下面命令查看:

[root@master ~]# kubectl get pod -n kube-system

NAME READY STATUS RESTARTS AGE

coredns-7f89b7bc75-w8fbf 1/1 Running 19 12d

coredns-7f89b7bc75-x9dkz 1/1 Running 19 12d

etcd-master 1/1 Running 19 12d

kube-apiserver-master 1/1 Running 19 12d

kube-controller-manager-master 1/1 Running 19 12d

kube-flannel-ds-4bzpt 1/1 Running 12 12d

kube-flannel-ds-92zvr 1/1 Running 19 12d

kube-proxy-5c5lr 1/1 Running 12 12d

kube-proxy-tt476 1/1 Running 19 12d

kube-scheduler-master 1/1 Running 19 12d

4.2.1、创建并运行

kubernetes没有提供单独运行Pod的命令,都是通过Pod控制器来实现的

# 命令格式: kubectl run (pod控制器名称) [参数]

# --image 指定Pod的镜像

# --port 指定端口

# --namespace 指定namespace

[root@master ~]# kubectl run nginx --image=nginx:latest --port=80 --namespace test

pod/nginx created

4.2.2、查看pod信息

# 查看Pod基本信息

[root@master ~]# kubectl get pods -n dev

NAME READY STATUS RESTARTS AGE

nginx 1/1 Running 0 43s

# 查看Pod的详细信息

[root@master ~]# kubectl describe pod nginx -n test

Name: nginx

Namespace: test

Priority: 0

Node: node1/192.168.129.158

Start Time: Thu, 02 Jun 2022 16:55:02 +0800

Labels: run=nginx

Annotations: <none>

Status: Running

IP: 10.244.1.38

IPs:

IP: 10.244.1.38

Containers:

nginx:

Container ID: docker://f4486e2b2ac27059b3b624b1dfaf28abea0a664bf1e2c0d1e49b250eb558e310

Image: nginx:latest

Image ID: docker-pullable://nginx@sha256:0d17b565c37bcbd895e9d92315a05c1c3c9a29f762b011a10c54a66cd53c9b31

Port: 80/TCP

Host Port: 0/TCP

State: Running

Started: Thu, 02 Jun 2022 16:55:58 +0800

Ready: True

Restart Count: 0

Environment: <none>

Mounts:

/var/run/secrets/kubernetes.io/serviceaccount from default-token-lnzxv (ro)

Conditions:

Type Status

Initialized True

Ready True

ContainersReady True

PodScheduled True

Volumes:

default-token-lnzxv:

Type: Secret (a volume populated by a Secret)

SecretName: default-token-lnzxv

Optional: false

QoS Class: BestEffort

Node-Selectors: <none>

Tolerations: node.kubernetes.io/not-ready:NoExecute op=Exists for 300s

node.kubernetes.io/unreachable:NoExecute op=Exists for 300s

Events:

Type Reason Age From Message

---- ------ ---- ---- -------

Normal Scheduled 69s default-scheduler Successfully assigned test/nginx to node1

Normal Pulling 68s kubelet Pulling image "nginx:latest"

Normal Pulled 13s kubelet Successfully pulled image "nginx:latest" in 55.001203213s

Normal Created 13s kubelet Created container nginx

Normal Started 13s kubelet Started container nginx

4.2.3、访问Pod

# 获取podIP

[root@master ~]# kubectl get pods -n test -o wide

NAME READY STATUS RESTARTS AGE IP NODE NOMINATED NODE READINESS GATES

nginx 1/1 Running 0 2m18s 10.244.1.38 node1 <none> <none>

#访问POD

[root@master ~]# curl http://10.244.1.38

<!DOCTYPE html>

<html>

<head>

<title>Welcome to nginx!</title>

<style>

html { color-scheme: light dark; }

body { width: 35em; margin: 0 auto;

font-family: Tahoma, Verdana, Arial, sans-serif; }

</style>

</head>

<body>

<h1>Welcome to nginx!</h1>

<p>If you see this page, the nginx web server is successfully installed and

working. Further configuration is required.</p>

<p>For online documentation and support please refer to

<a href="http://nginx.org/">nginx.org</a>.<br/>

Commercial support is available at

<a href="http://nginx.com/">nginx.com</a>.</p>

<p><em>Thank you for using nginx.</em></p>

</body>

</html>

4.2.4、删除指定Pod

# 删除指定Pod

[root@master ~]# kubectl delete pod nginx -n test

pod "nginx" deleted

# 此时,显示删除Pod成功,但是再查询,发现又新产生了一个

[root@master ~]# kubectl get pods -n test

NAME READY STATUS RESTARTS AGE

nginx 1/1 Running 0 21s

# 这是因为当前Pod是由Pod控制器创建的,控制器会监控Pod状况,一旦发现Pod死亡,会立即重建

# 此时要想删除Pod,必须删除Pod控制器

# 先来查询一下当前namespace下的Pod控制器

[root@master ~]# kubectl get deploy -n test

NAME READY UP-TO-DATE AVAILABLE AGE

nginx 1/1 1 1 9m7s

# 接下来,删除此PodPod控制器

[root@master ~]# kubectl delete deploy nginx -n test

deployment.apps "nginx" deleted

# 稍等片刻,再查询Pod,发现Pod被删除了

[root@master ~]# kubectl get pods -n test

No resources found in test namespace.

4.2.5、配置操作

创建一个pod-nginx.yaml,内容如下:

apiVersion: v1

kind: Pod

metadata:

name: nginx

namespace: test

spec:

containers:

- image: nginx:latest

name: pod

ports:

- name: nginx-port

containerPort: 80

protocol: TCP

然后就可以执行对应的创建和删除命令了:

-

创建:kubectl create -f pod-nginx.yaml

-

删除:kubectl delete -f pod-nginx.yaml

4.3 Label

Label是kubernetes系统中的一个重要概念。它的作用就是在资源上添加标识,用来对它们进行区分和选择。

Label的特点:

- 一个Label会以key/value键值对的形式附加到各种对象上,如Node、Pod、Service等等

- 一个资源对象可以定义任意数量的Label ,同一个Label也可以被添加到任意数量的资源对象上去

- Label通常在资源对象定义时确定,当然也可以在对象创建后动态添加或者删除

可以通过Label实现资源的多维度分组,以便灵活、方便地进行资源分配、调度、配置、部署等管理工作。

一些常用的Label 示例如下:

- 版本标签:“version”:“release”, “version”:“stable”…

- 环境标签:“environment”:“dev”,“environment”:“test”,“environment”:“pro”

- 架构标签:“tier”:“frontend”,“tier”:“backend”

标签定义完毕之后,还要考虑到标签的选择,这就要使用到Label Selector,即:

Label用于给某个资源对象定义标识

Label Selector用于查询和筛选拥有某些标签的资源对象

当前有两种Label Selector:

基于等式的Label Selector

name = slave: 选择所有包含Label中key="name"且value="slave"的对象

env != production: 选择所有包括Label中的key="env"且value不等于"production"的对象

基于集合的Label Selector

name in (master, slave):

选择所有包含Label中的key="name"且value="master"或"slave"的对象name not in (frontend): 选择所有包含Label中的key="name"且value不等于"frontend"的对象

标签的选择条件可以使用多个,此时将多个Label Selector进行组合,使用逗号","进行分隔即可。例如:

name=slave,env!=production

name not in (frontend),env!=production

4.3.1、命令方式

# 为pod资源打标签

[root@master ~]# kubectl label pod nginx version=1.0 -n test

pod/nginx labeled

# 为pod资源更新标签

[root@master ~]# kubectl label pod nginx version=2.0 -n test --overwrite

pod/nginx labeled

# 查看标签

[root@master ~]# kubectl get pod nginx -n test --show-labels

NAME READY STATUS RESTARTS AGE LABELS

nginx 1/1 Running 0 3m47s version=2.0

# 筛选标签

[root@master ~]# kubectl get pod -n test -l version=2.0 --show-labels

NAME READY STATUS RESTARTS AGE LABELS

nginx 1/1 Running 0 9m23s version=2.0

[root@master ~]# kubectl get pod -n test -l version!=2.0 --show-labels

No resources found in test namespace.

# 删除标签

[root@master ~]# kubectl label pod nginx version- -n test

pod/nginx labeled

[root@master ~]# kubectl get pod -n test -l version=2.0 --show-labels

No resources found in test namespace.

4.3.2、配置方式

apiVersion: v1

kind: Pod

metadata:

name: nginx

namespace: test

labels:

version: "3.0"

env: "test"

spec:

containers:

- image: nginx:latest

name: pod

ports:

- name: nginx-port

containerPort: 80

protocol: TCP

然后就可以执行对应的更新命令了:kubectl apply -f pod-nginx.yaml

4.4 Deployment

在kubernetes中,Pod是最小的控制单元,但是kubernetes很少直接控制Pod,一般都是通过Pod控制器来完成的。Pod控制器用于pod的管理,确保pod资源符合预期的状态,当pod的资源出现故障时,会尝试进行重启或重建pod。

4.4.1、命令操作

# 命令格式: kubectl create deployment 名称 [参数]

# --image 指定pod的镜像

# --port 指定端口

# --replicas 指定创建pod数量

# --namespace 指定namespace

[root@master ~]# kubectl create deployment nginx --image=nginx:latest --port=80 --replicas=3 -n test

deployment.apps/nginx created

# 查看创建的Pod

[root@master ~]# kubectl get pods -n test

NAME READY STATUS RESTARTS AGE

nginx-5ff7956ff6-6k8cb 1/1 Running 0 19s

nginx-5ff7956ff6-jxfjt 1/1 Running 0 19s

nginx-5ff7956ff6-v6jqw 1/1 Running 0 19s

# 查看deployment的信息

[root@master ~]# kubectl get deploy -n test

NAME READY UP-TO-DATE AVAILABLE AGE

nginx 3/3 3 3 2m42s

# UP-TO-DATE:成功升级的副本数量

# AVAILABLE:可用副本的数量

[root@master ~]# kubectl get deploy -n test -o wide

NAME READY UP-TO-DATE AVAILABLE AGE CONTAINERS IMAGES SELECTOR

nginx 3/3 3 3 2m51s nginx nginx:latest run=nginx

# 查看deployment的详细信息

[root@master ~]# kubectl describe deploy nginx -n dev

Name: nginx

Namespace: dev

CreationTimestamp: Wed, 08 May 2021 11:14:14 +0800

Labels: run=nginx

Annotations: deployment.kubernetes.io/revision: 1

Selector: run=nginx

Replicas: 3 desired | 3 updated | 3 total | 3 available | 0 unavailable

StrategyType: RollingUpdate

MinReadySeconds: 0

RollingUpdateStrategy: 25% max unavailable, 25% max surge

Pod Template:

Labels: run=nginx

Containers:

nginx:

Image: nginx:latest

Port: 80/TCP

Host Port: 0/TCP

Environment: <none>

Mounts: <none>

Volumes: <none>

Conditions:

Type Status Reason

---- ------ ------

Available True MinimumReplicasAvailable

Progressing True NewReplicaSetAvailable

OldReplicaSets: <none>

NewReplicaSet: nginx-5ff7956ff6 (3/3 replicas created)

Events:

Type Reason Age From Message

---- ------ ---- ---- -------

Normal ScalingReplicaSet 5m43s deployment-controller Scaled up replicaset nginx-5ff7956ff6 to 3

# 删除

[root@master ~]# kubectl delete deploy nginx -n dev

deployment.apps "nginx" deleted

4.4.2、配置操作

创建一个deploy-nginx.yaml,内容如下:

apiVersion: apps/v1

kind: Deployment

metadata:

name: nginx

namespace: dev

spec:

replicas: 3

selector:

matchLabels:

run: nginx

template:

metadata:

labels:

run: nginx

spec:

containers:

- image: nginx:latest

name: nginx

ports:

- containerPort: 80

protocol: TCP

然后就可以执行对应的创建和删除命令了:

创建:kubectl create -f deploy-nginx.yaml

删除:kubectl delete -f deploy-nginx.yaml

4.5、Service

- Pod IP 会随着Pod的重建产生变化

- Pod IP 仅仅是集群内可见的虚拟IP,外部无法访问

这样对于访问这个服务带来了难度。因此,kubernetes设计了Service来解决这个问题。

Service可以看作是一组同类Pod对外的访问接口。借助Service,应用可以方便地实现服务发现和负载均衡。

4.5.1、创建集群内部可访问的Service

# 暴露Service

[root@master ~]# kubectl expose deploy nginx --name=svc-nginx1 --type=ClusterIP --port=80 --target-port=80 -n dev

service/svc-nginx1 exposed

# 查看service

[root@master ~]# kubectl get svc svc-nginx1 -n dev -o wide

NAME TYPE CLUSTER-IP EXTERNAL-IP PORT(S) AGE SELECTOR

svc-nginx1 ClusterIP 10.109.179.231 <none> 80/TCP 3m51s run=nginx

# 这里产生了一个CLUSTER-IP,这就是service的IP,在Service的生命周期中,这个地址是不会变动的

# 可以通过这个IP访问当前service对应的POD

[root@master ~]# curl 10.109.179.231:80

<!DOCTYPE html>

<html>

<head>

<title>Welcome to nginx!</title>

</head>

<body>

<h1>Welcome to nginx!</h1>

.......

</body>

</html>

4.5.2、创建集群外部也可访问的Service

# 上面创建的Service的type类型为ClusterIP,这个ip地址只用集群内部可访问

# 如果需要创建外部也可以访问的Service,需要修改type为NodePort

[root@master ~]# kubectl expose deploy nginx --name=svc-nginx2 --type=NodePort --port=80 --target-port=80 -n dev

service/svc-nginx2 exposed

# 此时查看,会发现出现了NodePort类型的Service,而且有一对Port(80:31928/TC)

[root@master ~]# kubectl get svc svc-nginx2 -n dev -o wide

NAME TYPE CLUSTER-IP EXTERNAL-IP PORT(S) AGE SELECTOR

svc-nginx2 NodePort 10.100.94.0 <none> 80:31928/TCP 9s run=nginx

# 接下来就可以通过集群外的主机访问 节点IP:31928访问服务了

# 例如在的电脑主机上通过浏览器访问下面的地址

http://192.168.90.100:31928/

4.5.3、删除Service

4.5.4、配置方式

5. Pod详解

5.1 Pod介绍

5.1.1 Pod结构

5.1.2 Pod定义

5.2 Pod配置

5.2.1 基本配置

5.2.2 镜像拉取

5.2.3 启动命令

5.2.4 环境变量

5.2.5 端口设置

5.2.6 资源配额

5.3 Pod生命周期

5.3.1 创建和终止

5.3.2 初始化容器

5.3.3 钩子函数

5.3.4 容器探测

5.3.5 重启策略

5.4 Pod调度

5.4.1 定向调度

5.4.2 亲和性调度

5.4.3 污点和容忍

6. Pod控制器详解

6.1 Pod控制器介绍

6.2 ReplicaSet(RS)

6.3 Deployment(Deploy)

6.3.1 创建deployment

6.3.2 扩缩容

6.3.3 版本回退

6.3.4 金丝雀发布

6.4 Horizontal Pod Autoscaler(HPA)

6.4.1 安装metrics-server

6.4.2 准备deployment和servie

6.4.3 部署HPA

6.4.4 测试

6.5 DaemonSet(DS)

6.6 Job

6.7 CronJob(CJ)

7. Service详解

7.1 Service介绍

7.1.1 userspace 模式

7.1.2 iptables 模式

7.1.3 ipvs 模式

7.2 Service类型

7.3 Service使用

7.3.1 实验环境准备

7.3.2 ClusterIP类型的Service

7.3.3 Endpoint

7.3.4 HeadLiness类型的Service

7.3.5 NodePort类型的Service

7.3.6 LoadBalancer类型的Service

7.3.7 ExternalName类型的Service

7.4 Ingress介绍

7.5 Ingress使用

7.5.1 环境准备 搭建ingress环境

7.5.2 准备service和pod

7.5.3 Http代理

7.5.4 Https代理

8. 数据存储

8.1 基本存储

8.1.1 EmptyDir

8.1.2 HostPath

8.1.3 NFS

8.2 高级存储

8.2.1 PV

8.2.2 PVC

8.2.3 生命周期

8.3 配置存储

8.3.1 ConfigMap

8.3.2 Secret