- Pyecharts数据可视化大屏:打造沉浸式数据分析体验

我的运维人生

信息可视化数据分析数据挖掘运维开发技术共享

Pyecharts数据可视化大屏:打造沉浸式数据分析体验在当今这个数据驱动的时代,如何将海量数据以直观、生动的方式展现出来,成为了数据分析师和企业决策者关注的焦点。Pyecharts,作为一款基于Python的开源数据可视化库,凭借其丰富的图表类型、灵活的配置选项以及高度的定制化能力,成为了构建数据可视化大屏的理想选择。本文将深入探讨如何利用Pyecharts打造数据可视化大屏,并通过实际代码案例

- PHP环境搭建详细教程

好看资源平台

前端php

PHP是一个流行的服务器端脚本语言,广泛用于Web开发。为了使PHP能够在本地或服务器上运行,我们需要搭建一个合适的PHP环境。本教程将结合最新资料,介绍在不同操作系统上搭建PHP开发环境的多种方法,包括Windows、macOS和Linux系统的安装步骤,以及本地和Docker环境的配置。1.PHP环境搭建概述PHP环境的搭建主要分为以下几类:集成开发环境:例如XAMPP、WAMP、MAMP,这

- 使用Faiss进行高效相似度搜索

llzwxh888

faisspython

在现代AI应用中,快速和高效的相似度搜索是至关重要的。Faiss(FacebookAISimilaritySearch)是一个专门用于快速相似度搜索和聚类的库,特别适用于高维向量。本文将介绍如何使用Faiss来进行相似度搜索,并结合Python代码演示其基本用法。什么是Faiss?Faiss是一个由FacebookAIResearch团队开发的开源库,主要用于高维向量的相似性搜索和聚类。Faiss

- 在一台Ubuntu计算机上构建Hyperledger Fabric网络

落叶无声9

区块链超级账本Hyperledgerfabric区块链ubuntu构建hyperledgerfabric

在一台Ubuntu计算机上构建HyperledgerFabric网络Hyperledgerfabric是一个开源的区块链应用程序平台,为开发基于区块链的应用程序提供了一个起点。当我们提到HyperledgerFabric网络时,我们指的是使用HyperledgerFabric的正在运行的系统。即使只使用最少数量的组件,部署Fabric网络也不是一件容易的事。Fabric社区创建了一个名为Cello

- GitHub上克隆项目

bigbig猩猩

github

从GitHub上克隆项目是一个简单且直接的过程,它允许你将远程仓库中的项目复制到你的本地计算机上,以便进行进一步的开发、测试或学习。以下是一个详细的步骤指南,帮助你从GitHub上克隆项目。一、准备工作1.安装Git在克隆GitHub项目之前,你需要在你的计算机上安装Git工具。Git是一个开源的分布式版本控制系统,用于跟踪和管理代码变更。你可以从Git的官方网站(https://git-scm.

- MongoDB Oplog 窗口

喝醉酒的小白

MongoDB运维

在MongoDB中,oplog(操作日志)是一个特殊的日志系统,用于记录对数据库的所有写操作。oplog允许副本集成员(通常是从节点)应用主节点上已经执行的操作,从而保持数据的一致性。它是MongoDB副本集实现数据复制的基础。MongoDBOplog窗口oplog窗口是指在MongoDB副本集中,从节点可以用来同步数据的时间范围。这个窗口通常由以下因素决定:Oplog大小:oplog的大小是有限

- node.js学习

小猿L

node.jsnode.js学习vim

node.js学习实操及笔记温故node.js,node.js学习实操过程及笔记~node.js学习视频node.js官网node.js中文网实操笔记githubcsdn笔记为什么学node.js可以让别人访问我们编写的网页为后续的框架学习打下基础,三大框架vuereactangular离不开node.jsnode.js是什么官网:node.js是一个开源的、跨平台的运行JavaScript的运行

- 01-Git初识

Meereen

Gitgit

01-Git初识概念:一个免费开源,分布式的代码版本控制系统,帮助开发团队维护代码作用:记录代码内容。切换代码版本,多人开发时高效合并代码内容如何学:个人本机使用:Git基础命令和概念多人共享使用:团队开发同一个项目的代码版本管理Git配置用户信息配置:用户名和邮箱,应用在每次提交代码版本时表明自己的身份命令:查看git版本号git-v配置用户名gitconfig--globaluser.name

- Python开发常用的三方模块如下:

换个网名有点难

python开发语言

Python是一门功能强大的编程语言,拥有丰富的第三方库,这些库为开发者提供了极大的便利。以下是100个常用的Python库,涵盖了多个领域:1、NumPy,用于科学计算的基础库。2、Pandas,提供数据结构和数据分析工具。3、Matplotlib,一个绘图库。4、Scikit-learn,机器学习库。5、SciPy,用于数学、科学和工程的库。6、TensorFlow,由Google开发的开源机

- 你可能遗漏的一些C#/.NET/.NET Core知识点

追逐时光者

C#.NETDotNetGuide编程指南c#.net.netcoremicrosoft

前言在这个快速发展的技术世界中,时常会有一些重要的知识点、信息或细节被忽略或遗漏。《C#/.NET/.NETCore拾遗补漏》专栏我们将探讨一些可能被忽略或遗漏的重要知识点、信息或细节,以帮助大家更全面地了解这些技术栈的特性和发展方向。拾遗补漏GitHub开源地址https://github.com/YSGStudyHards/DotNetGuide/blob/main/docs/DotNet/D

- 【从浅识到熟知Linux】Linux发展史

Jammingpro

从浅学到熟知Linuxlinux运维服务器

归属专栏:从浅学到熟知Linux个人主页:Jammingpro每日努力一点点,技术变化看得见文章前言:本篇文章记录Linux发展的历史,因在介绍Linux过程中涉及的其他操作系统及人物,本文对相关内容也有所介绍。文章目录Unix发展史Linux发展史开源Linux官网企业应用情况发行版本在学习Linux前,我们可能都会问Linux从哪里来?它是如何发展的。但在介绍Linux之前,需要先介绍一下Un

- linux 发展史

种树的猴子

内核java操作系统linux大数据

linux发展史说明此前对linux认识模糊一知半解,近期通过学习将自己对于linux的发展总结一下方便大家日后的学习。那Linux是目前一款非常火热的开源操作系统,可是linux是什么时候出现的,又是因为什么样的原因被开发出来的呢。以下将对linux的发展历程进行详细的讲解。目录一、Linux发展背景二、UINIX的诞生三、UNIX的重要分支-BSD的诞生四、Minix的诞生五、GNU与Free

- Java:爬虫框架

dingcho

Javajava爬虫

一、ApacheNutch2【参考地址】Nutch是一个开源Java实现的搜索引擎。它提供了我们运行自己的搜索引擎所需的全部工具。包括全文搜索和Web爬虫。Nutch致力于让每个人能很容易,同时花费很少就可以配置世界一流的Web搜索引擎.为了完成这一宏伟的目标,Nutch必须能够做到:每个月取几十亿网页为这些网页维护一个索引对索引文件进行每秒上千次的搜索提供高质量的搜索结果简单来说Nutch支持分

- 如何用matlab灵活控制feko的求解

NingrLi

matlab开发语言

https://bbs.rfeda.cn/read.php?tid=3778Feko中的模型和求解设置等都可以通过editfeko进行设置,其文件存储为.pre文件,该文件可以用文本打开,因此,我们可以通过VB、VC、matlab等工具对.pre文件进行读写操作,以达到更灵活的使用feko。同样,对于.out文件,我们也可以进行读操作。熟练使用对.pre文件和.out文件的操作后,我们可以方便的计

- WebMagic:强大的Java爬虫框架解析与实战

Aaron_945

Javajava爬虫开发语言

文章目录引言官网链接WebMagic原理概述基础使用1.添加依赖2.编写PageProcessor高级使用1.自定义Pipeline2.分布式抓取优点结论引言在大数据时代,网络爬虫作为数据收集的重要工具,扮演着不可或缺的角色。Java作为一门广泛使用的编程语言,在爬虫开发领域也有其独特的优势。WebMagic是一个开源的Java爬虫框架,它提供了简单灵活的API,支持多线程、分布式抓取,以及丰富的

- 进销存小程序源码 PHP网络版ERP进销存管理系统 全开源可二开

摸鱼小号

php

可直接源码搭建部署发布后使用:一、功能模块介绍该系统模板主要有进,销,存三个主要模板功能组成,下面将介绍各模块所对应的功能;进:需要将产品采购入库,自动生成采购明细台账同时关联财务生成付款账单;销:是指对客户的销售订单记录,汇总生成产品销售明细及回款计划;存:库存的日常盘点与统计,库存下限预警、出入库台账、库存位置等。1.进购管理采购订单:采购下单审批→由上级审批通过采购入库;采购入库:货品到货>

- 计算机毕业设计PHP仓储综合管理系统(源码+程序+VUE+lw+部署)

java毕设程序源码王哥

php课程设计vue.js

该项目含有源码、文档、程序、数据库、配套开发软件、软件安装教程。欢迎交流项目运行环境配置:phpStudy+Vscode+Mysql5.7+HBuilderX+Navicat11+Vue+Express。项目技术:原生PHP++Vue等等组成,B/S模式+Vscode管理+前后端分离等等。环境需要1.运行环境:最好是小皮phpstudy最新版,我们在这个版本上开发的。其他版本理论上也可以。2.开发

- 浅谈MapReduce

Android路上的人

Hadoop分布式计算mapreduce分布式框架hadoop

从今天开始,本人将会开始对另一项技术的学习,就是当下炙手可热的Hadoop分布式就算技术。目前国内外的诸多公司因为业务发展的需要,都纷纷用了此平台。国内的比如BAT啦,国外的在这方面走的更加的前面,就不一一列举了。但是Hadoop作为Apache的一个开源项目,在下面有非常多的子项目,比如HDFS,HBase,Hive,Pig,等等,要先彻底学习整个Hadoop,仅仅凭借一个的力量,是远远不够的。

- metaRTC8.0,一个全新架构的webRTC SDK库

metaRTC

webrtc音视频

概述metaRTC8.0是metaRTC开源以来架构变化最大的一个版本,是metaIPC3.0等高性能的基础。metaRTC8.0是一个全新架构版本,并非在metaRTC7.0版本上简单升级,在QOS/语音对讲/内存占用/视频文件录制读取等方面新增多个模块,在弱网对抗/语音对讲/内存优化等效果上有显著提升。metaRTC8.0在一年多的开发中进行了近200次迭代,metaRTC8.0社区版计划在2

- 探索ASPICE V3.1:汽车行业软件开发的中文指南

阮懿同

探索ASPICEV3.1:汽车行业软件开发的中文指南ASPICE_V3.1中文版.pdf.zip项目地址:https://gitcode.com/open-source-toolkit/422a2在汽车软件工程领域,高质量的标准对于确保行车安全和提升用户体验至关重要。今天,我们为您介绍一个珍贵的开源宝藏——ASPICEV3.1中文版资源。这是一篇专为国内汽车行业开发者、质量管理者准备的深度解读,旨

- SpringBoot和SpringMVC是什么关系?SpringBoot替代SpringMVC了吗?

瑞金彭于晏

springboot后端javaMVCspring数据库

SpringBoot和SpringMVC都是SpringFramework生态系统中的一部分,但它们各自扮演着不同的角色和提供不同的功能集。理解它们之间的关系,首先需要了解SpringFramework本身。SpringFrameworkSpringFramework是一个全面的、开源的应用程序开发框架,它提供了广泛的功能来支持企业应用开发的几乎所有方面。SpringFramework的核心特性之

- Nginx:高性能的Web服务器与反向代理

张某布响丸辣

nginx前端服务器javaSpringBoot

在当今的互联网世界中,Web服务器的选择对于网站的性能、稳定性和安全性至关重要。Nginx(发音为“engineX”)凭借其卓越的性能、丰富的功能集和灵活的配置选项,成为了众多网站和应用程序的首选Web服务器和反向代理。本文将深入探讨Nginx的特点、应用场景、基本配置以及它如何助力你的Web项目。Nginx简介Nginx是一个开源的、高性能的HTTP和反向代理服务器,也是一个IMAP/POP3/

- Rust是否会取代C/C++?Rust与C/C++的较量

AI与编程之窗

源码编译与开发rustc语言c++内存安全并发编程代码安全性能优化

目录引言第一部分:Rust语言的优势内存安全性并发性性能社区和生态系统的成长第二部分:C/C++语言的优势和地位历史积淀和成熟度广泛的库和工具支持性能优化和硬件控制丰富的行业应用社区和行业支持第三部分:挑战和阻碍学习曲线现有代码库的迁移成本生态系统和工具链的完善度社区和人才培养行业应用和推广法规和标准化第四部分:未来趋势和可能性行业趋势教育和人才培养兼容和共存行业标准化企业支持和应用开源社区和生态

- 免费像素画绘制软件 | Pixelorama v1.0.3

dntktop

软件运维windows

Pixelorama是一款开源像素艺术多工具软件,旨在为用户提供一个强大且易于使用的平台来创作各种像素艺术作品,包括精灵、瓷砖和动画。这款软件以其丰富的工具箱、动画支持、像素完美模式、剪裁遮罩、预制及可导入的调色板等特色功能,满足了像素艺术家们的各种需求。用户可以享受到动态工具映射、洋葱皮效果、帧标签、播放动画时绘制等高级功能,以及非破坏性的、完全可定制的图层效果,如轮廓、渐变映射、阴影和调色板化

- Hadoop

傲雪凌霜,松柏长青

后端大数据hadoop大数据分布式

ApacheHadoop是一个开源的分布式计算框架,主要用于处理海量数据集。它具有高度的可扩展性、容错性和高效的分布式存储与计算能力。Hadoop核心由四个主要模块组成,分别是HDFS(分布式文件系统)、MapReduce(分布式计算框架)、YARN(资源管理)和HadoopCommon(公共工具和库)。1.HDFS(HadoopDistributedFileSystem)HDFS是Hadoop生

- python之pyecharts制作可视化数据大屏

cesske

大数据

文章目录前言一、安装Pyecharts二、创建Pyecharts图表三、设计大屏布局四、实时数据更新五、部署和展示总结前言使用Pyecharts制作可视化数据大屏是一个复杂但有趣的过程,因为Pyecharts本身是一个用于生成Echarts图表的Python库,而Echarts是由百度开发的一个开源可视化库,支持丰富的图表类型和高度自定义。然而,Pyecharts本身并不直接提供“大屏”的解决方案

- 大模型训练数据库Common Crawl

WindyChanChan

数据集语言模型数据库

CommonCrawl介绍CommonCrawl是一个非营利组织,致力于通过大规模分布式爬虫系统定期抓取整个Web并将其存储在一个可公开访问的数据库中。CommonCrawl的数据收集和处理过程包括使用Python开源爬虫工具收集全球范围内的网站数据,并将其上传到CommonCrawl基金会的数据仓库中。该项目从2008年开始,至今已经积累了大量的原始网页数据、元数据和文本提取数据。这些数据

- OpenCV图像处理技术(Python)——入门

森屿_

opencv

©FuXianjun.AllRightsReserved.OpenCV入门图像作为人类感知世界的视觉基础,是人类获取信息、表达信息的重要手段,OpenCV作为一个开源的计算机视觉库,它包括几百个易用的图像成像和视觉函数,既可以用于学术研究,也可用于工业邻域,它于1999年由因特尔的GaryBradski启动,OpenCV库主要由C和C++语言编写,它可以在多个操作系统上运行。1.1图像处理基本操作

- Github 2024-09-12 Go开源项目日报Top10

老孙正经胡说

githubgolang开源Github趋势分析开源项目PythonGolang

根据GithubTrendings的统计,今日(2024-09-12统计)共有10个项目上榜。根据开发语言中项目的数量,汇总情况如下:开发语言项目数量Go项目10C项目1Terraform:基础设施即代码的开源工具创建周期:3626天开发语言:Go协议类型:OtherStar数量:40393个Fork数量:9397次关注人数:40393人贡献人数:358人OpenIssues数量:1943个Git

- Kafka详细解析与应用分析

芊言芊语

kafka分布式

Kafka是一个开源的分布式事件流平台(EventStreamingPlatform),由LinkedIn公司最初采用Scala语言开发,并基于ZooKeeper协调管理。如今,Kafka已经被Apache基金会纳入其项目体系,广泛应用于大数据实时处理领域。Kafka凭借其高吞吐量、持久化、分布式和可靠性的特点,成为构建实时流数据管道和流处理应用程序的重要工具。Kafka架构Kafka的架构主要由

- log4j对象改变日志级别

3213213333332132

javalog4jlevellog4j对象名称日志级别

log4j对象改变日志级别可批量的改变所有级别,或是根据条件改变日志级别。

log4j配置文件:

log4j.rootLogger=ERROR,FILE,CONSOLE,EXECPTION

#log4j.appender.FILE=org.apache.log4j.RollingFileAppender

log4j.appender.FILE=org.apache.l

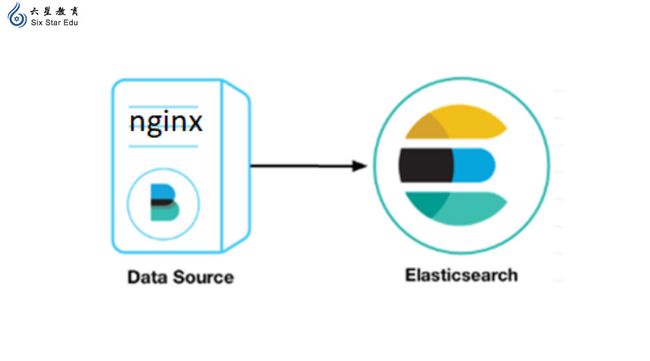

- elk+redis 搭建nginx日志分析平台

ronin47

elasticsearchkibanalogstash

elk+redis 搭建nginx日志分析平台

logstash,elasticsearch,kibana 怎么进行nginx的日志分析呢?首先,架构方面,nginx是有日志文件的,它的每个请求的状态等都有日志文件进行记录。其次,需要有个队 列,redis的l

- Yii2设置时区

dcj3sjt126com

PHPtimezoneyii2

时区这东西,在开发的时候,你说重要吧,也还好,毕竟没它也能正常运行,你说不重要吧,那就纠结了。特别是linux系统,都TMD差上几小时,你能不痛苦吗?win还好一点。有一些常规方法,是大家目前都在采用的1、php.ini中的设置,这个就不谈了,2、程序中公用文件里设置,date_default_timezone_set一下时区3、或者。。。自己写时间处理函数,在遇到时间的时候,用这个函数处理(比较

- js实现前台动态添加文本框,后台获取文本框内容

171815164

文本框

<%@ page language="java" import="java.util.*" pageEncoding="UTF-8"%>

<!DOCTYPE html PUBLIC "-//W3C//DTD XHTML 1.0 Transitional//EN" "http://w

- 持续集成工具

g21121

持续集成

持续集成是什么?我们为什么需要持续集成?持续集成带来的好处是什么?什么样的项目需要持续集成?... 持续集成(Continuous integration ,简称CI),所谓集成可以理解为将互相依赖的工程或模块合并成一个能单独运行

- 数据结构哈希表(hash)总结

永夜-极光

数据结构

1.什么是hash

来源于百度百科:

Hash,一般翻译做“散列”,也有直接音译为“哈希”的,就是把任意长度的输入,通过散列算法,变换成固定长度的输出,该输出就是散列值。这种转换是一种压缩映射,也就是,散列值的空间通常远小于输入的空间,不同的输入可能会散列成相同的输出,所以不可能从散列值来唯一的确定输入值。简单的说就是一种将任意长度的消息压缩到某一固定长度的消息摘要的函数。

- 乱七八糟

程序员是怎么炼成的

eclipse中的jvm字节码查看插件地址:

http://andrei.gmxhome.de/eclipse/

安装该地址的outline 插件 后重启,打开window下的view下的bytecode视图

http://andrei.gmxhome.de/eclipse/

jvm博客:

http://yunshen0909.iteye.com/blog/2

- 职场人伤害了“上司” 怎样弥补

aijuans

职场

由于工作中的失误,或者平时不注意自己的言行“伤害”、“得罪”了自己的上司,怎么办呢?

在职业生涯中这种问题尽量不要发生。下面提供了一些解决问题的建议:

一、利用一些轻松的场合表示对他的尊重

即使是开明的上司也很注重自己的权威,都希望得到下属的尊重,所以当你与上司冲突后,最好让不愉快成为过去,你不妨在一些轻松的场合,比如会餐、联谊活动等,向上司问个好,敬下酒,表示你对对方的尊重,

- 深入浅出url编码

antonyup_2006

应用服务器浏览器servletweblogicIE

出处:http://blog.csdn.net/yzhz 杨争

http://blog.csdn.net/yzhz/archive/2007/07/03/1676796.aspx

一、问题:

编码问题是JAVA初学者在web开发过程中经常会遇到问题,网上也有大量相关的

- 建表后创建表的约束关系和增加表的字段

百合不是茶

标的约束关系增加表的字段

下面所有的操作都是在表建立后操作的,主要目的就是熟悉sql的约束,约束语句的万能公式

1,增加字段(student表中增加 姓名字段)

alter table 增加字段的表名 add 增加的字段名 增加字段的数据类型

alter table student add name varchar2(10);

&nb

- Uploadify 3.2 参数属性、事件、方法函数详解

bijian1013

JavaScriptuploadify

一.属性

属性名称

默认值

说明

auto

true

设置为true当选择文件后就直接上传了,为false需要点击上传按钮才上传。

buttonClass

”

按钮样式

buttonCursor

‘hand’

鼠标指针悬停在按钮上的样子

buttonImage

null

浏览按钮的图片的路

- 精通Oracle10编程SQL(16)使用LOB对象

bijian1013

oracle数据库plsql

/*

*使用LOB对象

*/

--LOB(Large Object)是专门用于处理大对象的一种数据类型,其所存放的数据长度可以达到4G字节

--CLOB/NCLOB用于存储大批量字符数据,BLOB用于存储大批量二进制数据,而BFILE则存储着指向OS文件的指针

/*

*综合实例

*/

--建立表空间

--#指定区尺寸为128k,如不指定,区尺寸默认为64k

CR

- 【Resin一】Resin服务器部署web应用

bit1129

resin

工作中,在Resin服务器上部署web应用,通常有如下三种方式:

配置多个web-app

配置多个http id

为每个应用配置一个propeties、xml以及sh脚本文件

配置多个web-app

在resin.xml中,可以为一个host配置多个web-app

<cluster id="app&q

- red5简介及基础知识

白糖_

基础

简介

Red5的主要功能和Macromedia公司的FMS类似,提供基于Flash的流媒体服务的一款基于Java的开源流媒体服务器。它由Java语言编写,使用RTMP作为流媒体传输协议,这与FMS完全兼容。它具有流化FLV、MP3文件,实时录制客户端流为FLV文件,共享对象,实时视频播放、Remoting等功能。用Red5替换FMS后,客户端不用更改可正

- angular.fromJson

boyitech

AngularJSAngularJS 官方APIAngularJS API

angular.fromJson 描述: 把Json字符串转为对象 使用方法: angular.fromJson(json); 参数详解: Param Type Details json

string

JSON 字符串 返回值: 对象, 数组, 字符串 或者是一个数字 示例:

<!DOCTYPE HTML>

<h

- java-颠倒一个句子中的词的顺序。比如: I am a student颠倒后变成:student a am I

bylijinnan

java

public class ReverseWords {

/**

* 题目:颠倒一个句子中的词的顺序。比如: I am a student颠倒后变成:student a am I.词以空格分隔。

* 要求:

* 1.实现速度最快,移动最少

* 2.不能使用String的方法如split,indexOf等等。

* 解答:两次翻转。

*/

publ

- web实时通讯

Chen.H

Web浏览器socket脚本

关于web实时通讯,做一些监控软件。

由web服务器组件从消息服务器订阅实时数据,并建立消息服务器到所述web服务器之间的连接,web浏览器利用从所述web服务器下载到web页面的客户端代理与web服务器组件之间的socket连接,建立web浏览器与web服务器之间的持久连接;利用所述客户端代理与web浏览器页面之间的信息交互实现页面本地更新,建立一条从消息服务器到web浏览器页面之间的消息通路

- [基因与生物]远古生物的基因可以嫁接到现代生物基因组中吗?

comsci

生物

大家仅仅把我说的事情当作一个IT行业的笑话来听吧..没有其它更多的意思

如果我们把大自然看成是一位伟大的程序员,专门为地球上的生态系统编制基因代码,并创造出各种不同的生物来,那么6500万年前的程序员开发的代码,是否兼容现代派的程序员的代码和架构呢?

- oracle 外部表

daizj

oracle外部表external tables

oracle外部表是只允许只读访问,不能进行DML操作,不能创建索引,可以对外部表进行的查询,连接,排序,创建视图和创建同义词操作。

you can select, join, or sort external table data. You can also create views and synonyms for external tables. Ho

- aop相关的概念及配置

daysinsun

AOP

切面(Aspect):

通常在目标方法执行前后需要执行的方法(如事务、日志、权限),这些方法我们封装到一个类里面,这个类就叫切面。

连接点(joinpoint)

spring里面的连接点指需要切入的方法,通常这个joinpoint可以作为一个参数传入到切面的方法里面(非常有用的一个东西)。

通知(Advice)

通知就是切面里面方法的具体实现,分为前置、后置、最终、异常环

- 初一上学期难记忆单词背诵第二课

dcj3sjt126com

englishword

middle 中间的,中级的

well 喔,那么;好吧

phone 电话,电话机

policeman 警察

ask 问

take 拿到;带到

address 地址

glad 高兴的,乐意的

why 为什么

China 中国

family 家庭

grandmother (外)祖母

grandfather (外)祖父

wife 妻子

husband 丈夫

da

- Linux日志分析常用命令

dcj3sjt126com

linuxlog

1.查看文件内容

cat

-n 显示行号 2.分页显示

more

Enter 显示下一行

空格 显示下一页

F 显示下一屏

B 显示上一屏

less

/get 查询"get"字符串并高亮显示 3.显示文件尾

tail

-f 不退出持续显示

-n 显示文件最后n行 4.显示头文件

head

-n 显示文件开始n行 5.内容排序

sort

-n 按照

- JSONP 原理分析

fantasy2005

JavaScriptjsonpjsonp 跨域

转自 http://www.nowamagic.net/librarys/veda/detail/224

JavaScript是一种在Web开发中经常使用的前端动态脚本技术。在JavaScript中,有一个很重要的安全性限制,被称为“Same-Origin Policy”(同源策略)。这一策略对于JavaScript代码能够访问的页面内容做了很重要的限制,即JavaScript只能访问与包含它的

- 使用connect by进行级联查询

234390216

oracle查询父子Connect by级联

使用connect by进行级联查询

connect by可以用于级联查询,常用于对具有树状结构的记录查询某一节点的所有子孙节点或所有祖辈节点。

来看一个示例,现假设我们拥有一个菜单表t_menu,其中只有三个字段:

- 一个不错的能将HTML表格导出为excel,pdf等的jquery插件

jackyrong

jquery插件

发现一个老外写的不错的jquery插件,可以实现将HTML

表格导出为excel,pdf等格式,

地址在:

https://github.com/kayalshri/

下面看个例子,实现导出表格到excel,pdf

<html>

<head>

<title>Export html table to excel an

- UI设计中我们为什么需要设计动效

lampcy

UIUI设计

关于Unity3D中的Shader的知识

首先先解释下Unity3D的Shader,Unity里面的Shaders是使用一种叫ShaderLab的语言编写的,它同微软的FX文件或者NVIDIA的CgFX有些类似。传统意义上的vertex shader和pixel shader还是使用标准的Cg/HLSL 编程语言编写的。因此Unity文档里面的Shader,都是指用ShaderLab编写的代码,

- 如何禁止页面缓存

nannan408

htmljspcache

禁止页面使用缓存~

------------------------------------------------

jsp:页面no cache:

response.setHeader("Pragma","No-cache");

response.setHeader("Cache-Control","no-cach

- 以代码的方式管理quartz定时任务的暂停、重启、删除、添加等

Everyday都不同

定时任务管理spring-quartz

【前言】在项目的管理功能中,对定时任务的管理有时会很常见。因为我们不能指望只在配置文件中配置好定时任务就行了,因为如果要控制定时任务的 “暂停” 呢?暂停之后又要在某个时间点 “重启” 该定时任务呢?或者说直接 “删除” 该定时任务呢?要改变某定时任务的触发时间呢? “添加” 一个定时任务对于系统的使用者而言,是不太现实的,因为一个定时任务的处理逻辑他是不

- EXT实例

tntxia

ext

(1) 增加一个按钮

JSP:

<%@ page language="java" import="java.util.*" pageEncoding="UTF-8"%>

<%

String path = request.getContextPath();

Stri

- 数学学习在计算机研究领域的作用和重要性

xjnine

Math

最近一直有师弟师妹和朋友问我数学和研究的关系,研一要去学什么数学课。毕竟在清华,衡量一个研究生最重要的指标之一就是paper,而没有数学,是肯定上不了世界顶级的期刊和会议的,这在计算机学界尤其重要!你会发现,不论哪个领域有价值的东西,都一定离不开数学!在这样一个信息时代,当google已经让世界没有秘密的时候,一种卓越的数学思维,绝对可以成为你的核心竞争力. 无奈本人实在见地