sqoop系列:sqoop(离线数据同步)开发案例

目录

Apache Hadoop生态-目录汇总-持续更新

1:Mysql(RDBMS)与Hive/HDFS数据传输

1.1:列出MySQL数据有哪些数据库:

1.2:根据mysql表结构创建hive表

1.3: RDBMS导入到hdfs

(1)条件导入

(2)增量导入

(3)查询导入-常用

1.4:把mysql数据导入hive

1.5:把mysql数据导入hbase

2:导出数据

1:HIVE/HDFS到RDBMS

Apache Hadoop生态-目录汇总-持续更新

系统环境:centos7

Java环境:Java8

1:Mysql(RDBMS)与Hive/HDFS数据传输

1.1:列出MySQL数据有哪些数据库:

sqoop list-databases \

--connect jdbc:mysql://192.168.5.114:3306/ \

--username hive \

--password hive_pw1.2:根据mysql表结构创建hive表

根据test库mac_website创建hive表

sqoop create-hive-table \

--connect jdbc:mysql://192.168.5.114:3306/test \

--username hive \

--password hive_pw \

--table test \

--hive-table db_hive.my_test1.3: RDBMS导入到hdfs

--target-dir /user/company \ # 指定hdfs路径

--delete-target-dir \ 如果目标文件存在,会删除

--fields-terminated-by "\t" # 指定分隔符

--num-mappers 1MapTask个数, 默认4个(会生成4个文件)

(1)条件导入

sqoop import \

--connect jdbc:mysql://192.168.5.114:3306/test \

--username hive \

--password hive_pw \

--table test \

--target-dir /sqoop/test \

--delete-target-dir \

--num-mappers 1 \

--fields-terminated-by "\t"

--columns id,bid \ # 导入指定列,如果涉及到多列用逗号分隔,分隔时不要添加空格

--where "id=1" # 指定查询条件(2)增量导入

sqoop import \

--connect jdbc:mysql://192.168.5.114:3306/test \

--username hive \

--password hive_pw \

--table test \

--columns id,bid \

--num-mappers 1 \

--target-dir /sqoop/test \

--incremental append \

--check-column id \

--last-value 1增量导入数据 > last-value指定的值, 这里是从2开始

(3)查询导入-常用

sqoop import \

--connect jdbc:mysql://192.168.5.114:3306/test \

--username hive \

--password hive_pw \

--query 'select * from test where id < 100 and $CONDITIONS;' \

--target-dir /sqoop/test \

--delete-target-dir \

--num-mappers 1 \

--fields-terminated-by "\t"

提示:must contain '$CONDITIONS' in WHERE clause.

如果query后使用的是双引号,则$CONDITIONS前必须加转移符,

防止shell识别为自己的变量。

$CONDITIONS的作用,当有多个map时,用来切割数据用的,不然数据没法分配到多个map1.4:把mysql数据导入hive

sqoop import \

--connect jdbc:mysql://192.168.5.114:3306/test \

--username hive \

--password hive_pw \

--table test \

--num-mappers 1 \

--hive-import \

--fields-terminated-by "\t" \

--create-hive-table \

--hive-overwrite \

--hive-database db_hive \

--hive-table my_test2 \

--columns id,bid \

--where "id=1"

可以接where,columns

--create-hive-table 自动创建hive表

--hive-overwrite # 覆盖数据

--hive-database db_hive # 指定hive库

--hive-table staff_hive # 指定hive表提示:该过程分为两步,第一步将数据导入到HDFS,第二步将导入到HDFS的数据迁移到Hive仓库,第一步默认的临时目录是/user/$username/表名

1.5:把mysql数据导入hbase

Sqoop1.4.7,和HBase2.3.6 兼容性有些问题。将HBase的版本更换成HBase1.3.1

sqoop import \

--connect jdbc:mysql://192.168.5.114:3306/test \

--username hive \

--password hive_pw \

--table test \

--columns "id,bid" \

--column-family "info" \

--hbase-create-table \

--hbase-row-key "id" \

--hbase-table "student" \

--num-mappers 1 \

--split-by id

--------

--hbase-create-table \ # 自动创建hbase表2:导出数据

“导出”概念指:从大数据集群(HDFS,HIVE,HBASE)向非大数据集群(RDBMS)中传输数据

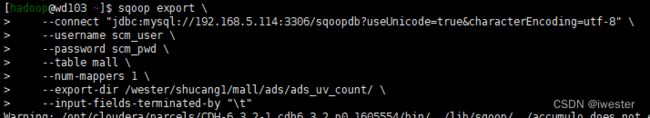

1:HIVE/HDFS到RDBMS

sqoop export \

--connect "jdbc:mysql://192.168.5.114:3306/test?useUnicode=true&characterEncoding=utf-8" \

--username hive \

--password hive_pw \

--table test1 \

--num-mappers 1 \

--export-dir /user/hive/warehouse/db_hive.db/my_test8 \

--input-fields-terminated-by "\t"

如果hive数据包含表情,mysql驱动使用8.x版本,sqoop语句添加characterEncoding

useUnicode=true&characterEncoding=UTF-8&zeroDateTimeBehavior=convertToNull&serverTimezone=GMT%2B8

--connect "jdbc:mysql://192.168.5.114:3306/数据库?useUnicode=true&characterEncoding=utf-8" \提示:Mysql中如果库,表不存在,不会自动创建