【PaLM2】PaLM2 大语言模型与 Bard 使用体验

欢迎关注【youcans的学习笔记】原创作品,火热更新中

【Google I/O 2023】PaLM2 大语言模型与 Bard 使用体验

-

- 1. PaLM2 大型语言模型

-

- 1.1 谷歌发布 PaLM2

- 1.2 PaLM2 的功能与性能

- 2. 基于 PaLM2 的谷歌 AI 产品

-

- 2.1 智能助手 Duet AI

- 2.2 Gmail:帮我写邮件

- 2.3 Google Maps:全新沉浸式视图

- 2.4 Google Photos:魔法编辑体验

- 2.5 让人工智能对每个人更有帮助

- 3. Bard 全面开放

-

- 3.1 对话式 AI 引擎 Bard

- 3.2 Bard 的注册方法

- 3.3 Bard 使用体验

- 4. 新的搜索生成体验

- 5. 推动 Android 的进步

- 6. 推动 AI 创新平台和工具

- 7. 共创未来,迎接新时代

5月11日 Google I/O 开发者大会发布大语言模型 PaLM2(Pathways Language Model 2),称在部分任务上超越 GPT-4。

- 谷歌办公全家桶 Workspace 将集成 Duet AI;

- 谷歌聊天机器人 Bard 全面升级并向所有人开放;

- 谷歌云将上线多个基础大模型,提供生成式 AI 服务。

说明:本文主要内容参考 Google CEO Sundar Pichai 在 Google I/O 2023 的演讲及 Google 相关资料。

1. PaLM2 大型语言模型

1.1 谷歌发布 PaLM2

2017年谷歌提出 transformer 架构,为近年来人工智能突破性发展奠定了基础。

2022年 4月,谷歌发布第一代 PaLM 大型语言模型(Pathways Language Model),在 7800亿 token 的高质量文本上训练 5400 亿参数的稠密自回归 Transformer,在数百个自然语言、代码和数学推理任务上实现了state-of-the-art 的结果。

2023年5月11日,谷歌最新发布了新的大型语言模型模型 PaLM2,推出了超过 25 种由 PaLM 2 提供支持的产品和功能。

PaLM2 建立在谷歌的基础研究和最新的基础设施之上,提供了不同规模的四个版本以便胜任不同任务和部署:“壁虎” (Gecko),“水獭”(Otter)、“野牛”(Bison)和“独角兽”(Unicorn)。轻量级的 Gecko 模型可以在移动设备上运行,速度非常快,可以在设备上运行出色的交互式应用程序,支持离线使用。这使在手机也能运行交互式应用程序,每秒可以处理20个token。

英伟达 Jim Fan 对此表示赞同, **“下一波大型语言模型(LLM)将是移动原生的。一个离线的、永远在线的 LLM 不仅可以降低服务成本,而且还为用户体验开辟了全新的途径。**例如,一个元应用程序可以从你的移动工作流程中学习,并为你实现自动化。”

Sundar Pichai 在演讲中说:

-

PaLM2 是我们以负责任的方式将 AI 带给数十亿人的十年旅程中的最新一步。 它建立在两个世界级研究团队 Brain Team 和 DeepMind 取得的进展之上。

-

回顾过去十年定义性的 AI 突破,这些团队为其中的许多突破做出了贡献:AlphaGo、Transformer、序列到序列模型等等。 所有这些都为我们今天所处的拐点奠定了基础。

-

我们最近将这两个团队合并为一个部门,即 Google DeepMind。 他们利用 Google 的计算资源,专注于安全、负责任地构建功能更强大的系统。

-

这包括我们仍在训练中的下一代基础模型 Gemini。 Gemini 旨在实现多模式、高效的工具和 API 集成,并旨在实现未来的创新,例如记忆和规划。Gemini 将具有像 GPT-4 一样的万亿参数,目前仍在训练中,但已经展示出了以往模型中从未见过的多模态能力。

1.2 PaLM2 的功能与性能

Google DeepMind 副总裁 Zoubin Ghahramani 说:回顾过去十年人工智能领域的最大突破时,谷歌一直走在其中的最前沿。

- 我们在基础模型方面的开创性工作已成为该行业和数十亿人每天使用的人工智能产品的基石。

- 我们如何构建和训练模型的最新进展教会了我们如何解锁多模态、在循环中获得人类反馈的重要性,以及如何比以往更有效地构建模型。

- 我们将继续推进 AI 的最先进水平,同时构建可以为人们的日常生活带来真正好处的模型。

PaLM 2 是一种最先进的语言模型,具有改进的多语言、推理和编码能力。

(1)语言能力:

PaLM2 在多语言文本方面接受了更多的训练,涵盖 100 多种语言。 这显着提高了它在多种语言中理解、生成和翻译细微差别文本(包括成语、诗歌和谜语)的能力。PaLM2 通过了高级语言能力考试,日语水平达到了A 级,法语水平达到了C1级,语言能力已经“足以教授这门语言”。

(2)推理能力:

PaLM2 的广泛数据集包括科学论文和包含数学表达式的网页。 因此,它展示了逻辑、常识推理和数学方面的改进能力。根据 MATH、GSM8K 和 MGSM 基准测试的评估,具有思维链提示的 PaLM2 的部分结果超越了 GPT-4。

(3)编程能力:PaLM2 现在支持 20种编程语言,不仅擅长 Python 和 JavaScript 等流行的编程语言,但也可以生成 Prolog、Fortran 和 Verilog 等语言的专用代码。还可以帮助开发人员在世界各地进行协作

(4)专业领域模型:

-

谷歌健康团队打造的 Med-PaLM2。它能回答各种医学问题,在美国医疗执照考试中达到专家水平。今后将引入多模态,检查 X 光片给出诊断。今年该模型将对部分谷歌云用户开放。

-

面向网络安全维护的Sec-PaLM2。它使用人工智能来帮助分析和解释潜在恶意脚本的行为,快速检测哪些脚本会对个人和组织构成实际威胁。

2. 基于 PaLM2 的谷歌 AI 产品

谷歌的聊天机器人 Bard 以及 25个 AI 产品和功能,都以 PaLM2 作为底层技术支持。

2.1 智能助手 Duet AI

Google Workspace 中的Duet AI 是一个内嵌在各种办公软件中的 AI 助手,类似于微软的 365 Copilot。

谷歌展示了 Duet AI 在Gmail、Google Docs、Google Sheets 中的能力。它可以根据提示补充邮件内容、生成PPT、根据提示生成图片素材、一键生成表格等。Duet AI 助手也能提供编程帮助,包括实时推荐、纠错代码块,并且以对话方式解答编程问题。

Google Workspace 中的 Duet AI 还提供了一些工具,可以根据 Slides 和 Meet 中的文本描述生成图像,在 Sheets 中创建自定义计划等等。

Duet AI 通过自动数据分类和创建自定义计划,帮助您比以往更快地分析和处理表格中的数据。

Duet AI 直接从幻灯片中的文本生成图像。

阅读有关Workspace 最新更新的更多信息。

2.2 Gmail:帮我写邮件

从 Gmail 开始,生成式 AI 正在帮助改进我们的产品。2017年,我们推出智能回复,一键选择简短回复。 接下来是 Smart Compose,它会在您键入时提供写作建议。 Smart Compose 带来了由 AI 提供支持的更高级的写作功能。 在过去的一年里,它们就在 Workspace 中被使用了超过 1800 亿次。 现在,有了更强大的生成模型,我们将在 Gmail 中迈出下一步:“帮我写(Help me write)”

假设您收到一封电子邮件,告知您的航班已取消。 航空公司已经发了代金券,但你真正想要的是全额退款。 你可以回复,并使用“帮我写”。

只需输入您想要的提示——一封要求全额退款的电子邮件——点击创建,就会出现完整的草稿。 它可以方便地从上一封电子邮件中提取航班详细信息。 它看起来与您要发送的内容非常接近,但也许您想进一步完善它。 在这种情况下,更详尽的电子邮件可能会增加获得退款的机会。 “帮我写”将作为我们 Workspace updates 的一部分开始推出。 就像使用 Smart Compose 一样,您会发现它会随着时间的推移变得更好。

2.3 Google Maps:全新沉浸式视图

自街景早期以来,人工智能已经将数十亿张全景图像拼接在一起,因此人们可以通过他们的设备探索世界。 在去年的 I/O 上,我们推出了沉浸式视图,它使用 AI 创建一个地方的高保真表示,因此您可以在访问之前体验它。

现在,我们正在扩展相同的技术来做地图最擅长的事情:帮助你到达你想去的地方。 谷歌地图每天提供 200 亿公里的方向——这是很多次旅行。 现在想象一下,如果你能提前看到你的整个旅程。 无论您是步行、骑自行车还是驾车,都可以使用沉浸式视图查看路线。

假设您在纽约市并且想骑自行车。 地图为您提供了几个靠近您所在位置的选项。 海滨的那个看起来风景优美,但你想先感受一下,所以你点击沉浸式视图查看路线。 这是一种全新的方式来看待您的旅程。 您可以放大以获得令人难以置信的骑行鸟瞰图。

还有更多可用信息。 您可以查看空气质量、交通和天气,看看它们会如何变化。

Immersive View 航线将于夏季开始推出,并于年底前在 15 个城市推出,包括伦敦、纽约、东京和旧金山。

2.4 Google Photos:魔法编辑体验

另一个由 AI 改进的产品是 Google Photos。 我们在 2015 年的 I/O 大会上推出了它,它是我们首批 AI 原生产品之一。 机器学习的突破使搜索照片中的人物、日落或瀑布等事物成为可能。

当然,我们希望您做的不仅仅是搜索照片——我们还希望帮助您改进照片。 事实上,每个月都有 17 亿张图片在 Google 相册中进行编辑。 人工智能的进步为我们提供了更强大的方法来做到这一点。 例如,首先在 Pixel 上推出的 Magic Eraser 使用 AI 驱动的计算摄影来消除不必要的干扰。 今年晚些时候,通过结合语义理解和生成 AI,您可以通过一种名为 Magic Editor 的新体验做更多事情。

这是一个例子:这是一张很棒的照片,但作为父母,您可能希望您的孩子处于一切的中心。 看起来气球在这个中被切断了,所以你可以继续重新定位生日男孩。 Magic Editor 会自动重新创建原始镜头中未捕捉到的部分长凳和气球。 作为画龙点睛之笔,可以一拳冲天。 这也会改变照片其余部分的光线,使编辑感觉一致。 这真的很神奇。 我们很高兴在今年晚些时候在 Google 相册中推出 Magic Editor。

2.5 让人工智能对每个人更有帮助

从 Gmail、Google Maps 到 Photos,这些只是 AI 如何在关键时刻为您提供帮助的几个例子。 我们还有很多工作可以做,以在您了解和喜爱的产品中充分发挥 AI 的潜力。

今天,我们有 15 种产品,每一种都为超过 5 亿人和企业提供服务。 其中六款产品分别为超过 20 亿用户提供服务。 这为我们提供了很多机会来履行我们的使命——组织世界信息并使人人都可以访问和使用这些信息。

这是一个永恒的使命,随着时间的推移,感觉更有意义。 展望未来,让 AI 对每个人都有帮助是我们推进使命的最深刻方式。 我们通过四种重要方式来做到这一点:

首先,通过提高你的知识和学习,加深你对世界的理解。

其次,通过提高创造力和生产力,您可以表达自己并完成工作。

第三,通过使开发人员和企业能够构建自己的变革性产品和服务。

最后,通过负责任地构建和部署人工智能,让每个人都能平等受益

3. Bard 全面开放

3.1 对话式 AI 引擎 Bard

谷歌推出了由 PaLM2 驱动的全新对话式 AI 引擎 Bard,简单地说就是谷歌版的 New Bing Chat。

谷歌说的更具有正能量:

-

随着模型变得更好、更有能力,最令人兴奋的机会之一就是让人们可以直接参与其中。

-

我们早就看到了通过对话式 AI 使信息和计算更容易访问的潜力。两年前,我们推出了LaMDA(对话应用程序语言模型)

-

我们一直在快速发展对话式 AI,Bard 是我们在 3 月份推出的对话式 AI 实验。

-

Bard 完全在 PaLM 2 上运行。它现在支持广泛的编程功能,并且在推理和数学提示方面变得更加智能。

-

Bard 即将支持各种第三方扩展,例如自动根据输入的文本生成图像,根据输入的图像识别内容和回答问题。

谷歌助手副总裁 Sissie Hsiao 说:今天我们将推出 Bard 的新更新,包括图像功能、编码功能和应用程序集成。 此外,我们正在扩大全球访问范围,引入更多语言并结束候补名单,在180个国家或地区提供服务。

注:处于符合当地法律要求的原因,目前暂不向“部分国家和地区”开放。

进一步获取有关Bard 的更新信息,请阅读: Bard 最新更新。

进一步了解 Bard 的原理,请阅读:LaMDA: our breakthrough conversation technology。

Bard 是什么?

我们早就看到了通过对话式人工智能使信息和计算更容易访问的潜力。两年前,我们推出了LaMDA(对话应用程序语言模型),这是一个能够进行流畅、多回合对话的对话式人工模型,并提供关于LaMDA的反馈。

Bard 是一个基于同样技术的实验,可以让你与生成人工智能合作。作为一个富有创造力和乐于助人的合作者,Bard 可以增强你的想象力,提高你的生产力,并帮助你将你的想法付诸实践,无论你是想帮助规划完美的生日派对和起草邀请函,或者简单地理解真正复杂的话题。

如果你对更多的技术细节感兴趣,Bard 是一个基于 Transformer 的模型。该语言模型通过“阅读”数万亿个单词来学习,这有助于它掌握构成人类语言的模式,因此它善于预测什么可能是合理的反应。

Bard 是否给出准确和安全的回应?

Bard 是实验性的,有些回答可能不准确,所以仔细检查 Bard 回答中的信息。

在 Bard 公开发布之前,数千名测试人员参与提供反馈,以帮助 Bard 提高其质量、安全性和准确性。

用生成人工智能加速人们的想法确实令人兴奋,但现在还为时过早,Bard 是一个实验。虽然 Bard 有内置的安全控制和明确的反馈机制,符合我们的人工智能原则,但要注意,它可能会显示不准确的信息或冒犯性的陈述。

3.2 Bard 的注册方法

Bard 是一个让你与生成人工智能合作的实验。

Bard 作为一个富有创造力和乐于助人的合作者,可以增强你的想象力,提高你的生产力。

登录 Bard

要使用 Bard,您需要使用谷歌帐户登录。

你需要什么

您自己管理的个人谷歌帐户,或管理员已启用 Bard 访问权限的谷歌工作区帐户。

年满18岁。

支持的浏览器:Chrome、Safari、Firefox、Opera或Edgium。

重要提示:目前,Bard 仅提供日语、韩语和英语版本。

登录 Bard

- 访问 bard.google.com。

- 在右上角,选择“登录(Sign in)”。

- 登录您的个人谷歌帐户。

退出 Bard

- 访问 bard.google.com。

- 在右上角,选择您的个人资料图片或首字母。

- 选择“注销(Sign out)”。

3.3 Bard 使用体验

Bard 的用户界面如下,非常简单。

使用体验:

1. 图文搜索

【User】What are some must-see sights in New Orleans?

【Bard】

虽然 Bard 支持图文搜索,但该功能对普通用户“即将推出” 。

2. 图像搜索

【User】write a funny caption about these two?

【Bard】

虽然 Bard 支持图像搜索,但该功能对普通用户“即将推出” 。

3. 中文支持

【User】请用中文输出以上内容

【Bard】

目前提供日语、韩语和英语版本。

4. 新的搜索生成体验

随着 AI 继续快速改进,我们专注于为用户提供有用的功能。

(1)多模态搜索体验,Lens 与多模态结合,允许使用图像和文本进行搜索。

计算机视觉的进步引入了视觉搜索的新方法。Lens 与多模态相结合导致了多重搜索,它允许您使用图像和文本进行搜索。现在,即使您不知道用什么词来描述您要查找的内容,您也可以使用 Google Lens 搜索您看到的任何内容。Lens 每个月用于视觉搜索的次数超过 120 亿次。

(2)生成式搜索体验,将生成式AI直接引入谷歌搜索。

Google 对信息的深刻理解与生成 AI 的独特功能相结合,可以再次改变搜索的工作方式,解开搜索可以回答的全新问题,并创造越来越有用的体验,将您与丰富的网络联系起来。

将生成式 AI 应用于搜索仍处于早期阶段。 世界各地的人们在重要时刻都依赖 Google 搜索,我们知道做好这一点并继续赢得他们的信任是多么重要。 那永远是我们的北极星。

(3)搜索提供代码提示,提供代码片段和更快更智能地编写代码。

(4)搜索结果添加到表格,可以将搜索结果直接插入到电子表格中,可以直接从谷歌搜索轻松添加链接。

我们以负责任的态度对待创新,从一开始就力争达到信息质量的最高标准。 这就是为什么我们首先在实验室中为您带来新的搜索生成体验。新的搜索体验可以帮助您快速找到并理解信息。在搜索时,您可以通过AI驱动的概述、探索更多内容的指示以及以自然跟进的方式来了解主题的要点。

我们将为您提供一种新的方式来预览 Workspace 和其他产品的一些体验。如果想试用这些新工具,需要注册 Workspace Labs 加入候补名单。现在,任何人都可以申请加入候补名单。注:处于符合当地法律要求的原因,目前暂不向“部分国家和地区”开放。

5. 推动 Android 的进步

谷歌展示了下一代移动操作系统 Android14 的新能力。

(1)使用 Android 推动进步

我们通过 Android 等计算平台,释放人们的创造力和潜力,惠及尽可能多的人。

我们分享了 AI 的进步如何让您的手机更加个性化,包括 Magic Compose、Cinematic Wallpapers 和 Generative AI Wallpapers。

Magic Compose将于今年夏天在谷歌的默认短信应用 Message中推出测试版,它是一种基于AI生成模型的工具,让你在回短信的时候根据聊天内容获得大量提示。它会学习你的说话方式,你也可以让自己的回复内容看起来有不同的语气,或者用莎士比亚的风格来写。

Generative Wallpapers 使用生成式 AI 来帮你制作独一无二的手机壁纸,和 AI 画图一样使用语言提示完成。

(2)新的 Pixel 平板电脑和折叠手机

我们还推出了 Pixel 7a、Pixel Fold 和 Pixel 平板电脑,以构建由 Google 设计的完整的人工智能设备生态系统。 Pixel 7a 从今天开始可供购买,Pixel Fold 和 Pixel Tablet 现已开放预订。

谷歌发布了 AI 笔记本Project Tailwind,目标受众定位为学生。它就像一个真正的笔记本一样,可以在里面记笔记,而这些内容就是AI学习的对象。用户可以从谷歌云端硬盘中挑选文件,创建一个兼具个性化和私人属性的AI模型。在示例演示中,Tailwind收集了一大堆学习笔记,然后生成了包括主题词在内的很多内容,比如用户可以为特定主题创建术语表。

(3)专为 Android 开发的 AI 编码机器人 Studio Bot

Studio Bot 不仅可以生成代码、修复BUG,还能回答关于 Android 应用开发的相关问题,同时支持 Kotlin 和 Java 编程语言,并将直接嵌入到 Android Studio 开发工具的工具栏中。

6. 推动 AI 创新平台和工具

AI 不仅是一个强大的推动者,也是一个巨大的平台转变。 每个企业和组织都在思考如何推动转型。 这就是为什么我们专注于让其他人能够轻松且可扩展地利用 AI 进行创新。

这意味着提供最先进的计算基础设施——包括最先进的 TPU 和 GPU——并扩大对谷歌最新基础模型的访问,这些模型已经在我们自己的产品中经过严格测试。 我们还致力于提供世界一流的工具,以便客户可以训练、微调和运行他们自己的模型——具有企业级的安全、保障和隐私。

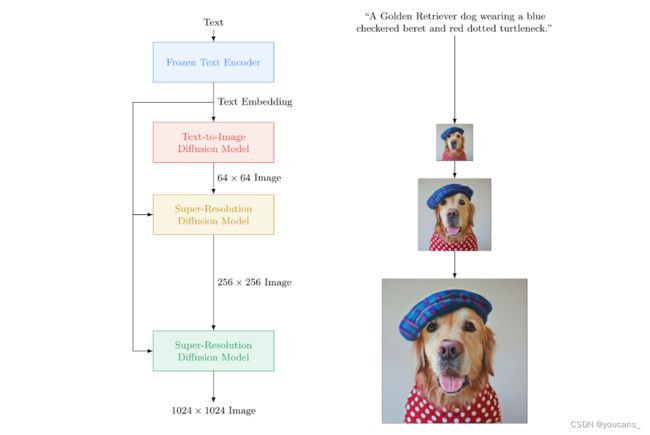

谷歌为云端机器学习平台 Vertex AI 推出了三款大模型:

- Codey:text-to-code,帮助程序员写代码

- Imagen:text-to-image,生成高质量图像

- Chirp:speech-to-text,方便沟通

在 Vertex AI 上还能使用文本和图像的嵌入式API。它支持将文本和图像数据转换为多维数值向量、映射语义关系,从而允许开发者创建出更加创新的应用。

谷歌云发布了一款新的 A3 超级计算机虚拟机。

-

A3 GPU VM 专为当今的机器学习工作负载提供最高性能的训练而设计。

-

A3 GPU VM 配备 Nvidia H100 GPU,可以获得具有高吞吐量和低延迟的巨大计算能力。

7. 共创未来,迎接新时代

我一直在反思我们都参与其中的重大技术变革。 AI 的转变与它们来时一样大,这就是为什么我们让 AI 对每个人都有帮助如此重要。 我们怀着兴奋的心情大胆地接近它。 我们正在以一种负责任的方式来做这件事,这种方式强调了我们对把它做好的坚定承诺。

没有一家公司可以单独做到这一点。 我们的开发者社区将是释放未来巨大机遇的关键。 我们期待着共同努力,共同建设。

最后,“这个新时代,是承前启后、继往开来的时代…

参考资料:

Google CEO Sundar Pichai 在 Google I/O 2023 的演讲,[https://blog.google/technology/ai/google-io-2023-keynote-sundar-pichai/#ai-products]

及 Google 相关资料。

版权声明:

欢迎关注【youcans的 AIGC 学习笔记】,转发请注明原文链接:【PaLM2】PaLM2 大语言模型与 Bard 使用体验

Copyright 2023 youcans, XUPT

Crated:2023-05-12