Redis入门笔记

Redis快速入门

- 1 初识Redis

-

- 1.1.认识NoSQL

-

- 1.1.1.结构化与非结构化

- 1.1.2.关联和非关联

- 1.1.3.查询方式

- 1.1.4.事务

- 1.1.5.总结

- 1.2.认识Redis

- 1.3.安装Redis

-

- 1.3.1.依赖库

- 1.3.2.上传安装包并解压

- 1.3.3.启动

- 1.3.4.默认启动

- 1.3.5.指定配置启动

- 1.3.6.开机自启

- 1.4.Redis桌面客户端

-

- 1.4.1.Redis命令行客户端

- 1.4.2.图形化桌面客户端

- 1.4.3.安装

- 1.4.4.建立连接

- 2 Redis常见命令

-

- 2.1.Redis通用命令

- 2.2.String类型

-

- 2.2.1.String的常见命令

- 2.2.2.Key结构

- 2.3.Hash类型

- 2.4.List类型

- 2.5.Set类型

- 2.6.SortedSet类型

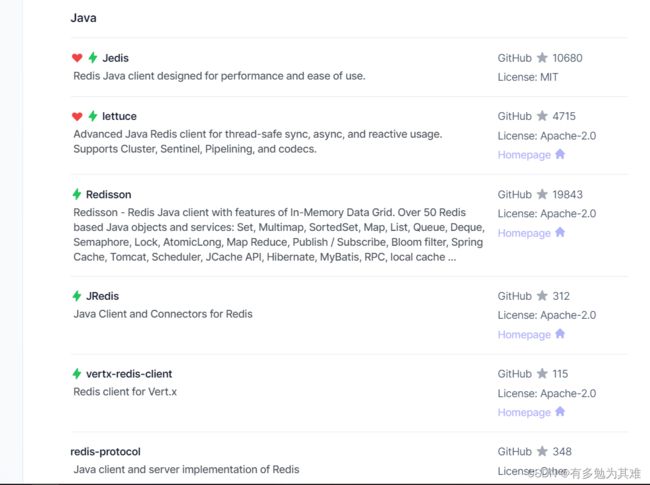

- 3 Redis的Java客户端

-

- 3.1.Jedis客户端

-

- 3.1.1.快速入门

- 3.1.2.连接池

- 3.2.SpringDataRedis客户端

-

- 3.2.1.快速入门

-

- 1)引入依赖

- 2)配置Redis

- 3)注入RedisTemplate

- 4)编写测试

- 3.2.2.自定义序列化

- 3.2.3.StringRedisTemplate

- 4 Redis短信登录核心代码

- 5 什么是缓存?

-

- 1. 为什么要使用缓存

- 2. 如何使用缓存

- 3. 缓存模型和思路

- 4. 缓存练习题

- 6 缓存更新策略

-

- 1. 数据库缓存不一致解决方案

- 2. 数据库和缓存不一致采用什么方案

- 3. 实现商铺和缓存与数据库双写一致

- 7 缓存穿透问题

-

- 1. 解决思路

- 2. 解决方案

- 8 缓存雪崩问题解决思路

- 9 缓存击穿问题及解决思路

-

- 解决方案一、使用锁来解决:

- 解决方案二、逻辑过期方案

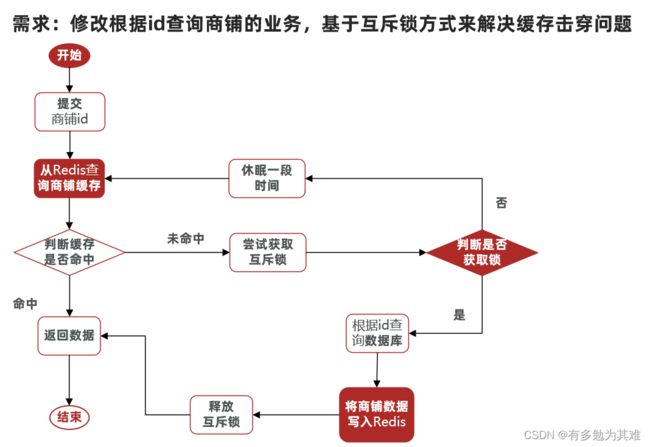

- 利用互斥锁解决缓存击穿问题

- 利用逻辑过期解决缓存击穿问题

-

- 3.1、封装Redis工具类

- 10 优惠卷秒杀

-

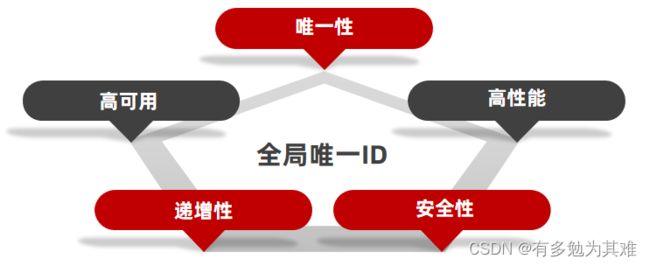

- 1. 全局唯一ID

- 2. Redis实现全局唯一Id

- 3. 实现秒杀下单

- 4. 库存超卖问题分析

- 5. 乐观锁解决超卖问题

- 6. 优惠券秒杀-一人一单

- 7. 集群环境下的并发问题

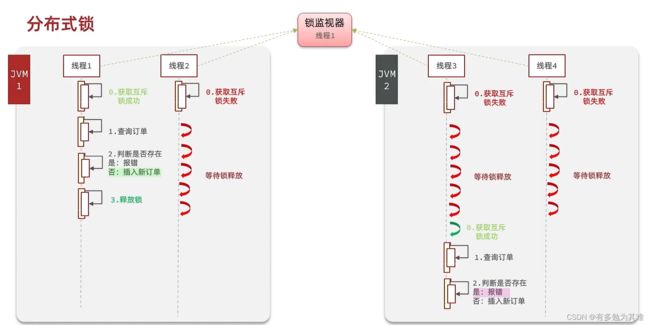

- 11 分布式锁

-

- 1. 基本原理和实现方式对比

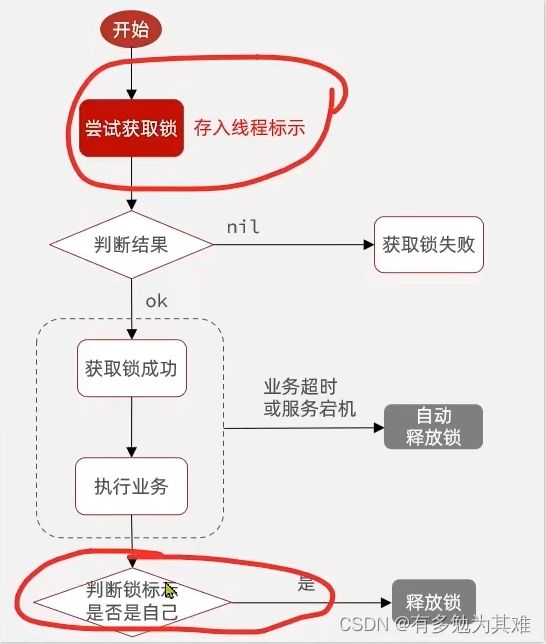

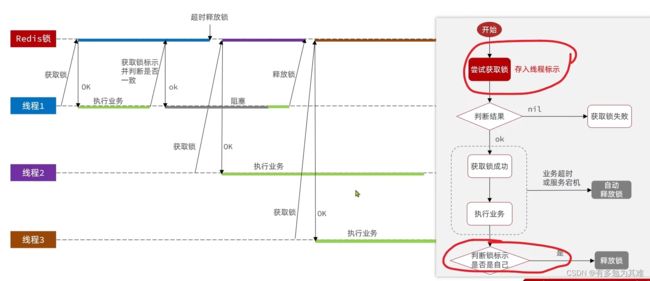

- 2. Redis分布式锁的实现核心思路

- 3. 实现分布式锁版本一

- 4. Redis分布式锁误删情况说明

- 5. 解决Redis分布式锁误删问题

- 6. 分布式锁的原子性问题

-

- 1. Lua脚本解决多条命令原子性问题

- 2. 利用Java代码调用Lua脚本改造分布式锁

- 12 分布式锁-redission

-

- 1. 分布式锁-redission功能介绍

- 2. 分布式锁-Redission快速入门

- 3. 分布式锁-redission可重入锁原理

- 4. 分布式锁-redission锁重试和WatchDog机制

- 5. 分布式锁-redission锁的MutiLock原理

- 13 秒杀优化

-

- 1. 秒杀优化-异步秒杀思路

- 2. 秒杀优化-Redis完成秒杀资格判断

- 3. 秒杀优化-基于阻塞队列实现秒杀优化

- 4. Redis消息队列(了解)

-

- 4.1 Redis消息队列-认识消息队列

- 4.2 Redis消息队列-基于List实现消息队列

- 4.3 Redis消息队列-基于PubSub的消息队列

- 4.4 Redis消息队列-基于Stream的消息队列

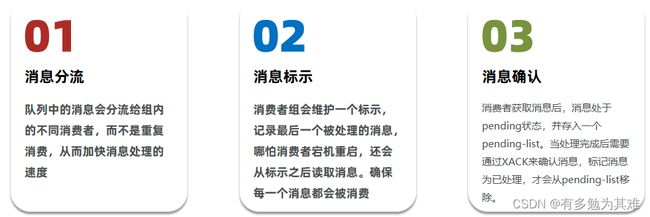

- 4.5 Redis消息队列-基于Stream的消息队列-消费者组

- 4.6 基于Redis的Stream结构作为消息队列,实现异步秒杀下单

- 14 达人探店

-

- 14.1 达人探店-发布探店笔记

- 14.2 达人探店-查看探店笔记

- 14.3 达人探店-点赞功能

- 14.4 达人探店-点赞排行榜

- 15 好友关注

-

- 15.1 好友关注-关注和取消关注

- 15.2 好友关注-共同关注

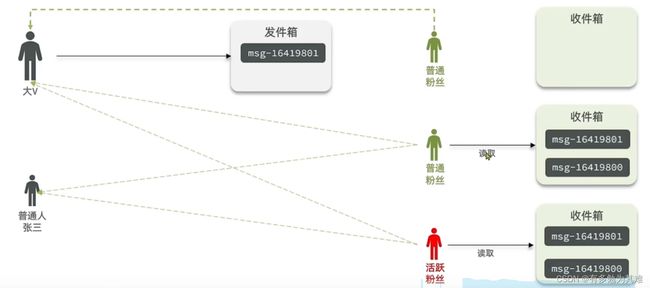

- 15.3 好友关注-Feed流实现方案

- 15.4 好友关注-推送到粉丝收件箱

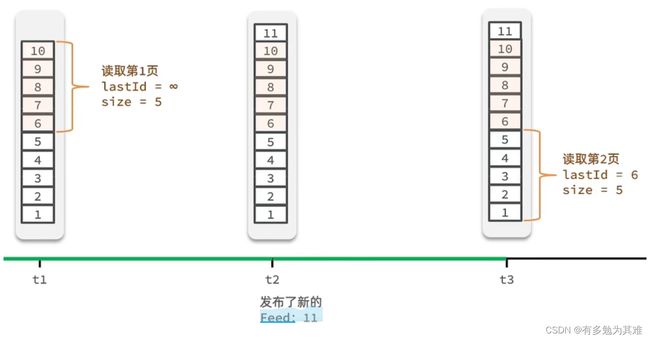

- 15.5好友关注-实现分页查询收邮箱

- 16 附近商户

-

- 16.1 附近商户-GEO数据结构的基本用法

-

- 1. 练习Redis的GEO功能

- 16.2 附近商户-导入店铺数据到GEO

- 16.3 附近商户-实现附近商户功能

- 17 用户签到

-

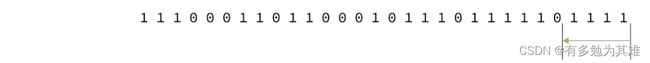

- 17.1 用户签到-BitMap功能演示

- 17.2 用户签到-实现签到功能

- 17.3 用户签到-签到统计

- 17.4 额外加餐-关于使用bitmap来解决缓存穿透的方案

- 18 UV统计

-

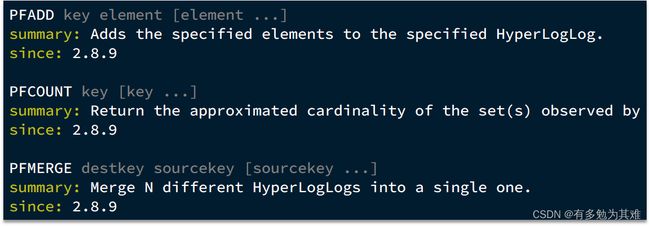

- 18.1 UV统计-HyperLogLog

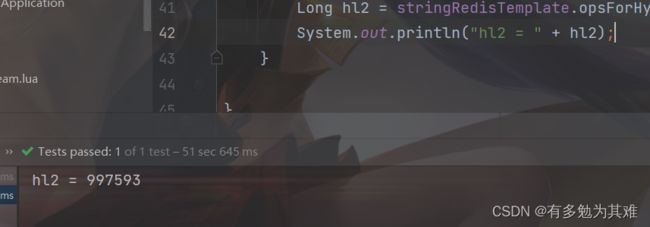

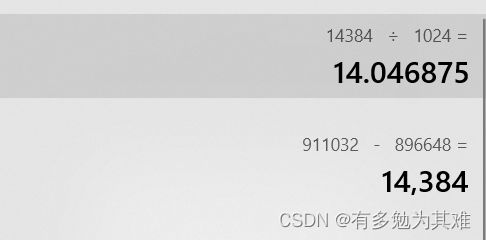

- 18.2 UV统计-测试百万数据的统计

- 19 总结RedisTemplate的基本操作

-

- 1 String类型操作

- 2 Hash类型

- 3 list类型

- 4 Set类型

- 5 zSet类型

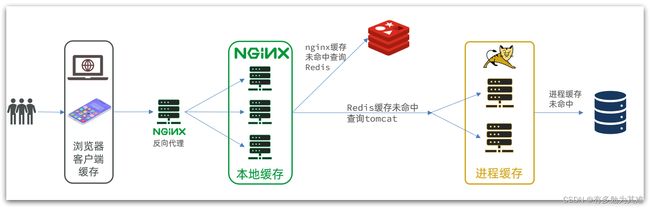

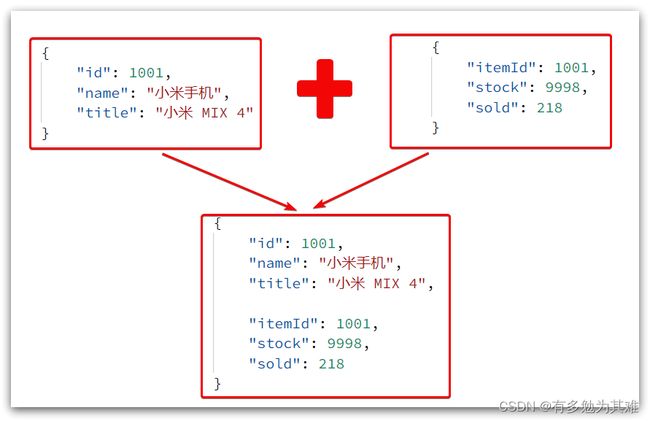

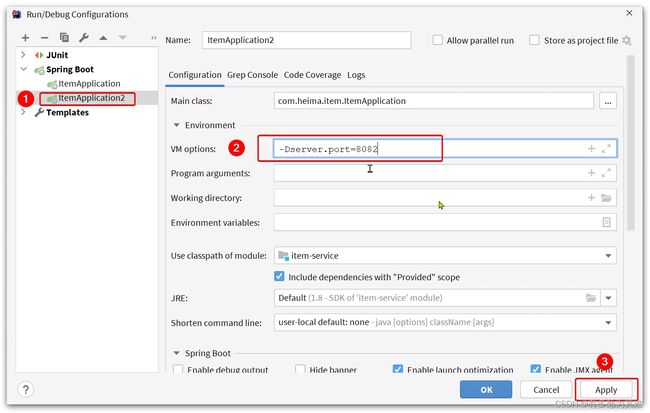

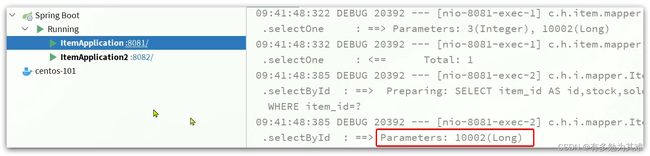

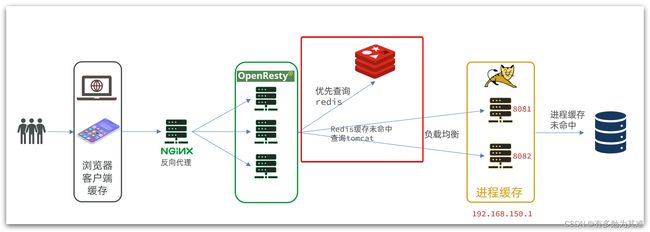

- 20 多级缓存(了解)

-

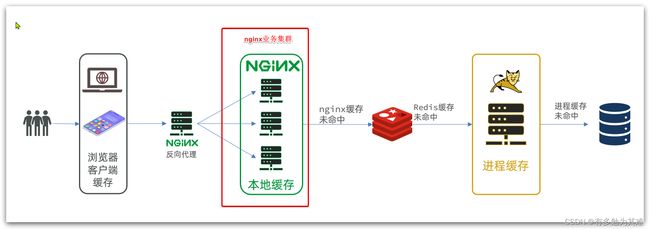

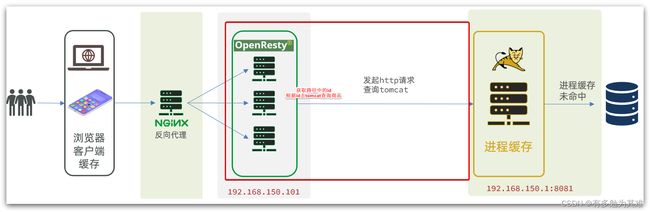

- 1.什么是多级缓存

- 2.JVM进程缓存

-

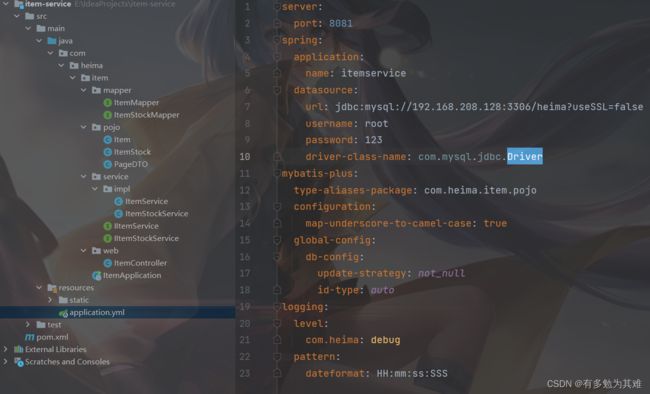

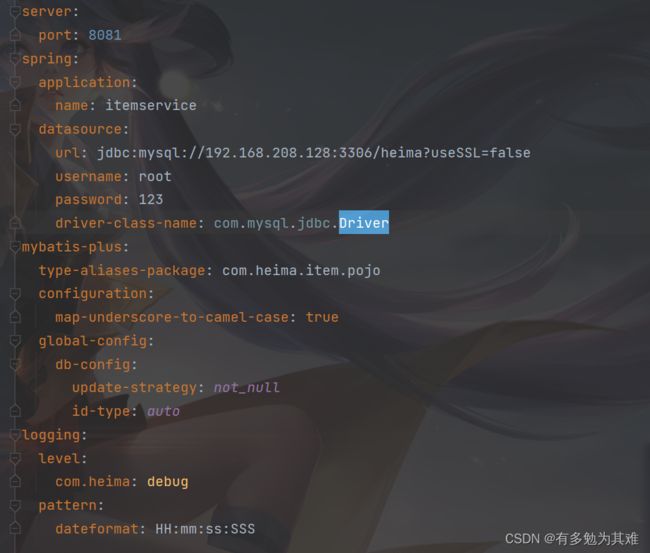

- 2.1.导入案例

-

- 案例导入说明

- 1.安装MySQL

-

- 1.1.准备目录

- 1.2.运行命令

- 1.3.修改配置

- 1.4.重启

- 2.导入SQL

- 3.导入Demo工程

-

-

- 3.1.启动

-

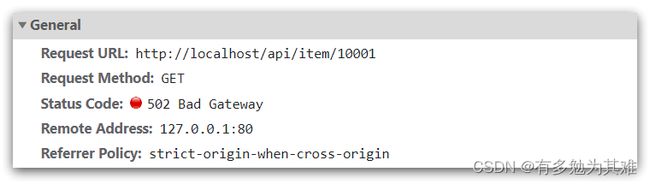

- 4.导入商品查询页面

-

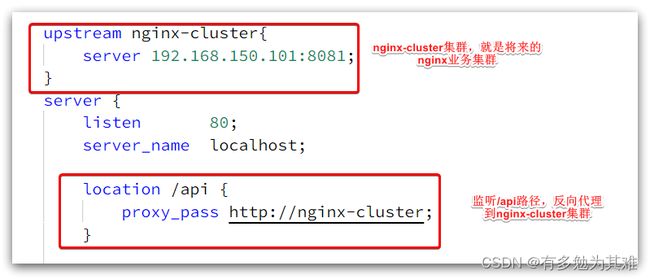

- 4.1.运行nginx服务

- 4.2.反向代理

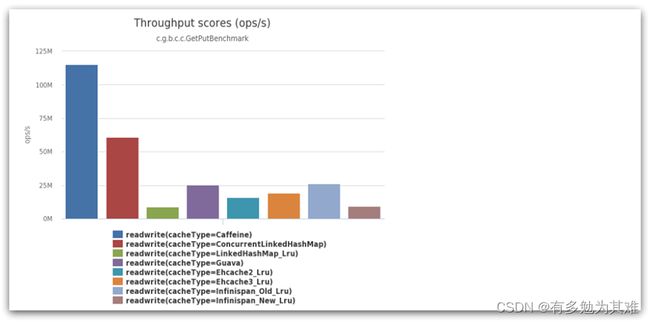

- 2.2.初识Caffeine

-

- 2.3.实现JVM进程缓存

-

- 2.3.1.需求

- 2.3.2.实现

- 3.Lua语法入门

-

- 3.1.初识Lua

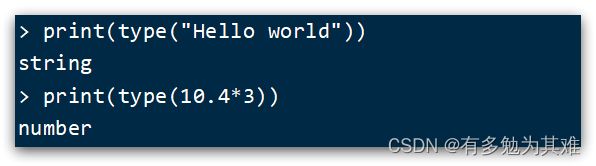

- 3.1.HelloWorld

- 3.2.变量和循环

-

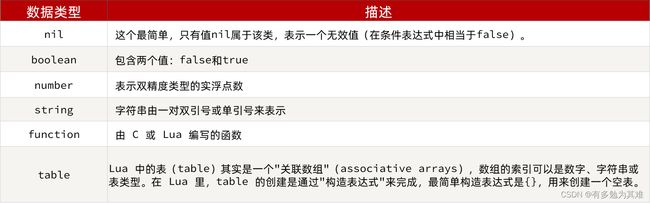

- 3.2.1.Lua的数据类型

- 3.2.2.声明变量

- 3.2.3.循环

- 3.3.条件控制、函数

-

- 3.3.1.函数

- 3.3.2.条件控制

- 3.3.3.案例

- 4.实现多级缓存

-

- 4.1.安装OpenResty

-

- 1.安装

-

- **1)安装开发库**

- **2)安装OpenResty仓库**

- **3)安装OpenResty**

- **4)安装opm工具**

- **5)目录结构**

- **6)配置nginx的环境变量**

- 2.启动和运行

- 3.备注

- 4.2.OpenResty快速入门

-

- 4.2.1.反向代理流程

- 4.2.2.OpenResty监听请求

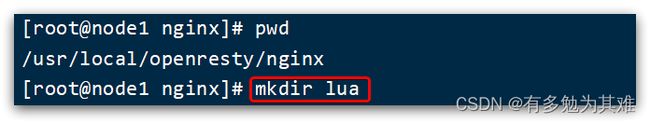

- 4.2.3.编写item.lua

- 4.3.请求参数处理

-

- 4.3.1.获取参数的API

- 4.3.2.获取参数并返回

- 4.4.查询Tomcat

-

- 4.4.1.发送http请求的API

- 4.4.2.封装http工具

- 4.4.3.CJSON工具类

- 4.4.4.实现Tomcat查询

- 4.4.5.基于ID负载均衡

-

- 1)原理

- 2)实现

- 3)测试

- 4.5.Redis缓存预热

- 4.6.查询Redis缓存

-

- 4.6.1.封装Redis工具

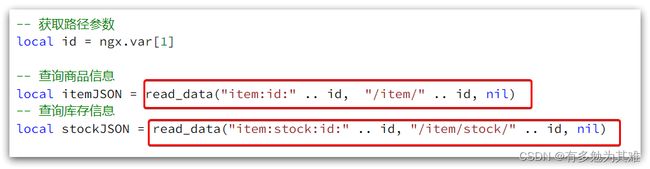

- 4.6.2.实现Redis查询

- 4.7.Nginx本地缓存

-

- 4.7.1.本地缓存API

- 4.7.2.实现本地缓存查询

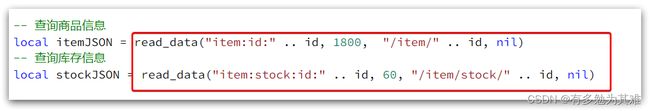

- 5.缓存同步

-

- 5.1.数据同步策略

- 5.2.安装Canal

-

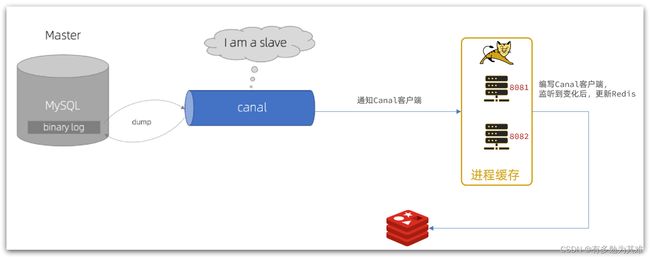

- 5.2.1.认识Canal

- 5.2.2.安装和配置Canal

-

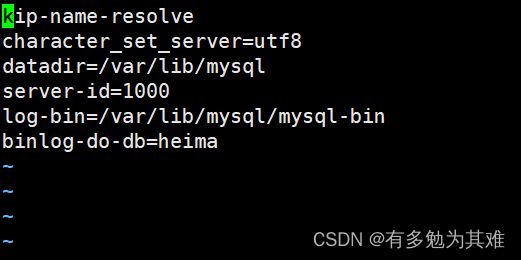

- 1.开启MySQL主从

-

- 1.1.开启binlog

- 1.2.设置用户权限

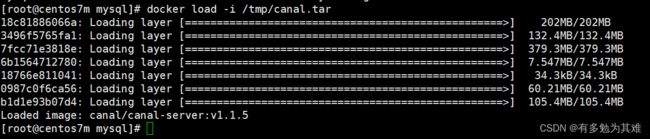

- 2.安装Canal

-

- 2.1.创建网络

- 2.3.安装Canal

- 5.3.监听Canal

-

- 5.3.1.引入依赖:

- 5.3.2.编写配置:

- 5.3.3.修改Item实体类

- 5.3.4.编写监听器

- Redis高级篇之最佳实践

-

- 1、Redis键值设计

-

- 1.1、优雅的key结构

- 1.2、拒绝BigKey

-

- 1.2.1、BigKey的危害

- 1.2.2、如何发现BigKey

-

- ①redis-cli --bigkeys

- ②scan扫描

- ③第三方工具

- ④网络监控

- 1.2.3、如何删除BigKey

- 1.3、恰当的数据类型

-

- 例1:比如存储一个User对象,我们有三种存储方式:

-

- ①方式一:json字符串

- ②方式二:字段打散

- ③方式三:hash(推荐)

- 例2:假如有hash类型的key,其中有100万对field和value,field是自增id,这个key存在什么问题?如何优化?

-

- 方案一

- 方案二

- 1.4、总结

- 2、批处理优化

-

- 2.1、Pipeline

-

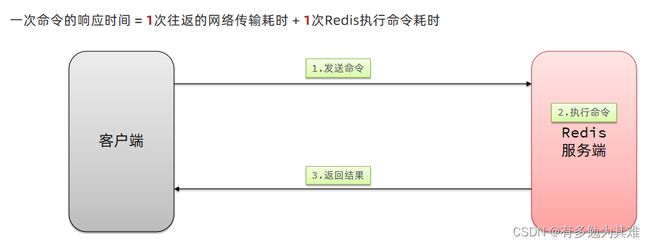

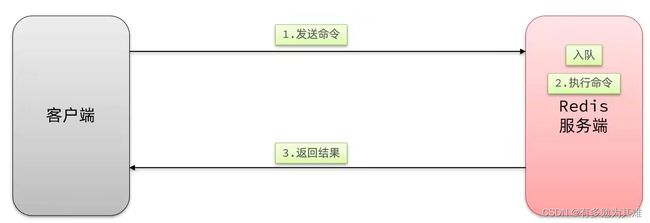

- 2.1.1、我们的客户端与redis服务器是这样交互的

- 2.1.2、MSet

- 2.1.3、Pipeline

- 2.2、集群下的批处理

-

- 2.2.1 串行化执行代码实践

- 3、服务器端优化-持久化配置

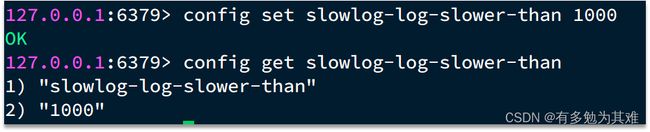

- 4、服务器端优化-慢查询优化

-

- 4.1 什么是慢查询

- 4.2 如何查看慢查询

- 5、服务器端优化-命令及安全配置

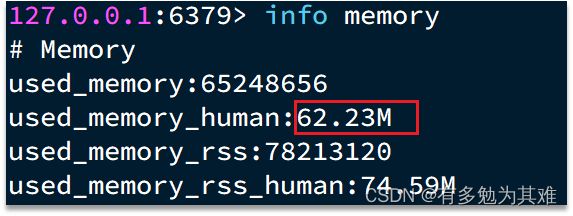

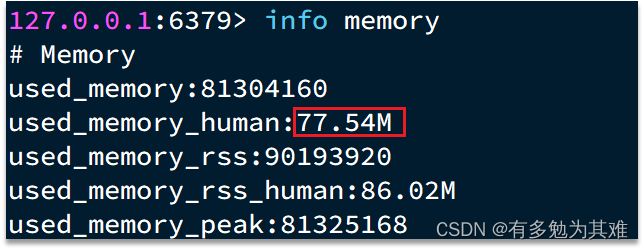

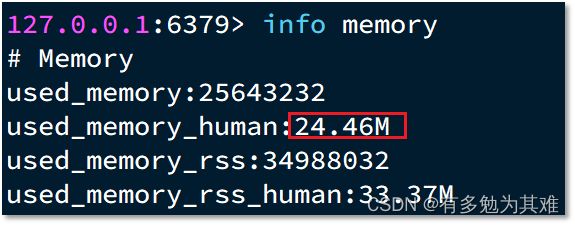

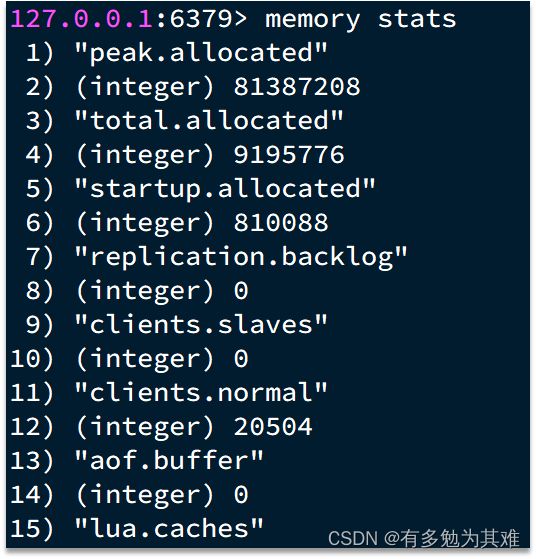

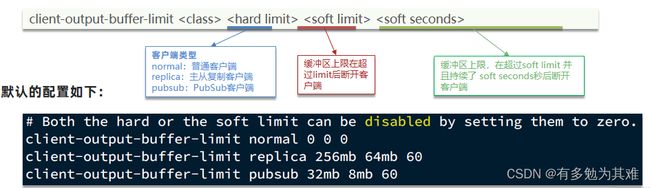

- 6、服务器端优化-Redis内存划分和内存配置

- 7、服务器端集群优化-集群还是主从

- 21 Redis原理篇(了解)

-

- 1、原理篇-Redis数据结构

-

- 1.1 Redis数据结构-动态字符串

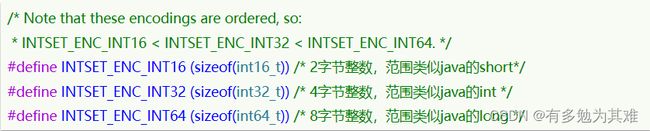

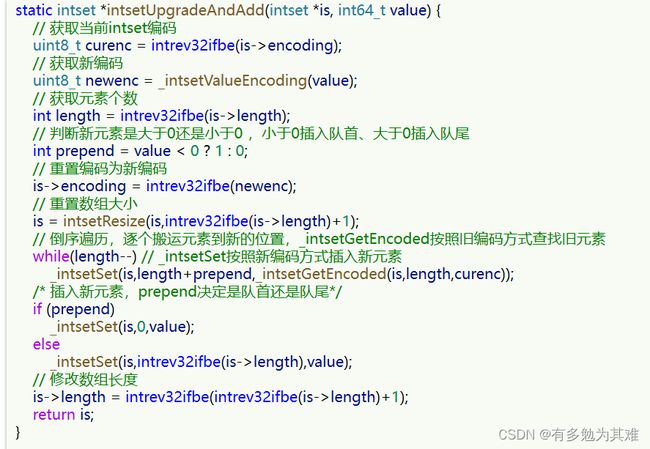

- 1.2 Redis数据结构-intset

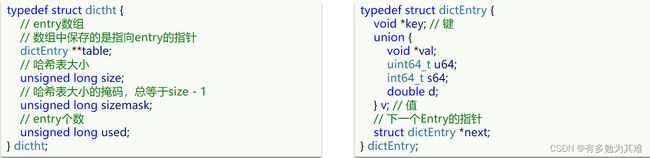

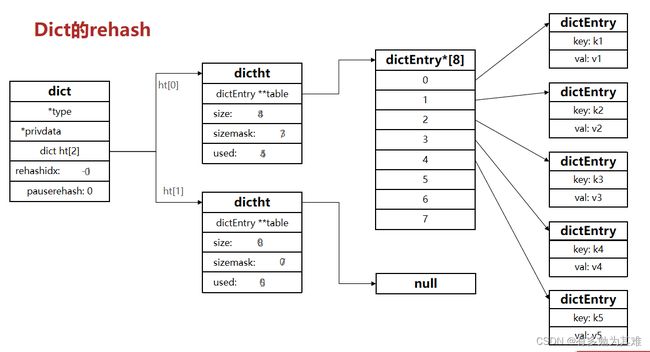

- 1.3 Redis数据结构-Dict

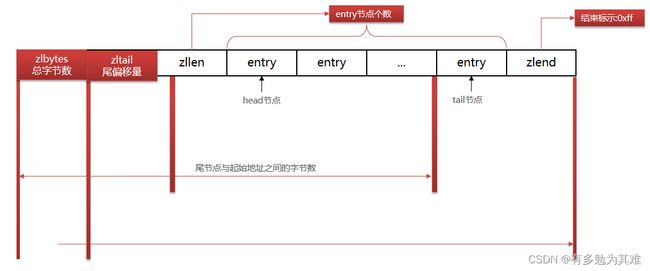

- 1.4 Redis数据结构-ZipList

- 1.5 Redis数据结构-ZipList的连锁更新问题

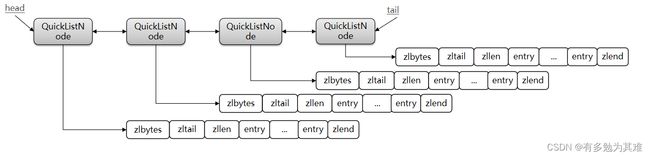

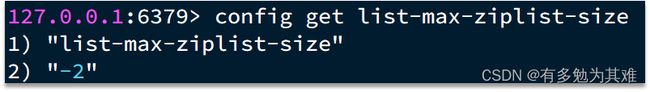

- 1.6 Redis数据结构-QuickList

- 1.7 Redis数据结构-RedisObject

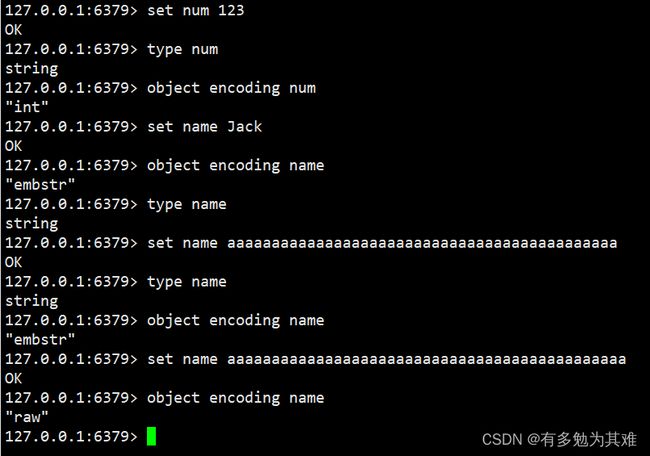

- 1.8 Redis数据结构-String

- 1.9 Redis数据结构-List

- 2.0 Redis数据结构-Set结构

- 2.1、Redis数据结构-ZSET

- 2.2 、Redis数据结构-Hash

- 2、原理篇-Redis网络模型

-

- 2.1 用户空间和内核态空间

- 2.2.网络模型-阻塞IO

- 2.3 网络模型-非阻塞IO

- 2.4 网络模型-IO多路复用

- 2.5 网络模型-IO多路复用-select方式

- 2.6 网络模型-IO多路复用模型-poll模式

- 2.7 网络模型-IO多路复用模型-epoll函数

- 2.8、网络模型-epoll中的ET和LT

- 2.9 网络模型-基于epoll的服务器端流程

- 3.0 、网络模型-信号驱动

-

- 3.0.1 异步IO

- 3.0.2 对比

- 3.1 、网络模型-Redis是单线程的吗?为什么使用单线程

- 3.2 、Redis的单线程模型-Redis单线程和多线程网络模型变更

- 3、Redis通信协议-RESP协议

-

- 3.1、Redis通信协议-基于Socket自定义Redis的客户端

- 3.2、Redis内存回收-过期key处理

- 3.3 Redis内存回收-内存淘汰策略

1 初识Redis

Redis是一种键值型的NoSql数据库,这里有两个关键字:

-

键值型

-

NoSql

其中键值型,是指Redis中存储的数据都是以key、value对的形式存储,而value的形式多种多样,可以是字符串、数值、甚至json:

而NoSql则是相对于传统关系型数据库而言,有很大差异的一种数据库。

1.1.认识NoSQL

NoSql可以翻译做Not Only Sql(不仅仅是SQL),或者是No Sql(非Sql的)数据库。是相对于传统关系型数据库而言,有很大差异的一种特殊的数据库,因此也称之为非关系型数据库。

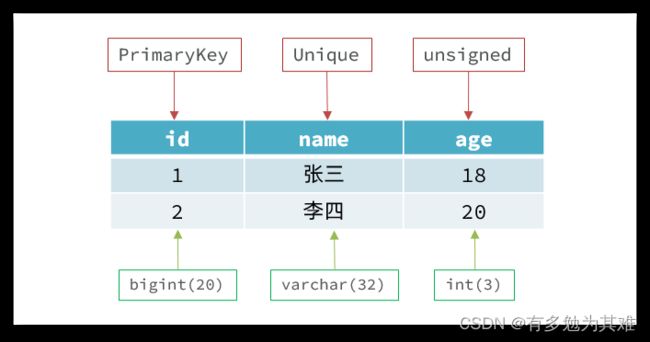

1.1.1.结构化与非结构化

传统关系型数据库是结构化数据,每一张表都有严格的约束信息:字段名、字段数据类型、字段约束等等信息,插入的数据必须遵守这些约束:

而NoSql则对数据库格式没有严格约束,往往形式松散,自由。

可以是键值型:

也可以是文档型:

甚至可以是图格式:

![]()

1.1.2.关联和非关联

传统数据库的表与表之间往往存在关联,例如外键:

而非关系型数据库不存在关联关系,要维护关系要么靠代码中的业务逻辑,要么靠数据之间的耦合:

{

id: 1,

name: "张三",

orders: [

{

id: 1,

item: {

id: 10, title: "荣耀6", price: 4999

}

},

{

id: 2,

item: {

id: 20, title: "小米11", price: 3999

}

}

]

}

此处要维护“张三”的订单与商品“荣耀”和“小米11”的关系,不得不冗余的将这两个商品保存在张三的订单文档中,不够优雅。还是建议用业务来维护关联关系。

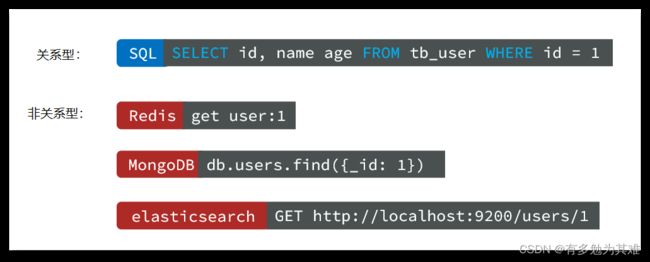

1.1.3.查询方式

传统关系型数据库会基于Sql语句做查询,语法有统一标准;

而不同的非关系数据库查询语法差异极大,五花八门各种各样。

1.1.4.事务

传统关系型数据库能满足事务ACID的原则。

而非关系型数据库往往不支持事务,或者不能严格保证ACID的特性,只能实现基本的一致性。

1.1.5.总结

除了上述四点以外,在存储方式、扩展性、查询性能上关系型与非关系型也都有着显著差异,总结如下:

![]()

- 存储方式

- 关系型数据库基于磁盘进行存储,会有大量的磁盘IO,对性能有一定影响

- 非关系型数据库,他们的操作更多的是依赖于内存来操作,内存的读写速度会非常快,性能自然会好一些

- 扩展性

- 关系型数据库集群模式一般是主从,主从数据一致,起到数据备份的作用,称为垂直扩展。

- 非关系型数据库可以将数据拆分,存储在不同机器上,可以保存海量数据,解决内存大小有限的问题。称为水平扩展。

- 关系型数据库因为表之间存在关联关系,如果做水平扩展会给数据查询带来很多麻烦

1.2.认识Redis

Redis诞生于2009年全称是Remote Dictionary Server 远程词典服务器,是一个基于内存的键值型NoSQL数据库。

特征:

- 键值(key-value)型,value支持多种不同数据结构,功能丰富

- 单线程,每个命令具备原子性

- 低延迟,速度快(基于内存、IO多路复用、良好的编码)。

- 支持数据持久化

- 支持主从集群、分片集群

- 支持多语言客户端

作者:Antirez

Redis的官方网站地址:https://redis.io/

1.3.安装Redis

大多数企业都是基于Linux服务器来部署项目,而且Redis官方也没有提供Windows版本的安装包。因此课程中我们会基于Linux系统来安装Redis.

此处选择的Linux版本为CentOS 7.

1.3.1.依赖库

Redis是基于C语言编写的,因此首先需要安装Redis所需要的gcc依赖:

yum install -y gcc tcl

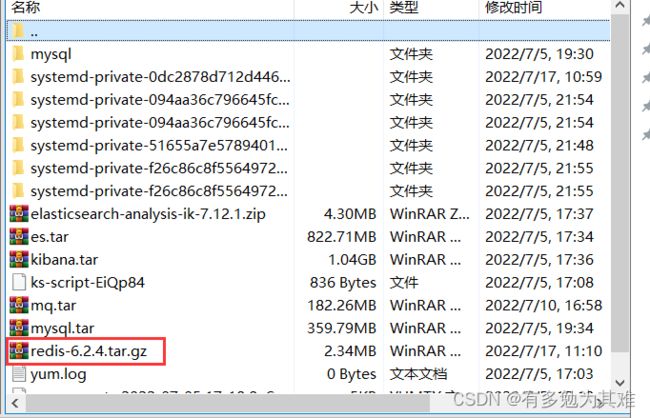

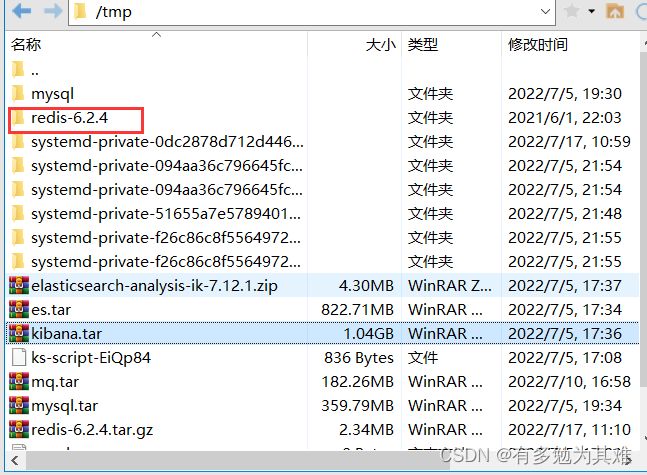

1.3.2.上传安装包并解压

然后将课前资料提供的Redis安装包上传到虚拟机的任意目录:

例如,我放到了/usr/local/src 目录:

解压缩:

tar -xzf redis-6.2.6.tar.gz

解压后:

进入redis目录:

cd redis-6.2.6

运行编译命令:

make && make install

如果没有出错,应该就安装成功了。

默认的安装路径是在 /usr/local/bin目录下:

该目录已经默认配置到环境变量,因此可以在任意目录下运行这些命令。其中:

- redis-cli:是redis提供的命令行客户端

- redis-server:是redis的服务端启动脚本

- redis-sentinel:是redis的哨兵启动脚本

1.3.3.启动

redis的启动方式有很多种,例如:

- 默认启动

- 指定配置启动

- 开机自启

1.3.4.默认启动

安装完成后,在任意目录输入redis-server命令即可启动Redis:

redis-server

直接启动

这种启动属于前台启动,会阻塞整个会话窗口,窗口关闭或者按下CTRL + C则Redis停止。不推荐使用。

1.3.5.指定配置启动

如果要让Redis以后台方式启动,则必须修改Redis配置文件,就在我们之前解压的redis安装包下(/usr/local/src/redis-6.2.6),名字叫redis.conf:

我们先将这个配置文件备份一份:

cp redis.conf redis.conf.bck

然后修改redis.conf文件中的一些配置:

在安装目录下

# 允许访问的地址,默认是127.0.0.1,会导致只能在本地访问。修改为0.0.0.0则可以在任意IP访问,生产环境不要设置为0.0.0.0

bind 0.0.0.0

# 守护进程,修改为yes后即可后台运行

daemonize yes

# 密码,设置后访问Redis必须输入密码

requirepass 123321

Redis的其它常见配置:

# 监听的端口

port 6379

# 工作目录,默认是当前目录,也就是运行redis-server时的命令,日志、持久化等文件会保存在这个目录

dir .

# 数据库数量,设置为1,代表只使用1个库,默认有16个库,编号0~15

databases 1

# 设置redis能够使用的最大内存

maxmemory 512mb

# 日志文件,默认为空,不记录日志,可以指定日志文件名

logfile "redis.log"

启动Redis:

# 进入redis安装目录

cd /usr/local/src/redis-6.2.6

# 启动

redis-server redis.conf

停止服务:

# 没有密码停止

redis-cli shutdown

# 利用redis-cli来执行 shutdown 命令,即可停止 Redis 服务,

# 因为之前配置了密码,因此需要通过 -u 来指定密码

redis-cli -u 123321 shutdown

1.3.6.开机自启

我们也可以通过配置来实现开机自启。

首先,新建一个系统服务文件:

vi /etc/systemd/system/redis.service

内容如下:

[Unit]

Description=redis-server

After=network.target

[Service]

Type=forking

ExecStart=/usr/local/bin/redis-server /usr/local/src/redis-6.2.6/redis.conf

PrivateTmp=true

[Install]

WantedBy=multi-user.target

然后重载系统服务:

systemctl daemon-reload

现在,我们可以用下面这组命令来操作redis了:

# 启动

systemctl start redis

# 停止

systemctl stop redis

# 重启

systemctl restart redis

# 查看状态

systemctl status redis

执行下面的命令,可以让redis开机自启:

systemctl enable redis

1.4.Redis桌面客户端

安装完成Redis,我们就可以操作Redis,实现数据的CRUD了。这需要用到Redis客户端,包括:

- 命令行客户端

- 图形化桌面客户端

- 编程客户端

1.4.1.Redis命令行客户端

Redis安装完成后就自带了命令行客户端:redis-cli,使用方式如下:

redis-cli [options] [commonds]

其中常见的options有:

-h 127.0.0.1:指定要连接的redis节点的IP地址,默认是127.0.0.1-p 6379:指定要连接的redis节点的端口,默认是6379-a 123321:指定redis的访问密码

其中的commonds就是Redis的操作命令,例如:

ping:与redis服务端做心跳测试,服务端正常会返回pong

不指定commond时,会进入redis-cli的交互控制台

redis-cli -a 123321

1.4.2.图形化桌面客户端

GitHub上的大神编写了Redis的图形化桌面客户端,地址:https://github.com/uglide/RedisDesktopManager

不过该仓库提供的是RedisDesktopManager的源码,并未提供windows安装包。

在下面这个仓库可以找到安装包:https://github.com/lework/RedisDesktopManager-Windows/releases

1.4.3.安装

解压缩后,运行安装程序即可安装:

安装完成后,在安装目录下找到rdm.exe文件:

双击即可运行

1.4.4.建立连接

略,研究一下就会了

Redis默认有16个仓库,编号从0至15. 通过配置文件可以设置仓库数量,但是不超过16,并且不能自定义仓库名称。

如果是基于redis-cli连接Redis服务,可以通过select命令来选择数据库:

# 选择 0号库

select 0

2 Redis常见命令

Redis是典型的key-value数据库,key一般是字符串,而value包含很多不同的数据类型:

Redis为了方便我们学习,将操作不同数据类型的命令也做了分组,在官网( https://redis.io/commands )可以查看到不同的命令

不同类型的命令称为一个group,我们也可以通过help命令来查看各种不同group的命令:

接下来,我们就学习常见的五种基本数据类型的相关命令。

2.1.Redis通用命令

通用指令是部分数据类型的,都可以使用的指令,常见的有:

- KEYS:查看符合模板的所有key

- DEL:删除一个指定的key

- EXISTS:判断key是否存在

- EXPIRE:给一个key设置有效期,有效期到期时该key会被自动删除

- TTL:查看一个KEY的剩余有效期

通过help [command] 可以查看一个命令的具体用法,例如:

# 查看keys命令的帮助信息:

127.0.0.1:6379> help keys

KEYS pattern

summary: Find all keys matching the given pattern

since: 1.0.0

group: generic

2.2.String类型

String类型,也就是字符串类型,是Redis中最简单的存储类型。

其value是字符串,不过根据字符串的格式不同,又可以分为3类:

- string:普通字符串

- int:整数类型,可以做自增、自减操作

- float:浮点类型,可以做自增、自减操作

不管是哪种格式,底层都是字节数组形式存储,只不过是编码方式不同。字符串类型的最大空间不能超过512m.

![]()

2.2.1.String的常见命令

String的常见命令有:

- SET:添加或者修改已经存在的一个String类型的键值对

- GET:根据key获取String类型的value

- MSET:批量添加多个String类型的键值对

- MGET:根据多个key获取多个String类型的value

- INCR:让一个整型的key自增1

- INCRBY:让一个整型的key自增并指定步长,例如:incrby num 2 让num值自增2

- INCRBYFLOAT:让一个浮点类型的数字自增并指定步长

- SETNX:添加一个String类型的键值对,前提是这个key不存在,否则不执行

- SETEX:添加一个String类型的键值对,并且指定有效期

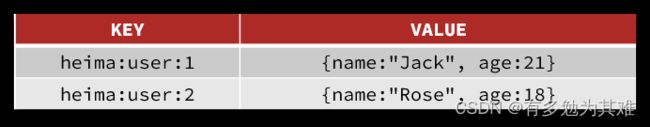

2.2.2.Key结构

Redis没有类似MySQL中的Table的概念,我们该如何区分不同类型的key呢?

例如,需要存储用户、商品信息到redis,有一个用户id是1,有一个商品id恰好也是1,此时如果使用id作为key,那就会冲突了,该怎么办?

我们可以通过给key添加前缀加以区分,不过这个前缀不是随便加的,有一定的规范:

Redis的key允许有多个单词形成层级结构,多个单词之间用’:'隔开,格式如下:

项目名:业务名:类型:id

这个格式并非固定,也可以根据自己的需求来删除或添加词条。这样以来,我们就可以把不同类型的数据区分开了。从而避免了key的冲突问题。

例如我们的项目名称叫 ww,有user和product两种不同类型的数据,我们可以这样定义key:

-

user相关的key:ww:user:1

-

product相关的key:ww:product:1

如果Value是一个Java对象,例如一个User对象,则可以将对象序列化为JSON字符串后存储:

| KEY | VALUE |

|---|---|

| heima:user:1 | {“id”:1, “name”: “Jack”, “age”: 21} |

| heima:product:1 | {“id”:1, “name”: “小米11”, “price”: 4999} |

2.3.Hash类型

Hash类型,也叫散列,其value是一个无序字典,类似于Java中的HashMap结构。

String结构是将对象序列化为JSON字符串后存储,当需要修改对象某个字段时很不方便:

Hash结构可以将对象中的每个字段独立存储,可以针对单个字段做CRUD:

Hash的常见命令有:

-

HSET key field value:添加或者修改hash类型key的field的值

-

HGET key field:获取一个hash类型key的field的值

-

HMSET:批量添加多个hash类型key的field的值

-

HMGET:批量获取多个hash类型key的field的值

-

HGETALL:获取一个hash类型的key中的所有的field和value

-

HKEYS:获取一个hash类型的key中的所有的field

-

HINCRBY:让一个hash类型key的字段值自增并指定步长

-

HSETNX:添加一个hash类型的key的field值,前提是这个field不存在,否则不执行

2.4.List类型

Redis中的List类型与Java中的LinkedList类似,可以看做是一个双向链表结构。既可以支持正向检索和也可以支持反向检索。

特征也与LinkedList类似:

- 有序

- 元素可以重复

- 插入和删除快

- 查询速度一般

常用来存储一个有序数据,例如:朋友圈点赞列表,评论列表等。

List的常见命令有:

- LPUSH key element … :向列表左侧插入一个或多个元素

- LPOP key:移除并返回列表左侧的第一个元素,没有则返回nil

- RPUSH key element … :向列表右侧插入一个或多个元素

- RPOP key:移除并返回列表右侧的第一个元素

- LRANGE key star end:返回一段角标范围内的所有元素

- BLPOP和BRPOP:与LPOP和RPOP类似,只不过在没有元素时等待指定时间,而不是直接返回nil

2.5.Set类型

Redis的Set结构与Java中的HashSet类似,可以看做是一个value为null的HashMap。因为也是一个hash表,因此具备与HashSet类似的特征:

-

无序

-

元素不可重复

-

查找快

-

支持交集、并集、差集等功能

Set的常见命令有:

- SADD key member … :向set中添加一个或多个元素

- SREM key member … : 移除set中的指定元素

- SCARD key: 返回set中元素的个数

- SISMEMBER key member:判断一个元素是否存在于set中

- SMEMBERS:获取set中的所有元素

- SINTER key1 key2 … :求key1与key2的交集

例如两个集合:s1和s2:

求交集:SINTER s1 s2

求s1与s2的不同:SDIFF s1 s2

练习:

- 将下列数据用Redis的Set集合来存储:

- 张三的好友有:李四、王五、赵六

- 李四的好友有:王五、麻子、二狗

- 利用Set的命令实现下列功能:

- 计算张三的好友有几人

- 计算张三和李四有哪些共同好友

- 查询哪些人是张三的好友却不是李四的好友

- 查询张三和李四的好友总共有哪些人

- 判断李四是否是张三的好友

- 判断张三是否是李四的好友

- 将李四从张三的好友列表中移除

2.6.SortedSet类型

Redis的SortedSet是一个可排序的set集合,与Java中的TreeSet有些类似,但底层数据结构却差别很大。SortedSet中的每一个元素都带有一个score属性,可以基于score属性对元素排序,底层的实现是一个跳表(SkipList)加 hash表。

SortedSet具备下列特性:

- 可排序

- 元素不重复

- 查询速度快

因为SortedSet的可排序特性,经常被用来实现排行榜这样的功能。

SortedSet的常见命令有:

- ZADD key score member:添加一个或多个元素到sorted set ,如果已经存在则更新其score值

- ZREM key member:删除sorted set中的一个指定元素

- ZSCORE key member : 获取sorted set中的指定元素的score值

- ZRANK key member:获取sorted set 中的指定元素的排名

- ZCARD key:获取sorted set中的元素个数

- ZCOUNT key min max:统计score值在给定范围内的所有元素的个数

- ZINCRBY key increment member:让sorted set中的指定元素自增,步长为指定的increment值

- ZRANGE key min max:按照score排序后,获取指定排名范围内的元素

- ZRANGEBYSCORE key min max:按照score排序后,获取指定score范围内的元素

- ZDIFF、ZINTER、ZUNION:求差集、交集、并集

注意:所有的排名默认都是升序,如果要降序则在命令的Z后面添加REV即可,例如:

-

升序获取sorted set 中的指定元素的排名:ZRANK key member

-

降序获取sorted set 中的指定元素的排名:ZREVRANK key memeber

练习题:

将班级的下列学生得分存入Redis的SortedSet中:

Jack 85, Lucy 89, Rose 82, Tom 95, Jerry 78, Amy 92, Miles 76

并实现下列功能:

- 删除Tom同学

- 获取Amy同学的分数

- 获取Rose同学的排名

- 查询80分以下有几个学生

- 给Amy同学加2分

- 查出成绩前3名的同学

- 查出成绩80分以下的所有同学

3 Redis的Java客户端

在Redis官网中提供了各种语言的客户端,地址:https://redis.io/docs/clients/

其中Java客户端也包含很多:

标记为*的就是推荐使用的java客户端,包括:

- Jedis和Lettuce:这两个主要是提供了Redis命令对应的API,方便我们操作Redis,而SpringDataRedis又对这两种做了抽象和封装,因此我们后期会直接以SpringDataRedis来学习。

- Redisson:是在Redis基础上实现了分布式的可伸缩的java数据结构,例如Map、Queue等,而且支持跨进程的同步机制:Lock、Semaphore等待,比较适合用来实现特殊的功能需求。

3.1.Jedis客户端

Jedis的官网地址: https://github.com/redis/jedis

3.1.1.快速入门

我们先来个快速入门:

1)引入依赖:

<dependency>

<groupId>redis.clientsgroupId>

<artifactId>jedisartifactId>

<version>3.7.0version>

dependency>

<dependency>

<groupId>org.junit.jupitergroupId>

<artifactId>junit-jupiterartifactId>

<version>5.7.0version>

<scope>testscope>

dependency>

2)建立连接

新建一个单元测试类,内容如下:

private Jedis jedis;

@BeforeEach

void setUp() {

// 1.建立连接

// jedis = new Jedis("192.168.150.101", 6379);

jedis = JedisConnectionFactory.getJedis();

// 2.设置密码

jedis.auth("123321");

// 3.选择库

jedis.select(0);

}

3)测试:

@Test

void testString() {

// 存入数据

String result = jedis.set("name", "虎哥");

System.out.println("result = " + result);

// 获取数据

String name = jedis.get("name");

System.out.println("name = " + name);

}

@Test

void testHash() {

// 插入hash数据

jedis.hset("user:1", "name", "Jack");

jedis.hset("user:1", "age", "21");

// 获取

Map<String, String> map = jedis.hgetAll("user:1");

System.out.println(map);

}

4)释放资源

@AfterEach

void tearDown() {

if (jedis != null) {

jedis.close();

}

}

3.1.2.连接池

Jedis本身是线程不安全的,并且频繁的创建和销毁连接会有性能损耗,因此我们推荐大家使用Jedis连接池代替Jedis的直连方式。

package com.heima.jedis.util;

import redis.clients.jedis.*;

public class JedisConnectionFactory {

private static JedisPool jedisPool;

static {

// 配置连接池

JedisPoolConfig poolConfig = new JedisPoolConfig();

poolConfig.setMaxTotal(8);

poolConfig.setMaxIdle(8);

poolConfig.setMinIdle(0);

poolConfig.setMaxWaitMillis(1000);

// 创建连接池对象,参数:连接池配置、服务端ip、服务端端口、超时时间、密码

jedisPool = new JedisPool(poolConfig, "192.168.150.101", 6379, 1000, "123321");

}

public static Jedis getJedis(){

return jedisPool.getResource();

}

}

3.2.SpringDataRedis客户端

SpringData是Spring中数据操作的模块,包含对各种数据库的集成,其中对Redis的集成模块就叫做SpringDataRedis,官网地址:https://spring.io/projects/spring-data-redis

- 提供了对不同Redis客户端的整合(Lettuce和Jedis)

- 提供了RedisTemplate统一API来操作Redis

- 支持Redis的发布订阅模型

- 支持Redis哨兵和Redis集群

- 支持基于Lettuce的响应式编程

- 支持基于JDK、JSON、字符串、Spring对象的数据序列化及反序列化

- 支持基于Redis的JDKCollection实现

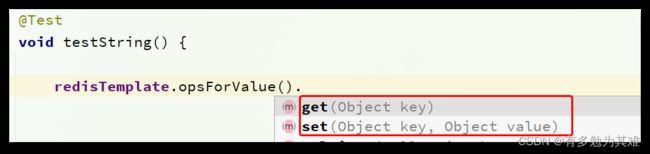

SpringDataRedis中提供了RedisTemplate工具类,其中封装了各种对Redis的操作。并且将不同数据类型的操作API封装到了不同的类型中:

3.2.1.快速入门

SpringBoot已经提供了对SpringDataRedis的支持,使用非常简单。

首先,新建一个maven项目,然后按照下面步骤执行:

1)引入依赖

<project xmlns="http://maven.apache.org/POM/4.0.0" xmlns:xsi="http://www.w3.org/2001/XMLSchema-instance"

xsi:schemaLocation="http://maven.apache.org/POM/4.0.0 https://maven.apache.org/xsd/maven-4.0.0.xsd">

<modelVersion>4.0.0modelVersion>

<parent>

<groupId>org.springframework.bootgroupId>

<artifactId>spring-boot-starter-parentartifactId>

<version>2.5.7version>

<relativePath/>

parent>

<groupId>com.heimagroupId>

<artifactId>redis-demoartifactId>

<version>0.0.1-SNAPSHOTversion>

<name>redis-demoname>

<description>Demo project for Spring Bootdescription>

<properties>

<java.version>1.8java.version>

properties>

<dependencies>

<dependency>

<groupId>org.springframework.bootgroupId>

<artifactId>spring-boot-starter-data-redisartifactId>

dependency>

<dependency>

<groupId>org.apache.commonsgroupId>

<artifactId>commons-pool2artifactId>

dependency>

<dependency>

<groupId>com.fasterxml.jackson.coregroupId>

<artifactId>jackson-databindartifactId>

dependency>

<dependency>

<groupId>org.projectlombokgroupId>

<artifactId>lombokartifactId>

<optional>trueoptional>

dependency>

<dependency>

<groupId>org.springframework.bootgroupId>

<artifactId>spring-boot-starter-testartifactId>

<scope>testscope>

dependency>

dependencies>

<build>

<plugins>

<plugin>

<groupId>org.springframework.bootgroupId>

<artifactId>spring-boot-maven-pluginartifactId>

<configuration>

<excludes>

<exclude>

<groupId>org.projectlombokgroupId>

<artifactId>lombokartifactId>

exclude>

excludes>

configuration>

plugin>

plugins>

build>

project>

2)配置Redis

spring:

redis:

host: 192.168.150.101

port: 6379

password: 123321

lettuce:

pool:

max-active: 8

max-idle: 8

min-idle: 0

max-wait: 100ms

3)注入RedisTemplate

因为有了SpringBoot的自动装配,我们可以拿来就用:

@SpringBootTest

class RedisStringTests {

@Autowired

private RedisTemplate redisTemplate;

}

4)编写测试

@SpringBootTest

class RedisStringTests {

@Autowired

private RedisTemplate redisTemplate;

@Test

void testString() {

// 写入一条String数据

redisTemplate.opsForValue().set("name", "虎哥");

// 获取string数据

Object name = stringRedisTemplate.opsForValue().get("name");

System.out.println("name = " + name);

}

}

3.2.2.自定义序列化

RedisTemplate可以接收任意Object作为值写入Redis:

只不过写入前会把Object序列化为字节形式,默认是采用JDK序列化,得到的结果是这样的:

缺点:

- 可读性差

- 内存占用较大

我们可以自定义RedisTemplate的序列化方式,代码如下:

@Configuration

public class RedisConfig {

@Bean

public RedisTemplate<String, Object> redisTemplate(RedisConnectionFactory connectionFactory){

// 创建RedisTemplate对象

RedisTemplate<String, Object> template = new RedisTemplate<>();

// 设置连接工厂

template.setConnectionFactory(connectionFactory);

// 创建JSON序列化工具

GenericJackson2JsonRedisSerializer jsonRedisSerializer =

new GenericJackson2JsonRedisSerializer();

// 设置Key的序列化

template.setKeySerializer(RedisSerializer.string());

template.setHashKeySerializer(RedisSerializer.string());

// 设置Value的序列化

template.setValueSerializer(jsonRedisSerializer);

template.setHashValueSerializer(jsonRedisSerializer);

// 返回

return template;

}

}

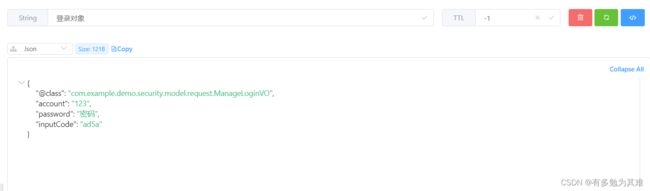

这里采用了JSON序列化来代替默认的JDK序列化方式。最终结果如图:

整体可读性有了很大提升,并且能将Java对象自动的序列化为JSON字符串,并且查询时能自动把JSON反序列化为Java对象。不过,其中记录了序列化时对应的class名称,目的是为了查询时实现自动反序列化。这会带来额外的内存开销。

3.2.3.StringRedisTemplate

为了节省内存空间,我们可以不使用JSON序列化器来处理value,而是统一使用String序列化器,要求只能存储String类型的key和value。当需要存储Java对象时,手动完成对象的序列化和反序列化。

因为存入和读取时的序列化及反序列化都是我们自己实现的,SpringDataRedis就不会将class信息写入Redis了。

这种用法比较普遍,因此SpringDataRedis就提供了RedisTemplate的子类:StringRedisTemplate,它的key和value的序列化方式默认就是String方式。

省去了我们自定义RedisTemplate的序列化方式的步骤,而是直接使用:

@Autowired

private StringRedisTemplate stringRedisTemplate;

// JSON序列化工具

private static final ObjectMapper mapper = new ObjectMapper();

@Test

void testSaveUser() throws JsonProcessingException {s

// 创建对象

User user = new User("虎哥", 21);

// 手动序列化

String json = mapper.writeValueAsString(user);

// 写入数据

stringRedisTemplate.opsForValue().set("user:200", json);

// 获取数据

String jsonUser = stringRedisTemplate.opsForValue().get("user:200");

// 手动反序列化

User user1 = mapper.readValue(jsonUser, User.class);

System.out.println("user1 = " + user1);

}

4 Redis短信登录核心代码

@Service

@Slf4j

public class UserServiceImpl extends ServiceImpl<UserMapper, User> implements IUserService {

@Resource

private StringRedisTemplate stringRedisTemplate;

@Override

public Result sendCode(String phone, HttpSession session) {

// 1.校验手机号格式是否正确

if (RegexUtils.isPhoneInvalid(phone)) {

return Result.fail("手机号格式错误!");

}

// 2.生成验证码

String code = RandomUtil.randomNumbers(6);

// 3.保存到redis

stringRedisTemplate.opsForValue().set(RedisConstants.LOGIN_CODE_KEY + phone, code, RedisConstants.LOGIN_CODE_TTL, TimeUnit.MINUTES);

// todo 4.模拟发送验证码,实现则需要调用第三方api

log.info("验证码:{},发送成功",code);

// 5.成功

return Result.ok();

}

@Override

public Result login(LoginFormDTO loginForm, HttpSession session) {

// 1.校验手机号

String phone = loginForm.getPhone();

if (RegexUtils.isPhoneInvalid(phone)) {

return Result.fail("手机号格式错误");

}

// 2.判断手机验证码

String cacheCode = stringRedisTemplate.opsForValue().get(RedisConstants.LOGIN_CODE_KEY + phone);

if (StringUtils.isBlank(cacheCode)) {

// 3.验证码过期

return Result.fail("验证码过期!");

}

if (!loginForm.getCode().equals(cacheCode)) {

// 3.验证码不正确报错

return Result.fail("验证码错误!");

}

// 4.验证码正确

// 5.根据手机号判断用户是否存在

User user = query().eq("phone", phone).one();

// 6.不存在创建新用户

if (user == null) {

user=creatUserWithPhone(phone);

save(user);

}

// 7. 存在则登录成功,保存用户信息到redis中

// 7.1. 随机生成token,作为登录令牌

String token = UUID.randomUUID().toString(true);

// 7,2. 将User对象转为 Hash存储

UserDTO userDTO = BeanUtil.copyProperties(user, UserDTO.class);

Map<String, Object> userMap = BeanUtil.beanToMap(userDTO,new HashMap<>(),

CopyOptions.create()

.setIgnoreNullValue(true)

.setFieldValueEditor((fieldName, fieldValue) -> fieldValue.toString()));

// 7.3 存储

String tokenKey = RedisConstants.LOGIN_USER_KEY + token;

stringRedisTemplate.opsForHash().putAll(tokenKey,userMap);

// 7.4 设置过期时间

stringRedisTemplate.expire(tokenKey, RedisConstants.LOGIN_USER_TTL, TimeUnit.SECONDS);

// 删除redis中的验证码

stringRedisTemplate.delete(RedisConstants.LOGIN_CODE_KEY + phone);

// 8. 返回token

return Result.ok(token);

}

private User creatUserWithPhone(String phone) {

// 创建用户

User user = new User();

user.setPhone(phone);

user.setNickName(SystemConstants.USER_NICK_NAME_PREFIX + RandomUtil.randomString(5));

return user;

}

}

MvcConfig

@Configuration

public class MvcConfig implements WebMvcConfigurer {

@Resource

private StringRedisTemplate stringRedisTemplate;

@Override

public void addInterceptors(InterceptorRegistry registry) {

// 登录拦截器

registry.addInterceptor(new LoginInterceptor())

.excludePathPatterns(

"/shop/**",

"/voucher/**",

"/shop-type/**",

"/upload/**",

"/blog/hot",

"/user/code",

"/user/login"

).order(1);

// token刷新的拦截器

registry.addInterceptor(new RefreshTokenInterceptor(stringRedisTemplate)).addPathPatterns("/**").order(0);

}

}

拦截器

public class LoginInterceptor implements HandlerInterceptor {

@Override

public boolean preHandle(HttpServletRequest request, HttpServletResponse response, Object handler) throws Exception {

//1.是否需要拦截(判断ThreadLocal中是否有用户)

if (UserHolder.getUser()==null) {

// 没有用户需要拦截

response.setStatus(HttpStatus.HTTP_UNAUTHORIZED);

return false;

}

// 有用户放行

return true;

}

@Override

public void afterCompletion(HttpServletRequest request, HttpServletResponse response, Object handler, Exception ex) throws Exception {

// 移出用户

UserHolder.removeUser();

}

}

public class RefreshTokenInterceptor implements HandlerInterceptor {

private StringRedisTemplate stringRedisTemplate;

public RefreshTokenInterceptor(StringRedisTemplate stringRedisTemplate) {

this.stringRedisTemplate = stringRedisTemplate;

}

@Override

public boolean preHandle(HttpServletRequest request, HttpServletResponse response, Object handler) throws Exception {

// 1.获取请求头中的token

String token = request.getHeader("authorization");

if (StrUtil.isBlank(token)) {

return true;

}

// 2.基于TOKEN获取redis中的用户

String key = RedisConstants.LOGIN_USER_KEY + token;

Map<Object, Object> userMap = stringRedisTemplate.opsForHash().entries(key);

// 3.判断用户是否存在

if (userMap.isEmpty()) {

return true;

}

// 5.将查询到的hash数据转为UserDTO

UserDTO userDTO = BeanUtil.fillBeanWithMap(userMap, new UserDTO(), false);

// 6.存在,保存用户信息到 ThreadLocal

UserHolder.saveUser(userDTO);

// 7.刷新token有效期

stringRedisTemplate.expire(key, RedisConstants.LOGIN_USER_TTL, TimeUnit.SECONDS);

// 8.放行

return true;

}

@Override

public void afterCompletion(HttpServletRequest request, HttpServletResponse response, Object handler, Exception ex) throws Exception {

// 移除用户

UserHolder.removeUser();

}

}

5 什么是缓存?

前言:什么是缓存?

就像自行车,越野车的避震器

举个例子:越野车,山地自行车,都拥有"避震器",防止车体加速后因惯性,在酷似"U"字母的地形上飞跃,硬着陆导致的损害,像个弹簧一样;

同样,实际开发中,系统也需要"避震器",防止过高的数据访问猛冲系统,导致其操作线程无法及时处理信息而瘫痪;

这在实际开发中对企业讲,对产品口碑,用户评价都是致命的;所以企业非常重视缓存技术;

缓存(Cache),就是数据交换的缓冲区,俗称的缓存就是缓冲区内的数据,一般从数据库中获取,存储于本地代码(例如:

例1:Static final ConcurrentHashMap<K,V> map = new ConcurrentHashMap<>(); 本地用于高并发

例2:static final Cache<K,V> USER_CACHE = CacheBuilder.newBuilder().build(); 用于redis等缓存

例3:Static final Map<K,V> map = new HashMap(); 本地缓存

由于其被Static修饰,所以随着类的加载而被加载到内存之中,作为本地缓存,由于其又被final修饰,所以其引用(例3:map)和对象(例3:new HashMap())之间的关系是固定的,不能改变,因此不用担心赋值(=)导致缓存失效;

1. 为什么要使用缓存

一句话:因为速度快,好用

缓存数据存储于代码中,而代码运行在内存中,内存的读写性能远高于磁盘,缓存可以大大降低用户访问并发量带来的服务器读写压力

实际开发过程中,企业的数据量,少则几十万,多则几千万,这么大数据量,如果没有缓存来作为"避震器",系统是几乎撑不住的,所以企业会大量运用到缓存技术;

2. 如何使用缓存

实际开发中,会构筑多级缓存来使系统运行速度进一步提升,例如:本地缓存与redis中的缓存并发使用

浏览器缓存:主要是存在于浏览器端的缓存

**应用层缓存:**可以分为tomcat本地缓存,比如之前提到的map,或者是使用redis作为缓存

**数据库缓存:**在数据库中有一片空间是 buffer pool,增改查数据都会先加载到mysql的缓存中

**CPU缓存:**当代计算机最大的问题是 cpu性能提升了,但内存读写速度没有跟上,所以为了适应当下的情况,增加了cpu的L1,L2,L3级的缓存

3. 缓存模型和思路

标准的操作方式就是查询数据库之前先查询缓存,如果缓存数据存在,则直接从缓存中返回,如果缓存数据不存在,再查询数据库,然后将数据存入redis。

代码:

代码思路:如果缓存有,则直接返回,如果缓存不存在,则查询数据库,然后存入redis。

@Override

public Result queryById(Long id) {

// 1. 从redis查询店铺缓存

String key = CACHE_SHOP_KEY + id;

String shopJson = stringRedisTemplate.opsForValue().get(key);

// 2.判断是否存在

if (StrUtil.isNotBlank(shopJson)) {

// 3.存在,直接返回数据

Shop shop = JSONUtil.toBean(shopJson, Shop.class);

return Result.ok(shop);

}

// 4. 不存在,根据id查询数据库

Shop shop = getById(id);

if (shop == null) {

// 5.不存在返回错误

return Result.fail("店铺不存在!");

}

// 6.存在,写入redis

stringRedisTemplate.opsForValue().set(key, JSONUtil.toJsonStr(shop));

return Result.ok(shop);

}

4. 缓存练习题

给店铺类型添加缓存

使用String,List方式处理

@Override

public Result queryTypeList() {

// 1.查询redis

// List shopTypeList = stringRedisTemplate.opsForList().range(CACHE_SHOP_TYPE_KEY, 0, -1);

// System.out.println("shopTypeList = " + shopTypeList.size());

// System.out.println("shopTypeList = " + shopTypeList);

//

// if (CollectionUtil.isNotEmpty(shopTypeList)) {

// // 2.存在直接返回

// List shopTypes = shopTypeList.stream().map(s -> JSONUtil.toBean(s, ShopType.class)).collect(Collectors.toList());

// return Result.ok(shopTypes);

// }

// 还是用string方便

String shopTypeJson = stringRedisTemplate.opsForValue().get(CACHE_SHOP_TYPE_KEY);

if (StrUtil.isNotBlank(shopTypeJson)) {

// 2.存在直接返回

List<ShopType> shopTypes = JSONUtil.toList(shopTypeJson, ShopType.class);

return Result.ok(shopTypes);

}

// 3.不存在查询数据库

List<ShopType> typeList = query().orderByAsc("sort").list();

// 将ShopType转为String,方便读取

// List shopTypes = typeList.stream().map(s -> JSONUtil.toJsonStr(s)).collect(Collectors.toList());

// 将ShopType转为String

String jsonStr = JSONUtil.toJsonStr(typeList);

// 4.保存到redis

// list类型

// stringRedisTemplate.opsForList().leftPushAll(CACHE_SHOP_TYPE_KEY, shopTypes);

// string类型

stringRedisTemplate.opsForValue().set(CACHE_SHOP_TYPE_KEY,jsonStr);

// 5.设置超时时间

// stringRedisTemplate.expire(CACHE_SHOP_TYPE_KEY, CACHE_SHOP_TYPE_TTL, TimeUnit.MINUTES);

return Result.ok(typeList);

}

6 缓存更新策略

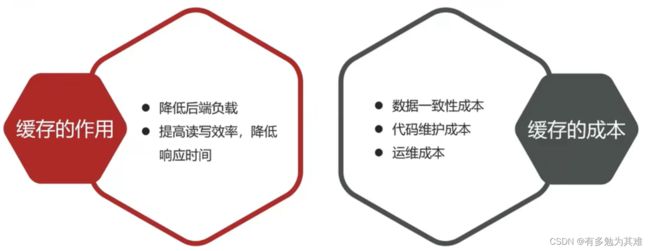

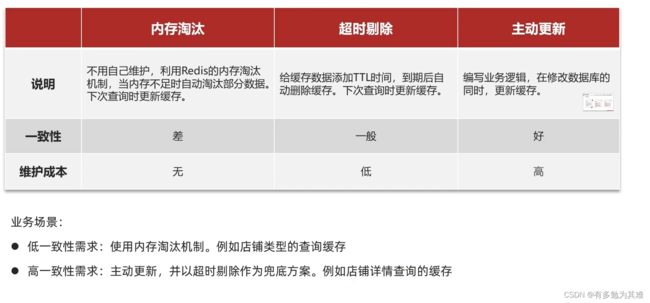

缓存更新是redis为了节约内存而设计出来的一个东西,主要是因为内存数据宝贵,当我们向redis插入太多数据,此时就可能会导致缓存中的数据过多,所以redis会对部分数据进行更新,或者把他叫为淘汰更合适。

内存淘汰: redis自动进行,当redis内存达到咱们设定的max-memery的时候,会自动触发淘汰机制,淘汰掉一些不重要的数据(可以自己设置策略方式)

超时剔除: 当我们给redis设置了过期时间ttl之后,redis会将超时的数据进行删除,方便咱们继续使用缓存

主动更新: 我们可以手动调用方法把缓存删掉,通常用于解决缓存和数据库不一致问题

1. 数据库缓存不一致解决方案

由于我们的缓存的数据源来自于数据库,而数据库的数据是会发生变化的,因此,如果当数据库中数据发生变化,而缓存却没有同步,此时就会有一致性问题存在,其后果是:

用户使用缓存中的过时数据,就会产生类似多线程数据安全问题,从而影响业务,产品口碑等;怎么解决呢?有如下几种方案

Cache Aside Pattern 人工编码方式:缓存调用者在更新完数据库后再去更新缓存,也称之为双写方案

Read/Write Through Pattern : 由系统本身完成,数据库与缓存的问题交由系统本身去处理

Write Behind Caching Pattern :调用者只操作缓存,其他线程去异步处理数据库,实现最终一致

2. 数据库和缓存不一致采用什么方案

综合考虑使用方案一,但是方案一调用者如何处理呢?这里有几个问题

操作缓存和数据库时有三个问题需要考虑:

如果采用第一个方案,那么假设我们每次操作数据库后,都操作缓存,但是中间如果没有人查询,那么这个更新动作实际上只有最后一次生效,中间的更新动作意义并不大,我们可以把缓存删除,等待再次查询时,将缓存中的数据加载出来

-

删除缓存还是更新缓存?

- 更新缓存:每次更新数据库都更新缓存,无效写操作较多

- 删除缓存:更新数据库时让缓存失效,查询时再更新缓存(√)

-

如何保证缓存与数据库的操作的同时成功或失败?

- 单体系统,将缓存与数据库操作放在一个事务

- 分布式系统,利用TCC等分布式事务方案

应该具体操作缓存还是操作数据库,我们应当是先操作数据库,再删除缓存,原因在于,如果你选择第一种方案,在两个线程并发来访问时,假设线程1先来,他先把缓存删了,此时线程2过来,他查询缓存数据并不存在,此时他写入缓存,当他写入缓存后,线程1再执行更新动作时,实际上写入的就是旧的数据,新的数据被旧数据覆盖了。

- 先操作缓存还是先操作数据库?

- 先删除缓存,再操作数据库

- 先操作数据库,再删除缓存(√)

3. 实现商铺和缓存与数据库双写一致

根据id查询店铺时,如果缓存未命中,则查询数据库,将数据库结果写入缓存,并设置超时时间

@Override

public Result queryById(Long id) {

// 1. 从redis查询店铺缓存

String key = CACHE_SHOP_KEY + id;

String shopJson = stringRedisTemplate.opsForValue().get(key);

// 2.判断是否存在

if (StrUtil.isNotBlank(shopJson)) {

// 3.存在,直接返回数据

Shop shop = JSONUtil.toBean(shopJson, Shop.class);

return Result.ok(shop);

}

// 4. 不存在,根据id查询数据库

Shop shop = getById(id);

if (shop == null) {

// 5.不存在返回错误

return Result.fail("店铺不存在!");

}

// 6.存在,写入redis

stringRedisTemplate.opsForValue().set(key, JSONUtil.toJsonStr(shop),CACHE_SHOP_TTL, TimeUnit.MINUTES);

return Result.ok(shop);

根据id修改店铺时,先修改数据库,再删除缓存

@Override

@Transactional

public Result updata(Shop shop) {

Long id = shop.getId();

if (id == null) {

Result.fail("id不能为空!");

}

// 1.更新数据库

updateById(shop);

// 2.删除缓存

stringRedisTemplate.delete(CACHE_SHOP_KEY + id);

return Result.ok();

}

代码分析:通过之前的淘汰,我们确定了采用删除策略,来解决双写问题,当我们修改了数据之后,然后把缓存中的数据进行删除,查询时发现缓存中没有数据,则会从mysql中加载最新的数据,从而避免数据库和缓存不一致的问题

7 缓存穿透问题

1. 解决思路

缓存穿透 :缓存穿透是指客户端请求的数据在缓存中和数据库中都不存在,这样缓存永远不会生效,这些请求都会打到数据库。

常见的解决方案有两种:

- 缓存空对象

- 优点:实现简单,维护方便

- 缺点:

- 额外的内存消耗

- 可能造成短期的不一致

- 布隆过滤

- 优点:内存占用较少,没有多余key

- 缺点:

- 实现复杂

- 存在误判可能

**缓存空对象思路分析:**当我们客户端访问不存在的数据时,先请求redis,但是此时redis中没有数据,此时会访问到数据库,但是数据库中也没有数据,这个数据穿透了缓存,直击数据库,我们都知道数据库能够承载的并发不如redis这么高,如果大量的请求同时过来访问这种不存在的数据,这些请求就都会访问到数据库,简单的解决方案就是哪怕这个数据在数据库中也不存在,我们也把这个数据存入到redis中去,这样,下次用户过来访问这个不存在的数据,那么在redis中也能找到这个数据就不会进入到缓存了

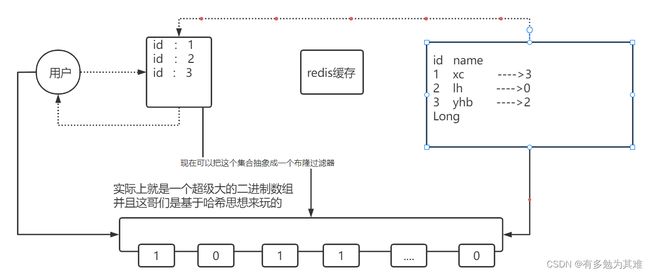

**布隆过滤:**布隆过滤器其实采用的是哈希思想来解决这个问题,通过一个庞大的二进制数组,走哈希思想去判断当前这个要查询的这个数据是否存在,如果布隆过滤器判断存在,则放行,这个请求会去访问redis,哪怕此时redis中的数据过期了,但是数据库中一定存在这个数据,在数据库中查询出来这个数据后,再将其放入到redis中,

假设布隆过滤器判断这个数据不存在,则直接返回

这种方式优点在于节约内存空间,存在误判,误判原因在于:布隆过滤器走的是哈希思想,只要哈希思想,就可能存在哈希冲突

2. 解决方案

核心思路如下:

在原来的逻辑中,我们如果发现这个数据在mysql中不存在,直接就返回404了,这样是会存在缓存穿透问题的

现在的逻辑中:如果这个数据不存在,我们不会返回404 ,还是会把这个数据写入到Redis中,并且将value设置为空,欧当再次发起查询时,我们如果发现命中之后,判断这个value是否是null,如果是null,则是之前写入的数据,证明是缓存穿透数据,如果不是,则直接返回数据。

代码:

@Override

public Result queryById(Long id) {

// 1. 从redis查询店铺缓存

String key = CACHE_SHOP_KEY + id;

String shopJson = stringRedisTemplate.opsForValue().get(key);

log.info("shopJson:{}", shopJson);

// 2.判断是否存在

if (StrUtil.isNotBlank(shopJson)) {

// 3.存在,直接返回数据

Shop shop = JSONUtil.toBean(shopJson, Shop.class);

return Result.ok(shop);

}

// 判断shopJson是否为null,是null则查询数据库,如果为"",则返回错误

if (shopJson != null) {

// shopJson=""时

return Result.fail("店铺不存在!");

}

// 4. 不存在,根据id查询数据库

Shop shop = getById(id);

if (shop == null) {

// 5.不存在将null存入redis

stringRedisTemplate.opsForValue().set(key, "",CACHE_NULL_TTL, TimeUnit.MINUTES);

return Result.fail("店铺不存在!");

}

// 6.存在,写入redis

stringRedisTemplate.opsForValue().set(key, JSONUtil.toJsonStr(shop),CACHE_SHOP_TTL, TimeUnit.MINUTES);

return Result.ok(shop);

}

小总结:

缓存穿透产生的原因是什么?

- 用户请求的数据在缓存中和数据库中都不存在,不断发起这样的请求,给数据库带来巨大压力

缓存穿透的解决方案有哪些?

- 缓存""值

- 布隆过滤

- 增强id的复杂度,避免被猜测id规律

- 做好数据的基础格式校验

- 加强用户权限校验

- 做好热点参数的限流

8 缓存雪崩问题解决思路

缓存雪崩是指在同一时段大量的缓存key同时失效或者Redis服务宕机,导致大量请求到达数据库,带来巨大压力。

解决方案:

9 缓存击穿问题及解决思路

缓存击穿问题也叫热点Key问题,就是一个被高并发访问并且缓存重建业务较复杂的key突然失效了,无数的请求访问会在瞬间给数据库带来巨大的冲击。

常见的解决方案有两种:

- 互斥锁

- 逻辑过期

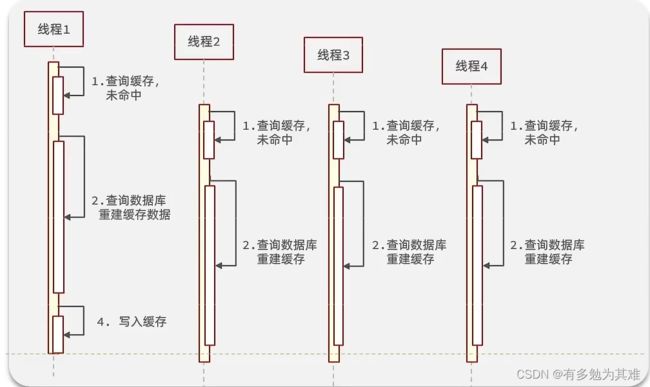

逻辑分析:假设线程1在查询缓存之后,本来应该去查询数据库,然后把这个数据重新加载到缓存的,此时只要线程1走完这个逻辑,其他线程就都能从缓存中加载这些数据了,但是假设在线程1没有走完的时候,后续的线程2,线程3,线程4同时过来访问当前这个方法, 那么这些线程都不能从缓存中查询到数据,那么他们就会同一时刻来访问查询缓存,都没查到,接着同一时间去访问数据库,同时的去执行数据库代码,对数据库访问压力过大

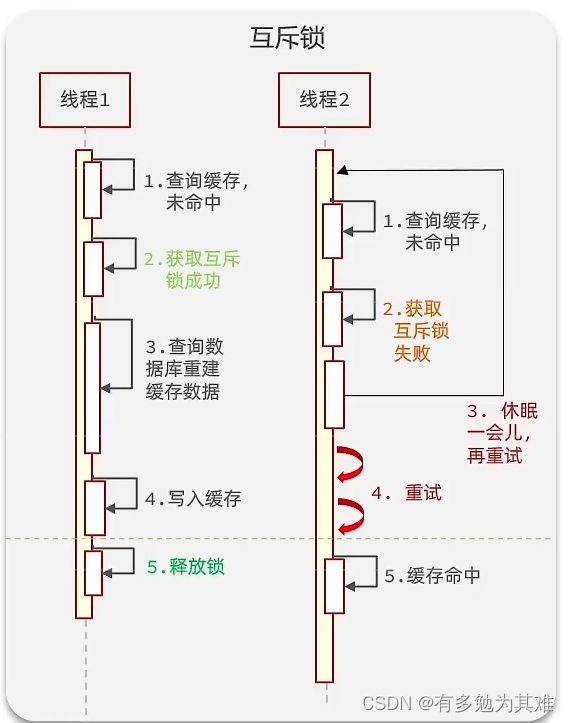

解决方案一、使用锁来解决:

因为锁能实现互斥性。假设线程过来,只能一个人一个人的来访问数据库,从而避免对于数据库访问压力过大,但这也会影响查询的性能,因为此时会让查询的性能从并行变成了串行,我们可以采用tryLock方法 + double check来解决这样的问题。

假设现在线程1过来访问,他查询缓存没有命中,但是此时他获得到了锁的资源,那么线程1就会一个人去执行逻辑,假设现在线程2过来,线程2在执行过程中,并没有获得到锁,那么线程2就可以进行到休眠,直到线程1把锁释放后,线程2获得到锁,然后再来执行逻辑,此时就能够从缓存中拿到数据了。

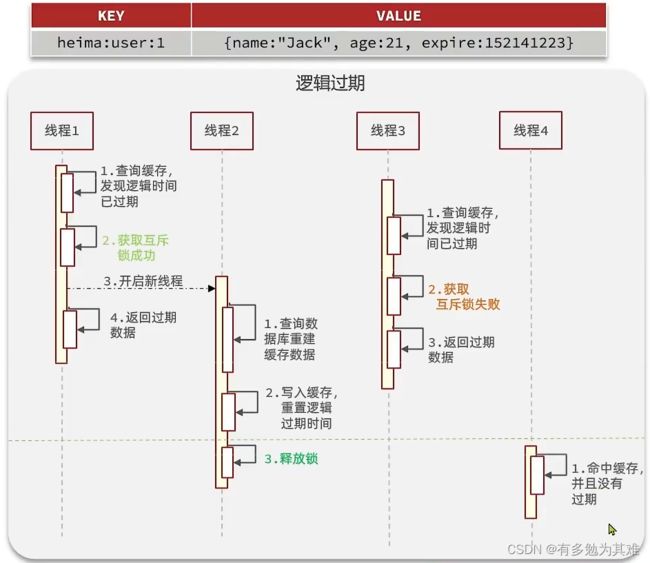

解决方案二、逻辑过期方案

方案分析:我们之所以会出现这个缓存击穿问题,主要原因是在于我们对key设置了过期时间,假设我们不设置过期时间,其实就不会有缓存击穿的问题,但是不设置过期时间,这样数据不就一直占用我们内存了吗,我们可以采用逻辑过期方案。

我们把过期时间设置在 redis的value中,注意:这个过期时间并不会直接作用于redis,而是我们后续通过逻辑去处理。假设线程1去查询缓存,然后从value中判断出来当前的数据已经过期了,此时线程1去获得互斥锁,那么其他线程会进行阻塞,获得了锁的线程他会开启一个 线程去进行 以前的重构数据的逻辑,直到新开的线程完成这个逻辑后,才释放锁, 而线程1直接进行返回,假设现在线程3过来访问,由于线程线程2持有着锁,所以线程3无法获得锁,线程3也直接返回数据,只有等到新开的线程2把重建数据构建完后,其他线程才能走返回正确的数据。

这种方案巧妙在于,异步的构建缓存,缺点在于在构建完缓存之前,返回的都是脏数据。

**互斥锁方案:**由于保证了互斥性,所以数据一致,且实现简单,因为仅仅只需要加一把锁而已,也没其他的事情需要操心,所以没有额外的内存消耗,缺点在于有锁就有死锁问题的发生,且只能串行执行性能肯定受到影响

逻辑过期方案: 线程读取过程中不需要等待,性能好,有一个额外的线程持有锁去进行重构数据,但是在重构数据完成前,其他的线程只能返回之前的数据,且实现起来麻烦

| 解决方案 | 有点 | 缺点 |

|---|---|---|

| 互斥锁 | 1. 没有额外的内存消耗 2. 保证一致性 3. 实现简单 |

1. 线程需要等待,性能受影响 2. 可能有死锁风险 |

| 逻辑过期 | 线程无需等待,性能较好 | 1. 不保证一致性 2. 有额外内存消耗 3. 实现复杂 |

利用互斥锁解决缓存击穿问题

核心思路:相较于原来从缓存中查询不到数据后直接查询数据库而言,现在的方案是 进行查询之后,如果从缓存没有查询到数据,则进行互斥锁的获取,获取互斥锁后,判断是否获得到了锁,如果没有获得到,则休眠,过一会再进行尝试,直到获取到锁为止,才能进行查询

如果获取到了锁的线程,再去进行查询,查询后将数据写入redis,再释放锁,返回数据,利用互斥锁就能保证只有一个线程去执行操作数据库的逻辑,防止缓存击穿

操作锁的代码:

核心思路就是利用redis的setnx方法来表示获取锁,该方法含义是redis中如果没有这个key,则插入成功,返回1,在stringRedisTemplate中返回true, 如果有这个key则插入失败,则返回0,在stringRedisTemplate返回false,我们可以通过true,或者是false,来表示是否有线程成功插入key,成功插入的key的线程我们认为他就是获得到锁的线程。

private boolean tryLock(String key) {

Boolean flag = stringRedisTemplate.opsForValue().setIfAbsent(key, "1", 10, TimeUnit.SECONDS);

return BooleanUtil.isTrue(flag);

}

private void unlock(String key) {

stringRedisTemplate.delete(key);

}

public Shop queryWithMutex(Long id) {

String key = CACHE_SHOP_KEY + id;

// 1、从redis中查询商铺缓存

String shopJson = stringRedisTemplate.opsForValue().get("key");

// 2、判断是否存在

if (StrUtil.isNotBlank(shopJson)) {

// 存在,直接返回

return JSONUtil.toBean(shopJson, Shop.class);

}

//判断命中的值是否是空值

if (shopJson != null) {

//返回一个错误信息

return null;

}

// 4.实现缓存重构

//4.1 获取互斥锁

String lockKey = "lock:shop:" + id;

Shop shop = null;

try {

boolean isLock = tryLock(lockKey);

// 4.2 判断否获取成功

if(!isLock){

//4.3 失败,则休眠重试

Thread.sleep(50);

return queryWithMutex(id);

}

//4.4 成功,根据id查询数据库

shop = getById(id);

// 5.不存在,返回错误

if(shop == null){

//将空值写入redis

stringRedisTemplate.opsForValue().set(key,"",CACHE_NULL_TTL,TimeUnit.MINUTES);

//返回错误信息

return null;

}

//6.写入redis

stringRedisTemplate.opsForValue().set(key,JSONUtil.toJsonStr(shop),CACHE_NULL_TTL,TimeUnit.MINUTES);

}catch (Exception e){

throw new RuntimeException(e);

}

finally {

//7.释放互斥锁

unlock(lockKey);

}

return shop;

}

利用逻辑过期解决缓存击穿问题

需求:修改根据id查询商铺的业务,基于逻辑过期方式来解决缓存击穿问题

思路分析:当用户开始查询redis时,判断是否命中,如果没有命中则直接返回空数据,不查询数据库,而一旦命中后,将value取出,判断value中的过期时间是否满足,如果没有过期,则直接返回redis中的数据,如果过期,则在开启独立线程后直接返回之前的数据,独立线程去重构数据,重构完成后释放互斥锁。

如果封装数据:因为现在redis中存储的数据的value需要带上过期时间,此时要么你去修改原来的实体类,要么你

步骤一、

新建一个实体类,我们采用第二个方案,这个方案,对原来代码没有侵入性。

@Data

public class RedisData {

private LocalDateTime expireTime;

private Object data;

}

步骤二、

在ShopServiceImpl 新增此方法,利用单元测试进行缓存预热

public void saveShop2Redis(Long id,Long expireSeconds) {

// 1.查询店铺数据

Shop shop = getById(id);

// 2.封装逻辑过期时间

RedisData redisData = new RedisData();

redisData.setData(shop);

// 在当前的时间基础上加上expireSeconds秒

redisData.setExpireTime(LocalDateTime.now().plusSeconds(expireSeconds));

// 3.写入redis

stringRedisTemplate.opsForValue().set(CACHE_SHOP_KEY + id,JSONUtil.toJsonStr(redisData));

}

@Resource

private ShopServiceImpl shopService;

@Test

public void testSaveShopRedis() {

shopService.saveShop2Redis(1L,30L);

}

步骤三:正式代码

ShopServiceImpl

private static final ExecutorService CACHE_REBUILD_EXECUTOR = Executors.newFixedThreadPool(10);

public Shop queryWithLogicalExpire( Long id ) {

String key = CACHE_SHOP_KEY + id;

// 1.从redis查询商铺缓存

String json = stringRedisTemplate.opsForValue().get(key);

// 2.判断是否存在

if (StrUtil.isBlank(json)) {

// 3.存在,直接返回

return null;

}

// 4.命中,需要先把json反序列化为对象

RedisData redisData = JSONUtil.toBean(json, RedisData.class);

Shop shop = JSONUtil.toBean((JSONObject) redisData.getData(), Shop.class);

LocalDateTime expireTime = redisData.getExpireTime();

// 5.判断是否过期

if(expireTime.isAfter(LocalDateTime.now())) {

// 5.1.未过期,直接返回店铺信息

return shop;

}

// 5.2.已过期,需要缓存重建

// 6.缓存重建

// 6.1.获取互斥锁

String lockKey = LOCK_SHOP_KEY + id;

boolean isLock = tryLock(lockKey);

// 6.2.判断是否获取锁成功

if (isLock){

CACHE_REBUILD_EXECUTOR.submit( ()->{

try{

//重建缓存

this.saveShop2Redis(id,20L);

}catch (Exception e){

throw new RuntimeException(e);

}finally {

unlock(lockKey);

}

});

}

// 6.4.返回过期的商铺信息

return shop;

}

3.1、封装Redis工具类

基于StringRedisTemplate封装一个缓存工具类,满足下列需求:

- 方法1:将任意Java对象序列化为json并存储在string类型的key中,并且可以设置TTL过期时间

- 方法2:将任意Java对象序列化为json并存储在string类型的key中,并且可以设置逻辑过期时间,用于处理缓

存击穿问题

- 方法3:根据指定的key查询缓存,并反序列化为指定类型,利用缓存空值的方式解决缓存穿透问题

- 方法4:根据指定的key查询缓存,并反序列化为指定类型,需要利用逻辑过期解决缓存击穿问题

将逻辑进行封装

@Slf4j

@Component

public class CacheClient {

private final StringRedisTemplate stringRedisTemplate;

private static final ExecutorService CACHE_REBUILD_EXECUTOR = Executors.newFixedThreadPool(10);

public CacheClient(StringRedisTemplate stringRedisTemplate) {

this.stringRedisTemplate = stringRedisTemplate;

}

public void set(String key, Object value, Long time, TimeUnit unit) {

stringRedisTemplate.opsForValue().set(key, JSONUtil.toJsonStr(value), time, unit);

}

public void setWithLogicalExpire(String key, Object value, Long time, TimeUnit unit) {

// 设置逻辑过期

RedisData redisData = new RedisData();

redisData.setData(value);

redisData.setExpireTime(LocalDateTime.now().plusSeconds(unit.toSeconds(time)));

// 写入Redis

stringRedisTemplate.opsForValue().set(key, JSONUtil.toJsonStr(redisData));

}

public <R,ID> R queryWithPassThrough(

String keyPrefix, ID id, Class<R> type, Function<ID, R> dbFallback, Long time, TimeUnit unit){

String key = keyPrefix + id;

// 1.从redis查询商铺缓存

String json = stringRedisTemplate.opsForValue().get(key);

// 2.判断是否存在

if (StrUtil.isNotBlank(json)) {

// 3.存在,直接返回

return JSONUtil.toBean(json, type);

}

// 判断命中的是否是空值

if (json != null) {

// 返回一个错误信息

return null;

}

// 4.不存在,根据id查询数据库

R r = dbFallback.apply(id);

// 5.不存在,返回错误

if (r == null) {

// 将空值写入redis

stringRedisTemplate.opsForValue().set(key, "", CACHE_NULL_TTL, TimeUnit.MINUTES);

// 返回错误信息

return null;

}

// 6.存在,写入redis

this.set(key, r, time, unit);

return r;

}

public <R, ID> R queryWithLogicalExpire(

String keyPrefix, ID id, Class<R> type, Function<ID, R> dbFallback, Long time, TimeUnit unit) {

String key = keyPrefix + id;

// 1.从redis查询商铺缓存

String json = stringRedisTemplate.opsForValue().get(key);

// 2.判断是否存在

if (StrUtil.isBlank(json)) {

// 3.存在,直接返回

return null;

}

// 4.命中,需要先把json反序列化为对象

RedisData redisData = JSONUtil.toBean(json, RedisData.class);

R r = JSONUtil.toBean((JSONObject) redisData.getData(), type);

LocalDateTime expireTime = redisData.getExpireTime();

// 5.判断是否过期

if(expireTime.isAfter(LocalDateTime.now())) {

// 5.1.未过期,直接返回店铺信息

return r;

}

// 5.2.已过期,需要缓存重建

// 6.缓存重建

// 6.1.获取互斥锁

String lockKey = LOCK_SHOP_KEY + id;

boolean isLock = tryLock(lockKey);

// 6.2.判断是否获取锁成功

if (isLock){

// 6.3.成功,开启独立线程,实现缓存重建

CACHE_REBUILD_EXECUTOR.submit(() -> {

try {

// 查询数据库

R newR = dbFallback.apply(id);

// 重建缓存

this.setWithLogicalExpire(key, newR, time, unit);

} catch (Exception e) {

throw new RuntimeException(e);

}finally {

// 释放锁

unlock(lockKey);

}

});

}

// 6.4.返回过期的商铺信息

return r;

}

public <R, ID> R queryWithMutex(

String keyPrefix, ID id, Class<R> type, Function<ID, R> dbFallback, Long time, TimeUnit unit) {

String key = keyPrefix + id;

// 1.从redis查询商铺缓存

String shopJson = stringRedisTemplate.opsForValue().get(key);

// 2.判断是否存在

if (StrUtil.isNotBlank(shopJson)) {

// 3.存在,直接返回

return JSONUtil.toBean(shopJson, type);

}

// 判断命中的是否是空值

if (shopJson != null) {

// 返回一个错误信息

return null;

}

// 4.实现缓存重建

// 4.1.获取互斥锁

String lockKey = LOCK_SHOP_KEY + id;

R r = null;

try {

boolean isLock = tryLock(lockKey);

// 4.2.判断是否获取成功

if (!isLock) {

// 4.3.获取锁失败,休眠并重试

Thread.sleep(50);

return queryWithMutex(keyPrefix, id, type, dbFallback, time, unit);

}

// 4.4.获取锁成功,根据id查询数据库

r = dbFallback.apply(id);

// 5.不存在,返回错误

if (r == null) {

// 将空值写入redis

stringRedisTemplate.opsForValue().set(key, "", CACHE_NULL_TTL, TimeUnit.MINUTES);

// 返回错误信息

return null;

}

// 6.存在,写入redis

this.set(key, r, time, unit);

} catch (InterruptedException e) {

throw new RuntimeException(e);

}finally {

// 7.释放锁

unlock(lockKey);

}

// 8.返回

return r;

}

private boolean tryLock(String key) {

Boolean flag = stringRedisTemplate.opsForValue().setIfAbsent(key, "1", 10, TimeUnit.SECONDS);

return BooleanUtil.isTrue(flag);

}

private void unlock(String key) {

stringRedisTemplate.delete(key);

}

}

在ShopServiceImpl 中

@Resource

private CacheClient cacheClient;

@Override

public Result queryById(Long id) {

// 解决缓存穿透

Shop shop = cacheClient

.queryWithPassThrough(CACHE_SHOP_KEY, id, Shop.class, this::getById, CACHE_SHOP_TTL, TimeUnit.MINUTES);

// 互斥锁解决缓存击穿

// Shop shop = cacheClient

// .queryWithMutex(CACHE_SHOP_KEY, id, Shop.class, this::getById, CACHE_SHOP_TTL, TimeUnit.MINUTES);

// 逻辑过期解决缓存击穿

// Shop shop = cacheClient

// .queryWithLogicalExpire(CACHE_SHOP_KEY, id, Shop.class, this::getById, 20L, TimeUnit.SECONDS);

if (shop == null) {

return Result.fail("店铺不存在!");

}

// 7.返回

return Result.ok(shop);

}

10 优惠卷秒杀

1. 全局唯一ID

当用户抢购时,就会生成订单并保存到tb_voucher_order这张表中,而订单表如果使用数据库自增ID就存在一些问题:

id的规律性太明显

受单表数据量的限制

场景分析:如果我们的id具有太明显的规则,用户或者说商业对手很容易猜测出来我们的一些敏感信息,比如商城在一天时间内,卖出了多少单,这明显不合适。

场景分析二:随着我们商城规模越来越大,mysql的单表的容量不宜超过500W,数据量过大之后,我们要进行拆库拆表,但拆分表了之后,他们从逻辑上讲他们是同一张表,所以他们的id是不能一样的, 于是乎我们需要保证id的唯一性。

全局ID生成器,是一种在分布式系统下用来生成全局唯一ID的工具,一般要满足下列特性:

为了增加ID的安全性,我们可以不直接使用Redis自增的数值,而是拼接一些其它信息:

long类型:8个字节,1byte = 8bit,8byte = 64bit

ID的组成部分:符号位:1bit,永远为0

时间戳:31bit,以秒为单位,可以使用69年

序列号:32bit,秒内的计数器,支持每秒产生2^32个不同ID

2. Redis实现全局唯一Id

@Component

public class RedisIdWorker {

/**

* 开始时间戳

*/

private static final long BEGIN_TIMESTAMP = 1640995200L;

/**

* 序列号的位数

*/

private static final int COUNT_BITS = 32;

private StringRedisTemplate stringRedisTemplate;

public RedisIdWorker(StringRedisTemplate stringRedisTemplate) {

this.stringRedisTemplate = stringRedisTemplate;

}

public long nextId(String keyPrefix) {

// 1.生成时间戳

LocalDateTime now = LocalDateTime.now();

long nowSecond = now.toEpochSecond(ZoneOffset.UTC);

long timestamp = nowSecond - BEGIN_TIMESTAMP;

// 2.生成序列号

// 2.1.获取当前日期,精确到天

String date = now.format(DateTimeFormatter.ofPattern("yyyy:MM:dd"));

// 2.2.自增长

long count = stringRedisTemplate.opsForValue().increment("icr:" + keyPrefix + ":" + date);

// 3.拼接并返回

return timestamp << COUNT_BITS | count;

}

}

3. 实现秒杀下单

秒杀下单应该思考的内容:

下单时需要判断两点:

- 秒杀是否开始或结束,如果尚未开始或已经结束则无法下单

- 库存是否充足,不足则无法下单

下单核心逻辑分析:

当用户开始进行下单,我们应当去查询优惠卷信息,查询到优惠卷信息,判断是否满足秒杀条件

比如时间是否充足,如果时间充足,则进一步判断库存是否足够,如果两者都满足,则扣减库存,创建订单,然后返回订单id,如果有一个条件不满足则直接结束。

VoucherOrderServiceImpl

@Override

public Result seckillVoucher(Long voucherId) {

// 1.查询优惠券

SeckillVoucher voucher = seckillVoucherService.getById(voucherId);

// 2.判断秒杀是否开始

if (voucher.getBeginTime().isAfter(LocalDateTime.now())) {

// 尚未开始

return Result.fail("秒杀尚未开始!");

}

// 3.判断秒杀是否已经结束

if (voucher.getEndTime().isBefore(LocalDateTime.now())) {

// 尚未开始

return Result.fail("秒杀已经结束!");

}

// 4.判断库存是否充足

if (voucher.getStock() < 1) {

// 库存不足

return Result.fail("库存不足!");

}

//5,扣减库存

boolean success = seckillVoucherService.update()

.setSql("stock= stock -1")

.eq("voucher_id", voucherId).update();

if (!success) {

//扣减库存

return Result.fail("库存不足!");

}

//6.创建订单

VoucherOrder voucherOrder = new VoucherOrder();

// 6.1.订单id

long orderId = redisIdWorker.nextId("order");

voucherOrder.setId(orderId);

// 6.2.用户id

Long userId = UserHolder.getUser().getId();

voucherOrder.setUserId(userId);

// 6.3.代金券id

voucherOrder.setVoucherId(voucherId);

save(voucherOrder);

return Result.ok(orderId);

}

4. 库存超卖问题分析

if (voucher.getStock() < 1) {

// 库存不足

return Result.fail("库存不足!");

}

//5,扣减库存

boolean success = seckillVoucherService.update()

.setSql("stock= stock -1")

.eq("voucher_id", voucherId).update();

if (!success) {

//扣减库存

return Result.fail("库存不足!");

}

假设线程1过来查询库存,判断出来库存大于1,正准备去扣减库存,但是还没有来得及去扣减,此时线程2过来,线程2也去查询库存,发现这个数量一定也大于1,那么这两个线程都会去扣减库存,最终多个线程相当于一起去扣减库存,此时就会出现库存的超卖问题。

超卖问题是典型的多线程安全问题,针对这一问题的常见解决方案就是加锁:而对于加锁,我们通常有两种解决方案:见下图:

悲观锁可以实现对于数据的串行化执行,比如syn,和lock都是悲观锁的代表,同时,悲观锁中又可以再细分为公平锁,非公平锁,可重入锁,等等

乐观锁:

乐观锁:会有一个版本号,每次操作数据会对版本号+1,再提交回数据时,会去校验是否比之前的版本大1 ,如果大1 ,则进行操作成功,这套机制的核心逻辑在于,如果在操作过程中,版本号只比原来大1 ,那么就意味着操作过程中没有人对他进行过修改,他的操作就是安全的,如果不大1,则数据被修改过,当然乐观锁还有一些变种的处理方式比如cas

乐观锁的典型代表:就是cas,利用cas进行无锁化机制加锁,var5 是操作前读取的内存值,while中的var1+var2 是预估值,如果预估值 == 内存值,则代表中间没有被人修改过,此时就将新值去替换 内存值

其中do while 是为了在操作失败时,再次进行自旋操作,即把之前的逻辑再操作一次。

int var5;

do {

var5 = this.getIntVolatile(var1, var2);

} while(!this.compareAndSwapInt(var1, var2, var5, var5 + var4));

return var5;

5. 乐观锁解决超卖问题

修改代码方案一、

VoucherOrderServiceImpl 在扣减库存时,改为:

boolean success = seckillVoucherService.update()

.setSql("stock= stock -1") //set stock = stock -1

.eq("voucher_id", voucherId).eq("stock",voucher.getStock()).update(); //where id = ? and stock = ?

以上逻辑的核心含义是:只要我扣减库存时的库存和之前我查询到的库存是一样的,就意味着没有人在中间修改过库存,那么此时就是安全的,但是以上这种方式通过测试发现会有很多失败的情况,失败的原因在于:在使用乐观锁过程中假设100个线程同时都拿到了100的库存,然后大家一起去进行扣减,但是100个人中只有1个人能扣减成功,其他的人在处理时,他们在扣减时,库存已经被修改过了,所以此时其他线程都会失败

修改代码方案二、

之前的方式要修改前后都保持一致,但是这样我们分析过,成功的概率太低,所以我们的乐观锁需要变一下,改成stock大于0 即可

boolean success = seckillVoucherService.update()

.setSql("stock= stock -1")

.eq("voucher_id", voucherId).update().gt("stock",0); //where id = ? and stock > 0

知识小扩展:

针对cas中的自旋压力过大,我们可以使用Longaddr这个类去解决

Java8 提供的一个对AtomicLong改进后的一个类,LongAdder

大量线程并发更新一个原子性的时候,天然的问题就是自旋,会导致并发性问题,当然这也比我们直接使用syn来的好

所以利用这么一个类,LongAdder来进行优化

如果获取某个值,则会对cell和base的值进行递增,最后返回一个完整的值

6. 优惠券秒杀-一人一单

需求:修改秒杀业务,要求同一个优惠券,一个用户只能下一单

现在的问题在于:

优惠卷是为了引流,但是目前的情况是,一个人可以无限制的抢这个优惠卷,所以我们应当增加一层逻辑,让一个用户只能下一个单,而不是让一个用户下多个单

具体操作逻辑如下:比如时间是否充足,如果时间充足,则进一步判断库存是否足够,然后再根据优惠卷id和用户id查询是否已经下过这个订单,如果下过这个订单,则不再下单,否则进行下单

VoucherOrderServiceImpl

初步代码:增加一人一单逻辑

@Override

public Result seckillVoucher(Long voucherId) {

// 1.查询优惠券

SeckillVoucher voucher = seckillVoucherService.getById(voucherId);

// 2.判断秒杀是否开始

if (voucher.getBeginTime().isAfter(LocalDateTime.now())) {

// 尚未开始

return Result.fail("秒杀尚未开始!");

}

// 3.判断秒杀是否已经结束

if (voucher.getEndTime().isBefore(LocalDateTime.now())) {

// 尚未开始

return Result.fail("秒杀已经结束!");

}

// 4.判断库存是否充足

if (voucher.getStock() < 1) {

// 库存不足

return Result.fail("库存不足!");

}

// 5.一人一单逻辑

// 5.1.用户id

Long userId = UserHolder.getUser().getId();

int count = query().eq("user_id", userId).eq("voucher_id", voucherId).count();

// 5.2.判断是否存在

if (count > 0) {

// 用户已经购买过了

return Result.fail("用户已经购买过一次!");

}

//6,扣减库存

boolean success = seckillVoucherService.update()

.setSql("stock= stock -1")

.eq("voucher_id", voucherId).update();

if (!success) {

//扣减库存

return Result.fail("库存不足!");

}

//7.创建订单

VoucherOrder voucherOrder = new VoucherOrder();

// 7.1.订单id

long orderId = redisIdWorker.nextId("order");

voucherOrder.setId(orderId);

voucherOrder.setUserId(userId);

// 7.3.代金券id

voucherOrder.setVoucherId(voucherId);

save(voucherOrder);

return Result.ok(orderId);

}

**存在问题:**现在的问题还是和之前一样,并发过来,查询数据库,都不存在订单,所以我们还是需要加锁,但是乐观锁比较适合更新数据,而现在是插入数据,所以我们需要使用悲观锁操作

**注意:**在这里提到了非常多的问题,我们需要慢慢的来思考,首先我们的初始方案是封装了一个createVoucherOrder方法,同时为了确保他线程安全,在方法上添加了一把synchronized 锁

@Transactional

public synchronized Result createVoucherOrder(Long voucherId) {

Long userId = UserHolder.getUser().getId();

// 5.1.查询订单

int count = query().eq("user_id", userId).eq("voucher_id", voucherId).count();

// 5.2.判断是否存在

if (count > 0) {

// 用户已经购买过了

return Result.fail("用户已经购买过一次!");

}

// 6.扣减库存

boolean success = seckillVoucherService.update()

.setSql("stock = stock - 1") // set stock = stock - 1

.eq("voucher_id", voucherId).gt("stock", 0) // where id = ? and stock > 0

.update();

if (!success) {

// 扣减失败

return Result.fail("库存不足!");

}

// 7.创建订单

VoucherOrder voucherOrder = new VoucherOrder();

// 7.1.订单id

long orderId = redisIdWorker.nextId("order");

voucherOrder.setId(orderId);

// 7.2.用户id

voucherOrder.setUserId(userId);

// 7.3.代金券id

voucherOrder.setVoucherId(voucherId);

save(voucherOrder);

// 7.返回订单id

return Result.ok(orderId);

}

,但是这样添加锁,锁的粒度太粗了,在使用锁过程中,控制锁粒度 是一个非常重要的事情,因为如果锁的粒度太大,会导致每个线程进来都会锁住,所以我们需要去控制锁的粒度,以下这段代码需要修改为:

intern() 这个方法是从常量池中拿到数据,如果我们直接使用userId.toString() 他拿到的对象实际上是不同的对象,new出来的对象,我们使用锁必须保证锁必须是同一把,所以我们需要使用intern()方法

@Transactional

public Result createVoucherOrder(Long voucherId) {

Long userId = UserHolder.getUser().getId();

synchronized(userId.toString().intern()){

// 5.1.查询订单

int count = query().eq("user_id", userId).eq("voucher_id", voucherId).count();

// 5.2.判断是否存在

if (count > 0) {

// 用户已经购买过了

return Result.fail("用户已经购买过一次!");

}

// 6.扣减库存

boolean success = seckillVoucherService.update()

.setSql("stock = stock - 1") // set stock = stock - 1

.eq("voucher_id", voucherId).gt("stock", 0) // where id = ? and stock > 0

.update();

if (!success) {

// 扣减失败

return Result.fail("库存不足!");

}

// 7.创建订单

VoucherOrder voucherOrder = new VoucherOrder();

// 7.1.订单id

long orderId = redisIdWorker.nextId("order");

voucherOrder.setId(orderId);

// 7.2.用户id

voucherOrder.setUserId(userId);

// 7.3.代金券id

voucherOrder.setVoucherId(voucherId);

save(voucherOrder);

// 7.返回订单id

return Result.ok(orderId);

}

}

但是以上代码还是存在问题,问题的原因在于当前方法被spring的事务控制,如果你在方法内部加锁,可能会导致当前方法事务还没有提交,但是锁已经释放也会导致问题,所以我们选择将当前方法整体包裹起来,确保事务不会出现问题:如下:

在seckillVoucher 方法中,添加以下逻辑,这样就能保证事务的特性,同时也控制了锁的粒度

// 给用户id加锁

// intern()表示 确定的池中已经包含与此string对象相等的字符串,则返回池中的字符串,如果不加toString()将会是全新的字符串对象

synchronized (voucherId.toString().intern()) {

return createVoucherOrder(voucherId, userId);

}

但是以上做法依然有问题,因为你调用的方法,其实是this.的方式调用的,事务想要生效,还得利用代理来生效,所以这个地方,我们需要获得原始的事务对象, 来操作事务

// 给用户id加锁

// intern()表示 确定的池中已经包含与此string对象相等的字符串,则返回池中的字符串,如果不加toString()将会是全新的字符串对象

synchronized (voucherId.toString().intern()) {

// 获取代理对象(事务)

IVoucherOrderService proxy = (IVoucherOrderService) AopContext.currentProxy();

return proxy.createVoucherOrder(voucherId, userId);

}

7. 集群环境下的并发问题

1、我们将服务启动两份,端口分别为8081和8082:

复制一份service在 vm ptions :-Dserver.port=8082

2、然后修改nginx的conf目录下的nginx.conf文件,配置反向代理和负载均衡:

重启nginx

nginx目录下执行

nginx.exe -s reload

有关锁失效原因分析

由于现在我们部署了多个tomcat,每个tomcat都有一个属于自己的jvm,那么假设在服务器A的tomcat内部,有两个线程,这两个线程由于使用的是同一份代码,那么他们的锁对象是同一个,是可以实现互斥的,但是如果现在是服务器B的tomcat内部,又有两个线程,但是他们的锁对象写的虽然和服务器A一样,但是锁对象却不是同一个,所以线程3和线程4可以实现互斥,但是却无法和线程1和线程2实现互斥,这就是 集群环境下,syn锁失效的原因,在这种情况下,我们就需要使用分布式锁来解决这个问题。

通过加锁可以解决在单机情况下的一人一单安全问题,但是在集群模式下就不行了。

11 分布式锁

1. 基本原理和实现方式对比

分布式锁:满足分布式系统或集群模式下多进程可见并且互斥的锁。

分布式锁的核心思想就是让大家都使用同一把锁,只要大家使用的是同一把锁,那么我们就能锁住线程,不让线程进行,让程序串行执行,这就是分布式锁的核心思路

可见性:多个线程都能看到相同的结果,注意:这个地方说的可见性并不是并发编程中指的内存可见性,只是说多个进程之间都能感知到变化的意思

互斥:互斥是分布式锁的最基本的条件,使得程序串行执行

高可用:程序不易崩溃,时时刻刻都保证较高的可用性

高性能:由于加锁本身就让性能降低,所有对于分布式锁本身需要他就较高的加锁性能和释放锁性能

安全性:安全也是程序中必不可少的一环

常见的分布式锁有三种

Mysql:mysql本身就带有锁机制,但是由于mysql性能本身一般,所以采用分布式锁的情况下,其实使用mysql作为分布式锁比较少见

Redis:redis作为分布式锁是非常常见的一种使用方式,现在企业级开发中基本都使用redis或者zookeeper作为分布式锁,利用setnx这个方法,如果插入key成功,则表示获得到了锁,如果有人插入成功,其他人插入失败则表示无法获得到锁,利用这套逻辑来实现分布式锁

Zookeeper:zookeeper也是企业级开发中较好的一个实现分布式锁的方案,由于本套视频并不讲解zookeeper的原理和分布式锁的实现,所以不过多阐述

2. Redis分布式锁的实现核心思路

实现分布式锁时需要实现的两个基本方法:

-

获取锁:

- 互斥:确保只能有一个线程获取锁

- 非阻塞:尝试一次,成功返回true,失败返回false

-

释放锁:

- 手动释放

- 超时释放:获取锁时添加一个超时时间

核心思路:

我们利用redis 的setNx 方法,当有多个线程进入时,我们就利用该方法,第一个线程进入时,redis 中就有这个key 了,返回了1,如果结果是1,则表示他抢到了锁,那么他去执行业务,然后再删除锁,退出锁逻辑,没有抢到锁的哥们,等待一定时间后重试即可

3. 实现分布式锁版本一

- 加锁逻辑

锁的基本接口

public interface ILock {

/**

* 尝试获取锁

* @param timeoutSec

* @return

*/

boolean tryLock(long timeoutSec);

/**

* 释放锁

*/

void unlock();

}

SimpleRedisLock

利用setnx方法进行加锁,同时增加过期时间,防止死锁,此方法可以保证加锁和增加过期时间具有原子性

private static final String KEY_PREFIX="lock:"

@Override

public boolean tryLock(long timeoutSec) {

// 获取线程标示

String threadId = Thread.currentThread().getId()

// 获取锁

Boolean success = stringRedisTemplate.opsForValue()

.setIfAbsent(KEY_PREFIX + name, threadId + "", timeoutSec, TimeUnit.SECONDS);

return Boolean.TRUE.equals(success);

}

- 释放锁逻辑

SimpleRedisLock

释放锁,防止删除别人的锁

public void unlock() {

//通过del删除锁

stringRedisTemplate.delete(KEY_PREFIX + name);

}

- 修改业务代码

@Override

public Result seckillVoucher(Long voucherId) {

// 1.查询优惠券

SeckillVoucher voucher = seckillVoucherService.getById(voucherId);

// 2.判断秒杀是否开始

if (voucher.getBeginTime().isAfter(LocalDateTime.now())) {

// 尚未开始

return Result.fail("秒杀尚未开始!");

}

// 3.判断秒杀是否已经结束

if (voucher.getEndTime().isBefore(LocalDateTime.now())) {

// 尚未开始

return Result.fail("秒杀已经结束!");

}

// 4.判断库存是否充足

if (voucher.getStock() < 1) {

// 库存不足

return Result.fail("库存不足!");

}

Long userId = UserHolder.getUser().getId();

//创建锁对象(新增代码)

SimpleRedisLock lock = new SimpleRedisLock("order:" + userId, stringRedisTemplate);

//获取锁对象

boolean isLock = lock.tryLock(1200);

//加锁失败

if (!isLock) {

return Result.fail("不允许重复下单");

}

try {

//获取代理对象(事务)

IVoucherOrderService proxy = (IVoucherOrderService) AopContext.currentProxy();

return proxy.createVoucherOrder(voucherId);

} finally {

//释放锁

lock.unlock();

}

}

4. Redis分布式锁误删情况说明

逻辑说明:

持有锁的线程在锁的内部出现了阻塞,导致他的锁自动释放,这时其他线程,线程2来尝试获得锁,就拿到了这把锁,然后线程2在持有锁执行过程中,线程1反应过来,继续执行,而线程1执行过程中,走到了删除锁逻辑,此时就会把本应该属于线程2的锁进行删除,这就是误删别人锁的情况说明

解决方案:解决方案就是在每个线程释放锁的时候,去判断一下当前这把锁是否属于自己,如果属于自己,则不进行锁的删除,假设还是上边的情况,线程1卡顿,锁自动释放,线程2进入到锁的内部执行逻辑,此时线程1反应过来,然后删除锁,但是线程1,一看当前这把锁不是属于自己,于是不进行删除锁逻辑,当线程2走到删除锁逻辑时,如果没有卡过自动释放锁的时间点,则判断当前这把锁是属于自己的,于是删除这把锁。

逻辑说明:

持有锁的线程在锁的内部出现了阻塞,导致他的锁自动释放,这时其他线程,线程2来尝试获得锁,就拿到了这把锁,然后线程2在持有锁执行过程中,线程1反应过来,继续执行,而线程1执行过程中,走到了删除锁逻辑,此时就会把本应该属于线程2的锁进行删除,这就是误删别人锁的情况说明

解决方案:解决方案就是在每个线程释放锁的时候,去判断一下当前这把锁是否属于自己,如果属于自己,则不进行锁的删除,假设还是上边的情况,线程1卡顿,锁自动释放,线程2进入到锁的内部执行逻辑,此时线程1反应过来,然后删除锁,但是线程1,一看当前这把锁不是属于自己,于是不进行删除锁逻辑,当线程2走到删除锁逻辑时,如果没有卡过自动释放锁的时间点,则判断当前这把锁是属于自己的,于是删除这把锁。

5. 解决Redis分布式锁误删问题

需求:修改之前的分布式锁实现,满足:在获取锁时存入线程标示(可以用UUID表示)

在释放锁时先获取锁中的线程标示,判断是否与当前线程标示一致

- 如果一致则释放锁

- 如果不一致则不释放锁

核心逻辑:在存入锁时,放入自己线程的标识,在删除锁时,判断当前这把锁的标识是不是自己存入的,如果是,则进行删除,如果不是,则不进行删除。

具体代码如下:加锁

private static final String ID_PREFIX = UUID.randomUUID().toString(true) + "-";

@Override

public boolean tryLock(long timeoutSec) {

// 获取线程标示

String threadId = ID_PREFIX + Thread.currentThread().getId();

// 获取锁

Boolean success = stringRedisTemplate.opsForValue()

.setIfAbsent(KEY_PREFIX + name, threadId, timeoutSec, TimeUnit.SECONDS);

return Boolean.TRUE.equals(success);

}

释放锁

public void unlock() {

// 获取线程标示

String threadId = ID_PREFIX + Thread.currentThread().getId();

// 获取锁中的标示

String id = stringRedisTemplate.opsForValue().get(KEY_PREFIX + name);

// 判断标示是否一致

if(threadId.equals(id)) {

// 释放锁

stringRedisTemplate.delete(KEY_PREFIX + name);

}

}

有关代码实操说明:

在我们修改完此处代码后,我们重启工程,然后启动两个线程,第一个线程持有锁后,手动释放锁,第二个线程 此时进入到锁内部,再放行第一个线程,此时第一个线程由于锁的value值并非是自己,所以不能释放锁,也就无法删除别人的锁,此时第二个线程能够正确释放锁,通过这个案例初步说明我们解决了锁误删的问题。

6. 分布式锁的原子性问题

更为极端的误删逻辑说明:

线程1现在持有锁之后,在执行业务逻辑过程中,他正准备删除锁,而且已经走到了条件判断的过程中,比如他已经拿到了当前这把锁确实是属于他自己的,正准备删除锁,但是此时他的锁到期了,那么此时线程2进来,但是线程1他会接着往后执行,当他卡顿结束后,他直接就会执行删除锁那行代码,相当于条件判断并没有起到作用,这就是删锁时的原子性问题,之所以有这个问题,是因为线程1的拿锁,比锁,删锁,实际上并不是原子性的,我们要防止刚才的情况发生,

1. Lua脚本解决多条命令原子性问题

Redis提供了Lua脚本功能,在一个脚本中编写多条Redis命令,确保多条命令执行时的原子性。Lua是一种编程语言,它的基本语法大家可以参考网站:https://www.runoob.com/lua/lua-tutorial.html,这里重点介绍Redis提供的调用函数,我们可以使用lua去操作redis,又能保证他的原子性,这样就可以实现拿锁比锁删锁是一个原子性动作了,作为Java程序员这一块并不作一个简单要求,并不需要大家过于精通,只需要知道他有什么作用即可。

这里重点介绍Redis提供的调用函数,语法如下:

redis.call('命令名称', 'key', '其它参数', ...)

例如,我们要执行set name jack,则脚本是这样:

# 执行 set name jack

redis.call('set', 'name', 'jack')

例如,我们要先执行set name Rose,再执行get name,则脚本如下:

# 先执行 set name jack

redis.call('set', 'name', 'Rose')

# 再执行 get name

local name = redis.call('get', 'name')

# 返回

return name

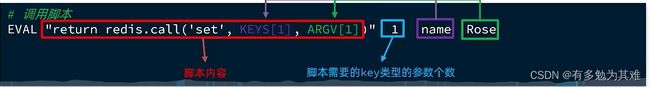

写好脚本以后,需要用Redis命令来调用脚本,调用脚本的常见命令如下:

例如,我们要执行 redis.call(‘set’, ‘name’, ‘jack’) 这个脚本,语法如下:

如果脚本中的key、value不想写死,可以作为参数传递。key类型参数会放入KEYS数组,其它参数会放入ARGV数组,在脚本中可以从KEYS和ARGV数组获取这些参数:

接下来我们来回一下我们释放锁的逻辑:

释放锁的业务流程是这样的

1、获取锁中的线程标示

2、判断是否与指定的标示(当前线程标示)一致

3、如果一致则释放锁(删除)

4、如果不一致则什么都不做

如果用Lua脚本来表示则是这样的:

最终我们操作redis的拿锁比锁删锁的lua脚本就会变成这样

-- 这里的 KEYS[1] 就是锁的key,这里的ARGV[1] 就是当前线程标示

-- 获取锁中的标示,判断是否与当前线程标示一致

if (redis.call('GET', KEYS[1]) == ARGV[1]) then

-- 一致,则删除锁

return redis.call('DEL', KEYS[1])

end

-- 不一致,则直接返回

return 0

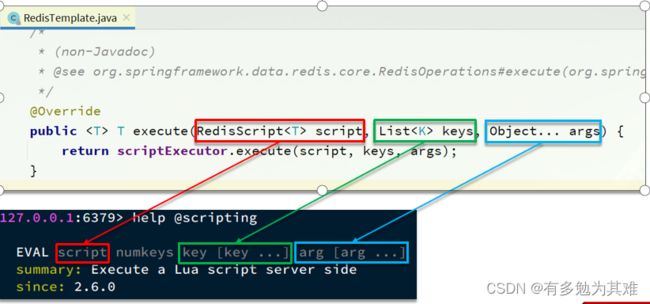

2. 利用Java代码调用Lua脚本改造分布式锁

lua脚本本身并不需要大家花费太多时间去研究,只需要知道如何调用,大致是什么意思即可,所以在笔记中并不会详细的去解释这些lua表达式的含义。

我们的RedisTemplate中,可以利用execute方法去执行lua脚本,参数对应关系就如下图股

Java代码

private static final DefaultRedisScript<Long> UNLOCK_SCRIPT;

static {

UNLOCK_SCRIPT = new DefaultRedisScript<>();

UNLOCK_SCRIPT.setLocation(new ClassPathResource("unlock.lua"));

UNLOCK_SCRIPT.setResultType(Long.class);

}

public void unlock() {

// 调用lua脚本

stringRedisTemplate.execute(

UNLOCK_SCRIPT,

Collections.singletonList(KEY_PREFIX + name),

ID_PREFIX + Thread.currentThread().getId());

}

经过以上代码改造后,我们就能够实现 拿锁比锁删锁的原子性动作了~

小总结:

基于Redis的分布式锁实现思路:

- 利用set nx ex获取锁,并设置过期时间,保存线程标示

- 释放锁时先判断线程标示是否与自己一致,一致则删除锁

- 特性:

- 利用set nx满足互斥性

- 利用set ex保证故障时锁依然能释放,避免死锁,提高安全性

- 利用Redis集群保证高可用和高并发特性

- 特性:

笔者总结:我们一路走来,利用添加过期时间,防止死锁问题的发生,但是有了过期时间之后,可能出现误删别人锁的问题,这个问题我们开始是利用删之前 通过拿锁,比锁,删锁这个逻辑来解决的,也就是删之前判断一下当前这把锁是否是属于自己的,但是现在还有原子性问题,也就是我们没法保证拿锁比锁删锁是一个原子性的动作,最后通过lua表达式来解决这个问题

但是目前还剩下一个问题锁不住,什么是锁不住呢,你想一想,如果当过期时间到了之后,我们可以给他续期一下,比如续个30s,就好像是网吧上网, 网费到了之后,然后说,来,网管,再给我来10块的,是不是后边的问题都不会发生了,那么续期问题怎么解决呢,可以依赖于我们接下来要学习redission啦

测试逻辑:

第一个线程进来,得到了锁,手动删除锁,模拟锁超时了,其他线程会执行lua来抢锁,当第一天线程利用lua删除锁时,lua能保证他不能删除他的锁,第二个线程删除锁时,利用lua同样可以保证不会删除别人的锁,同时还能保证原子性。

12 分布式锁-redission

1. 分布式锁-redission功能介绍

基于setnx实现的分布式锁存在下面的问题:

重入问题:重入问题是指 获得锁的线程可以再次进入到相同的锁的代码块中,可重入锁的意义在于防止死锁,比如HashTable这样的代码中,他的方法都是使用synchronized修饰的,假如他在一个方法内,调用另一个方法,那么此时如果是不可重入的,不就死锁了吗?所以可重入锁他的主要意义是防止死锁,我们的synchronized和Lock锁都是可重入的。

不可重试:是指目前的分布式只能尝试一次,我们认为合理的情况是:当线程在获得锁失败后,他应该能再次尝试获得锁。

**超时释放:**我们在加锁时增加了过期时间,这样的我们可以防止死锁,但是如果卡顿的时间超长,虽然我们采用了lua表达式防止删锁的时候,误删别人的锁,但是毕竟没有锁住,有安全隐患

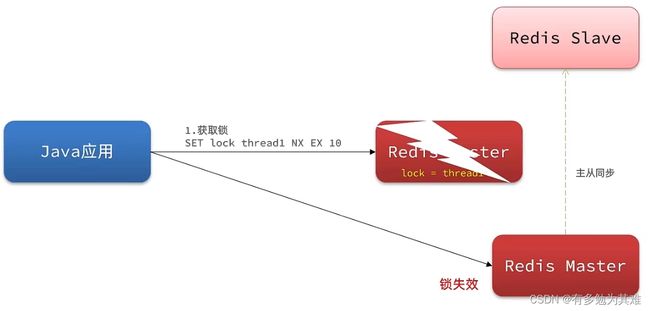

主从一致性: 如果Redis提供了主从集群,当我们向集群写数据时,主机需要异步的将数据同步给从机,而万一在同步过去之前,主机宕机了,就会出现死锁问题。

Redisson是一个在Redis的基础上实现的Java驻内存数据网格(In-Memory Data Grid)。它不仅提供了一系列的分布式的Java常用对象,还提供了许多分布式服务,其中就包含了各种分布式锁的实现。

Redission提供了分布式锁的多种多样的功能

官网:https://redisson.org/

2. 分布式锁-Redission快速入门

引入依赖:

<dependency>

<groupId>org.redisson</groupId>

<artifactId>redisson</artifactId>

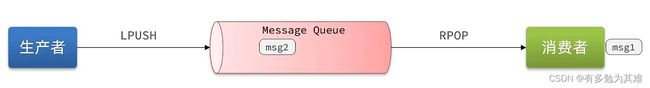

<version>3.13.6</version>

</dependency>

配置Redisson客户端:

@Configuration

public class RedissonConfig {

@Bean

public RedissonClient redissonClient(){

// 配置

Config config = new Config();

config.useSingleServer().setAddress("redis://192.168.150.101:6379")

.setPassword("123321");

// 创建RedissonClient对象

return Redisson.create(config);

}

}

如何使用Redission的分布式锁

@Resource

private RedissionClient redissonClient;

@Test

void testRedisson() throws Exception{

//获取锁(可重入),指定锁的名称

RLock lock = redissonClient.getLock("anyLock");

//尝试获取锁,参数分别是:获取锁的最大等待时间(期间会重试),锁自动释放时间,时间单位

boolean isLock = lock.tryLock(1,10,TimeUnit.SECONDS);

//判断获取锁成功

if(isLock){

try{

System.out.println("执行业务");

}finally{

//释放锁

lock.unlock();

}

}

}

在 VoucherOrderServiceImpl

注入RedissonClient

@Resource

private RedissonClient redissonClient;

@Override

public Result seckillVoucher(Long voucherId) {

// 1.查询优惠券

SeckillVoucher voucher = seckillVoucherService.getById(voucherId);

// 2.判断秒杀是否开始

if (voucher.getBeginTime().isAfter(LocalDateTime.now())) {

// 尚未开始

return Result.fail("秒杀尚未开始!");

}

// 3.判断秒杀是否已经结束

if (voucher.getEndTime().isBefore(LocalDateTime.now())) {

// 尚未开始

return Result.fail("秒杀已经结束!");

}

// 4.判断库存是否充足

if (voucher.getStock() < 1) {

// 库存不足

return Result.fail("库存不足!");

}

Long userId = UserHolder.getUser().getId();

//创建锁对象 这个代码不用了,因为我们现在要使用分布式锁

//SimpleRedisLock lock = new SimpleRedisLock("order:" + userId, stringRedisTemplate);

RLock lock = redissonClient.getLock("lock:order:" + userId);

//获取锁对象

boolean isLock = lock.tryLock();

//加锁失败

if (!isLock) {

return Result.fail("不允许重复下单");

}

try {

//获取代理对象(事务)

IVoucherOrderService proxy = (IVoucherOrderService) AopContext.currentProxy();

return proxy.createVoucherOrder(voucherId);

} finally {

//释放锁

lock.unlock();

}

}

3. 分布式锁-redission可重入锁原理

在Lock锁中,他是借助于底层的一个voaltile的一个state变量来记录重入的状态的,比如当前没有人持有这把锁,那么state=0,假如有人持有这把锁,那么state=1,如果持有这把锁的人再次持有这把锁,那么state就会+1 ,如果是对于synchronized而言,他在c语言代码中会有一个count,原理和state类似,也是重入一次就加一,释放一次就-1 ,直到减少成0 时,表示当前这把锁没有被人持有。

在redission中,我们的也支持支持可重入锁

在分布式锁中,他采用hash结构用来存储锁,其中大key表示表示这把锁是否存在,用小key表示当前这把锁被哪个线程持有,所以接下来我们一起分析一下当前的这个lua表达式

这个地方一共有3个参数

KEYS[1] : 锁名称

ARGV[1]: 锁失效时间

ARGV[2]: id + “:” + threadId; 锁的小key

exists: 判断数据是否存在 name:是lock是否存在,如果==0,就表示当前这把锁不存在

redis.call(‘hset’, KEYS[1], ARGV[2], 1);此时他就开始往redis里边去写数据 ,写成一个hash结构

Lock{

id + “:” + threadId : 1

}

如果当前这把锁存在,则第一个条件不满足,再判断

redis.call(‘hexists’, KEYS[1], ARGV[2]) == 1

此时需要通过大key+小key判断当前这把锁是否是属于自己的,如果是自己的,则进行

redis.call(‘hincrby’, KEYS[1], ARGV[2], 1)

将当前这个锁的value进行+1 ,redis.call(‘pexpire’, KEYS[1], ARGV[1]); 然后再对其设置过期时间,如果以上两个条件都不满足,则表示当前这把锁抢锁失败,最后返回pttl,即为当前这把锁的失效时间

如果小伙帮们看了前边的源码, 你会发现他会去判断当前这个方法的返回值是否为null,如果是null,则对应则前两个if对应的条件,退出抢锁逻辑,如果返回的不是null,即走了第三个分支,在源码处会进行while(true)的自旋抢锁。

4. 分布式锁-redission锁重试和WatchDog机制

说明:由于课程中已经说明了有关tryLock的源码解析以及其看门狗原理,所以笔者在这里给大家分析lock()方法的源码解析,希望大家在学习过程中,能够掌握更多的知识

抢锁过程中,获得当前线程,通过tryAcquire进行抢锁,该抢锁逻辑和之前逻辑相同

1、先判断当前这把锁是否存在,如果不存在,插入一把锁,返回null

2、判断当前这把锁是否是属于当前线程,如果是,则返回null

所以如果返回是null,则代表着当前这哥们已经抢锁完毕,或者可重入完毕,但是如果以上两个条件都不满足,则进入到第三个条件,返回的是锁的失效时间,同学们可以自行往下翻一点点,你能发现有个while( true) 再次进行tryAcquire进行抢锁

long threadId = Thread.currentThread().getId();

Long ttl = tryAcquire(-1, leaseTime, unit, threadId);

// lock acquired

if (ttl == null) {

return;

}

接下来会有一个条件分支,因为lock方法有重载方法,一个是带参数,一个是不带参数,如果带带参数传入的值是-1,如果传入参数,则leaseTime是他本身,所以如果传入了参数,此时leaseTime != -1 则会进去抢锁,抢锁的逻辑就是之前说的那三个逻辑

if (leaseTime != -1) {

return tryLockInnerAsync(waitTime, leaseTime, unit, threadId, RedisCommands.EVAL_LONG);

}

如果是没有传入时间,则此时也会进行抢锁, 而且抢锁时间是默认看门狗时间 commandExecutor.getConnectionManager().getCfg().getLockWatchdogTimeout()

ttlRemainingFuture.onComplete((ttlRemaining, e) 这句话相当于对以上抢锁进行了监听,也就是说当上边抢锁完毕后,此方法会被调用,具体调用的逻辑就是去后台开启一个线程,进行续约逻辑,也就是看门狗线程

RFuture<Long> ttlRemainingFuture = tryLockInnerAsync(waitTime,

commandExecutor.getConnectionManager().getCfg().getLockWatchdogTimeout(),

TimeUnit.MILLISECONDS, threadId, RedisCommands.EVAL_LONG);

ttlRemainingFuture.onComplete((ttlRemaining, e) -> {

if (e != null) {

return;

}

// lock acquired

if (ttlRemaining == null) {

scheduleExpirationRenewal(threadId);

}

});

return ttlRemainingFuture;

此逻辑就是续约逻辑,注意看commandExecutor.getConnectionManager().newTimeout() 此方法

Method( new TimerTask() {},参数2 ,参数3 )

指的是:通过参数2,参数3 去描述什么时候去做参数1的事情,现在的情况是:10s之后去做参数一的事情

因为锁的失效时间是30s,当10s之后,此时这个timeTask 就触发了,他就去进行续约,把当前这把锁续约成30s,如果操作成功,那么此时就会递归调用自己,再重新设置一个timeTask(),于是再过10s后又再设置一个timerTask,完成不停的续约

那么大家可以想一想,假设我们的线程出现了宕机他还会续约吗?当然不会,因为没有人再去调用renewExpiration这个方法,所以等到时间之后自然就释放了。

private void renewExpiration() {

ExpirationEntry ee = EXPIRATION_RENEWAL_MAP.get(getEntryName());

if (ee == null) {

return;

}

Timeout task = commandExecutor.getConnectionManager().newTimeout(new TimerTask() {

@Override

public void run(Timeout timeout) throws Exception {

ExpirationEntry ent = EXPIRATION_RENEWAL_MAP.get(getEntryName());

if (ent == null) {

return;

}

Long threadId = ent.getFirstThreadId();

if (threadId == null) {

return;

}

RFuture<Boolean> future = renewExpirationAsync(threadId);

future.onComplete((res, e) -> {

if (e != null) {

log.error("Can't update lock " + getName() + " expiration", e);

return;

}

if (res) {

// reschedule itself

renewExpiration();

}

});

}

}, internalLockLeaseTime / 3, TimeUnit.MILLISECONDS);

ee.setTimeout(task);

}

5. 分布式锁-redission锁的MutiLock原理

为了提高redis的可用性,我们会搭建集群或者主从,现在以主从为例

此时我们去写命令,写在主机上, 主机会将数据同步给从机,但是假设在主机还没有来得及把数据写入到从机去的时候,此时主机宕机,哨兵会发现主机宕机,并且选举一个slave变成master,而此时新的master中实际上并没有锁信息,此时锁信息就已经丢掉了。

为了解决这个问题,redission提出来了MutiLock锁,使用这把锁咱们就不使用主从了,每个节点的地位都是一样的, 这把锁加锁的逻辑需要写入到每一个主丛节点上,只有所有的服务器都写入成功,此时才是加锁成功,假设现在某个节点挂了,那么他去获得锁的时候,只要有一个节点拿不到,都不能算是加锁成功,就保证了加锁的可靠性。

那么MutiLock 加锁原理是什么呢?笔者画了一幅图来说明

当我们去设置了多个锁时,redission会将多个锁添加到一个集合中,然后用while循环去不停去尝试拿锁,但是会有一个总共的加锁时间,这个时间是用需要加锁的个数 * 1500ms ,假设有3个锁,那么时间就是4500ms,假设在这4500ms内,所有的锁都加锁成功, 那么此时才算是加锁成功,如果在4500ms有线程加锁失败,则会再次去进行重试.

13 秒杀优化

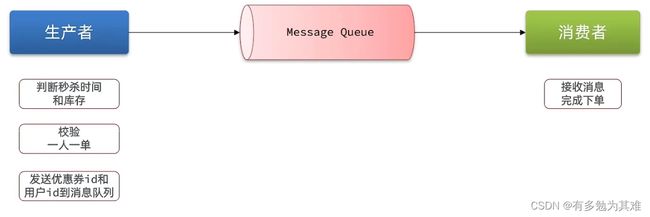

1. 秒杀优化-异步秒杀思路

回顾一下下单流程

当用户发起请求,此时会请求nginx,nginx会访问到tomcat,而tomcat中的程序,会进行串行操作,分成如下几个步骤

1、查询优惠卷

2、判断秒杀库存是否足够

3、查询订单

4、校验是否是一人一单

5、扣减库存

6、创建订单

在这六步操作中,又有很多操作是要去操作数据库的,而且还是一个线程串行执行, 这样就会导致我们的程序执行的很慢,所以我们需要异步程序执行,那么如何加速呢?

在这里笔者想给大家分享一下课程内没有的思路,看看有没有小伙伴这么想,比如,我们可以不可以使用异步编排来做,或者说我开启N多线程,N多个线程,一个线程执行查询优惠卷,一个执行判断扣减库存,一个去创建订单等等,然后再统一做返回,这种做法和课程中有哪种好呢?答案是课程中的好,因为如果你采用我刚说的方式,如果访问的人很多,那么线程池中的线程可能一下子就被消耗完了,而且你使用上述方案,最大的特点在于,你觉得时效性会非常重要,但是你想想是吗?并不是,比如我只要确定他能做这件事,然后我后边慢慢做就可以了,我并不需要他一口气做完这件事,所以我们应当采用的是课程中,类似消息队列的方式来完成我们的需求,而不是使用线程池或者是异步编排的方式来完成这个需求

优化方案:我们将耗时比较短的逻辑判断放入到redis中,比如是否库存足够,比如是否一人一单,这样的操作,只要这种逻辑可以完成,就意味着我们是一定可以下单完成的,我们只需要进行快速的逻辑判断,根本就不用等下单逻辑走完,我们直接给用户返回成功, 再在后台开一个线程,后台线程慢慢的去执行queue里边的消息,这样程序不就超级快了吗?而且也不用担心线程池消耗殆尽的问题,因为这里我们的程序中并没有手动使用任何线程池,当然这里边有两个难点

第一个难点是我们怎么在redis中去快速校验一人一单,还有库存判断

第二个难点是由于我们校验和tomct下单是两个线程,那么我们如何知道到底哪个单他最后是否成功,或者是下单完成,为了完成这件事我们在redis操作完之后,我们会将一些信息返回给前端,同时也会把这些信息丢到异步queue中去,后续操作中,可以通过这个id来查询我们tomcat中的下单逻辑是否完成了。

我们现在来看看整体思路:当用户下单之后,判断库存是否充足只需要导redis中去根据key找对应的value是否大于0即可,如果不充足,则直接结束,如果充足,继续在redis中判断用户是否可以下单,如果set集合中没有这条数据,说明他可以下单,如果set集合中没有这条记录,则将userId和优惠卷存入到redis中,并且返回0,整个过程需要保证是原子性的,我们可以使用lua来操作

当以上判断逻辑走完之后,我们可以判断当前redis中返回的结果是否是0 ,如果是0,则表示可以下单,则将之前说的信息存入到到queue中去,然后返回,然后再来个线程异步的下单,前端可以通过返回的订单id来判断是否下单成功。

2. 秒杀优化-Redis完成秒杀资格判断

需求:

- 新增秒杀优惠券的同时,将优惠券信息保存到Redis中

- 基于Lua脚本,判断秒杀库存、一人一单,决定用户是否抢购成功

- 如果抢购成功,将优惠券id和用户id封装后存入阻塞队列

- 开启线程任务,不断从阻塞队列中获取信息,实现异步下单功能

@Override

@Transactional

public void addSeckillVoucher(Voucher voucher) {

// 保存优惠券

save(voucher);

// 保存秒杀信息

SeckillVoucher seckillVoucher = new SeckillVoucher();

seckillVoucher.setVoucherId(voucher.getId());

seckillVoucher.setStock(voucher.getStock());

seckillVoucher.setBeginTime(voucher.getBeginTime());

seckillVoucher.setEndTime(voucher.getEndTime());

seckillVoucherService.save(seckillVoucher);

// 保存秒杀库存到Redis中

//SECKILL_STOCK_KEY 这个变量定义在RedisConstans中

//private static final String SECKILL_STOCK_KEY ="seckill:stock:"

stringRedisTemplate.opsForValue().set(SECKILL_STOCK_KEY + voucher.getId(), voucher.getStock().toString());

}

完整lua表达式

-- 1.参数列表

-- 1.1.优惠券id

local voucherId = ARGV[1]

-- 1.2.用户id

local userId = ARGV[2]

-- 1.3.订单id

local orderId = ARGV[3]

-- 2.数据key

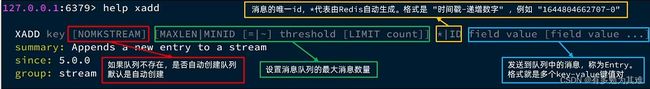

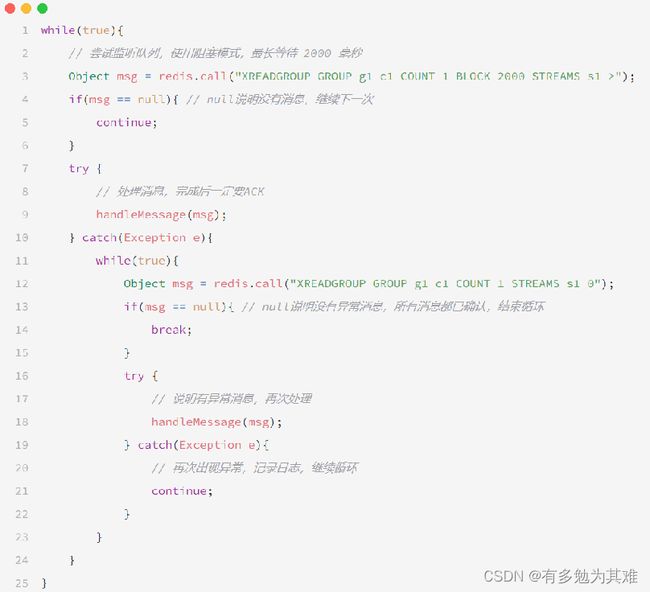

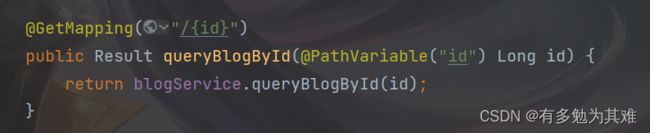

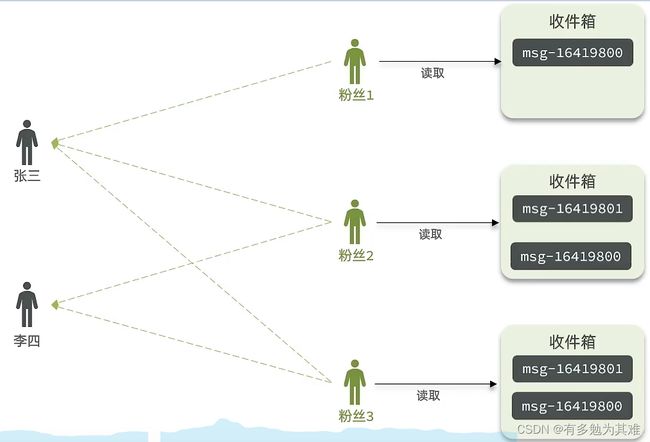

-- 2.1.库存key